Agent智能体应用

本文介绍了基于Coze平台实现零代码开发Agent智能体的方法。主要内容包括:1)提示词设计四大要素(角色定位、技能描述、输出格式、约束条件);2)检索增强技术(RAG)原理及知识库构建流程;3)函数调用(Function Calling)机制与应用;4)工作流设计方法及节点编排。通过跨境电商答疑助手案例,展示了从意图识别到知识库检索的完整工作流实现过程,包括开始节点、意图识别插件、选择器、知识库

文章目录

一、简介

基于Coze的Agent智能体0代码开发

文章将以概念思路理解与实际操作并行的形式展开

相关文件:电商答疑助手案例 链接: https://pan.baidu.com/s/1Fw8Pj0JtAanBnumS_o6drg?pwd=q5wt 提取码: q5wt

· 大模型与Agent的区别?

传统大模型:智慧的头脑

Agent:智慧的大脑 + 四肢

· Coze零代码开发智能体

【 专注于开发Bot(Agent)的平台】

二、提示词(Prompt)——《让Bot听懂人话》

【与AI沟通”说明书“】

1. 四大核心要素

· 角色定位:越具体,越专业

· 技能描述:动作、对象以及目标;避免模糊词汇

· 输出格式:情况分析(50字)、回复建议(3条,每条30字)、 完整范文(150字)

· 约束条件:内容约束、风格约束

2. 提示词分类

系统提示词:大模型定位

用户提示词:用户提问解析

3. 设置方法

自己编写提示词+AI调优

三、检索增强技术(RAG)——《让Bot更专业》

【RAG(Retrieval-Augmented Generation)检索增强技术】

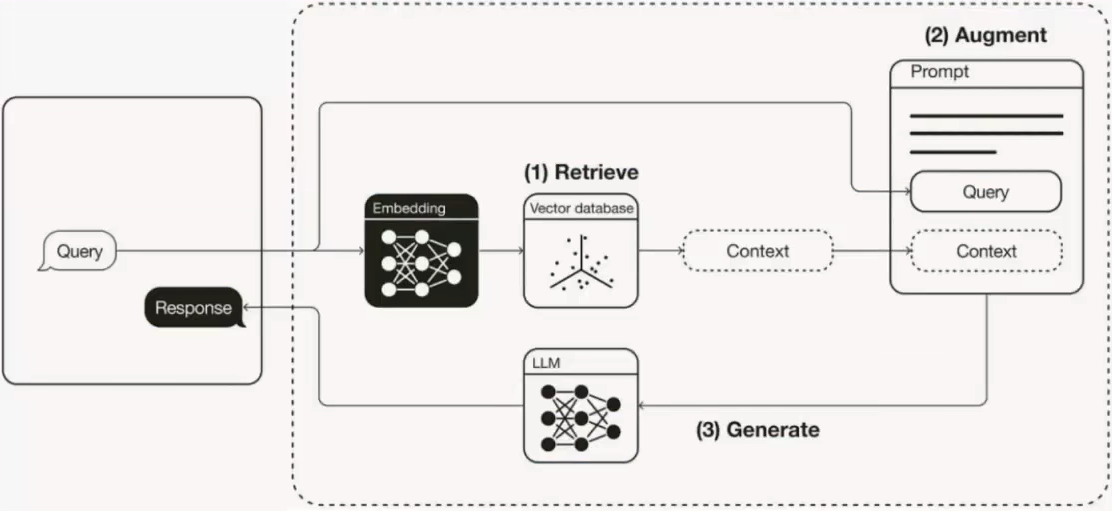

1. 基本原理流程图

1)没有RAG:

直接将用户问题(query)送进大模型(LLM)得到结果。

2)有RAG:

1.将用户问题(query)和知识库(database)做相关性检索,得出和问题相关的上下文(Context); 2.再将query和Context融合拼接,得到一个融合的结果(result); 3.最后将result送入LLM,得到最后的结果。

2.解决问题

RAG解决了传统LLM消息滞后(无法获取最新知识)导致回答问题时乱回答的大模型幻觉问题

3. RAG知识库构建【Coze实践】

· 流程:

1)文档准备

建议:准备markdown文件,便于文档切分

2)文档切分

建议:按照层级分段

3)文档向量化

(服务器会进行自动处理)

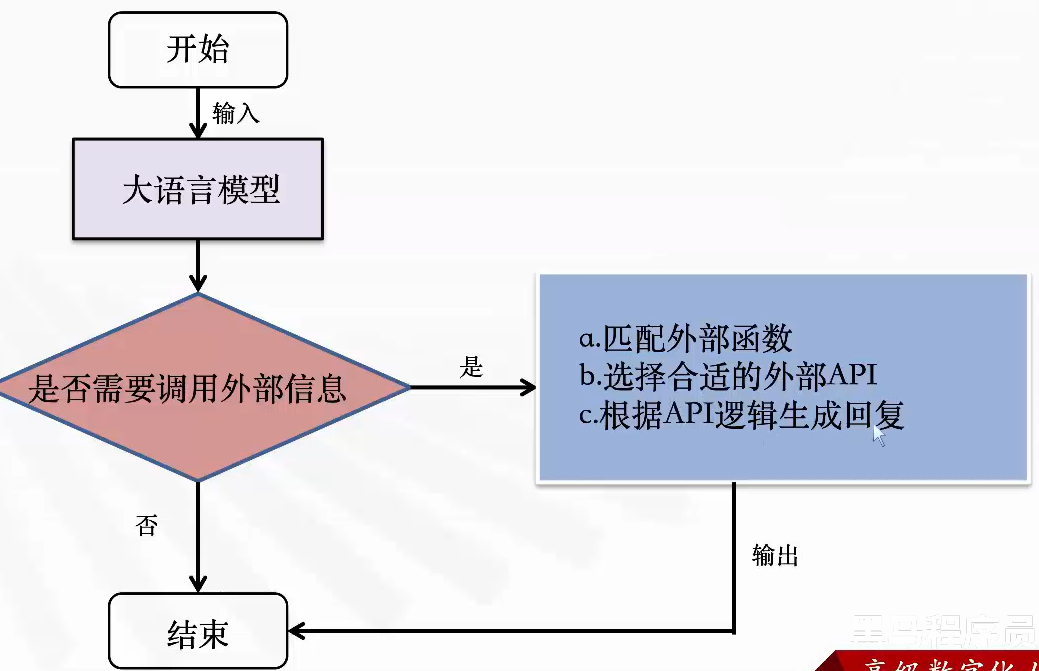

四、函数调用(Function Calling)——《让Bot做事》

1. Function Call应用基本流程图

Function Call: 在语言模型中 集成外部功能 或 API调用 的能力

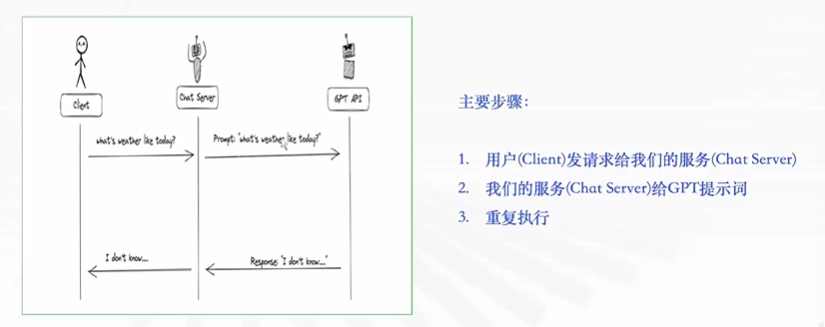

1)没有function-call 时

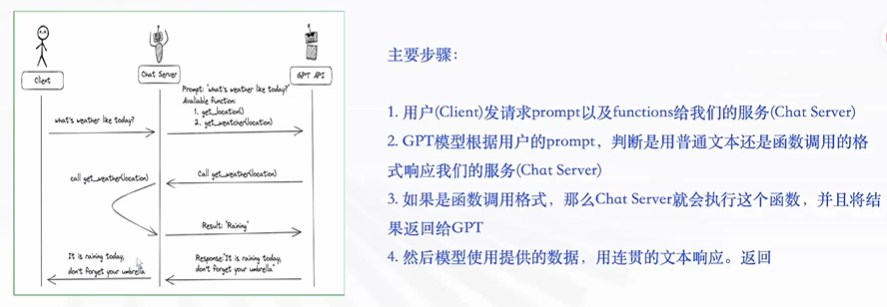

2)有function-call 时

注意:大模型的Fuction call不会调用函数,仅返回函数的参数。开发者利用模型输出的参数在应用中调用函数。

2. Function Calling应用 【Coze实践】

· Function Call: 是一个工具集,每个工具都是一个可调用的 API(API = 程序与程序之间的 “通用接口”,负责互相通信、互相调用功能)。

· 核心机制: 模型通过阅读【工具集描述】来决定是否调用该插件!

· 流程: 创建智能体–》 编排–》添加技能–》 选着插件–》 应用

3. Coze自定义插件应用

1)打开资源库

2)点击插件

3)选择python开发

4)定义输入输出

5)构建代码

6)测试插件

7)发布

8)添加Bot

五、工作流设计与编排——《让Bot做复杂的事》

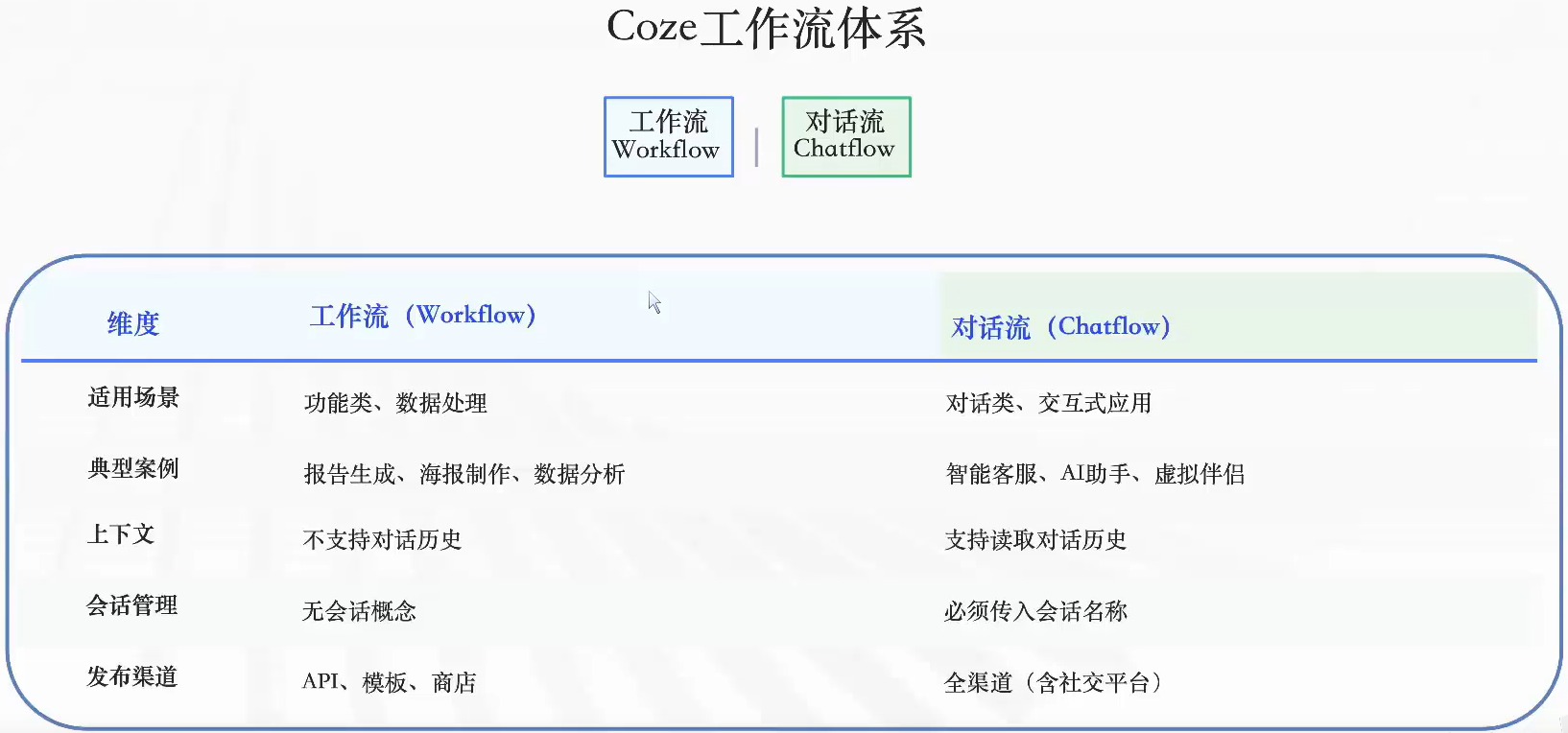

1. 工作流分类

1)工作流

2)对话流

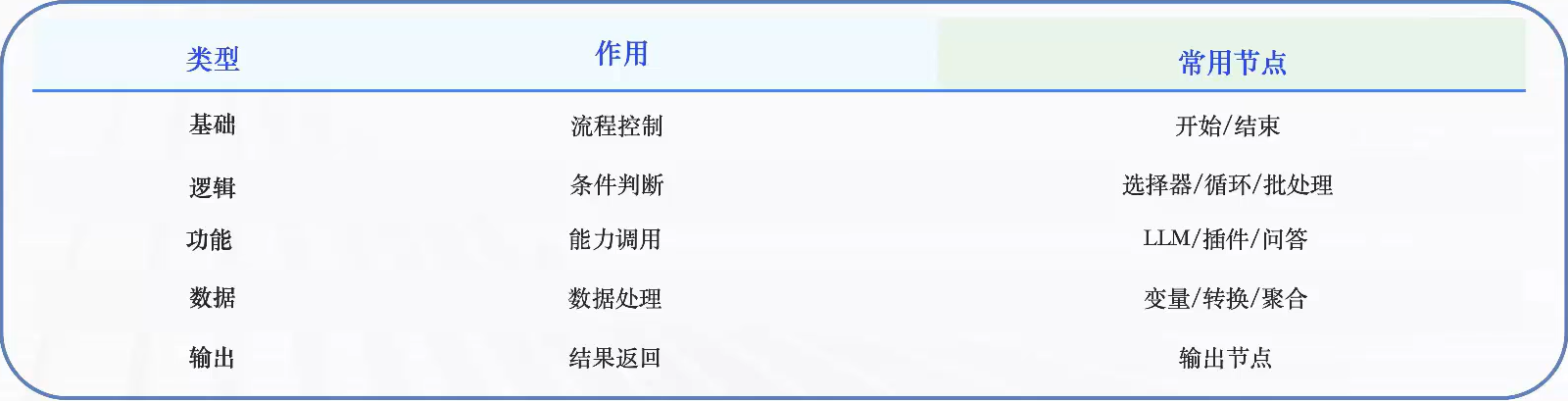

2. 工作流核心—节点

【工作流的核心组件】

每个节点时一个具有特定功能的独立组件,负责处理数据、执行任务

通过将不同功能的节点连接起来,精准地控制数据流向和任务执行顺序,从而实现任何复杂的业态逻辑。

3. 创建工作流的标准流程【Coze实践】

1)创建工作流

操作路径:资源库 → +资源 → 工作流

设置内容:· 工作流名称(清晰明确)· 功能描述(帮助AI理解)

2)编排工作流

操作核心:· 可视化画布添加节点 · 连接节点形成数据流 · 配置节点的输入输出参数

设置内容:开始节点 → LLM节点 → 结束节点

3)测试并发布

测试方法:点击测试 → 输入测试数据 → 检查节点状态

发布流程:· 测试通过后点击发布 · 发布后可使用

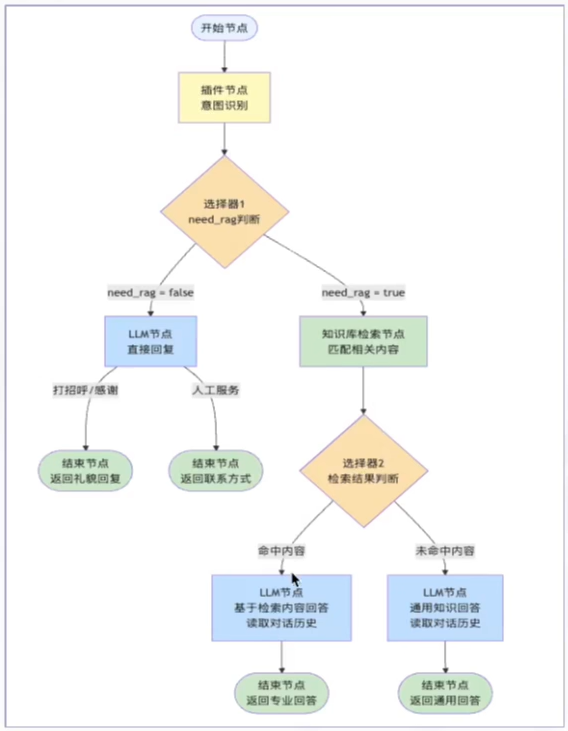

(案例实践:跨境电商答疑助手)工作流编排【Coze实践】

1.设计流程

1)开始节点

作用:接受用户输入的问题(query)

实现:《默认节点》

2)* 意图识别*

作用:判断用户的query是否属于《知识库》范畴

实现:python编写自定义《插件》

3)选择器

作用:获取《意图识别》的结果

实现:添加《选择器》节点

4)* 知识库检索 *

作用:输入用户的query,经过知识库检索,得到和query相关的context,注意:有可能检索出来的结果为空

实现:添加《知识库检索》节点

5)判断是否可以检索出结果

作用:根据检索结果进行判断选择

实现:添加《选择器》节点

1.如果检索出相关的context,那么交由《大模型RAG回答》:基于query和context来让LLM回答问题

2.如果没有检索出相关的context,那么交由《闲聊大模型回答》:直接将query送入LLM回答问题

6)大模型RAG回答

作用:接受用户的query和context,经过大模型得到结果

实现:添加《大模型》节点,注意:需添加大模型系统prompt

7)大模型闲聊回答

作用:接受用户的prompt,直接基于大模型本身回答结果

实现:添加《大模型》节点,注意:需添加大模型系统prompt

2. 核心功能设计

1)智能意图识别:打招呼/感谢、人工服务请求、专业问题等意图分区

2)知识库智能检索:命中相关内容→基于问题回答;未命中相关内容→结合通用知识回答

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)