AI 治理的顿悟时刻:从安全补丁到执行权限,我们终于读懂了治理的本质

如果在执行发生的那一刻,权限的归属依然是模糊的,执行动作可以在没有明确授权的情况下完成,那么你的治理体系,依然只是建议性的,而非强制性的。这一句话,就说透了当前 AI 治理所有问题的核心。现在太多企业的 AI 治理,都是「纸面治理」:他们制定了上百页的 AI 合规政策,明确了「高风险操作必须经过人工审批」「敏感数据访问必须有对应权限」「智能体不能执行越权操作」,但这些规则,从来没有被嵌入到 AI

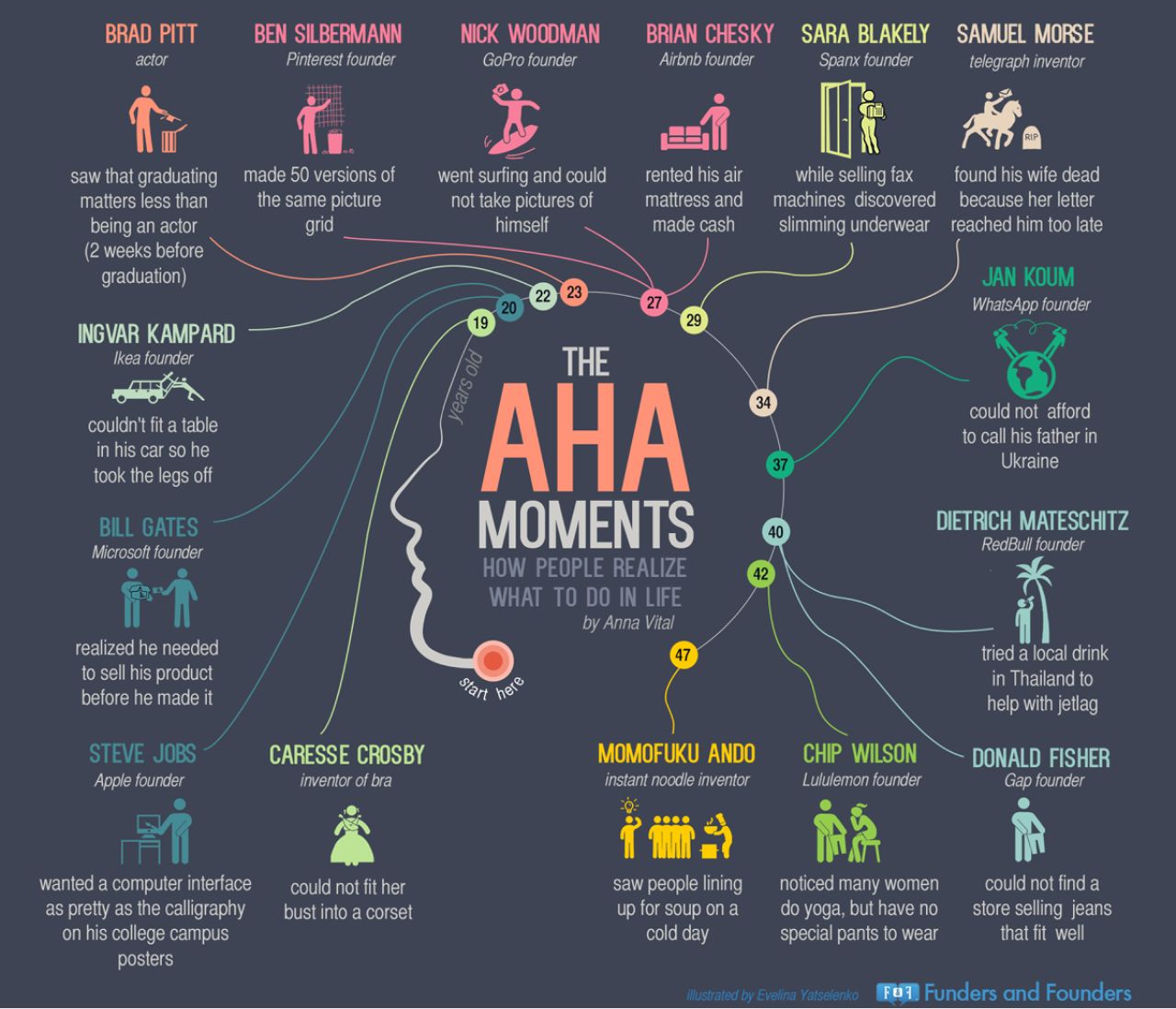

所有改变世界的创新,都始于一个电光火石的「AHA 时刻」。

布拉德・皮特在毕业前 2 周,突然意识到成为演员比拿到毕业证更重要,从此开启了好莱坞传奇生涯;史蒂夫・乔布斯在大学校园里,被海报上的书法美感击中,最终把优雅的字体设计带进了个人电脑,重塑了人机交互的审美;安藤百福在寒冬里看到人们排着长队等一碗热汤,顿悟出方便速食的巨大需求,发明了改变全球饮食的方便面;萨拉・布雷克里在推销传真机时,意外发现了塑身内衣的市场空白,从零打造了市值超 10 亿美元的 Spanx 品牌。

伟大的颠覆,从来都始于一句戳破本质的「原来如此」。

我用整整一周的时间,参与了 30 多场关于 AI 治理未来的深度对话,其中一句话像电流一样击中了我,在此后的四天里,四个核心真相不断在脑海中浮现,彻底重构了我对 AI 治理的认知:

「护栏只是安全补丁,治理的本质是执行权限。」

这句话,戳破了当下整个 AI 行业在治理上的最大误区。我们花了太多精力在「如何让 AI 不说错话」,却始终没搞懂「如何让 AI 不做错事」。我们堆起了层层叠叠的安全补丁,却从来没有搭建起真正的治理体系。

一、护栏不是治理:我们做的大多只是安全补丁,而非真正的治理

当下绝大多数团队对 AI 治理的理解,都停留在「护栏建设」的层面:内容过滤、输出审核、拒绝提示词、敏感词拦截…… 这些措施确实能减少可见的伤害,就像给汽车贴上了防撞条,能在轻微剐蹭时减少掉漆,却无法从根本上避免车祸的发生。

护栏的本质,是「事后拦截」——AI 已经生成了违规内容、已经发起了越权请求,只是在最终输出的环节被拦住了。它没有从底层解决一个核心问题:谁拥有执行的最终权限?干预应该在哪个环节发生?哪些决策在运行时是可强制执行、不可绕过的?

这就是安全补丁与真正治理的核心区别:

- 安全补丁是「你不能这么做」:它靠提示词、过滤规则告诉 AI 什么不能做,但 AI 依然有能力生成、发起违规动作,只是被外围的规则拦住了,永远存在被绕过的可能 —— 提示词注入、角色扮演、逻辑绕过,都能轻松突破绝大多数的护栏。

- 真正的治理是「你根本做不了这件事」:它从系统的底层,定义了 AI 可执行的动作边界,没有权限的操作,在结构上就无法被表达、被执行,连发起的可能都没有,自然不存在被绕过的问题。

举个最现实的例子:很多企业给财务智能体加了「不能执行未经审批的付款操作」的提示词护栏,看起来很安全,但实际上,智能体依然可以生成付款指令,甚至绕过审批流程发起付款,只是在最终付款的环节被人工审核拦住了。而真正的治理,是在智能体的执行底层,就没有「发起付款」这个动作的执行权限,没有对应的授权信封,它连付款指令都无法在系统中定义,更别说执行了。

我们必须清醒地认识到:内容安全、输出审核、提示词护栏,都只是治理的补充环节,而非治理本身。如果你的 AI 治理体系,只停留在堆补丁的阶段,那你本质上只是在「降低违规行为的可见性」,而非「杜绝违规行为的发生」。

二、权限的生效,只在执行的那一刻

这是整个 AI 治理体系中最核心的真相,也是当下绝大多数治理方案失效的根源:权限的定义,不在厚厚的政策文档里,不在公司的汇报层级里,更不在董事会的会议室里,而在决策变成有约束力动作的那个精确瞬间。

如果在执行发生的那一刻,权限的归属依然是模糊的,执行动作可以在没有明确授权的情况下完成,那么你的治理体系,依然只是建议性的,而非强制性的。这一句话,就说透了当前 AI 治理所有问题的核心。

现在太多企业的 AI 治理,都是「纸面治理」:他们制定了上百页的 AI 合规政策,明确了「高风险操作必须经过人工审批」「敏感数据访问必须有对应权限」「智能体不能执行越权操作」,但这些规则,从来没有被嵌入到 AI 的执行路径里。政策写在 PPT 里,规则写在文档里,而 AI 的执行,依然可以自由地绕过这些规则。审批变成了事后的审计环节,权限变成了出事之后的追责依据,而非事前的强制约束。

真正的权限生效,从来不是「写在文档里」,而是「锁在执行中」。就像企业的合同签署体系,不是你在员工手册里写了「只有 CEO 能签署百万级合同」就完事了,而是在签署的那一刻,系统必须强制校验签署人的身份与权限,没有权限,根本无法完成签署动作,连提交的入口都没有。AI 治理的权限逻辑,也是如此:每一个执行动作,在发起的那一刻,必须校验对应的时间绑定授权元组,明确授权人、责任主体、有效期、权限范围,没有有效的授权,执行在结构上就不可能完成。

这也正是 Gartner 给出的判断:到 2030 年,解决「执行时刻权限管控」这个问题的市场规模将达到 10 亿美元。因为整个行业终于意识到,纸面的政策、事后的审计,都无法解决 AI 自主执行带来的风险,只有把权限校验嵌入到执行的每一个瞬间,才能真正实现可管控的 AI 治理。

三、上下文层:既是你的护城河,也是你的爆炸半径

当下所有 AI 团队都在做同一件事:给智能体构建更完整的上下文能力 —— 持久化内存、模块化知识库、实时的邮件与 CRM 系统访问、全量的业务数据权限。

这确实是智能体的核心竞争力所在。没有上下文的智能体,只是一个会说空话的聊天机器人,而有了完整的业务上下文,智能体才能真正理解企业的业务逻辑,完成端到端的工作流,从「顾问」变成「执行者」。这层上下文,就是你的护城河,它让你的 AI 系统真正适配你的业务,形成别人无法复制的竞争壁垒。

但我们必须清醒地认识到:同样是这层上下文,在给智能体完整业务认知的同时,也会在出现问题时,指数级放大伤害的范围。你的护城河,和你的攻击面,是同一个文件,你必须同时按照这两个维度来设计它。

太多团队只看到了上下文层的价值,却忽略了它的风险。他们给智能体开放了全公司的 CRM、财务、供应链、人事系统的访问权限,让智能体可以自由读取、修改所有业务数据,看起来实现了「全链路自动化」,但实际上,这相当于给智能体配了一把全公司的万能钥匙。一旦智能体出现故障、被提示词注入攻击、被恶意诱导,它就能拿到所有的敏感数据,执行全范围的越权操作,造成公司级别的毁灭性灾难。

这就是智能体治理的核心悖论:你给的上下文越完整,智能体的业务能力越强,同时它的风险爆炸半径也越大。正确的设计原则,从来不是「给智能体尽可能多的上下文」,而是「最小权限原则」:智能体需要什么数据,就给什么数据;需要什么范围的权限,就开什么范围的权限,绝对不能给「全量访问权限」。同时,上下文的访问权限,必须和执行权限严格绑定,能访问什么数据,和能执行什么动作,一一对应,从底层避免数据泄露与越权操作的风险。

四、行业的词汇正在收敛,意味着市场正在成型

一个行业从混乱走向成熟的标志,从来不是技术的突破,而是认知的统一。

在过去的几年里,不同的人、不同的行业、不同的公司,对 AI 治理的定义千差万别:有人说 AI 治理是内容安全,有人说是合规审计,有人说是模型对齐,有人说是权限管控。大家说着完全不同的词汇,从完全不同的入口进入这个领域,最终走向完全不同的方向。

但现在,一切都在发生变化。不管是科技公司的 AI 安全团队、金融机构的合规部门、工业企业的自动化团队,还是监管机构的政策制定者,大家都在说着同样的词汇:运行时强制、覆盖设计、否决权、执行权限、撤销而非检测、机器速度级治理。

不同的人,从不同的场景出发,最终都抵达了同一个认知拐点:AI 治理的核心,不是事后的检测与追责,而是事前的执行管控;不是写在文档里的政策,而是运行时的强制权限;不是减少可见的伤害,而是从底层定义 AI 可执行的动作边界。

当一个行业的词汇开始收敛,就意味着这个市场正在找到自己的方向。当所有人都对核心问题达成了共识,标准化的产品、成熟的解决方案、统一的行业规范,都会快速成型。AI 治理这个赛道,正在从混乱的探索期,走向成熟的落地期,它的爆发,已经近在眼前。

最终的顿悟:我们不缺能力,缺的是让能力可落地的执行层

走到这里,我们终于看清了当下 AI 行业的核心现状:我们在 AI 能力上一点都不落后,我们缺的,是让这些能力能够安全、合规地部署到生产环境的强制执行层。

我们有 GPT-4o、Claude 3.7 这样强大的基础大模型,有 CrewAI、LangGraph 这样成熟的智能体框架,有 MCP 这样标准化的工具集成协议,我们能做出能完成端到端业务流程的强大智能体。但我们始终不敢把它们真正部署到核心业务场景中,不敢让它们真正自主执行高风险的业务动作,核心原因,就是我们没有搭建起一套真正可靠的治理体系。

那些把治理做进执行路径里,而不是贴在执行路径旁边的人,才能在潮水退去后依然站着。而其他人,最终只会在会议室里,给法务部门解释,上周二那个智能体到底干了什么。

就像所有伟大的创新都始于一个顿悟时刻,AI 治理这个行业,也终于迎来了它的 AHA 时刻。我们终于明白,治理不是给强大的 AI 能力套上枷锁,而是给它装上可靠的刹车和方向盘,让它能安全地驶向我们想要的目的地。

慢就是稳,稳就是快。做可问责、可管控、可执行的 AI,才是这个行业真正的未来。

更多推荐

已为社区贡献104条内容

已为社区贡献104条内容

所有评论(0)