中文大模型的底层秩序,正在被 OpenCSG 重写

大模型竞争的下半场,是数据结构的竞争。OpenCSG 并没有选择只发布模型,而是在重构中文训练数据的底层逻辑。Fineweb-Chinese 只是这个体系的起点。当数据被工程化、被规模化、被持续迭代,中文大模型的上限将不再依赖封闭资源,而建立在开放且可验证的基础设施之上。这,才是 Fineweb-Chinese 在论文中的真正价值。也是 OpenCSG 正在构建的长期优势。关于OpenCSG从社区

大模型的竞争正在发生转向。

早期比拼的是参数规模和算力储备,而当架构逐渐趋同、训练策略越来越公开之后,真正拉开差距的变量只剩下一个:数据。

在《OpenCSG Chinese Corpus》这篇论文中,Fineweb-Edu-Chinese 并不是一个简单的数据发布,而是被作为完整数据工程体系提出、验证并公开的方法论成果

这篇论文真正重要的意义,不在于“有了一份中文语料”,而在于 OpenCSG 正在为中文大模型建立一套可复现、可规模化、可持续演进的数据底层秩序。

中文数据的问题,从资源不足到质量失序

论文开篇就指出,中文大模型长期受限于高质量预训练语料的稀缺 。但真正的瓶颈并不是绝对数量,而是质量结构。

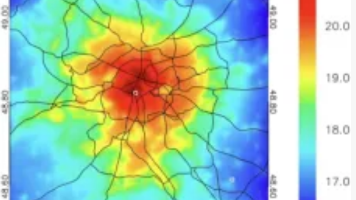

开放中文网页数据天然充满广告、拼接内容与低信息密度文本。论文中给出的评分分布图清楚显示,高质量样本占比极低,大部分语料集中在低评分区间 。如果缺乏系统化精炼机制,模型训练将被噪声稀释。

这不是“数据够不够多”的问题,而是“数据有没有秩序”的问题。

Fineweb-Edu-Chinese 的核心价值,正是在为中文训练数据建立秩序。

从规则清洗到模型评分:OpenCSG 的工程升级

Fineweb-Edu-Chinese 的构建流程并不依赖简单规则,而是建立了可学习的质量评分体系。

论文披露,团队首先使用 Qwen2-7B-Instruct 对采样文本进行 0–5 分教育价值评分 。随后,这些评分样本被用于微调一个 BERT-based 模型,形成规模化过滤器。这意味着数据筛选机制本身具备可训练能力,可以持续优化。

这一步是关键差异。

当多数团队仍停留在启发式清洗阶段时,OpenCSG 已经把数据质量控制转化为模型驱动的工程模块。

在去重环节,论文采用 MinHash 并设置阈值控制文本相似度 ,在减少冗余的同时保持语料多样性。最终形成的 Fineweb-Edu-Chinese v1 包含约 89M 高质量样本,v2 在扩充数据源和升级评分模型后规模进一步扩大 。

这不是简单“做数据”,而是在构建可持续扩展的中文数据底座。

实验证明:数据结构决定能力跃迁

论文最有力的部分在实验验证。

作者从零训练一个 2B 级 Llama 架构模型,对比 Fineweb-Edu-Chinese 与随机数据的训练效果,并在 CEval、CMMLU 等中文权威评测中观察到显著差距 。

更值得注意的是,性能提升呈现阶段性跃迁,而非线性缓慢增长。这意味着高质量数据不仅提高训练效率,更可能改变模型内部知识吸收方式。

当训练语料从“碎片化网页文本”转变为“结构化教育文本”,模型对知识的组织方式随之改变。

这种能力提升,并不依赖更大参数规模,而依赖更高密度的信息输入。

OpenCSG 的布局,不止于 Fineweb

如果只关注 Fineweb-Edu-Chinese,很容易低估这篇论文的战略意义。

论文同时提出 Cosmopedia-Chinese 与 Smoltalk-Chinese,覆盖预训练语料、知识型合成数据与对齐微调数据 。这构成了完整的数据链条:从知识密集预训练,到合成扩展,再到指令对齐优化。

OpenCSG 在做的不是一个数据集,而是一套中文大模型数据基础设施。

当模型架构逐渐标准化,数据工程能力将成为长期竞争优势。谁能建立可复现的高质量数据体系,谁就拥有持续迭代的能力。

中文大模型的话语权,来自底层工程能力

模型参数可以追赶,训练配方可以借鉴,但数据秩序的建立需要时间与体系沉淀。

Fineweb-Chinese 被系统写入论文并通过实验验证 ,意味着中文训练数据第一次以工程化、标准化姿态进入国际视野。

这背后,是 OpenCSG 在定义中文数据精炼标准。

当标准被建立,生态就会围绕标准展开。当生态形成,话语权自然产生。

结语

大模型竞争的下半场,是数据结构的竞争。

OpenCSG 并没有选择只发布模型,而是在重构中文训练数据的底层逻辑。Fineweb-Chinese 只是这个体系的起点。

当数据被工程化、被规模化、被持续迭代,中文大模型的上限将不再依赖封闭资源,而建立在开放且可验证的基础设施之上。

这,才是 Fineweb-Chinese 在论文中的真正价值。

也是 OpenCSG 正在构建的长期优势。

关于OpenCSG

从社区到产业:OpenCSG打造AI模型新基础设施

国产开源生态的推动力不可忽视。以 OpenCSG 社区为代表的国产 AI 社区,正成为大模型时代关键的基础设施提供者与技术创新策源地。OpenCSG作为全球第二大的大模型生态社区,仅次于HuggingFace。

OpenCSG (开放传神)是一个全球领先的开源大模型生态社区,致力于构建开放、协同、可持续的 AI 开发者生态系统。其背后的核心平台 CSGHub提供强大的大模型资产管理能力,为模型训练和部署提供从模型、数据集、代码到 AI 应用的 一站式托管、协作与共享服务。

截至目前,OpenCSG 社区已汇聚超过 20万个高质量开源 AI 模型,覆盖 NLP、CV、语音、多模态等多个核心方向,为研究机构、企业用户和开发者提供了坚实的数据与算力支持。

OpenCSG (开放传神)正在推动形成具有中国特色的 开源大模型生态闭环,不仅赋能科研机构与企业创新,也让中国 AI 开发者在全球模型生态中拥有更多自主性与话语权。

开源数据

依托以 Chinese Fineweb Edu 为核心的数据集矩阵,OpenCSG 开源的数据集已完成从学术研究到产业落地的全链路赋能 —— 既在 NeurIPS、ACL 等顶会顶刊中成为验证中文模型泛化能力的核心数据支撑,也在 Llama3-Chinese 等模型训练及企业级生产场景中发挥关键作用;而其输出的数据治理方法论,更正在让高质量数据构建的门槛持续降低。面向未来,OpenCSG 将继续开放数据资源与技术工具,与全球开发者、科研机构及产业伙伴携手,共同打造更理性、更可持续的中文 AI 数据基础设施,助力中文 NLP 领域迈向更深远的发展阶段。

更多推荐

已为社区贡献149条内容

已为社区贡献149条内容

所有评论(0)