深度学习篇---Instance Normalization(实例归一化)

InstanceNorm(实例归一化)是深度学习中针对风格迁移和图像生成任务的关键技术。它通过对每个样本的每个通道单独进行标准化,有效剥离图像风格信息(如亮度、对比度),保留内容结构特征。与BatchNorm和LayerNorm不同,InstanceNorm不依赖批量统计量,具有样本独立性。核心应用包括:1)风格迁移中配合AdaIN动态调整风格;2)GAN生成器中通过affine参数学习风格特征;

Instance Normalization(实例归一化)

如果说BatchNorm是全班同学的数学成绩对比,LayerNorm是一个学生各科成绩对比,那么InstanceNorm就是只看一个学生的一门课在不同考试中的表现——纯粹的个体独立性!

InstanceNorm是风格迁移、图像生成等任务的"秘密武器",没有它,就没有今天的StyleGAN和各类炫酷的风格转换应用。

一、InstanceNorm是什么?

1.1 最直观的理解

# 伪代码:InstanceNorm的本质

def instance_norm(x):

"""

x: [batch_size, channels, height, width]

"""

# 对每个样本的每个通道单独做标准化

for each_sample in range(batch_size): # 遍历每个样本

for each_channel in range(channels): # 遍历每个通道

# 只对这个通道的像素点计算统计量

channel_data = x[sample, channel, :, :]

mean = channel_data.mean()

std = channel_data.std()

# 标准化这个通道

x[sample, channel, :, :] = (channel_data - mean) / std

# 缩放和平移(可学习参数,每个通道独立)

return γ × x_norm + β生活比喻:

-

BatchNorm:比较全班同学的数学成绩

-

LayerNorm:比较一个同学的各科成绩

-

InstanceNorm:只看一个同学的一次考试,分析这张试卷的难易程度

1.2 数学定义

import torch

import torch.nn as nn

# 手动实现InstanceNorm

def manual_instance_norm(x, eps=1e-5):

"""

x: [batch, channels, height, width]

"""

# 对每个样本、每个通道独立计算

# 在height和width维度上求统计量

mean = x.mean(dim=(2, 3), keepdim=True) # 形状: [batch, channels, 1, 1]

var = x.var(dim=(2, 3), keepdim=True, unbiased=False)

# 标准化

x_norm = (x - mean) / torch.sqrt(var + eps)

# γ和β(可学习参数,每个通道独立)

# 实际使用时,这些参数由网络自动学习

return x_norm

# PyTorch中的InstanceNorm

# 对图像(4D张量)

in_nn = nn.InstanceNorm2d(64) # 64个通道,affine=False时无学习参数

# 带可学习参数的InstanceNorm

in_learnable = nn.InstanceNorm2d(64, affine=True) # 学习γ和β

# 对视频/3D数据(5D张量)

in_3d = nn.InstanceNorm3d(64) # 用于视频、医学图像二、为什么需要InstanceNorm?

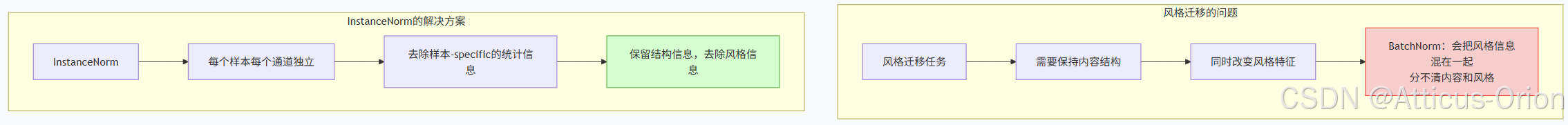

2.1 风格迁移的痛点

2.2 核心动机:去除实例特定的统计信息

def why_instance_norm_needed():

"""

为什么图像生成任务需要InstanceNorm?

"""

# 1. 对比度的归一化

# 一张照片可能很亮,一张可能很暗

# InstanceNorm:移除这种全局亮度差异

# 2. 风格的解耦

# 风格 = 特征的统计信息(均值、方差)

# InstanceNorm:移除这些统计信息,保留结构

# 3. 每个样本独立

# 风格迁移时,每张图要单独处理

# InstanceNorm:完美支持

story = """

想象你有很多画家画的苹果:

- 梵高画的苹果:笔触粗犷,色彩鲜艳

- 莫奈画的苹果:光影柔和,色调朦胧

InstanceNorm就是帮你把"苹果的形状"提取出来,

扔掉"梵高的笔触"和"莫奈的朦胧",

只留下最纯粹的"苹果本身"。

"""

return story三、InstanceNorm添加到网络

3.1 在风格迁移中的标准用法

import torch.nn as nn

import torch.nn.functional as F

class StyleTransferBlock(nn.Module):

"""风格迁移网络的典型块"""

def __init__(self, in_channels, out_channels):

super().__init__()

# 标准模式:Conv -> IN -> ReLU

self.conv = nn.Conv2d(in_channels, out_channels, 3, padding=1)

self.in_norm = nn.InstanceNorm2d(out_channels, affine=True)

# affine=True:学习γ和β,让网络可以恢复某些风格

def forward(self, x):

return F.relu(self.in_norm(self.conv(x)))

# 自适应实例归一化(AdaIN)——风格迁移的核心

class AdaIN(nn.Module):

"""Adaptive Instance Normalization

把内容图的特征,调整成风格图的统计信息

"""

def forward(self, content, style):

# 内容图的均值和方差

content_mean = content.mean(dim=[2, 3], keepdim=True)

content_std = content.std(dim=[2, 3], keepdim=True)

# 风格图的均值和方差

style_mean = style.mean(dim=[2, 3], keepdim=True)

style_std = style.std(dim=[2, 3], keepdim=True)

# 内容图标准化

normalized = (content - content_mean) / content_std

# 用风格图的统计信息去标准化

stylized = normalized * style_std + style_mean

return stylized3.2 在生成对抗网络(GAN)中的应用

class StyleGANBlock(nn.Module):

"""StyleGAN中的风格控制块"""

def __init__(self, channels):

super().__init__()

# StyleGAN的核心:用风格向量控制InstanceNorm

self.in_norm = nn.InstanceNorm2d(channels, affine=False)

# 注意:affine=False,不用可学习参数

# 风格向量会动态生成γ和β

# style_vector -> fc -> (γ, β)

def forward(self, x, style_gamma, style_beta):

# 先用InstanceNorm标准化

x_norm = self.in_norm(x)

# 再用风格向量提供的γ和β去标准化

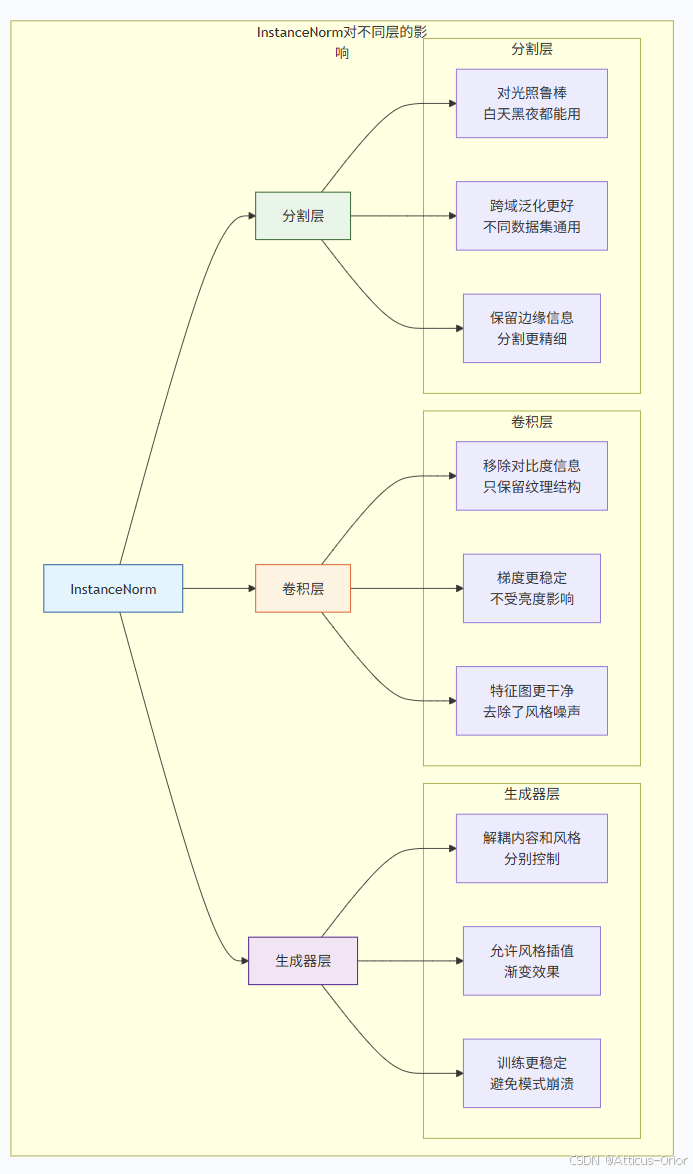

return style_gamma * x_norm + style_beta四、InstanceNorm对层的影响

4.1 对不同层的效果对比

4.2 对特征图的影响

import matplotlib.pyplot as plt

import numpy as np

def visualize_in_effect():

"""可视化InstanceNorm对特征图的影响"""

# 模拟特征图

np.random.seed(42)

# 原始特征图(有亮度差异)

original = np.random.randn(8, 8) * 2 + 3

# 经过InstanceNorm后

mean = original.mean()

std = original.std()

normalized = (original - mean) / std

fig, axes = plt.subplots(1, 3, figsize=(15, 5))

# 原始特征

im1 = axes[0].imshow(original, cmap='viridis')

axes[0].set_title('原始特征\n有亮度差异')

plt.colorbar(im1, ax=axes[0])

# 标准化后

im2 = axes[1].imshow(normalized, cmap='viridis')

axes[1].set_title('IN后\n对比度归一化')

plt.colorbar(im2, ax=axes[1])

# 结构保持

# 计算两种特征的梯度(边缘信息)

grad_orig = np.gradient(original)[0]

grad_norm = np.gradient(normalized)[0]

axes[2].plot(grad_orig.flatten(), label='原始梯度', alpha=0.5)

axes[2].plot(grad_norm.flatten(), label='IN后梯度', alpha=0.5)

axes[2].set_title('梯度(结构信息)保持不变')

axes[2].legend()

plt.tight_layout()

plt.show()

# 结论:IN移除了亮度信息,但保留了结构信息五、InstanceNorm vs 其他Normalization

5.1 归一化维度对比

def compare_all_norms():

"""对比所有归一化方法的维度"""

# 输入:[batch=8, channels=64, height=32, width=32]

x = torch.randn(8, 64, 32, 32)

# 各种归一化的统计量维度

norms = {

'BatchNorm': '统计量形状: [1, 64, 1, 1] (跨batch和空间)',

'LayerNorm': '统计量形状: [8, 1, 32, 32] (跨通道和空间)',

'InstanceNorm': '统计量形状: [8, 64, 1, 1] (只跨空间)',

'GroupNorm': '统计量形状: [8, 32, 1, 1] (组内跨空间)' # 假设32组

}

# 统计量的计算方式

computation = {

'BN': 'mean over (batch, height, width)',

'LN': 'mean over (channels, height, width)',

'IN': 'mean over (height, width)',

'GN': 'mean over (height, width, channels/group)'

}

return norms, computation5.2 详细对比表

| 方面 | BatchNorm | LayerNorm | InstanceNorm | GroupNorm |

|---|---|---|---|---|

| 归一化维度 | batch+空间 | 特征+空间 | 空间 | 组+空间 |

| 统计量范围 | 跨样本 | 样本内跨通道 | 样本内单通道 | 样本内分组 |

| 适用场景 | CV大batch | NLP | 风格迁移 | 小batch CV |

| batch依赖 | 强依赖 | 不依赖 | 不依赖 | 不依赖 |

| 参数量 | 2×C | 2×C | 2×C (affine=True) | 2×C |

| 计算开销 | 最小 | 中等 | 最大 | 中等 |

| 风格迁移 | ❌ 不合适 | ❌ 不合适 | ✅ 完美 | ⚠️ 可用 |

六、InstanceNorm的实战技巧

6.1 参数设置指南

class InstanceNormConfig:

"""InstanceNorm的配置选项"""

def __init__(self):

# 1. 基本配置

self.in_basic = nn.InstanceNorm2d(

num_features=64, # 通道数

eps=1e-5, # 数值稳定常数

momentum=0.1, # 如果track_running_stats=True时用

affine=False, # 是否学习γ和β

track_running_stats=False # 是否跟踪全局统计量

)

# 2. 风格迁移:通常不用affine

self.in_style = nn.InstanceNorm2d(64, affine=False)

# 因为风格由AdaIN动态提供

# 3. 生成器:有时用affine

self.in_generator = nn.InstanceNorm2d(64, affine=True)

# 让网络自己学一些固定的风格偏差

# 4. 视频处理:用3d

self.in_video = nn.InstanceNorm3d(64)6.2 AdaIN(自适应实例归一化)的高级用法

class AdvancedAdaIN:

"""AdaIN的高级应用"""

@staticmethod

def style_interpolate(content, style1, style2, alpha=0.5):

"""风格插值:在两个风格之间平滑过渡"""

# 计算两个风格的统计信息

mean1 = style1.mean(dim=[2, 3], keepdim=True)

std1 = style1.std(dim=[2, 3], keepdim=True)

mean2 = style2.mean(dim=[2, 3], keepdim=True)

std2 = style2.std(dim=[2, 3], keepdim=True)

# 线性插值

mean = (1 - alpha) * mean1 + alpha * mean2

std = (1 - alpha) * std1 + alpha * std2

# 应用插值后的风格

content_mean = content.mean(dim=[2, 3], keepdim=True)

content_std = content.std(dim=[2, 3], keepdim=True)

normalized = (content - content_mean) / content_std

stylized = normalized * std + mean

return stylized

@staticmethod

def spatial_adain(content, style_maps):

"""空间变化的AdaIN(不同区域不同风格)"""

# 为特征图的不同位置应用不同的风格统计量

# 需要更复杂的实现

pass6.3 训练技巧

def in_training_tips():

"""InstanceNorm训练技巧"""

tips = {

'初始化': {

'γ': '初始化为1(affine=True时)',

'β': '初始化为0(affine=True时)'

},

'学习率': {

'建议': '可以和主网络使用相同学习率',

'注意': '如果affine=True,γ和β学习率可以和主网络一致'

},

'梯度': {

'问题': 'IN的梯度计算量大(每个通道独立)',

'解决': '可以用GroupNorm替代,速度更快'

},

'数值稳定': {

'问题': '当特征图很小时(1x1),统计量不稳定',

'解决': '增大eps,或用GroupNorm'

}

}

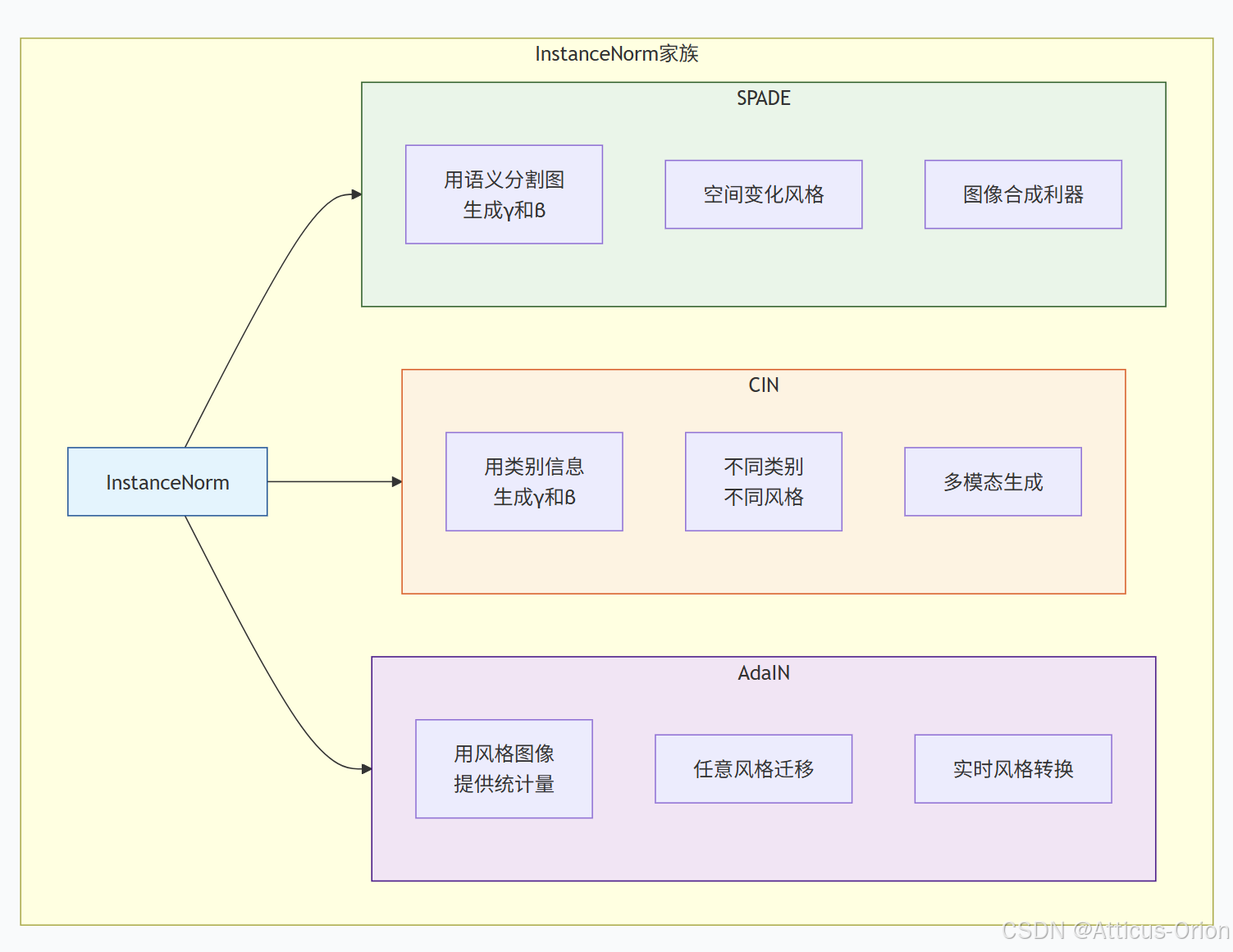

return tips七、InstanceNorm的变种

7.1 SPADE(空间自适应归一化)

class SPADE(nn.Module):

"""SPatially-Adaptive DEnormalization

用于GAN的图像合成,根据语义布局生成图像

"""

def __init__(self, norm_nc, label_nc):

super().__init__()

# 根据语义图生成γ和β(空间变化的)

self.param_free_norm = nn.InstanceNorm2d(norm_nc, affine=False)

# 语义图 -> γ的卷积

self.conv_gamma = nn.Sequential(

nn.Conv2d(label_nc, 128, 3, padding=1),

nn.ReLU(),

nn.Conv2d(128, norm_nc, 3, padding=1)

)

# 语义图 -> β的卷积

self.conv_beta = nn.Sequential(

nn.Conv2d(label_nc, 128, 3, padding=1),

nn.ReLU(),

nn.Conv2d(128, norm_nc, 3, padding=1)

)

def forward(self, x, segmap):

# 先做标准化

normalized = self.param_free_norm(x)

# 根据语义图生成空间变化的γ和β

gamma = self.conv_gamma(segmap)

beta = self.conv_beta(segmap)

# 应用空间变化的风格

return gamma * normalized + beta八、实战应用场景

8.1 风格迁移

class StyleTransferNet(nn.Module):

"""完整的风格迁移网络"""

def __init__(self):

super().__init__()

# 编码器(VGG结构,用InstanceNorm)

self.encoder = nn.Sequential(

ConvBlock(3, 64),

ConvBlock(64, 128),

ConvBlock(128, 256),

ConvBlock(256, 512),

)

# AdaIN模块

self.adain = AdaIN()

# 解码器

self.decoder = nn.Sequential(

DecodeBlock(512, 256),

DecodeBlock(256, 128),

DecodeBlock(128, 64),

nn.Conv2d(64, 3, 3, padding=1),

nn.Tanh()

)

def forward(self, content, style):

# 编码

content_feat = self.encoder(content)

style_feat = self.encoder(style)

# AdaIN风格融合

fused = self.adain(content_feat, style_feat)

# 解码

return self.decoder(fused)

class ConvBlock(nn.Module):

def __init__(self, in_c, out_c):

super().__init__()

self.conv = nn.Conv2d(in_c, out_c, 3, padding=1)

self.norm = nn.InstanceNorm2d(out_c, affine=False)

self.relu = nn.ReLU()

def forward(self, x):

return self.relu(self.norm(self.conv(x)))8.2 图像生成

class GeneratorWithIN(nn.Module):

"""使用InstanceNorm的生成器"""

def __init__(self, latent_dim=100):

super().__init__()

# 初始层(没有IN)

self.init = nn.Sequential(

nn.ConvTranspose2d(latent_dim, 512, 4, 1, 0),

nn.ReLU()

)

# 中间层(有IN)

self.mid = nn.Sequential(

GBlock(512, 256), # 内部有IN

GBlock(256, 128),

GBlock(128, 64),

)

# 输出层

self.final = nn.Sequential(

nn.ConvTranspose2d(64, 3, 4, 2, 1),

nn.Tanh()

)

def forward(self, z):

x = self.init(z.unsqueeze(-1).unsqueeze(-1))

x = self.mid(x)

return self.final(x)

class GBlock(nn.Module):

def __init__(self, in_c, out_c):

super().__init__()

self.conv = nn.ConvTranspose2d(in_c, out_c, 4, 2, 1)

self.norm = nn.InstanceNorm2d(out_c, affine=True) # 生成器用affine

self.relu = nn.ReLU()

def forward(self, x):

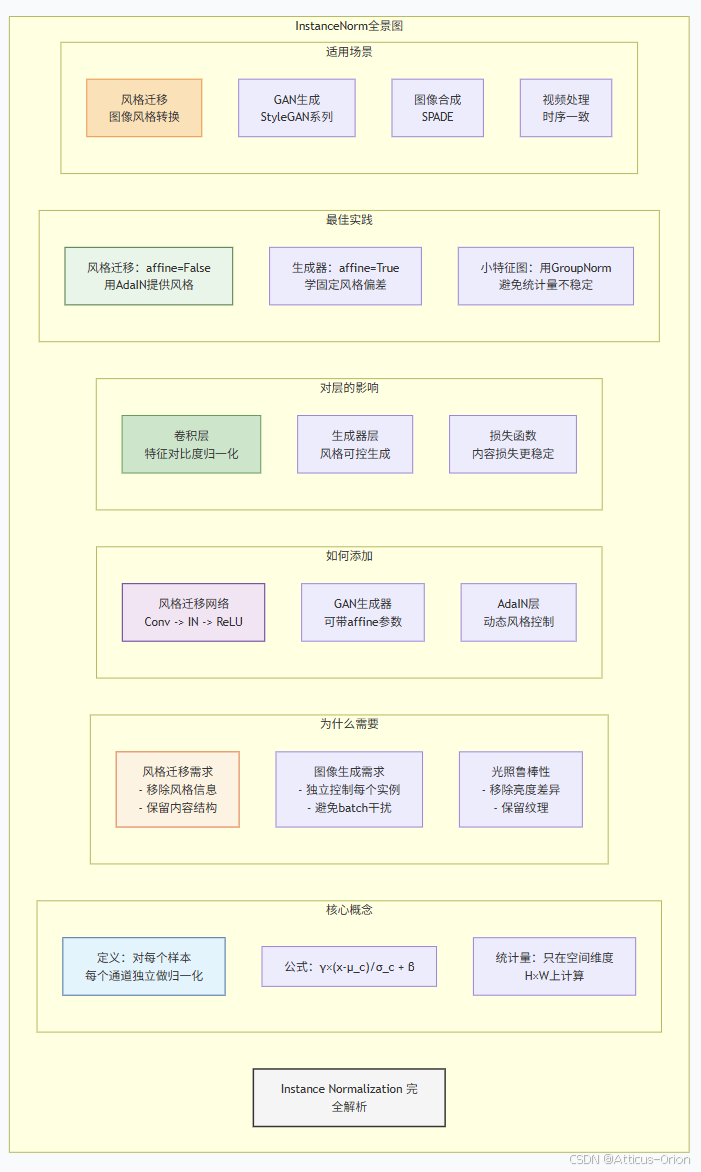

return self.relu(self.norm(self.conv(x)))九、InstanceNorm总结全景图

十、终极总结

InstanceNorm是什么?

-

对每个样本、每个通道独立做归一化的技术

-

风格迁移和图像生成的"魔法棒"

它解决了什么问题?

-

移除图像的全局风格信息(亮度、对比度等)

-

让网络专注于学习内容结构

-

实现内容和风格的完美解耦

它给网络带来了什么?

-

对生成器:精细的风格控制能力

-

对判别器:更好的特征提取

-

对损失函数:更稳定的训练过程

一句话记住InstanceNorm:

不管你是梵高还是莫奈,我只关心你画的是什么——把风格剥离,只留内容!

使用口诀:

-

风格迁移用InstanceNorm,affine=False配合AdaIN

-

GAN生成用InstanceNorm,affine=True学风格

-

特征图太小要小心,GroupNorm来替代

-

空间风格用SPADE,语义布局来调控

更多推荐

已为社区贡献87条内容

已为社区贡献87条内容

所有评论(0)