HX 370上使用 NPU 加速 LLM 实践

在 HX 370 上使用 NPU 加速 LLM 实践

📖 背景

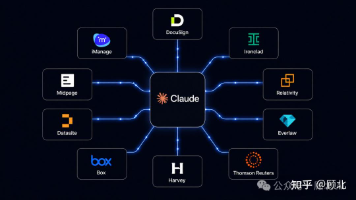

AMD Ryzen AI 300 系列处理器(如 HX 370)集成了强大的 XDNA 2 架构 NPU,可提供高达 50 TOPS 的算力,专为低功耗、高效率的 AI 推理任务设计。然而,主流推理框架目前对 NPU 的支持尚不完善,主要依赖 GPU(Radeon 890M)进行加速。笔者半年前购置了这个满配96G DDR5的AI小主机,NPU一直闲置,令人遗憾。之前看到有个框架软件和AMD合作,貌似有专用的GUI工具推出,都有了专门的./amd链接。 结果不是推出,我觉得是退出,一直就没有任何能支持NPU的版本。马年春节闲着瞎看,发现了这个迟到的好工具💡Lemonade Server。这是极少数原生支持 AMD NPU 的推理服务工具之一,通过 ONNX Runtime 调用 NPU,实现真正意义上的“AI 加速”。

本文介绍了笔者在Ryzen AI HX370小主机上使用NPU加速运行LLM的主要过程,分享给选用这类主机的朋友们。个人经验,欢迎批评交流。

一✅ 准备工作

1. 系统环境

- 操作系统:Windows 11

- 硬件:搭载 AMD Ryzen AI 300 系列处理器(如 HX 370)的设备

- 驱动:确保已安装最新 AMD 官方驱动(包含 NPU 驱动),可通过 AMD 官网 获取

- 内存:推荐 32GB 以上,如果是 96GB……那恭喜你,可以彻底告别内存焦虑了 😎

2. 安装 Lemonade Server

Lemonade Server 提供两种安装方式:

方式一:GUI 安装包(推荐新手)

- 访问 Lemonade Server 官方发布页(或官方指引)

- 下载 Windows 一键安装包(

.exe),双击按提示完成安装

方式二:pip 安装(开发者)

应该先好一个venv环境,我这就略掉了。

pip install lemonade-server

若网络较慢,可使用国内镜像源,如:

pip install lemonade-server -i https://pypi.tuna.tsinghua.edu.cn/simple

安装完成后,可通过桌面快捷方式或命令行启动服务。托盘中会有小柠檬的程序图标。

二⚙️ 为 NPU 配置“Turbo 模式”

AMD 官方建议在运行 NPU 推理前开启 Turbo 模式以释放最佳性能。步骤如下:

- 以管理员身份打开 命令提示符(CMD) 或 PowerShell。

- 依次执行:

cd C:\Windows\System32\AMD .\xrt-smi configure --pmode turbo该命令将 NPU 设为最高性能模式,无需重启。

三 🧠 选择适合 NPU 的模型

NPU 无法直接运行 GGUF 格式模型,必须使用针对 AMD XDNA 架构优化的 ONNX 格式模型(通常命名包含 onnx、hybrid、ryzenai 等关键词)。常见的可用模型(HX 370 实测支持)有且不只有:

| 模型名称 | 参数规模 | 特点 |

|---|---|---|

Llama-3.1-8B-Instruct-awq-asym-uint4-g128-lmhead-onnx-hybrid |

8B | Meta Llama 3.1 官方优化版,综合能力强 |

Qwen3-14b-onnx-ryzenai-1.7-hybrid |

14B | 通义千问 Qwen3,中文表现优秀 |

DeepSeek-R1-Distill-Qwen-7B-onnx-ryzenai-hybrid |

7B | 推理能力特化,适合逻辑、数学、代码任务 |

Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybrid |

8B | Qwen3 的 Ryzen AI 优化版,平衡性能与资源 |

更多模型可在 Hugging Face 或 HFree Mirror 混合模型搜索关键词

onnx hybrid ryzenai获取,NPU专用模型用onnx npu ryzenai搜索就好 。

📥 国内下载模型的小提示

Hugging Face + 镜像加速(保留原习惯)

可以使用 Hugging Face,通过配置镜像站实现高速下载。但请注意:Lemonade 本身不读取 HF_ENDPOINT 环境变量,下载模型仍需通过其他工具手动下载到指定目录。

推荐方法:使用 huggingface-cli 配合镜像

- 安装

huggingface-hub工具:pip install huggingface-hub -i https://pypi.tuna.tsinghua.edu.cn/simple - 设置镜像并下载模型(以 Qwen3-8B 为例):

这样下载的模型包含所有必需文件(包括set HF_ENDPOINT=https://hf-mirror.com huggingface-cli download amd/Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybridgenai_config.json)。

huggingface-cli的后期版本命令格式变成了简单的 hf, 特别简单。

四 🧩 高级配置:让 Lemonade 自动识别模型

1. 了解 Lemonade 的模型存储机制

根据 官方文档:

- Lemonade 默认使用 Hugging Face 缓存目录:

~/.cache/huggingface/hub/ - 目录命名规则:

models--{org}--{model_name}(例如models--amd--Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybrid) - 可以通过设置环境变量

HF_HOME或HF_HUB_CACHE来改变缓存位置。

2. 设置缓存目录到你的大容量硬盘

- 在系统环境变量中新建:

- 变量名:

HF_HOME - 变量值:

D:\HuggingFaceCache(或你喜欢的路径)

- 变量名:

- 重启终端使环境变量生效。

3. 用 huggingface-cli 下载模型到缓存目录

set HF_ENDPOINT=https://hf-mirror.com

huggingface-cli download amd/Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybrid --local-dir %HF_HOME%\hub\models--amd--Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybrid

下载完成后,模型文件会出现在正确的缓存目录中。

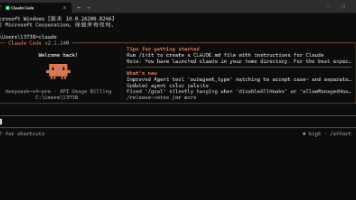

4. 启动 Lemonade Server

lemonade-server

Lemonade 启动时会自动扫描 Hugging Face 缓存目录,新下载的模型会直接出现在 Web UI 的模型列表中(无需手动添加)!这是最省心、最符合官方设计的方式。

五🚀 在 Lemonade Server 中加载模型并验证

1. 启动 Lemonade Server

- 若使用 GUI 安装包,双击桌面快捷方式即可启动服务。

- 若使用 pip 安装,在终端运行:

默认服务地址为lemonade servehttp://localhost:8000,打开浏览器进入 Web 界面可以管理模型加载,测试对话等。

2. 加载下载的模型

通过 Web UI(自动发现的模型)

-

在浏览器中打开

http://localhost:8000 -

-

左侧模型列表中应该已经出现你下载的模型(如

amd/Qwen3-8B-awq-quant-onnx-ryzenai-1.7-hybrid) -

选中该模型,在聊天框输入消息,点击发送。

3. 验证 NPU 是否工作

方法一:Windows 任务管理器

- 在运行推理时(例如发送一条聊天消息),打开任务管理器 → 性能 标签页

- 查看 NPU 核心的使用率图表是否有波动

- 这图是混合模型运行时的情况

- 这张是NPU模型运行时情况:

注意:在 Hybrid 模式下,NPU 主要负责处理输入提示(Prompt),GPU 负责生成回复(Token),因此短提示下 NPU 占用可能一闪而过,属正常现象。

Lemonade Server 默认启用 Hybrid 模式,NPU 处理提示,GPU 生成 token。无需额外配置。

方法二:查看 Lemonade 统计信息

访问 http://localhost:8000/api/v1/stats,可查看当前推理的 token 速度等性能数据。

📚 参考资料

🎉 结语

至此,你已成功在 HX 370 上通过 NPU 运行大语言模型!相比 GPU 推理,NPU 的功耗更低、后台运行更安静,特别适合需要长时间运行的 AI 任务(如会议转录、实时翻译、个人助手)。

呵呵,不要以为我只有古旧的老机器可玩, 我们也是有新款好玩具 96GDDR5、AI HX370 可玩的。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)