OpenClaw + Ollama 在 Windows 环境下的完整安装指南

本文提供Windows系统下OpenClaw与Ollama的完整安装指南,重点优化Intel核显GPU加速方案。主要内容包括:1) 前期Git和Node.js环境准备;2) Ollama客户端安装;3) OpenClaw的两种安装方法;4) 服务启动与模型连接配置;5) 针对Intel UHD核显的特殊优化方案,包含驱动更新、专用版Ollama下载及环境变量设置。文档详细说明了每个步骤的操作命令和

Windows + Ollama 安装 OpenClaw 完整指南(含 Intel 核显优化)

本文档基于原始安装说明进行格式整理、细节补充与逻辑优化,适用于 Windows 系统用户部署 OpenClaw 并通过 Ollama 调用本地大模型。特别包含针对 Intel UHD 核显(如 UHD 770) 的 GPU 加速配置方案。

一、前期环境准备

1. 安装 Git

以 管理员身份 打开 PowerShell,执行以下命令安装 Git:

winget install git.git

💡 若提示执行策略错误,请先运行以下命令解除限制:

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser Set-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass

你也可以前往 Git 官网 下载安装包手动安装。

2. 检查并安装 Node.js

在 PowerShell 中运行以下命令,确认 Node.js 版本:

node --version

- ✅ 要求版本 ≥ 18.0.0

- ❌ 若未安装或版本过低,请前往 Node.js 官网 下载 LTS 版本 并安装。

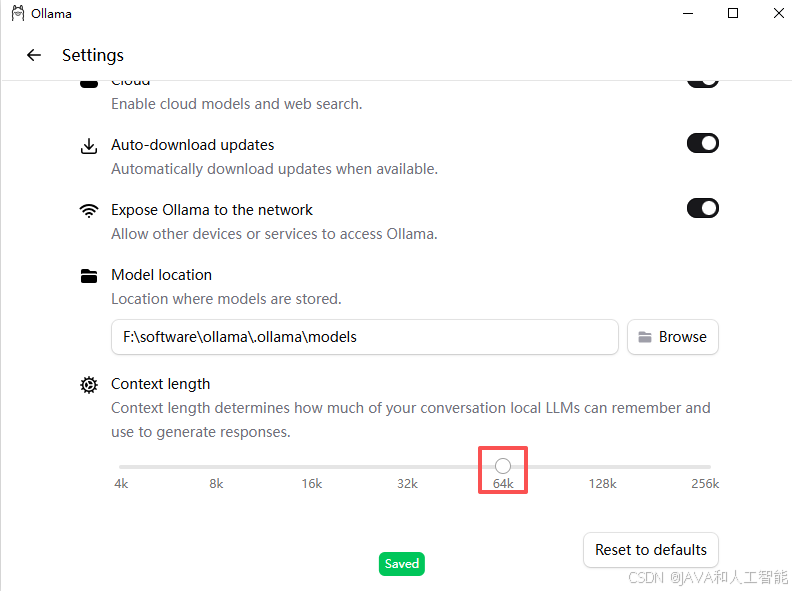

二、安装最新版 Ollama 客户端

前往官方下载页面安装 Ollama:

⚠️ 注意:如果你使用的是 Intel 核显(如 UHD 770),请不要使用标准版 Ollama,而应使用 Intel 优化版(详见第六部分)。

三、安装 OpenClaw

方法 3.1:极简一键安装(可能因网络问题失败)

在 PowerShell(管理员)中运行:

iwr -useb https://openclaw.ai/install.ps1 | iex

🌐 此方法依赖境外资源,国内用户常因网络波动失败。

方法 3.2:手动通过 npm 全局安装(推荐)

此方法可查看详细日志,便于排查问题。

步骤如下:

-

设置 npm 镜像源(加速)

npm config set registry https://registry.npmmirror.com -

全局安装 OpenClaw

npm install -g openclaw@latest -

验证安装是否成功

openclaw --version若返回版本号(如

3.1.x),则安装成功。

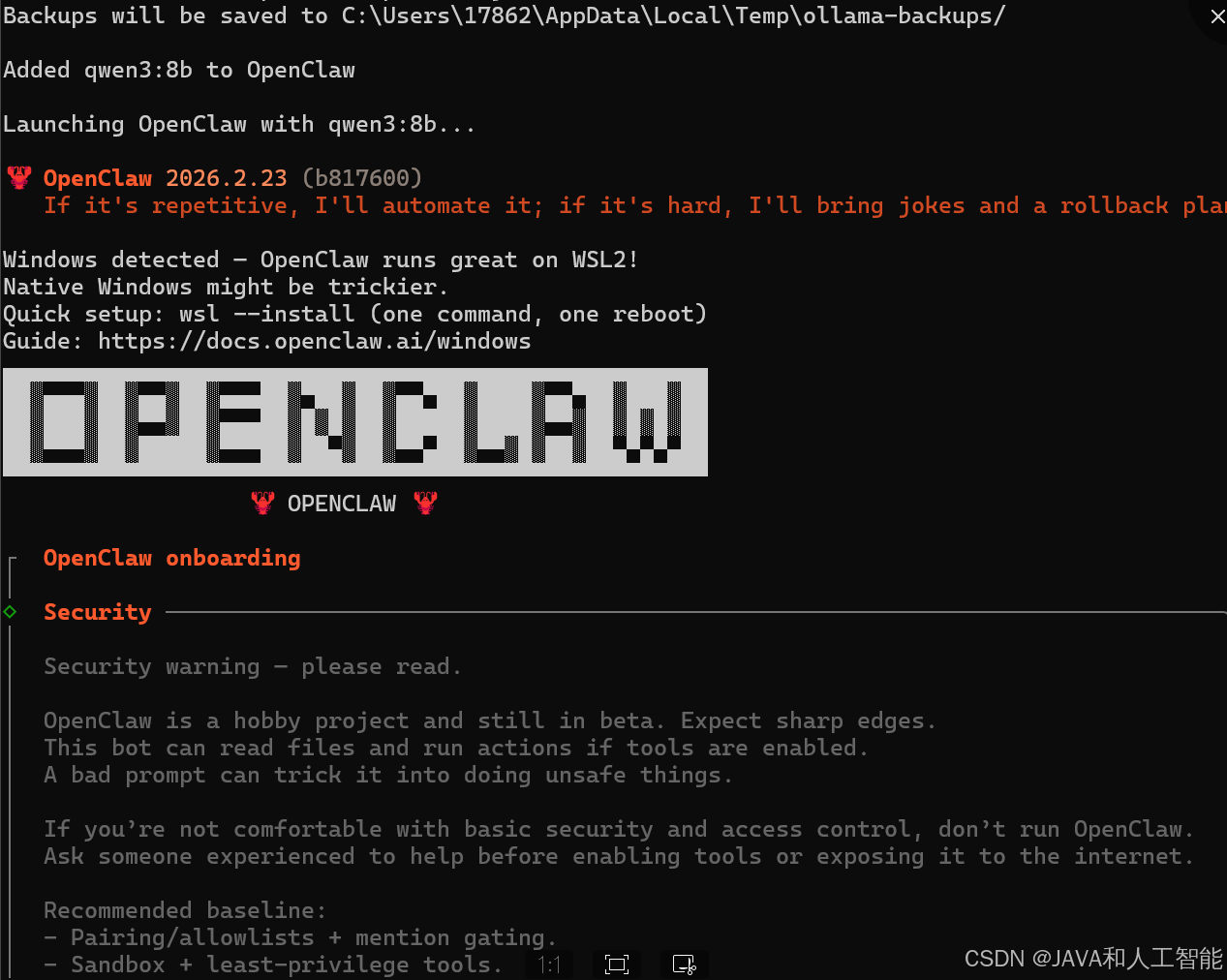

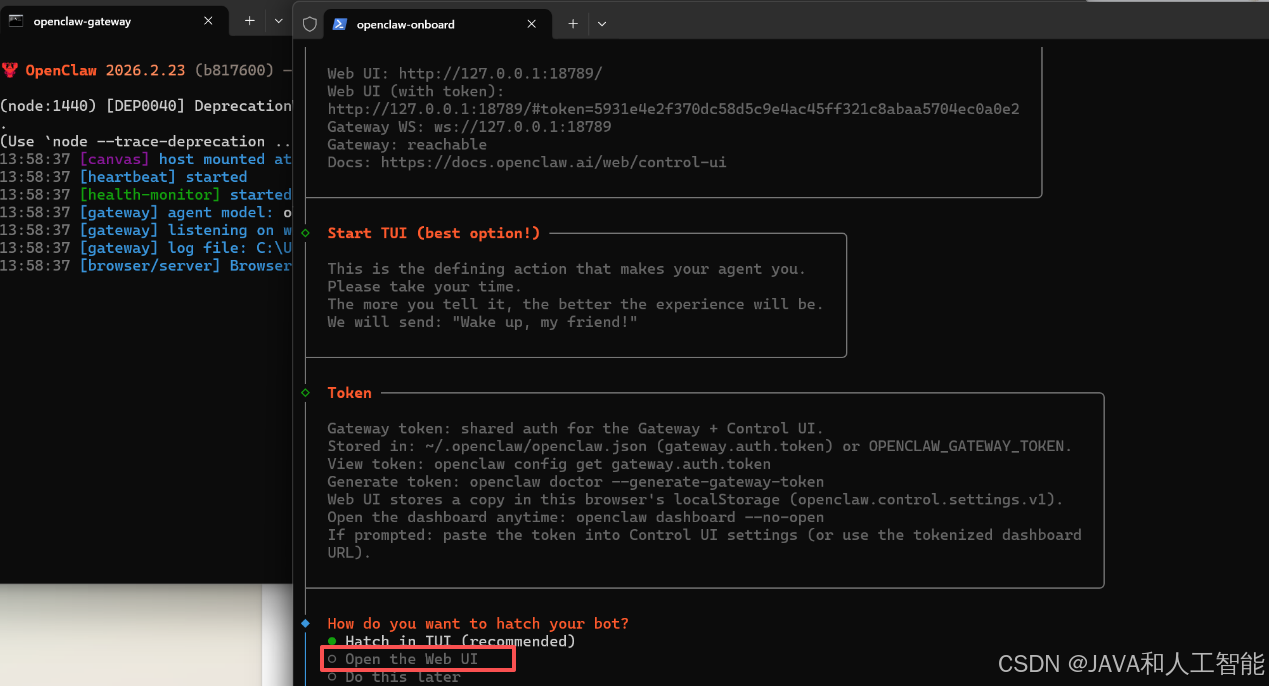

四、启动 OpenClaw 并连接 Ollama

4.1 启动命令

ollama launch openclaw

⚠️ 若启动失败,常见原因包括:

- Node.js 版本不兼容(建议 ≥18)

- Ollama 服务未运行

- 模型未下载或路径错误

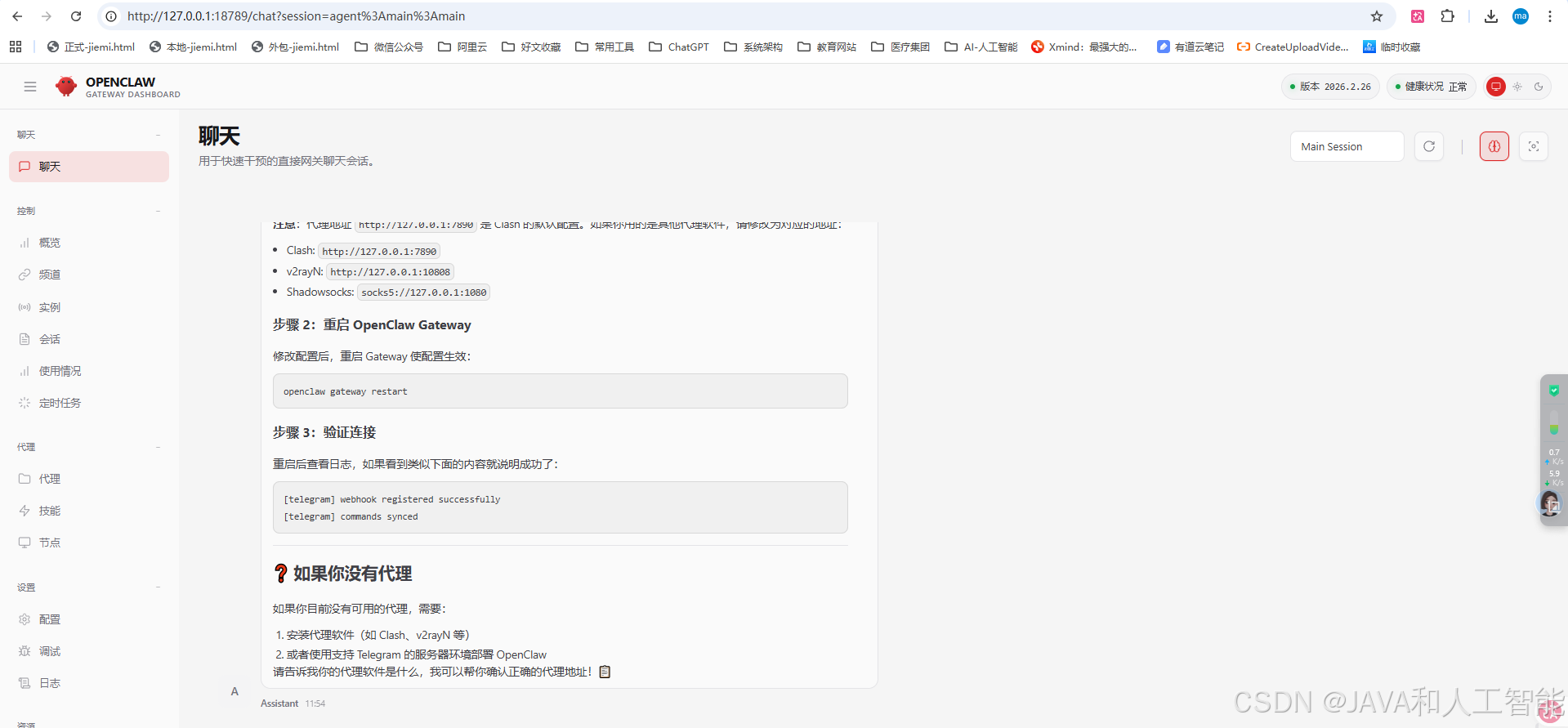

你这里看到我能够流畅的对话,完全基于你的电脑是不是可以运行起来你的大模型,在对话过程中,是相当吃GPU的,你的GPU如何无法支撑起来,模型越大,越好用,低级的模型,可能无法理解你的对话,无法操作你的电脑。

如果实在无法忍受,直接对接Qwen模型即可,每天有免费的Token,可以对话几次感受一下

4.2 关闭内存搜索(避免阻塞)

OpenClaw 默认启用内存搜索,可能导致响应卡顿。建议关闭:

openclaw config set agents.defaults.memorySearch.enabled false

4.3 重启 Gateway 服务

openclaw gateway restart

💡 Windows 重启后,需手动以管理员身份运行:

openclaw gateway

4.4 切换模型(示例)

-

停止当前网关:

openclaw gateway stop # 或强制结束进程(替换为实际 PID) taskkill /F /PID 13372 -

启动新模型(会打开配置界面):

ollama launch openclaw --config -

重启服务:

openclaw gateway restart

五、卸载 OpenClaw

如需彻底卸载:

openclaw gateway stop

npm uninstall -g openclaw

openclaw --version # 应提示“command not found”

openclaw dashboard --no-open # 可用于清理残留(如有)

六、特殊情况:Intel 核显(UHD 770 等)GPU 加速配置

适用于搭载 Intel 第 12/13/14 代 CPU + UHD 核显 的设备。

6.1 更新显卡驱动

前往 Intel 驱动下载中心,下载并安装 最新版显卡驱动。

6.2 下载 Intel 优化版 Ollama

- 下载地址:ModelScope - Intel/Ollama

- 选择

win后缀的 ZIP 压缩包(如ollama-win-intel.zip)

解压到 D 盘(建议):

- 程序目录:

D:\ollama-intel - 模型目录:

D:\ollama_models(提前创建)

操作步骤:

- 下载 ZIP 文件(通常位于

C:\Users\<用户名>\Downloads) - 右键 → “解压到…” → 目标路径设为

D:\ollama-intel

6.3 设置环境变量(关键!)

让 Ollama 将模型存储到 D 盘,避免 C 盘爆满。

- Win + S 搜索 “查看高级系统设置” → 打开

- 点击 “环境变量”

- 在 系统变量 区域点击 “新建”

- 变量名:

OLLAMA_MODELS - 变量值:

D:\ollama_models

- 变量名:

- 点击“确定”保存

✅ 此设置永久生效,所有后续模型将自动存入该目录。

6.4 启动 Intel 优化版 Ollama 服务

-

按

Win + R,输入cmd回车 -

进入程序目录:

cd /d D:\ollama-intel -

启动服务:

start-ollama.bat

🖥️ 此时会弹出一个黑色命令行窗口——请勿关闭,这是 Ollama 后台服务。

6.5 下载并运行支持核显的模型(验证 GPU 加速)

-

再次打开一个新的 CMD 窗口(保留上一个服务窗口)

-

进入目录:

cd /d D:\ollama-intel -

运行轻量模型(推荐 Qwen3 4B):

ollama run qwen3:4b

📦 首次运行将自动下载模型(约 4.7GB),请耐心等待。

- 验证 GPU 是否工作:

- 按

Ctrl + Shift + Esc打开任务管理器 - 切换到 “性能” → “GPU”

- 观察 Compute 或 3D 利用率

- 当你在对话中提问时,若利用率明显上升 → GPU 加速已生效!

- 按

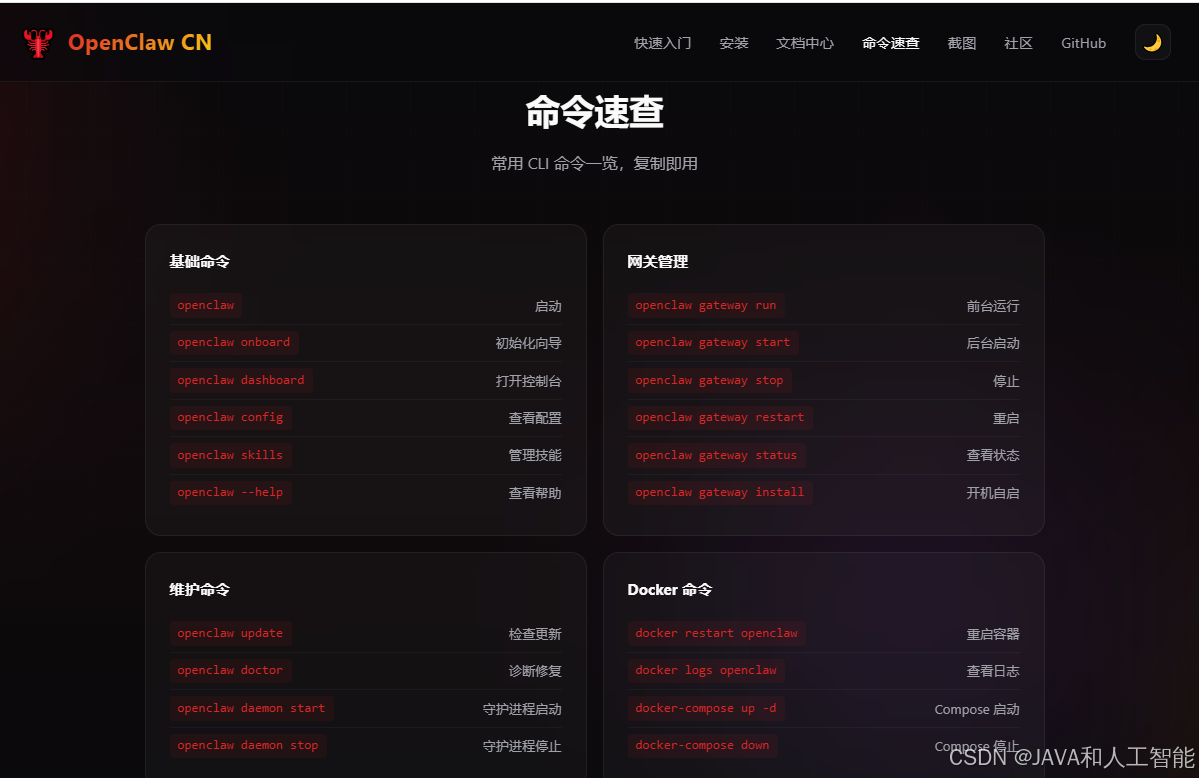

附录:常用命令速查

| 功能 | 命令 |

|---|---|

| 查看 OpenClaw 版本 | openclaw --version |

| 启动网关 | openclaw gateway |

| 重启网关 | openclaw gateway restart |

| 停止网关 | openclaw gateway stop |

| 关闭内存搜索 | openclaw config set agents.defaults.memorySearch.enabled false |

| 强制结束进程 | taskkill /F /PID <进程ID> |

| 启动指引 | openclaw onboard |

| 切换模型 | ollama launch openclaw --config |

| 更新配置 | openclaw configure |

✅ 完成以上步骤后,你已成功在 Windows 上部署 OpenClaw + Ollama,并针对 Intel 核显完成 GPU 加速优化,可流畅运行 4B~7B 级别本地大模型。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)