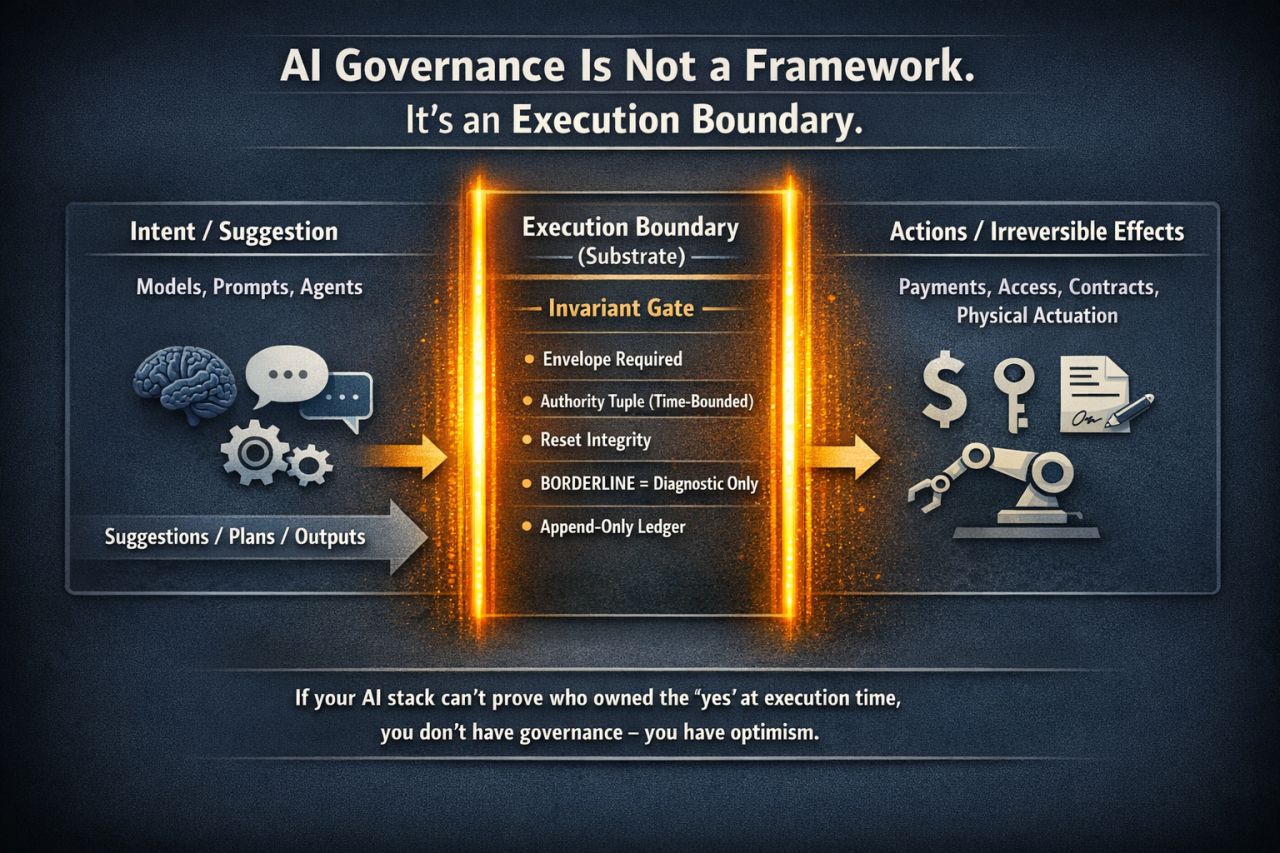

AI 治理不是纸面框架,是不可逾越的执行边界

AI治理的核心在于将安全机制嵌入系统底层而非事后审计。当前企业普遍采用"纸面框架+人工审核"模式,无法阻止AI执行时的越权行为。真正的治理应构建"执行基底"——通过六大机制(授权信封、时间绑定授权元组、重置完整性等)确保未授权操作在数学和结构上无法表达。这种"基底治理"模式将安全边界直接写入系统底层,取代传统的外围校验机制,从根源上杜绝A

AI governance isn’t a framework. It’s an execution substrate.

当生成式 AI、自主智能体开始深度渗透金融支付、工业控制、合同签署、权限管理等核心业务场景,行业正在面临一个致命的认知误区:绝大多数企业的 AI 治理,依然停留在 “纸面框架 + 事后审计” 的阶段。

我们见过太多这样的 “AI 治理方案”:厚厚的合规政策文档、流程繁琐的人工审核规则、花里胡哨的监控仪表盘、TB 级别的执行日志。这些东西听起来很完备,看起来尽在掌控,却始终无法回答 AI 治理唯一核心的问题:当 AI 真正执行一个动作的那一刻,到底是谁,被授权按下了那个 “同意” 的按钮?

当 AI 错误执行了一笔百万级的付款,当 AI 越权修改了核心系统的访问权限,当 AI 发出了错误的工业控制指令造成物理损伤,事后的日志、审计、复盘,都无法挽回已经发生的不可逆损失。这些外围的治理措施,本质上只是 “出事之后的追责工具”,而不是 “出事之前的阻断机制”。

真正的 AI 治理,从来不是一套围绕系统的框架,而是定义系统本身的执行基底(Execution Substrate)。它不是在 AI 的执行路径上加一道 “劝你不要越界” 的警示牌,而是从机器指令的底层,让未授权的执行不仅不被鼓励,甚至在数学上、结构上根本无法被表达、无法被执行。

一、AI 治理的核心矛盾:从 “意图” 到 “不可逆动作” 的生死线

我们可以把 AI 系统的完整链路,清晰地划分为三个核心区域,这也是所有 AI 风险的诞生路径:

- 左侧:意图 / 建议区:这里是 AI 的 “思考层”,大模型、提示词、智能体在这里生成建议、计划、执行方案,所有的内容都只是文本、数据、想法,不会对真实世界产生任何不可逆的影响。哪怕 AI 在这里生成了再离谱、再违规的方案,它也只是一个建议,没有任何实际破坏力。

- 右侧:动作 / 不可逆影响区:这里是 AI 的 “执行层”,所有的动作都会对真实世界产生不可逆的影响 —— 金融付款、系统权限变更、法律合同签署、工业设备物理动作,每一个操作都可能带来真金白银的损失,甚至危及人身安全。

- 中间:执行边界(Execution Boundary):这是分隔 “思考” 与 “执行” 的唯一闸门,是 AI 治理的唯一生死线。所有从左侧的意图,要变成右侧的不可逆动作,都必须穿过这道闸门。而真正的 AI 治理,就是把这道闸门,做成 AI 系统本身的执行基底,而不是事后加装的一把锁。

行业里绝大多数的治理方案,都犯了一个根本性的错误:它们把所有的管控措施,都放在了闸门的两侧 —— 在左侧做意图审核、提示词约束,在右侧做日志审计、事后复盘,却唯独没有把管控做进闸门本身。

这就像你给汽车装了行车记录仪、违章监控、事后扣分规则,却没有给汽车装刹车和方向盘。你能记录下所有的违章和事故,却无法阻止事故的发生。而真正的治理,是把刹车和方向盘,直接做进汽车的底盘里,让它从结构上就无法冲出安全的边界。

二、不变量门:治理执行基底的核心架构

这道执行边界的核心,就是不变量门(Invariant Gate)—— 它不是一个可绕过的校验环节,而是 AI 执行动作的底层载体。所有的执行指令,必须通过不变量门的校验,才能被系统表达、被机器执行;没有通过校验的指令,在系统里根本就不存在,更别说触达右侧的真实世界。

不变量门的六大核心机制,从底层定义了 AI 执行的安全边界,彻底重构了 AI 治理的底层逻辑。

1. 无有效信封,无执行可能

核心规则:No execution without a valid envelope bound at load. No envelope ⇒ no representable action.

这是整个治理体系的第一性原理:AI 要执行任何一个动作,必须在加载阶段就绑定一个有效的授权信封(Envelope)。没有这个信封,系统里根本就没有办法表达这个动作,更别说执行它。

这和传统的权限系统有着本质的区别:

- 传统权限系统是 “请求 - 校验” 模式:AI 先发出执行请求,系统再判断这个请求是否有权限。哪怕校验不通过,这个违规的请求已经被生成、被表达了,只是被拦截了,依然存在绕过的可能。

- 信封机制是 “结构上不可表达” 模式:没有授权信封,AI 连要执行的动作都无法在系统里定义出来。违规的动作从根源上就没有存在的空间,自然不存在绕过的可能。

这就像你要进一个房间,传统的锁是 “你到了门口,我检查你的钥匙,没钥匙就不让你进”;而信封机制是 “没有钥匙,你连通往房间的路都找不到,这个房间在你的世界里根本不存在”。

2. 时间绑定的授权元组:执行时刻的责任闭环

核心规则:每一次调用,都必须在不变量门中验证完整的时间绑定授权元组(Authority Tuple),元组包含:authority_id(授权ID)、stop_right_holder(终止权持有者)、liability_binding(责任绑定主体)、t_issue(签发时间)、t_expiry(过期时间)、envelope_id(信封ID)。一旦当前时间超过过期时间,执行在结构上就不可能完成。

这个机制彻底解决了 AI 治理最核心的两个问题:责任主体模糊和权限永久化。

- 责任闭环:每一个执行动作,从底层就绑定了授权人、责任承担人、终止权人,不存在 “出了事没人负责” 的情况。在执行的那一刻,系统就已经用不可篡改的方式,记录了谁为这个 “同意” 负责,而不是事后再去追溯。

- 时间刚性约束:授权不是永久有效的,而是严格绑定了有效期。一旦超过过期时间,这个执行指令在结构上就无法被执行,不是 “系统把权限关掉了”,而是这个指令本身的执行条件已经不成立了,从根源上杜绝了 “权限泄露后被永久滥用” 的风险。

比如,你给 AI 授权了一笔付款操作,有效期是 24 小时,责任人是财务主管。哪怕这个授权信封被泄露,24 小时之后,它就彻底失效了,任何人都无法用它再执行付款操作;同时,任何一笔用这个信封执行的付款,都明确绑定了财务主管的责任,不存在权责不清的问题。

3. 重置完整性:杜绝权限回退式越权

核心规则:当系统拒绝(REFUSE)一个执行请求后,系统的能力快照会与上一个已验证的安全状态做对比。任何有效权限范围的扩大、安全阈值的放宽,都必须申请新的授权信封,并获得管理员的重新授权,绝对禁止 “重置到更大权限” 的操作。

这是针对 AI 系统越权漏洞的核心防御机制。现在很多 AI 系统的安全风险,都来自于 “重置绕过”:当 AI 的执行请求被拒绝后,它可以通过重置会话、重置上下文的方式,绕过之前的权限限制,甚至获得更大的执行权限。

而重置完整性机制,从底层保证了:系统的安全状态只能单向收敛,不能反向放宽。重置操作只能让系统回到上一个已经验证过的安全状态,要扩大权限、放宽阈值,必须走完整的重新授权流程,没有任何例外。这就彻底杜绝了 AI 通过重置、绕过来获取越权权限的可能。

4. 边界状态仅用于诊断:从根源杜绝 “打擦边球”

核心规则:BORDERLINE(边界)状态仅可用于诊断,它们从结构上就是不可靶向、无法被优化器利用的。你无法把 “贴着合规边缘走” 作为性能优化策略。

AI 系统的一个经典风险,就是 “边缘优化”:为了提升执行效率、完成目标,AI 会不断试探合规边界,最终卡在违规的边缘,甚至越界。就像司机为了开得更快,一直贴着车道线行驶,很容易就会压线违章。

而这个机制,从底层就把合规边界的临界状态,设置成了不可靶向、无法被优化器捕捉的状态。AI 的优化目标,根本无法触达这些边界状态,自然也就不可能把 “贴着边缘走” 作为优化策略。这就像在车道线的位置设置了物理隔离带,司机根本不可能贴着线开,从根源上杜绝了打擦边球的可能。

5. 仅追加的证据账本:执行时刻绑定的不可篡改链路

核心规则:每一次执行提交,都会被哈希链式写入仅追加的证据账本,绑定发生在提交的那一刻,而不是事后的取证痕迹。

这和传统的日志系统有着天壤之别:

- 传统日志是 “事后写入”:执行完成之后,再把操作记录写到日志里。这种日志可以被篡改、被删除、被伪造,本质上是 “事后取证”,可信度完全依赖于日志系统的安全性。

- 仅追加的哈希账本是 “执行时刻绑定”:在执行提交的瞬间,操作记录就会和授权信封、授权元组一起,通过哈希链写入账本,不可篡改、不可删除、不可回溯修改。每一次执行,都会在账本里留下不可磨灭的、完整的链路证据,从授权到执行,全链路可追溯、不可抵赖。

这就彻底解决了 AI 执行的审计难题:不是出事之后再去找日志、拼链路,而是每一次执行,都已经在账本里留下了完整的、不可篡改的证据,随时可以审计、随时可以追溯。

三、从 “政策 + 日志” 到 “治理即执行基底”:第四代 AI 治理运行时的革命

当这六大机制完整落地,我们对 AI 治理的认知就会发生本质的颠覆:这个执行边界,不再只是执行前的校验环节,它本身就是 AI 系统的执行基底。

系统可到达的状态空间,是由不变量授权合约字面定义的,而不是由配置文件、政策文档定义的。现在绝大多数的 AI 系统,是 “政策写在 PPT 里,规则写在配置里,执行的时候可以绕过配置”;而基于不变量门的治理运行时,是 “政策直接写成了底层的不变量合约,定义了系统能到达的所有安全状态,超出这个范围的状态,在系统里根本就不存在,更别说被执行”。

我们可以清晰地看到 AI 治理的四代演进:

- 第一代:无治理:AI 可以自由执行所有动作,完全没有约束,只靠人工事后兜底。

- 第二代:框架治理:制定了完整的合规政策、审核流程、监控体系,靠人工和外围规则约束 AI 的执行,本质上是 “人治”,而非 “系统治”。

- 第三代:接口治理:在 AI 的执行接口上加了权限校验、规则拦截,是 “关卡式治理”,依然存在被绕过的可能。

- 第四代:基底治理:把治理规则直接做进了 AI 系统的执行基底,未授权的执行从结构上就无法被表达、无法被执行,是 “本质安全” 的治理模式。

而基于实时代数的预执行治理运行时,就是第四代 AI 治理的核心落地形态。它已经不再是理论上的设计,而是正在安全关键场景中落地的成熟方案。

四、真正的 AI 治理,是让乐观主义变成确定性

图片里的那句话,道破了当前 AI 治理行业的真相:If your AI stack can’t prove who owned the “yes” at execution time, you don’t have governance – you have optimism.

如果你的 AI 系统,无法在执行的那一刻,用不可篡改的方式证明是谁授权了这个 “同意”,那你根本没有治理,你只有乐观主义。

你乐观地相信,AI 不会生成违规的指令;你乐观地相信,审核流程不会被绕过;你乐观地相信,日志不会被篡改;你乐观地相信,出事之后能找到责任人。但所有的乐观,都无法阻止不可逆的损失发生。

而真正的 AI 治理,从来不是靠乐观主义,而是靠底层架构带来的确定性。它不是告诉你 “AI 大概率不会出事”,而是从底层保证 “AI 绝对不可能做出未授权的动作”。

在 AI 全面走向自主化、走向真实世界执行的今天,治理已经不再是 AI 系统的 “附加模块”,而是它的 “底层地基”。当 AI 要执行的动作,会带来不可逆的金融、法律、物理影响时,纸面的框架、事后的审计,都没有任何意义。

只有把治理变成执行基底本身,把安全边界做进机器指令的底层,让未授权的执行从根本上无法发生,我们才能真正放心地把更多的任务交给 AI,才能真正释放自主智能体的全部潜力。

毕竟,AI 能走多远,从来不取决于它的能力有多强,而取决于它的治理有多可靠。

更多推荐

已为社区贡献104条内容

已为社区贡献104条内容

所有评论(0)