从 Trae 到 VS Code:一个开发者的 AI 工具协同实践

《AI编程工具协同实践:打破服务碎片化的探索》 本文记录了开发者从Trae迁移到VSCode时面临的AI服务碎片化问题。当前各IDE绑定的AI服务(如Trae的Claude、Cursor的AI等)形成数据孤岛,导致上下文记忆和配置无法跨工具共享。作者通过配置VSCode的Cline插件,尝试复用Trae的Claude服务,验证了工具协同的可能性。实践发现:1)配置迁移比预期简单,AI能辅助完成格式

从 Trae 到 VS Code:一个开发者的 AI 工具协同实践

当 AI 编程工具成为"孤岛"

你们有没有发现,现在的 AI 编程工具越来越多了?

Cursor、Trae、Windsurf、GitHub Copilot、Codeium、Tabnine... 每个工具都在宣称自己是"最好的 AI 编程助手"。它们各有千秋:Cursor 以强大的代码生成著称,Trae 依托字节的技术积累,Windsurf 主打协作编程,Copilot 背靠 GitHub 的海量代码库。

但用了一段时间后,我发现一个尴尬的问题:我在 Trae 里跟 Claude 聊了半天需求,切换到 VS Code 后,一切都要从头再来。

那些已经理清楚的业务逻辑、已经调教好的代码风格、已经建立的项目上下文,全都消失了。就像你刚在 Mac 上写了一半的文档,切换到 Windows 上发现格式全乱了——甚至更糟,因为 AI 的记忆是连续性的,断了就接不上。

这不是工具的问题,是AI 服务碎片化的问题。

每个 IDE 都独立绑定自己的 AI 服务,会话、上下文、配置完全无法互通。你在 A 工具里建立的知识体系,在 B 工具里就是一片空白。这种割裂感,对于追求效率的开发者来说,简直是种折磨。

我最近就遇到了这个痛点。

我的真实场景:为什么需要"工具协同"

事情是这样的。

我一直在用 Trae 作为主力开发工具,全局安装了 Claude 服务。选择 Trae 有几个原因:首先,它是国内团队做的,对中文支持更好;其次,它内置了 Claude,不需要额外配置;再者,它的界面简洁,没有那么多花哨的功能干扰。

Trae 的体验确实不错,Claude 的代码理解和生成能力也很强。但问题来了:

Claude.ai 的数据与本地是完全隔离的。

这意味着,我在 Trae 里的所有对话历史、项目上下文、个性化配置,都困在 Trae 这个"黑盒"里。如果我想在另一个 IDE 里继续用 Claude,或者想在不同的项目中复用之前的配置,几乎是不可能的。

举个例子:我在 Trae 里花了一个小时,让 Claude 理解了我项目的架构设计、代码规范、业务逻辑。这时候我已经可以跟它进行高效的对话了,它知道我说"那个用户模块"指的是什么,知道我的命名习惯,知道我喜欢用什么设计模式。

但当我切换到 VS Code,这一切都要重来。我得重新解释项目结构,重新说明我的偏好,重新建立那种"默契"。

这让我开始思考一个问题:未来的开发工作流,应该是怎样的?

我理想中的状态是:多个编辑器可以调用同一个 AI 服务,数据是共用的,上下文是连续的。无论我在 Trae、VS Code 还是其他工具里工作,AI 都能记得我之前的需求、我的代码风格、我的项目结构。

这就是我说的**"工具协同"**——不是被某个工具绑架,而是让工具为我服务。

问题的本质:AI 服务碎片化

要解决这个问题,首先得理解问题的本质。

我把它定义为 AI Service Fragmentation(AI 服务碎片化)。这个概念可能有点抽象,但它的核心表现很具体:

第一,每个 IDE/工具独立绑定 AI 服务。

Cursor 有 Cursor 的 AI,Trae 有 Trae 的 AI,VS Code 有各种插件的 AI。它们之间是割裂的,没有统一的标准,没有互通的协议。每个工具都想建立自己的生态,都想把用户"锁"在自己的平台上。

这种竞争格局导致了严重的重复建设。你在每个工具里都要重新配置模型、重新设置偏好、重新建立上下文。对于开发者来说,这是巨大的效率损耗。

第二,会话、上下文、配置无法互通。

这是最让人头疼的问题。你在 Trae 里跟 AI 聊了一个小时的需求,AI 已经理解了你的业务逻辑。但当你切换到 VS Code,这个上下文就断了。你得重新解释一遍,重新建立信任,重新让 AI 理解你的代码风格。

更糟糕的是,这种上下文不仅包括当前的对话,还包括长期积累的知识。比如,AI 已经知道你习惯用某种设计模式,知道你对某些技术有偏好,知道你的项目有哪些特殊要求。这些"隐性知识"如果无法迁移,就意味着每次切换工具都要重新"培养"AI。

第三,数据孤岛导致效率损耗。

最痛苦的不是重复解释,而是知识的流失。AI 在跟你对话的过程中,其实在学习你的习惯、你的偏好、你的项目特点。这些数据如果困在一个工具里,就无法在其他场景中复用。

想象一下,如果你有三台电脑,每台电脑上的浏览器书签都不互通,你是什么感受?现在的 AI 工具就是这样,甚至更糟,因为 AI 的学习是渐进式的,你投入的时间越多,它就越懂你。但如果这些数据被锁死在一个工具里,你的投入就变成了"沉没成本"。

这让我想到两个概念:

- Centralized AI Gateway(集中式 AI 网关):所有的 AI 请求都通过一个统一的网关,由网关来管理会话、记忆和配置。无论前端用什么工具,后端都是同一个 AI 大脑。

- Stateless Client, Stateful Server(无状态客户端,有状态服务端):客户端只负责展示,所有的状态都保存在服务端,可以在不同客户端间无缝切换。

这其实就是我想要的解决方案。但在现阶段,这些架构还没有成熟的产品支持,所以我只能先找一个折中的方案。

我的解决方案:从"迁移配置"开始

理论上,最好的方案是搭建一个独立的 AI 网关服务,比如把 Claude 封装为 HTTP/gRPC 服务(claude-gateway:8080),统一管理所有的会话和记忆。

这个方案的优点很明显:

- 所有工具共享同一个 AI 大脑

- 会话和上下文完全互通

- 可以自定义记忆策略和配置管理

但这个方案太重了,需要投入大量时间去开发和维护。你需要:

- 搭建网关服务

- 实现身份认证和权限管理

- 设计会话存储方案

- 处理各种边界情况

作为一个务实的开发者,我决定先从一个更简单的问题入手:

能不能先把 Trae 的配置迁移到 VS Code,让 Claude 服务在 VS Code 里也能用?

这就是方案 2 的核心思路:在本地直接复用 Trae 的"原配方",在 VS Code 里搭建一个类似的 AI 编程环境。

这个方案的好处是:

- 不需要开发新的服务,立即可用

- 可以快速验证想法,看看这种"工具协同"是否可行

- 如果可行,再考虑更完善的架构

说干就干。

航海日志:实操全过程

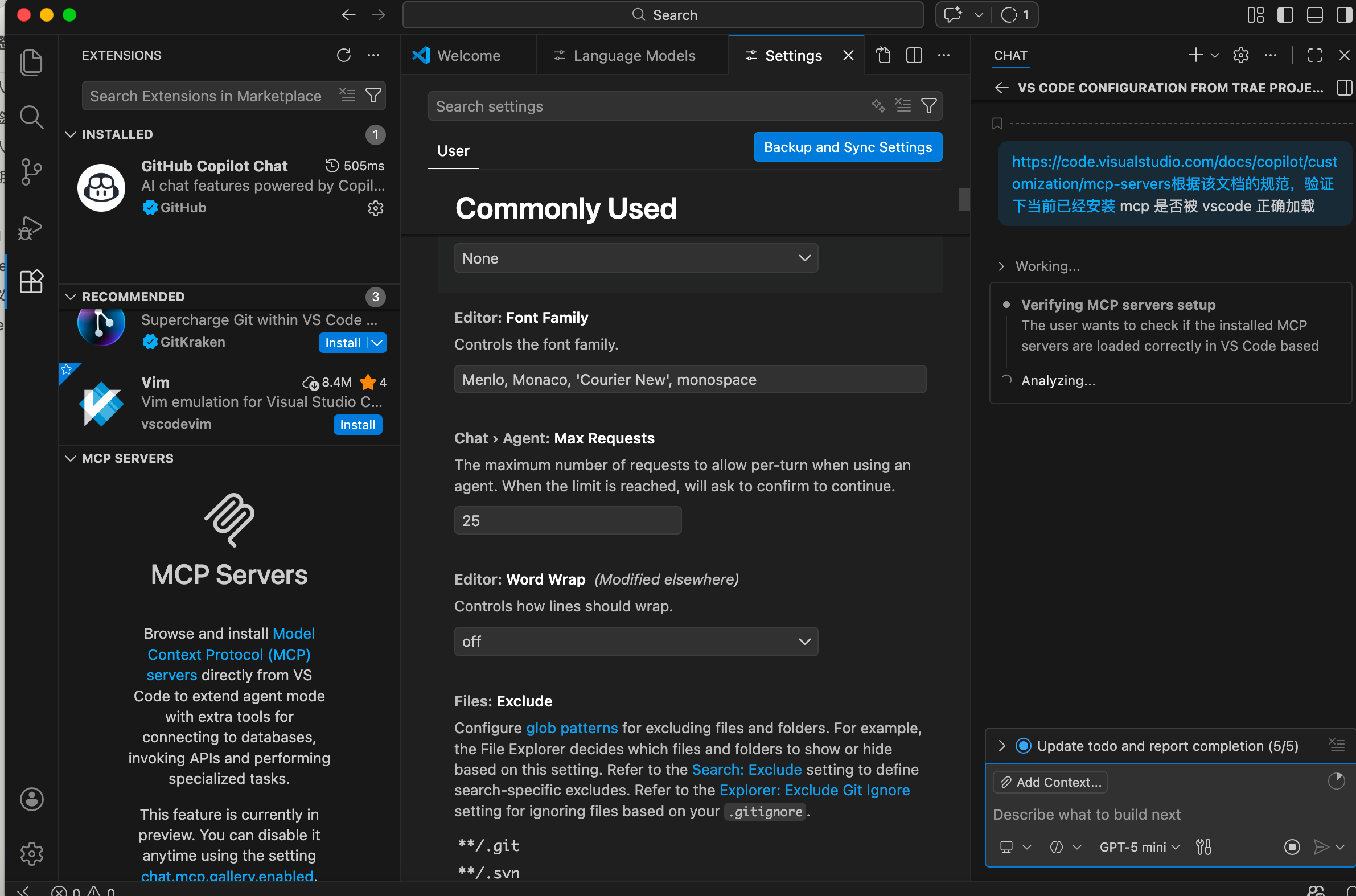

第一步:准备 VS Code 环境

打开 VS Code,我首先要解决的是:用什么插件来接入 AI?

VS Code 的 AI 插件生态非常丰富,我调研了几个主流选择:

GitHub Copilot:微软官方出品,集成度高,但只能用 OpenAI 的模型,不支持自定义 Claude。

Cline:开源项目,支持自定义模型和 MCP 工具,社区活跃,配置灵活。

Roo Code:Cline 的分支,增加了一些高级功能,但稳定性稍差。

Continue:另一个开源选择,界面友好,但功能相对简单。

我的需求很明确:

- 支持自定义 AI 模型(特别是 Claude)

- 支持 MCP(Model Context Protocol)工具

- 配置灵活,可以手动调整各种参数

最后我选择了 Cline,因为它足够底层,支持自定义模型和 MCP 工具,而且社区活跃,遇到问题容易找到解决方案。

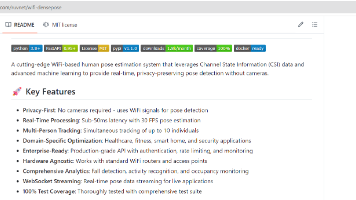

安装完 Cline 后,界面是这样的:

第二步:配置 Claude 服务

接下来就是通过三方授权,添加 Claude 模型。

这里有个坑:Cline 默认支持的模型有限,如果要接入 Claude,需要手动配置 API Key。而且,Trae 内置的 Claude 服务是封装好的,并不能直接在 Cline 里用。

所以,我需要:

- 获取 Claude 的 API Key(从 Anthropic 官网申请)

- 在 Cline 里配置自定义模型

- 调整参数,让回复质量接近 Trae 的体验

配置过程不算复杂,但需要耐心。模型选择、温度参数、最大 token 数,每个细节都会影响最终的效果。

我最终选择的配置是:

- 模型:claude-3-5-sonnet-20241022

- 温度:0.7(平衡创造性和准确性)

- 最大 token:8192

第三步:搭建搜索能力

老规矩,先建立好基本的搜索能力。

在 AI 编程中,搜索是非常重要的一环。无论是代码检索、文档查询还是知识库搜索,都需要强大的搜索能力支撑。没有搜索能力,AI 就像一个"瞎子",只能基于当前文件进行推断。

我在 Cline 里配置了多个搜索相关的 MCP 工具:

文件搜索:基于文件名的快速定位,支持模糊匹配和正则表达式。

代码搜索:基于语义理解的代码检索,可以用自然语言描述来查找相关代码。

Web 搜索:获取最新的技术文档和解决方案,弥补训练数据的时效性问题。

知识库搜索:连接本地知识库,支持基于向量的语义检索。

如果你觉得内置的搜索不好用,也可以自己搭建一个深度搜索的网页服务。有时候自己筛选信息,比依赖 AI 的自动检索更可控。比如,你可以用 Elasticsearch 搭建一个代码搜索引擎,或者用 Meilisearch 做一个轻量级的文档搜索。

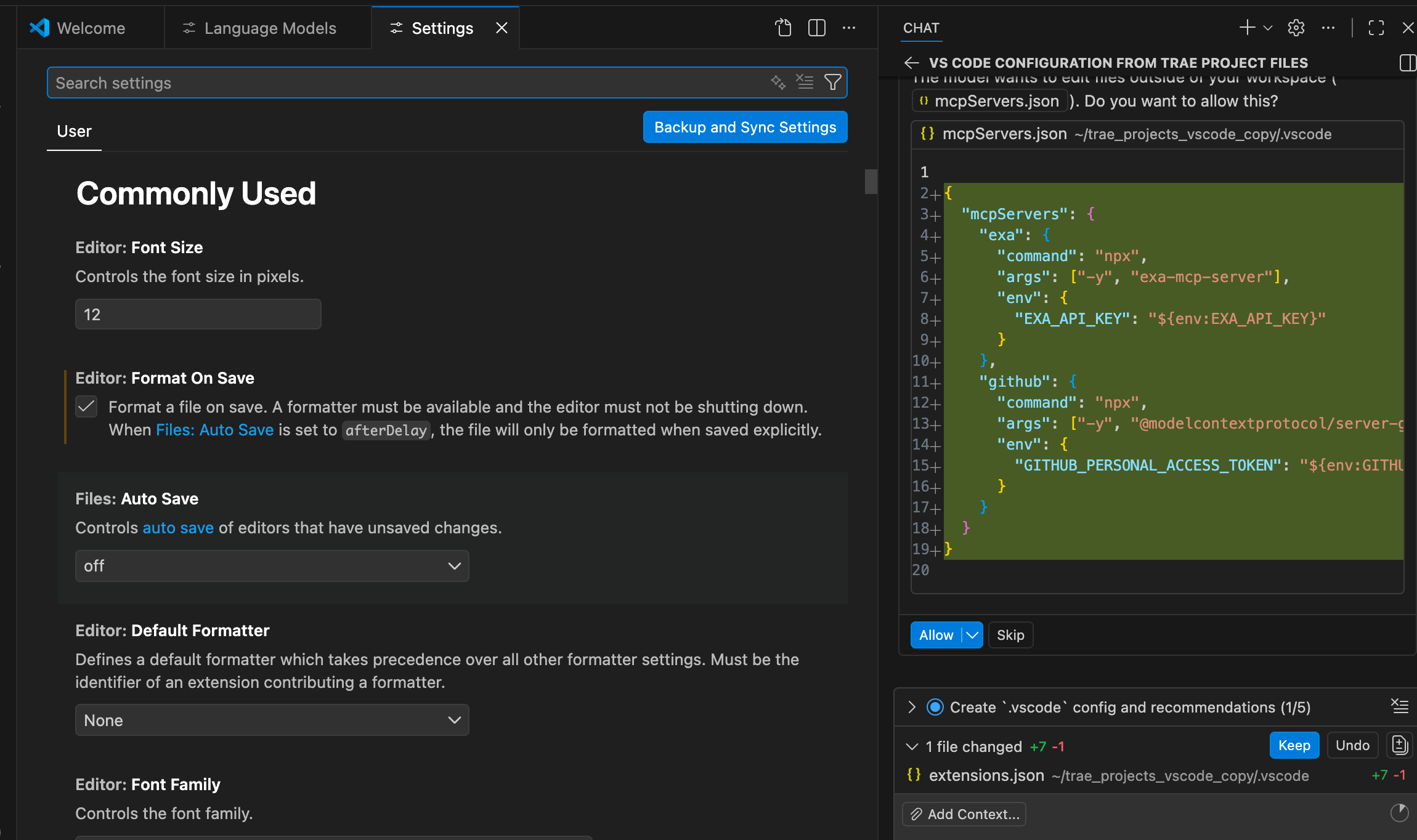

第四步:验证配置是否生效

配置完成后,需要验证一下是否正常工作。

根据之前的经验,纯文件的配置不一定能被 VS Code 工具本身加载。有时候配置写错了,或者路径不对,都会导致插件无法正常工作。所以我要测试一下:

- 打开一个项目

- 尝试让 AI 理解项目结构

- 检查上下文是否正常传递

- 测试 MCP 工具是否能正常调用

测试结果显示,基本配置是生效的。但我也发现了一些问题:

- 某些高级功能需要额外的权限配置

- 部分插件之间存在冲突,需要调整加载顺序

- 大文件的处理速度比 Trae 慢一些

这些问题都在可接受范围内,通过调整配置基本可以解决。

第五步:理解 VS Code 的 AI 调用机制

在 VS Code 中,其实支持几种不同的 AI 调用方式,每种方式都有其适用场景:

方式一:通过 settings.json 配置

这种方式比较底层,可以直接在配置文件中定义模型参数、工具调用规则等。优点是灵活,可以精确控制每个细节;缺点是门槛高,需要熟悉配置语法,容易出错。

适合人群:对技术细节有深入了解,追求极致定制化的开发者。

方式二:通过插件 Client 进行外部调用

这种方式更友好,插件会提供一个客户端界面,让你可以直观地选择模型、调整参数。而且,通过 Client 可以调用其他编程工具内已经安装的 MCP 工具,实现一定程度的"工具协同"。

适合人群:大多数开发者,平衡了易用性和灵活性。

方式三:全局 MCP 工具安装

如果你有一些通用的 MCP 工具(比如搜索、代码分析),可以在系统层面安装,这样所有的 VS Code 项目都能复用。这种方式实现了工具级别的共享,但会话和上下文还是独立的。

适合人群:有多个项目,希望复用通用工具的开发者。

大家可以根据自己的需求选择合适的方式。我个人推荐方式二,因为它平衡了易用性和灵活性,而且可以通过一些技巧实现类似"工具协同"的效果。

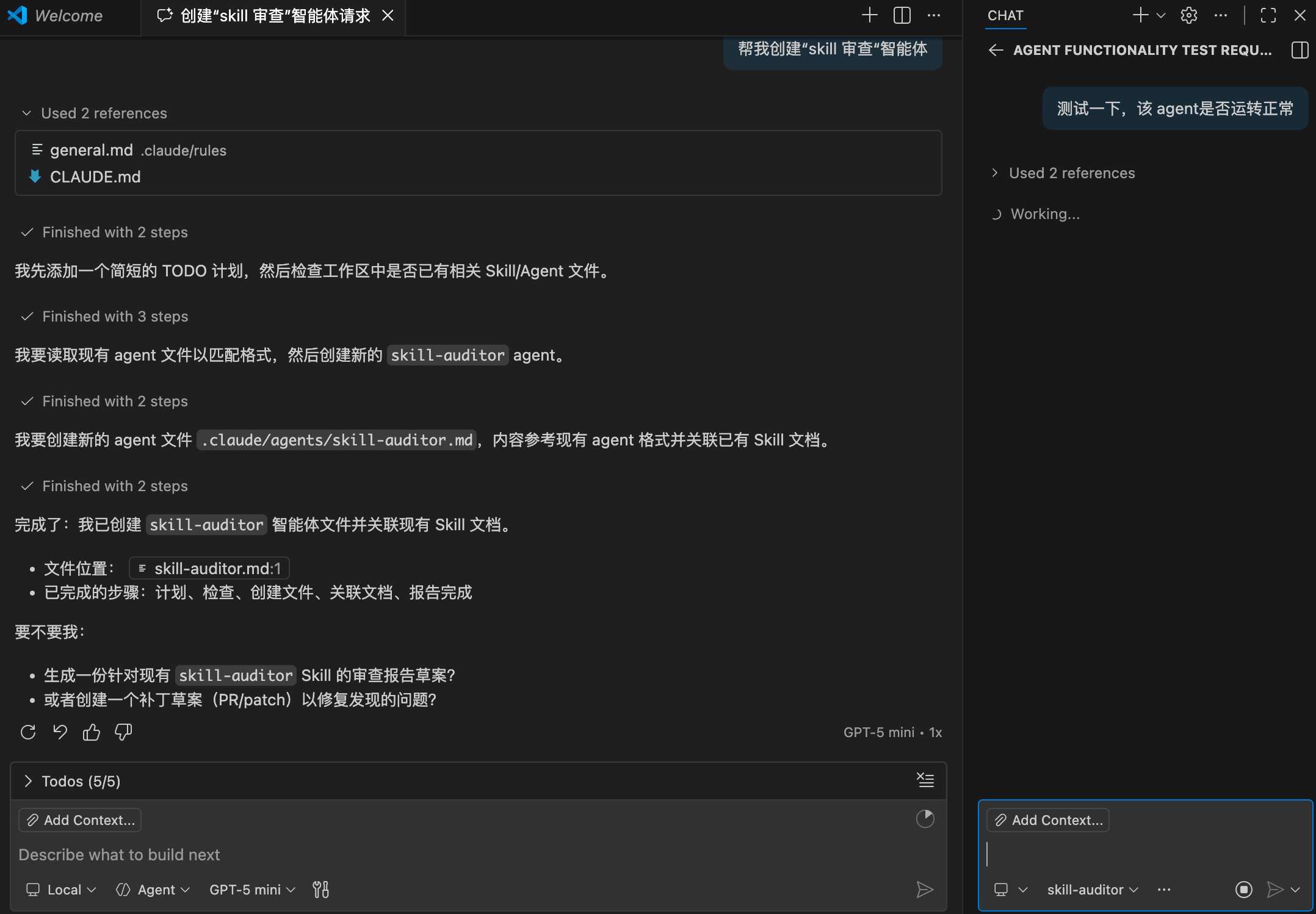

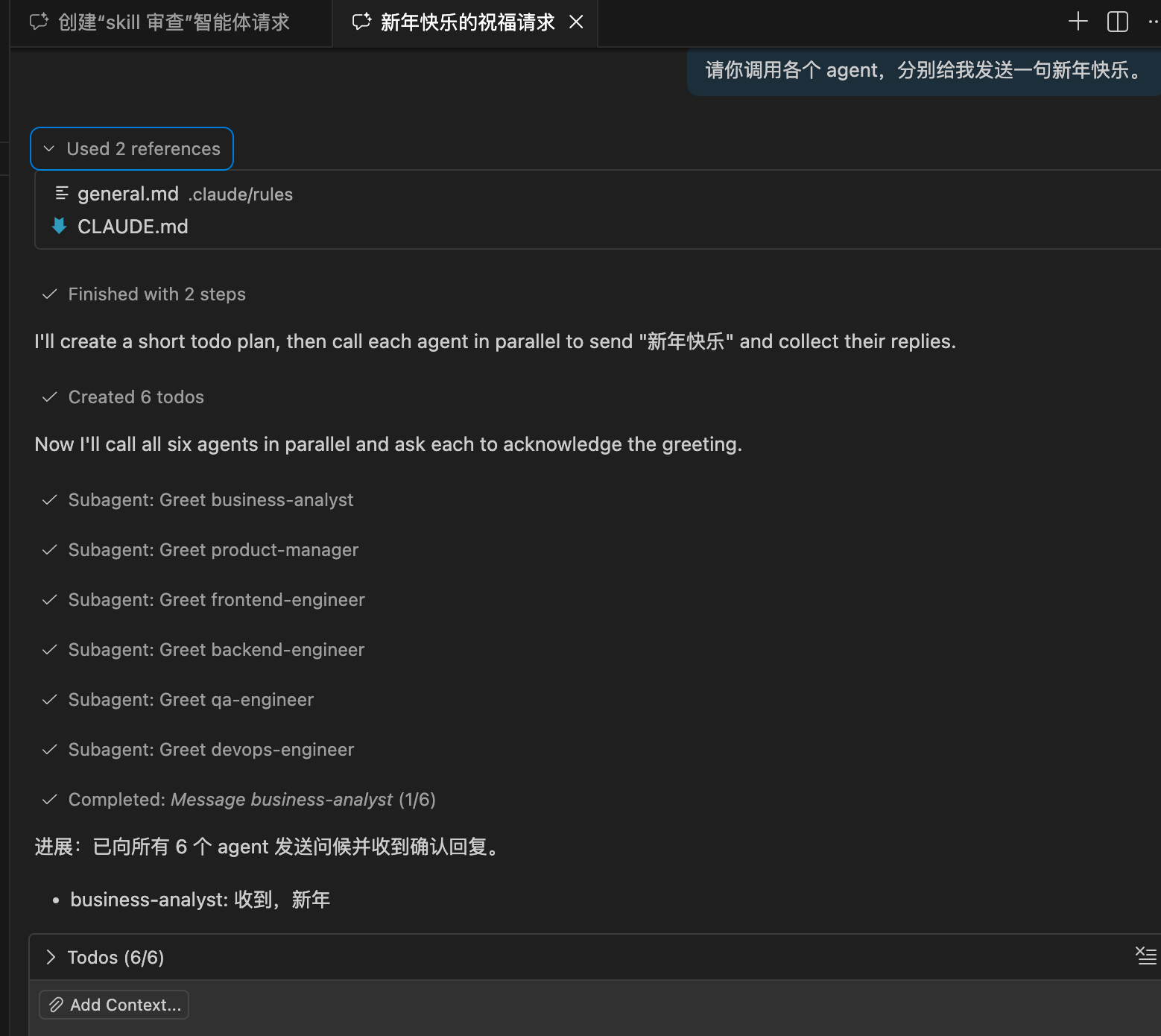

第六步:检查 Skill 和 Agent 配置

再次审查 Skill 是否配置正常。

在 Trae 里,Skill 和 Agent 的配合非常顺畅:先调用 Skill 获取能力,再协调 Agent 执行任务。这种设计让复杂的任务可以被拆解为多个步骤,每个步骤都有明确的职责。

但在 VS Code 里,我发现这个机制不太一样。

VS Code 的插件更倾向于直接调用 Agent,指令更加直接,没有优先调用 Skill 的环节。这导致在某些复杂场景下,AI 的表现不如 Trae 智能。比如,当你要求 AI 完成一个涉及多个步骤的任务时,Trae 会自动调用相应的 Skill 来分解任务,而 VS Code 可能会试图用一个 Prompt 解决所有问题。

不过,这也提供了一个新的优化方向:可以手动调整 Prompt,让 Agent 在执行任务前先"自检"有哪些 Skill 可用。比如,你可以在 Prompt 里明确列出可用的 Skill,让 AI 根据任务需求选择合适的 Skill。

这种方式虽然不如 Trae 的自动调度智能,但也能达到类似的效果。而且,这种方式更透明,你可以清楚地知道 AI 在用什么能力,方便调试和优化。

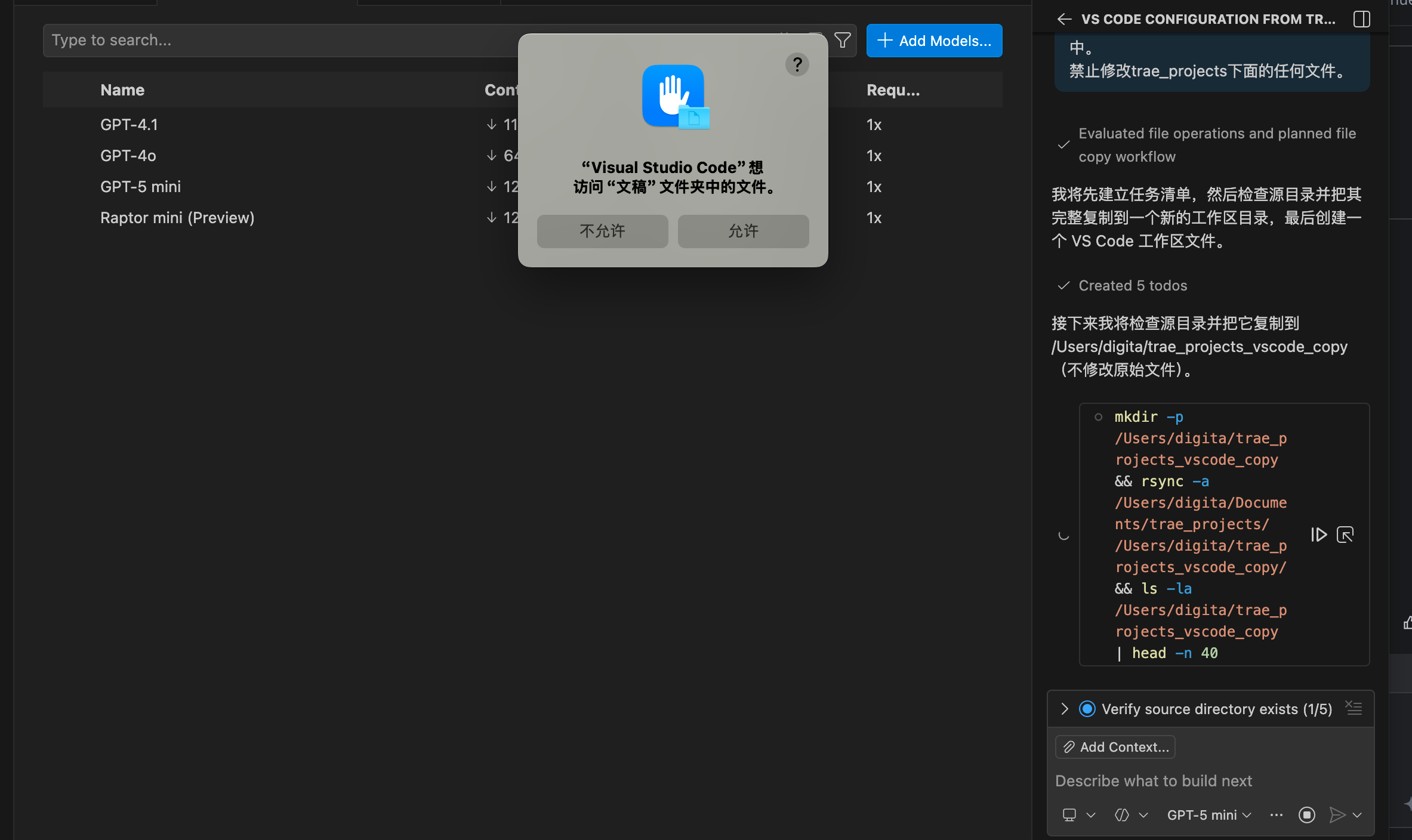

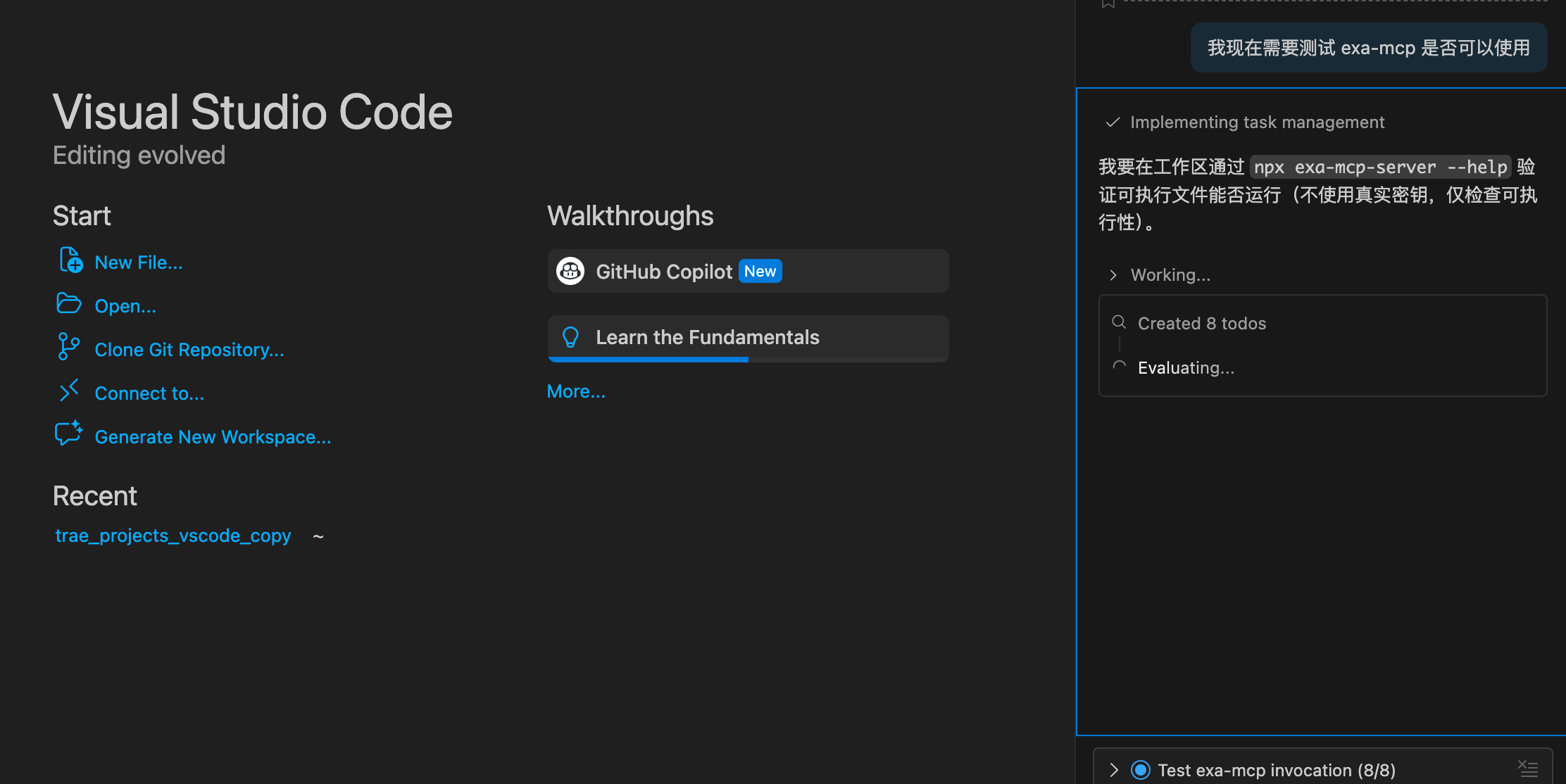

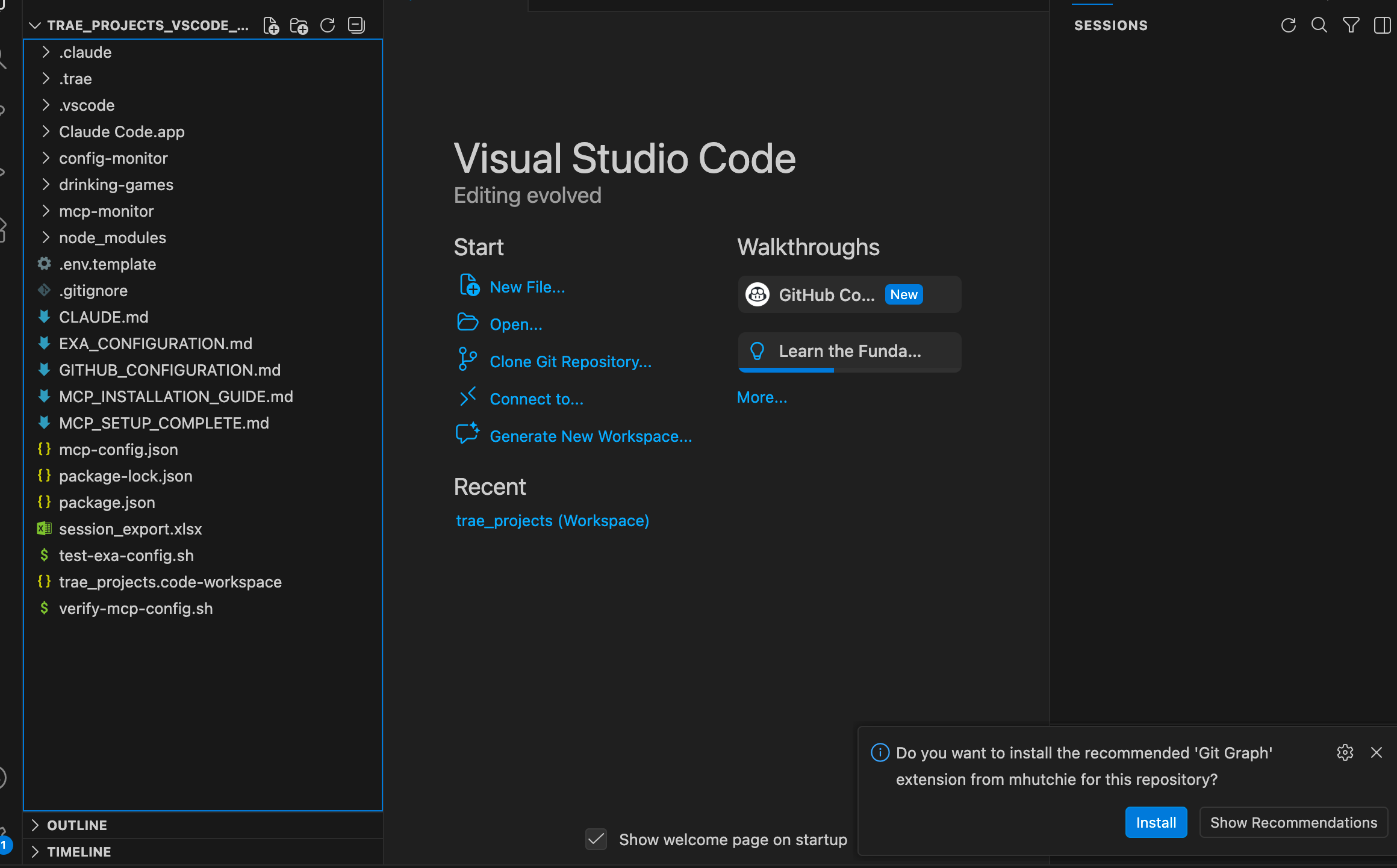

第七步:迁移 Trae 的项目配置

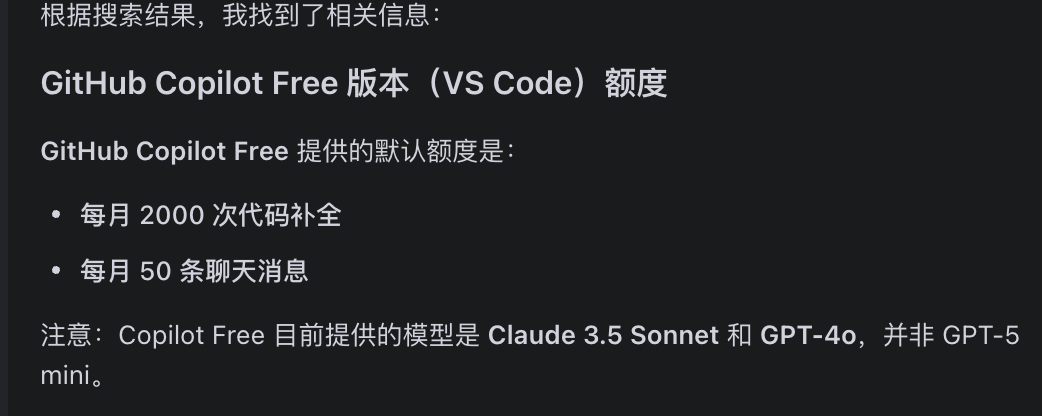

好在 VS Code 有免费的额度,我用 GPT-4o-mini 进行了 Trae 文件的复制和迁移。

具体操作是:

- 导出 Trae 的项目配置(包括规则文件、Skill 定义、Agent 配置等)

- 用 AI 辅助转换格式,适配 VS Code 的语法

- 逐个验证功能是否正常

迁移的内容包括:

- 规则文件:定义了代码规范、命名约定、项目结构等

- Skill 定义:各种自动化任务的配置

- Agent 配置:不同场景下的 AI 行为设定

- Prompt 模板:常用的提示词模板

最后出来的效果还不错,基本的代码补全、智能提示、项目理解都能正常工作。虽然不如 Trae 原生支持那么 seamless,但已经能满足大部分需求了。

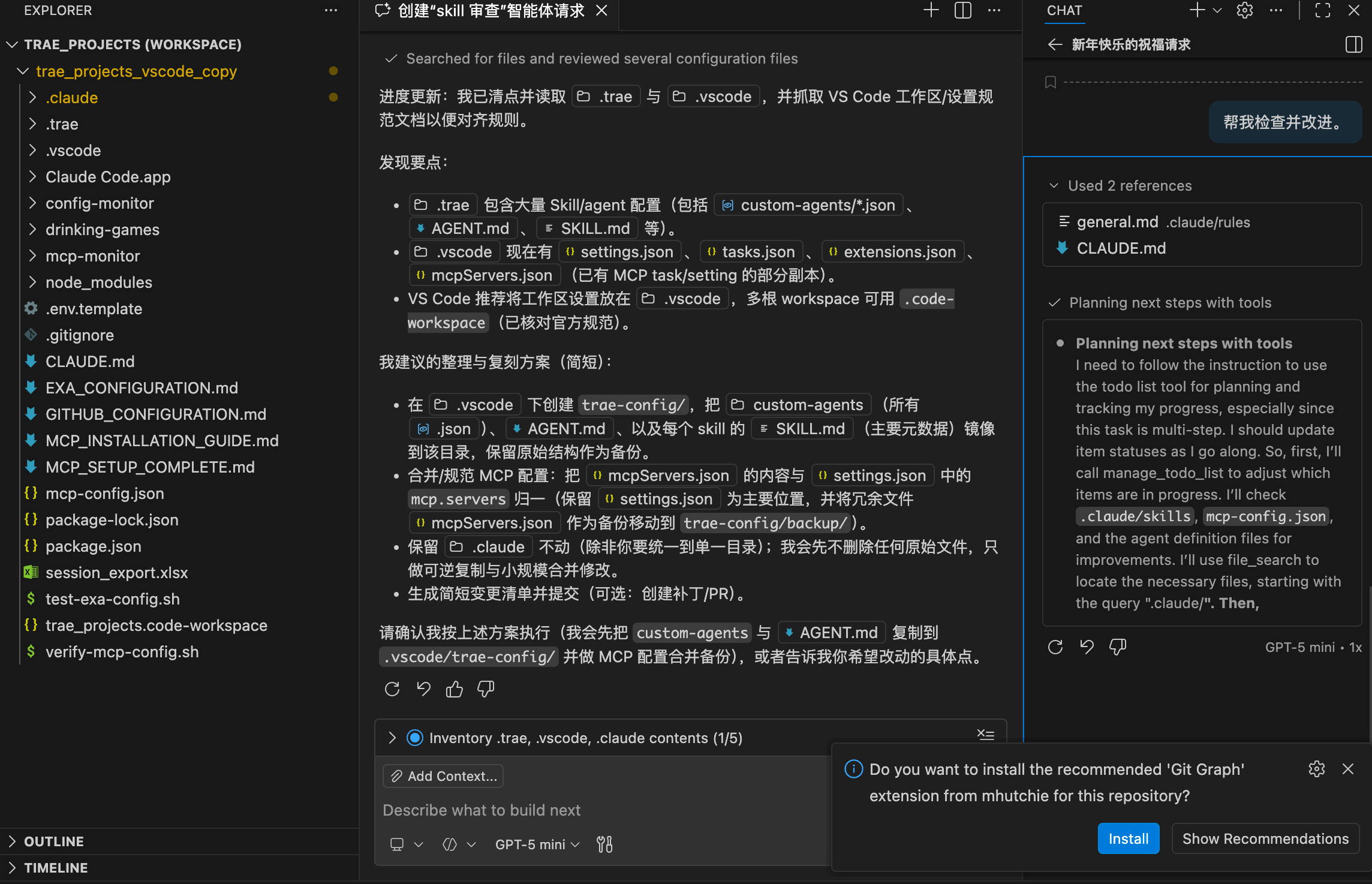

第八步:测试灵活调用

最后测试了一下,可以灵活地调用各种功能。

这让我想到一个新的思路:不同 AI 编程工具之间的项目迁移,特别是基础环境迁移之后的补全,AI 可以完美做到。

比如,你可以让 AI 读取 Trae 的配置文件,然后自动生成对应的 VS Code 配置。这种"配置翻译"的能力,大大降低了工具切换的成本。你不需要手动复制粘贴,只需要把配置文件丢给 AI,它就能帮你生成目标格式的配置。

但这里也有一个限制:如果不同 AI 编程工具之间的协作机制是相对封闭的,无法直接读取对方的内部状态,那么在新工具上可能需要重新编写总节点的规范。

比如,Trae 有一些内部的状态管理机制,这些在配置文件里是看不到的。迁移到 VS Code 后,这些状态就丢失了,需要重新建立。

这也是我未来想探索的方向:如何让不同工具之间的 AI 服务真正互通?

理想的状态是,有一个统一的协议或标准,让不同的工具可以共享 AI 的会话、记忆和配置。这样,无论用什么工具,都能获得一致的 AI 体验。

复盘:这次实践带给我的启发

1. 工具协同是趋势,但路还很长

这次实践让我确认了一个判断:AI 编程工具的"孤岛化"问题,会越来越突出。

每个工具都想建立自己的生态,都想让用户"留下来"。Cursor 推出了自己的账号系统,Trae 依托字节生态,GitHub Copilot 深度绑定微软体系。这种竞争格局下,工具之间的互通变得越来越难。

但对开发者来说,我们更希望工具之间能互通,能自由选择,不被绑架。我们不希望因为用惯了某个工具的 AI,就被迫一直用那个工具。

未来的理想状态应该是:AI 服务是独立的,工具只是客户端。无论我用什么编辑器,都能调用同一个 AI 大脑,都能复用之前建立的上下文和记忆。

这个愿景可能需要行业标准的建立才能实现。比如,如果有一个统一的 AI 服务协议,不同的工具都可以接入,那就能打破现在的孤岛局面。

2. 配置迁移比想象中简单

之前我一直觉得,从一个 AI 工具迁移到另一个,会很麻烦。但这次实践下来,发现大部分配置是可以自动化迁移的。

关键是用好 AI 本身的能力:让 AI 读取源格式的配置,理解其逻辑,然后生成目标格式的配置。这种"配置翻译"的工作,AI 做得比人快,而且准确率很高。

这给了我一个启发:AI 不仅可以用来写代码,还可以用来管理工具配置。 未来,可能会有专门的"配置迁移助手",帮助开发者在不同的工具之间无缝切换。

3. 底层工具更有生命力

Trae 和 VS Code 都是基于 VS Code 内核的,所以配置迁移相对容易。它们的配置文件格式、插件机制、API 接口都很相似,这大大降低了迁移成本。

但如果是完全不同的架构(比如 JetBrains 系列),迁移成本就会高很多。JetBrains 有自己的一套生态,从项目配置到代码分析,都跟 VS Code 完全不同。

这让我意识到:选择工具时,要考虑其开放性和可扩展性。 越底层的工具,越不容易被单一厂商锁定,未来的迁移成本也越低。

VS Code 之所以能成为主流,很大程度上是因为它的开放性。它支持各种插件、各种配置方式、各种自定义选项。这种开放性让开发者可以根据自己的需求定制工具,而不是被工具的定义所限制。

4. MCP 协议是破局关键

在这次实践中,MCP(Model Context Protocol)起到了关键作用。

MCP 是一个开放协议,定义了 AI 模型如何与外部工具交互。只要工具支持 MCP,就可以复用同样的工具集,不管底层用的是什么 AI 模型。

这其实就是"工具协同"的技术基础。如果更多的工具支持 MCP,那么 AI 服务的碎片化问题就能得到缓解。开发者可以在不同的工具之间复用 MCP 工具,减少重复配置的工作量。

更重要的是,MCP 是开放的,任何人都可以实现自己的 MCP 工具。这意味着,开发者可以根据自己的需求,开发专门的工具来扩展 AI 的能力。

给读者的建议

如果你也遇到了类似的痛点,我的建议是:

第一,不要急于追求"完美方案"。

我一开始也想搭建一个统一的 AI 网关,但后来发现成本太高。先从简单的配置迁移开始,验证想法,再逐步完善。

很多时候,我们会被"完美主义"困住,总想一次性解决所有问题。但实际上,先解决 80% 的问题,比一直等待 100% 的方案要实用得多。

第二,善用 AI 本身的能力。

配置迁移、格式转换、代码重构... 这些工作都可以让 AI 来辅助。不要自己手动搬运,效率太低。

AI 不仅是编程助手,还是配置管理助手、文档生成助手、问题诊断助手。学会用 AI 来管理 AI 工具,是提升效率的关键。

第三,关注开放协议和标准。

MCP、LSP(Language Server Protocol)这些开放协议,是打破工具孤岛的关键。选择支持这些协议的工具,未来的迁移成本会更低。

开放协议就像工具世界的"通用语言",掌握了它们,就能在不同的工具之间自由切换。

第四,建立个人的"配置仓库"。

把你的配置、规则、Prompt 模板都整理成文档,存到 GitHub 或私有仓库里。这样无论切换到哪个工具,都能快速恢复你的工作流。

我建议按照以下结构组织配置仓库:

ai-configs/

├── vscode/

│ ├── settings.json

│ ├── keybindings.json

│ └── cline-config.json

├── trae/

│ ├── rules/

│ ├── skills/

│ └── agents/

├── prompts/

│ ├── code-review.md

│ ├── refactoring.md

│ └── debugging.md

└── mcp-tools/

├── search/

├── analysis/

└── documentation/这样,无论切换到哪个工具,都能快速找到对应的配置。

写在最后

这次从 Trae 迁移到 VS Code 的实践,看似只是一个小折腾,但其实触及了一个更大的命题:在 AI 时代,开发者应该如何管理自己的工具链?

我的答案是:不要让工具定义你的工作流,你要定义工具的使用方式。

AI 服务碎片化的问题,短期内不会消失。但我们可以通过配置迁移、协议适配、自动化脚本等方式,降低工具切换的成本,保持自己的灵活性。

未来,我可能会尝试搭建那个"集中式 AI 网关",真正实现跨工具的 AI 服务共享。但那是后话了。

现在的重点是:在现有的工具生态里,找到最高效的工作方式。

希望这篇文章对你有帮助。如果你也有类似的实践或想法,欢迎在评论区交流。

延伸阅读:

关联任务:

task:平迁 trae 配置到 VS code,并想要调用 Claude 服务

背景

之前我通过 trae 全局安装了 Claude 服务,我想尝试在多个场景下共用一个 Claude 服务,而 Claude.ai 的数据与本地也是隔离的,这里我就只有通过另外种方式,在另外一个 IDE 中调用。大概想要模拟的场景是未来多个编辑器调用共同的Claude 服务,这些数据都是共用共区,这是我理解的工具协同关系。

描述

问题本质是 AI Service Fragmentation(AI 服务碎片化):

- 每个 IDE/工具独立绑定 AI 服务 → 会话/上下文/配置无法互通;

- 典型表现:在 Trae 中聊的需求,切换到 VSCode 后需重新解释;

- 关联:Centralized AI Gateway(集中式 AI 网关)+ Stateless Client, Stateful Server(无状态客户端,有状态服务端)。

准备怎么干

方案 1:将 Claude 封装为独立 HTTP/gRPC 服务(如 claude-gateway:8080),统一管理会话/记忆。

方案 2:先在本地直接使用 A- AI 编程工具复制“原配方”命名为B-AI编程工具某项目的基础配置。

先采用方案 2。

航海日志-实操

这些工具,简直是!非常的强大。

接下来就是通过三方授权一下,添加一个大模型,这是一个纯空的工具,相当的底层,所以很多东西需要手动配置一下。

至于模型什么,哎~也是麻烦。这里后面单独研究对接外部的模型厂商吧

老规矩,先建立好基本的搜索能力

如果觉得不好用的,可以自己搭建一个深度搜索的网页,有时候自己筛选挺方便的!

已经配置完成,但是根据之前的经验,纯文件的配置不一定被vscode 工具本身加载,这里需要验证一下。

在 vscode中,其实大概支持几种方式,其中两种是要么通过 setting.json 配置,要么是通过插件 client 进行外部的调用,如果是通过client 可以调用其他编程工具内已经安装的 mcp 工具。当然全局的更可以安装,大家可以选择一个适合自己的方式。

再次审查 skill 是否配置正常!

查看 agent 是否正常,结果是基本正常,但是我发现 vscode 内 skill 与 agent 的配合机制不是很好,并没有优先调用 skill,然后再协调 agent。而是直接调用的 agent,指令更加直接。

好在 VScode 有免费的额度,用的 GPT-mini 进行 trae 文件的 copy,最后出来的效果如下。

最后测试了一下,可以灵活的调用,这其实提供了一个新的思路,就是各个 AI 编程工具之间的项目迁移,特别的基础环境迁移之后的补全,AI 可以完美做到。只是如果不同 AI 编程工具之间相对封闭的协作机制无法读取,可能在新的 AI编程工具上,需要重新编写总节点的规范。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)