AI的胃口有多大?一篇文章带你看懂“算力”这笔硬开支

算力,是决定AI想法能否落地、能否盈利的第一道硬门槛,也是最大的成本黑洞之一。

当你轻敲键盘,向ChatGPT提出一个问题,并在几秒内得到一篇流畅的回答时,你可能不会意识到,屏幕另一端正发生着一场惊人的能量消耗。据估算,ChatGPT处理一次简单对话的耗电量,可能相当于一个普通灯泡点亮数十分钟。如果把AI比作一个正在进化的数字大脑,那么驱动这个大脑运转的“食物”和“血液”,便是我们今天要谈的核心——算力。

对于大多数专注于应用开发的IT从业者而言,算力可能只是一个云服务账单上跳动的数字,或是训练模型时需要选择的“GPU型号”。但当你开始深入AI项目,特别是涉及大模型微调或大规模推理时,你就会发现:算力,是决定AI想法能否落地、能否盈利的第一道硬门槛,也是最大的成本黑洞之一。

Part 01 算力:不只是“计算速度”,更是AI的“生命度量”

我们常说“这个芯片算力很强”,到底指什么?

在专业领域,算力的常用衡量单位是 FLOPS(每秒浮点运算次数)。它可以被通俗地理解为计算系统在一秒内能完成多少次基础数学运算(比如加减乘除)。一个每秒能进行一万亿次运算的处理器,其算力就是1TFLOPS。

但这只是静态指标。对于AI而言,我们更关心的是“完成特定任务所需的总算力消耗”。这就像衡量一辆汽车的“运输能力”,不能只看引擎转速(FLOPS),更要看它拉一趟货需要烧多少油(总运算量)。

这里有一个关键概念:AI模型的训练过程,本质上是一个在海量数据上进行天文数字般迭代计算的过程。 模型中的每一个“参数”(你可以理解为它的记忆点和决策规则)都需要经过数百万、数十亿次的计算来调整和优化。因此,模型的参数量,直接决定了它对算力的“胃口”。

举个例子:

GPT-3(ChatGPT的前身)拥有1750亿个参数。据研究机构估算,其单次训练消耗的算力高达3640 PFLOPS-day。这是什么概念?如果你用一台当下顶尖的消费级GPU(约100 TFLOPS)来干这活,需要不眠不休地计算一万年以上。

即便只是微调一个模型,或者在本地部署一个“小尺寸”的百亿参数模型进行推理,它所需要的计算资源,也远远超过运行一个传统的企业级软件。

所以,AI算力不是“快一点慢一点”的问题,而是 “有没有”和“够不够” 的问题。它从一种性能指标,变成了一种可量化消耗的核心生产资料,就像电力、带宽一样。

Part 02 为什么AI成了“算力吞噬巨兽”?指数增长的宿命

大家可能会有疑问:计算机技术也在飞速发展,为什么偏偏AI对算力的需求如此饥渴,甚至成了瓶颈?

这背后有三个相互作用的“放大效应”:

1、模型规模的“摩尔定律”

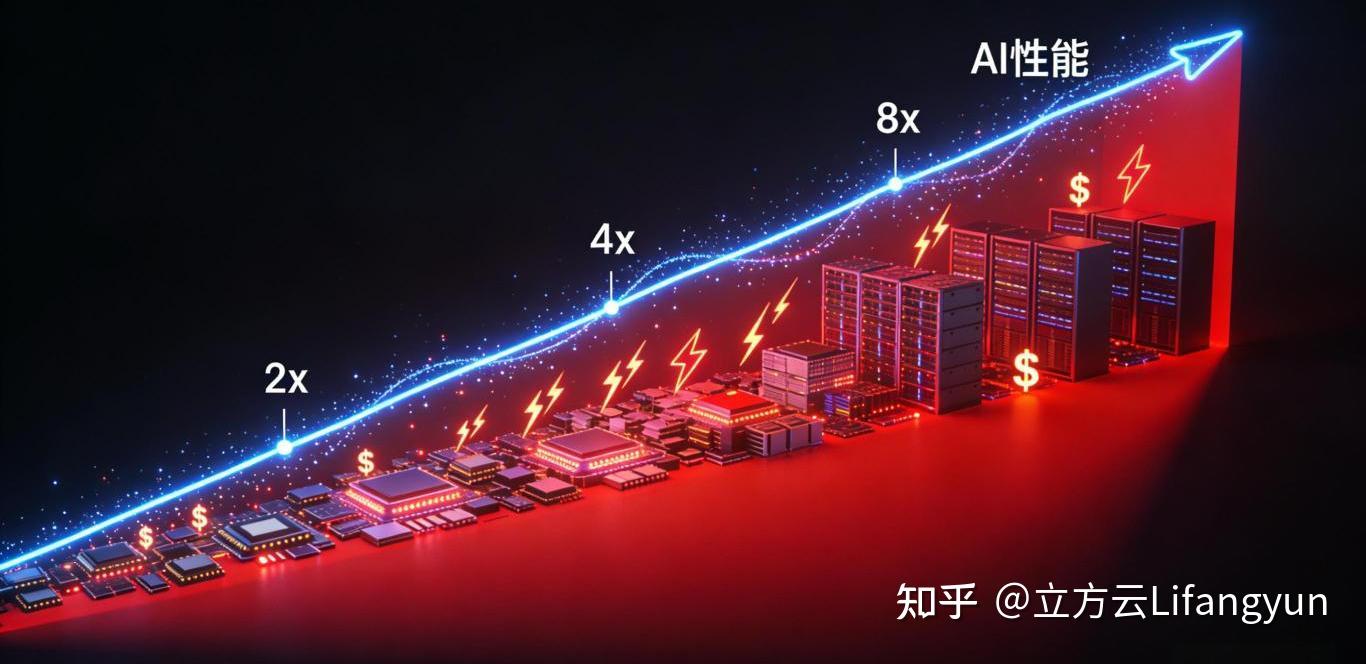

AI,尤其是大语言模型和视觉模型,其性能提升强烈依赖于参数规模的扩大。OpenAI的研究显示,模型性能随着参数、数据量和计算量的指数增长而提升。想要更聪明、更通用的AI?最直接(但非唯一)的路径就是堆砌更大的模型,而这需要的是算力的同步甚至超指数级增长。芯片工艺的进步速度(传统摩尔定律)已经快跟不上AI模型对算力需求的膨胀速度了。

2、数据洪流的“燃料需求”

大模型需要“吞食”互联网级别的文本、图像数据来学习。处理、清洗、学习这些海量数据,每一个字节都需要经过计算。数据是燃料,算力是引擎,更多的燃料需要更强大、运行更久的引擎。

3、计算本身的复杂性

AI训练中的核心数学操作(如矩阵乘法、梯度计算)本身计算复杂度就极高。而且,为了让拥有千亿参数的模型能够被训练,工程师们还需要设计复杂的分布式计算框架,让成千上万的GPU协同工作。这就像不是让一个超级大力士举重,而是指挥一支庞大的军队同步举起一座山——协调这支“军队”本身,也需要消耗额外的算力和极其精密的网络架构作为支撑。

这三种效应叠加,结果就是:AI的性能每翻一番,背后所需的算力资源可能需要增长数倍乃至数十倍。 这直接转化为了实实在在的硬件采购成本、惊人的电费账单和复杂的运维挑战。

Part 03 算力是AI时代的新式“硬开支”

理解了算力的本质和AI对其的巨大需求,我们可以明确几个点:

1、成本中心转移

对于AI项目,尤其是企业级应用,算力成本将超越甚至主导传统的软件授权、人力开发成本,成为财务预算中必须被严肃规划的核心部分。你不能只问“这个AI功能能不能实现”,更要问“我准备为它支付多少算力费用”。

2、基础设施即竞争力

稳定、高效、性价比高的算力供给,不再只是IT后台支持,而直接关系到AI产品的研发速度、用户体验和商业模式的可行性。拥有或能便捷获取优质算力,将成为企业和开发者的关键竞争力。

3、选择比努力更重要

在启动一个AI项目前,对算力需求的评估变得至关重要。你是需要强大的集群进行训练,还是需要低延迟的边缘节点进行推理?不同的路径,对应的算力基础设施方案和成本结构天差地别。

算力是基石,后续我们要探讨的——从GPU芯片的选型,到云边协同的架构,再到高速网络的互联——都是围绕如何高效、经济地获取和利用这一基石展开的。

本质上,立方云提供云主机、裸金属服务器、AI算力、边缘节点和高速网络,就是在为你搭建一条通往AI应用的“算力高速公路”,让作为开发者和企业的你,无需自建电厂,就能随时获得稳定、澎湃的“动力”输出。

在下一篇中,我们将继续深入来聊聊GPU、NPU这些芯片的不同和适用的场景。欢迎关注网鼎立方云。

网鼎科技旗下“立方云”平台致力于为企业客户打造全球算力与网络解决方案。通过云主机、裸金属服务器、云连接及AI算力等核心服务,助力企业实现核心应用灵活部署、边缘业务高效运行与AI创新快速落地,全面满足多样化计算需求。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)