langchain

LangChain是一个流行的语言模型应用框架,通过链式调用思想将多个功能模块串联,实现复杂任务的自动化处理。其核心模块包括:LLM接口层统一调用不同语言模型;Chain模块编排任务流程;Prompt模块管理动态提示词;Memory模块维护上下文记忆;Tool模块扩展外部功能调用;Agent模块集成模型推理和工具决策。这些模块协同工作,支持从简单问答到复杂业务场景的灵活适配。LangChain采用

LangChain 原理和主要模块介绍

LangChain 是近年来在大语言模型应用中极为流行的框架,旨在帮助开发者更高效地构建复杂的语言模型应用。它的核心在于“链式调用”思想,即将多个语言模型或工具功能模块有机串联,实现更强大且灵活的功能。以下内容将系统性介绍 LangChain 的原理、模块构成及其实现机制。

一、LangChain 的基本原理

LangChain 的设计基于对大语言模型单次调用能力的补充和扩展。单一调用虽然能处理基础问答、文本生成等任务,但面对复杂业务需求时,往往需要将模型与外部工具、知识库、数据处理等结合。LangChain 的目标是让开发者通过编排“链”方式将这些环节串联,实现任务的自动化和增强。

LangChain 本质上是一个面向任务流程编排的框架。它将复杂的自然语言任务拆解为多个模块,每个模块完成特定的操作,再将结果传递给下一个模块。流程中包括:

• 语言模型调用

• 外部数据接口访问(如数据库、搜索引擎)

• 多轮对话管理

• 记忆机制维护上下文

• 条件判断和控制流

通过这样的模块化设计,LangChain 能灵活适配多种应用场景,如智能问答、自动化写作、数据分析助理等。

二、LangChain 的核心模块结构

LangChain 主要由以下几个核心模块组成,它们相互协作,完成从输入解析、模型推理到结果输出的完整过程。

1. LLM(Large Language Model)接口层

这是 LangChain 与语言模型(如 OpenAI GPT、Claude、Llama 等)的交互接口。它定义了调用模型的统一标准,屏蔽了底层 API 细节,方便开发者切换不同模型。

功能包括:

• 构造提示(prompt)

• 调用模型完成推理

• 解析模型返回结果

示例代码:调用 OpenAI GPT-3.5

from langchain.llms import OpenAI

llm = OpenAI(model_name="gpt-3.5-turbo")

response = llm("介绍一下LangChain的作用")

print(response)

2. Chain 链式流程模块

Chain 是 LangChain 的核心抽象,表示一个有序执行的任务流程。每个 Chain 可以由多个步骤组成,每步是一个函数、模型调用或外部接口操作。

它支持:

• 线性执行和嵌套调用

• 条件分支

• 并行和异步操作(部分实现中支持)

开发者可以灵活组合 Chain,实现复杂业务逻辑。

3. Prompt 模块

Prompt 模块负责管理和构建与语言模型交互时的提示词(Prompt)。Prompt 是引导模型生成目标内容的关键输入。LangChain 提供了丰富的 Prompt 模板和拼接机制,方便动态生成符合上下文和业务需求的提示。

功能和特点:

• 支持变量替换,实现模板化提示

• 提供多种预定义模板,适配常见任务

• 支持复杂的提示拼接和多轮对话上下文管理

示例:

from langchain.prompts import PromptTemplate

template = "请用中文介绍一下{topic}"

prompt = PromptTemplate(template=template, input_variables=["topic"])

final_prompt = prompt.format(topic="LangChain")

print(final_prompt)

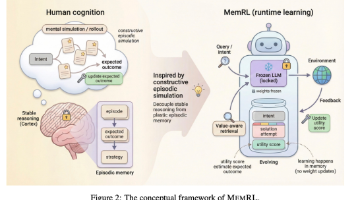

4. Memory 记忆模块

记忆模块解决了对话或任务中上下文信息的保持和传递问题。普通的单次模型调用是无状态的,无法保存之前的上下文。Memory 模块通过内部结构保存对话历史、用户信息或其他状态数据,并在后续调用中自动注入。

常见的 Memory 类型包括:

• 对话记忆(ConversationBufferMemory):保存完整的对话记录

• 长期记忆(VectorStoreMemory):基于向量数据库实现上下文相关记忆查询

• 自定义内存,支持业务扩展

Memory 是实现多轮复杂交互、上下文感知任务的关键。

5. Tool 工具模块

工具模块使 LangChain 不仅仅依赖语言模型生成文本,还能调用外部系统完成特定任务。常见工具包括:

• 网络搜索接口(Google、Bing等)

• 数据库查询

• 计算引擎

• 文件系统访问

• 自定义API调用

开发者可以自定义工具并在 Chain 中调用,扩展模型的能力边界。

示例:调用计算工具

from langchain.agents import Tool, initialize_agent

def calculator_tool(input: str) -> str:

# 这里可以调用计算服务或本地计算逻辑

return str(eval(input))

tool = Tool(name="Calculator", func=calculator_tool)

agent = initialize_agent([tool], llm)

result = agent.run("计算 3 + 5 * 2")

print(result)

6. Agent 代理模块

Agent 是 LangChain 中集语言模型、工具调用和决策于一体的智能代理。它能根据用户输入和当前状态,动态选择调用不同工具或 Chain,完成复杂任务自动化。

Agent 的特点:

• 基于语言模型进行任务规划和决策

• 自动调用内置或自定义工具

• 支持多轮交互和上下文管理

Agent 让复杂业务场景的自动化落地更为便捷。

三、LangChain 模块间的协同工作流程

LangChain 的强大不仅来源于单个模块,而是这些模块在实际任务中无缝协同,形成完整的工作链路。下面以一个典型的智能问答流程为例,展示模块间的交互:

• 输入处理:用户输入经过 Prompt 模板模块加工生成最终模型提示语

• 模型调用:LLM 模块接收提示,执行语言模型推理,生成回答候选结果

• 记忆注入:Memory 模块将历史对话或相关上下文拼接到 Prompt 中,增强模型理解能力

• 工具调用:Agent 根据模型的指令判断是否调用外部工具(如知识库查询或计算器)

• 结果整合:工具返回结果后,Agent 结合模型结果生成最终输出

• 输出返回:将处理后的结果返回给用户或业务系统

这种流程可高度自定义,比如替换不同 LLM 模型、调整 Prompt 策略、扩展工具接口,实现针对具体业务的最佳性能。

四、LangChain 的技术实现细节

1. Prompt 模板动态生成机制

LangChain 内部实现了强大的模板引擎,支持多变量替换和条件逻辑。它能将静态模板转化为带参数的动态字符串,方便实现灵活的上下文拼接。

这种机制通过定义“输入变量列表”和“模板字符串”,并使用 format 函数替换变量完成。多轮对话时,历史对话内容也会作为变量注入。

2. 内存模块的数据结构设计

记忆模块常用的数据结构包括:

• 环形缓冲区:保存有限长度的对话历史,保证上下文窗口大小控制

• 向量数据库:将关键上下文编码成向量,利用相似度搜索实现长期记忆检索

• KV 存储:键值对结构存储用户状态,快速读写

这些设计保证了上下文数据的高效存储与调用,避免模型上下文溢出。

3. Agent 决策逻辑的实现

Agent 利用语言模型自身的推理能力,通过解析模型输出指令来决定后续动作,比如调用哪个工具或继续与用户交互。

实现方式通常是:

• 语言模型生成类似自然语言的“行动计划”

• 解析行动计划,将指令映射成具体函数调用

• 根据工具返回结果更新状态,形成闭环交互

这种“模型+规则”混合的方法,提高了灵活性和可靠性。

五、性能和扩展性分析

LangChain 在性能上既依赖语言模型本身,也受模块设计影响。合理使用缓存(如 Prompt 缓存、Memory 缓存)和并行化工具调用可显著提升响应速度。

扩展性方面,LangChain 设计开放,支持:

• 自定义 Prompt 模板

• 插入任意第三方工具接口

• 灵活定义 Chain 流程

• 多模型混合使用

这使得 LangChain 能适应从小型项目到大型复杂系统的多种需求。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)