AIOps实战指南

AIOps代表了运维工作的未来形态,但成功实施需要扎实的基础和清晰的路线图。核心在于构建数据驱动的决策体系,而非简单堆砌AI技术。随着实践的深入,可逐步探索以下进阶方向:•多模态学习:结合指标、日志、追踪等多种数据类型•强化学习:让系统通过反馈不断优化决策策略•因果推理:超越相关性,理解系统行为的因果机制•知识图谱:积累和复用运维经验通过持续迭代和优化,AIOps能真正实现从"人工救火"到"智能预

AIOps实战指南:从原理到落地的智能运维体系

什么是AIOps?它如何改变传统运维模式

AIOps(Artificial Intelligence for IT Operations)本质上是通过机器学习和大数据分析技术,让IT系统具备自主感知、决策和执行能力的智能体系。与传统运维相比,它的核心差异在于:

• 从规则驱动到数据驱动:不再依赖人工设定静态阈值,而是通过算法自动学习系统行为模式

• 从事后处理到事前预测:能在故障发生前识别异常趋势,提前干预

• 从人工操作到自动闭环:发现问题后能自动执行修复流程,无需等待人工介入

这种转变的关键在于三个核心技术支柱:可观测性数据、智能分析算法和自动化执行引擎。三者形成"感知-思考-行动"的完整闭环,让运维体系具备类似人类的决策能力,但又远超人类的处理速度和规模。

AIOps的核心架构与数据流

一个完整的AIOps系统通常由以下几个关键模块组成:

数据采集层

这一层负责从各个系统组件收集原始数据,主要包括:

• 指标数据:CPU、内存、磁盘IO等系统指标,通常通过Prometheus、Telegraf等工具采集

• 日志数据:系统日志、应用日志,常用ELK或Loki栈处理

• 追踪数据:分布式调用链信息,Jaeger或SkyWalking是常见选择

• 拓扑数据:服务间依赖关系,通常来自CMDB或服务网格

以下是Prometheus配置的一个典型示例,用于采集节点和容器指标:

scrape_configs:

- job_name: 'node'

static_configs:

- targets: ['node-exporter:9100']

- job_name: 'docker'

static_configs:

- targets: ['cadvisor:8080']

数据处理与分析层

这一层对原始数据进行清洗、聚合和特征提取,为上层算法提供结构化输入:

• 流处理引擎:如Flink或Kafka Streams,实时处理数据流

• 时序数据库:VictoriaMetrics或InfluxDB,存储和查询指标数据

• 特征工程:提取有意义的模式,供机器学习模型使用

一个简单的异常检测特征提取示例:

def extract_features(ts_data):

features = {

'mean': np.mean(ts_data),

'std': np.std(ts_data),

'slope': calculate_trend_slope(ts_data),

'periodicity': detect_periodicity(ts_data)

}

return features

智能决策层

这是AIOps的大脑,包含各种机器学习模型和规则引擎:

• 异常检测模型:识别偏离正常模式的行为

• 根因分析引擎:关联多维度数据,定位问题源头

• 预测模型:预测资源需求、故障风险等

• 策略引擎:决定何时以及如何采取行动

执行层

负责将决策转化为实际行动:

• 自动化脚本:执行具体的修复操作

• 编排引擎:协调复杂的跨系统操作

• 通知系统:在需要人工介入时发出警报

AIOps的三大核心能力解析

智能异常检测:超越静态阈值

传统监控依赖人工设定静态阈值,而AIOps采用动态基线技术。核心算法包括:

• 时间序列分析:ARIMA、Prophet等模型学习指标的正常波动模式

• 无监督学习:聚类和异常检测算法发现未知异常模式

• 深度学习:LSTM等网络处理复杂非线性模式

一个基于动态基线的异常检测示例:

def detect_anomaly(current_value, baseline):

# 计算当前值与基线的偏离程度

deviation = abs(current_value - baseline.mean) / baseline.std

# 动态调整敏感度

sensitivity = adjust_sensitivity_based_on_seasonality()

if deviation > sensitivity * baseline.std_threshold:

return True

return False

这种方法能适应业务的周期性变化,比如电商平台的流量在促销期间自然增长不会被误判为异常。

根因分析:穿透表象看本质

当系统出现问题时,AIOps能自动分析海量数据,找出根本原因。关键技术包括:

• 拓扑分析:基于服务依赖图定位问题传播路径

• 事件关联:将分散的异常事件聚类为相关组

• 知识图谱:利用历史经验加速问题诊断

以下是基于拓扑的简单根因分析逻辑:

def find_root_cause(alert, topology):

affected_service = alert.service

# 向上游追溯依赖链

for dependency in topology.get_upstream_dependencies(affected_service):

if check_service_health(dependency) == 'unhealthy':

return find_root_cause(create_alert(dependency), topology)

return affected_service

自动化修复:从诊断到行动的闭环

AIOps不仅能发现问题,还能自动解决问题。常见策略包括:

• 服务重启:对无状态服务进行滚动重启

• 流量调度:将流量从故障节点转移

• 资源调整:自动扩容或释放资源

一个自动扩容的决策逻辑示例:

def auto_scaling_decision(metrics):

cpu = metrics['cpu_usage']

rps = metrics['requests_per_second']

if cpu > 80 and rps > 1000:

return {'action': 'scale_out', 'amount': 2}

elif cpu < 30 and rps < 300:

return {'action': 'scale_in', 'amount': 1}

return {'action': 'no_op'}

关键技术实现细节

高效日志分析实战

日志是运维的宝贵数据源,但非结构化特性使其难以分析。AIOps采用以下方法:

• 日志解析:将非结构化日志转换为结构化事件

• 模式挖掘:发现频繁出现的日志模式

• 异常检测:识别罕见的异常日志序列

一个简单的日志解析规则示例:

def parse_log_line(line):

# 解析常见的日志格式,如:

# [2023-01-01 12:00:00] ERROR serviceA: Connection timeout

pattern = r'\[(.*?)\] (\w+) (\w+): (.*)'

match = re.match(pattern, line)

if match:

return {

'timestamp': match.group(1),

'level': match.group(2),

'service': match.group(3),

'message': match.group(4)

}

return None

指标异常检测算法比较

不同场景适合不同的异常检测算法:

• 统计方法:适合平稳时间序列,计算量小

• 机器学习:能处理复杂模式,但需要更多数据

• 深度学习:对非线性关系建模能力强,但解释性差

以下是几种算法的简单对比:

# 统计方法:3-sigma原则

def sigma_rule(data_point, history):

mean = np.mean(history)

std = np.std(history)

return abs(data_point - mean) > 3 * std

# 机器学习:隔离森林

from sklearn.ensemble import IsolationForest

clf = IsolationForest(contamination=0.01)

clf.fit(training_data)

# 深度学习:LSTM自动编码器

from keras.models import Sequential

model = Sequential()

# 添加LSTM层和编码器结构

model.compile(optimizer='adam', loss='mse')

分布式追踪与拓扑发现

微服务架构中,理解服务间依赖至关重要。实现方法包括:

• 注入追踪头:在请求间传递唯一ID

• 构建调用图:分析服务间调用关系

• 动态拓扑发现:适应服务实例的动态变化

一个简单的追踪数据收集示例:

@app.middleware('http')

async def add_correlation_id(request: Request, call_next):

# 从请求头获取或生成追踪ID

corr_id = request.headers.get('X-Correlation-ID', str(uuid.uuid4()))

# 注入到当前上下文

tracing.set_correlation_id(corr_id)

response = await call_next(request)

# 将ID添加到响应头

response.headers['X-Correlation-ID'] = corr_id

return response

性能优化与实战技巧

实时处理与批处理的平衡

AIOps系统需要平衡实时性和处理深度:

• 流处理:低延迟,适合快速响应

• 批处理:高吞吐,适合复杂分析

• Lambda架构:结合两者优势

一个简单的混合处理策略:

def process_data(data):

# 实时处理:快速异常检测

if is_urgent(data):

real_time_analysis(data)

# 批量处理:深入分析

else:

batch_queue.put(data)

模型更新与漂移检测

数据分布变化会导致模型性能下降,解决方法包括:

• 持续监控模型指标:如准确率、召回率

• 概念漂移检测:识别数据分布变化

• 在线学习:逐步适应新数据

模型漂移检测示例:

def detect_drift(new_data, reference_data):

# 计算特征分布的差异

distance = wasserstein_distance(

new_data['feature'],

reference_data['feature']

)

return distance > DRIFT_THRESHOLD

资源利用优化

AIOps系统自身也需要优化资源使用:

• 数据采样:对非关键指标降采样

• 模型轻量化:使用更高效的算法

• 缓存策略:减少重复计算

自适应采样策略示例:

def should_sample(metric_name, current_value):

# 关键指标全量采集

if metric_name in CRITICAL_METRICS:

return True

# 非关键指标采样

return random.random() < SAMPLING_RATE

安全与稳定性考量

权限与访问控制

自动化系统需要严格的安全措施:

• 最小权限原则:每个组件只拥有必要权限

• 操作审计:记录所有自动化操作

• 审批流程:关键操作需人工确认

使用Vault管理凭据的示例:

def get_secret(secret_name):

client = hvac.Client(url=VAULT_ADDR, token=VAULT_TOKEN)

secret = client.read(f'secret/data/{secret_name}')

return secret['data']['data']

熔断与回滚机制

自动化操作可能出错,必须包含安全措施:

• 熔断机制:连续失败时停止自动操作

• 操作回滚:修复失败后恢复原状态

• 影响评估:预测操作可能造成的影响

简单的熔断器实现:

class CircuitBreaker:

def __init__(self, max_failures=3):

self.failures = 0

self.max_failures = max_failures

def execute(self, operation):

if self.failures >= self.max_failures:

raise CircuitOpenError

try:

result = operation()

self.failures = 0

return result

except Exception:

self.failures += 1

raise

落地实施策略

渐进式实施路径

建议分阶段引入AIOps能力:

- 基础监控自动化:统一数据采集,建立基线

- 智能告警:减少噪音,提高告警质量

- 根因分析:加速问题定位

- 自动化修复:对已知问题自动处理

- 预测性维护:主动预防问题发生

关键成功因素

• 数据质量:确保采集数据的完整性和准确性

• 场景选择:从高频、高价值场景入手

• 人机协作:AI辅助人类,而非完全替代

• 持续迭代:根据反馈不断优化模型和策略

常见陷阱与规避

• 过度自动化:保留关键环节的人工确认

• 忽视解释性:确保决策过程可理解

• 数据孤岛:打破系统间数据壁垒

• 技能缺口:培养团队的数据科学能力

典型应用场景详解

容量预测与自动扩缩

基于历史负载模式预测未来需求,自动调整资源:

def predict_capacity(history, growth_factor=1.2):

# 使用时间序列模型预测基础需求

base_demand = arima_model.predict(history)

# 考虑业务增长因素

adjusted = base_demand * growth_factor

# 计算所需实例数

return math.ceil(adjusted / INSTANCE_CAPACITY)

日志异常模式发现

从海量日志中自动识别异常模式:

def detect_log_anomalies(logs):

# 将日志转换为向量

vectors = [log_to_vector(log) for log in logs]

# 使用聚类发现异常点

clusters = DBSCAN().fit_predict(vectors)

# 小簇或噪声点很可能是异常

return [log for log, cluster in zip(logs, clusters)

if cluster == -1 or Counter(clusters)[cluster] < 5]

跨系统故障关联

当多个系统同时出现异常时,找出根本原因:

def correlate_events(events, topology):

# 构建事件图

graph = build_event_graph(events, topology)

# 寻找中心节点

centrality = nx.betweenness_centrality(graph)

# 最中心的节点很可能是根因

return max(centrality.items(), key=lambda x: x[1])[0]

总结与进阶方向

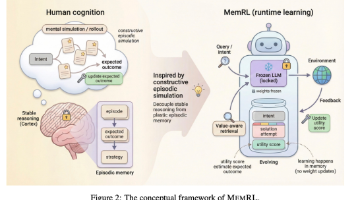

AIOps代表了运维工作的未来形态,但成功实施需要扎实的基础和清晰的路线图。核心在于构建数据驱动的决策体系,而非简单堆砌AI技术。随着实践的深入,可逐步探索以下进阶方向:

• 多模态学习:结合指标、日志、追踪等多种数据类型

• 强化学习:让系统通过反馈不断优化决策策略

• 因果推理:超越相关性,理解系统行为的因果机制

• 知识图谱:积累和复用运维经验

通过持续迭代和优化,AIOps能真正实现从"人工救火"到"智能预防"的转变,释放运维团队的创造力,让IT系统运行更加稳定高效。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)