[论文阅读] AI + 软件工程 | AI编码代理的代码评审融合之道:协作信号才是核心关键

自主编码代理日益频繁地在GitHub提交拉取请求(PR),但这类贡献如何融入人类主导的代码评审工作流仍知之甚少。本研究基于公共AIDev数据集对代理编写的PR开展大规模实证研究,分析其整合结果、决议速度和评审期协作信号。通过带仓库聚类标准误的逻辑回归发现,评审者参与度与整合成功的相关性最强,而更大的改动量、强制推送等破坏协调的行为会降低合并概率,考虑协作信号后,单纯的迭代强度仅具有有限的解释力。定

AI编码代理的代码评审融合之道:协作信号才是核心关键

论文信息

原标题

When AI Teammates Meet Code Review: Collaboration Signals Shaping the Integration of Agent-Authored Pull Requests

主要作者及研究机构

Costain Nachuma(美国爱达荷州立大学)、Minhaz F. Zibran(美国爱达荷州立大学)

引文格式(GB/T 7714)

NAHUMA C,ZIBRAN M F. When AI Teammates Meet Code Review: Collaboration Signals Shaping the Integration of Agent-Authored Pull Requests[C]//23rd International Conference on Mining Software Repositories (MSR ’26). Rio de Janeiro: ACM,2026.

研究背景

如今AI编码代理早已不只是简单的代码生成工具,Devin、Codex、Copilot等工具能自主在GitHub提交修复bug、新增功能、扩展测试套件的拉取请求(PR),软件研发进入人-AI混合协作的新阶段。

但行业里一直存在两大核心问题:一是大家只知道AI PR的整体采纳率在上升,却不清楚这些PR到底能多可靠地完成整合、从提交到决议要花多久,不同AI代理的表现差异也无明确数据;二是此前的研究多把AI PR当成单纯的技术代码产物,忽略了代码评审本就是技术+社会协作的双重过程,没人搞清楚评审时的协作信号(比如迭代行为、评审者参与、是否强制推送)到底如何影响AI PR的整合结果。

就像人类开发者提交PR时,不仅代码要对,还要契合团队的评审习惯、沟通节奏,AI代理也面临同样问题——哪怕代码质量再高,若频繁强制推送打乱评审节奏、提交的改动量过大增加评审负担,也很难被合并,这也是当下很多研发团队引入AI编码代理后,发现其实际落地效率远低于预期的关键原因。

创新点

- 研究视角创新:首次将AI PR的整合从“纯技术代码评价”升级为社会技术协作过程研究,打破了此前仅关注AI代码生成质量的单一视角,聚焦评审期的协作信号对整合结果的影响。

- 研究维度创新:同时从定量+定性双维度分析AI PR整合,定量通过逻辑回归识别关键协作信号的关联作用,定性通过样本编码拆解信号背后的实际协作机制,实现“是什么影响整合”到“为什么影响整合”的深度解答。

- 研究数据创新:基于目前最系统的AIDev AI PR数据集,筛选热门仓库的3万+样本建立AI PR整合基线数据,明确了不同主流AI编码代理的整合表现差异,为行业提供了可参考的基准。

- 结论价值创新:推翻了“AI PR迭代次数越多、加测越多越容易合并”的固有认知,证实协作信号的重要性远大于单纯的活动量,为AI编码代理的优化和人-AI研发团队的协作规范制定提供了实证依据。

一段话总结

该研究基于AIDev数据集对33,596个由AI编码代理提交的GitHub拉取请求(PR)开展大规模实证分析,探究其整合结果、解决速度及评审期协作信号的影响,发现71.5%的AI生成PR最终合并,且不同代理的合并率和决议延迟差异显著(如OpenAI_Codex合并率82.6%、中位数决议时间不足1小时,Copilot合并率仅43.0%);通过逻辑回归分析得出评审者参与度是PR成功整合的最强相关因素,而大改动量、强制推送等破坏协调的行为会降低合并概率,单纯的迭代强度解释力有限;定性分析则表明AI代理参与可操作的评审循环并贴合评审者预期是整合成功的关键,研究最终指出AI生成PR的有效整合不仅取决于代码质量,更需契合既定的代码评审和协作规范。

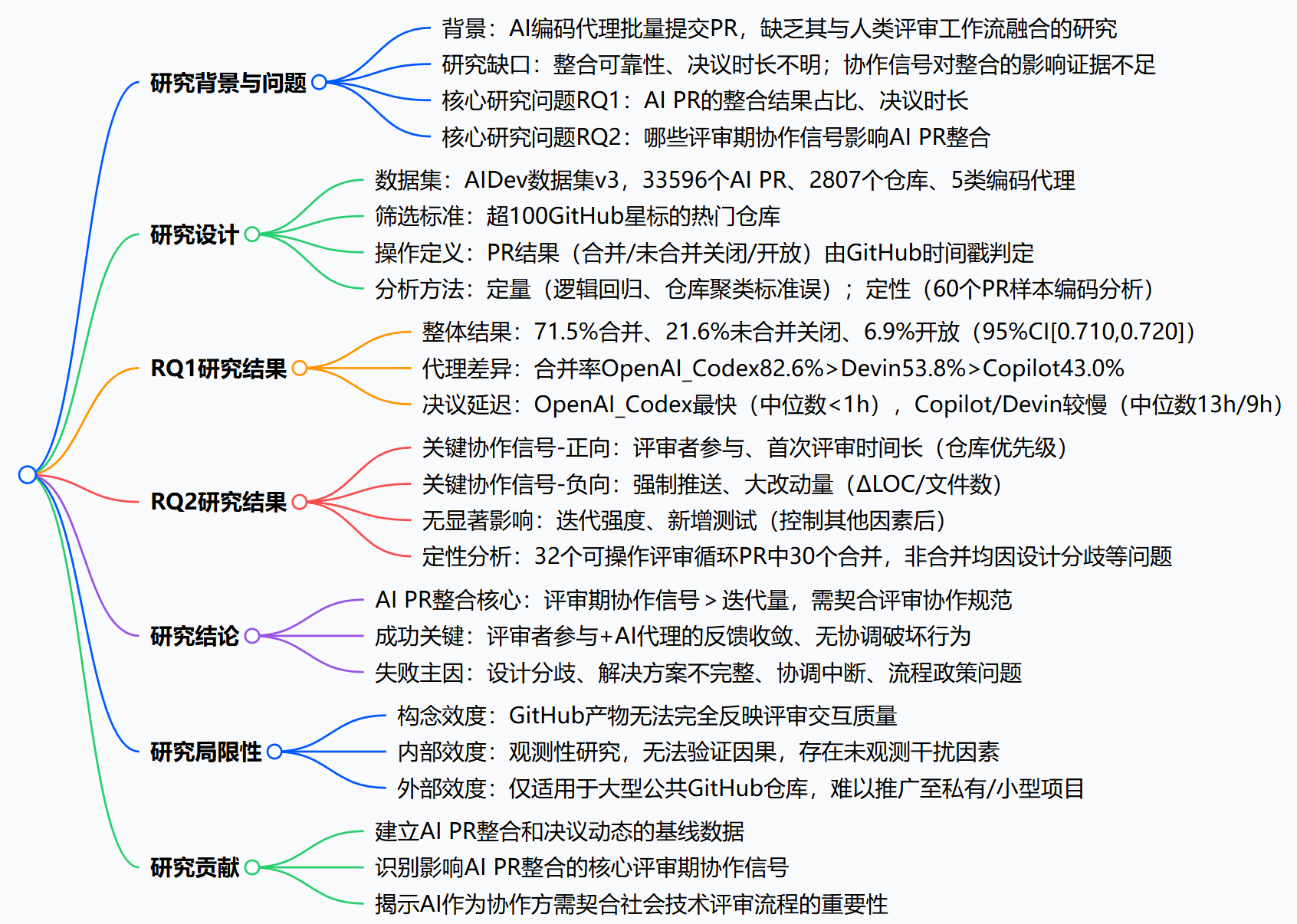

思维导图

详细总结

本研究由美国爱达荷州立大学的Costain Nachuma和Minhaz F. Zibran开展,发表于2026年第23届挖掘软件仓库国际会议(MSR ’26),聚焦AI编码代理提交的拉取请求(PR)与人类代码评审工作流的融合问题,通过定量+定性的实证分析,揭示了影响AI PR整合的关键因素,核心结论强调AI协作需契合代码评审的社会技术规范。以下为分维度详细研究内容:

一、研究背景与核心问题

- 研究动因:自主AI编码代理已能在GitHub提交修复bug、新增功能的PR,但现有研究仅关注其采纳率,缺乏对AI PR与人类评审工作流融合效果的探究,且PR整合是技术正确性与社会协作流程结合的结果,AI作为协作方的表现尚未明确。

- 研究缺口:① 无法确定AI PR的整合可靠性、决议时长;② 缺乏评审期协作信号(迭代行为、评审者参与等)对AI PR整合影响的实证证据。

- 核心研究问题

- RQ1:AI PR的合并、未合并关闭、开放的占比?已决议PR的耗时如何?

- RQ2:哪些评审期协作信号与AI PR的成功整合相关?

二、研究设计与数据基础

- 数据集:采用Zenodo的AIDev数据集v3(2025年11月获取),筛选超100GitHub星标的热门仓库,最终纳入33,596个AI PR,涉及1,797名开发者、2,807个仓库、5类主流AI编码代理。

- 操作定义:通过GitHub时间戳明确PR结果,避免歧义

- 合并:merged_at非空;未合并关闭:closed_at非空且merged_at为空;开放:两者均为空。

- 决议时长:PR创建时间至决议时间(合并/关闭)的耗时,因数据右偏同时报告均值和中位数。

- 分析方法

- 定量分析:构建逻辑回归模型(仓库聚类标准误),将PR整合设为二分类结果(合并/未合并关闭),分析协作信号与整合的关联;

- 定性分析:随机+目的性选取60个AI PR样本,通过预定义编码手册分析影响整合结果的主导机制。

- 协作信号维度:迭代与改动量、协调稳定性、评审者参与度,具体包括提交次数、代码变更量(ΔLOC)、文件修改数、是否新增测试、是否强制推送、是否有评审、首次评审时间等。

三、RQ1:AI PR的整合与决议结果

- 整体整合占比:在33,596个AI PR中,71.5%合并(95%置信区间[0.710,0.720])、21.6%未合并关闭、6.9%仍处于开放状态,说明多数AI PR能完成整合,但仍有近30%存在整合失败或未决议问题。

- 不同AI代理的结果差异

AI代理 合并率 决议延迟(中位数) 决议延迟(均值) OpenAI_Codex 82.6% <1小时 ≈19.4小时 Devin 53.8% 9小时 80-100小时 Copilot 43.0% 13小时 80-100小时 注:Claude_Code、Cursor无具体数值,但整体表现介于上述代理之间,Copilot的开放占比显著高于其他代理。 - 核心结论:AI PR的整合成功率和决议速度因代理差异显著,说明整合效果不仅取决于代码正确性,还与AI代理带来的人类评审交互、协调成本相关。

四、RQ2:影响AI PR整合的协作信号

(一)定量回归分析结果(核心关联因素)

- 正向最强相关:评审者参与度(是否收到至少1次评审),有评审的AI PR合并概率大幅提升,说明评审者会选择性为可行的AI PR投入精力。

- 负向相关因素:① 强制推送(破坏协调,降低合并概率,因重写提交历史会增加评审者的协调成本);② 大改动量(代码变更量ΔLOC、修改文件数越多,合并概率越低,评审者对AI PR采用与人类PR相同的风险判断)。

- 无显著独立影响:迭代强度、新增测试,在控制评审者参与度和协调稳定性后,单纯增加提交次数、新增测试无法提升合并概率。

- 特殊关联:首次评审时间越长,合并概率越高(非直接因果,反映仓库的工作流优先级分配)。

- 模型稳健性:分别用提交次数分桶、对数化提交次数衡量迭代强度,两个模型的结果一致,验证了结论的可靠性。

(二)定性样本分析结果(60个PR,30合并/30未合并)

通过编码分析识别了影响PR整合的7类主导机制,核心结果如下表:

| 主导机制 | PR数量 | 合并数 | 未合并数 | 核心结果 |

|---|---|---|---|---|

| 可操作的评审循环 | 32 | 30 | 2 | 成功主因 |

| 设计分歧 | 10 | 0 | 10 | 失败主因 |

| 解决方案不完整 | 7 | 0 | 7 | 失败因素 |

| 流程/政策问题 | 3 | 0 | 3 | 失败因素 |

| 协调中断 | 2 | 0 | 2 | 失败因素 |

| CI错误/失败 | 2 | 0 | 2 | 失败因素 |

| 其他(范围/风格等) | 4 | 0 | 4 | 失败因素 |

- 成功关键:可操作的评审循环,即评审者给出具体反馈,AI代理针对性修订并贴合评审者预期,这也解释了评审者参与度与合并率的强正相关。

- 失败主因:设计/架构分歧(与项目原则不符)、协调中断(如强制推送)、解决方案不完整,且这类问题无法通过单纯的迭代修复。

- 核心结论:迭代量无意义,基于反馈的收敛才是AI PR整合成功的关键。

五、相关工作与研究局限性

- 相关工作:现有研究已证实人类PR的整合是社会技术过程,受技术和社会因素共同影响;AIDev数据集首次记录了AI PR的规模化提交,但未探究其与评审流程的融合,本研究填补了这一空白。

- 威胁到效度的因素

- 构念效度:通过GitHub产物(评审、提交)推断协作,无法完全反映评审者意图和交互质量;

- 内部效度:观测性研究,无法验证因果关系,存在未观测的项目规范、评审者习惯等干扰因素;

- 外部效度:仅分析大型公共GitHub仓库的AI PR,结论难以推广至私有项目、小型社区或未来新AI代理。

六、研究结论与贡献

- 核心结论:AI编码代理提交的PR的有效整合,评审期协作信号的重要性远大于迭代量,不仅取决于代码质量,更需要契合既定的代码评审和协调规范;成功的关键是评审者参与下的反馈收敛,而大改动量、破坏协调的行为会显著降低整合成功率。

- 研究贡献

- 建立了AI PR整合和决议动态的基线数据,明确了不同AI代理的表现差异;

- 识别了影响AI PR整合的核心评审期协作信号,为优化AI编码代理的协作能力提供实证依据;

- 揭示了AI作为软件研发协作方,需融入人类主导的社会技术评审流程的重要性,为混合人-AI软件团队的发展提供指导。

- 公开资源:研究发布了完整的可复现包,包含所有分析脚本,支持结果验证和后续研究。

关键问题

问题1(研究数据与基础层面):该研究分析的AI PR数据集有哪些核心特征,不同AI编码代理的整合表现差异体现在哪里?

答案:研究采用AIDev数据集v3,筛选超100GitHub星标的热门仓库,最终纳入33,596个AI PR,涉及2807个仓库、5类AI编码代理;不同代理的整合表现差异显著,体现在合并率和决议延迟两方面,其中OpenAI_Codex合并率最高(82.6%)且决议最快(中位数<1小时),Devin合并率53.8%、中位数决议时间9小时,Copilot合并率最低(43.0%)且决议较慢(中位数13小时),同时Copilot的PR开放占比显著高于其他代理。

问题2(核心影响因素层面):哪些评审期协作信号对AI PR的成功整合起关键作用,各信号的影响方向和机制是什么?

答案:核心协作信号及影响为:①评审者参与度(正向最强),有评审的AI PR合并概率大幅提升,因评审者会为可行的AI PR选择性投入精力,且有效参与会形成可操作的评审循环;②强制推送(负向),作为破坏协调的行为,重写提交历史会增加评审者协调成本、破坏共享理解,降低合并概率;③大改动量(负向),代码变更量ΔLOC和修改文件数越多,评审负担越大,评审者对AI PR采用与人类PR相同的风险判断,合并概率降低;④迭代强度、新增测试(无显著独立影响),在控制评审者参与和协调稳定性后,单纯的迭代和加测无法提升合并概率;⑤首次评审时间(正向),并非延迟评审的直接作用,而是反映了仓库的工作流优先级分配。

问题3(研究实践启示层面):该研究的结论对优化AI编码代理的研发、推动混合人-AI软件研发团队的协作有哪些核心实践启示?

答案:核心实践启示包括:① 对AI编码代理研发:需弱化单纯的代码迭代、测试生成能力,重点优化基于人类评审反馈的针对性修订能力,让代理能参与可操作的评审循环并向评审者预期收敛,同时避免强制推送等破坏协调的行为,控制PR的改动量以降低人类评审负担;② 对混合人-AI软件团队协作:需建立适配AI PR的评审规范,明确AI PR的改动量阈值、提交规则,减少协调成本;人类评审者需为AI PR提供具体、可操作的反馈,而非模糊评价,推动AI代理的反馈收敛;③ 对项目管理:在引入AI编码代理时,需考虑不同代理的协作表现差异,结合项目需求选择适配的AI代理,同时建立AI PR的优先级评审机制,提升整合效率。

研究方法和思路

本研究围绕两个核心研究问题(RQ1/RQ2)展开,整体采用**“数据准备→定量分析→定性验证→结论总结”**的研究思路,方法拆解为以下6个步骤,其中创新的混合分析方法是核心:

步骤1:数据集选取与筛选

采用Zenodo上的AIDev数据集(v3,2025年11月获取),这是目前记录AI编码代理PR的最系统数据集;按数据集作者建议,筛选至少100个GitHub星标的热门仓库,最终得到33596个AI PR样本,涉及1797名开发者、2807个仓库、5类主流AI编码代理(OpenAI_Codex、Copilot、Devin、Cursor、Claude_Code)。

步骤2:核心概念操作定义

为避免歧义,通过GitHub原生时间戳明确定义PR结果和决议时长,这是后续分析的基础:

- 合并:merged_at字段非空;未合并关闭:closed_at非空且merged_at为空;开放:两者均为空;

- 决议时长:PR创建时间(created_at)到决议时间(合并/关闭时间)的耗时,因数据右偏,同时报告均值和中位数。

步骤3:RQ1定量描述性分析

针对“AI PR整合结果占比、决议时长”问题,统计样本的合并/未合并关闭/开放的占比(计算95%威尔逊置信区间),并按不同AI代理分组,对比各代理的合并率和决议延迟差异,建立AI PR整合的基线数据。

步骤4:RQ2定量回归分析

针对“哪些协作信号影响AI PR整合”问题,构建逻辑回归模型(带仓库聚类标准误,提升结果可靠性):

- 因变量:PR整合结果(二分类:合并=1,未合并关闭=0);

- 自变量:三类评审期协作信号(迭代与改动量:提交次数、log(1+ΔLOC)、修改文件数;协调稳定性:是否强制推送、是否新增测试;评审者参与度:是否有评审、log(1+首次评审时间)),同时加入AI代理指示变量控制代理差异;

- 模型稳健性验证:分别用**提交次数分桶(Model A)和对数化提交次数(Model B)**衡量迭代强度,对比两个模型的结果,确保结论可靠;

- 结果解读:以比值比(Odds Ratio)为核心指标,分析各协作信号与PR合并的关联方向和强度。

步骤5:RQ2定性样本编码分析

为解释定量结果背后的实际协作机制,选取60个AI PR样本(随机+目的性选取,30合并/30未合并):

- 制定编码手册:基于此前人类PR评审的研究成果,结合AI PR评审线程预调研,确定7类影响整合结果的主导机制;

- 编码与分歧解决:为每个PR标注核心主导机制,研究者间的分歧通过讨论统一;

- 结果分析:统计不同机制下的PR合并/未合并数量,拆解AI PR整合成功/失败的实际原因。

步骤6:结果整合与讨论

结合RQ1和RQ2的定量、定性结果,分析AI PR整合的核心规律,同时梳理研究的构念、内部、外部效度威胁,确保研究结论的严谨性。

主要成果和贡献

一、核心研究成果

本研究的两大核心研究问题均得到明确解答,核心结果通过表格清晰归纳,同时给出了不同AI代理的表现基准和关键协作信号的影响规律:

| 研究问题 | 研究方法 | 核心结论 |

|---|---|---|

| RQ1:AI PR整合结果占比、决议时长 | 描述性统计(分组对比) | 1. 整体:71.5%合并(95%CI[0.710,0.720])、21.6%未合并关闭、6.9%开放; 2. 代理差异:合并率OpenAI_Codex(82.6%)>Devin(53.8%)>Copilot(43.0%);决议速度OpenAI_Codex最快(中位数<1h),Copilot/Devin较慢(中位数13h/9h); 3. 核心规律:AI PR整合效果不仅取决于代码质量,还与人类评审的交互、协调成本相关。 |

| RQ2:哪些协作信号影响AI PR整合 | 逻辑回归+定性样本编码 | 1. 正向最强关联:评审者参与度(有评审的AI PR合并概率大幅提升); 2. 负向关联:强制推送(破坏协调)、大改动量(增加评审负担); 3. 无显著独立影响:迭代强度、新增测试(控制其他因素后,单纯迭代/加测无意义); 4. 成功关键:AI代理参与可操作的评审循环(评审者给具体反馈,AI针对性修订并贴合预期); 5. 失败主因:设计分歧、解决方案不完整、协调中断、流程/政策问题。 |

不同AI编码代理PR整合关键指标对比

| AI代理 | 合并率 | 决议延迟(中位数) | 决议延迟(均值) | 核心特征 |

|---|---|---|---|---|

| OpenAI_Codex | 82.6% | <1小时 | ≈19.4小时 | 整合表现最优,适配评审流程能力最强 |

| Devin | 53.8% | 9小时 | 80-100小时 | 表现中等,决议速度优于Copilot |

| Copilot | 43.0% | 13小时 | 80-100小时 | 合并率最低,开放占比显著偏高,适配性最弱 |

二、研究贡献

本研究为软件研发领域的人-AI混合协作提供了首个系统的AI PR整合实证依据,带来的实实在在的价值体现在三个层面:

- 行业基准层面:建立了AI PR整合和决议动态的基线数据,明确了主流AI编码代理的表现差异,为研发团队选择AI编码代理提供了可参考的量化标准;

- AI代理研发层面:为AI编码代理的优化指明了方向——无需盲目提升迭代、代码生成能力,重点要优化基于人类反馈的针对性修订能力,同时规避强制推送等破坏协调的行为,控制PR改动量;

- 团队协作层面:为混合人-AI研发团队制定协作规范提供了实证依据,明确了“契合评审协作规范”比“单纯的代码活动量”更重要,指导团队建立适配AI PR的评审流程(如明确改动量阈值、要求评审者给出具体反馈)。

三、开源资源

研究发布了完整的可复现包,包含所有实现分析的脚本,可通过以下地址获取:doi:10.5281/zenodo.17860503;

研究使用的AIDev数据集(v3)地址:doi:10.5281/zenodo.16919272。

总结

本研究基于AIDev数据集对33596个AI编码代理提交的PR开展了大规模实证分析,探究了AI PR的整合结果、决议速度及评审期协作信号的影响。研究发现,尽管整体71.5%的AI PR能成功合并,但不同AI代理的整合表现和决议速度差异显著;通过逻辑回归分析证实,评审者参与度是AI PR成功整合的最强相关因素,而大改动量、强制推送等破坏协调的行为会降低合并概率,单纯的迭代强度和新增测试并无显著独立影响。定性分析进一步表明,AI代理参与可操作的评审循环并贴合评审者预期是整合成功的核心,而设计分歧、协调中断等是主要失败原因。整体而言,AI PR的有效整合不仅取决于代码质量,更需要契合既定的代码评审和协作规范,这一结论为AI编码代理的优化和人-AI混合研发团队的协作管理提供了关键的实证依据。

更多推荐

已为社区贡献116条内容

已为社区贡献116条内容

所有评论(0)