【专题之MARL】 Prescriptive Process Monitoring Under Resource Constraints: A Reinforcement Learning Appro

本文提出了一种基于强化学习(RL)的资源受限规范性流程监控(PrPM)方法。该方法通过预测模型、因果模型和生存模型评估干预的必要性、效果及时机,并结合共形预测技术处理不确定性。离线阶段进行数据预处理并训练预测、因果和生存模型;在线阶段利用RL代理实时决策,动态调整干预策略。系统还包含容量监控组件,跟踪资源利用率和工作量,以优化资源分配。实验表明,该方法能有效平衡干预时机与资源限制,显著提升流程效率

文章目录

文章 :Prescriptive Process Monitoring Under Resource Constraints: A Reinforcement Learning Approach

资源受限下的规范性流程监控:强化学习方法

为了解决这个问题,我们引入了一种基于在线RL的方法来处理PrPM问题,该方法使用预测和因果模型来估计干预的必要性和预期影响,并结合生存模型来估算干预的紧迫性以及采用共形预测技术以考虑不确定性。此外,所提出的方法包括一个容量监控组件,用于跟踪资源利用率和需求强度,将这些参数纳入干预政策中。

一、 Approach

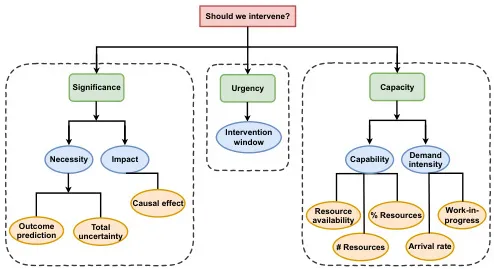

1.1 Factors Influencing Intervention Decisions

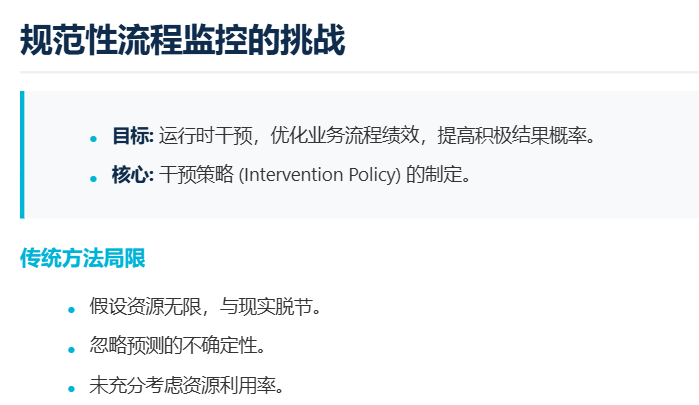

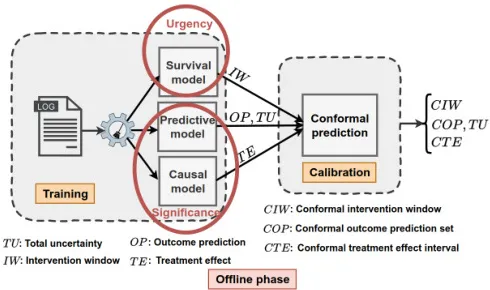

图1:影响干预决策的因素。

这些因素可能会影响代理触发干预并分配资源到特定案例中的能力。如图1所示,这些因素被分类为三个主要维度:重要性(significance)、紧迫性(Urgency)和能力(Capacity)。

显著性 (Significance): 干预是否必要且有效?

必要性 (Necessity): 结果预测 + 总不确定性

影响 (Impact): 因果效应 (TE)

紧迫性 (Urgency): 干预时机是否合适?

干预窗口 (Intervention Window): 生存模型预测

能力 (Capacity): 资源是否允许干预?---->容量

能力 (Capability): 资源可用性、资源比例、工作量---->执行能力

需求强度 (Demand Intensity): 到达率、WIP

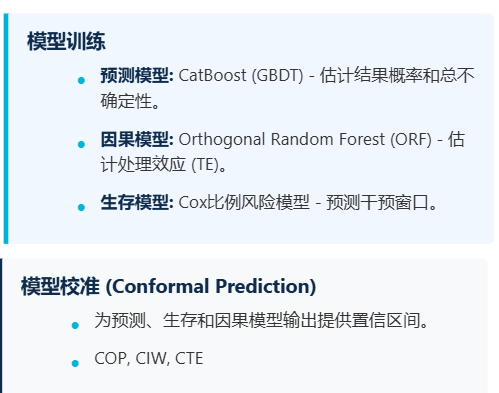

1.2 Offline Phase

图 2:离线阶段的概述。

conformal prection:共形预测

calibration:校准

3.2.1 事件日志预处理

数据准备

数据准备包括数据清洗、案例前缀提取和特征编码。

1️⃣在数据清洗步骤中,我们遵循[32]来删除事件日志中的不完整记录和具有错误时间戳的事件。

2️⃣然后,我们从每个案例中提取长度前缀,反映现实世界场景下需要对不完整的案例做出干预决策的情况。换句话说,每个前缀都表示一个决策点,或RL代理需要决定是否分配资源并执行干预(或不)的状态。

3️⃣第三步是将每个前缀映射到一个特征向量。这是训练机器学习模型所必需的。这个特征编码步骤如下实现:

- 每个案例属性 被映射到一个特征(数值或分类,取决于案例属性的类型)。例如,“贷款类型”是一个分类案例属性。因此它被映射到一个分类特征.

- 每个事件属性都通过所谓的聚合编码方法映射到一组特征,如[32]中定义的。如果一个事件属性是分类的,我们为该属性的每个值引入一个特征。对于给定的事件属性值,相应的特征是一个表示该值在编码案例前缀中出现次数的正整数。例如,如果其中一个属性是“资源”,并且这个属性的一个可能值是“约翰·史密斯”,那么我们将引入一个对应于该属性值“约翰·史密斯”的事件数量的特征。另一方面,数值型事件属性被编码为单个特征,对应于该属性观察到的值的平均值。例如,事件属性“付款到期”被映射到一个对应于该属性值的平均值的特征,这些值是在案例前缀中的事件中观察到的.

- 预测过程监控的先前工作强调了包括时间特征的重要性[31]。因此,我们纳入了与时间戳相关的细节来编码:‘上次事件发生的时间’、‘自案例开始以来的时间’、‘自上次事件发生以来的时间’、‘自午夜以来的时间’、‘月份’、‘星期几’和’小时’

- 我们还可以添加其他与日志相关的属性来捕捉特定于域的需求。例如,在本文后面介绍的贷款发放日志中,我们将包括两个关键属性的变化特征:发送给申请人的贷款提议数量的变化和向申请人提供的月利率变化。

1.2.2 Survival Model

生存模型[12]预测了特定事件(如负面结果)发生之前的时间。这种分析在资源有限的情况下特别有价值,因为它有助于优先处理排队中的病例以及时进行干预,从而避免昂贵的负面事件。目标是平衡过早或过晚干预的成本,认识到时机对于高效资源配置至关重要。因此,我们使用生存模型来确定干预窗口(IW)——即可以在关键事件发生前实施干预的时间范围——这为决策和病例优先级提供了重要的洞见。我们明确地向RL代理提供干预窗口,以加速收敛。此外,与让RL代理在运行时自行推断这些信息相比,这种方法减少了额外的试错步骤的需求。

1.2.3 Predictive Model

之前的工作[29]详细介绍了PrPM的预测模型。预测模型估计每个案例在不同前缀或决策点上的两个关键度量。这些度量是负面结果的概率,表示为结果预测(OP),以及不确定性总量的量化 。OP 是通过聚合来自预测集合的分数来确定的。同时,TU 使用平均预测的熵进行估算,遵循[16]引入的方法.

集成OP和TU在影响不同决策点的触发干预方面发挥了重要作用,使RL代理能够评估干预必要性。

1.2.4 Causal Model

因果模型的主要目标是估计潜在的干预效果。具体来说,它评估了减少负面结果的概率以及相应地增加正面结果的概率。通过比较有无干预时事件发生的概率来完成这一估算。例如,如果在有干预的情况下订单的概率为0.9,在没有干预的情况下为0.3,则干预效果被估算为0.6。因此,量化干预效果对于了解干预措施在减轻负面结果方面的有效性至关重要。

不同的度量,包括个体治疗效果(TE)和条件平均治疗效果(CATE),可以用来表示干预效应。TE量化了在特定决策点接受干预与未接受干预时的结局差异。它使我们能够理解干预如何独特地影响每个前缀。相反,CATE关注的是干预对具有相似特征或状况的子群体的影响平均值。它涉及根据某些属性或状况将数据集划分为组或队列,然后计算每个组的平均治疗效果。因此,CATE帮助我们了解干预对其不同子人群体的影响如何变化,并提供其在各种情况下的有效性见解。TE和CATE对于评估干预效应都是有价值的。然而,由于后者存在一些局限性,我们选择专注于TE而不是CATE,正如[14]所指出的那样.

1.2.5 Calibration

在校准步骤中,我们使用来自共形推断原理的技术( a technique from the conformal inference principles)来生成具有保证置信水平(confidence level)的估计值。值得注意的是,这种技术是模型无关的,意味着它可以应用于任何预测模型以将其估计值转换为具有保证置信水平的估计值。该技术依赖于用户定义的显著性水平( α \alpha α)来产生可靠的估计值,确保 1 − α 1- \alpha 1−α 的置信度。因此,较低的显著性水平对应较高的置信水平。例如,如果用户希望置信度为90%,则显著性水平设置为0.1。

该校准步骤应用于预测、生存和因果估计,特别是OP、IW和TE,以确保预定的置信水平。通过共形推理的原则,这些估计被转化为有效的分类任务预测集(例如,OP)和回归任务区间(例如,IW和TE)。因此,与低置信度的单点估计不同,RL代理具有可靠的估计来做出自信的决策

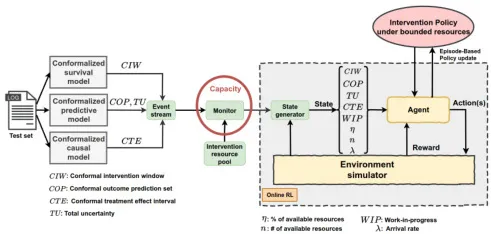

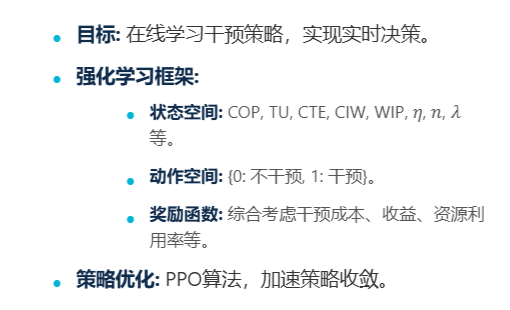

1.3 Online Phase

图 3:在线阶段的概览。

如图3所示,我们使用在线RL算法通过试错和操作化所提出的PrPM方法来学习干预策略。为了学习这个干预策略,RL代理与环境互动,在环境中资源有限的情况下,并在每个状态内做出实时决策。根据代理做出的决策,它会收到奖励或惩罚,具体取决于其决策的质量。随着时间的推移,它通过从这些经验中学习并迭代调整其策略而逐步提高性能,最终收敛到最优的干预策略。代理的目标是通过采取能够产生更高奖励、减少惩罚的行动来实现快速收敛,从而最大化其总收益,即总增益。通过这些持续的学习和适应过程,代理逐渐收敛到一个优化的干预策略上,以最大化总增益。

为了将上述场景转化为不确定性下的PrPM任务,并考虑资源限制,我们的第一步是利用在离线阶段训练的模型。我们使用这些模型来生成反映重要性(COP、TU和 CTE)和紧迫性(CIW)维度的估计值。这些估计值反映了与模型估算相关的不确定性和置信度水平。然后,我们将一个设计用于连续观察事件流的监控组件纳入其中,考虑到到达模式和干预资源的可用性,这由特定领域的知识定义.

该组件主动监控可用资源的数量 ( n ) (n) (n) 和百分比 ( η ) (\eta) (η),以及表示工作负载的案例在进行中的数量( WIP),并根据案例到达率 ( λ ) (\lambda) (λ) 进行干预需求的管理。此外,监控组件还跟踪干预资源池内的可用资源。因此,当RL代理触发针对特定案例的干预时,并且干预资源池内有可用资源时,将分配给所选案例。然后,分配的资源将在预设的处理时间 ( T d u r ) (T_{dur}) (Tdur) 内暂时保留,并在分配的时间结束后释放。这一监控过程显著有助于有效地建模容量维度,确保最优的资源规划。

1.3.1 Learning Problem

重要性、紧迫性和能力的维度被纳入一个状态生成器中,从而创建了一个状态空间。这个状态空间帮助构建一个具有不确定性和有限资源的模拟环境。在这个环境中,代理能够准确地模拟过程执行。因此,代理在每个决策点观察到的状态,并根据这些步骤迭代地重复这一过程,直到模拟结束.

这一迭代过程对于代理的学习过程至关重要,使它能够探索并利用各种干预措施,直到收敛于最大化总收益的最优干预策略。当代理的决策与必要时触发干预的标准一致,并且是有效的、紧急的以及在资源可用时,这种收敛性就得到了体现。这种收敛性通过持续的正向奖励和由此产生的收益来表示。

状态空间包含所有关于正在进行的案件的相关信息。因此,该状态由一个因素的元组表示,包括CIW、COP、TU、CTE、WIP、 η \eta η、n和 λ \lambda λ。这些因素被纳入状态表示中以反映其重要性、紧迫性和容量维度。相应地,这种状态表示指导代理在决定是否以及何时触发干预措施并提前规划时做出明智的决策。

另一方面,干预空间由两个潜在值组成:0,表示不触发干预的决策;1,表示选择触发干预。干预指的是任何能够积极影响可能以负面结果结束的案例的行为。我们假设干预是基于领域知识预定义的。例如,干预可以是对客户打电话提供折扣或降低贷款申请的月利率以增加其获批的可能性。

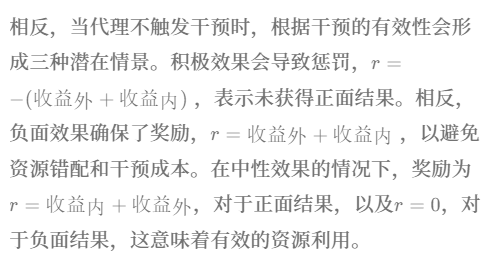

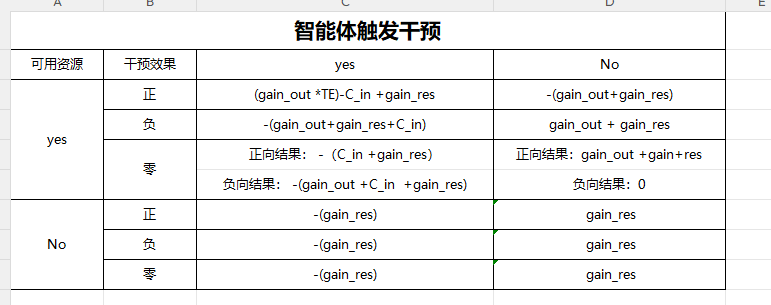

1.3.2 Reward function

上述奖励函数假设对于每个案例,我们都知道如果代理执行干预会有什么结果,以及如果不执行干预会有什么结果。通过这种方式,无论代理采取何种决策(进行干预或不进行干预),我们都可以计算出一个奖励。在实际事件日志中,我们只知道其中一个可能的结果:

(1)如果某个案例中发生了干预,我们知道干预发生时的后果,但不知道如果没有干预会发生什么;

和(2)如果某个案例中没有进行干预,我们知道干预未发生时的后果,但不知道如果进行了干预会发生什么。

为了解决这种信息缺失的问题,并受到[4]的启发,我们使用了一个替代结果估计器,即RealCause[19]。给定一个数据集,在该数据集中每个样本只有一个可能的结果(即对于每个案例,我们要么知道干预发生的后果,要么知道干预未发生时的后果),RealCause估计了假设案例结果遵循伯努利分布的情况下,替代结果的可能性。

在资源不可用的情况下,我们假设干预无法触发,因为资源有限。因此,负面结果不能被阻止。我们根据资源分配来奖励或惩罚代理,在这些情况下,如果代理触发了干预,无论其效果如何,它都会受到惩罚 r = − ( g a i n r e s ) r= -(gain_{res}) r=−(gainres) ,标记为由于资源限制而浪费的努力。相反,如果代理没有触发干预,则会获得等 r = ( g a i n r e s ) r= (gain_{res}) r=(gainres)的奖励,奖励代理选择不进行干预的决定,即使在这种情况下资源不可用.

(Eq.1)

(Eq.1)

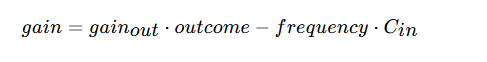

最后,我们估计代理的回合收益,这在每个回合结束后进行更新。随着事件按时间顺序发生,一个回合从观察到给定案例的第一个事件开始,并在观察到该案例的最后一项事件时结束。然后,在每个回合(或案例)结束时更新策略,有效地避免了任何潜在的数据泄露。每回合的收益定义为式1所示。

收益函数考虑了 g a i n o u t gain_{out} gainout ,表示在特定案例结束时实现积极结果的好处。这种好处是根据该案例结束时观察到的结果进行调整的。如果结果是积极的,收益达到最大值。否则,对于积极结果没有收益。此外,这种收益会因干预触发次数(或频率)乘以干预成本而减少。

表1:所提出的奖励函数

翻译:

g a i n o u t gain_{out} gainout:积极结果收益

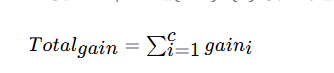

(Eq.2)

(Eq.2)

随着模拟达到其终点, t o t a l g a i n total_{gain} totalgain 被估计,如公式2所示,其中c表示在整个模拟过程中遇到的案例总数。这种估算是通过每个案例或事件中累积的收益之和来确定的,从而提供了一个全面衡量代理整体表现的指标。将奖励函数与总收益分开处理有几个令人信服的原因。首先,这一决定是由资源限制所迫,因为需要有效地考虑可用的资源分配。任何资源的错误分配或不正确使用都会受到惩罚。此外,当奖励函数直接与总收益挂钩时,代理可能会犹豫探索不太熟悉或风险更大的决策。通过分离两者,代理可以更自由地探索,因为收益计算不受这些探索行为的影响

二、Evalution

2.1 实验设计与数据

2.2 实验结果:收敛性分析

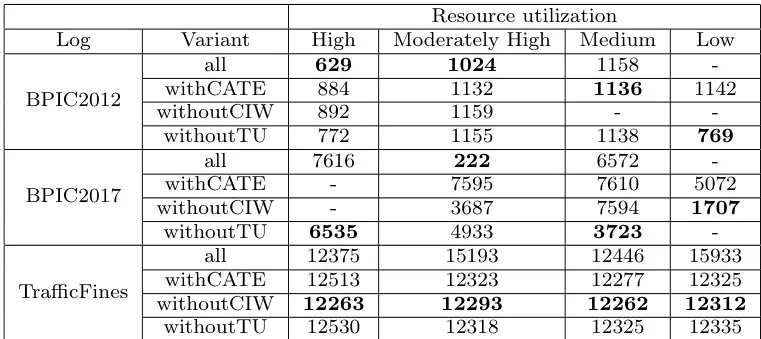

表4:不同资源利用率水平和日志中,针对各种提案变体的收敛速度(以案例数量为单位)。

- RQ1: 不同变体在不同资源利用率下的收敛性。

- all 变体: 在资源受限时 (高/中高利用率),收敛更快。

- withoutCIW 变体: TrafficFines 数据集上略快。

- withoutTU 变体: 收敛较慢。

结论: 提供完整信息 (显著性, 紧迫性, 能力) 有助于加速收敛,尤其在资源受限时

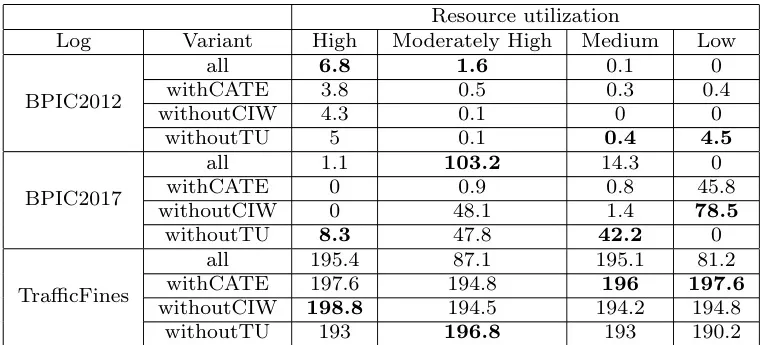

2.3 实验结果:性能分析

表5:不同资源利用率水平和日志中,针对各种提案变体的收敛后总收益(以千为单位)

- RQ1: 不同变体在不同资源利用率下的性能 (总收益)。

- all 变体: 在资源受限时 (高/中高利用率),总收益更高。

- withoutTU 变体: 低资源利用率下表现较好。

- withCATE 变体: TrafficFines 数据集上中低资源利用率下表现较好。

结论: 提供完整信息 (显著性, 紧迫性, 能力) 有助于提升性能,尤其在资源受限时

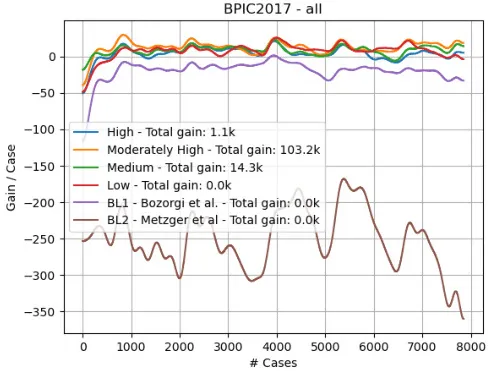

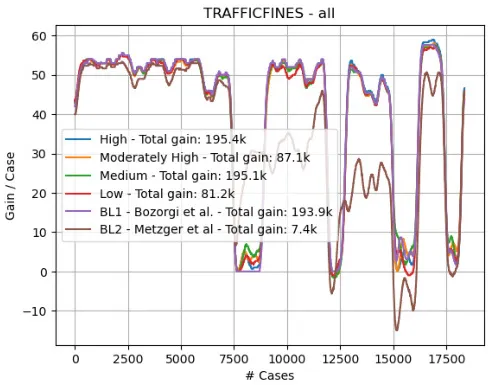

2.4 实验结果:与基线方法对比

图4:所有变体和两种基线方法的比较分析:BPIC2012

图5:所有变体和两个基线的比较分析:BPIC2017。

图6:所有变体和两个基线的比较分析:TrafficFines

- RQ2: 与基线方法 (BL1, BL2) 对比。

- BPIC2012 & BPIC2017: all 变体在所有资源利用率下均优于基线方法

- TrafficFines: all 变体与基线方法性能相近。

三、结论与展望

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)