告别Agent一复杂就崩!Multi-Agent工程化解法(非常详细),复杂系统开发从入门到精通,收藏这一篇就够了!

你可能也遇到过这种情况:* 一个 Agent,刚开始很聪明* 任务一复杂,就开始跑偏* Prompt 越写越长,系统却越来越不稳定

0 引子

你可能也遇到过这种情况:

- 一个 Agent,刚开始很聪明

- 任务一复杂,就开始跑偏

- Prompt 越写越长,系统却越来越不稳定

于是我们自然会做一件事:

“再加点 Prompt,再塞点上下文。”

但很快你会发现:

Agent 并没有变聪明,只是更容易崩了。

这不是你的问题,也不是模型不行,而是——你在用单 Agent,解决一个本质上需要“团队协作”的问题。

1 单 Agent 的天花板,其实在工程上早就暴露了

根本原因来自于现有大模型 在复杂任务中有几个非常典型的工程性限制:

- 上下文越长,注意力越分散

- 错误一旦出现,就会被后续推理不断放大

- 模型对最近 token 过度敏感,早期关键信息逐渐失效

这也是为什么:

单 Agent 在 Demo 阶段表现惊艳,

一进入真实系统,就开始不稳定。

由于当前大模型的局限,还无法构建Superman Agent

而是你让一个 Agent 同时承担了过多角色:

- 规划者

- 执行者

- 校验者

- 决策者

在工程世界里,这种设计几乎一定会失败。

2 Multi-Agent 的本质:不是 AI 技巧,而是解决复杂问题的常识

Multi-Agent 不是为了让模型更聪明,

而是让系统更可靠。

换个角度理解就很清晰了:

现实中的复杂系统,从来不是靠“一个超强模块”完成的,

而是靠角色拆分 + 协作机制。

Multi-Agent,本质上就是把这套成熟的软件工程思想,

迁移到 Agent 系统中。

3 一个可落地的 Multi-Agent 系统,长什么样?

一个工程化的 Multi-Agent 系统,通常由这几层组成:

1. Agent 层:每个 Agent 都有清晰职责

Agent 从来不是“万能体”,而是角色组件:

- 有的负责 规划(Planner)

- 有的负责 执行(Executor)

- 有的专门 调用工具 / 写代码(Code Agent)

- 有的负责 评估、纠错(Evaluator)

- 有的负责 整体协调(Coordinator)

关键不是 Agent 多,

而是——每个 Agent 都足够简单、足够可替换。

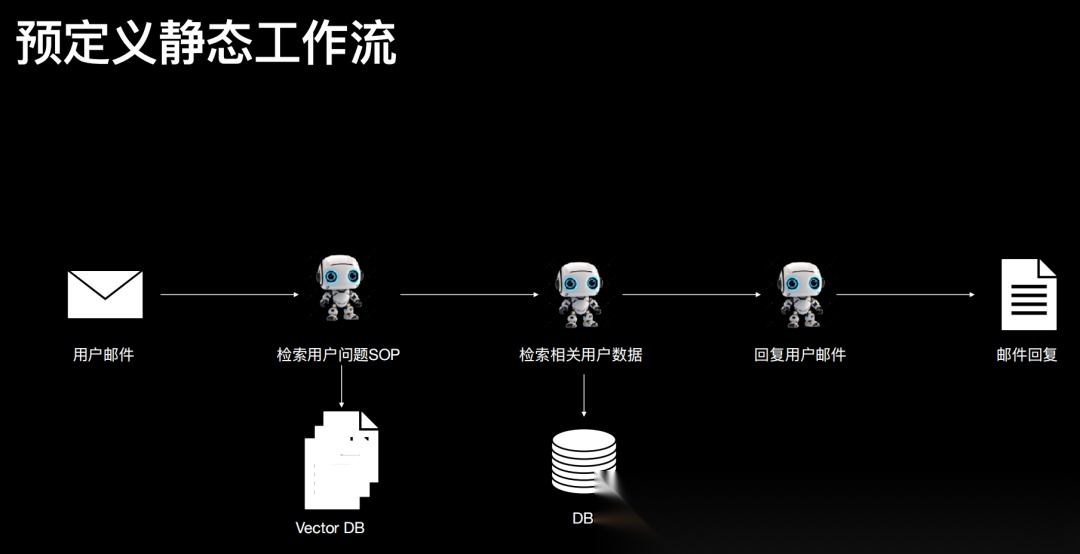

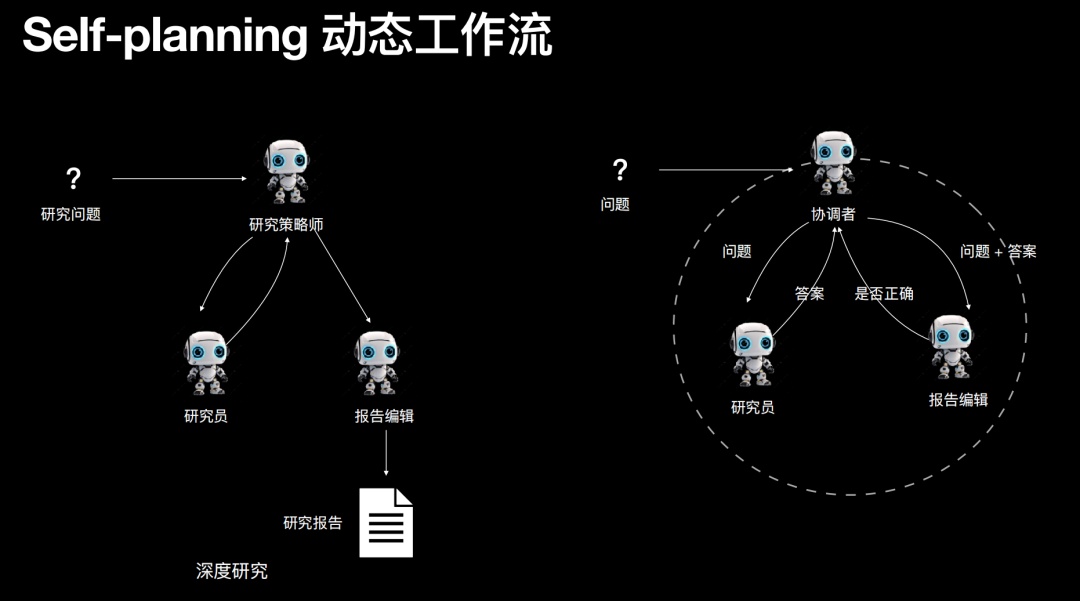

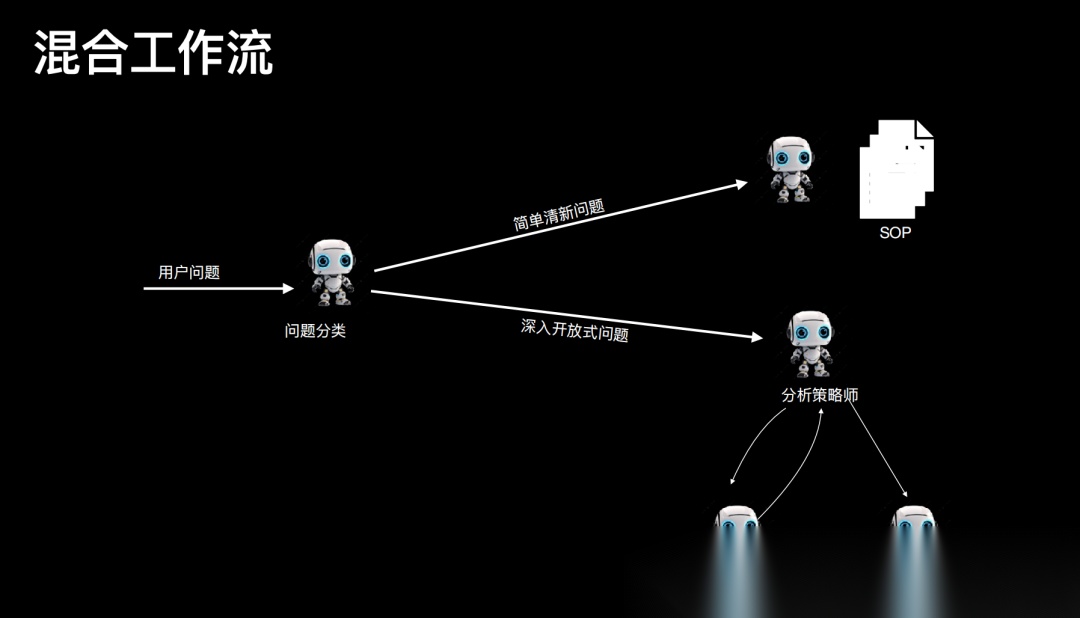

2. Workflow 层:决定系统是否可控

- 静态工作流:流程确定、可审计

- 自规划(Self-Planning):适合探索型问题

- 混合模式:根据问题动态的选择适合的工作流

需要注意的是,事情往往和我们的直觉不同:

- 静态工作流 != 稳定/确定性

- Self-planning 动态流程同样可以获取的一致及可预测的结果。例如:通过运行结果的验证及迭代

- 动态流程更加适合于启发式流程以解决复杂任务。

Agentic AI 系统的独特之处在于它们能够执行迭代式工作流程,通过持续的改进循环不断优化输出

4 Multi-Agent 本身,就是最有效的 Context Engineering

很多文章会说:

Prompt 不够了,要做 Context Engineering。

Context Engineering is all you need.

但具体怎么做呢?

真正高效的 Context Engineering,

不是“管理上下文”,

而是——从架构上避免无关上下文出现。

而这一点,Multi-Agent 天生就具备。

单 Agent 的上下文为什么一定会失控?

在单 Agent 系统中,所有信息都会不断堆进同一个上下文里:

- 需求背景

- 中间推理

- 工具调用结果

- 历史尝试与错误

最终结果是:

Context 越来越长,

信息越来越杂,

模型的注意力却越来越差。

Multi-Agent 的结构性解法:拆分、隔离、压缩

在 Multi-Agent 系统中:

- 每个 Agent 只接触完成当前子任务所需的最小上下文

- Task 在 Agent 之间流转时,上下文会被提取、裁剪或总结

- 子任务完成后,完整历史不会继续向后传播

换句话说:

上下文不是被“管理”的,

而是被“结构性隔离”的。

Agent 和 Task的边界,本身就是 Context 边界

一个非常重要但常被忽略的事实是:

Agent 的职责边界,本身就是上下文的边界。

- Planner 不需要知道执行细节

- Executor 不需要理解全局战略

- Code Agent 只关心输入和可验证输出

- Evaluator 只关注结果,而不是全过程噪声

这让每个 Agent 的上下文:

- 更短

- 更干净

- 更稳定

从“堆上下文”到“上下文演化”

在 Multi-Agent 系统中,上下文不再是线性堆积的,而是在任务流转中不断演化:

- 一次任务拆解 = 一次上下文抽象

- 一次 Agent 切换 = 一次上下文压缩

- 一次评估反馈 = 一次语义升级

这也是为什么,在复杂系统中:

Multi-Agent 往往比“更强的单 Agent”更稳定。

5 为什么很多 Multi-Agent 系统止步于 Demo?

不是模型不行,而是工程能力没跟上:

- 没有评估体系

- 没有决策回放

- 没有持续迭代机制

一旦系统出错,你不知道:

- 是哪个 Agent 出了问题

- 为什么会做出这个决策

- 下次该如何改进

所以在工程上,Agent 必须是:

可观测、可审计、可回滚的软件组件。

6 给工程师的 4 条实践结论

- 不是所有问题都需要 Multi-Agent

- 但复杂系统几乎一定需要

- Agent 边界比 Prompt 更重要

- 没有评估,就没有智能系统

最后一句话

Agent 一复杂就崩,不是模型的问题,而是架构的问题;Multi-Agent 不是炫技,而是把 AI 系统拉回工程的常识世界。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献652条内容

已为社区贡献652条内容

所有评论(0)