ScienceMetaBench 开源:建立科学文献元数据提取的客观评测基准

导言:从科学文献 PDF 文档中提取作者、年份、摘要等元数据,构建高效索引与分析,并以此激活海量文档价值,能够直接帮助研究者、图书馆、企业及数据库平台等实现更高效的文献管理、资源数字化、AI知识库构建与数据聚合分析等。然而,面对排版复杂、元素多样的科学文献,如何客观地评估模型的元数据提取能力?为此,上海人工智能实验室 OpenDataLab 团队推出了科学文献元数据提取评测集,该基准旨在建立客观、

导言:

从科学文献 PDF 文档中提取作者、年份、摘要等元数据,构建高效索引与分析,并以此激活海量文档价值,能够直接帮助研究者、图书馆、企业及数据库平台等实现更高效的文献管理、资源数字化、AI知识库构建与数据聚合分析等。然而,面对排版复杂、元素多样的科学文献,如何客观地评估模型的元数据提取能力?

为此,上海人工智能实验室 OpenDataLab 团队推出了 ScienceMetaBench 科学文献元数据提取评测集,该基准旨在建立客观、统一的评估标准,助力社区衡量与比较各类前沿方法的实际性能。其开源不久,获得广泛关注,连续多日登顶 Hugging Face Trending 文档类数据集榜首。

我们诚邀社区同仁使用此基准开展评测、对比与交流,共同推动科学文献智能处理技术的迭代与发展。

🔗 立即体验

● 数据集地址:https://huggingface.co/datasets/opendatalab/ScienceMetaBench

● 评测工具代码 (Dingo):https://github.com/MigoXLab/dingo

一、评测集概览(多场景、多维度的深度覆盖)

ScienceMetaBench 是一个专注于评估科学文献 PDF 元数据提取能力的评测集,涵盖了学术论文 (Paper)、教科书 (Textbook) 与 电子书 (Ebook) 三类典型语料 。在构建过程中,研究团队针对中英文双语环境进行了深度适配,确保元信息的提取逻辑与正文语种保持一致。

为了提升样本的代表性,团队结合了多数据源采样与 K-Means 图像聚类技术,力求覆盖更多元、复杂的排版样式。在标注环节,团队采用了“AI 预标注 + 人工修正”的高效模式,并参考了用于MinerU评测的OmniDocBench 权威评测基准,以确保数据质量与评测维度的专业性。

二、评估体系(标准化、精细化的度量规范)

为了确保评测结果的客观性与公平性,ScienceMetaBench 不仅提供高质量样本,更配套了一套标准化的评估逻辑。在相似度度量上,我们采用基于字符串编辑距离的算法来计算字段准确率,并在计算过程中忽略大小写差异,以力求真实反映模型的提取效能。同时,我们对数据进行了严格的规范化预处理:统一将作者与关键词的分隔符定为英文逗号,对 ISBN 进行了去符号化处理(去掉“-”连接符),并将出版时间标准化至年份(如 2016)。通过在 Qwen2.5-72B 等模型上的初步测试,我们发现不同字段(如 DOI 与 Abstract)的提取难度存在显著差异,这些精细化的反馈将为后续模型的针对性优化提供清晰的数据支撑。

数据格式示例(以论文类为例):

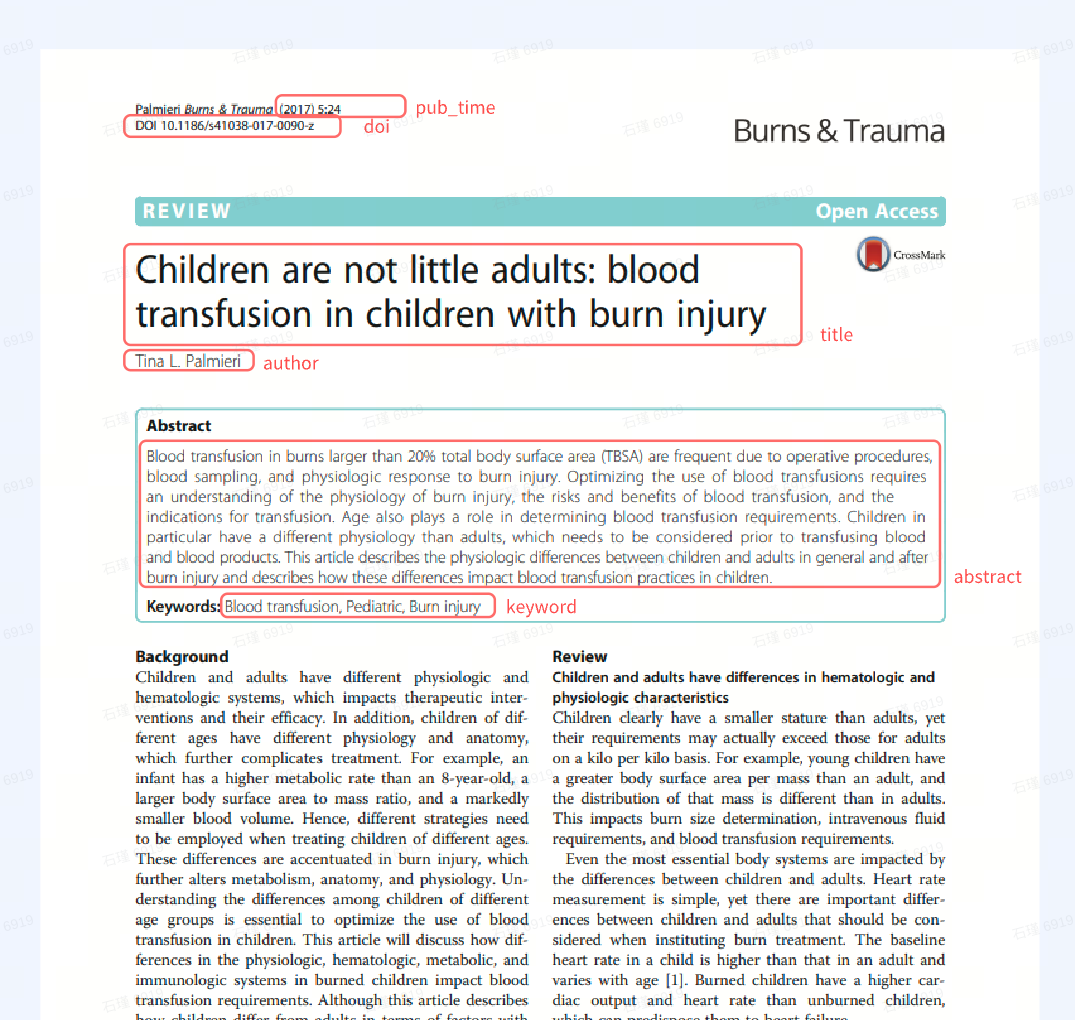

下图展示了从学术论文 PDF 文件中提取的元数据字段示例:

需要从论文首页提取以下关键信息:

{

"sha256": "8d3e...f3a", // 文件唯一哈希,确保数据可追溯

"doi": "10.1186/s41038-017-0090-z", // 唯一标识符

"title": "Children are not little adults...", // 文献标题

"author": "Tina L. Palmieri, ...", // 作者姓名,统一用英文逗号分隔

"keyword": "Blood transfusion, Pediatric", // 关键词,统一用英文逗号分隔

"abstract": "Blood transfusion in burns larger than...", // 摘要正文

"pub_time": "2017" // 标准化后的出版年份

}三、技术背景(基于 MinerU 数据引擎的实践积累)

ScienceMetaBench 的诞生离不开 MinerU 智能文档解析引擎的深厚积累。作为大模型时代的 AI-Ready 数据引擎,MinerU在多模态文档解析领域准确率高达 99%,已为包括 Google Gemini 3 和 DeepSeek 在内的顶尖模型提供评测基准支撑。

如果您觉得这个项目对您的研究或工程有所帮助,恳请在 Hugging Face 和 GitHub 上为我们点个 Star 🌟!

🔗 立即体验

● 数据集地址:https://huggingface.co/datasets/opendatalab/ScienceMetaBench

● 评测工具代码 (Dingo):https://github.com/MigoXLab/dingo

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)