【医学影像AI】VascX 模型:基于彩色眼底图像的视网膜血管分析深度集成模型

VascX 是一种面向彩色眼底图像(CFI)的视网膜血管分析深度集成模型,旨在实现高精度的血管分割、动静脉分类与视网膜结构特征量化。本文配套提供完整工程化实现方案,包括眼底图像预处理工具 retinalysis‑fundusprep 与推理工具 rtnls_inference,支持一键式批量处理、边界提取、对比度增强与血管分析结果输出,可直接用于临床辅助诊断与科研数据集标准化处理。

【医学影像AI】VascX 模型:基于彩色眼底图像的视网膜血管分析深度集成模型

0. 论文简介

0.1 基本信息

2025年 Vargas Quiros J 等 在 TVST 发表论文 【VascX 模型:基于彩色眼底图像的视网膜血管分析深度集成模型】(VascX Models: Deep Ensembles for Retinal Vascular Analysis From Color Fundus Images)。

本文聚焦于彩色眼底图像(CFIs)视网膜血管分析的模型集成开发,提出 VascX 集成模型:一套涵盖血管分割、动脉/静脉(A/V)分割、视盘分割与黄斑中心凹定位四项任务的端到端模型,全面支撑视网膜血管分析流程。

论文标题: VascX Models: Deep Ensembles for Retinal Vascular Analysis From Color Fundus Images

作者: Vargas Quiros J, Liefers B, van Garderen KA, Vermeulen JP, Klaver C

论文地址: tvst: VascX,PMC12306690,arxiv: VascX

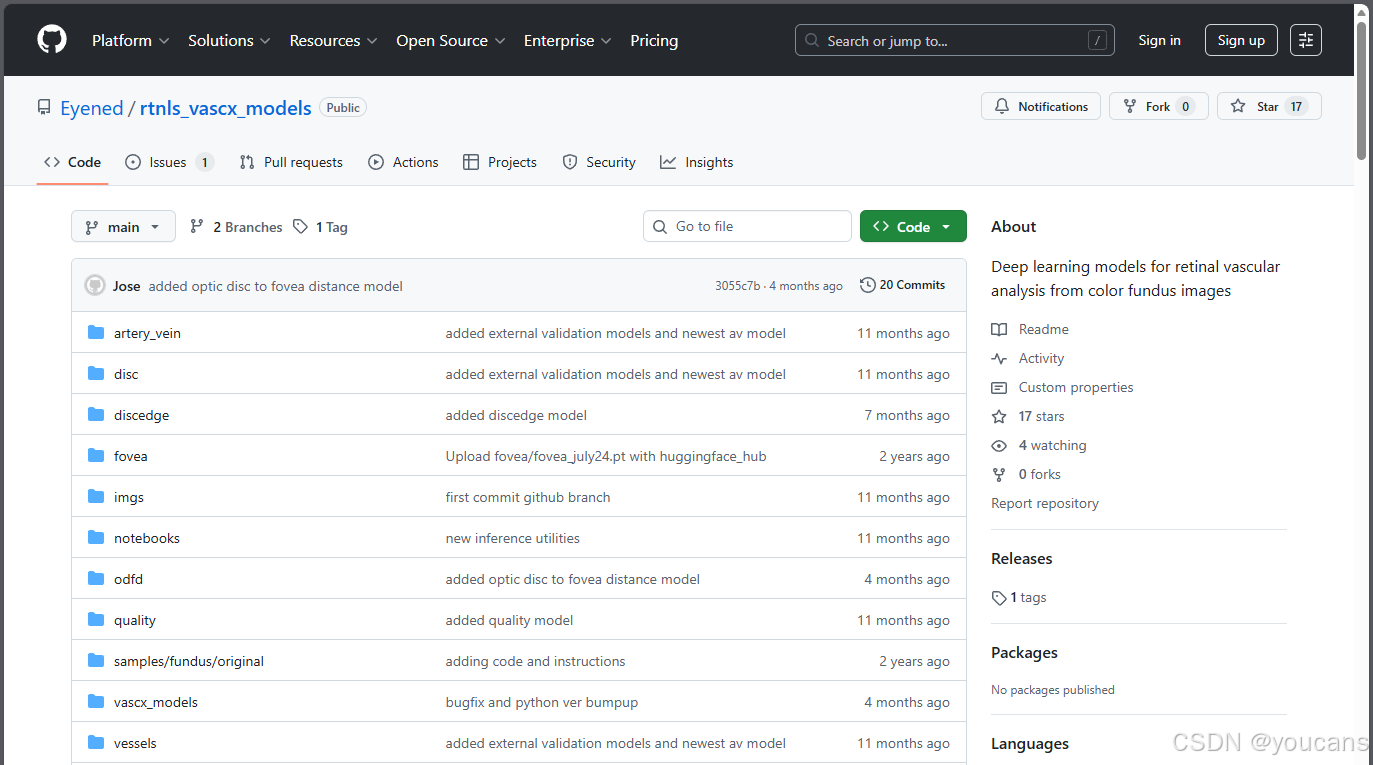

代码仓库: github: VascX

引用格式: Vargas Quiros J, Liefers B, van Garderen KA, Vermeulen JP, Klaver C. VascX Models: Deep Ensembles for Retinal Vascular Analysis From Color Fundus Images. Trans Vis Sci Technol. 2025 Jul 1;14(7):19. doi: 10.1167/tvst.14.7.19. PMID: 40699175; PMCID: PMC12306690.

0.2 论文速览

研究背景

视网膜血管的形态特征(如口径、弯曲度、分支角度)是眼部疾病(糖尿病视网膜病变、青光眼)与全身性疾病(心血管疾病、阿尔茨海默病)的重要生物标志物。现有方法存在显著局限:

- 训练数据集规模小、同质性强,多局限于单一设备、单一解剖区域(仅视盘或黄斑),泛化能力不足;

- 动脉 - 静脉分割、视盘分割在中等质量图像(临床常见场景)中性能不佳;

- 分割结果的误差会传导至下游血管特征提取,影响疾病诊断准确性。

主要贡献

- 提出 VascX 模型集成:一套涵盖四大核心任务的端到端模型,包括血管分割、动脉 - 静脉(A/V)分割、视盘分割与黄斑中心凹定位,全面支撑视网膜血管分析流程。

- 构建多样化训练数据集:整合 15 + 公开数据集与荷兰鹿特丹研究(RS)、AMD-Life、MYST 等本土队列数据,总样本量覆盖:血管分割 1559 张、A/V 分割 562 张、视盘分割 7464 张、黄斑定位 15824 张。数据涵盖 30°-50° 视场角、11 种成像设备、40 + 岁至老年人群及多种眼病(DR、AMD、青光眼等),增强模型鲁棒性。

- 开源完整技术工具链:公开预处理算法、模型权重、推理代码,支持直接部署,简化自动化视网膜血管分析的落地流程。

系统验证性能与特征准确性:不仅验证分割效果,还量化下游血管特征提取质量,建立从分割到诊断标志物的完整性能链路。

研究方法

- 数据处理与标注

- 数据融合:筛选并整合多源公开数据集,补充鹿特丹队列的多样化图像,剔除不可用样本(如无完整视盘标注的图像);

- AI 辅助标注:采用 “模型初始化 + 人工修正” 流程,专业标注员借助对比度增强图像与定制标注工具,完成血管、动脉 - 静脉、视盘的像素级标注及黄斑中心凹定位,确保标注一致性;

- 数据增强:针对不同任务设计差异化增强策略(如血管分割采用弹性变换、随机裁剪,黄斑定位采用温和旋转与缩放),保留细血管细节与解剖结构完整性。

- 模型架构与训练

- 核心架构:基于 U-Net 改进,采用 6 输入通道(原始 RGB 图像 + 对比度增强图像)、8 级下采样与深度监督机制,提升分割精度;

- 任务适配设计:

- 分割任务(血管、A/V、视盘):采用 Dice + 交叉熵联合损失函数,A/V 分割单独标注动脉、静脉、交叉区域三类标签;

- 黄斑定位:基于热图回归法,以 U-Net 为骨干网络,采用 MSE 损失函数优化;

- 图像质量分类:微调 ResNet101,支持 “优质 / 可用 / 不可用” 三级质量评估;

- 训练配置:5 折分组交叉验证(确保同眼图像不跨集),Adam 优化器(学习率 0.001),按任务设置差异化训练轮次(血管分割 100 轮、A/V 分割 200 轮等)。

关键结果

-

分割性能超越现有模型

- 以 Dice 系数(分割任务)和欧氏距离(黄斑定位)为指标,VascX 在所有测试数据集上表现最优:

血管分割:在 ChaseDB、HRF 等数据集上 Dice 系数 0.780-0.890,显著高于 Automorph(0.741-0.824)和 LWNet(0.573-0.756); - 动脉 - 静脉分割: veins 分割 Dice 系数 0.760-0.849,arteries 分割 0.711-0.817,较现有模型提升约 0.1;

- 视盘分割:在鹿特丹数据集(异质性最强)上 Dice 系数达 0.886,远超 Automorph 的 0.220;

- 黄斑定位:在 REFUGE2 数据集上平均欧氏距离仅 10.68 像素,定位精度满足临床区域划分需求。

- 以 Dice 系数(分割任务)和欧氏距离(黄斑定位)为指标,VascX 在所有测试数据集上表现最优:

-

鲁棒性优势显著

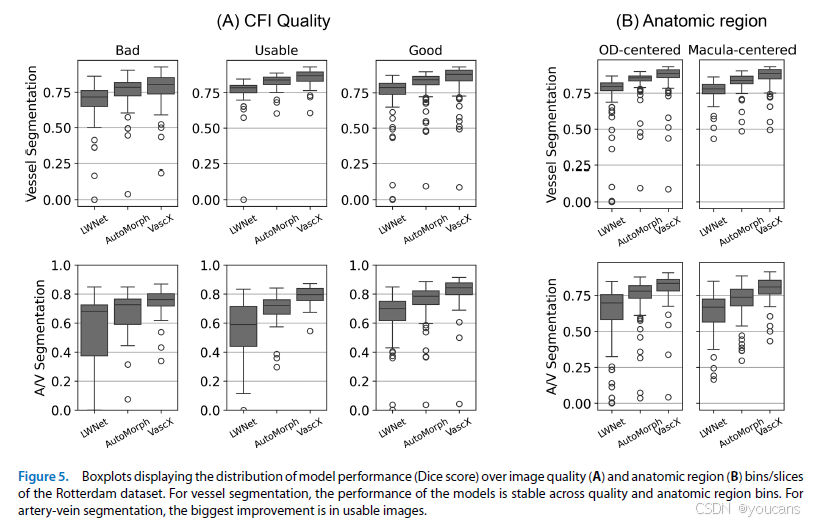

图像质量适应性:在 “可用” 级中等质量图像(临床最常见)中性能提升最明显,“差” 质量图像中仍保持稳定分割;

解剖区域适配:同时支持视盘中心与黄斑中心图像,解决现有模型对单一区域依赖的问题。 -

特征提取准确性提升

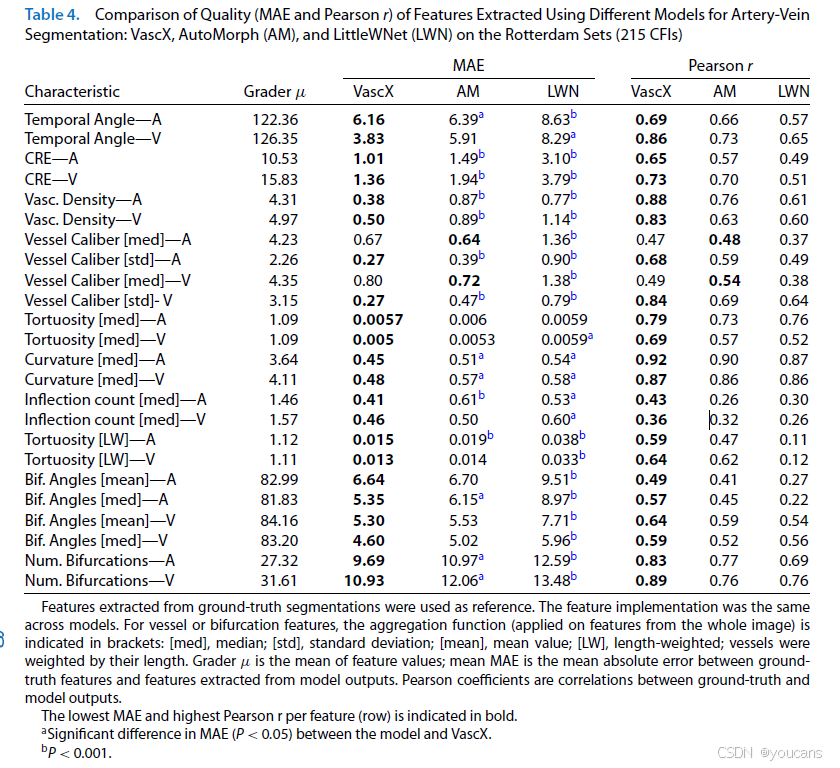

基于 24 项核心血管特征(口径、弯曲度、血管密度、分支角度等)的验证显示:

与 Automorph 相比,16 项特征的平均绝对误差(MAE)显著降低;与 LWNet 相比,22 项特征 MAE 显著改善;

所有特征与人工标注金标准的 Pearson 相关系数均最高(0.20-0.93),验证了分割质量向特征准确性的有效传导。

VascX 模型通过多样化数据集训练与优化架构设计,实现了多场景下视网膜血管分析的性能突破,其开源工具链为临床辅助诊断、大规模队列研究提供了可靠支撑。

0.3 摘要

-

研究目的:

提出并验证用于彩色眼底图像(CFIs)血管、动静脉、视盘分割及黄斑中心凹定位的深度学习集成模型(VascX)。本研究公开发布 VascX 的预处理、推理代码及模型权重,为视网膜血管相关研究提供支撑。 -

研究方法:

模型训练阶段,整合 15 余个已发表的标注数据集与荷兰相关研究(以鹿特丹研究为主)的彩色眼底图像,构建包含多样化患者特征与成像条件的训练集。基于全新的鲁棒性预处理算法与强数据增强策略,训练 Unet 集成模型;以骰子系数为评价指标,将 VascX 的分割性能与公开权重模型 AutoMorph、LittleWNet 进行对比;通过计算与人工标注分割结果提取特征的一致性(平均绝对误差、皮尔逊相关系数),对比 VascX 及上述传统模型的特征提取质量。 -

研究结果:

VascX 在大部分受试数据集上均表现更优,在动静脉与视盘分割任务中优势尤为显著。

随着图像质量下降,且无论针对视盘中心型还是黄斑中心型图像,VascX 的分割性能均保持高度一致性。

分割性能的提升进一步带来血管特征提取质量的优化:在评估的 24 项特征中,与 AutoMorph 相比,14 项特征的平均绝对误差实现显著改善;与 LittleWNet 相比,23 项特征的平均绝对误差显著优化;除 2 项特征外,VascX 提取的其余所有特征与金标准特征的皮尔逊相关系数均为最高。 -

研究结论:

VascX 模型在多种成像条件下均表现优异,这一结果大概率得益于训练集的规模与多样性。该模型实现了视网膜图像分割质量的重要提升,进而能够提取更优质的血管特征,为视网膜血管的鲁棒性分析提供支撑。

转化应用价值:本研究将 VascX 模型开源,旨在推动视网膜血管生物标志物与眼疾、全身性疾病关联的相关研究,为疾病的检测、预防与监测提供助力。

1. 引言

对视网膜管径测量的研究始于 20 世纪 70 年代,当时 Parr 和 Spears[1] 提出了利用最大分支管径近似估算视网膜中央动、静脉管径的方法。自 20 世纪 90 年代末以来,研究人员开发了多种半自动计算方法,通过不同程度的人机交互提升了测量效率。[2] 其中具有代表性的工具包括 SIVA(新加坡 I 血管评估系统)[3–7]、IVAN8,9 以及 VAMPIRE(视网膜图像血管评估与测量平台)[10–12]。

如今,人们对视网膜血管及其与疾病关联的认知已大幅拓展。研究重点集中在视网膜管径、迂曲度、分支特征等生物标志物上。这些标志物不仅与眼部疾病相关,还被广泛用于研究全身性疾病,尤其是心血管疾病[13–15,59]。 近年来,视网膜被视作观察脑部病变的 “窗口”,多项研究将视网膜血管改变与阿尔茨海默病等神经退行性疾病联系起来[16]。已有研究表明,自动提取的血管特征可提升糖尿病视网膜病变(DR)的检测与分类性能(Abtahi M 等,IOVS,2024;65:ARVO 电子摘要 PB0060)。

在科学进展的同时,深度学习在各类分割任务中实现了突破性的质量提升[17]。 这推动了多个数据集、深度学习架构与模型的发展,用于分割彩色眼底图像(CFI)中主要解剖结构:血管分割 [18,19]、动静脉分割 [20,21] 以及视盘分割。眼底图像质量评估任务也受到广泛关注[22–24]。近期研究开始将这些模型整合为可全自动、可解释地提取血管特征的流程。AutoMorph 是其中最具代表性的开源深度学习流程,集成了血管分割、动静脉分割、视盘分割与血管特征提取功能[25]。AutoMorph 已被应用于多项研究,包括其特征可重复性研究[26–29]。AutoMorph 中的视盘分割模型支持基于区域的分析,可从视网膜特定区域单独提取特征。

尽管取得上述进展,在多样化患者与成像条件下,从彩色眼底图像中稳健分割视网膜形态结构(动脉、静脉、视盘、中心凹)的问题仍未解决。大多数公开的动静脉分割训练数据集规模小、同质性高,通常仅来自单一设备、以单一解剖区域(黄斑或视盘)为中心、视场角固定。直到近期 [30] 之前,最大的公开动静脉分割数据集仅包含 45 幅图像[31]。 此外,研究人群的病变类型与人口学特征往往受限,显著影响基于这些数据训练的模型的泛化能力。这会影响下游可解释血管特征的提取,而特征质量高度依赖分割精度 [29](Somfai GM 等,IOVS,2023;64:ARVO PB0038)。这在大型队列研究与临床数据分析中尤为突出,因为这类数据通常包含多种设备与拍摄条件。为克服这些缺陷,需要构建规模更大、多样性更高的训练数据集,以开发能在更广条件下稳定运行的模型。

本文通过改进分割与定位模型,为视网膜血管的稳健分析提供一系列研究成果。主要贡献如下:

- 提出视盘分割、血管分割、动静脉分割与黄斑中心凹定位模型,这些是构建彩色眼底图像分析系统(尤其是视网膜血管分析系统)的基础模型。我们基于公开数据集与荷兰相关研究(主要为鹿特丹研究)中多样化彩色眼底图像的专业标注人员新标注数据构建模型。

- 将所提模型与公开可用模型 [25,20] 进行基准测试,证明分割性能显著提升。同时利用质量评估模型分析模型在不同图像质量下的表现。

- 通过与经验丰富的标注人员分割结果提取的特征对比,评估模型输出特征的质量。

- 公开发布预处理与推理代码及模型权重,实现开源:github: VascX。

2. 方法

VascX 模型包含血管分割、动静脉(A/V)分割、视盘分割与黄斑中心凹定位集成模型。模型权重与推理代码公开于 github: VascX。

本节详细介绍这些集成模型的构建过程,包括数据源、标注与模型训练。

2.1 数据集

我们结合公开数据集与鹿特丹研究(RS)及其他荷兰研究的图像对模型进行训练与评估。

2.1.1 公开数据集

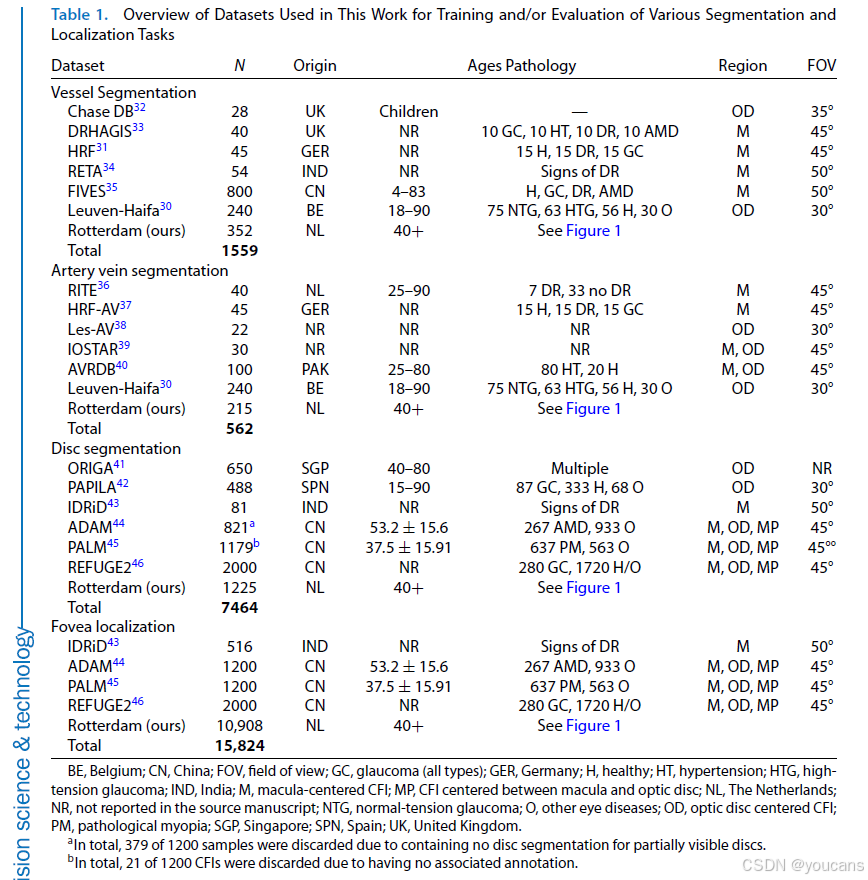

我们收集了已有研究中的公开数据集。这些数据集在患者人口学特征、病变类型、视网膜区域(黄斑中心与视盘中心)、视场角与来源国家上各不相同。表 1 概述了这些数据集。补充信息表 S5 提供了拍摄设备与分辨率等补充细节。

我们纳入了多个包含糖尿病视网膜病变患者的知名血管与动静脉分割数据集[31,33,34,37]。 因分辨率过低(584×565 像素),排除了 DRIVE 数据集 [36,47]。我们纳入了规模更大、更新的 FIVES[35] 与 Leuven-Haifa[30] 数据集,包含病变与健康患者。另一方面,大多数带视盘分割标注的数据集最初用于青光眼评估[41,42,46]。REFUGE2 数据集是原始 REFUGE 数据集的扩展 [48],以规模大(2000 幅彩色眼底图像)、覆盖多种解剖区域、包含黄斑中心凹位置标注而著称。我们还纳入了 ADAM(年龄相关性黄斑变性)[44]、PALM(病理性近视)[45] 与 IDRiD(糖尿病视网膜病变)[43] 数据集,均包含黄斑中心凹位置。训练集中图像视场角在 30° 至 50° 之间,覆盖绝大多数标准眼底成像设备。因可能存在显著域偏移,我们排除了广视野与超广角彩色眼底图像数据集。

最后,我们使用 Eye-Quality(EyeQ)数据集(表 1)训练质量评估算法。该数据集包含来自 EyePACS 糖尿病视网膜病变数据集的 28792 幅彩色眼底图像的人工质量分级结果[49]。 图像按三级体系分为不可用 / 差、可用、良好。该数据集规模大、包含多种拍摄设备与图像条件,具有独特性。因此我们未对该数据集追加标注。

2.1.2 鹿特丹数据集

我们以鹿特丹伊拉斯姆斯医学中心眼科的图像(主要为鹿特丹研究)补充公开数据集的彩色眼底图像。鹿特丹研究是针对鹿特丹市 Ommoord 区居民开展的前瞻性人群队列研究[50]。 该研究包含四个队列,均用于本研究。研究对象最低年龄从第一队列的>55 岁到第四队列的>40 岁不等。每队列每 4 至 5 年进行多轮随访检查。鹿特丹研究的大多数随访均采集双眼彩色眼底图像。因研究跨度长达数十年,数据集包含多种设备、拍摄条件与视场(黄斑中心与视盘中心)

。

除鹿特丹研究外,我们还纳入年龄相关性黄斑变性随机对照试验(AMD-Life)[51] 采集的图像,该研究包含 150 名 55 至 85 岁患者,使用拓普康 3D OCT 2000-plus 与拓普康 TRC-50EX 相机拍摄。同时使用荷兰近视研究(MYST)[52] 图像,研究对象更年轻(平均年龄 47.3 [12.9] 岁),采用拓普康 TRC-50EX 拍摄。

2.1.3 彩色眼底图像筛选与采样

在统一标注后,我们完整使用大多数公开数据集,未做过滤。主要例外是 ADAM 数据集中的视盘分割数据,1200 个样本中有 379 个因视盘部分可见、无有效分割被剔除。

对于鹿特丹数据集,我们从所有可用图像中随机采样。为提升数据集设备多样性,我们纳入了光学相干断层扫描(OCT)设备采集的眼底图像。对于血管与动静脉分割数据集(表 1),因鹿特丹研究规模远大于 AMD-Life 与 MYST,我们对后两者进行过采样,使其占总样本的 15%。我们要求标注人员排除因血管整体可见度极低、完全无法用于当前任务的图像。但为构建更多样、更具挑战性的训练集,我们有意放宽质量筛选标准。我们纳入了 AutoMorph 质量评估算法判定为不可用的图像,理由是尽管整体质量较差,但许多图像仍包含可清晰用于生物标志物测量的血管信息,例如主要血管弓(如视网膜中央等效血管 CRE 或开口角)。

对于视盘分割,因公开数据集规模较大(表 1),我们首先使用在公开数据集上训练的模型自动识别分割失败或难度高的彩色眼底图像。挑选模型未检测到视盘或生成不连续视盘掩码的图像。由经过训练的标注人员复核,确认其中视盘存在但分割错误的图像纳入训练集。实际中,这类图像多为鹿特丹数据集中的模拟式、黄斑中心图像,对模型挑战极大。

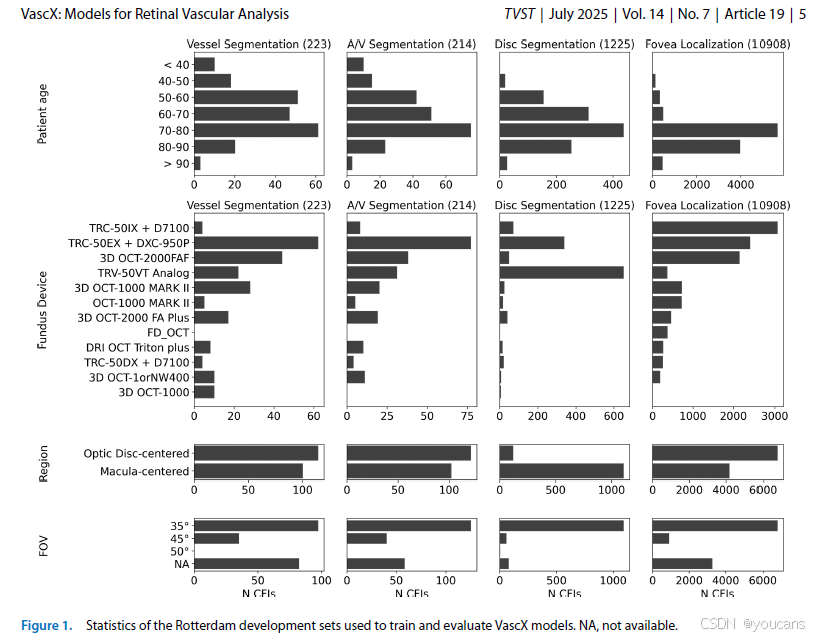

对于黄斑中心凹检测,我们使用鹿特丹研究亚队列中已标注年龄相关性黄斑变性的彩色眼底图像,其中包含为 ETDRS 网格定位而标注的黄斑中心凹位置。使用 AutoMorph 中的质量评估模型 [25] 评估图像质量,排除判定为不可用的图像。图 1 展示最终鹿特丹训练集的统计信息。血管与动静脉分割集相似(部分因重叠),更接近鹿特丹研究整体分布。而视盘分割数据集包含更多模拟设备图像,这类图像通常最难分割,部分原因是视盘位置不常规。

2.2 彩色眼底图像标注

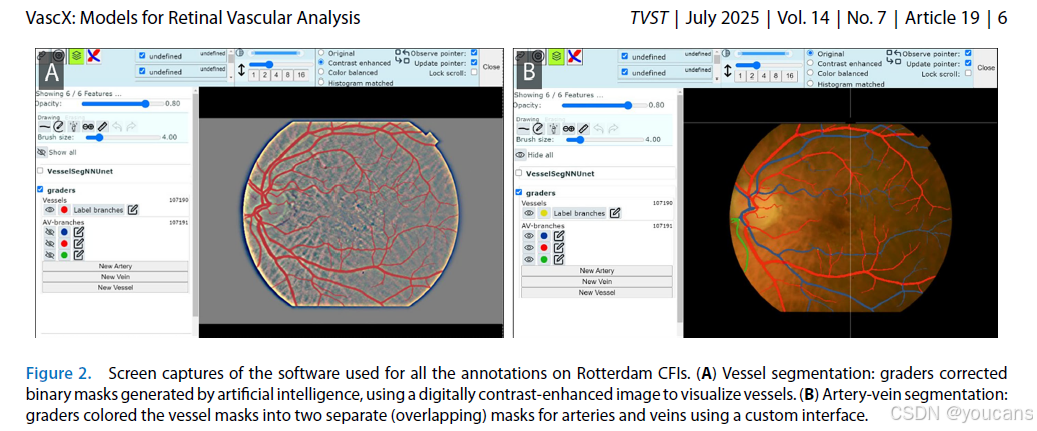

图像使用定制眼科图像标注软件标注(Liefers B 等,IOVS,2024;65:ARVO 5891)。四名专业标注人员参与标注。标注人员在台式电脑上使用绘图板进行分割。不同标注类型流程不同:

-

血管分割:

采用人工智能辅助流程,以血管分割模型输出作为初始掩码。前 200 幅图像使用公开数据训练的模型(包括 AutoMorph25),后续切换为同时在公开数据与本研究迭代标注数据上训练的模型。要求标注人员独立修正模型生成的掩码,包括补全缺失血管与去除过分割。使用血管边缘对比度增强的数字增强图像辅助标注(图 2)。 -

动静脉分割:

通过在独立图层分别标注动脉与静脉,解决动静脉交叉处的连通性问题。专门开发动静脉分割界面(图 2),允许标注人员从血管分割结果(无动静脉区分)出发,使用绘图工具将动脉与静脉标注为两个独立掩码或图层。增加第三类 “未知” 图层,用于无法判定的血管。要求标注人员在两个图层均标注交叉区域(重叠)。可独立或同时查看与修正各图层。另一功能可将各掩码连通分量以不同颜色显示,便于发现连通错误。整个流程包括:(1)修正提供的掩码(血管分割)错误;(2)将掩码标注为动静脉与未知类别 / 图层;(3)检查动静脉掩码连通分量并填补间隙。 -

视盘分割:

由一名专业标注人员使用与二值血管分割相同的界面完成标注(图 2)。标注人员标注整个视盘区域,排除视盘周围萎缩区,以匹配公开数据集标注规范[41,46,53]。 若因图像质量差或视盘边界不清存在疑问,由三名标注人员达成共识。图像质量过差无法达成共识的样本被剔除。 -

黄斑中心凹定位:

由四名标注人员按照标准标注流程定位黄斑中心凹,包括在图像上放置 ETDRS 网格。

图2:在鹿特丹研究彩色眼底图像(Rotterdam CFIs)上进行所有标注所用软件的界面截图。

(A)血管分割:标注人员修正由人工智能生成的二值掩码,借助数字增强对比度的图像来清晰显示血管。

(B)动静脉分割:标注人员通过自定义界面,将血管掩码分别着色为动脉和静脉两个独立(可重叠)的掩码。

2.3 模型训练

我们在表 1 数据集上训练模型集成。实现改进的彩色眼底图像边界检测与预处理流程,并适配经典 NN–U-Net 方法进行训练。

2.3.1 数据预处理

所有模型的训练与测试彩色眼底图像均按以下步骤预处理:

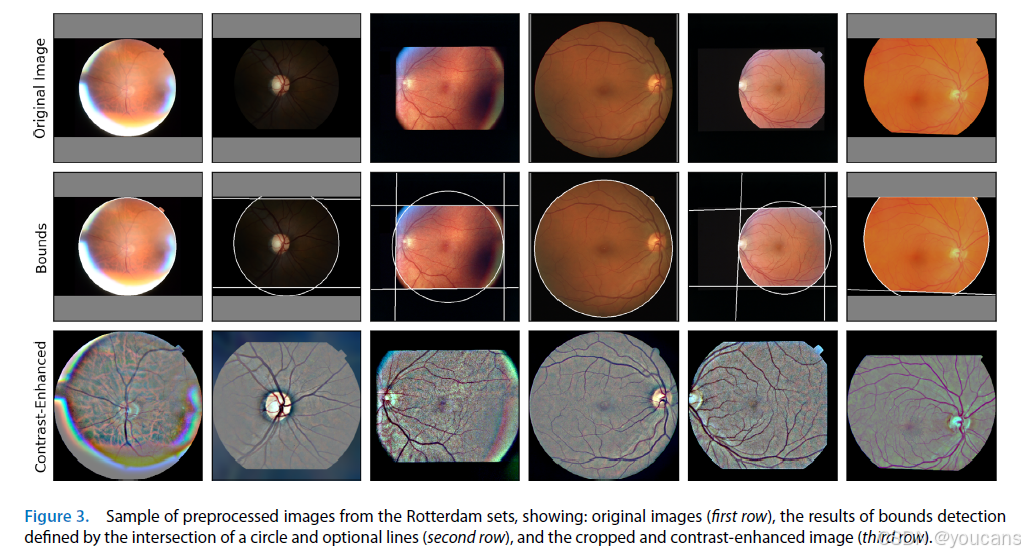

- 检测由圆形与上、下、左、右直线定义的彩色眼底图像边界(见图 3)。

- 沿边界裁剪为正方形图像,缩放至 1024×1024 像素。

- 通过高斯滤波进行对比度增强。增强前沿边界镜像以避免伪影,增强后将边界外区域置黑。

训练标签同步执行几何变换(裁剪与缩放)。图 3 展示预处理算法输出。模型以裁剪后的原始图像与对比度增强图像拼接作为输入(共 6 个通道)。

*图3:来自鹿特丹数据集的预处理图像样例,展示内容包括:原始图像(第一行)、由圆形与可选直线相交所定义的边界检测结果(第二行),以及裁剪并增强对比度后的图像(第三行)。

*

2.3.2 血管、动静脉与视盘分割模型

因训练集不同,血管与动静脉分割模型分别训练。训练与推理流程基于 PyTorch 开源实现的 NN–U-Net[17,54],包括架构、分块 / 窗口与测试时增强。我们加入专为眼底图像设计的训练增强策略,以弥补动静脉分割数据集规模相对较小的问题。训练数据先进行随机外观变换:散焦、色相饱和度值变换、伽马校正与高斯噪声,再进行几何变换:翻转(水平与垂直)、随机缩放(1.0–1.15 倍)、随机旋转(最大 10 度)与随机弹性变换。使用 Albumentations 库 [55] 进行图像与掩码增强。掩码由库采用最近邻插值。

遵循 NN–U-Net 方案,训练与推理在从 1024×1024 图像中裁剪的 512×512 块上进行。块输入至 U-Net 网络,该网络有 6 个输入通道(原始 RGB 与对比度增强图像)、8 个下采样阶段与深度监督(在下采样阶段同步计算损失)。推理采用 50% 重叠滑动窗口与高斯核融合。

血管标注编码为背景(0)与血管(1)。动静脉标注编码为背景(0)、动脉(1)、静脉(2)、交叉(动静脉均为 3)。该设计旨在提升损失函数中交叉区域的权重。损失函数为等权重的 Dice 损失与交叉熵损失之和。视盘分割模型类似,以二值掩码训练,编码为背景(0)与视盘掩码(1),使用相同损失函数。

2.3.3 黄斑中心凹定位模型

黄斑中心凹定位模型单独训练,用于在彩色眼底图像上定位关键点。以与动静脉分割相同的 U-Net 架构为骨干,采用热图回归方法[56]。 热图回归即训练模型回归关键点位置的概率图或热图。输出热图上最大值的像素位置作为关键点输出。训练热图可使用以真值关键点为中心的不同概率密度函数生成。我们以关键点为中心、固定 σ 的高斯函数生成目标热图(512×512 像素)。通过在保留集上实验定位视盘中心,选定 σ=50 像素。使用均方误差(MSE)作为损失函数训练模型拟合连续目标热图。模型输出热图上最大值的位置(二维索引)作为关键点位置。

输入彩色眼底图像先进行随机外观变换:散焦、色相饱和度值变换、伽马校正与高斯噪声,再进行几何变换:水平翻转、随机缩放(1.0–1.05 倍)、随机旋转(最大 5 度),最后缩至模型输入尺寸。测试时增强相应使用输入垂直翻转。

2.3.4 质量分类模型

图像质量分类模型使用与黄斑中心凹与视盘模型相同的增强策略训练。通过微调 ResNet-101(ImageNet 权重)开发,输入分辨率 224 像素。此处仅使用原始 RGB 彩色眼底图像(三通道;无对比度增强版本)。所有模型权重均微调(无冻结层)。分类使用交叉熵损失,回归使用 MSE。测试时增强通过平均原始与水平翻转输入的输出实现。

2.3.5 训练设置

所有模型均使用 Albumentations 库进行数据增强。使用 PyTorch 与 pytorch-lightning 构建训练流程。

所有模型批次大小设为 16。分割任务使用 Adam 优化器,学习率 lr=0.001。模型按固定轮数训练:血管分割 100 轮、动静脉分割 200 轮、视盘分割 100 轮、黄斑中心凹定位 35 轮。该设置大致基于 20% 训练集的实验确定。我们观察到在选定轮数前后验证损失稳定,因此未进一步优化。NN–U-Net 中的部分架构选择(如深度监督与加深 U-Net)通过同一划分验证,对 Dice 系数影响极小。

所有模型在单张 11GB 显存 NVIDIA 显卡上训练。分割模型采用混合精度训练。

2.4 评估

我们提供模型内部与外部验证结果。外部验证采用留一数据集策略,即在所有训练集(表 1)上重新训练集成模型,仅留一个数据集用于评估。该策略可在多个数据集上提供外部验证结果,尤其是鹿特丹与 Leuven-Haifa 动静脉分割数据集,它们构成训练集主体。我们的目标是准确呈现模型在不同数据集特征下的泛化性能。

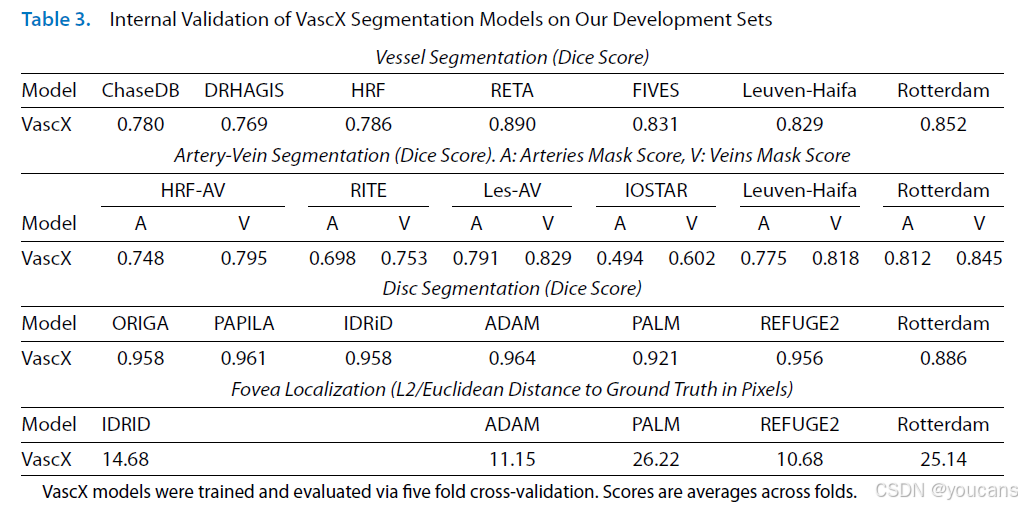

内部验证采用五折交叉验证,以 Dice 系数为主要评估指标。报告五个验证集上的平均分数(按来源数据集分开)。注意该评估设置意味着模型分数可能略低于完整集成模型的表现。

所有模型均输入 1024×1024 分辨率预处理图像,使用默认推理设置。

为确保所有模型在相同图像上公平对比,我们对完整数据集进行评估,不做自动质量过滤或其他剔除。对于动静脉模型,从模型输出恢复动脉与静脉掩码。对于 VascX 模型,即将交叉输出掩码与动脉、静脉掩码合并。

3. 结果

3.1 与公开模型对比

我们将模型性能与公开可用模型对比。注意我们的目标并非对比深度学习架构,而是对比训练好的模型(包括架构、推理代码与公开权重)在不同数据集上的性能(表 1)。因此,未提供公开权重的架构未纳入分析。

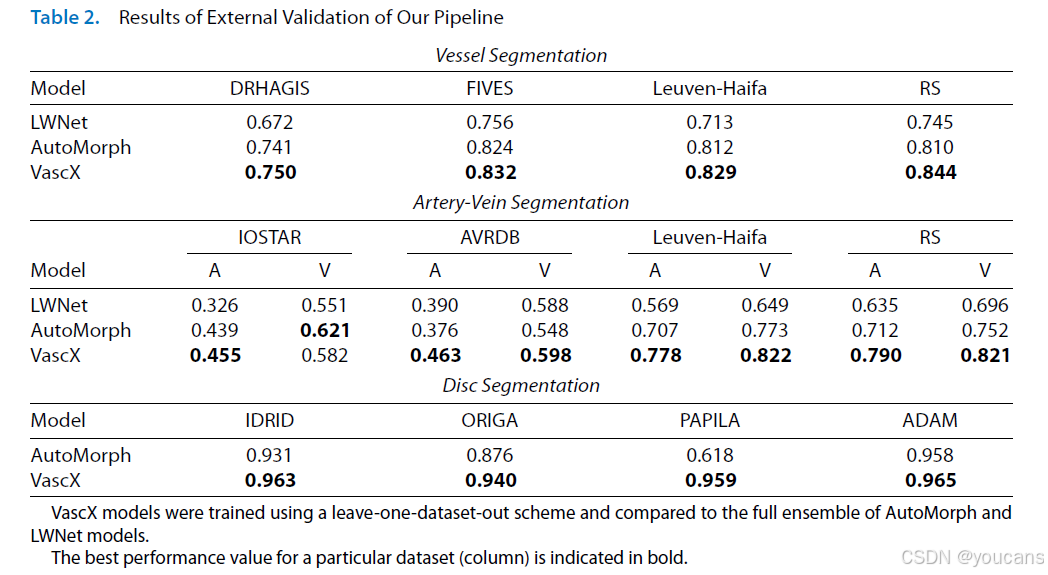

我们将三个分割模型与 AutoMorph25 中的集成模型对比,AutoMorph 是最相近的集成血管、动静脉与视盘分割的流程。此外,将血管与动静脉模型与 Little-WNet(LWNet)[20] 对比,后者是专用血管与动静脉分割模型,提供公开权重。表 2 展示外部验证结果,以 Dice 系数衡量对未知数据集的泛化性能。LWNet 血管分割权重在 DRIVE 上训练。对于动静脉分割,我们测试了在 DRIVE 与 HRF 上训练的权重,发现 DRIVE 权重在所有数据集上表现更好,因此仅报告该结果。

血管分割中 AutoMorph 与 VascX 性能相当,LWNet 最低。尽管 VascX 使用更大训练集,与 LWNet 差距不大。所有模型在各数据集上表现相对稳定,DRHAGIS 分数略低。

动静脉分割中,VascX 在大多数数据集上取得更高 Dice 系数,静脉表现优于动脉,与已有研究一致[21]。 唯一例外是 IOSTAR,AutoMorph 在静脉上表现更好。值得注意的是,最大提升出现在鹿特丹研究与 Leuven-Haifa 数据集,分别是最多样与规模最大的数据集。各数据集性能一致性较低,IOSTAR 与 AVRDB 分数远低于 Leuven-Haifa 与鹿特丹数据集。

类似地,视盘分割中,与 AutoMorph 相比,VascX 在大多数数据集上实现温和但稳定的提升,最大提升出现在 PAPILA 数据集。

表 3 展示 VascX 内部验证结果,衡量对来自同一训练分布未知图像的泛化能力。VascX 在大多数数据集上表现稳定。值得注意的是,部分数据集内部与外部验证分数差距不大。

最后,我们的质量评估模型准确率达到 0.93,与 AutoMorph 报告的 0.92 相当 [25],均为内部验证。因我们未增强 EyeQ 数据集(也用于训练 AutoMorph),未提供该模型更多性能评估。

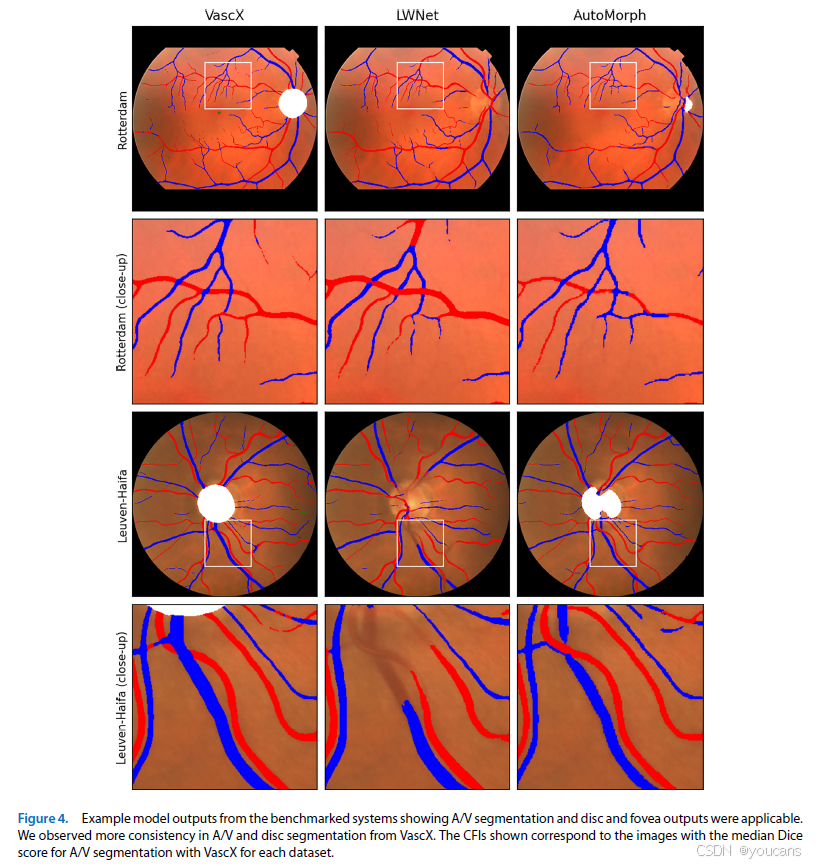

定性观察可见 VascX 模型分割性能显著提升。

图 4 展示鹿特丹与 Leuven-Haifa 输入(两个独立数据集)的模型输出示例。VascX 视盘检测更稳定,尤其在视盘边界不清晰的情况下。动静脉分割虽非完美,但相比 LWNet 与 AutoMorph,连续性错误与分类错误明显更少。重要的是,多数血管交叉在动脉与静脉掩码中均被正确处理。所有分割模型更多输出示例见补充材料 B 节。

图4:来自基准测试系统的模型输出示例,展示了动静脉(A/V)分割,以及适用情况下的视盘与黄斑中心凹检测结果。我们观察到 VascX 在动静脉和视盘分割上具有更高的一致性。

所示彩色眼底图像(CFI)对应于各数据集中 VascX 动静脉分割 Dice 系数取中位数的图像。

3.2 图像质量对血管与动静脉分割的影响

为更深入表征模型性能,我们使用彩色眼底图像质量评估模型将鹿特丹图像分为良好、可用、差 / 不可用三类。因其他数据集规模较小且 / 或图像质量与拍摄条件高度统一,本分析仅限于鹿特丹数据集。使用在其余数据集上训练的集成模型预测结果(表 2 外部评估)。图 5 展示不同图像质量区间(由模型评估)以及视盘中心与黄斑中心图像的 Dice 系数分布。血管分割模型再次表现出高一致性,即使在被判定为差质量的彩色眼底图像上。

3.3 特征准确性

我们模型的核心目标是作为可解释血管特征 / 生物标志物提取系统的骨干。因此,我们量化了这类特征的质量。将模型外部评估(VascX、AutoMorph 与 LWNet)提取的特征与训练集标注结果提取的参考特征对比,后者视为真值。通过测量与真值特征的平均绝对误差(MAE)与相关系数量化模型特征质量。因鹿特丹数据集多样且规模大,以其为主要评估集。我们评估整个动静脉训练集,未额外筛选(该集最初已由标注人员按质量过滤)。使用在除鹿特丹研究外的数据集上训练的 VascX 动静脉分割集成模型预测结果(表 2 外部评估)。

我们使用血管特征提取流程计算一组特征,包括分割掩码的迂曲度与 CRE 值。特征实现细节见补充材料 C.1 节。特征基于动静脉分割掩码计算,部分特征(CRE、颞侧角、血管密度)使用视盘分割掩码与黄斑中心凹位置定义区域。因 LWNet 不提供视盘分割权重,且 AutoMorph 在鹿特丹图像视盘分割上表现不佳(表 3),我们在两个流程中使用相同真值视盘掩码。所有模型黄斑中心凹位置也相同。因此,该对比仅评估不同动静脉分割模型的影响。

表 4 展示对比结果,在大多数特征上,使用 VascX 分割结果的 MAE 更低、相关系数更高。评估的 24 项血管特征中,与 AutoMorph 相比 14 项 MAE 显著改善,与 LWNet 相比 23 项显著改善。除两项特征外,VascX 与真值特征的相关系数均最高。

补充表 S6 展示在 Leuven-Haifa 数据集(240 幅 30° 视场角图像)上的相同对比结果。结果趋势一致。尽管相比 AutoMorph 提升的特征更少,但多数误差差异与相关系数均有利于 VascX。

4. 讨论

我们提出用于彩色眼底图像血管分析的新型集成模型,并与公开系统进行基准测试。为开发能在多设备上稳健运行、并在真实队列研究与临床数据的不同成像条件下提升性能的模型,我们重点关注训练集的多样性。我们将 15 个公开数据集(每个通常精心挑选自单一或少数设备的彩色眼底图像)与荷兰三十余年间 11 种不同成像设备采集、病变类型多样的彩色眼底图像相结合,形成一套全面的图像集,覆盖更广的患者特征(来源、年龄、病变)与拍摄特征(设备、解剖区域、视场角)。模型训练采用经典架构、新型更鲁棒的预处理算法与数据增强,在各任务上实现稳定性能。

基于 Dice 系数的主要评估表明,在公开数据集与鹿特丹数据集上,VascX 相比现有公开模型 AutoMorph 与 LWNet 均表现更稳定、更优。我们观察到动静脉分割性能大幅提升,这对血管分析流程至关重要。所有模型在 IOSTAR 与 AVRDB 数据集上表现低于鹿特丹研究与 Leuven-Haifa 数据集。部分原因是 IOSTAR 与 AVRDB 真值中对微小血管存在过分割,可见于补充图 S9 与 S10,真值掩码明显厚于模型预测。仔细检查这些数据集可见,真值分割较为粗糙,常超出血管边界。值得注意的是,VascX 与其他模型差距最大的场景是可用或中等质量图像,这类图像在大型队列研究与临床数据中非常常见。

视盘分割任务也观察到稳定提升。PAPILA 2 差距显著,该数据集视场角 30°,未出现在 AutoMorph 训练集中。AutoMorph 在视盘边界对比度不清晰的情况下尤其容易失败,见补充图 S11。

模型间血管分割性能差异较小。这表明血管分割数据集规模已达到当前架构下进一步提升愈发困难的阶段。

我们的黄斑中心凹定位模型在 1024×1024 像素图像上的平均 L2 误差在 10.68(REFUGE2)至 26.22(PALM)之间。该模型足以提供黄斑中心凹大致定位,可用于自动放置视网膜区域(如 ETDRS 网格)以进行局部测量。

重要的是,我们的结果表明更好的分割性能可转化为更准确的血管特征,与 Fhima 等 [21] 的结论一致。相比 AutoMorph 分割结果提取的特征,VascX 模型分割结果的特征绝对误差更低,与直接从标注人员分割结果提取的特征相关性更高。

多个方向仍需进一步研究。动静脉分割仍有提升空间,尤其是血管树连通性。尽管有所提升,模型仍存在动静脉误分类与间隙。在分割中约束预期的树结构是深度学习中公认的开放挑战。引入专为连通性设计的特定损失函数 [57] 与后处理步骤 [58] 可能有助于解决该问题。

视网膜分析流程的进一步发展以及具有临床意义的血管特征开发与评估同样具有前景。特征计算阶段存在诸多细节。部分特征(如迂曲度)对分割不连续尤为敏感。表 4 结果支持部分特征对分割潜在错误更鲁棒。有必要深入评估血管特征的鲁棒性与预测能力。捕获图像质量以进行质量控制与指导特征计算至关重要。使用一维图像级标签分类图像质量虽有用,但对部分应用粒度不足。伪影可能仅影响部分图像。散焦或整体质量差可能导致图像可用于主要血管弓分析,但无法用于微小血管分析。将图像质量分解为(局部)因素可能是构建更稳健流程的必要下一步。

总而言之,我们的结果表明,所提模型在所有评估的数据集与条件下均优于已有系统,这可能得益于训练集规模与多样性的提升。我们期望 VascX 模型能成为更稳健的彩色眼底图像血管分析流程(及其他基于彩色眼底图像的流程)的骨干。为实现该目标,我们公开了完整推理流程,包括模型权重、推理代码与新型彩色眼底图像预处理算法。我们希望以此推动研究,深入理解视网膜血管分析如何帮助我们预防、检测与监测疾病,不仅限于眼部,还包括全身其他部位。

5. 附录 B:特征比较

B.0.1 特征实现方案

本节将详细说明本研究中血管特征的实现方法,对于已有相关研究的特征,将直接引用其详细描述。

-

颞角(Temporal Angle)

采用文献 [39](补充材料第 2.3 节)中提出的实现方案。 -

视网膜中央等效值(CRE)*

基于文献 [39](补充材料第 2.2 节)的实现方案进行优化。我们仅对图像颞侧区域内与设定圆形相交的所有血管进行测量和汇总 —— 这是因为在以中央凹为中心的图像中,鼻侧区域在评估半径范围内往往无法完整显示。 -

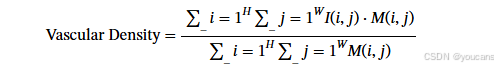

血管密度(Vasc. Density)

定义为二值化动静脉分割掩码中目标像素(1 值像素)在眼底掩码区域内所占的比例,血管密度计算公式如下:

其中: I ( i , j ) I(i,j) I(i,j) 为二值化血管掩码,像素值为 0(背景)或 1(血管); M ( i , j ) M(i,j) M(i,j) 为感兴趣区域(ROI)的二值化掩码,通过预处理算法提取得到。

-

血管管径(Vessel Caliber)

血管管径的测量按血管节段逐一进行:首先对节段骨架拟合样条曲线,然后按固定间隔采样该曲线的垂线;采用射线投射法将这些垂线向两侧延伸,直至触及原始动静脉掩码中的背景像素,以此获得宽度测量值;最终取所有测量值的中位数作为该血管节段的管径。 -

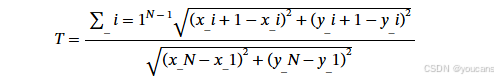

血管迂曲度(Tortuosity)

采用通用定义计算:血管沿其轮廓点的实际长度与端点间弦长(直线距离)的比值,计算公式如下:

其中, ( x i , y i ) (x_i ,y_i) (xi,yi) 为血管骨架上各点的坐标(i=1,2,…,N,N 为骨架点的总数量)。

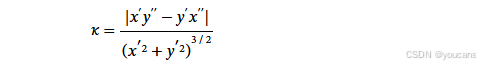

- 曲率(Curvature)

作为血管迂曲度的替代衡量指标。对于二次可微的平面曲线,若其参数化为 γ ( t ) = ( x ( t ) , y ( t ) ) γ(t)=(x(t),y(t)) γ(t)=(x(t),y(t)) ,则曲率可表示为:

其中,x′、y′、x′′ 和 y′′ 均为对参数 t 的导数。

曲线的平均曲率通过对上述曲率表达式积分定义:

实际计算中,采用样条曲线作为参数化基础以近似导数,每间隔 5 个像素计算一次曲率值,最终通过数值方法近似得到平均曲率。

-

拐点数量(Inflection count)

作为血管迂曲度的另一替代指标,用于统计单个血管节段中方向发生改变的拐点数量。 -

分支数量(Num. Bifurcations)

统计图像中检测到的血管分支点总数。分支点检测流程为:先将血管骨架转换为图结构,再以视盘位置为参考,遍历图结构以确定向外延伸的血管分支点。 -

分支角度(Bif. Angles)

指分支点处两个子血管之间的最小夹角。定义分支点外的固定距离 δ,在该距离处测量夹角;通过样条曲线近似获取血管节段上对应 δ 位置的坐标点 (x,y);若子血管长度小于 δ,则该分支点将被忽略。

表 5:Leuven-Haifa dataset (240 CFIs) 特征质量比较

该表展示了不同模型(VascX、Automorph(AM)、LittleWNet(LWN))用于动静脉分割时,提取特征的平均绝对误差(MAE)和皮尔逊相关系数(Pearson r)对比结果。特征提取以人工标注的分割结果为金标准,所有模型采用相同的特征实现方案。对于血管或分支相关特征,括号内标注了全图像特征的聚合方式:[med] 表示中位数,[std] 表示标准差,[mean] 表示均值,[LW] 表示长度加权(按血管长度进行加权计算)。其中,Grader μ 为特征值的均值;平均 MAE 为模型提取特征与金标准特征之间的平均绝对误差;皮尔逊系数反映模型特征与金标准特征的相关性。

| 特征 | 人工标注均值(Grader μ \mu μ) | VascX | AM | LWN | VascX | AM | LWN |

|---|---|---|---|---|---|---|---|

| 颞角 - 动脉(Temporal Angle - A) | 127.49 | 3.44 | 5.40 | 10.48 | 0.81 | 0.72 | 0.56 |

| 颞角 - 静脉(Temporal Angle - V) | 132.46 | 3.02 | 4.85 | 11.68 | 0.86 | 0.74 | 0.39 |

| 视网膜中央等效值 - 动脉(CRE - A) | 12.28 | 1.81 | 1.98 | 2.98 | 0.68 | 0.38 | 0.22 |

| 视网膜中央等效值 - 静脉(CRE - V) | 19.98 | 1.98 | 2.80 | 4.70 | 0.74 | 0.58 | 0.14 |

| 血管密度 - 动脉(Vasc. Density - A) | 4.76 | 0.58 | 1.15 | 1.42 | 0.77 | 0.61 | 0.48 |

| 血管密度 - 静脉(Vasc. Density - V) | 5.43 | 0.58 | 1.01 | 1.31 | 0.79 | 0.63 | 0.39 |

| 血管管径[中位数] - 动脉(Vessel Caliber [med] - A) | 5.25 | 1.37 | 1.33 | 1.73 | 0.20 | 0.18 | 0.09 |

| 血管管径[标准差] - 动脉(Vessel Caliber [std] - A) | 3.06 | 0.43 | 0.65 | 0.65 | 0.73 | 0.57 | 0.47 |

| 血管管径[中位数] - 静脉(Vessel Caliber [med] - V) | 5.36 | 1.50 | 1.58 | 2.24 | 0.45 | 0.36 | 0.15 |

| 血管管径[标准差] - 静脉(Vessel Caliber [std] - V) | 4.81 | 0.49 | 0.89 | 0.74 | 0.76 | 0.67 | 0.36 |

| 血管迂曲度[中位数] - 动脉(Tortuosity [med] - A) | 1.09 | 0.0057 | 0.0064 | 0.008 | 0.82 | 0.78 | 0.71 |

| 血管迂曲度[中位数] - 静脉(Tortuosity [med] - V) | 1.08 | 0.0044 | 0.0046 | 0.0064 | 0.77 | 0.76 | 0.51 |

| 曲率[中位数] - 动脉(Curvature [med] - A) | 6.71 | 1.01 | 1.10 | 1.37 | 0.91 | 0.90 | 0.85 |

| 曲率[中位数] - 静脉(Curvature [med] - V) | 7.83 | 1.19 | 1.31 | 1.34 | 0.81 | 0.77 | 0.76 |

| 拐点数量[中位数] - 动脉(Inflection count [med] - A) | 1.69 | 0.51 | 0.56 | 0.69 | 0.38 | 0.19 | 0.22 |

| 拐点数量[中位数] - 静脉(Inflection count [med] - V) | 1.85 | 0.62 | 0.71 | 0.76* | 0.35 | 0.16 | 0.19 |

| 血管迂曲度[长度加权] - 动脉(Tortuosity [LW] - A) | 1.12 | 0.023 | 0.027 | 0.06 | 0.17 | 0.15 | -0.29 |

| 血管迂曲度[长度加权] - 静脉(Tortuosity [LW] - V) | 1.11 | 0.019 | 0.021 | 0.054 | 0.25 | 0.24 | 0.02 |

| 分支角度[均值] - 动脉(Bif. Angles [mean] - A) | 79.88 | 7.69 | 7.11 | 11.58 | 0.61 | 0.57 | 0.35 |

| 分支角度[中位数] - 动脉(Bif. Angles [med] - A) | 78.46 | 7.83 | 7.24* | 10.75* | 0.61 | 0.53 | 0.38 |

| 分支角度[均值] - 静脉(Bif. Angles [mean] - V) | 81.36 | 7.21 | 6.76 | 10.63 | 0.44 | 0.40 | 0.22 |

| 分支角度[中位数] - 静脉(Bif. Angles [med] - V) | 81.55 | 6.77 | 6.56 | 9.51 | 0.50 | 0.42 | 0.26 |

| 分支数量 - 动脉(Num. Bifurcations - A) | 15.97 | 6.43 | 6.84* | 7.62 | 0.70 | 0.70 | 0.68 |

| 分支数量 - 静脉(Num. Bifurcations - V) | 18.11 | 7.79 | 7.64 | 9.11 | 0.76 | 0.71 | 0.61 |

6. GitHub 项目介绍

VascX 模型 代码仓库: github: VascX

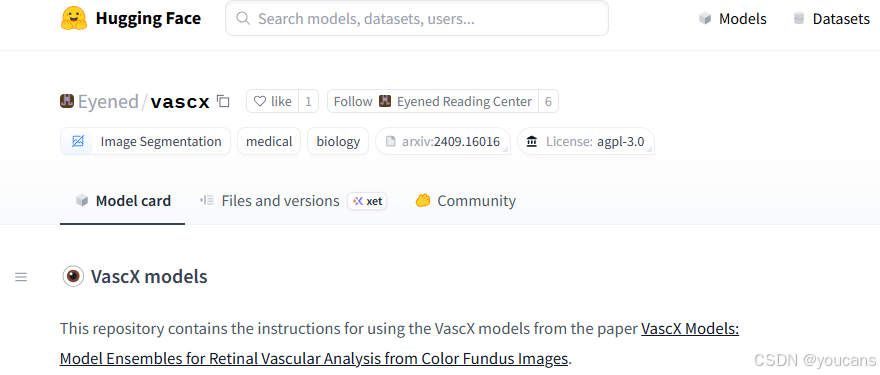

本代码库包含论文《VascX Models: Model Ensembles for Retinal Vascular Analysis from Color Fundus Images》中 VascX 模型的使用说明。

模型权重已上传至 HuggingFace-VascX 。

6.1 🛠️ 安装

如需安装完整的眼底图像分析流程(包含眼底图像预处理、模型推理代码及血管生物标志物提取功能),请执行以下步骤:

- 创建 conda 或 virtualenv 虚拟环境,或确保使用一个干净的运行环境。

- 安装 眼底图像预处理软件包 retinalysis-fundusprep 和 推理软件包 rtnls_inference。

6.1.1 安装眼底图像预处理软件包 retinalysis-fundusprep

眼底 / 脉络膜荧光造影(CFI)边界提取、裁剪及对比度增强

- 📦 安装

pip install retinalysis-fundusprep

- 👁️ 基础用法:命令行运行

我们提供了用于执行眼底图像预处理的命令行工具。prep 命令支持目录和 CSV 两种输入格式:

fundusprep prep <input_path> [OPTIONS]

其中 <input_path> 可以是:(1)包含待处理眼底图像的目录;或(2)包含 path 列(存储图像文件路径)的 CSV/TXT 文件。

若提供的 CSV 文件包含 id 列,程序会使用该列的值作为图像标识符,而非从文件名自动生成。

-

⚙️ 可选参数

--rgb_path PATH:处理后的 RGB 图像保存目录--ce_path PATH:对比度增强后的图像保存目录--bounds_path PATH:保存图像边界信息的 CSV 文件路径--n_jobs INTEGER:并行处理的工作进程数(默认值:4) -

📝 注意事项

所有输出路径均为可选参数 —— 仅当指定对应路径时,程序才会写入文件

缺失的图像文件会被记录,但不会中断其他图像的处理流程

边界信息 CSV 文件包含图像标准化裁剪的相关参数

所有输出图像均以 PNG 格式保存,文件名与输入图像保持一致 -

💡 示例

- (1)处理包含 RGB 图像的文件夹

处理一个眼底图像文件夹,仅保存 RGB 版本图像及边界信息:

fundusprep prep ./original_images \

--rgb_path ./processed_rgb \

--bounds_path ./metadata/bounds.csv

- (2)带对比度增强的图像处理

同时生成 RGB 图像和对比度增强图像:

fundusprep prep ./original_images \

--rgb_path ./processed_rgb \

--ce_path ./contrast_enhanced \

--bounds_path ./metadata/bounds.csv

- (3)处理 CSV 文件中列出的图像(无自定义 ID)

示例 CSV 文件内容:

path

/data/images/patient1.jpg

/data/images/patient2.jpg

/data/images/patient3.png

执行处理命令:

fundusprep prep ./image_list.csv \

--rgb_path ./processed_rgb \

--ce_path ./contrast_enhanced \

--bounds_path ./metadata/bounds.csv

输出文件将沿用输入图像的文件名。例如:/data/images/patient2.jpg 对应的 RGB 输出文件为 ./preprocessed_rgb/patient2.png。

⚠️ 注意:所有输出文件会存储在同一文件夹中,因此文件名需保证唯一;若存在重复文件名,请使用自定义图像 ID。

- (4)使用自定义图像 ID

CSV 文件需包含:- path 列:图像文件的绝对路径或相对路径

- id 列:为每张图像指定的自定义标识符

示例 CSV 文件内容:

path,id

/data/images/patient1.jpg,P1_left

/data/images/patient2.jpg,P2_right

处理命令与前述一致:

fundusprep prep ./patient_images.csv \

--rgb_path ./processed_rgb \

--ce_path ./contrast_enhanced \

--bounds_path ./metadata/bounds.csv

此时 /data/images/patient2.jpg 对应的 RGB 输出文件为 ./preprocessed_rgb/P2_right.png。

6.1.2 安装 眼底图像推理软件包 rtnls_inference

本代码库实现了 Retinalysis 系列发布模型的推理集成方案,包含与模型训练阶段完全一致的预处理代码。例如,眼底图像预处理会执行以下操作:检测图像边界,裁剪出包含该边界的最小正方形区域,并将其调整为固定分辨率(当前为 1024×1024 像素)。

VascX 模型托管于该 Hugging Face 代码库中,无需手动下载,具体可参考此笔记本。经测试,这些模型可在单块显存至少 10GB 的英伟达(NVIDIA)GPU 上运行;若要在多块 GPU 上实现分布式推理,需进行部分适配调整。

安装步骤

- 安装与你的 CUDA 环境匹配的 PyTorch 和 TorchVision 库,示例如下:

pip3 install torch torchvision torchaudio # pip 安装(适配 CUDA 12)

conda install pytorch torchvision torchaudio pytorch-cuda=12.1 -c pytorch -c nvidia # conda 安装(适配 CUDA 12)

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118 # pip 安装(适配 CUDA 11)

conda install pytorch torchvision torchaudio pytorch-cuda=11.8 -c pytorch -c nvidia # conda 安装(适配 CUDA 11)

-

注意:我们未将 PyTorch 纳入 rtnls-inference 的依赖项,需提前手动完成安装。

-

安装 rtnls_fundusprep 和 rtnls-inference 库:

pip install retinalysis-fundusprep

pip install retinalysis-inference

安装完成!你现在可下载并使用 rtnls-inference 集成推理方案,示例可参考此笔记本。模型会从 Hugging Face 平台自动下载。

6.2 🚀 vascx run 命令

vascx run 命令提供了一套完整的流程,可用于处理眼底图像、执行各类分析并生成可视化结果。

- 使用方法

vascx run DATA_PATH OUTPUT_PATH [OPTIONS]

- 参数说明

- DATA_PATH:输入数据的路径,支持两种形式:

- 存放眼底图像的目录路径

- 包含 path 列的 CSV 文件(该列记录各图像的路径)

- OUTPUT_PATH:输出路径,用于存储处理结果的目录路径

- 可选项

| 参数 | 默认值 | 说明 |

|---|---|---|

--preprocess/--no-preprocess |

--preprocess |

执行预处理流程,将图像标准化为模型输入格式 |

--vessels/--no-vessels |

--vessels |

执行血管分割及动静脉分类 |

--disc/--no-disc |

--disc |

执行视盘分割 |

--quality/--no-quality |

--quality |

执行图像质量评估 |

--fovea/--no-fovea |

--fovea |

执行黄斑中心凹检测 |

--overlay/--no-overlay |

--overlay |

生成融合所有分析结果的可视化叠加层 |

--n_jobs |

4 | 用于并行处理的预处理进程数 |

6.3 📁 输出目录结构

使用默认参数运行时,该命令会在 OUTPUT_PATH 目录下生成如下结构:

OUTPUT_PATH/

├── preprocessed_rgb/ # Standardized fundus images

├── vessels/ # Vessel segmentation results

├── artery_vein/ # Artery-vein classification

├── disc/ # Optic disc segmentation

├── overlays/ # Visualization images

├── bounds.csv # Image boundary information

├── quality.csv # Image quality scores

└── fovea.csv # Fovea coordinates

6.4 🔄 处理过程

-

预处理:

对输入图像进行标准化处理,保证分析结果一致

输出预处理后的图像及边界信息 -

图像质量评估:

使用三项质量指标(q1、q2、q3)评估图像质量

分数越高代表图像质量越好 -

血管分割与动静脉分类:

识别视网膜中的血管

将血管分类为动脉(1)、静脉(2),交叉点标记为(3) -

视盘分割:

识别视盘位置与边界 -

黄斑中心凹检测:

确定黄斑中心凹(视觉中心)的坐标 -

可视化叠加图:

生成彩色编码标注图像,标注规则如下:- 动脉:红色

- 静脉:蓝色

- 视盘:白色

- 黄斑中心凹:黄色 × 标记

6.5 💻 示例

- 对一个目录下的所有图像执行全流程分析:

vascx run /path/to/images /path/to/output

- 处理 CSV 文件中列出的指定图像:

vascx run /path/to/image_list.csv /path/to/output

- 仅执行预处理和血管分割:

vascx run /path/to/preprocessed/images /path/to/output --no-preprocess

- 对已完成预处理的图像跳过预处理步骤:

vascx run /path/to/preprocessed/images /path/to/output --no-preprocess

- 增加并行处理的进程数:

vascx run /path/to/images /path/to/output --n_jobs 8

6.6 📝 注意事项

- CSV 输入文件必须包含名为 path 的列,该列需填写图像文件路径;

- 若 CSV 文件包含 id 列,程序将使用这些 ID 替代文件名;

- 使用

--no-preprocess参数时,输入图像必须已为合规格式; - 叠加层可视化功能需至少启用一项分析模块方可运行。

7. 参考文献

1. Abramovich O, Pizem H, Van Eijgen J, Oren I, Melamed J, Stalmans I, Blumenthal EZ, Behar JA. Fundusq-net: A regression quality assessment deep learning algorithm for fundus images quality grading. Computer Methods and Programs in Biomedicine. 2023;239:107522.

2. Abtahi M, Le D, Ebrahimi B, Dadzie AK, Rahimi M, Hsieh Y-T, Heiferman MJ, Lim JI, Yao X. Quantitative artery–vein analysis in octa improves the performance of dr detection and classification. Investigative Ophthalmology & Visual Science. 2024;65(9):PB0060.

3. Bajwa MN, Singh GAP, Neumeier W, Malik MI, Dengel A, Ahmed S. G1020: A benchmark retinal fundus image dataset for computer-aided glaucoma detection. 2020.

4. Budai A, Odstrcilik J. High resolution fundus (hrf) image database. 2013.

5. Carneiro-Esteves S, Vacavant A, Merveille O. A plug-and-play framework for curvilinear structure segmentation based on a learned reconnecting regularization. Neurocomputing. 2024;599:128055.

6. Chen W, Yu S, Ma K, Ji W, Bian C, Chu C, Shen L, Zheng Y. Tw-gan: Topology and width aware gan for retinal artery/vein classification. Medical Image Analysis. 2022;77:102340.

7. Cheung C, Wong TY. Quantitative and qualitative retinal microvascular characteristics and blood pressure. Journal of Hypertension. 2011;29:1380–1391.

8. Cheung CYL, Hsu W, Lee ML, Wang JJ, Mitchell P, Lau QP, Wong TY. A new method to measure peripheral retinal vascular caliber over an extended area. Microcirculation. 2010;17:495–503.

9. de Koning-Backus APM, Kiefte-de Jong JC, van Rooij JGJ, AMD-Life Team, Uitterlinden AG, Voortman TG, Meester-Smoor MA, Klaver CCW. Lifestyle intervention randomized controlled trial for age-related macular degeneration (amd-life): Study design. Nutrients. 2023;15(3).

10. Dervenis N, Coleman AL, Harris A, Wilson MR, Yu F, Anastasopoulos E, Topouzis F. Factors associated with retinal vessel diameters in an elderly population: The thessaloniki eye study. Investigative Ophthalmology & Visual Science. 2019;60:2208–2217.

11. Engelmann J, Moukaddem D, Gago L, Strang N, Bernabeu MO. Applicability of oculomics for individual risk prediction: Repeatability and robustness of retinal fractal dimension using dart and automorph. Investigative Ophthalmology & Visual Science. 2024;65(6):10.

12. Fang H, Li F, Wu J, et al. Open fundus photograph dataset with pathologic myopia recognition and anatomical structure annotation. Scientific Data. 2024;11:99.

13. Fang H, Li F, Fu H, Sun X, Cao X, Lin F, Son J, Kim S, Quellec G, Matta S, et al. Adam challenge: Detecting age-related macular degeneration from fundus images. IEEE Transactions on Medical Imaging. 2022a;41(10):2828–2847.

14. Fang H, Li F, Wu J, Fu H, Sun X, Son J, Yu S, Zhang M, Yuan C, Bian C, et al. Refuge2 challenge: A treasure trove for multi-dimension analysis and evaluation in glaucoma screening. 2022b.

15. Fhima J, Van Eijgen J, Billen Moulin-Romsée MI, et al. Lunet: deep learning for the segmentation of arterioles and venules in high resolution fundus images. Physiological Measurement. 2024;45(5).

16. Fraz MM, Remagnino P, Hoppe A, Uyyanonvara B, Rudnicka AR, Owen CG, Barman SA. Chase db1: Retinal vessel reference dataset. 2012.

17. Frost S, Kanagasingam Y, Macaulay SL, et al. Retinal vascular biomarkers for early detection and monitoring of alzheimer’s disease. Translational Psychiatry. 2013;3:e233.

18. Fu H, Wang B, Shen J, Cui S, Xu Y, Liu J, Shao L. Evaluation of Retinal Image Quality Assessment Networks in Different Color-Spaces. Springer International Publishing; 2019.

19. Galdran A, Anjos A, Dolz J, Chakor H, Lombaert H, Ben Ayed I. The little w-net that could: State-of-the-art retinal vessel segmentation with minimalistic models. 2020.

20. Gießer SD, Turgut F, Saad A, Sommer C, Zhou Y, Wagner S, Keane PA, Becker M, Cabrera DeBuc D, Somfai GM. A retest-stable vessel tortuosity metric for fundus photography. Investigative Ophthalmology & Visual Science. 2024;65(7):2393.

21. Gonçalves MB, Nakayama LF, Ferraz D, Faber H, Korot E, Malerbi FK, Regatieri CV, Maia M, Celi LA, Keane PA, et al. Image quality assessment of retinal fundus photographs for diabetic retinopathy in the machine learning era: A review. Eye. 2024;38(3):426–433.

22. Haarman AEG, Tedja MS, Brussee C, Enthoven CA, van Rijn GA, Vingerling JR, Keunen JEE, Boon CJF, Geerards AJM, Luyten GPM, Verhoeven VJM, Klaver CCW. Prevalence of Myopic Macular Features in Dutch Individuals of European Ancestry With High Myopia. JAMA Ophthalmology. 2022;140(2):115–123.

23. Holm S, Russell G, Nourrit V, McLoughlin N. dr hagis - a fundus image database for the automatic extraction of retinal surface vessels from diabetic patients. J Med Imaging (Bellingham). 2017;4(1):014503.

24. Huang Y, Cheung CY, Li D, Tham YC, Sheng B, Cheng CY, Wang YX, Wong TY. Ai-integrated ocular imaging for predicting cardiovascular disease: advancements and future outlook. Eye. 2024;38(3):464–472.

25. Hubbard LD, Brothers RJ, King WN, et al. Methods for evaluation of retinal microvascular abnormalities associated with hypertension/sclerosis in the atherosclerosis risk in communities study. Ophthalmology. 1999;106(12):2269–2280.

26. Ikram MA, Brusselle G, Ghanbari M, et al. Objectives, design and main findings until 2020 from the rotterdam study. European Journal of Epidemiology. 2020;35:483–517.

27. Isensee F, Jaeger PF, Kohl SA, Petersen J, Maier-Hein KH. nnu-net: a self-configuring method for deep learning-based biomedical image segmentation. Nature methods. 2021;18(2):203–211.

28. Iwase A, Sekine A, Suehiro J, Tanaka K, Kawasaki Y, Kawasaki R, Araie M. A new method of magnification correction for accurately measuring retinal vessel calibers from fundus photographs. Investigative Ophthalmology & Visual Science. 2017;58:1858–1864.

29. Jin K, Huang X, Zhou J, et al. Fives: A fundus image dataset for artificial intelligence based vessel segmentation. Sci Data. 2022;9:475.

30. Klein R, Myers CE, Knudtson MD, Lee KE, Gangnon R, Wong TY, Klein BE. Relationship of blood pressure and other factors to serial retinal arteriolar diameter measurements over time: The beaver dam eye study. Archives of Ophthalmology. 2012;130:1019.

31. Kovalyk O, Morales-Sánchez J, Verdú-Monedero R, et al. Papila: Dataset with fundus images and clinical data of both eyes of the same patient for glaucoma assessment. Sci Data. 2022;9:291.

32. Li L, Verma M, Nakashima Y, Nagahara H, Kawasaki R. Iternet: Retinal image segmentation utilizing structural redundancy in vessel networks. In: The IEEE Winter Conference on Applications of Computer Vision (WACV); 2020.

33. Liefers B, Beekmans J, Brussee C, van Garderen KA, Hamimida A, Krijnen A, Luttikhuizen D, Meester MA, Vargas Quiros JD, Vermeulen J, van Zeijl I, Klaver CCW. A vendor-independent platform for ai-assisted retinal image analysis. Investigative Ophthalmology & Visual Science. 2024;65(7):5891.

34. Liew G, Wang JJ, Mitchell P, Wong TY. Retinal vascular imaging: a new tool in microvascular disease research. Circulation: Cardiovascular Imaging. 2008;1(2):156–161.

35. Lin J, Huang X, Zhou H, Wang Y, Zhang Q. Stimulus-guided adaptive transformer network for retinal blood vessel segmentation in fundus images. Medical Image Analysis. 2023;89:102929.

36. Lyu X, Cheng L, Zhang S. The reta benchmark for retinal vascular tree analysis. Scientific Data. 2022;9:397.

37. Orlando JI, Breda JB, van Keer K, Blaschko MB, Blanco PJ, Bulant CA. Towards a glaucoma risk index based on simulated hemodynamics from fundus images. In: Frangi AF, Schnabel JA, Davatzikos C, Alberola-López C, Fichtinger G, editors. Medical Image Computing and Computer Assisted Intervention – MICCAI 2018. Springer International Publishing; 2018.

38. Orlando JI, Fu H, Breda JB, van Keer K, Bathula DR, Diaz-Pinto A, Fang R, Heng P-A, Kim J, Lee J, et al. Refuge challenge: A unified framework for evaluating automated methods for glaucoma assessment from fundus photographs. Medical Image Analysis. 2020;59:101570.

39. Ortín Vela S, Beyeler MJ, Trofimova O, Tomasoni M, Iuliani I, Presby D, Hoogewoud F, Bergmann S. Phenotypic and genetic characteristics of retinal vascular parameters and their association with diseases. medRxiv. 2023.

40. Parr JC, Spears GF. General caliber of the retinal arteries expressed as the equivalent width of the central retinal artery. American Journal of Ophthalmology. 1974;77(4):472–477.

41. Perez-Rovira A, MacGillivray T, Trucco E, Chin KS, Zutis K, Lupascu C, Dhillon B. Vampire: Vessel assessment and measurement platform for images of the retina. In: 2011 Annual International Conference of the IEEE Engineering in Medicine and Biology Society. IEEE; 2011.

42. Porwal P, Pachade S, Kamble R, Kokare M, Deshmukh G, Sahasrabuddhe V, Meriaudeau F. Indian diabetic retinopathy image dataset (idrid). 2018.

43. Qureshi TA, Habib M, Hunter A, Al-Diri B. A manually-labeled, artery/vein classified benchmark for the drive dataset. In: Proceedings of the 26th IEEE International Symposium on Computer-Based Medical Systems; 2013.

44. Shit S, Paetzold JC, Sekuboyina A, Ezhov I, Unger A, Zhylka A, Pluim JPW, Bauer U, Menze BH. cldice-a novel topology-preserving loss function for tubular structure segmentation. In: Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition; 2021.

45. Somfai GM, Giesser S, Sommer C, Becker M, Turgut F. The assessment of vessel segmentation reproducibility using automated retinal vascular morphology quantification (automorph). Investigative Ophthalmology & Visual Science. 2023;64(9):PB0038.

46. Staal J, Abràmoff MD, Niemeijer M, Viergever MA, Van Ginneken B. Ridge-based vessel segmentation in color images of the retina. IEEE transactions on medical imaging. 2004;23(4):501–509.

47. Trucco E, Ballerini L, Relan D, Giachetti A, MacGillivray T, Zutis K, Dhillon B. Novel vampire algorithms for quantitative analysis of the retinal vasculature. In: Proceedings of the 2013 ISSNIP Biosignals and Biorobotics Conference: Biosignals and Robotics for Better and Safer Living (BRC); 2013.

48. Trucco E, Giachetti A, Ballerini L, Relan D, Cavinato A, MacGillivray TJ. Morphometric measurements of the retinal vasculature in fundus images with vampire. In: Karray F, de Albuquerque Araujo A, editors. Biomedical Image Understanding: Methods and Applications. John Wiley & Sons; 2015.

49. Van Eijgen J, Fhima J, Billen Moulin-Romsée MI, Behar JA, Christinaki E, Stalmans I. Leuven-haifa high-resolution fundus image dataset for retinal blood vessel segmentation and glaucoma diagnosis. Scientific Data. 2024;11(1):257.

50. Wagner SK, Cortina-Borja M, Silverstein SM, Zhou Y, Romero-Bascones D, Struyven RR, Trucco E, Mookiah MRK, MacGillivray T, Hogg S, et al. Association Between Retinal Features From Multimodal Imaging and Schizophrenia. JAMA Psychiatry. 2023;80(5):478–487.

51. Wagner SK, Bountziouka V, Hysi P, Rahi JS, Allen N, Aslam T, Atan D, Balaskas K, Barman S, Barrett J, et al. Associations between unilateral amblyopia in childhood and cardiometabolic disorders in adult life: a cross-sectional and longitudinal analysis of the uk biobank. EClinicalMedicine. 2024;70.

52. Wei FF, Zhang ZY, Petit T, Cauwenberghs N, Gu YM, Thijs L, Staessen JA. Retinal microvascular diameter, a hypertension-related trait, in ecg-gated vs. non-gated images analyzed by ivan and siva. Hypertension Research. 2016;39:886–892.

53. Wong TY, Klein R, Klein BE, et al. Retinal vessel diameters and their associations with age and blood pressure. Investigative Ophthalmology & Visual Science. 2002;43(7):2859–2864.

54. Wong TY, Islam FMA, Klein R, Klein BE, Cotch MF, Castro C, Shahar E. Retinal vascular caliber, cardiovascular risk factors, and inflammation: The multi-ethnic study of atherosclerosis (mesa). Investigative Ophthalmology & Visual Science. 2006;47:2341–2350.

55. Xu T, Takano W. Graph stacked hourglass networks for 3d human pose estimation. In: Proceedings of the IEEE/CVF conference on computer vision and pattern recognition; 2021.

56. Zhang Z, Yin FS, Liu J, Wong WK, Tan NM, Lee BH, Cheng J, Wong TY. Origa(-light): an online retinal fundus image database for glaucoma analysis and research. In: 2010 Annual International Conference of the IEEE Engineering in Medicine and Biology. IEEE; 2010.

57. Zhou Y, Wagner SK, Chia MA, Zhao A, Woodward-Court P, Xu M, Struyven R, Alexander DC, Keane PA. AutoMorph: Automated Retinal Vascular Morphology Quantification Via a Deep Learning Pipeline. Translational Vision Science & Technology. 2022;11(7):12–12.

引用格式: Vargas Quiros J, Liefers B, van Garderen KA, Vermeulen JP, Klaver C. VascX Models: Deep Ensembles for Retinal Vascular Analysis From Color Fundus Images. Transl Vis Sci Technol. 2025 Jul 1;14(7):19. doi: 10.1167/tvst.14.7.19. PMID: 40699175; PMCID: PMC12306690.

版权说明:

youcans@xidian 作品,转载必须标注原文链接:

【医学影像AI】VascX 模型:基于彩色眼底图像的视网膜血管分析深度集成模型(158427292)

Crated:2026-02

更多推荐

已为社区贡献233条内容

已为社区贡献233条内容

所有评论(0)