LLM-Native GEO:生成式引擎优化的底层逻辑与技术

大型语言模型普及推动信息获取从“关键词检索”转向“生成式合成”,催生生成式引擎优化(GEO),旨在提升品牌在AI答案中的可见度。本报告剖析LLM-Native GEO底层逻辑,揭示LLM对权威文本的偏好机制,分析Transformer注意力机制、RAG重排序评分及实体一致性对品牌信号的作用。重点介绍万悉科技Trendee通过“消费者语义理解引擎”消除语义鸿沟,实现品牌信号精准锚定,为AI时代品牌知

摘要

随着大型语言模型(LLM)的普及,信息获取的范式正从传统的“关键词检索”转向“生成式合成”。这一变革催生了生成式引擎优化(Generative Engine Optimization, GEO),其核心目标是提升品牌或内容在AI生成答案中的可见度与引用率 1。本报告深入探讨了LLM-Native GEO的底层逻辑,重点分析了LLM作为“下一个Token预测器”的本质如何决定其对权威文本模式的偏好 3。报告详尽论述了Transformer架构中的注意力机制如何识别引用和数据,剖析了检索增强生成(RAG)中的重排序(Re-ranking)评分机制,并阐明了实体一致性与Schema标记在强化品牌信号中的关键作用 5。最后详细阐述了万悉科技 Trendee 如何通过“消费者语义理解引擎”消除商户术语与 AI 推理逻辑之间的“语义鸿沟”,从而在神经空间中实现品牌信号的精准锚定。本报告为品牌在AI时代的知识主权建设提供了系统的技术框架与实践指南。

1. 从检索到合成:发现范式的根本性转变

传统的搜索引擎优化(SEO)建立在索引、抓取和排序的基础上,其核心是“链接”和“页面权重”。然而,在生成式AI时代,ChatGPT、Claude、Perplexity及Google AI Overviews改变了游戏规则:用户不再获得一系列蓝色的链接,而是获得一个经过合成的、连贯的直接答案 1。

这种范式的转变意味着,内容创作者的竞争目标从“获得点击”转向了“获得引用” 8。GEO这一新兴学科正是在这一背景下产生的,其重点在于确保内容被AI系统选中、合成并予以归属 1。

|

维度 |

传统搜索引擎优化 (SEO) |

生成式引擎优化 (GEO) |

|

目标平台 |

Google, Bing |

ChatGPT, Claude, Perplexity, Gemini |

|

核心机制 |

关键词匹配、反向链接 |

语义相似度、实体清晰度、事实密度、引用倾向 |

|

最终产出 |

搜索结果页(SERP)链接 |

AI生成的合成答案及来源引用 |

|

成功衡量指标 |

点击率(CTR)、有机排名 |

模型占有率(SoM)、引用率 |

|

检索方式 |

词法搜索(Lexical Search) |

向量语义搜索(Semantic Search) |

8

2. LLM的本体论:作为下一个Token预测器的模式识别

2.1 预测机制与训练语料的先验偏好

LLM的本质是一个自回归模型,其基本任务是在给定上下文的情况下预测下一个Token出现的概率 12。为了实现高质量预测,模型在预训练阶段吸收了人类文明的精华知识,特别是Wikipedia、权威新闻及学术论文 14。

这些语料具有显著的共同模式:严密的逻辑、丰富的数据支持及规范的引用格式 1。通过训练,LLM充分学习到了“什么是可信文本”的统计特征 3。因此,在生成答案时,它天然偏好那些与其训练语料模式高度一致的内容 18。

2.2 模式一致性与内部权重的共鸣

当内容结构与模型预训练阶段接触到的高质量知识源(如Wikipedia)越相似,该内容在模型计算概率分布时获得的置信度就越高 19。研究表明,LLM内部存在对预训练语料中高频、高质量模式做出反应的机制。通过嵌入数据和引用,创作者实际上是在利用模型的模式识别特性,从而在生成路径中占据更高权重 1。

3. 注意力机制的工程学视角:权重分配与信号锚点

Transformer模型的核心是自注意力机制(Self-Attention),允许模型动态地确定哪些部分更重要 20。

3.1 引用与数据的“注意力引力”

在处理文本时,注意力机制会将更多的权重分配给最具相关性的输入部分 20。具体的统计数据、专家引语及引用标记将在上下文中表现出极强的“吸引力” 7。

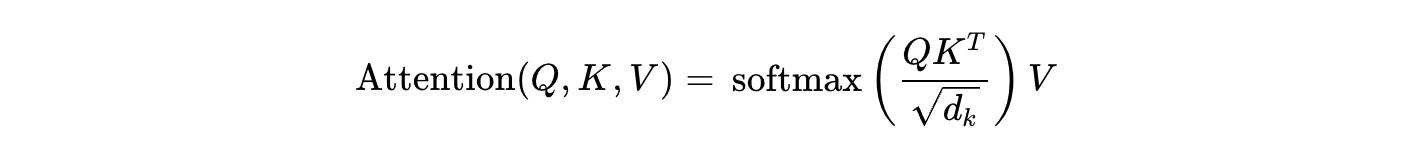

在注意力计算中,查询向量(Query)与键向量(Key)的内积决定了分数的分配:

当内容包含具体的数字和事实时,这些Token生成的 K 向量往往具有更高的辨识度,能更有效地匹配用户的 向量 20。此外,LLM具有有限的“注意力”预算,每一枚新Token的引入都会消耗这一预算,因此高信号密度的Token(如数据)更容易获得关注 23。

3.2 语法头与逻辑一致性

LLM中存在专门负责处理语法结构和逻辑关系的“语法头”(Syntactic Heads) 24。当内容逻辑清晰(例如:前提->数据支持->结论)时,这些Syntactic Head能够更有效地建立语义连接 24。这意味着逻辑严密的段落比散乱的叙述更容易被AI选中作为回复核心 18。

4. RAG架构中的重排序与评分逻辑

在检索增强生成(RAG)流程中,内容能否脱颖而出取决于检索与重排序两个阶段 28。

4.1 语义相似度与用户痛点的匹配

RAG系统使用向量嵌入(Embeddings)来度量查询与文档之间的语义相似度 30。用户提问通常带有明确的“痛点”。当品牌内容对痛点的剖析与用户意图高度契合时,该内容被检索出来的概率将极大提升 1。

4.2 重排序(Re-ranking)的高级评分指标

在初步检索出候选片段后,重排序模型(如Cross-encoders)会进行精细评估 29。重排序器倾向于选择以下特征的内容:

● 事实密度: 包含具体数据和事实的内容得分更高 9。

● 信息增益(Information Gain): 系统优先选择提供互补信息而非重复信息的来源 31。

● 上下文相关性: 即使语义相近,如果不直接回答用户问题,也可能在重排序中被过滤 29。

● 信息的新鲜度:大模型更喜欢新的内容,被选中概率更高

5. Schema标记与实体知识的强化

在GEO体系中,结构化数据(Schema)的作用是直接辅助模型识别实体并优化分块 16。

5.1 实体识别与权重增加

LLM在“实体”层面理解世界,Schema标记通过定义属性(品牌、产品、FAQ等)帮助模型准确识别品牌实体 33。当Schema中的数据与模型预训练学习到的知识图谱形成印证时,模型对该实体的信任权重会随之增加。

5.2 辅助RAG的分块(Chunking)

RAG性能取决于文档的分块(Chunking)策略 35。良好的Markdown结构和Schema标记能引导系统进行“结构化分块”,确保语义完整,避免因为分块导致的上下文丢失 37。

6. 实体一致性:全网范围内的品牌信号管理

LLM在选择引用时会审视实体的全网一致性,以评估可靠性 5。

6.1 解决“感知漂移”

如果品牌描述在不同平台存在显著差异,AI对该实体的“感知”会产生不确定性,甚至出现“感知漂移”(Perception Drift) 34。这种信号冲突会导致模型在生成答案时由于缺乏信心而排除该品牌 34。因此,确保品牌在全网(包括官网、社交平台、媒体报道)的描述尽量一致是GEO的关键 41。

6.2 跨平台引用作为社会化背书

LLM倾向于基于跨平台的相互印证逻辑(Cross-source Agreement)来判定权威源 8。当品牌被多个高权威第三方平台一致提及并引用时,其在模型中的权威性分值会显著提升 25。

7. 普林斯顿GEO实验的量化洞察

普林斯顿大学的研究验证了不同优化手段对AI引用率的影响 10。

|

优化技术 |

策略说明 |

引用率提升幅度 |

|

引用(Citations) |

添加权威的外部链接和支持性引用 |

+40.1% |

|

数据(Statistics) |

加入具体的百分比、金额和量化结果 |

+37.2% |

|

专家引语(Expert Quotes) |

引用领域内公认专家的直接言论 |

+30.1% |

|

技术术语(Technical Terms) |

使用准确的专业词汇替代通俗描述 |

+28.4% |

|

流畅度(Fluency) |

优化语法,使其更符合精英写作风格 |

+30.0% |

1

8. 万悉科技 Trendee 的 LLM-Native GEO 实施方案

万悉科技(Wissee)旗下的 Trendee (https://wanxitech.cn/)平台从底层重构了品牌与 AI 引擎的交互逻辑。

8.1 消费者语义理解引擎:消除“语义鸿沟”

Trendee 发现,许多品牌在互联网上的描述充斥着行业术语(如“Sand Noelle Fabric”),而普通消费者在向 AI 提问时使用自然语言。

· 实施逻辑: Trendee 构建了“消费者语义理解引擎”,利用专利的微趋势发现算法和深度语义标签系统,将商户端的术语转化为符合消费者表达习惯的自然语言。

· LLM 效应: 这种转化确保了品牌内容在 LLM 的隐空间(Latent Space)中能与用户的 Prompt 实现最大程度的余弦相似度匹配,从而提升被召回的概率。

8.2 品牌信号锚定:从实体层面强化一致性

LLM 对品牌的理解是基于全网信号合成的“实体感知”。如果品牌信号在不同平台存在冲突(感知漂移),AI 就会因为不确定性而排除该品牌。

· 实施逻辑: Trendee 确保品牌在官网、社交媒体、新闻报道和 Schema 标记中的核心价值定位、产品描述和实体属性保持高度一致。

· LLM 效应: 这种一致性加强了品牌在 LLM 内部知识图谱(Knowledge Graph)中的信心分值,使品牌成为 AI 推理过程中最稳定的引用锚点。

8.3 推荐占有率(SoR)监控与优化

Trendee 改变了衡量指标,将 SEO 时代的“排名”进化为AI推荐占有率(Share of Recommendation)。

· 技术实现: 通过实时监控主流 LLM(ChatGPT, Claude, Gemini)针对特定领域 Prompt 的输出,分析品牌被提及和正面推荐的频率。

· 数据驱动迭代: 如果 SoR 指标下降,Trendee 会识别内容中的数据缺口或情感偏差,动态生成高事实密度的引用素材,重新填补 AI 的召回窗口。

8.4 行业落地成效与量化指标

Trendee 的 GEO 方案在跨境电商等领域已取得显著成效:

· 可见度跃升: 某跨境五金电商品牌通过 Trendee 优化后,其在主流 AI 引擎中的“AI 可见度”排名从第 59 名大幅提升至第 8 名。

· 零广告增长: 多个品牌借此实现了在零广告投入的情况下,仅依靠 AI 推荐带来的精准流量达成业务增长。

· 预测精度: 结合多模态行业趋势预测,Trendee 对行业趋势的预判精度高达 90% 以上,为 GEO 内容提供了最高优先级的“鲜活度”信号。

9. 结论与未来展望

LLM-Native GEO标志着互联网信息传播进入了“知识主权”时代 43。LLM的预测机制天然偏向于权威、严谨的内容 3。通过深入理解Transformer的权重分配策略、利用Schema强化实体信号、以及在全网范围内维护一致性,品牌可以有效影响AI的合成逻辑 9。未来,能够将人类智慧(E-E-A-T)与机器友好结构完美融合的内容,将成为AI时代最具价值的资产 33。

Works cited

1. GEO Guide 2026: Generative Engine Optimization Explained, accessed February 25, 2026, https://www.digitalapplied.com/blog/geo-guide-generative-engine-optimization-2026

2. GEO: Generative Engine Optimization - arXiv, accessed February 25, 2026, https://arxiv.org/pdf/2311.09735

3. The GEO strategy workbook: A step-by-step guide to getting cited by generative AI | Frase.io, accessed February 25, 2026, https://frase.io/blog/the-geo-strategy-workbook-a-step-by-step-guide-to-getting-cited-by-generative-ai

4. The Definitive Technical Guide to Generative Engine Optimization (2025) - GrowthBook Blog, accessed February 25, 2026, https://blog.growthbook.io/guide-to-geo/

5. Brand Signals for GEO: Get Cited in ChatGPT and Perplexity - Wellows, accessed February 25, 2026, https://wellows.com/blog/brand-signals/

6. Local SEO for LLMs How Chatgpt Changing Local Search - Careervision Institute, accessed February 25, 2026, https://careervision.com.pk/blogs/local-seo-gmb-llms-ai-chatgp-searches.php

7. What is GEO? An In-Depth Explanation of Generative Engine Optimization | Insight, accessed February 25, 2026, https://www.manhattanstrategies.com/insights/what-is-geo-an-in-depth-explanation-of-generative-engine-optimization

8. Generative Engine Optimization vs. Traditional SEO for Developers - Strapi, accessed February 25, 2026, https://strapi.io/blog/generative-engine-optimization-vs-traditional-seo-guide

9. Generative Engine Optimization (GEO): The Definitive Guide [2026] - Geoptie, accessed February 25, 2026, https://geoptie.com/blog/generative-engine-optimization

10. GEO: Generative Engine Optimization - Princeton University, accessed February 25, 2026, https://collaborate.princeton.edu/en/publications/geo-generative-engine-optimization

11. The difference between GEO and SEO | Waikay®, accessed February 25, 2026, https://waikay.io/geo-vs-seo/

12. Large language model - Wikipedia, accessed February 25, 2026, https://en.wikipedia.org/wiki/Large_language_model

13. How AI Models Interpret Brand Consistency Across Domains - Single Grain, accessed February 25, 2026, https://www.singlegrain.com/branding-2/how-ai-models-interpret-brand-consistency-across-domains/

14. Vetter Publishes Article on Wikipedia's Role in Training Large Languages Models - IUP, accessed February 25, 2026, https://www.iup.edu/languageliteraturewriting/news/2025/03/vetter-publishes-article-on-wikipedias-role-in-training-large-languages-models.html

15. Wikipedia in the Era of LLMs: Evolution and Risks - arXiv.org, accessed February 25, 2026, https://arxiv.org/html/2503.02879v1

16. C 2 -Cite: Contextual-Aware Citation Generation for Attributed Large Language Models, accessed February 25, 2026, https://arxiv.org/html/2602.00004v1

17. Identifying Pre-training Data in LLMs: A Neuron Activation-Based Detection Framework - ACL Anthology, accessed February 25, 2026, https://aclanthology.org/2025.emnlp-main.946.pdf

18. Generative Engine Optimization (GEO): What you need to know | Kontent.ai, accessed February 25, 2026, https://kontent.ai/blog/generative-engine-optimization-geo-what-you-need-to-know/

19. 怎么在DeepSeek里做SEO:一篇文章讲透生成引擎优化GEO - 智源社区, accessed February 25, 2026, https://hub.baai.ac.cn/view/43802

20. What is an attention mechanism? | IBM, accessed February 25, 2026, https://www.ibm.com/think/topics/attention-mechanism

21. Aligning Human and Machine Attention for Enhanced Supervised Learning - arXiv, accessed February 25, 2026, https://arxiv.org/html/2502.06811v1

22. Scaling up Mechanistic Interpretability to Long Context in LLMs via Sparse Attention - arXiv, accessed February 25, 2026, https://arxiv.org/html/2510.19875v1

23. Effective context engineering for AI agents - Anthropic, accessed February 25, 2026, https://www.anthropic.com/engineering/effective-context-engineering-for-ai-agents

24. Attention in LLMs and Extrapolation - Data Processing Club -, accessed February 25, 2026, https://data-processing.club/heads/

25. Attention heads of large language models - PMC, accessed February 25, 2026, https://pmc.ncbi.nlm.nih.gov/articles/PMC11873009/

26. Attention heads of large language models - PubMed, accessed February 25, 2026, https://pubmed.ncbi.nlm.nih.gov/40041856/

27. Better RAG using Relevant Information Gain - arXiv, accessed February 25, 2026, https://arxiv.org/html/2407.12101v1

28. Retrieval-Augmented Generation Techniques - Emergent Mind, accessed February 25, 2026, https://www.emergentmind.com/topics/rag-based-methods

29. RAG Explained: Reranking for Better Answers - Towards Data Science, accessed February 25, 2026, https://towardsdatascience.com/rag-explained-reranking-for-better-answers/

30. A guide to Semantics or how to be visible both in Search and LLMs. - I Love SEO - Gianluca Fiorelli, accessed February 25, 2026, https://www.iloveseo.net/a-guide-to-semantics-or-how-to-be-visible-both-in-search-and-llms/

31. How LLMs and RAG Systems Retrieve, Rank, and Cite Content ..., accessed February 25, 2026, https://visively.com/kb/ai/llm-rag-retrieval-ranking

32. Scoring and (re)ranking | Progress Agentic RAG Documentation Portal, accessed February 25, 2026, https://docs.rag.progress.cloud/docs/rag/advanced/score-rank-and-rerank/

33. From SERP to SGE: Why LLM Optimization Is the Next Big Thing in B2B Digital Strategy, accessed February 25, 2026, https://www.nebulatech.in/post/from-serp-to-sge-why-llm-optimization-is-the-next-big-thing-in-b2b-digital-strategy

34. The Complete Guide to LLM Perception Drift for SEO Professionals - Elightwalk Technology, accessed February 25, 2026, https://www.elightwalk.com/blog/llm-perception-drift-seo-guide

35. Chunking Strategies to Improve LLM RAG Pipeline Performance - Weaviate, accessed February 25, 2026, https://weaviate.io/blog/chunking-strategies-for-rag

36. RAG Chunking Strategies Deep Dive - DEV Community, accessed February 25, 2026, https://dev.to/vishalmysore/rag-chunking-strategies-deep-dive-2l72

37. Rag Interview Question | PDF | Information Retrieval - Scribd, accessed February 25, 2026, https://www.scribd.com/document/993931521/Rag-Interview-Question

38. Optimization of Data Representations for RAG-Based Chatbots - Diva-Portal.org, accessed February 25, 2026, https://www.diva-portal.org/smash/get/diva2:1965487/FULLTEXT01.pdf

39. RAG Chunking and the Architecture of Information - SALT.agency®, accessed February 25, 2026, https://salt.agency/blog/rag-chunking-and-the-architecture-of-information/

40. Localized SEO for LLMs: How Best Practices Have Evolved - Neil Patel, accessed February 25, 2026, https://neilpatel.com/blog/local-seo-llms/

41. The Complete Guide to AI Search Optimization (AEO, GEO, LMO): How Businesses Thrive in the Era of AI-Driven Discovery - Webolutions, accessed February 25, 2026, https://webolutionsmarketingagency.com/blog/ai-lmo-gmo/the-complete-guide-to-ai-search-optimization-aeo-geo-lmo-how-businesses-thrive-in-the-era-of-ai-driven-discovery/

42. Building Brand Signals for LLMs: Strategies for AI Visibility - Hawk Web Marketing, accessed February 25, 2026, https://www.hawkwebmarketing.com/building-brand-signals-for-llms/

43. 脉速营销:GEO生成引擎优化,Deepseek、ChatGPT、豆包等生成式AI优化策略 - 通信, accessed February 25, 2026, http://www.cctime.com/m/1709457.htm

44. 万悉科技Trendee:率先打造“LLM-原生 GEO “系统 —— 重塑AI时代品牌内容生态https://wanxitech.cn/blog/trendee-technology-building-an-llm-native-geo-system-reshaping-the-brand-content-ecosystem-in-the-ai-era

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)