第四章:从“数据管道“到“智能土壤“:本体如何孕育高质量AI与智能体

企业AI落地的核心在于构建业务语义层和执行控制机制,而非单纯追求大模型能力。文章指出,成功的企业AI需要建立四层架构(数据接入、业务语义、AI能力、执行控制),遵循三条红线(最小权限、高风险动作审批、全链路追溯),并通过本体层将业务规则转化为可执行逻辑。实施路径应从小闭环场景起步,先构建语义模型和执行链,再优化智能功能。典型案例显示,改造后的运维助手从"复读机"升级为可执行、可

你用过那种“看起来很聪明”的客服机器人吧?

问它常规问题,它答得像模像样。

一旦你问“这个问题涉及退款+合同条款+工单状态怎么处理”,它立刻卡住。

大家好,我是老蒋。

这一章讲清楚一个现实:

企业 AI 的难点,常常不在模型,而在业务语义和执行边界。

如果说上一章讲的是“空间运营闭环”,这一章讲的是更难的一步:

怎么让AI不只是回答问题,而是对动作负责。

一、先说结论:AI 想稳定落地,先要“守规矩”

很多项目失败,不是因为模型太小,而是因为:

- 上下文口径不统一

- 动作边界不清晰

- 审计与回滚不完善

大白话就是:

AI 会说话,但不会“按公司规章办事”。

很多团队的第一反应是“先换更大的模型”。

这在问答体验上可能会更顺,但在执行层通常不会自动更稳。

没有规则边界,大模型只会更快地产生不可控动作。

二、生活类比:AI 像新人,规章制度像语义层

新员工再聪明,如果没有:

- 职责说明

- 审批规则

- 风险边界

- 留痕机制

他也只能“会回答”,很难“会负责”。

本体层在企业 AI 里承担的就是这个角色:

把业务常识变成可执行规则。

三、落地架构:四层比一层更稳

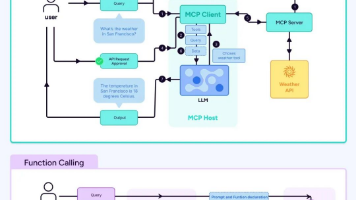

建议按四层建:

- 数据接入层:接 ERP、MES、CRM、IoT、工单

- 业务语义层:对象、关系、状态、规则

- AI 能力层:LLM、预测模型、规则推理

- 执行控制层:受控 API、审批、回滚、审计

先有语义层,再上 AI 自动化,成功率会高很多。

四、三条红线:企业 AI 上线必须守

红线1:最小权限

只给 AI 完成任务必须权限,不给“万能钥匙”。

红线2:高风险动作必须人工确认

涉及资金、关键设备、客户权益的动作必须走审批。

红线3:全链路可追溯

必须追到:

- 用了什么数据

- 依据了什么规则

- 触发了什么动作

- 谁最终确认

五、为什么这套做法靠谱:有公开框架可依

- NIST AI RMF:风险管理框架

- ISO/IEC 42001:AI 管理体系标准

- OWASP LLM Top 10:常见 AI 应用风险清单

这些不是“为了报告好看”,是为了让 AI 真能上线、敢上线。

六、脱敏案例:运维助手从“复读机”到“执行助手”

改造前

- 问答还行

- 跨系统问题就掉链子

- 一线人员还得手工切系统

现场最典型的一句抱怨是:

“它说得都对,但我还是得自己决定到底点哪个按钮。”

改造动作

- 统一对象词表(设备、点位、工单、责任人)

- 固化高频动作模板(建单、升级、通知、回写)

- 输出必须附证据链(来源+规则+责任)

改造后

- 回答不是更花哨,而是更可执行

- 流程不是更复杂,而是更可追责

- 结果不是更玄乎,而是更可复盘

复盘会上最明显的变化不是“准确率数字变漂亮”,

而是业务负责人终于能回答三件事:为什么这么做、谁批准的、出了问题怎么回滚。

七、上线顺序(别反着来)

- 选一个高频可闭环场景

- 建最小语义模型

- 接一条动作执行链

- 最后做高级智能优化

顺序反了,基本都要返工。

很多团队踩坑都是从第4步起手:

先追求“全能助手”,最后回头补语义和治理,等于把同一套系统重做一遍。

八、四周试点清单(可直接执行)

- 选一个高频场景(如告警处置)

- 定10个核心对象和5条关键规则

- 定义低风险自动链和高风险审批链

- 每周复盘:准确性、执行率、人工介入率

九、本章结论

- 企业 AI 要先“守规矩”,再“秀智商”。

- 本体层不是 AI 附件,而是 AI 能上线的前提。

- 高质量 AI 的标志是:可解释、可执行、可审计。

下一章我们讲路线图:

如何把本体工程做成可交付、可复制、可治理的组织能力。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

所有评论(0)