【Kafka进阶篇】Spring Boot Kafka客户端踩坑记:自定义序列化器+ContainerFactory调优指南

本文介绍基于Java21和Spring Boot的Kafka高级客户端定制方案,针对生产环境中常见的序列化乱码、消费卡顿、并发能力不足等问题提供解决方案。内容包括环境搭建、ConcurrentKafkaListenerContainerFactory调优、自定义序列化器实现和多线程并发消费优化。通过详细代码示例,帮助开发者实现高效稳定的Kafka客户端,适用于高并发场景下的消息处理。文章提供实战配

引言

作为Java后端开发者,Spring Boot整合Kafka实现消息收发早已是必备技能,但大多数人只停留在“能用上”的层面——序列化乱码、消费卡顿、并发能力不足等问题频发,尤其是基于Java21的新环境下,高级客户端的定制更是难倒不少人。本文聚焦Kafka高级客户端开发,从ContainerFactory调优、自定义序列化器到多线程并发消费,手把手教你落地生产级实战方案,建议收藏备用!

文章目录

一、前言:为什么要做Kafka高级客户端定制?

日常开发中,我们用Spring Boot整合Kafka时,大多直接使用默认配置,快速实现消息的生产和消费。但在真实的工程场景中,默认配置往往无法满足需求:

- 消息体是自定义实体类,默认序列化器会导致乱码或无法反序列化;

- 高并发场景下,单线程消费无法及时处理消息,出现消息堆积;

- 不同业务场景需要不同的消费策略,默认的监听容器无法灵活适配;

- Java21环境下,部分旧版本客户端配置存在兼容性问题,需要针对性调优。

今天,我们就基于Java21和Spring Boot,一步步实现Kafka高级客户端的定制,解决上述痛点,让Kafka客户端既稳定又高效 ✨。

温馨提示:本文涉及大量实战代码,建议点赞+收藏,后续开发遇到问题可直接查阅!

二、环境准备:Java21+Spring Boot+Kafka环境搭建

在开始高级定制前,先确保我们的基础环境搭建完成,避免因环境问题影响实战效果。

2.1 核心依赖导入

新建Spring Boot项目,在pom.xml中导入以下核心依赖(适配Java21,选用最新稳定版本):

<!-- Spring Boot Kafka Starter -->

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

</dependency>

<!-- Lombok 简化实体类开发 -->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<optional>true</optional>

</dependency>

<!-- 测试依赖 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka-test</artifactId>

<scope>test</scope>

</dependency>

2.2 基础配置(application.yml)

配置Kafka的连接信息、默认序列化方式(后续会自定义替换),注意适配Java21的环境参数:

spring:

kafka:

# Kafka集群地址(单机版直接写localhost:9092)

bootstrap-servers: 127.0.0.1:9092

# 生产者配置

producer:

# 重试次数

retries: 3

# 批量发送大小(16KB)

batch-size: 16384

# 缓冲区大小(32MB)

buffer-memory: 33554432

# 默认序列化器(后续自定义替换)

key-serializer: org.apache.kafka.common.serialization.StringSerializer

value-serializer: org.apache.kafka.common.serialization.StringSerializer

# 消费者配置

consumer:

# 消费者组ID(自定义,同一组内消费者分摊消费)

group-id: kafka-demo-group

# 自动提交偏移量(默认true,后续可根据需求调整)

enable-auto-commit: true

# 自动提交偏移量的间隔时间

auto-commit-interval: 1000

# 默认反序列化器

key-deserializer: org.apache.kafka.common.serialization.StringDeserializer

value-deserializer: org.apache.kafka.common.serialization.StringDeserializer

# 偏移量重置策略(noearliest=从头开始消费,latest=消费最新消息)

auto-offset-reset: earliest

环境搭建完成后,我们可以先写一个简单的生产者和消费者测试,确保Kafka能正常收发消息,再进入高级定制环节。

三、核心实战一:ConcurrentKafkaListenerContainerFactory调优

ConcurrentKafkaListenerContainerFactory 是Spring Kafka提供的核心监听容器工厂,负责创建Kafka消费者监听容器,其配置直接影响消费性能和稳定性,也是高级客户端定制的重点。

3.1 为什么需要调优?

默认情况下,ConcurrentKafkaListenerContainerFactory 的配置较为保守:

- 并发消费线程数为1,无法应对高并发消息场景;

- 消息批量消费未开启,单条消费效率低;

- 无异常重试机制,消息消费失败直接丢失;

- 偏移量提交策略不够灵活,易出现重复消费或消息丢失。

3.2 实战调优配置(核心代码)

创建Kafka配置类,自定义 ConcurrentKafkaListenerContainerFactory,结合Java21特性进行调优:

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

import org.springframework.kafka.config.ConcurrentKafkaListenerContainerFactory;

import org.springframework.kafka.core.ConsumerFactory;

import org.springframework.kafka.listener.ContainerProperties;

import org.springframework.kafka.listener.SeekToCurrentErrorHandler;

import org.springframework.util.backoff.FixedBackOff;

@Configuration

public class KafkaConfig {

/**

* 自定义ConcurrentKafkaListenerContainerFactory,实现高级调优

*/

@Bean

public ConcurrentKafkaListenerContainerFactory<String, Object> kafkaListenerContainerFactory(

ConsumerFactory<String, Object> consumerFactory) {

ConcurrentKafkaListenerContainerFactory<String, Object> factory = new ConcurrentKafkaListenerContainerFactory<>();

// 绑定消费者工厂

factory.setConsumerFactory(consumerFactory);

// 1. 并发消费配置:设置并发线程数(建议小于等于Topic的分区数)

factory.setConcurrency(3);

// 2. 批量消费配置(开启后,监听方法可接收List类型消息)

factory.setBatchListener(true);

// 批量消费每次拉取的消息数量

factory.getContainerProperties().setBatchErrorHandler(new BatchLoggingErrorHandler());

factory.getContainerProperties().setPollTimeout(3000); // 拉取超时时间

// 3. 偏移量提交策略(手动提交,更灵活,避免重复消费/丢失)

factory.getContainerProperties().setAckMode(ContainerProperties.AckMode.MANUAL_IMMEDIATE);

// 4. 异常重试机制:消费失败后重试,重试3次,每次间隔1秒

SeekToCurrentErrorHandler errorHandler = new SeekToCurrentErrorHandler(

new FixedBackOff(1000L, 3)

);

factory.setErrorHandler(errorHandler);

// 5. Java21特性:开启虚拟线程(可选,提升并发性能)

factory.getContainerProperties().setVirtualThreads(true);

return factory;

}

}

3.3 关键调优参数说明(重点记)

| 调优参数 | 作用 | 推荐配置 |

|---|---|---|

| concurrency | 设置并发消费线程数 | 小于等于Topic的分区数(分区数决定最大并发数) |

| batchListener | 是否开启批量消费 | 高并发场景开启(true),提升消费效率 |

| pollTimeout | 消息拉取超时时间 | 3000-5000ms(避免频繁拉取消耗资源) |

| AckMode | 偏移量提交模式 | 手动提交(MANUAL_IMMEDIATE),避免重复消费 |

| errorHandler | 异常重试处理器 | FixedBackOff(重试间隔1s,重试3次) |

| virtualThreads | 是否开启虚拟线程 | Java21环境可开启(true),降低线程开销 |

这里提醒一句:并发线程数不能超过Topic的分区数,否则多余的线程会处于空闲状态,浪费资源哦 😜。

四、核心实战二:自定义序列化器/反序列化器

Kafka默认的序列化器(StringSerializer、ByteArraySerializer)只能处理字符串、字节数组类型的消息。但实际开发中,我们经常需要发送自定义实体类(如User、Order),此时就需要自定义序列化器/反序列化器,解决实体类消息的序列化问题。

4.1 痛点场景

如果直接发送实体类消息,不使用自定义序列化器,会出现以下报错:

org.apache.kafka.common.errors.SerializationException: Can't serialize data [User(id=1, name="予枫")] for topic: test-topic

原因:Kafka不知道如何将实体类转换为字节数组(序列化),也不知道如何将字节数组转换为实体类(反序列化)。

4.2 实战实现(JSON格式序列化,最常用)

我们使用Jackson工具类,实现实体类的JSON序列化/反序列化,步骤如下:

4.2.1 导入Jackson依赖

<dependency>

<groupId>com.fasterxml.jackson.core</groupId>

<artifactId>jackson-databind</artifactId>

</dependency>

4.2.2 自定义序列化器(Serializer)

import com.fasterxml.jackson.databind.ObjectMapper;

import org.apache.kafka.common.serialization.Serializer;

import java.util.Map;

/**

* 自定义Kafka序列化器:将实体类序列化为JSON字节数组

* @param <T> 实体类泛型

*/

public class CustomKafkaSerializer<T> implements Serializer<T> {

private final ObjectMapper objectMapper = new ObjectMapper();

@Override

public void configure(Map<String, ?> configs, boolean isKey) {

// 初始化配置(可选,如设置JSON序列化格式)

}

/**

* 序列化核心方法:将实体类转换为字节数组

*/

@Override

public byte[] serialize(String topic, T data) {

if (data == null) {

return null;

}

try {

// 将实体类转换为JSON字节数组

return objectMapper.writeValueAsBytes(data);

} catch (Exception e) {

throw new RuntimeException("Kafka序列化失败:" + e.getMessage(), e);

}

}

@Override

public void close() {

// 关闭资源(可选)

}

}

4.2.3 自定义反序列化器(Deserializer)

import com.fasterxml.jackson.databind.ObjectMapper;

import org.apache.kafka.common.serialization.Deserializer;

import java.util.Map;

/**

* 自定义Kafka反序列化器:将JSON字节数组反序列化为实体类

* @param <T> 实体类泛型

*/

public class CustomKafkaDeserializer<T> implements Deserializer<T> {

private final ObjectMapper objectMapper = new ObjectMapper();

private Class<T> targetClass;

/**

* 初始化:获取目标实体类的Class对象

*/

@Override

public void configure(Map<String, ?> configs, boolean isKey) {

// 从配置中获取目标实体类的全路径名,反射获取Class对象

String targetClassName = (String) configs.get("target.class.name");

try {

this.targetClass = (Class<T>) Class.forName(targetClassName);

} catch (ClassNotFoundException e) {

throw new RuntimeException("Kafka反序列化器初始化失败:找不到目标类", e);

}

}

/**

* 反序列化核心方法:将字节数组转换为实体类

*/

@Override

public T deserialize(String topic, byte[] data) {

if (data == null) {

return null;

}

try {

// 将JSON字节数组转换为实体类

return objectMapper.readValue(data, targetClass);

} catch (Exception e) {

throw new RuntimeException("Kafka反序列化失败:" + e.getMessage(), e);

}

}

@Override

public void close() {

// 关闭资源(可选)

}

}

4.2.4 配置自定义序列化器/反序列化器

修改application.yml,替换默认的序列化器/反序列化器,指定目标实体类路径:

spring:

kafka:

producer:

# 替换为自定义序列化器

key-serializer: org.apache.kafka.common.serialization.StringSerializer

value-serializer: com.yufeng.kafka.CustomKafkaSerializer

consumer:

# 替换为自定义反序列化器

key-deserializer: org.apache.kafka.common.serialization.StringDeserializer

value-deserializer: com.yufeng.kafka.CustomKafkaDeserializer

# 配置反序列化器的目标实体类(替换为你的实体类全路径)

properties:

target.class.name: com.yufeng.kafka.entity.User

4.2.5 测试验证

- 定义实体类User:

import lombok.Data;

@Data

public class User {

private Integer id;

private String name;

private Integer age;

}

- 编写生产者,发送User实体类消息:

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.kafka.core.KafkaTemplate;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.PathVariable;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class KafkaProducerController {

@Autowired

private KafkaTemplate<String, Object> kafkaTemplate;

// 测试发送实体类消息

@GetMapping("/send/user/{id}/{name}/{age}")

public String sendUserMessage(@PathVariable Integer id,

@PathVariable String name,

@PathVariable Integer age) {

User user = new User();

user.setId(id);

user.setName(name);

user.setAge(age);

// 发送消息到test-topic

kafkaTemplate.send("test-topic", user);

return "消息发送成功:" + user;

}

}

- 编写消费者,接收User实体类消息:

import org.springframework.kafka.annotation.KafkaListener;

import org.springframework.kafka.support.Acknowledgment;

import org.springframework.stereotype.Component;

import com.yufeng.kafka.entity.User;

@Component

public class KafkaConsumer {

// 监听test-topic,使用自定义的容器工厂

@KafkaListener(topics = "test-topic", containerFactory = "kafkaListenerContainerFactory")

public void consumeUserMessage(User user, Acknowledgment acknowledgment) {

// 处理消息

System.out.println("接收并处理User消息:" + user);

// 手动提交偏移量(对应AckMode=MANUAL_IMMEDIATE)

acknowledgment.acknowledge();

}

}

启动项目,访问接口 http://localhost:8080/send/user/1/予枫/25,如果控制台能正常打印User消息,说明自定义序列化器/反序列化器配置成功 ✅。

五、核心实战三:多线程并发消费模型设计

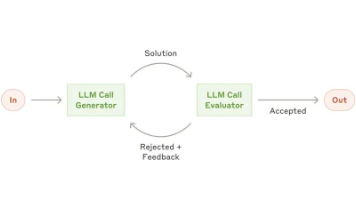

在高并发场景下,单线程消费无法及时处理大量消息,会导致消息堆积。结合前面 ConcurrentKafkaListenerContainerFactory 的并发配置,我们设计一套可落地的多线程并发消费模型,提升消费效率。

5.1 并发消费核心原理

Kafka的并发消费能力由 Topic分区数 和 监听容器并发线程数 共同决定:

- 分区数是并发消费的上限(比如Topic有3个分区,最多只能有3个线程同时消费);

- 并发线程数由

factory.setConcurrency(3)配置,建议与分区数保持一致。

5.2 实战模型设计(两种常用场景)

场景1:单一Topic,多线程分摊消费

适用于单一业务场景,一个Topic对应多个分区,多个线程分摊消费,示例代码如下(复用前面的消费者配置):

// 并发消费单一Topic,3个线程分摊消费(对应3个分区)

@KafkaListener(topics = "test-topic", containerFactory = "kafkaListenerContainerFactory", groupId = "kafka-demo-group")

public void consumeConcurrentMessage(User user, Acknowledgment acknowledgment) {

// 打印当前消费线程,验证并发效果

String threadName = Thread.currentThread().getName();

System.out.println("线程[" + threadName + "] 接收并处理User消息:" + user);

// 手动提交偏移量

acknowledgment.acknowledge();

}

启动项目,发送多条消息,控制台会打印不同的线程名称,说明多线程并发消费生效。

场景2:多Topic,指定线程消费

适用于多业务场景,不同Topic的消息由指定数量的线程消费,避免业务干扰:

// 场景2:多Topic并发消费,不同Topic指定不同线程数

// Topic1:用户消息,2个线程消费

@KafkaListener(topics = "user-topic", containerFactory = "kafkaListenerContainerFactory", groupId = "user-group")

public void consumeUserTopic(User user, Acknowledgment acknowledgment) {

String threadName = Thread.currentThread().getName();

System.out.println("用户线程[" + threadName + "] 处理消息:" + user);

acknowledgment.acknowledge();

}

// Topic2:订单消息,3个线程消费

@KafkaListener(topics = "order-topic", containerFactory = "kafkaListenerContainerFactory", groupId = "order-group")

public void consumeOrderTopic(Order order, Acknowledgment acknowledgment) {

String threadName = Thread.currentThread().getName();

System.out.println("订单线程[" + threadName + "] 处理消息:" + order);

acknowledgment.acknowledge();

}

注意:不同Topic可以配置不同的消费者组(groupId),避免消费干扰;同时调整 ConcurrentKafkaListenerContainerFactory 的并发数,适配不同Topic的消费需求。

5.3 并发消费避坑点

- 并发线程数不能超过Topic分区数,否则多余线程空闲;

- 批量消费开启后,监听方法参数需改为List(如List),避免序列化失败;

- 手动提交偏移量时,需确保消息处理完成后再提交,避免消息丢失;

- 多线程消费时,避免共享资源,如需共享,需做好线程安全控制(如使用ConcurrentHashMap)。

六、全文总结

本文基于Java21和Spring Boot,围绕Kafka高级客户端定制展开实战,核心内容总结如下:

- 环境搭建:完成Java21+Spring Boot+Kafka的基础配置,确保消息正常收发;

- ContainerFactory调优:通过并发线程数、批量消费、异常重试、偏移量提交等配置,提升消费性能和稳定性;

- 自定义序列化器/反序列化器:解决实体类消息的序列化问题,适配实际开发场景;

- 多线程并发消费:基于Topic分区数设计并发模型,解决高并发场景下的消息堆积问题。

通过本文的实战配置,你可以直接将代码复用至生产环境,解决Kafka客户端开发中的常见痛点。当然,实际生产环境中,还需要结合业务场景进一步优化参数,比如消息重试机制、死信队列配置等,后续我会持续更新相关内容。

作者:予枫(CSDN技术博主)

声明:本文为原创实战博客,禁止抄袭、搬运,转载请注明出处!

如果本文对你有帮助,欢迎点赞+收藏+关注,后续会更新更多Java、Kafka实战干货~

评论区留言你遇到的Kafka客户端问题,我会逐一回复解答!

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)