众智FlagOS实现千问Qwen3.5 397B MoE模型多芯版统一发布,下载可用

依托面向多种AI芯片的统一开源系统软件栈众智FlagOS的跨芯能力,众智FlagOS社区在Qwen3.5模型发布后,即完成了397B MoE多模态模型的全量适配、精度对齐、及多芯片迁移,实现Qwen3.5在多款芯片的同步适配上线。

2026年2月16日,农历除夕之夜,阿里云悄然发布了全新旗舰大模型——Qwen3.5(Qwen3.5-397B-A17B)。作为Qwen3.5系列的第一个大模型,Qwen3.5-397B-A17B是一个具有3970亿全量参数及170亿激活参数的原生Vision-Language MoE大模型,在通用能力、代码生成、长上下文理解、Agent推理、工具调用、多模态理解等核心场景实现全面跃升,成为当前开源社区综合能力最强的多模态大模型。

本次通义千问发布的Qwen3.5-397B开源模型是迄今参数量最大的开源多模态MoE模型,对跨芯适配、多机部署、精度对齐都带来新的系统挑战。依托面向多种AI芯片的统一开源系统软件栈众智FlagOS的跨芯能力,众智FlagOS社区在Qwen3.5模型发布后,即完成了397B MoE多模态模型的全量适配、精度对齐、及多芯片迁移,实现Qwen3.5在沐曦、平头哥真武、英伟达三种芯片的同步适配上线。

开发者速用指南:Qwen3.5新模型多芯版本一键获取 + 部署

FlagOS为Qwen3.5新模型提供了统一支持多种AI芯片的vLLM多芯片插件(vLLM-plugin-FL)适配版本,在保证高效推理的同时,统一支持多种芯片,为用户提供开箱即用的跨芯片Qwen3.5版本。目前在vLLM-plugin-FL的支持下,沐曦、平头哥真武等多种芯片已经实现统一接入,完成Qwen3.5 397B MoE旗舰模型的原生BF16版本的双机16卡推理部署,及充分验证。

使用源码进行安装部署,可参考以下官方一站式开发者文档,含详细代码示例与操作指引。

GitHub:https://github.com/flagos-ai/vllm-plugin-FL/blob/main/README.md

GitCode:https://gitcode.com/flagos-ai/vllm-plugin-FL/blob/main/README.md

用户也可以直接拉取魔搭、HuggingFace等开源AI社区上FlagRelease组织账号发布的迁移版Qwen3.5-FlagOS模型文件、代码、和镜像。以下是迁移适配后的几种AI芯片的模型版本,开箱即用、无需迁移。

HuggingFace平台

-

沐曦版

https://huggingface.co/FlagRelease/Qwen3.5-397B-A17B-metax-FlagOS -

平头哥真武版

https://huggingface.co/FlagRelease/Qwen3.5-397B-A17B-zhenwu-FlagOS

-

NVIDIA版

https://huggingface.co/FlagRelease/Qwen3.5-397B-A17B-nvidia-FlagOS

魔搭平台

-

沐曦版

https://modelscope.cn/models/FlagRelease/Qwen3.5-397B-A17B-metax-FlagOS

-

平头哥真武版

https://modelscope.cn/models/FlagRelease/Qwen3.5-397B-A17B-zhenwu-FlagOS

-

NVIDIA版

https://modelscope.cn/models/FlagRelease/Qwen3.5-397B-A17B-nvidia-FlagOS

开发者极致体验:“发布即多芯” + “零改码”

Qwen3.5新模型的跨芯适配版本从开发到部署,全程围绕开发者友好设计,解决了大模型落地过程中选芯难、适配繁、性能低、精度损四大核心痛点,让开发者真正实现 “一次开发,多芯运行”。

零改码适配:不改变原有开发与调用习惯

无论是模型原有接口、vLLM推理引擎使用逻辑,还是开发者的日常调用代码,均无需做任何修改,FlagOS通过底层插件与算子替换实现适配,开发者专注业务开发即可,无需重新学习硬件相关开发知识,大幅降低迁移与部署门槛。

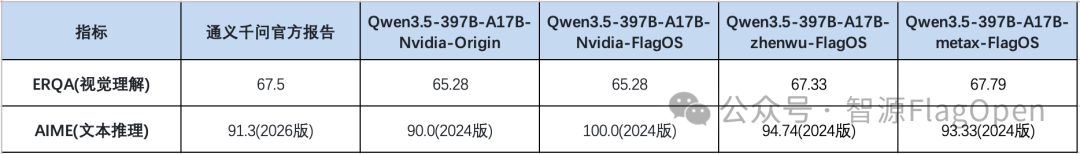

精度零损失:核心能力与原生版本完全对齐

经ERQA、AIME等公认权威评测集全维度验证,FlagOS适配后的Qwen3.5新模型,在视觉语言理解、空间理解、语言理解、复杂推理等核心能力上,与CUDA原生版本得分基本一致,可放心应用于金融、教育、政企服务、代码开发等高精度要求场景,无需担心适配导致业务效果折损。

注:Qwen官方评测使用的AIME数据集是2026版,FlagOS版Qwen3.5新模型在Nvidia、MetaX和ZhenWu芯片硬件的评测使用2024版AIME数据集

极简部署:开箱即用,底层优化无感知

FlagOS将核心算子库、编译器等技术组件提前内置到Qwen3.5新模型代码框架中,开发者加载官方模型时,底层优化代码自动生效,无需手动添加任何FlagOS初始化代码。同时,基于FlagOS的大模型跨芯半自动迁移及发版工具FlagRelease,直接提供了多芯版Qwen3.5-FlagOS模型版本,无需用户迁移,真正实现 “开箱即用”;同时标准化Docker镜像 + 一键加速命令,解决了开发者最头疼的环境配置、效果对齐、性能优化等问题。

大模型核心基座:FlagOS四大技术支撑,实现Qwen3.5极速跨芯适配

Qwen3.5新模型能实现 “发布即多芯适配”,并非偶然。其背后依托众智FlagOS打造的统一多芯片AI系统软件栈,从算子层、编译层、框架层到工具层,全链路为大模型跨芯适配提供技术支撑,将原本数周的适配周期缩短至数天,真正实现极速落地。

-

统一多芯片接入插件 vLLM-plugin-FL:无缝兼容原生使用习惯

vLLM-plugin-FL是FlagOS为vLLM推理服务框架打造的专属插件,基于FlagOS统一多芯片后端开发,在完全不改变vLLM原生接口与用户使用习惯的前提下,丝滑实现Qwen3.5全系列模型的多芯片推理部署。目前vLLM-plugin-FL已经支持了华为昇腾、沐曦、平头哥真武、天数智芯、清微智能、英伟达等六家芯片。

-

高性能算子库 FlagGems:全量覆盖 + 专项优化,释放硬件算力

FlagGems作为FlagOS核心的高性能通用大模型算子库,基于Triton语言实现,全量覆盖Qwen3.5系列模型的PyTorch Aten算子,针对Qwen3.5的MoE专家调度、Attention计算、RMSNorm等核心计算模块做了手搓级专项优化,同时原生支持 NVIDIA、华为昇腾、沐曦、清微智能、天数等接近20家AI芯片。

-

统一AI编译器FlagTree:一次编写,多芯编译

FlagTree是FlagOS面向多AI芯片后端的统一编译器,基于Triton深度定制,可将Qwen3.5全系列模型的核心算子,编译为NVIDIA、华为昇腾、沐曦、清微智能、平头哥等十多种不同AI芯片后端可识别的指令,彻底解决不同芯片编译器生态割裂的问题,大幅降低算子跨芯片适配的开发成本。

-

大模型跨芯迁移发布工具FlagRelease:半自动实现模型跨芯迁移与版本发布

依托FlagOS全栈技术能力,FlagRelease平台已完成本次Qwen3.5开源的397B MoE旗舰模型的多芯片版本适配迁移、评测验证、自动打包与版本发布,覆盖 HuggingFace、ModelScope等主流开源社区,开发者无需关注底层硬件适配细节,即可一键拉取对应芯片平台的Qwen3.5优化镜像,实现开箱即用的部署体验。截至发布当日,FlagRelease已完成了数十个开源主流基座大模型在10多种不同 AI 硬件的适配迁移,是国内唯一的大模型跨芯片迁移适配及版本发布平台。

开源共建:众智FlagOS持续做开发者的 “跨芯适配技术后盾”

当下,“异构算力协同、大模型普惠落地” 已成为全球开源开发者社区的核心热点,打破硬件生态隔离、让大模型在不同算力平台高效低成本运行,是无数开发者的核心诉求。FlagOS从诞生之初就将开源开放、众智共建刻入技术基因,始终以开发者为中心,通过全栈开源的统一系统软件栈,把复杂的 “M×N” 硬件适配问题降维为 “M+N”,做每一位开发者最可靠的跨芯适配后盾。

全栈开源无保留,把技术主动权交给开发者

目前,FlagOS已形成完整的开源技术体系,所有核心组件均已开源在Github,同时开放了数十款最新的主流基础大模型、十多款AI芯片的适配方案与最佳实践,开发者可自由获取、深度定制。

-

四大核心技术库:FlagGems通用大模型算子库、FlagTree统一 AI 编译器、FlagScale训练推理并行框架、FlagCX统一通信库,覆盖算子开发、编译优化、并行计算、跨芯片通信全链路;

-

三大开源工具平台:FlagRelease大模型自动迁移发版平台、KernelGen算子自动生成工具、FlagPerf多芯片评测工具、提供从模型适配、性能评测到工程落地的一站式工具链;

-

全场景使能生态:vLLM-plugin-FL、Megatron-LM-FL、TransformerEngine-FL等框架增强组件,以及 FlagOS-Robo具身智能工具包,覆盖大模型训练、推理、应用全场景。

多路径参与共建,全层级开发者均可入局

我们为不同技术方向、不同经验层级的开发者,设计了低门槛、多路径的共建方式,无论你是 AI 开发新手,还是深耕系统软件的资深专家,都能在FlagOS社区找到自己的位置。

-

新手友好型参与:可在对应仓库提交 Issue反馈bug、优化建议,或是补充完善文档、撰写入门教程与最佳实践,也可参与社区技术交流、分享使用经验,零门槛开启开源之旅;(社区文档参考:https://docs.flagos.io/en/latest/)

-

深度技术共建:可参与FlagGems算子开发、FlagTree编译器优化、FlagScale框架迭代等核心代码贡献,也可为更多开源大模型、AI芯片完成适配优化,或是开发垂直场景解决方案,拓展FlagOS的技术与应用边界。

赛事与科研合作,释放你的技术创造力

我们为技术开发者搭建了全方位的能力学习与成长平台,欢迎开发者通过赛事、科研合作,一起探索 AI 系统软件的前沿技术,挑战技术极限。

-

FlagOS 开放计算全球挑战赛:众智FlagOS社区联合北京智源人工智能研究院,开启总奖金池200万元的FlagOS开放计算全球挑战赛,设置算子开发、推理优化、自动数据标注三大核心赛道,无论你想挑战技术极限,还是赢取丰厚奖金,都能在这里大展身手。赛事官网参见:https://flagos.io/RaceDetail?id=295v67vw&lang=cn

-

产学研深度合作:我们与清华大学、北京大学、中科院计算所等顶尖高校院所建立深度合作,欢迎高校实验室、科研团队与我们联合开展技术研究、人才培养,共同推动AI系统软件领域的技术创新。

众智FlagOS的每一次技术突破,都离不开全球开发者的参与贡献,我们诚挚邀请每一位开发者加入,并承诺为所有参与共建的开发者提供全程技术支持、完整学习资源。一起推动AI芯片生态互联互通,让大模型技术在更广泛的算力环境中实现普惠落地!

-----------------------------------------------------------

关于众智FlagOS社区

为解决不同 AI 芯片大规模落地应用,北京智源研究院联合众多科研机构、芯片企业、系统厂商、算法和软件相关单位等国内外机构共同发起并创立了众智 FlagOS 社区。成员单位包括北京智源研究院、中科院计算所、中科加禾、安谋科技、北京大学、北京师范大学、百度飞桨、硅基流动、寒武纪、海光信息、华为、基流科技、摩尔线程、沐曦科技、澎峰科技、清微智能、天数智芯、先进编译实验室、移动研究院、中国矿业大学(北京)等多家在 FlagOS 软件栈研发中做出卓越贡献的单位。

FlagOS 是一款专为异构 AI 芯片打造的开源、统一系统软件栈,支持 AI 模型一次开发即可无缝移植至各类硬件平台,大幅降低迁移与适配成本。它包括大型算子库、统一AI编译器、并行训推框架、统一通信库等核心开源项目,致力于构建「模型-系统-芯片」三层贯通的开放技术生态,通过“一次开发跨芯迁移”释放硬件计算潜力,打破不同芯片软件栈之间生态隔离。

官网:https://flagos.io

GitHub 项目地址:https://github.com/flagos-ai

GitCode 项目地址:https://gitcode.com/flagos-ai

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)