“黑进”心脏:当创意技术遇上情感数字智能,我们到底在改造什么?

黑进心脏”这个说法很刺激,它既可以指技术入侵,也可以指创造性地拆解与重建。情感数字智能站在一个很危险也很可能伟大的交界处:它可能带来更好的心理支持、更细腻的创作工具、更民主的文化表达;也可能带来更隐蔽的操控、更深的依赖、更廉价的同情模拟。当AI越来越擅长“让你感觉被理解”,你如何确认自己仍然拥有对自己情绪的解释权?

看完 《Hacking The Heart: Creative Technologist on Emotional Digital Intelligence》 这类主题的视频,我最强烈的感受不是“AI又进化了”,而是一个更具体、也更让人不安的问题:当我们把情绪、同理心、脆弱、羞耻、渴望这些最“人”的东西,交给数字系统去识别、反馈、乃至引导时,我们是在让机器更像人,还是在让人更像机器?

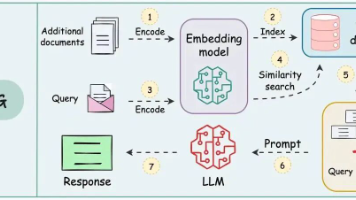

视频里谈到的关键词是“情感数字智能”(Emotional Digital Intelligence):它不是传统意义上的情绪识别小功能(比如识别你笑没笑、皱没皱眉),而更像一种面向人的整体能力——通过算法、交互、创意实践,让技术能在更细腻的层面“读懂”人的状态,并对人的情感连接与创造力产生影响。

这篇文章我想用博客的方式,把视频摘要中的几个线索串起来:情感智能与AI的结合、创意技术专家的实验、时尚与物理/数字世界融合、AI对初级开发岗位的冲击、学位与知识的关系、以及那个很抓人的艺术品数字重建与“虚拟盗窃”项目。它们看起来分散,但其实指向同一个核心:未来的技术竞争,不只在算力和模型,而在“人”——人在系统里如何被理解、被塑造、被组织。

1. 为什么“情感智能”可能比“逻辑智能”更重要?

我们很容易用考试和工作来理解智力:逻辑推理、记忆、运算、规划。AI在这些方面持续变强,于是很多讨论会滑向“人被替代”。

但视频抛出的观点是:情感智能在生活中可能比逻辑智能更重要。这句话看似鸡汤,其实很硬核——因为现实里最难的问题往往不是“怎么做”,而是“为什么做”“还能不能做下去”“和谁一起做”“做的时候我是什么状态”。这些问题,本质上是情绪、关系、意义感的问题。

你可以把情感智能理解为三层能力:

- 识别:我现在到底在感受什么?是焦虑、羞耻、愤怒,还是疲惫与空虚混在一起?

- 调节:我如何让自己从情绪里走出来,不被拖着跑?

- 连接:我如何和别人建立信任,让对话不只是交换信息,而是交换理解?

AI一旦进入这个领域,事情就不再是“工具效率提升”。它开始触及人的内部结构:我们如何解释自己的感受,我们如何被回应,我们如何形成习惯与自我叙事。

2. “情感数字智能”不是读心术,而是交互设计的新战场

视频强调个体与AI互动会带来独特视角和创造力。这句话很关键:情感数字智能不是单向的“机器理解人”,而是双向的“人—机共同建构体验”。

也就是说,所谓“更懂你”的AI,并不只来自模型训练得更好,还来自:

- 你愿意透露多少(表达、语音、行为、文本、停顿、选择)

- 系统如何回应你(语气、节奏、建议方式、是否留白、是否追问)

- 系统如何塑造你(它奖励什么、惩罚什么、让你对什么上瘾、让你怎样表达更“有效”)

所以“情感数字智能”的落点更像是:把心理学、叙事、交互、艺术表达、伦理边界,和AI能力一起打包,形成一种新的体验工程。

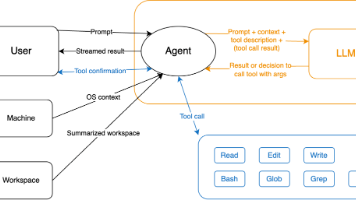

这也解释了为什么视频主角是“创意技术专家”(Creative Technologist)——他们往往不是只写模型或只做设计,而是把技术当作材料,把情感当作场景,把人当作系统的一部分来做实验。

3. 机器的“同情”到底是什么:理解、模拟,还是有效安抚?

摘要里提到:机器在理解和同情方面有潜力,能够改善用户情绪。这里我建议保持一种清醒的区分:

- 理解(understanding):知道你为什么难过,难过背后是什么处境、价值冲突与关系结构。

- 模拟(simulation):生成一种“像理解”的话术,让你觉得被接住。

- 安抚(soothing):让你的情绪下降,让你更平静、更愿意继续行动。

今天的AI在“模拟”和“安抚”上进步很快,但“理解”是最难的,因为理解需要对现实处境的长期观察、对价值冲突的承担、对后果的负责。机器没有人生,不承担后果,因此它可以很轻易地说出“正确的温柔话”。

这就带来一个关键问题:当AI能稳定地让你感觉更好,它是在帮助你,还是在训练你用一种更省事的方式处理痛苦?

比如你在关系里受挫,AI可以随时提供共情与支持;但真正的成长可能来自你与人之间艰难的沟通与边界建立。AI提供的“低摩擦安慰”,可能会让你更不愿进入真实世界的高摩擦关系。

这不是否定情感型AI的价值,而是提醒我们:情感数字智能的目标应该是增强人的能力,而不是替代人的生活。

4. 创意与技术的结合:为什么时尚也会成为AI情感交互的前线?

摘要里提到“创意与技术结合的重要性,尤其在时尚领域,强调物理世界与数字世界的交融”。很多人听到“时尚+AI”会以为是营销噱头,但从情感数字智能的角度,时尚是非常自然的场景——因为时尚本身就是一种情感表达与身份叙事:

- 我穿什么,是我如何被看见,也是我希望如何被理解。

- 服装、材质、剪裁、颜色,本质是情绪语言。

- “物理世界与数字世界的交融”意味着:你在现实里穿的、你在社交媒体上展示的、你在虚拟空间里使用的形象,会逐渐连成一个整体。

当AI参与其中,它不只是“给你推荐衣服”,而可能变成一种更深层的东西:推荐你成为哪一种人。比如它会根据你的情绪画像与社交反馈,告诉你某种风格更适合你、更能获得认可、更能表达“你是谁”。这就把“审美选择”推向了“身份构建”。

因此,时尚不是边缘应用,它可能是情感AI最早被大众接受、也最容易商业化的入口之一。

5. AI会不会让初级开发岗位消失?更现实的问题是:人才如何被培养

视频谈到AI对初级软件开发人员的影响:有人认为初级职位会消失,但仍然需要这些职位来培养新人才。这段观点非常接地气,也很重要。

我更倾向于这样理解:AI确实会吞掉一部分“入门级工作内容”(重复性编码、模板化CRUD、简单脚手架),但入门岗位的价值从来不只是产出代码,而是“学习系统”。没有初级岗位,组织就失去培养梯队的渠道;没有真实项目的低风险入口,新人只能在“练习题”里长大。

所以变化很可能是:

- 初级岗位不一定消失,但技能结构会改变:更强调需求理解、测试、数据处理、工具链、提示工程、代码审查与系统思维。

- “写代码”变得更容易,但“写对代码”仍然难,而“把问题说清楚”更难。

- 未来的区分不再是“会不会写”,而是“能不能定义问题、验证结果、承担质量”。

这也映射到情感数字智能:当技术门槛降低,真正稀缺的是对人的理解、对场景的洞察、对伦理与后果的敏感度。

6. “快速获得博士学位”的诱惑:知识比学位更重要,但知识从哪里来?

摘要里提到关于“快速获得博士学位”的想法,并强调知识的重要性超过学位本身。这点我很认同,但也想补一刀:知识不是信息堆积,而是可迁移的理解结构。

在AI时代,信息和“看起来像知识的文本”变得极其廉价。你随时可以让模型生成一篇论文框架、一个研究综述、十个研究问题。真正困难的是:

- 你能否判断哪些是关键概念、哪些是伪概念?

- 你能否识别论证链条里的断裂?

- 你能否把知识落到真实数据、真实案例、真实行动?

所以“知识比学位重要”不等于“学位无用”,而是提醒我们:如果学位的过程不能逼你建立这些能力,那它就只是一个标签;反之,如果你能通过严谨训练获得这些能力,学位只是一个自然结果。

而情感数字智能的研究与实践尤其需要这种“扎实”:因为它很容易陷入“温柔的空话”,或者陷入“可用但危险的产品”。

7. 那个“虚拟盗窃”项目:数字重建艺术品,挑战的是权力结构

视频里提到一个很有冲击力的项目:用AI进行艺术品的数字重建,针对大英博物馆文物做虚拟“盗窃”。这类项目之所以抓人,是因为它让AI从“效率工具”转向“文化与政治介入”。

它至少触及三个层面:

- 技术层面:数字重建让失落、残缺、被限制访问的文化遗产,以新的形式“可见”。这不仅是3D建模或图像生成,更是一种“再生产能力”。

- 叙事层面:所谓“盗窃”是一种反讽与对抗式叙事——当现实里的归还与正义很慢,数字世界可以先把“可访问权”夺回来。

- 权力层面:谁拥有文化遗产?谁决定展示方式?谁决定解释权?数字化不只是复制,更是重新分配权力。

把它放到“情感数字智能”的框架里,你会发现它同样在处理情绪与连接:愤怒、羞耻、历史创伤、身份认同、集体记忆。AI在这里不是“共情助手”,而是“表达与行动的媒介”。

8. 我们应该期待什么样的情感数字智能?

如果把视频的线索收束成一句话:情感数字智能的意义不在于让机器拥有情绪,而在于让技术更负责任地参与人的情绪生活。

我对它的期待更接近以下几个原则(也许可以当成创意技术实践的自检清单):

- 增强而非替代:让人更能识别与表达情绪,而不是把情绪外包给系统处理。

- 透明而非操控:系统应告诉你它基于什么作出判断、建议有什么局限,而不是用“像懂你”的话术来驱动行为。

- 可退出、可拒绝:情绪数据极其私密,用户应有明确的控制权与退出机制。

- 把人放回现实关系:好的情感AI应鼓励你回到真实世界的关系与行动中,而不是制造“永远在线的替代陪伴”。

结语:真正被“黑进”的,可能是我们对自己的解释权

“黑进心脏”这个说法很刺激,它既可以指技术入侵,也可以指创造性地拆解与重建。情感数字智能站在一个很危险也很可能伟大的交界处:它可能带来更好的心理支持、更细腻的创作工具、更民主的文化表达;也可能带来更隐蔽的操控、更深的依赖、更廉价的同情模拟。

最后我想把问题留在这里:当AI越来越擅长“让你感觉被理解”,你如何确认自己仍然拥有对自己情绪的解释权?

更多推荐

已为社区贡献199条内容

已为社区贡献199条内容

所有评论(0)