收藏!AI智能体落地真相:90%是工程架构,10%才是大模型(小白/程序员必看)

拆解完这14层架构,相信大家都能明白:AI智能体的企业级落地,从来不是“搞定大模型就万事大吉”,而是一场“全链路工程架构打磨”。大模型确实是核心,但它只是14层架构中的一环,相当于“画龙点睛”的那一笔——没有前面90%的工程架构铺垫,再强大的大模型,也无法落地生根,更无法发挥实际价值。对于小白程序员来说,想要入门AI智能体开发,不要一开始就死磕大模型调优,建议从工程架构入手,熟练掌握K8s、数据库

随着AI技术的普及,越来越多企业开始发力AI智能体落地,但很多小白程序员甚至资深开发都会陷入一个误区:以为搞定大模型就等于搞定了智能体。实则不然,实战中我们会发现一个铁律:90%的工作都集中在工程架构设计上,真正留给大模型本身发挥的空间,只有区区10%。

相信很多程序员在做AI智能体PoC(概念验证)阶段,都会信心满满:只要调用大模型API,简单调试几句,就能快速跑通demo。但当项目真正进入企业级落地环节,就会被现实“泼冷水”——大模型其实只是冰山一角,我们大部分时间和精力,都要消耗在数据清洗、系统部署、协议对接、监控运维、安全管控这些“不显眼、不吸睛”,但却缺一不可的工程细节上。

这里给大家分享一个真实案例,我曾和一家头部金融企业的CTO深度交流,他的话至今让我印象深刻,也道出了绝大多数企业的痛点:“我们一开始果断上了GPT,本以为核心工作是调prompt、优化模型输出,结果实际落地时才发现,大部分时间都花在把GPT融入整个风控体系上。数据要去噪清洗、权限要分级管控、操作要日志追踪、内外接口要打通适配,到最后才发现,大模型在整个系统里,只是最不起眼的一块小拼图。”

其实这并不是个例,而是AI智能体落地的普遍现状。这就像我们盖一栋摩天大楼,大家都关注华丽的外立面和高耸的楼层,但很少有人注意到,地基、管道、电力、消防、给排水这些底层工程,才是大楼能稳固矗立的核心。AI智能体的落地,亦是如此——没有扎实的工程架构,再强大的大模型也无法发挥价值。

今天就给小白和程序员们拆解AI智能体落地的14层工程架构(建议收藏,落地时直接对照参考),从底层算力到前端交互,每一层都拆解到位,帮你避开“只盯大模型”的坑,快速摸清企业级落地的核心逻辑。

第一层:CPU/GPU算力层(基础中的基础)

算力是AI智能体的“动力源泉”,没有足够的算力支撑,所有的模型和架构都是空中楼阁,这也是很多小白最容易忽视的一点。很多初创公司一开始做智能体,觉得买几台高性能GPU就够了,结果实际跑业务时才发现算力严重不足。

比如一家做视频内容智能审查的企业,初期只部署了4台GPU,本以为能支撑日常业务,可上线后才发现,每天需要处理的海量视频片段,直接把GPU集群“跑满烧穿”,系统频繁卡顿宕机。最后他们调整策略,转向公有云混合部署,灵活调度Azure和阿里云的算力资源,结合算力弹性伸缩,才让系统平稳运转。

这里提醒小白程序员:算力选择绝不是“选一块好显卡”那么简单,而是要结合业务场景,平衡采购成本、算力利用率和低延迟执行,尤其是高并发、大数据量的场景,提前做好算力规划至关重要。

第二层:基础设施层(架构的“钢筋水泥”)

基础设施层主要负责集群管理和服务稳定,核心工具就是容器和编排工具,相当于大楼的钢筋水泥,决定了整个架构的稳定性和可扩展性。很多小白程序员初期图省事,不做集群管理,结果导致智能体“时好时坏”。

举个例子,一家跨境电商公司做AI客服智能体,初期没有部署Kubernetes(K8s),也没有做自动伸缩机制。结果在大促活动期间,用户咨询量暴增,AI客服直接宕机,不仅影响用户体验,还错失了大批订单。后来他们优化基础设施,用上K8s和Kserve,实现服务弹性扩展和高可用,才彻底解决了宕机问题。

建议程序员们:无论做小型demo还是企业级项目,基础设施层都要重视,K8s、Docker这些工具一定要熟练掌握,这是AI智能体稳定落地的基础。

第三层:数据库层(智能体的“记忆中枢”)

智能体的记忆能力和实时决策能力,全靠数据库层支撑。很多小白初期会随便用一款关系型数据库,结果在处理海量数据、复杂检索时,性能严重不足。

比如一家医疗企业做诊断助手智能体,初期用MySQL作为数据库,处理海量医疗影像检索和病例查询时,响应速度慢到无法使用。后来他们优化数据库架构,采用Milvus(向量数据库)和Neo4j(图数据库)组合,Milvus负责高效向量检索,Neo4j管理病例之间的复杂关系,才实现“医生问一句,就能快速调出完整病例图谱”的效果,大幅提升了诊断效率。

第四层:ETL层(数据的“净化过滤器”)

ETL层(数据抽取、转换、加载)负责数据清洗和预处理,这是最琐碎但最关键的一步,很多项目之所以落地失败,就是因为忽视了ETL层,被“脏数据”拖垮。小白程序员很容易陷入“拿到数据就直接喂给模型”的误区,却不知道脏数据会严重影响模型效果。

一家制造业客户的案例很有代表性:他们的流水线上每天采集的数据五花八门,包含大量异常值、缺失值,初期没有做ETL处理,直接把数据喂给模型,导致模型输出混乱,无法正常使用。后来他们搭建了基于Datavolo的ETL流水线,实时对数据进行清洗、转换和标准化,让智能体能够“吸收干净的数据”,模型效果和系统稳定性大幅提升。

提醒小白:数据是模型的“粮食”,ETL层就是“粮仓管理员”,只有把数据清洗干净,模型才能发挥价值。

第五层:基础模型层(大家最熟悉的“核心环节”)

这是大家最熟悉的一层,也是小白程序员最关注的一层,核心就是各类大模型,比如GPT、DeepSeek、Claude、Qwen、Llama等,它们提供了智能体的认知、推理和对话能力。

但这里要重点提醒:企业级落地中,单靠一款大模型很难满足所有需求,真正的高手,都会“大模型+小模型”组合使用,发挥各自优势。比如一家物流公司的订单处理智能体,用Llama做通用对话和订单理解,用PaddleOCR做快递单号识别,效率比单靠大模型提升了3倍,还降低了成本。

小白程序员注意:不要只专注于调prompt,还要学会结合业务场景,选择合适的模型组合,这才是企业级落地的核心思路。

第六层:模型路由层(多模型的“交通指挥员”)

当项目中用到多个模型时,就需要模型路由层来分配任务,相当于交通指挥员,决定“哪类任务交给哪个模型处理”,既能节省成本,又能提升效率。很多小白在做多模型融合时,没有用模型路由,导致成本居高不下,延迟过高。

比如一家金融风控智能体团队,初期全靠GPT处理所有任务,不仅成本高昂,而且简单的规则校验任务也需要调用GPT,导致响应延迟。后来他们引入OpenRouter(模型路由工具),把高价值、高复杂度的风控决策交给大模型,低价值、简单的规则校验交给小模型,既降低了成本,又把响应延迟缩短了一半。

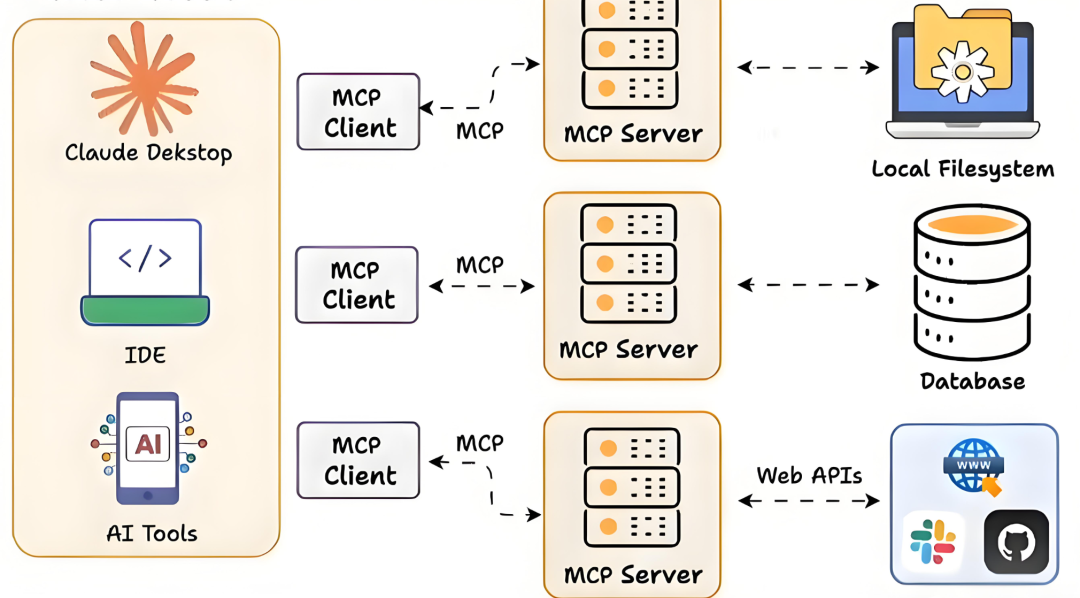

第七层:协议层(智能体的“沟通语言”)

协议层负责不同智能体之间、智能体与系统之间的通信,核心协议有MCP、A2A、AG-UI等。很多小白初期忽视协议层,用手工API拼接,导致系统臃肿、容易出错,而且难以扩展。

比如一个政务智能体项目,包含公文处理、政策比对、数据库对接三个子智能体,初期用手工API拼接,不同子智能体之间通信不畅,经常出现数据不一致、接口报错的问题。后来他们改用MCP协议,统一通信标准,让不同子智能体之间“说同一种语言”,通信效率大幅提升,报错率也降到了几乎为零。

第八层:编排层(智能体的“工作流程指挥官”)

编排层负责将不同的智能体、工具、模型串联起来,形成完整的工作流程,相当于智能体的“指挥官”,决定了智能体如何高效完成复杂任务。很多小白初期只做单一功能的智能体,不需要编排,但一旦涉及复杂流程,就会陷入“混乱”。

比如一家保险公司做理赔智能体,涉及数据比对、合同解析、客户对话、理赔核算等多个环节,单靠一个大模型根本无法完成。后来他们用LangGraph做编排,把不同的子智能体、工具串联成一个完整的理赔工作流,每个环节各司其职,就像一支交响乐队,协同完成理赔全流程,效率提升了50%以上。

第九层:认证层(智能体的“安全门禁”)

企业级落地中,安全永远是第一位的,认证层负责智能体之间的身份验证和权限管控,相当于智能体的“安全门禁”,防止越权访问和数据泄露。很多小白初期忽视认证层,导致项目无法通过企业审计。

比如一家银行的智能体项目,上线前被审计部门驳回,原因就是没有完善的身份验证机制,任何人都可能越权访问客户隐私数据。后来他们引入AWS AgentCore Identity,实现细粒度访问控制,给不同角色分配不同权限,才顺利通过审计,成功上线。

第十层:可观测层(问题的“排查雷达”)

可观测层负责日志追踪、异常监控和问题排查,相当于智能体的“排查雷达”,很多小白初期图省事,不做可观测配置,结果系统出问题后,无法定位原因,只能盲目调试。

举个例子,一个电商AI推荐智能体,初期没有部署可观测工具,经常出现“推荐错乱”“胡说八道”的问题,但开发团队无法定位原因,调试了很久都没有解决。后来他们引入LangSmith和OpenTelemetry,实现日志追踪、链路监控和异常告警,才发现问题出在上下文截断——模型输入的上下文过长,被自动截断,导致输出异常。找到问题后,很快就优化解决了。

提醒程序员们:可观测层不是锦上添花,而是刚需,尤其是企业级项目,一定要提前部署,避免出现“出问题无法排查”的尴尬。

第十一层:工具层(智能体的“手和眼”)

智能体要真正发挥价值,必须能调用外部工具,工具层就是智能体的“手和眼”,让智能体能够与外部系统交互,获取实时数据、执行具体操作。很多小白初期只做“对话型智能体”,不接入外部工具,导致智能体“纸上谈兵”,无法解决实际问题。

比如一家投资公司的AI助理智能体,核心功能是给用户提供投资建议,但如果不接入实时财经数据API、股票行情API,只能给出通用的投资理论,无法提供有价值的实时建议。接入外部工具后,AI助理能够实时抓取最新财经数据、分析行情,给出的建议才更具实用性。

第十二层:用户认证层(面向用户的“安全防护”)

很多人会把用户认证层和第九层的认证层混淆,其实两者不同:第九层是智能体之间的认证,而用户认证层是面向外部用户的安全防护,负责管理用户身份、控制用户访问权限,避免用户越权操作。

比如一个在线教育平台的AI辅导智能体,需要区分学生和老师的权限:学生只能查看自己的学习数据、咨询辅导问题,而老师可以查看所有学生的学习情况、布置作业。他们用Okta做用户认证和权限管理,有效避免了“学生冒充老师”“越权查看数据”的漏洞,保障了系统安全。

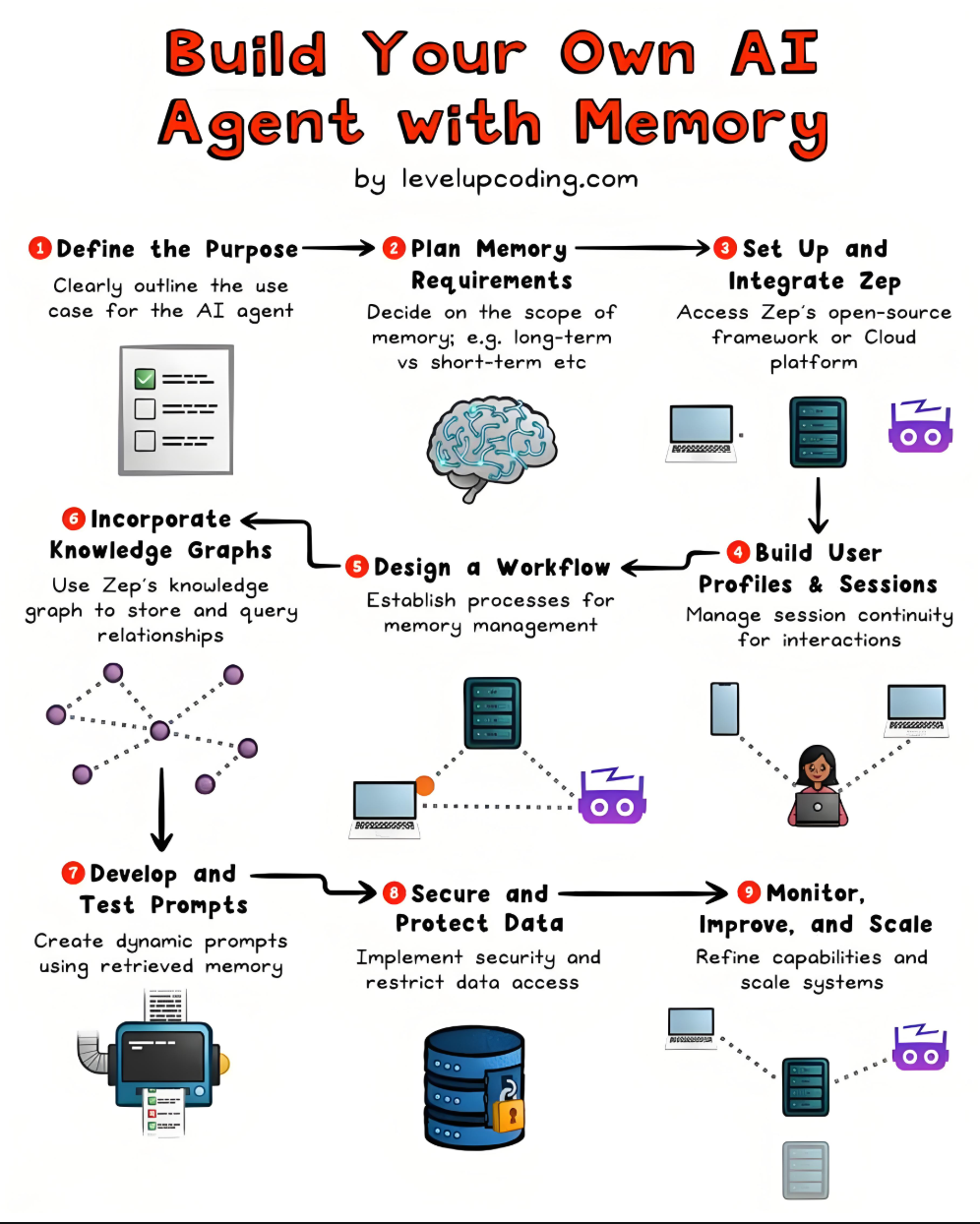

第十三层:记忆层(智能体的“长期记忆”)

没有记忆的智能体,就像金鱼一样,每次对话都从零开始,无法实现“连续对话”和“个性化交互”,这也是很多小白智能体的痛点。比如用户昨天和智能体说过自己的需求,今天再咨询时,智能体完全不记得,需要用户重复说明,体验很差。

比如一家客服智能体项目,初期没有做记忆层,用户抱怨“每次咨询都要重复说问题,智能体根本不懂我”。后来他们引入Mem0,将用户历史对话、需求偏好存储起来,智能体能够快速调取历史记忆,实现个性化交互,用户满意度大幅提升。

第十四层:前端层(用户的“第一印象”)

前端层是智能体与用户交互的入口,相当于大楼的“大门”,无论后端架构多么强大、模型多么优秀,如果前端界面繁琐、不好用,用户也不会愿意使用。很多程序员专注于后端开发,忽视前端优化,导致智能体“落地即闲置”。

比如一家医疗智能体项目,初期前端界面复杂,操作繁琐,医生需要点击多个步骤才能使用核心功能,抱怨不断,使用率很低。后来他们优化前端,采用基于Gradio的轻量化界面,简化操作流程,医生只需简单几步就能完成病例查询、诊断咨询,使用率大幅提升。

提醒程序员们:前端不是“装饰”,而是决定用户接受度的关键,尤其是面向非技术用户的智能体,前端一定要简洁、易用。

最后总结(小白/程序员必看)

拆解完这14层架构,相信大家都能明白:AI智能体的企业级落地,从来不是“搞定大模型就万事大吉”,而是一场“全链路工程架构打磨”。大模型确实是核心,但它只是14层架构中的一环,相当于“画龙点睛”的那一笔——没有前面90%的工程架构铺垫,再强大的大模型,也无法落地生根,更无法发挥实际价值。

对于小白程序员来说,想要入门AI智能体开发,不要一开始就死磕大模型调优,建议从工程架构入手,熟练掌握K8s、数据库、ETL这些基础工具,理解每一层的核心作用,再结合模型优化,这样才能快速成长,真正做好AI智能体落地。

对于企业来说,想要让AI智能体落地成功,必须从项目初期就正视工程架构的重要性,不要盲目追求“大模型噱头”,而是脚踏实地打磨每一层细节,只有这样,才能让AI智能体真正为业务赋能。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。我们整理出这套 AI 大模型突围资料包:

- ✅ 从零到一的 AI 学习路径图

- ✅ 大模型调优实战手册(附医疗/金融等大厂真实案例)

- ✅ 百度/阿里专家闭门录播课

- ✅ 大模型当下最新行业报告

- ✅ 真实大厂面试真题

- ✅ 2026 最新岗位需求图谱

所有资料 ⚡️ ,朋友们如果有需要 《AI大模型入门+进阶学习资源包》,下方扫码获取~

① 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

② 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。这里我给大家准备了一份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

③ 大模型学习书籍&文档

学习AI大模型离不开书籍文档,我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

④ AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

⑤ 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

⑥ 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

以上资料如何领取?

为什么大家都在学大模型?

最近科技巨头英特尔宣布裁员2万人,传统岗位不断缩减,但AI相关技术岗疯狂扩招,有3-5年经验,大厂薪资就能给到50K*20薪!

不出1年,“有AI项目经验”将成为投递简历的门槛。

风口之下,与其像“温水煮青蛙”一样坐等被行业淘汰,不如先人一步,掌握AI大模型原理+应用技术+项目实操经验,“顺风”翻盘!

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

以上全套大模型资料如何领取?

更多推荐

已为社区贡献421条内容

已为社区贡献421条内容

所有评论(0)