可验证奖励强化学习(RLVR):如何让大模型更可靠?

大型语言模型(Large Language Models, LLMs)的发展正在经历一场深刻的范式转变。自GPT系列问世以来,研究者们在预训练阶段投入了大量计算资源,通过扩大模型参数规模和训练数据量来提升模型能力。然而,随着边际收益递减规律的显现,单纯依靠"更大模型+更多数据"的路径已难以持续[1]。近年来,以OpenAI的o1/o3系列和DeepSeek-R1为代表的大型推理模型(Large R

1 引言:大模型推理能力的范式革命

1.1 从预训练到后训练的能力跃迁

大型语言模型(Large Language Models, LLMs)的发展正在经历一场深刻的范式转变。自GPT系列问世以来,研究者们在预训练阶段投入了大量计算资源,通过扩大模型参数规模和训练数据量来提升模型能力。然而,随着边际收益递减规律的显现,单纯依靠"更大模型+更多数据"的路径已难以持续[1]。

近年来,以OpenAI的o1/o3系列和DeepSeek-R1为代表的大型推理模型(Large Reasoning Models, LRMs)展现了令人瞩目的推理能力突破。这些模型在数学竞赛、代码生成和科学推理等复杂任务上取得了前所未有的成绩。例如,在AIME 2024数学竞赛基准上,o1模型达到了83.3%的准确率,远超GPT-4o的13.4%;在Codeforces编程竞赛中,o1更是取得了89.0%的成绩[2]。

这些突破性进展的背后,是一种名为**可验证奖励强化学习(Reinforcement Learning with Verifiable Rewards, RLVR)**的新型训练范式。RLVR的核心思想在于:不再依赖主观的人类反馈或昂贵的奖励模型来评估模型输出,而是利用客观、可程序化验证的规则来提供奖励信号[3]。这种方法在数学推理(答案可精确验证)和代码生成(可通过测试用例验证)等领域展现出独特的优势。

1.2 RLVR的核心价值主张

RLVR作为一种新兴的强化学习训练范式,其本质区别在于奖励信号的来源和性质。传统的人类反馈强化学习(RLHF)依赖人类标注者或由其训练的奖励模型对模型输出进行主观评价,而RLVR则采用基于规则的验证函数自动生成奖励[4]。这种转变带来了几个显著优势:

第一,奖励信号的客观性与透明性。RLVR的奖励来源于可验证的正确性标准,例如数学问题的标准答案、代码的测试用例通过率等。这些标准在训练前就已明确设定,可以通过程序自动判定,消除了人类评价中的主观偏见和不一致性。

第二,训练成本的可控性。RLHF需要大量高质量的人类偏好数据进行奖励模型训练,数据收集既昂贵又耗时。相比之下,RLVR利用自动验证机制,可以在无需人工干预的情况下生成海量训练信号,大幅降低了后训练阶段的成本。

第三,推理能力的涌现性。研究表明,当基础模型具备一定能力后,RLVR训练可以激发出模型自发形成的深度推理行为,包括长思维链(Long Chain-of-Thought)、自我验证、回溯修正等复杂的元认知策略[5]。这些行为并非显式编程实现,而是在追求可验证奖励的过程中自然涌现的。

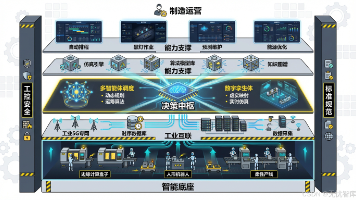

上图展示了RLVR与传统RLHF的核心区别。RLHF依赖于人类或奖励模型的主观评估,而RLVR则通过规则验证器直接生成可验证的奖励信号,形成了更加客观、高效的训练闭环。

1.3 文章结构概述

本文将系统性地探讨RLVR的理论基础、算法机制、训练动态以及实际应用。第2章将回顾从RLHF到RLVR的演进历程,分析两种范式的本质差异。第3章深入阐述RLVR的数学原理和理论基础。第4章重点介绍GRPO(Group Relative Policy Optimization)算法——RLVR框架下的核心优化方法。第5章探讨RLVR训练过程中的动态特性和涌现能力。第6章对比分析过程奖励与结果奖励的优劣。第7章讨论测试时缩放(Test-Time Scaling)与推理能力的扩展。第8章展望RLVR面临的挑战与未来发展方向。

2 从RLHF到RLVR:奖励机制的范式演进

2.1 RLHF的原理与局限性

2.1.1 RLHF的基本框架

人类反馈强化学习(RLHF)自InstructGPT和ChatGPT成功应用以来,已成为大模型对齐人类偏好的主流方法[6]。RLHF的典型流程包含三个阶段:

第一阶段:监督微调(Supervised Fine-Tuning, SFT)。使用高质量的人类标注数据对预训练模型进行初步微调,使模型学习基本的指令遵循能力。

第二阶段:奖励模型训练。收集人类标注者对模型输出的偏好比较数据,训练一个奖励模型(Reward Model, RM)来近似人类偏好。给定输入xxx和候选输出yyy,奖励模型R(x,y)R(x, y)R(x,y)输出一个标量分数,表示该输出符合人类偏好的程度[7]。

第三阶段:强化学习优化。使用PPO(Proximal Policy Optimization)等策略梯度算法,基于奖励模型的反馈优化语言模型策略。优化目标可形式化为:

JRLHF(θ)=Ex∼D,y∼πθ(y∣x)[R(x,y)]−βDKL(πθ∥πref)J_{RLHF}(\theta) = \mathbb{E}_{x \sim D, y \sim \pi_\theta(y|x)}[R(x, y)] - \beta D_{KL}(\pi_\theta \|\pi_{ref})JRLHF(θ)=Ex∼D,y∼πθ(y∣x)[R(x,y)]−βDKL(πθ∥πref)

其中πθ\pi_\thetaπθ是当前策略,πref\pi_{ref}πref是参考策略(通常是SFT模型),β\betaβ控制KL散度惩罚的强度,防止策略偏离过远[8]。

2.1.2 RLHF的核心局限

尽管RLHF在提升模型有用性和安全性方面取得了显著成效,但其固有局限性也日益凸显:

奖励模型的不稳定性。奖励模型是从有限的人类偏好数据中训练得到的,存在模型误设(model misspecification)和泛化错误的风险。研究表明,奖励模型容易过拟合到表面特征(如响应长度、格式偏好等),导致"奖励黑客"(reward hacking)现象——模型学会利用奖励模型的漏洞获取高分,而非真正提升输出质量[9]。

人类反馈的稀疏性与主观性。获取高质量的人类偏好数据成本高昂,且人类标注者之间存在显著的主观差异。对于需要专业知识的复杂任务(如数学证明、代码调试),普通标注者难以提供准确的偏好判断[10]。

扩展性的瓶颈。随着模型能力的提升和应用场景的扩展,需要持续收集新的偏好数据来覆盖更多领域。这种对人工标注的持续依赖限制了RLHF的可扩展性。

| 维度 | RLHF | RLVR |

|---|---|---|

| 奖励来源 | 人类标注/奖励模型 | 规则验证器 |

| 奖励性质 | 主观、连续 | 客观、离散 |

| 成本 | 高(需人工标注) | 低(自动验证) |

| 可扩展性 | 受限于标注规模 | 高度可扩展 |

| 适用领域 | 通用任务 | 可验证任务 |

| 主要风险 | 奖励黑客 | 稀疏奖励 |

上表系统对比了RLHF与RLVR在六个关键维度上的差异。RLVR通过自动化验证机制,在成本、可扩展性和客观性方面具有明显优势,但其适用范围目前主要局限于具有明确正确性标准的任务。

2.2 RLVR的兴起与核心特征

2.2.1 RLVR的定义与形式化

可验证奖励强化学习(RLVR)是一种利用可程序化验证的奖励函数来指导策略优化的强化学习范式[11]。在RLVR框架下,奖励信号由确定性验证函数生成,而非学习得到的奖励模型。对于给定问题qqq和模型输出ooo,奖励函数可定义为:

R(q,o)={1if Verify(q,o)=True0otherwiseR(q, o) = \begin{cases} 1 & \text{if } \text{Verify}(q, o) = \text{True} \\ 0 & \text{otherwise} \end{cases}R(q,o)={10if Verify(q,o)=Trueotherwise

其中Verify(⋅)\text{Verify}(\cdot)Verify(⋅)是针对特定任务设计的验证函数。例如在数学问题中,验证函数检查模型答案是否与标准答案一致;在代码生成任务中,验证函数执行测试用例检查代码正确性[12]。

RLVR的优化目标与RLHF类似,但奖励来源不同:

JRLVR(θ)=Eq∼D,o∼πθ(o∣q)[R(q,o)]−βDKL(πθ∥πref)J_{RLVR}(\theta) = \mathbb{E}_{q \sim D, o \sim \pi_\theta(o|q)}[R(q, o)] - \beta D_{KL}(\pi_\theta \|\pi_{ref})JRLVR(θ)=Eq∼D,o∼πθ(o∣q)[R(q,o)]−βDKL(πθ∥πref)

2.2.2 RLVR的适用领域

RLVR特别适用于具有以下特征的任务:

数学推理。数学问题的答案具有唯一性和可验证性。无论是算术运算、代数方程还是几何证明,最终结果都可以通过计算或逻辑推理进行验证。DeepSeekMath的研究表明,基于RLVR的训练可以显著提升模型在MATH等数学竞赛基准上的表现[4]。

代码生成。编程任务天然具备可验证性——代码是否正确可以通过编译和执行测试用例来判定。DeepSeek-Coder等模型通过RLVR训练,在HumanEval、MBPP等代码生成基准上取得了优异性能[13]。

逻辑推理与约束满足。涉及明确规则和约束的推理任务,如逻辑谜题、数独求解等,都适合采用RLVR进行训练。验证函数可以精确检查解是否满足所有约束条件。

上图展示了大模型任务的分类。绿色区域表示适合RLVR的可验证任务,红色区域表示更适合传统RLHF的主观任务。值得注意的是,近期研究正在探索将RLVR扩展到开放式任务的方法,如通过可验证的多项选择重构(VMR-RLVR)等技术[14]。

2.3 为什么RLVR在2025年成为主流

2.3.1 基础模型能力的成熟

RLVR并非全新的概念,但其在2025年成为大模型训练的主流范式,与基础模型能力的显著提升密不可分。早期模型在基础语言理解和推理能力上存在明显短板,即使提供可验证的奖励信号,模型也难以通过探索形成有效的推理策略。研究表明,只有当基础模型达到一定能力阈值后,RLVR才能发挥出其应有的效果[15]。

DeepSeek-R1的成功验证了这一观点。该研究首先使用DeepSeek-V3作为基础模型——这是一个在多项基准上表现出色的通用大模型——然后应用RLVR进行后训练,最终激发出强大的推理能力。这印证了RLVR的有效性建立在基础模型能力之上的假设[16]。

2.3.2 算法创新的推动

GRPO(Group Relative Policy Optimization)等新型策略优化算法的提出,为RLVR的高效实施提供了关键工具。与传统PPO相比,GRPO消除了对独立价值网络(critic)的依赖,通过组内相对奖励估计优势函数,将内存占用降低约50%[4]。这一创新使得在更大规模模型上应用RLVR成为可能。

此外,针对RLVR训练稳定性的研究也取得了重要进展。Shrinkage Baselines等方法通过改进基线估计降低策略梯度的方差,进一步提升了训练效率和最终性能[17]。

2.3.3 计算资源的优化配置

随着大模型训练成本的持续上升,研究社区开始重新审视训练资源的配置策略。传统上,扩大模型参数规模和预训练数据量被视为提升能力的主要途径。然而,研究表明,在后训练阶段投入更多计算资源,通过RLVR激发模型已有潜能,可能比单纯扩大预训练规模更具成本效益[18]。

测试时缩放(Test-Time Scaling)的兴起进一步强化了这一趋势。通过允许模型在推理时生成更长的思维链,模型可以将额外的计算资源转化为更强的推理能力,而无需增加参数规模[19]。这种"以时间换空间"的策略与RLVR训练相辅相成,共同推动了推理模型的发展。

3 RLVR的理论基础与数学原理

3.1 强化学习的基本框架

3.1.1 马尔可夫决策过程

强化学习的数学基础是马尔可夫决策过程(Markov Decision Process, MDP)。一个MDP由五元组(S,A,P,R,γ)(S, A, P, R, \gamma)(S,A,P,R,γ)定义[20]:

- SSS:状态空间,表示环境中所有可能的状态

- AAA:动作空间,表示智能体可以采取的所有动作

- P(s′∣s,a)P(s'|s, a)P(s′∣s,a):状态转移概率,表示在状态sss采取动作aaa后转移到状态s′s's′的概率

- R(s,a)R(s, a)R(s,a):奖励函数,表示在状态sss采取动作aaa获得的即时奖励

- γ∈[0,1]\gamma \in [0, 1]γ∈[0,1]:折扣因子,用于平衡即时奖励与未来奖励的重要性

在语言模型场景中,状态sss对应于已生成的词元序列,动作aaa对应于选择下一个词元。策略π(a∣s)\pi(a|s)π(a∣s)定义了在给定状态下选择动作的概率分布。语言模型的核心任务就是学习一个最优策略,最大化期望累积奖励:

J(π)=Eτ∼π[∑t=0TγtR(st,at)]J(\pi) = \mathbb{E}_{\tau \sim \pi}\left[\sum_{t=0}^{T} \gamma^t R(s_t, a_t)\right]J(π)=Eτ∼π[t=0∑TγtR(st,at)]

其中τ=(s0,a0,s1,a1,...,sT)\tau = (s_0, a_0, s_1, a_1, ..., s_T)τ=(s0,a0,s1,a1,...,sT)表示一条轨迹(trajectory)。

3.1.2 策略梯度定理

策略梯度方法直接对策略参数θ\thetaθ进行优化。策略梯度定理指出,期望累积奖励对策略参数的梯度为[21]:

∇θJ(πθ)=Eτ∼πθ[∑t=0T∇θlogπθ(at∣st)⋅Gt]\nabla_\theta J(\pi_\theta) = \mathbb{E}_{\tau \sim \pi_\theta}\left[\sum_{t=0}^{T} \nabla_\theta \log \pi_\theta(a_t|s_t) \cdot G_t\right]∇θJ(πθ)=Eτ∼πθ[t=0∑T∇θlogπθ(at∣st)⋅Gt]

其中Gt=∑t′=tTγt′−tR(st′,at′)G_t = \sum_{t'=t}^{T} \gamma^{t'-t} R(s_{t'}, a_{t'})Gt=∑t′=tTγt′−tR(st′,at′)是从时刻ttt开始的折扣累积奖励。

在实际应用中,为了降低方差,通常引入基线(baseline)b(st)b(s_t)b(st):

∇θJ(πθ)=Eτ∼πθ[∑t=0T∇θlogπθ(at∣st)⋅(Gt−b(st))]\nabla_\theta J(\pi_\theta) = \mathbb{E}_{\tau \sim \pi_\theta}\left[\sum_{t=0}^{T} \nabla_\theta \log \pi_\theta(a_t|s_t) \cdot (G_t - b(s_t))\right]∇θJ(πθ)=Eτ∼πθ[t=0∑T∇θlogπθ(at∣st)⋅(Gt−b(st))]

基线的引入不改变梯度的期望值,但可以显著降低方差,提高训练稳定性。常见的基线选择包括状态价值函数V(st)V(s_t)V(st)或平均奖励[22]。

3.2 RLVR的奖励设计原理

3.2.1 二元奖励与稀疏性挑战

RLVR最典型的奖励形式是二元奖励:当模型输出完全正确时获得奖励1,否则为0。这种奖励设计简单直接,但带来了稀疏性挑战——在巨大的输出空间中,正确输出可能只占极小比例,导致智能体难以通过随机探索获得正向反馈[23]。

形式上,对于问题qqq,设所有可能输出的集合为O\mathcal{O}O,其中正确答案集合为O∗⊂O\mathcal{O}^* \subset \mathcal{O}O∗⊂O。二元奖励函数为:

R(q,o)=I(o∈O∗)R(q, o) = \mathbb{I}(o \in \mathcal{O}^*)R(q,o)=I(o∈O∗)

其中I(⋅)\mathbb{I}(\cdot)I(⋅)是指示函数。奖励的稀疏程度可以用∣O∗∣/∣O∣|\mathcal{O}^*|/|\mathcal{O}|∣O∗∣/∣O∣来衡量,对于复杂推理任务,这一比例可能极低。

3.2.2 奖励塑形与密集化策略

为了缓解稀疏奖励问题,研究者提出了多种**奖励塑形(Reward Shaping)**策略:

格式奖励(Format Reward)。除了最终答案的正确性,还奖励符合预定格式的输出。例如,要求模型将推理过程放在<think>标签内,最终答案放在<answer>标签内。格式奖励可以形式化为:

Rformat(o)=I(FormatValid(o))R_{format}(o) = \mathbb{I}(\text{FormatValid}(o))Rformat(o)=I(FormatValid(o))

过程奖励(Process Reward)。对中间推理步骤进行奖励,而不仅仅关注最终结果。过程奖励模型(Process Reward Model, PRM)为每个推理步骤sts_tst分配一个质量分数[24]:

Rprocess=∑t=1Twt⋅Quality(st)R_{process} = \sum_{t=1}^{T} w_t \cdot \text{Quality}(s_t)Rprocess=t=1∑Twt⋅Quality(st)

其中wtw_twt是步骤权重,Quality(st)\text{Quality}(s_t)Quality(st)衡量第ttt步的质量。

规则组合奖励。将多个可验证的维度组合成综合奖励信号:

Rcombined=α⋅Raccuracy+β⋅Rformat+γ⋅RprocessR_{combined} = \alpha \cdot R_{accuracy} + \beta \cdot R_{format} + \gamma \cdot R_{process}Rcombined=α⋅Raccuracy+β⋅Rformat+γ⋅Rprocess

其中α,β,γ\alpha, \beta, \gammaα,β,γ是权重超参数。

| 奖励类型 | 定义 | 优点 | 缺点 |

|---|---|---|---|

| 二元结果奖励 | R=I(o∈O∗)R = \mathbb{I}(o \in \mathcal{O}^*)R=I(o∈O∗) | 简单、无偏 | 过于稀疏 |

| 格式奖励 | R=I(FormatValid(o))R = \mathbb{I}(\text{FormatValid}(o))R=I(FormatValid(o)) | 引导结构化输出 | 可能偏离核心目标 |

| 过程奖励 | R=∑wt⋅Quality(st)R = \sum w_t \cdot \text{Quality}(s_t)R=∑wt⋅Quality(st) | 提供细粒度信号 | 需要额外标注或模型 |

| 组合奖励 | R=αRacc+βRfmt+γRprocR = \alpha R_{acc} + \beta R_{fmt} + \gamma R_{proc}R=αRacc+βRfmt+γRproc | 灵活可调 | 超参数敏感 |

上表总结了不同类型奖励的特点。在实际应用中,DeepSeek-R1采用了以二元结果奖励为主、辅以格式奖励的策略,取得了良好效果[16]。

3.3 策略优化的理论保证

3.3.1 信任区域方法

策略梯度方法面临的一个核心挑战是训练稳定性。过大的策略更新可能导致性能崩溃,而过小的更新则降低学习效率。信任区域(Trust Region)方法通过限制策略更新的幅度来解决这一问题[25]。

TRPO(Trust Region Policy Optimization)算法引入KL散度约束:

maxθEs∼ρθold,a∼πθold[πθ(a∣s)πθold(a∣s)Aθold(s,a)]\max_\theta \mathbb{E}_{s \sim \rho_{\theta_{old}}, a \sim \pi_{\theta_{old}}}[\frac{\pi_\theta(a|s)}{\pi_{\theta_{old}}(a|s)} A_{\theta_{old}}(s, a)]θmaxEs∼ρθold,a∼πθold[πθold(a∣s)πθ(a∣s)Aθold(s,a)]

s.t. Es∼ρθold[DKL(πθold(⋅∣s)∥πθ(⋅∣s))]≤δ\text{s.t. } \mathbb{E}_{s \sim \rho_{\theta_{old}}}[D_{KL}(\pi_{\theta_{old}}(\cdot|s) \|\pi_\theta(\cdot|s))] \leq \deltas.t. Es∼ρθold[DKL(πθold(⋅∣s)∥πθ(⋅∣s))]≤δ

其中Aθold(s,a)=Qθold(s,a)−Vθold(s)A_{\theta_{old}}(s, a) = Q_{\theta_{old}}(s, a) - V_{\theta_{old}}(s)Aθold(s,a)=Qθold(s,a)−Vθold(s)是优势函数,δ\deltaδ是信任区域半径。

PPO(Proximal Policy Optimization)进一步简化了TRPO,使用裁剪目标函数替代显式约束[8]:

LCLIP(θ)=Et[min(rt(θ)At,clip(rt(θ),1−ϵ,1+ϵ)At)]L^{CLIP}(\theta) = \mathbb{E}_t[\min(r_t(\theta)A_t, \text{clip}(r_t(\theta), 1-\epsilon, 1+\epsilon)A_t)]LCLIP(θ)=Et[min(rt(θ)At,clip(rt(θ),1−ϵ,1+ϵ)At)]

其中rt(θ)=πθ(at∣st)πθold(at∣st)r_t(\theta) = \frac{\pi_\theta(a_t|s_t)}{\pi_{\theta_{old}}(a_t|s_t)}rt(θ)=πθold(at∣st)πθ(at∣st)是概率比率,ϵ\epsilonϵ是裁剪超参数。

3.3.2 KL散度正则化的理论分析

在RLHF和RLVR中,KL散度正则化项扮演着关键角色。从理论角度分析,KL正则化确保了优化过程不会使策略偏离参考策略过远,从而维持生成内容的多样性和合理性[26]。

反向KL(Reverse KL)正则化的优化目标为:

maxπEY∼π(⋅∣x)[r(x,Y)]−1γKL(π(⋅∣x)∥πref(⋅∣x))\max_\pi \mathbb{E}_{Y \sim \pi(\cdot|x)}[r(x, Y)] - \frac{1}{\gamma} KL(\pi(\cdot|x) \|\pi_{ref}(\cdot|x))πmaxEY∼π(⋅∣x)[r(x,Y)]−γ1KL(π(⋅∣x)∥πref(⋅∣x))

该问题的闭式解为:

π∗(y∣x)=πref(y∣x)Z(x)exp(γr(x,y))\pi^*(y|x) = \frac{\pi_{ref}(y|x)}{Z(x)} \exp(\gamma r(x, y))π∗(y∣x)=Z(x)πref(y∣x)exp(γr(x,y))

其中Z(x)=EY∼πref(⋅∣x)[exp(γr(x,Y))]Z(x) = \mathbb{E}_{Y \sim \pi_{ref}(\cdot|x)}[\exp(\gamma r(x, Y))]Z(x)=EY∼πref(⋅∣x)[exp(γr(x,Y))]是归一化因子。

正向KL(Forward KL)正则化则采用不同的形式:

maxπEY∼π(⋅∣x)[r(x,Y)]−1γKL(πref(⋅∣x)∥π(⋅∣x))\max_\pi \mathbb{E}_{Y \sim \pi(\cdot|x)}[r(x, Y)] - \frac{1}{\gamma} KL(\pi_{ref}(\cdot|x) \|\pi(\cdot|x))πmaxEY∼π(⋅∣x)[r(x,Y)]−γ1KL(πref(⋅∣x)∥π(⋅∣x))

研究表明,反向KL正则化倾向于使优化后的策略更加"集中",而正向KL正则化则使策略更加"分散"。在实际应用中,反向KL更常用于RLHF和RLVR框架[27]。

3.3.3 无Critic策略优化

传统Actor-Critic方法需要维护一个独立的价值网络(Critic)来估计状态价值,这带来了额外的计算和内存开销。GRPO等RLVR算法采用组相对优势估计,消除了对Critic的依赖[4]。

对于问题qqq,从旧策略πθold\pi_{\theta_{old}}πθold采样GGG个输出{o1,o2,...,oG}\{o_1, o_2, ..., o_G\}{o1,o2,...,oG},获得对应奖励{r1,r2,...,rG}\{r_1, r_2, ..., r_G\}{r1,r2,...,rG}。第iii个输出的优势估计为:

Ai=ri−mean({r1,...,rG})std({r1,...,rG})A_i = \frac{r_i - \text{mean}(\{r_1, ..., r_G\})}{\text{std}(\{r_1, ..., r_G\})}Ai=std({r1,...,rG})ri−mean({r1,...,rG})

这种组内相对估计的直观意义是:对于同一问题的多个尝试,表现优于平均水平的输出获得正向优势,反之获得负向优势。这种方法无需学习价值函数,大大降低了内存占用和训练复杂度。

GRPO通过组内相对奖励估计,消除了对独立Critic网络的依赖,以更低的计算成本实现了有效的优势估计。

4 GRPO算法:RLVR的核心优化引擎

4.1 GRPO的算法设计

4.1.1 算法动机与核心思想

Group Relative Policy Optimization(GRPO)是DeepSeek团队为RLVR场景专门设计的策略优化算法,首次在DeepSeekMath工作中提出[4]。GRPO的设计动机源于对传统PPO在RLVR场景下局限性的深刻洞察:

第一,Critic网络的冗余性。在RLVR中,奖励仅取决于最终答案的正确性,与中间状态的价值没有直接关系。训练一个独立的价值网络来估计状态价值既消耗资源,又引入了额外的近似误差。

第二,奖励的离散性与稀疏性。二元奖励信号难以支撑精确的价值估计。对于同一问题的不同尝试,价值网络难以准确预测哪些推理路径更可能导向正确答案。

第三,组内比较的直观性。人类在评估自己表现时,往往通过与同类尝试的比较形成判断。GRPO借鉴这一思想,通过组内相对表现来估计优势,避免了绝对价值估计的困难[28]。

4.1.2 GRPO的完整算法流程

GRPO的完整流程可以描述如下:

输入:初始策略πθinit\pi_{\theta_{init}}πθinit,参考策略πref\pi_{ref}πref,训练数据集DDD,组大小GGG,学习率η\etaη,KL惩罚系数β\betaβ,裁剪阈值ϵ\epsilonϵ

对于每个训练迭代:

- 从数据集中采样问题q∼Dq \sim Dq∼D

- 从旧策略采样GGG个输出:{oi}i=1G∼πθold(⋅∣q)\{o_i\}_{i=1}^G \sim \pi_{\theta_{old}}(\cdot|q){oi}i=1G∼πθold(⋅∣q)

- 计算每个输出的奖励:ri=R(q,oi)r_i = R(q, o_i)ri=R(q,oi)

- 计算组内相对优势:

μ=1G∑i=1Gri,σ=1G∑i=1G(ri−μ)2\mu = \frac{1}{G}\sum_{i=1}^G r_i, \quad \sigma = \sqrt{\frac{1}{G}\sum_{i=1}^G(r_i - \mu)^2}μ=G1i=1∑Gri,σ=G1i=1∑G(ri−μ)2

Ai=ri−μσ+ϵstabA_i = \frac{r_i - \mu}{\sigma + \epsilon_{stab}}Ai=σ+ϵstabri−μ - 计算每个词元级别的损失(对于输出oio_ioi的第ttt个词元):

ri,t(θ)=πθ(oi,t∣q,oi,<t)πθold(oi,t∣q,oi,<t)r_{i,t}(\theta) = \frac{\pi_\theta(o_{i,t}|q, o_{i,<t})}{\pi_{\theta_{old}}(o_{i,t}|q, o_{i,<t})}ri,t(θ)=πθold(oi,t∣q,oi,<t)πθ(oi,t∣q,oi,<t)

Li,t=min(ri,tAi,clip(ri,t,1−ϵ,1+ϵ)Ai)L_{i,t} = \min(r_{i,t}A_i, \text{clip}(r_{i,t}, 1-\epsilon, 1+\epsilon)A_i)Li,t=min(ri,tAi,clip(ri,t,1−ϵ,1+ϵ)Ai) - 计算KL散度惩罚:

DKLi,t=πref(oi,t∣q,oi,<t)πθ(oi,t∣q,oi,<t)−logπref(oi,t∣q,oi,<t)πθ(oi,t∣q,oi,<t)−1D_{KL}^{i,t} = \frac{\pi_{ref}(o_{i,t}|q, o_{i,<t})}{\pi_\theta(o_{i,t}|q, o_{i,<t})} - \log\frac{\pi_{ref}(o_{i,t}|q, o_{i,<t})}{\pi_\theta(o_{i,t}|q, o_{i,<t})} - 1DKLi,t=πθ(oi,t∣q,oi,<t)πref(oi,t∣q,oi,<t)−logπθ(oi,t∣q,oi,<t)πref(oi,t∣q,oi,<t)−1 - 总损失函数:

LGRPO(θ)=−1G∑i=1G1∣oi∣∑t=1∣oi∣(Li,t−βDKLi,t)\mathcal{L}_{GRPO}(\theta) = -\frac{1}{G}\sum_{i=1}^G \frac{1}{|o_i|}\sum_{t=1}^{|o_i|}(L_{i,t} - \beta D_{KL}^{i,t})LGRPO(θ)=−G1i=1∑G∣oi∣1t=1∑∣oi∣(Li,t−βDKLi,t) - 更新参数:θ←θ−η∇θLGRPO(θ)\theta \leftarrow \theta - \eta \nabla_\theta \mathcal{L}_{GRPO}(\theta)θ←θ−η∇θLGRPO(θ)

输出:优化后的策略πθ\pi_\thetaπθ[16]

4.2 GRPO的数学分析

4.2.1 优势估计的无偏性

GRPO的组相对优势估计具有理论上的合理性。设对于问题qqq,真实期望奖励为rˉ=Eo∼πθold[R(q,o)]\bar{r} = \mathbb{E}_{o \sim \pi_{\theta_{old}}}[R(q, o)]rˉ=Eo∼πθold[R(q,o)],方差为σr2=Varo∼πθold[R(q,o)]\sigma_r^2 = \text{Var}_{o \sim \pi_{\theta_{old}}}[R(q, o)]σr2=Varo∼πθold[R(q,o)]。

组内样本均值μ\muμ是rˉ\bar{r}rˉ的无偏估计:E[μ]=rˉ\mathbb{E}[\mu] = \bar{r}E[μ]=rˉ。标准化后的优势估计AiA_iAi满足:

E[Ai]=E[ri−μσ]≈0\mathbb{E}[A_i] = \mathbb{E}\left[\frac{r_i - \mu}{\sigma}\right] \approx 0E[Ai]=E[σri−μ]≈0

当ri>rˉr_i > \bar{r}ri>rˉ时,Ai>0A_i > 0Ai>0,策略更新将提高该输出的概率;当ri<rˉr_i < \bar{r}ri<rˉ时,Ai<0A_i < 0Ai<0,策略将降低该输出的概率。这种相对比较机制确保了策略向优于平均水平的方向演进[29]。

4.2.2 方差缩减分析

策略梯度估计的方差是影响训练稳定性的关键因素。GRPO通过组内比较实现了方差缩减效果。

设单个样本的奖励方差为σr2\sigma_r^2σr2。使用组均值作为基线,优势估计的方差为:

Var(ri−μ)=Var(ri)+Var(μ)−2Cov(ri,μ)=σr2(1−1G)\text{Var}(r_i - \mu) = \text{Var}(r_i) + \text{Var}(\mu) - 2\text{Cov}(r_i, \mu) = \sigma_r^2(1 - \frac{1}{G})Var(ri−μ)=Var(ri)+Var(μ)−2Cov(ri,μ)=σr2(1−G1)

当组大小GGG增大时,方差趋近于σr2\sigma_r^2σr2,但协方差项的存在使得方差始终小于直接使用原始奖励的方差。这表明组内比较机制确实起到了方差缩减的作用[17]。

近期研究进一步提出了Shrinkage Baselines方法,借鉴James-Stein估计的思想,将组内均值向全局均值收缩,进一步降低估计方差:

μshrink=λμgroup+(1−λ)μglobal\mu^{shrink} = \lambda \mu_{group} + (1-\lambda)\mu_{global}μshrink=λμgroup+(1−λ)μglobal

其中λ∈[0,1]\lambda \in [0, 1]λ∈[0,1]是收缩系数。理论分析表明,适当选择的收缩系数可以进一步降低均方误差[30]。

4.3 GRPO的变体与扩展

4.3.1 处理零奖励情况

在RLVR训练的早期阶段,模型可能对所有GGG个采样输出都产生错误答案,导致所有ri=0r_i = 0ri=0。此时μ=0\mu = 0μ=0,σ=0\sigma = 0σ=0,优势估计AiA_iAi变为未定义的0/00/00/0形式,训练陷入停滞。

Scaf-GRPO(Scaffolded GRPO)提出了一种解决方案:当检测到全零奖励时,引入一个"引导输出"(guided output)来恢复梯度信号[31]。具体而言:

- 检测当前组是否全为零奖励

- 如果是,构造一个辅助提示(如添加"让我们逐步思考"等引导语)

- 从当前策略采样一个引导输出oh∗o_h^*oh∗

- 将引导输出加入组中,重新计算优势

这种方法保持了on-policy特性(引导输出仍来自当前策略),同时避免了零梯度问题。

4.3.2 多轮工具调用场景

对于需要多轮工具交互的复杂任务,标准GRPO面临新的挑战:奖励只在最终轮次产生,中间轮次的动作缺乏直接反馈。

RC-GRPO(Reward-Conditioned GRPO)扩展了GRPO以支持多轮场景[32]。其核心思想是在每个轮次引入"奖励条件",让模型知晓当前已累积的奖励信息:

πθ(at∣st,raccumulated)\pi_\theta(a_t|s_t, r_{accumulated})πθ(at∣st,raccumulated)

其中raccumulatedr_{accumulated}raccumulated是截至当前轮次已获得的累积奖励。这种条件化机制帮助模型在多轮交互中形成更有效的策略。

上图展示了多轮交互场景下GRPO的工作流程。模型通过组采样探索多种可能的动作序列,根据最终验证结果计算相对优势,并据此更新策略。

5 RLVR的训练动态与涌现能力

5.1 训练过程中的相变现象

5.1.1 顿悟时刻的观察

DeepSeek-R1-Zero的训练过程揭示了一个引人入胜的现象——“顿悟时刻”(Aha Moment)[16]。在训练的某个阶段,模型突然展现出自我反思和验证的能力,即使这种能力从未被显式编程或监督学习。

具体观察到的行为包括:

自我修正(Self-Correction)。模型在推理过程中意识到之前的步骤可能存在错误,主动回溯并修正。例如:“等等,让我重新检查一下这个计算…”

多路径探索(Multi-path Exploration)。模型尝试不同的解题方法,比较各路径的可行性。例如:“另一种方法是…让我看看哪种更有效。”

验证与确认(Verification and Confirmation)。模型在得出最终答案前进行验证。例如:“为了验证这个结果,我可以…”

这些行为的出现并非渐进式,而是呈现出某种"相变"特征——在训练的特定阶段突然涌现。这与物理学中的相变现象类似,暗示着复杂系统中秩序从无序中自发产生的普遍规律[33]。

5.1.2 训练动态的理论解释

从优化角度理解,RLVR训练动态可以建模为策略在奖励景观中的探索过程。设策略空间为Θ\ThetaΘ,奖励函数R(θ)R(\theta)R(θ)定义了策略空间上的"景观"。训练过程就是寻找θ∗=argmaxθR(θ)\theta^* = \arg\max_\theta R(\theta)θ∗=argmaxθR(θ)。

早期训练阶段,策略随机初始化,采样到的输出大多不正确,奖励信号稀疏。此时策略主要在学习基本格式和输出结构。随着训练进行,策略偶尔采样到正确答案,这些"成功经历"被强化,策略开始向高奖励区域移动。

关键转折点发生在策略达到某个临界能力阈值后。此时,策略能够稳定地生成部分正确的推理步骤,即使最终答案仍可能出错。这些部分正确的步骤为进一步探索提供了"跳板",策略开始系统地探索推理空间的不同路径[34]。

数学上,可以建模为策略分布的演化过程。设第ttt次迭代时的策略为πθt\pi_{\theta_t}πθt,策略更新遵循:

πθt+1(o∣q)∝πθt(o∣q)⋅exp(ηA(o))\pi_{\theta_{t+1}}(o|q) \propto \pi_{\theta_t}(o|q) \cdot \exp(\eta A(o))πθt+1(o∣q)∝πθt(o∣q)⋅exp(ηA(o))

其中A(o)A(o)A(o)是输出ooo的优势。这种指数权重更新使得高优势输出的概率呈指数增长,最终主导策略分布。

5.2 长思维链的自发形成

5.2.1 长度增长的内在机制

RLVR训练中观察到的另一个显著现象是输出长度的持续增长。模型自发地生成越来越长的思维链,包含更多的中间推理步骤和自我反思。

这一现象的内在机制可以从奖励结构角度理解:

探索-利用权衡。较长的输出提供了更多的探索空间,模型可以尝试不同的推理路径。当某条路径被验证为正确时,整个长序列被强化,包括其中的探索性步骤。

错误恢复的价值。在复杂问题中,完全避免错误往往困难。长思维链允许模型在犯错后进行自我修正,这种"试错-修正"模式在某些情况下比追求一次性正确更有效。验证函数只关注最终答案,因此只要最终正确,中间的错误和修正都会被正向强化[5]。

计算作为资源。模型似乎学会了将生成长度作为一种"计算资源"来使用——通过生成更多token进行更深入的思考。这与人类解决复杂问题时的行为类似:更难的问题需要更多的思考时间[35]。

5.2.2 长度与质量的权衡

虽然长度增长通常伴随着性能提升,但过长的输出也带来了问题:

过度思考(Overthinking)。模型可能在已经找到正确答案后继续无意义的推理,浪费计算资源。研究表明,某些任务上模型的最优推理长度存在上限,超过后性能不再提升甚至下降[36]。

信号稀释。极长的输出中,真正有价值的推理步骤被大量冗余内容稀释,增加了学习难度。

推理效率。在实际应用中,过长的推理时间影响用户体验和系统吞吐量。

针对这些问题,研究者提出了多种解决方案:

长度惩罚。在奖励函数中加入长度惩罚项:Rpenalized=Roriginal−λ⋅Length(o)R_{penalized} = R_{original} - \lambda \cdot \text{Length}(o)Rpenalized=Roriginal−λ⋅Length(o)

动态长度控制。根据问题难度自适应调整允许的推理长度。简单问题限制短输出,复杂问题允许长输出[37]。

蒸馏与压缩。训练专门的模型将长思维链蒸馏为更紧凑的形式,保留关键推理步骤同时去除冗余[38]。

| 阶段 | 特征 | 输出长度 | 正确率 | 典型行为 |

|---|---|---|---|---|

| 早期 | 探索期 | 短 | 低 | 随机猜测,格式错误 |

| 中期 | 成长期 | 快速增长 | 快速提升 | 尝试推理步骤,偶尔正确 |

| 后期 | 成熟期 | 稳定或缓慢增长 | 高位稳定 | 系统推理,自我验证 |

| 过度 | 饱和期 | 过度增长 | 持平或下降 | 冗余思考,效率降低 |

上表总结了RLVR训练不同阶段的特征。理解这些阶段有助于设计更好的训练策略和早停机制。

5.3 样本极性的作用分析

5.3.1 正样本与负样本的差异化作用

RLVR训练中,模型同时接触到正样本(正确答案)和负样本(错误答案)。近期研究系统分析了这两种样本的不同作用[39]:

正样本的作用:

- 强化已有能力:正样本帮助模型巩固已经掌握的正确推理路径

- 降低熵:正样本的强化使策略分布更加集中,减少随机性

- 缩短输出:正样本往往对应更简洁的推理路径,训练后模型输出趋于精炼

负样本的作用:

- 促进探索:负样本的惩罚驱使策略远离已知的错误模式,探索新的推理路径

- 增加熵:对负样本的惩罚使策略分布更加分散,增加探索性

- 延长输出:为避开已知的错误路径,模型可能尝试更复杂的推理策略,导致输出变长

5.3.2 负向强化的 surprisingly effectiveness

传统观念认为,强化学习主要依赖正反馈(奖励)来塑造行为。然而,RLVR中的研究发现,负向强化(negative reinforcement)在推理任务中发挥着出人意料的重要作用[40]。

研究表明,仅使用负样本进行训练(即只惩罚错误答案,不奖励正确答案)仍然能够显著提升模型的Pass@K指标。这一现象的解释是:

排除法的价值。通过系统地排除错误选项,模型逐步缩小了正确答案的搜索空间。即使不直接知道什么是正确的,知道什么是错误的也有重要价值。

边界探索。负样本训练迫使策略探索那些"接近正确但又不完全正确"的区域,这些边界区域的探索有助于发现新的解题思路。

错误模式学习。分析负样本帮助模型学习常见的错误模式,从而在未来的推理中主动避免这些陷阱。

当然,最优的训练策略仍然是正负样本的结合。正样本提供明确的学习目标,负样本防止策略陷入局部最优,两者的协同作用实现了最佳的训练效果[41]。

上图展示了正负样本在RLVR训练中的差异化作用及协同效应。理解这些机制有助于设计更高效的采样策略和损失函数。

6 过程奖励与结果奖励的深入对比

6.1 结果奖励模型(ORM)

6.1.1 ORM的定义与形式化

结果奖励模型(Outcome Reward Model, ORM)是RLVR中最直接的奖励形式,仅根据最终答案的正确性提供反馈[42]。对于问题qqq和模型输出ooo,ORM的形式化定义为:

Routcome(q,o)=I(ypred=ytrue)R_{outcome}(q, o) = \mathbb{I}(y_{pred} = y_{true})Routcome(q,o)=I(ypred=ytrue)

其中ypredy_{pred}ypred是从输出ooo中提取的预测答案,ytruey_{true}ytrue是标准答案,I(⋅)\mathbb{I}(\cdot)I(⋅)是指示函数。

ORM的优势在于其简洁性和客观性:无需人工标注中间步骤,验证过程完全自动化,奖励信号不存在主观偏差。

6.1.2 ORM的局限性

尽管ORM在RLVR中取得了显著成功,但其局限性也不容忽视:

稀疏性。ORM只在最终答案正确时提供奖励,对于长推理链而言,这种稀疏信号使得信用分配(credit assignment)困难——模型难以确定哪些中间步骤对最终成功有贡献。

过程不可知性。ORM无法区分"正确的过程得出正确的答案"和"错误的过程侥幸得出正确答案"。后者实际上包含有害的训练信号,可能导致策略学习错误的推理模式[24]。

效率低下。由于奖励稀疏,模型需要大量采样才能获得足够的正向信号,降低了样本效率。

一个典型的例子是:某道数学题的正确答案是42。模型A通过正确的数学推导得出42,模型B通过错误的推导但巧合地得到42。ORM对两者给予相同的奖励,但模型B的推理过程实际上是有问题的。

6.2 过程奖励模型(PRM)

6.2.1 PRM的设计与实现

过程奖励模型(Process Reward Model, PRM)旨在解决ORM的过程不可知问题,通过对中间推理步骤进行评分来提供更细粒度的反馈[43]。

PRM的形式化定义为:

Rprocess=∑t=1Twt⋅Quality(st)R_{process} = \sum_{t=1}^{T} w_t \cdot \text{Quality}(s_t)Rprocess=t=1∑Twt⋅Quality(st)

其中sts_tst是第ttt个推理步骤,Quality(st)\text{Quality}(s_t)Quality(st)评估该步骤的质量,wtw_twt是权重因子。

PRM的实现方式主要有两种:

显式PRM。训练一个独立的神经网络作为步骤级评估器。该模型接收问题、已完成的推理步骤和候选下一步作为输入,输出该步骤的质量分数。训练数据通常需要人工标注或使用启发式方法自动生成[24]。

隐式PRM。不显式训练独立模型,而是通过其他机制隐式地评估步骤质量。例如,使用蒙特卡洛 rollout 估计从当前步骤到达正确答案的概率:

Quality(st)=E[Routcome∣st]\text{Quality}(s_t) = \mathbb{E}[R_{outcome}|s_t]Quality(st)=E[Routcome∣st]

即从步骤sts_tst开始,按照当前策略进行多次采样,统计最终成功的比例[43]。

6.2.2 PRM800k与自动标注

OpenAI的PRM800k数据集是过程奖励研究的重要里程碑。该数据集包含80万个人工标注的数学问题推理步骤,每个步骤被标记为"正确"、“错误"或"不确定”[24]。

然而,大规模人工标注成本高昂。研究者开发了多种自动标注方法:

Math-Shepherd方法。使用蒙特卡洛估计自动标注步骤质量:对于每个候选步骤,进行多次随机rollout,根据最终成功率估计该步骤的价值[43]。

对比学习方法。利用正负样本的对比学习训练PRM。正确的推理路径作为正例,错误路径作为负例,模型学习区分两者[44]。

自举方法。使用当前策略生成大量推理路径,通过结果验证筛选出高质量路径,再用这些路径训练PRM,迭代优化[45]。

6.3 ORM与PRM的综合比较

| 维度 | ORM | PRM |

|---|---|---|

| 奖励粒度 | 粗粒度(仅最终结果) | 细粒度(每步评估) |

| 标注成本 | 低(自动验证) | 高(需步骤标注) |

| 信用分配 | 困难 | 相对容易 |

| 训练稳定性 | 较低(稀疏奖励) | 较高(密集奖励) |

| 奖励黑客风险 | 较低 | 较高(PRM可能被利用) |

| 计算开销 | 低 | 高(需PRM推理) |

| 典型应用 | DeepSeek-R1, Kimi K1.5 | OpenAI o1, 部分研究 |

上表全面比较了ORM和PRM的优劣。值得注意的是,DeepSeek-R1采用了纯ORM策略仍取得了卓越性能,这表明在适当的训练设置下,ORM的局限性可以被部分克服[16]。

6.4 混合奖励策略

6.4.1 结合ORM与PRM

考虑到ORM和PRM各自的优缺点,研究者探索了多种混合策略:

阶段性混合。训练早期使用PRM提供密集信号帮助学习,后期切换到ORM进行精细优化。

加权组合。综合两种奖励:Rhybrid=αRoutcome+(1−α)RprocessR_{hybrid} = \alpha R_{outcome} + (1-\alpha)R_{process}Rhybrid=αRoutcome+(1−α)Rprocess

条件应用。根据问题难度动态选择奖励类型:简单问题使用ORM,复杂问题使用PRM[46]。

6.4.2 元推理奖励

更前沿的研究探索了元推理奖励(Meta-Reasoning Rewards),不仅评估推理步骤的正确性,还评估推理过程的"质量",如:

- 是否进行了有效的规划

- 是否识别并纠正了错误

- 是否使用了适当的验证策略

RLVMR(RL with Verifiable Meta-Reasoning Rewards)框架将元推理行为显式标签化(如"规划"、“探索”、“反思”),并为这些行为提供可验证的奖励[47]。这种方法在ALFWorld和ScienceWorld等长程任务基准上取得了新的最优结果。

上图展示了从ORM到PRM再到元推理奖励的演进谱系。每种奖励类型都有其适用场景,实际应用中需要根据任务特性进行选择。

7 测试时缩放与推理能力扩展

7.1 测试时缩放的基本原理

7.1.1 从训练时缩放到测试时缩放

大模型能力扩展的传统范式是训练时缩放(Train-Time Scaling)——通过增加模型参数、训练数据和计算资源来提升能力。然而,这种范式面临边际收益递减和成本激增的挑战[1]。

**测试时缩放(Test-Time Scaling, TTS)**提供了一种替代路径:保持模型参数不变,在推理阶段分配更多计算资源来提升性能。其核心洞察是,额外的推理计算可以部分补偿模型规模的限制[19]。

TTS的主要形式包括:

序列缩放(Sequential Scaling)。允许模型生成更长的推理链,通过"思考更长时间"来提升复杂问题的解决能力。这是DeepSeek-R1等推理模型的核心机制[16]。

并行缩放(Parallel Scaling)。采样多个独立推理路径,通过投票或选择机制聚合结果。常见方法包括Self-Consistency、Best-of-N等[48]。

搜索缩放(Search Scaling)。使用树搜索、束搜索等算法系统性地探索推理空间,如Monte Carlo Tree Search (MCTS)、Beam Search等[49]。

7.1.2 计算-性能权衡曲线

TTS的核心问题是理解计算资源与性能提升之间的关系。研究表明,这种关系遵循幂律(Power Law)特征:

Performance=a⋅(Compute)b+c\text{Performance} = a \cdot (\text{Compute})^b + cPerformance=a⋅(Compute)b+c

其中b∈(0,1)b \in (0, 1)b∈(0,1)是扩展系数,决定了额外计算的边际收益[19]。

不同类型的任务表现出不同的扩展特性:

- 高可扩展任务:数学推理、代码生成等,性能随计算增加持续提升

- 低可扩展任务:常识推理、语言理解等,性能快速提升后饱和

- 不可扩展任务:知识检索、简单分类等,额外计算几乎无帮助

上图示意了不同类型任务的TTS曲线。高可扩展任务(上曲线)从额外计算中获益最多,低可扩展任务(下曲线)很快达到性能上限。

7.2 长思维链的测试时扩展

7.2.1 长度控制机制

推理模型如DeepSeek-R1通过生成极长的思维链(可达数万token)来实现测试时扩展。有效的长度控制机制至关重要:

预算强制(Budget Forcing)。在推理时强制指定最大生成长度。当模型达到长度限制时,必须输出最终答案。这种方法简单直接,但可能导致模型在思考不充分时被迫作答[35]。

自适应长度。模型根据问题难度自动决定推理长度。这可以通过在训练时引入长度相关的奖励来实现,或者在推理时使用特殊的控制token(如<|end_of_thinking|>)让模型自主决定何时结束思考[50]。

思考速度控制。CoLaR等方法引入了"思考速度"参数,通过压缩或扩展隐状态来控制推理步数。较高的思考速度意味着更少的推理步骤但更快速的思考,较低的速度允许更深入的推理[51]。

7.2.2 推理效率优化

长思维链带来了显著的计算开销,优化推理效率成为实际部署的关键:

投机解码(Speculative Decoding)。使用小模型快速生成候选token,大模型进行验证和修正。这种方法可以显著加速推理,特别是在长序列生成场景[52]。

提前终止。训练一个"终止预测器",在推理过程中评估当前思考是否充分,如果预测继续思考不会带来显著收益,则提前终止并输出答案[53]。

级联推理。使用简单模型首先尝试快速解决问题,只有在失败时才调用复杂的长思维链模型。这种级联策略在保持整体性能的同时降低了平均推理成本[36]。

7.3 并行测试时缩放

7.3.1 Best-of-N与Self-Consistency

并行TTS通过采样多个独立推理路径并聚合结果来提升性能:

Best-of-N。对于给定问题,采样NNN个独立答案,使用验证器或奖励模型选择最佳答案。在RLVR场景下,可以直接使用可验证奖励进行选择:

yfinal=argmaxyi∈{y1,...,yN}R(q,yi)y_{final} = \arg\max_{y_i \in \{y_1, ..., y_N\}} R(q, y_i)yfinal=argyi∈{y1,...,yN}maxR(q,yi)

Self-Consistency(多数投票)。对于选择题或具有标准格式的答案,采用多数投票机制:

yfinal=mode({y1,...,yN})y_{final} = \text{mode}(\{y_1, ..., y_N\})yfinal=mode({y1,...,yN})

研究表明,Best-of-N在RLVR场景下特别有效,因为可验证奖励提供了明确的选择标准[54]。

7.3.2 树搜索与过程奖励引导

对于复杂的多步推理,简单的并行采样可能效率低下。树搜索方法通过过程奖励引导搜索方向:

Beam Search。在每一步保留得分最高的kkk个候选,继续扩展。过程奖励模型为每个候选步骤评分,指导搜索方向[55]。

MCTS(蒙特卡洛树搜索)。构建搜索树,通过选择、扩展、模拟、回溯四个步骤迭代优化。每个节点的价值通过从该节点开始的随机rollout估计[56]。

过程奖励引导。使用PRM为中间步骤评分,优先扩展高分路径,避免在错误的推理方向上浪费计算[49]。

| 方法 | 机制 | 适用场景 | 计算效率 | 性能提升 |

|---|---|---|---|---|

| 序列缩放 | 延长推理链 | 复杂推理 | 低 | 高 |

| Best-of-N | 并行采样+选择 | 可验证任务 | 中 | 中 |

| Self-Consistency | 多数投票 | 有标准答案 | 中 | 中 |

| Beam Search | 束搜索+PRM | 多步推理 | 中 | 高 |

| MCTS | 树搜索 | 复杂决策 | 低 | 高 |

上表比较了不同TTS方法的特点。实际应用中,这些方法可以组合使用,例如先用序列缩放生成高质量的单路径推理,再用Best-of-N进行结果选择。

7.4 隐式推理与连续思维链

7.4.1 从显式到隐式推理

传统思维链以自然语言token的形式显式表达,每个推理步骤都是可读的文本。近期研究探索了隐式推理(Implicit Reasoning)——在连续的隐状态空间中进行推理,而非显式生成token[50]。

CoCoNut(Chain of Continuous Thought)等方法让模型在transformer的隐层状态中进行多步"思考",只有当思考完成时才生成最终的显式输出。这种方法的优势包括:

效率提升。隐状态推理避免了生成大量中间token,显著减少了推理时间和内存占用。

表达能力。连续空间可能比离散token空间更适合表达某些抽象概念和关系。

与人类直觉的类比。人类的快速直觉思考往往不经过显式的语言化,隐式推理更接近这种思维模式[50]。

7.4.2 隐式推理的测试时缩放

将TTS扩展到隐式推理场景面临独特挑战:

采样困难。隐状态空间缺乏显式的概率分布,传统的top-k、nucleus sampling等方法无法直接应用。

聚合困难。隐状态没有可比较的概率分数,Best-of-N等聚合策略难以实施。

针对这些挑战,研究者提出了创新解决方案:

不确定性引导采样。使用Monte Carlo Dropout或添加高斯噪声引入随机性,实现隐状态空间的探索[51]。

隐式奖励模型(LatentRM)。训练专门的模型评估隐状态质量,为聚合提供依据。LatentRM通过对比学习训练,学习区分好的和坏的隐状态表示[51]。

上图对比了显式思维链和隐式思维链的工作流程。隐式CoT通过压缩中间token生成,有望实现更高效的推理。

8 RLVR的挑战与未来方向

8.1 当前面临的主要挑战

8.1.1 奖励设计的困境

RLVR的核心挑战之一是奖励设计的根本困境。理想的奖励函数应该:

- 可验证性:能够自动、准确地评估

- 完整性:覆盖所有重要的性能维度

- 稀疏性适中:既不能太稀疏(学习困难),也不能太密集(容易被利用)

然而,这些目标往往相互矛盾。可验证的奖励通常局限于最终结果,难以捕捉推理过程的质量;而过程级的奖励又需要昂贵的标注或容易出错的自动估计[57]。

**奖励黑客(Reward Hacking)**是另一个严峻问题。模型可能找到意想不到的方式获取高奖励,而这些方式并不符合设计者的真实意图。例如,模型可能学会生成符合格式要求但内容无意义的输出,或者利用验证器的漏洞产生虚假的正确答案[9]。

8.1.2 泛化能力的局限

RLVR训练的模型在分布内(in-distribution)任务上表现出色,但在分布外(out-of-distribution)任务上的泛化能力存在局限:

领域特异性。在数学数据上训练的模型难以直接迁移到代码生成任务,反之亦然。每个领域似乎需要专门的RLVR训练[14]。

难度泛化。模型在训练时见过的难度级别上表现良好,但对于明显更简单或更复杂的问题可能表现不佳。例如,经过高难度数学问题训练的模型可能在基础算术上反而出错。

格式依赖。模型对训练时的输出格式产生依赖,当输入或输出格式发生变化时性能可能显著下降[58]。

8.1.3 计算资源与效率

RLVR训练需要大量的计算资源:

采样开销。每个训练步骤需要采样多个输出(GRPO中的GGG个),这增加了前向传播的计算量。

验证成本。虽然可验证奖励避免了人工标注,但某些验证过程(如执行代码测试用例)本身计算成本高昂。

训练稳定性。RL训练的不稳定性可能导致需要多次重启或更长的收敛时间,进一步增加了计算开销[59]。

8.2 扩展RLVR到开放式任务

8.2.1 可验证性的边界

RLVR目前最成功的应用都局限于具有明确正确性标准的任务。扩展到开放式任务(如创意写作、开放式问答)面临根本性挑战——这些任务缺乏客观的评价标准[14]。

研究者正在探索多种路径来突破这一限制:

VMR-RLVR(Verifiable Multiple-Choice Reformulation)。将开放式任务重构为可验证的多项选择格式。例如,创意写作任务可以转化为"从多个候选中选择最佳续写"的形式[14]。

Rubrics as Rewards(RaR)。使用结构化的评分标准(rubrics)作为奖励信号。虽然rubrics仍需要LLM-as-a-judge进行评估,但结构化的标准比直接打分更可靠、更可解释[60]。

自一致性验证。对于某些任务,可以通过检查输出的内部一致性来提供部分验证信号。例如,检查故事的情节是否前后一致、角色的行为是否符合设定等[61]。

8.2.2 混合奖励范式

未来的发展方向可能是混合奖励范式,结合RLVR的客观性和RLHF的灵活性:

分层奖励。底层使用RLVR的客观奖励确保基本正确性,上层使用RLHF的偏好奖励优化风格和表达。

条件奖励。根据任务类型动态选择奖励机制:可验证任务使用RLVR,开放式任务使用RLHF或RaR。

元学习奖励。训练模型学习如何组合不同的奖励信号,根据当前任务特性自适应地调整奖励权重[62]。

8.3 算法层面的创新方向

8.3.1 更高效的策略优化

GRPO虽然比PPO更高效,但仍有改进空间:

自适应组大小。根据问题难度动态调整GGG的大小。简单问题使用较小的GGG节省计算,复杂问题使用较大的GGG获得更稳定的优势估计。

分层GRPO。对于多步推理任务,在不同推理层次应用GRPO。局部优化单步决策,全局优化整体路径[32]。

方差缩减技术。进一步改进基线估计,如使用控制变量法、对偶估计等技术降低策略梯度的方差。

8.3.2 离线RLVR

当前RLVR主要采用在线策略(on-policy)训练,需要实时采样和更新。探索离线RLVR(offline RLVR)有重要价值:

利用历史数据。使用预先收集的推理轨迹进行训练,无需实时交互。

安全约束。离线训练避免了在线探索可能产生的有害输出。

效率提升。离线算法通常具有更好的样本效率,可以从固定数据集中提取更多信息[63]。

8.4 多模态与具身智能

8.4.1 视觉-语言推理

将RLVR扩展到视觉-语言任务是一个活跃的研究方向:

Chart-RVR。在图表理解任务中应用RLVR,通过可验证的奖励(如图表类型分类正确性、数据表重建准确性)训练视觉-语言模型[64]。

视觉推理。在需要视觉感知的推理任务中(如几何问题、视觉谜题),设计能够验证视觉理解和推理过程的奖励函数。

多模态一致性。奖励模型输出在不同模态间的一致性,如生成的描述是否与图像内容匹配[65]。

8.4.2 具身智能与机器人

RLVR在具身智能领域的应用前景广阔:

任务完成验证。机器人任务的最终状态往往可以客观验证(如物体是否被正确放置、目标是否达成)。

动作序列优化。使用RLVR优化机器人的动作序列,可验证奖励基于任务完成度和执行效率。

安全约束。将安全规则编码为可验证的约束条件,违反约束的动作获得负奖励[47]。

8.5 理论理解的深化

8.5.1 涌现能力的理论解释

RLVR训练中观察到的涌现能力(如自我反思、长思维链)缺乏系统的理论解释。未来的研究需要回答:

- 这些能力是真正"涌现"的,还是只是预训练能力的重新组合?

- 涌现的临界条件是什么?与模型规模、数据质量、训练设置的关系如何?

- 能否预测哪些能力会在训练中涌现?[33]

8.5.2 优化景观分析

理解RLVR的优化景观有助于设计更好的算法:

局部最优。RLVR训练是否容易陷入局部最优?如何设计算法帮助逃脱局部最优?

平坦性与泛化。优化景观的平坦区域是否与更好的泛化性能相关?

相变现象。训练中观察到的"顿悟时刻"是否对应优化景观中的相变?[66]

上图总结了RLVR的未来发展方向。算法创新、应用扩展和理论深化三个维度相互促进,共同推动RLVR技术的进步。

8.6 结论

8.6.1 RLVR的核心价值

可验证奖励强化学习(RLVR)代表了大模型后训练范式的重要演进。通过利用客观、可程序化验证的奖励信号,RLVR克服了传统RLHF在成本、可扩展性和客观性方面的局限,为构建可靠的推理模型提供了有效路径[3]。

RLVR的核心价值体现在:

可靠性。基于客观验证的奖励确保了模型性能提升反映真实能力增长,而非对主观评价标准的迎合。

可扩展性。自动化的验证机制使RLVR能够利用海量数据进行训练,不受人工标注规模的限制。

涌现性。在适当的条件下,RLVR能够激发模型自发形成复杂的推理策略,包括自我反思、多路径探索等元认知能力。

8.6.2 对AI发展的深远影响

RLVR的兴起对人工智能领域具有深远影响:

训练范式的转变。从"更大规模的预训练"向"更高效的后训练"转变,强调激发已有能力而非单纯增加参数。

推理即计算。确立了"推理时间可以作为计算资源进行缩放"的新范式,为资源受限场景下的性能优化提供了新思路。

可解释性的提升。长思维链的生成使模型的推理过程更加透明,有助于理解和信任AI系统的决策[67]。

8.6.3 展望

RLVR仍处于快速发展阶段,未来有望在以下方面取得突破:

更广泛的适用性。通过VMR-RLVR、RaR等创新方法,将RLVR扩展到更多类型的任务,包括开放式生成任务。

更深度的理论理解。建立RLVR训练动态和涌现能力的系统理论,指导算法设计和超参数选择。

更高效的算法。开发计算效率更高、训练更稳定的RLVR算法,降低研究和应用门槛。

更多模态的融合。将RLVR成功应用于视觉、音频、机器人等多模态场景,构建更通用的智能系统[14]。

RLVR的发展展示了强化学习在释放大模型潜能方面的巨大价值。随着算法的不断完善和应用领域的持续扩展,RLVR有望成为构建可靠、可解释、高效的人工智能系统的关键技术之一。

参考文献

[1] Hoffmann J, Borgeaud S, Mensch A, et al. Training compute-optimal large language models[J]. arXiv preprint arXiv:2203.15556, 2022.

[2] OpenAI. Learning to reason with LLMs[EB/OL]. https://openai.com/index/learning-to-reason-with-llms/, 2024.

[3] Lambert N, Morrison J, Pyatkin V, et al. RewardBench: Evaluating reward models for language modeling[J]. arXiv preprint arXiv:2403.13787, 2024.

[4] Shao Z, Wang P, Zhu Q, et al. DeepSeekMath: Pushing the limits of mathematical reasoning in open language models[J]. arXiv preprint arXiv:2402.03300, 2024.

[5] Yeo J, Choi J, Oh M, et al. Can large language models reason about long chain-of-thought?[J]. arXiv preprint arXiv:2502.09671, 2025.

[6] Ouyang L, Wu J, Jiang X, et al. Training language models to follow instructions with human feedback[J]. Advances in Neural Information Processing Systems, 2022, 35: 27730-27744.

[7] Ziegler D M, Stiennon N, Wu J, et al. Fine-tuning language models from human preferences[J]. arXiv preprint arXiv:1909.08593, 2019.

[8] Schulman J, Wolski F, Dhariwal P, et al. Proximal policy optimization algorithms[J]. arXiv preprint arXiv:1707.06347, 2017.

[9] Gao L, Schulman J, Hilton J. Scaling laws for reward model overoptimization[C]//International Conference on Machine Learning. PMLR, 2023: 10835-10866.

[10] Casper S, Davies X, Shi C, et al. Open problems and fundamental limitations of reinforcement learning from human feedback[J]. arXiv preprint arXiv:2307.15217, 2023.

[11] Liu Z, Lu M, Wang S, et al. Why think step-by-step? Reasoning emerges from the locality of experience[J]. Advances in Neural Information Processing Systems, 2024, 36.

[12] Zelikman E, Wu Y, Mu J, et al. STaR: Bootstrapping reasoning with reasoning[J]. Advances in Neural Information Processing Systems, 2022, 35: 15476-15488.

[13] Guo D, Zhu Q, Yang D, et al. DeepSeek-Coder: When the large language model meets programming–the rise of code intelligence[J]. arXiv preprint arXiv:2401.14196, 2024.

[14] Zhang Y, Zhang F, Yang Z, et al. Extending RLVR to open-ended tasks via verifiable multiple-choice reformulation[J]. arXiv preprint arXiv:2511.02463, 2025.

[15] Hu Y, Shi W, Fu X, et al. RLVR in the wild: Learning from incomplete and noisy preferences[J]. arXiv preprint arXiv:2507.17746, 2025.

[16] Guo D, Yang D, Zhang H, et al. DeepSeek-R1: Incentivizing reasoning capability in LLMs via reinforcement learning[J]. arXiv preprint arXiv:2501.12948, 2025.

[17] Zhang Z, Mao A, Liu H, et al. Shrinkage baselines for reinforcement learning with verifiable rewards[J]. arXiv preprint arXiv:2511.03710, 2025.

[18] Kaplan J, McCandlish S, Henighan T, et al. Scaling laws for neural language models[J]. arXiv preprint arXiv:2001.08361, 2020.

[19] Snell C, Lee J, Xu K, et al. Scaling LLM test-time compute optimally can be more effective than scaling model parameters[J]. arXiv preprint arXiv:2408.03314, 2024.

[20] Sutton R S, Barto A G. Reinforcement learning: An introduction[M]. MIT press, 2018.

[21] Sutton R S, McAllester D, Singh S, et al. Policy gradient methods for reinforcement learning with function approximation[C]//Advances in Neural Information Processing Systems. 1999: 1057-1063.

[22] Weaver L, Tao N. The optimal reward baseline for gradient-based reinforcement learning[C]//Proceedings of the Seventeenth Conference on Uncertainty in Artificial Intelligence. 2001: 538-545.

[23] Eisenstein J, Nagpal C, Agarwal A, et al. Helping or herding? Reward model ensembles mitigate but do not eliminate reward hacking[J]. arXiv preprint arXiv:2312.09244, 2023.

[24] Lightman H, Kosaraju V, Burda Y, et al. Let’s verify step by step[J]. arXiv preprint arXiv:2305.20050, 2023.

[25] Schulman J, Levine S, Abbeel P, et al. Trust region policy optimization[C]//International Conference on Machine Learning. PMLR, 2015: 1889-1897.

[26] Liu Y, Zhang Y, Li H, et al. Rethinking KL regularization in RLHF: From value estimation to gradient optimization[J]. arXiv preprint arXiv:2510.01555, 2025.

[27] Asadi A, Aminian G. Theoretical analysis of KL-regularized RLHF with multiple reference models[J]. arXiv preprint arXiv:2502.01203, 2025.

[28] Liu Z, Mao A, Shao Z, et al. Understanding the Uncertainty of LLM Explanifications in Mathematical Reasoning[J]. arXiv preprint arXiv:2505.04607, 2025.

[29] Wang Y, Zhang H, Xu Z, et al. RLVR: A theoretical perspective on rule-based reinforcement learning for reasoning[J]. arXiv preprint arXiv:2507.21836, 2025.

[30] James W, Stein C. Estimation with quadratic loss[C]//Proceedings of the Fourth Berkeley Symposium on Mathematical Statistics and Probability. 1961: 361-379.

[31] Chen X, Zhang J, Li Y, et al. Scaf-GRPO: Scaffolded group relative policy optimization for enhancing LLM reasoning[J]. arXiv preprint arXiv:2510.19807, 2025.

[32] Wang H, Xiao Z, Liu Y, et al. RC-GRPO: Reward-conditioned group relative policy optimization for multi-turn tool calling agents[J]. arXiv preprint arXiv:2602.03025, 2025.

[33] Wei J, Tay Y, Bommasani R, et al. Emergent abilities of large language models[J]. arXiv preprint arXiv:2206.07682, 2022.

[34] Wen X, Liu Z, Zheng S, et al. Reinforcement learning with verifiable rewards implicitly incentivizes correct reasoning in base LLMs[J]. arXiv preprint arXiv:2506.14245, 2025.

[35] Muennighoff N, Yang Z, Shi W, et al. s1: Simple test-time scaling[J]. arXiv preprint arXiv:2501.19393, 2025.

[36] Chen J, Pan Y, Yao J, et al. Stop overthinking: A survey on efficient reasoning for large language models[J]. arXiv preprint arXiv:2503.16419, 2025.

[37] Team K. Kimi K1.5: Scaling reinforcement learning with LLMs[J]. arXiv preprint arXiv:2501.12599, 2025.

[38] Hsieh C P, Sun S, Kriman S, et al. RULER: What’s the real context size of your long-context language models?[J]. arXiv preprint arXiv:2404.06654, 2024.

[39] Zhang Y, Li Y, Zhang C, et al. Rethinking sample polarity in reinforcement learning with verifiable rewards[J]. arXiv preprint arXiv:2512.21625, 2025.

[40] Wang H, Xiao Z, Liu Y, et al. The surprising effectiveness of negative reinforcement in LLM reasoning[J]. arXiv preprint arXiv:2506.01347, 2025.

[41] Liu Y, Zhang C, Gao Y, et al. PSRNSR: Positive and negative sample reinforcement for LLM reasoning[J]. arXiv preprint arXiv:2507.23317, 2025.

[42] Uesato J, Kushman N, Kumar R, et al. Solving math word problems with process-and outcome-based feedback[J]. arXiv preprint arXiv:2211.14275, 2022.

[43] Wang P, Li L, Shao Z, et al. Math-Shepherd: Verify and reinforce LLMs step-by-step without human annotations[C]//Proceedings of the 62nd Annual Meeting of the Association for Computational Linguistics. 2024: 9426-9439.

[44] Zhang Y, Chen X, Liu J, et al. Step-level value preference optimization for mathematical reasoning[J]. arXiv preprint arXiv:2501.03255, 2025.

[45] Setlur A, Garg S, Geng X, et al. RL on incorrect synthetic data scales the efficiency of LLM math inference by eight-fold[J]. arXiv preprint arXiv:2501.04584, 2025.

[46] Liu X, Zhang X, Zhang Y, et al. Beyond correctness: Harmonizing process and outcome rewards through RL training[J]. arXiv preprint arXiv:2509.03403, 2025.

[47] Zhang Z, Liu Y, Shun Z, et al. RLVMR: Reinforcement learning with verifiable meta-reasoning rewards for robust long-horizon agents[J]. arXiv preprint arXiv:2507.22844, 2025.

[48] Wang X, Wei J, Schuurmans D, et al. Self-consistency improves chain of thought reasoning in language models[C]//International Conference on Learning Representations. 2023.

[49] Yao S, Yu D, Zhao J, et al. Tree of thoughts: Deliberate problem solving with large language models[J]. Advances in Neural Information Processing Systems, 2024, 36.

[50] Hao S, Sukhbaatar S, Su D, et al. Training large language models to reason in a continuous latent space[J]. arXiv preprint arXiv:2412.06769, 2024.

[51] You R, Li Y, Liu M, et al. Parallel test-time scaling for latent reasoning models[J]. arXiv preprint arXiv:2510.07745, 2025.

[52] Leviathan Y, Kalman M, Matias Y. Fast inference from transformers via speculative decoding[C]//International Conference on Machine Learning. PMLR, 2023: 19274-19286.

[53] Liu T, Zhang Y, Bogatskiy A, et al. Reasoning with language model is planning with world model[J]. arXiv preprint arXiv:2310.16427, 2023.

[54] Cobbe K, Kosaraju V, Bavarian M, et al. Training verifiers to solve math word problems[J]. arXiv preprint arXiv:2110.14168, 2021.

[55] Xie Y, Goyal A, Zheng W, et al. Monte Carlo tree search with value networks for combinatorial optimization[J]. arXiv preprint arXiv:2310.00142, 2023.

[56] Silver D, Hubert T, Schrittwieser J, et al. A general reinforcement learning algorithm that masters chess, shogi, and Go through self-play[J]. Science, 2018, 362(6419): 1140-1144.

[57] Skalse J, Howe N H, Krasheninnikov D, et al. Defining and characterizing reward gaming[J]. Advances in Neural Information Processing Systems, 2022, 35: 9460-9471.

[58] Zhou Y, Cui P, Shi J, et al. Isbert: Explanation-based training for out-of-distribution detection[J]. arXiv preprint arXiv:2402.11453, 2024.

[59] Engstrom L, Ilyas A, Santurkar S, et al. Implementation matters in deep RL: A case study on PPO and TRPO[C]//International Conference on Learning Representations. 2020.

[60] Gunjal A, Datta S, He L, et al. Rubrics as rewards: Reinforcement learning beyond verifiable domains[J]. arXiv preprint arXiv:2507.17746, 2025.

[61] Welleck S, Lu X, West P, et al. Generating sequences by learning to self-correct[J]. arXiv preprint arXiv:2211.00053, 2022.

[62] Kurenkov V, Shah R, Creager E, et al. RL with KL penalties is better viewed as Bayesian inference[J]. arXiv preprint arXiv:2402.03920, 2024.

[63] Fujimoto S, Meger D, Precup D. Off-policy deep reinforcement learning without exploration[C]//International Conference on Machine Learning. PMLR, 2019: 2052-2062.

[64] Sinha S, Frunza O, Rasul K, et al. Chart-RVR: Reinforcement learning with verifiable rewards for explainable chart reasoning[J]. arXiv preprint arXiv:2510.10973, 2025.

[65] Li B, Wang R, Liu Y, et al. Multimodal reward shaping for visual-language models[J]. arXiv preprint arXiv:2502.04463, 2025.

[66] Fort S. Scaling laws for reward model overoptimization in deep reinforcement learning[J]. arXiv preprint arXiv:2406.14393, 2024.

[67] Turpin M, Michael J, Perez E, et al. Language models don’t always say what they think: Unfaithful explanations in chain-of-thought prompting[J]. Advances in Neural Information Processing Systems, 2024, 36.

更多推荐

已为社区贡献39条内容

已为社区贡献39条内容

所有评论(0)