基于YOLO26的学生课堂行为检测系统(中英文双版) | 附完整源码与效果演示

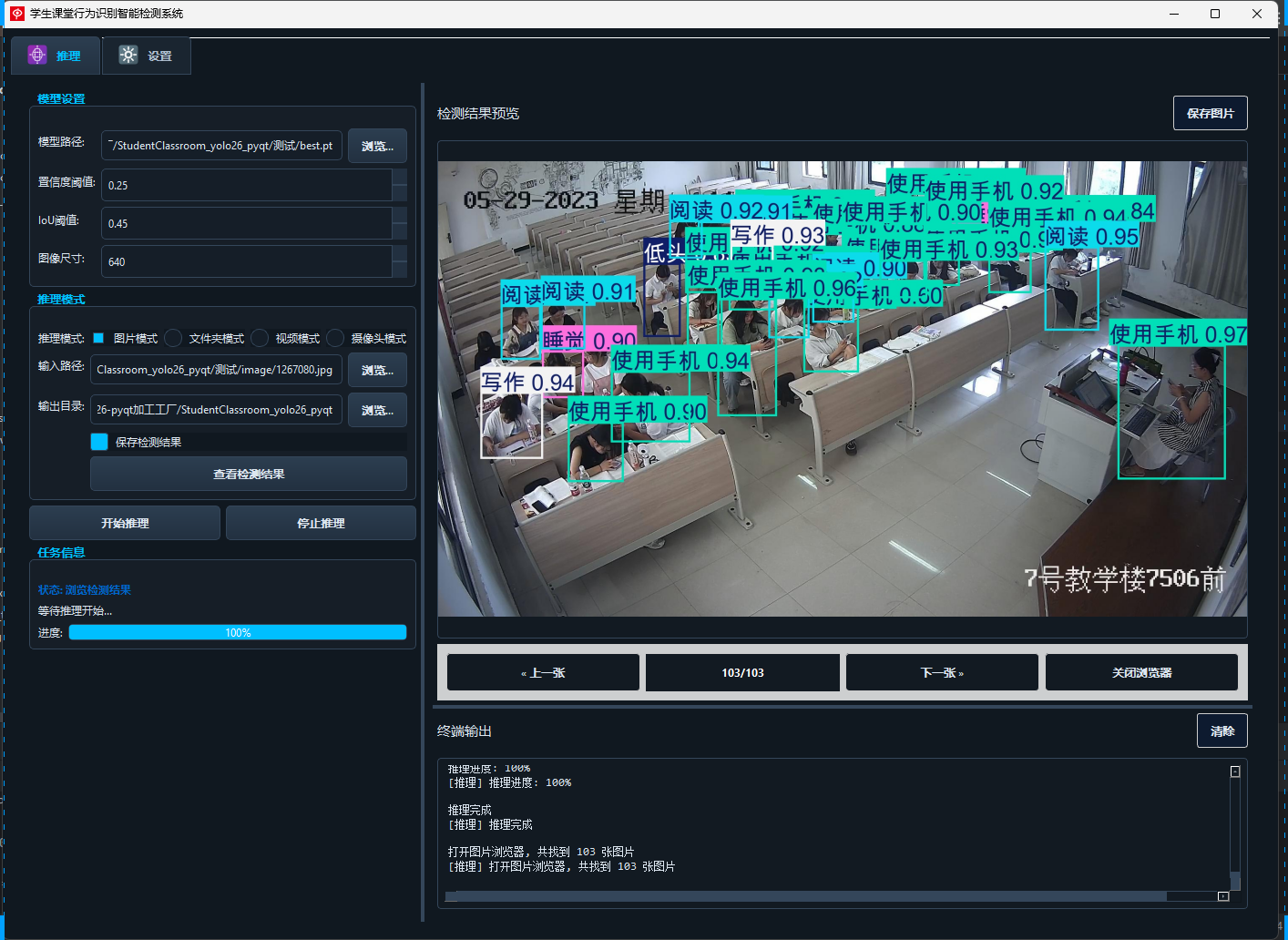

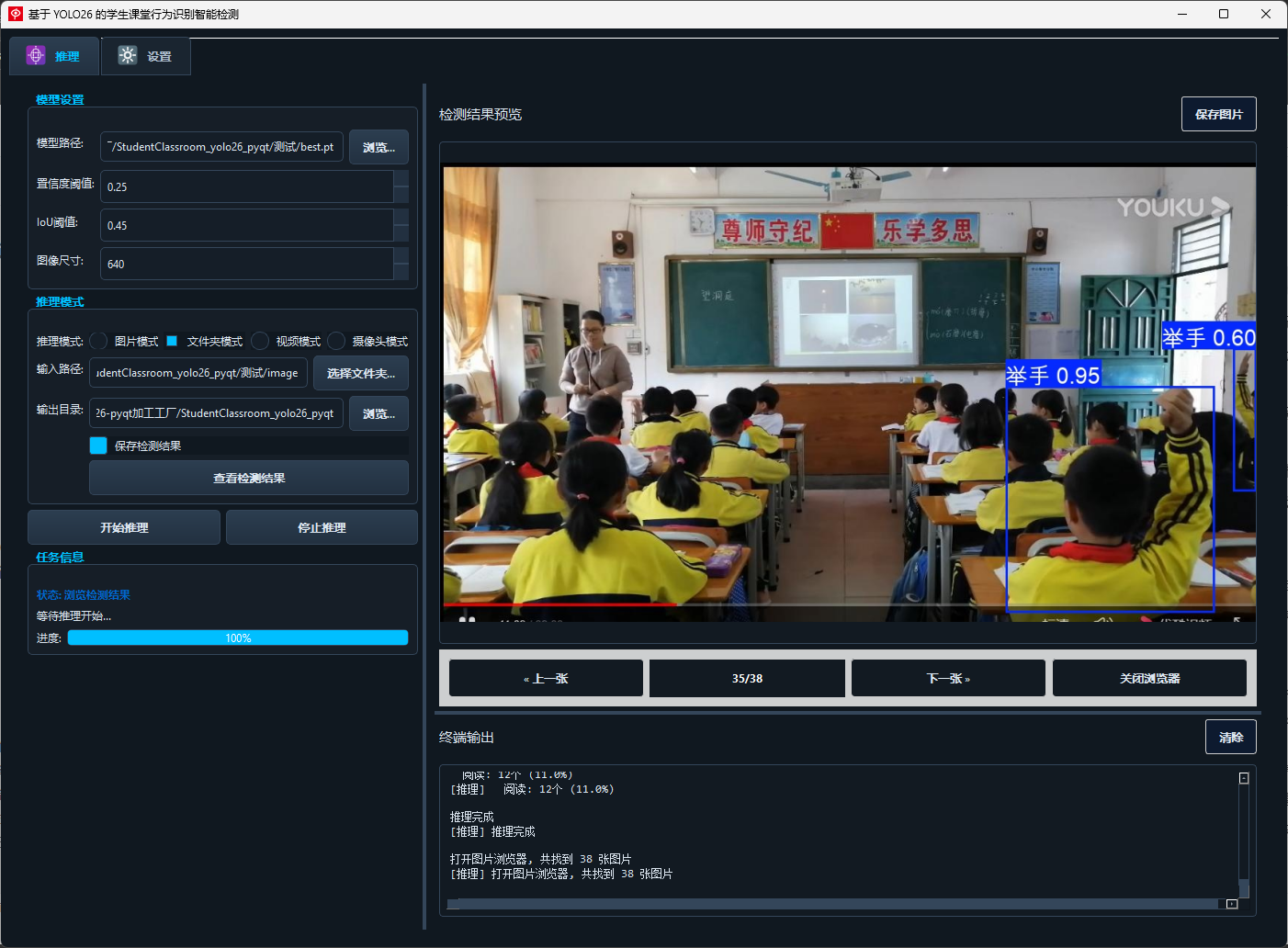

本文介绍了一个基于YOLO26和PyQt5的学生课堂行为智能检测系统。该系统可实时识别6种典型课堂行为(举手、阅读、写作、使用手机、低头、睡觉),具备图片/视频/摄像头多源输入能力。系统采用模块化设计,包含界面层、核心层和数据层,支持模型训练、评估及数据格式转换。技术亮点包括多线程架构、主题切换和快捷键操作。应用场景覆盖智慧教室监控、教学评估和课堂管理,具有较高的工程实用性和扩展潜力。项目提供完整

基于YOLO26的学生课堂行为检测系统(中英文双版可切换) | 附完整源码与效果演示

本项目是一个基于 PyQt5 + YOLO28 的学生课堂行为检测系统,专为教育场景设计。系统能够实时识别学生在课堂上的6种典型行为状态,帮助教师了解课堂参与情况,提升教学管理效率。

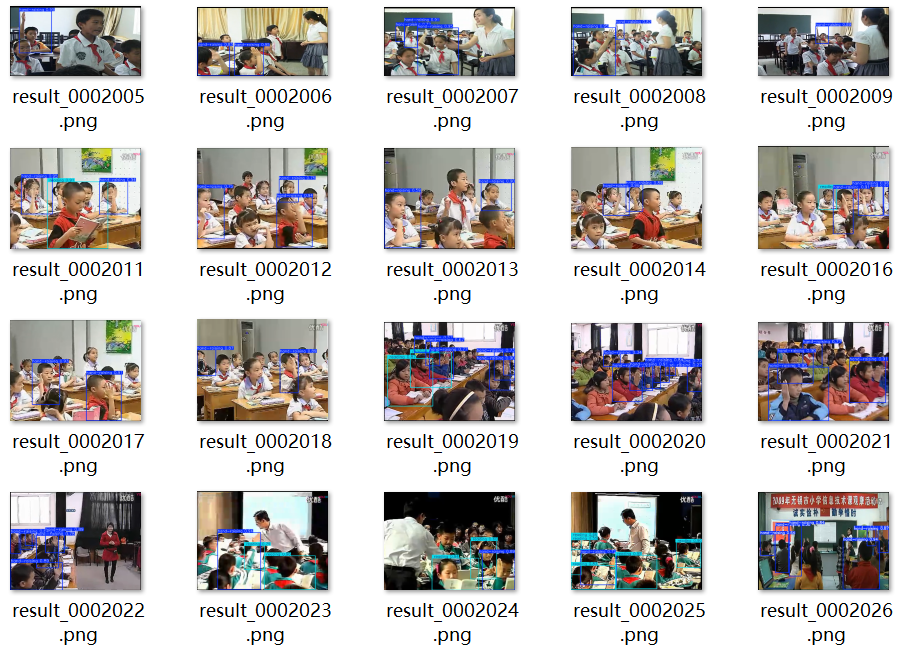

📸 效果演示(可在后台配置中文/英文显示)

视频演示与源码获取

哔哩哔哩视频下方观看:

https://www.bilibili.com/video/BV1PNfnB2E1t

包含:

📦完整项目源码

📦预训练模型权重

🗂️数据集

一、项目简介

本项目是一个基于 PyQt5 + YOLO26 的学生课堂行为检测系统,专为教育场景设计。系统能够实时识别学生在课堂上的6种典型行为状态,帮助教师了解课堂参与情况,提升教学管理效率。

核心功能

| 功能模块 | 说明 |

|---|---|

| 🎯 实时检测 | 支持图片、视频、摄像头输入,实时识别学生行为 |

| 🏋️ 模型训练 | 支持自定义数据集训练,适配不同教室环境 |

| 📊 模型评估 | 自动生成性能评估报告,包括mAP、Precision、Recall等指标 |

| 🔄 数据转换 | 支持COCO、VOC格式转换为YOLO格式 |

| 🎨 多主题UI | 亮色、暗色、科技感三种主题可选 |

二、检测类别说明

系统可识别以下6种学生课堂行为:

| 类别ID | 类别名称 | 说明 |

|---|---|---|

| 0 | 举手 | 学生举手发言或提问 |

| 1 | 阅读 | 学生正在阅读书本/屏幕 |

| 2 | 写作 | 学生正在书写笔记 |

| 3 | 使用手机 | 学生使用手机的检测 |

| 4 | 低头 | 学生低头(可能走神或睡觉) |

| 5 | 睡觉 | 学生趴在桌上睡觉 |

数据集配置

path: main/datasets/dataset

train: images/train

val: images/val

test: images/test

# 类别数量

nc: 6

# 类别名称

names: ['举手', '阅读', '写作', '使用手机', '低头', '睡觉']

三、系统架构

YOLO26课堂行为检测系统

├── 🚀 启动层

│ └── start.py # 推荐入口

├── 🖥️ 界面层 (youi/ui/)

│ ├── main_window.py # 主窗口

│ ├── components/

│ │ ├── inference_tab.py # 推理界面

│ │ └── settings_tab.py # 设置界面

│ └── assets/ # 图标、样式资源

├── ⚙️ 核心层 (youi/utils/)

│ ├── inference_worker.py # 推理引擎

│ ├── training_worker.py # 训练引擎

│ ├── testing_worker.py # 评估引擎

│ ├── dataset_converter.py # 数据转换

│ └── theme_manager.py # 主题管理

└── 📁 数据层 (datasets/)

├── images/ # 图像数据

├── labels/ # YOLO标注

└── data.yaml # 数据集配置

四、快速开始

4.1 环境安装

# 克隆项目

cd YOLO26

# 安装依赖

cd youi

pip install -r requirements.txt

# CPU用户建议安装PyTorch CPU版本

pip install torch torchvision --index-url https://download.pytorch.org/whl/cpu

4.2 启动系统

# 方式1:使用启动脚本(推荐)

python start.py

# 方式2:直接运行主程序

cd youi

python main.py

五、使用指南

5.1 准备数据集

datasets/dataset/

├── images/

│ ├── train/ # 训练图像

│ ├── val/ # 验证图像

│ └── test/ # 测试图像

├── labels/

│ ├── train/ # 训练标注(YOLO格式)

│ └── val/ # 验证标注(YOLO格式)

└── data.yaml # 数据集配置

YOLO标注格式:

<class_id> <x_center> <y_center> <width> <height>

5.2 模型训练

在系统界面中选择:

- 配置训练参数(epochs、batch size、图像尺寸等)

- 选择预训练模型(yolo26n/s/m/l/x)

- 点击"开始训练"

5.3 实时推理

支持多种输入源:

- 📷 单张图片检测

- 📁 文件夹批量检测

- 🎬 视频文件检测

- 📹 摄像头实时检测

六、技术亮点

6.1 多线程架构

- 推理、训练、测试均采用独立工作线程

- GUI界面保持流畅,不卡顿

- 实时显示终端输出日志

6.2 主题切换

# 支持三种主题

- 亮色主题:适合白天使用

- 暗色主题:适合夜间使用

- 科技主题:专业监控风格

6.3 快捷键支持

| 快捷键 | 功能 |

|---|---|

| Ctrl+O | 打开文件 |

| Ctrl+R | 开始推理 |

| Ctrl+T | 开始训练 |

| Ctrl+Q | 退出程序 |

七、应用场景

- 智慧教室:实时监控学生课堂状态

- 教学评估:统计各类行为出现频率

- 课堂管理:及时发现走神、睡觉学生

- 教学研究:分析学生参与度数据

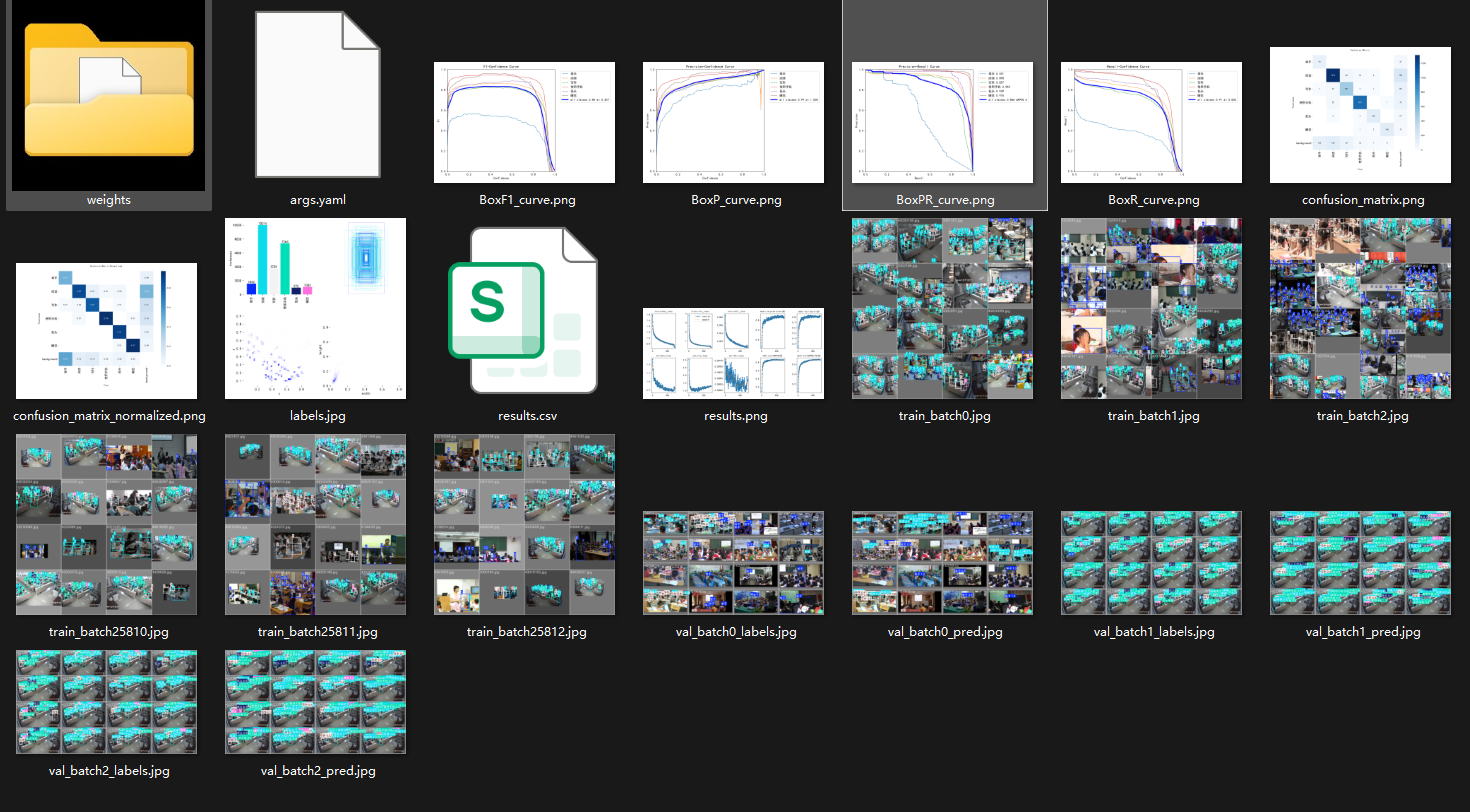

八、效果展示

九、总结

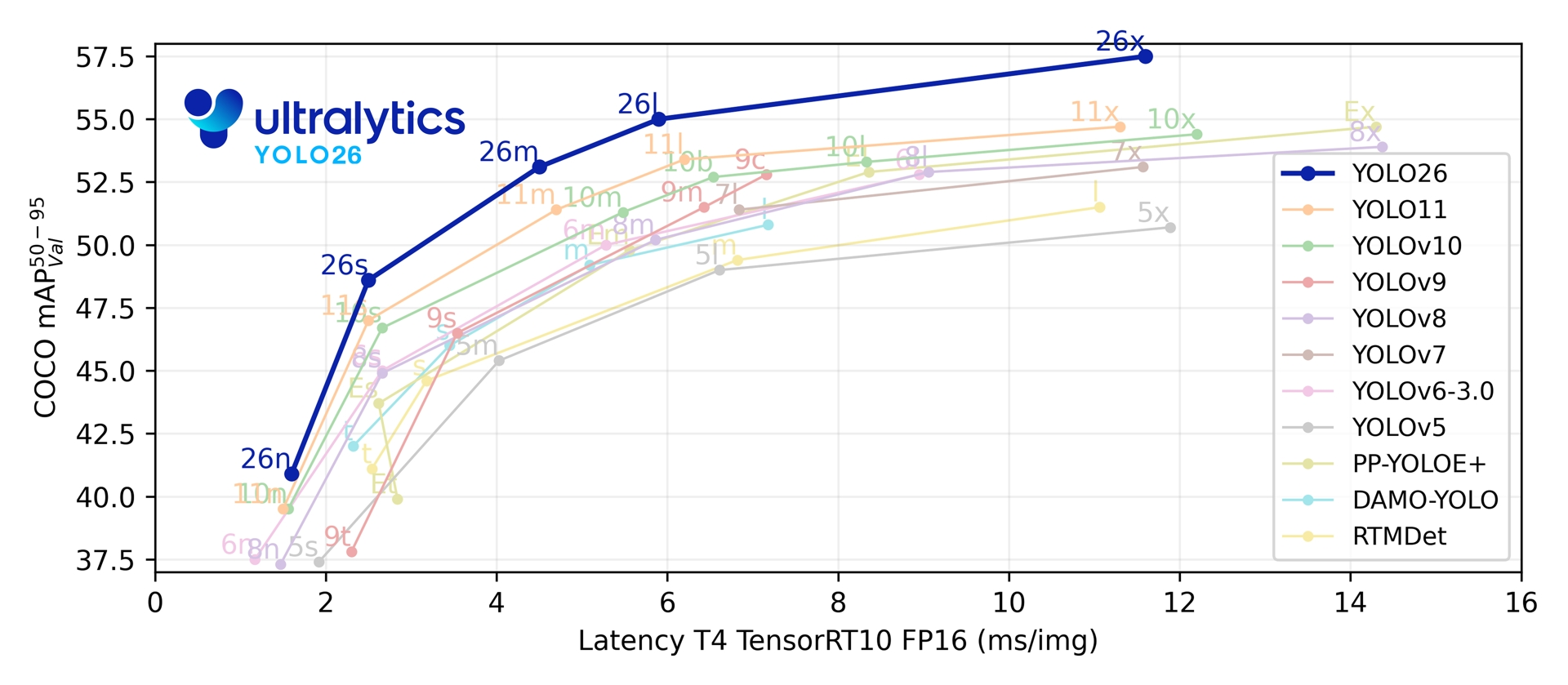

本系统基于YOLO26目标检测算法,结合PyQt5图形界面,实现了一个功能完善的学生课堂行为检测系统。系统具有检测精度高、实时性好、界面友好等特点,可广泛应用于智慧教育场景。

技术栈:

- 检测框架:YOLO26

- 界面框架:PyQt5

- 深度学习:PyTorch

- 图像处理:OpenCV

本项目基于 YOLO26 目标检测框架 与 PyQt5 图形界面架构 深度融合,构建了一套完整的学生课堂行为智能分析系统。从数据标注、模型训练、性能评估到实时推理部署,形成了端到端的闭环解决方案。系统不仅支持多输入源检测(图片 / 视频 / 摄像头),还通过多线程机制保障 GUI 流畅运行,在实际教学场景中具备较强的工程可落地性。

在算法层面,依托 YOLO 系列模型在实时目标检测领域的高效推理优势,实现了对“举手、阅读、写作、使用手机、低头、睡觉”等六类课堂行为的精准识别;在系统设计层面,通过模块化架构划分(界面层 / 核心层 / 数据层),增强了代码可维护性与扩展能力;在用户体验层面,提供主题切换、多语言支持与快捷键操作,使系统兼顾专业性与易用性。

整体来看,该系统不仅适用于智慧教室实时行为监测,还可作为教育数据分析、教学评估研究、校园 AI 实践课程的示范项目。无论是作为科研原型验证,还是作为工程项目落地,都具备较高的实用价值与扩展潜力。

如果需要进一步扩展,还可引入行为时序分析(Action Temporal Modeling)、行为统计可视化看板、或基于 Transformer 的多模态融合策略,实现更高层级的课堂行为理解与智能决策支持。

更多推荐

已为社区贡献133条内容

已为社区贡献133条内容

所有评论(0)