OpenClaw接入飞书全流程:打造你的24小时AI助手

这篇文章将手把手教你如何在云服务器上部署OpenClaw并接入飞书,打造一个24小时待命的AI助手。

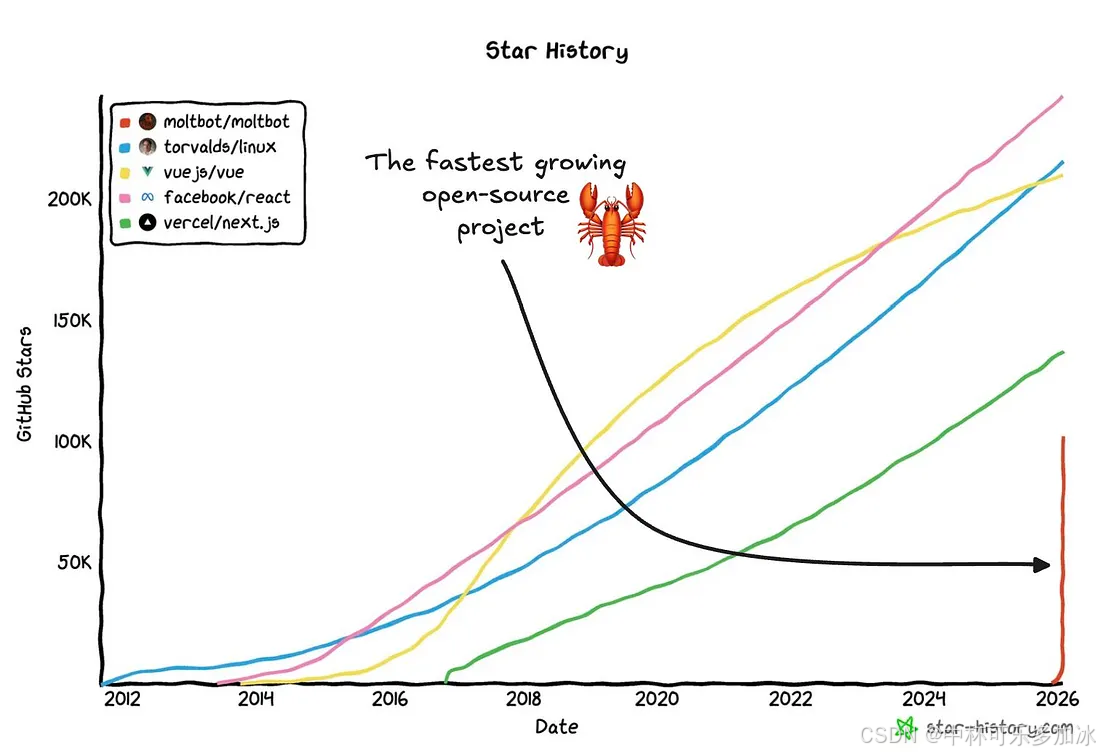

如果你关注AI领域,一定听说过OpenClaw。这个由程序员Peter Steinberger开发的开源AI Agent应用,在2026年1月25日发布后迅速走红——GitHub星标一周内突破17万,成为2026年AI领域最受关注的项目之一。

它的核心能力是:本地部署+系统级执行+全渠道交互。你可以通过聊天工具(飞书、钉钉、Telegram等)下达指令,让AI自动完成文件整理、代码部署、日程同步等任务,它的核心价值是打通了微信、钉钉、邮箱、日历、网页等几十款我们日常用的软件,从而让AI能直接查询天气、预订餐厅、网购抢购、火车票订购等高时效性任务。更重要的是,所有数据本地存储,隐私零泄露。

这篇文章将手把手教你如何在云服务器上部署OpenClaw并接入飞书,打造一个24小时待命的AI助手。

为什么选择OpenClaw

在深入部署之前,有必要先理解OpenClaw为什么值得关注。

传统AI助手(如ChatGPT)是被动的——你问一句,它答一句。OpenClaw是主动的——它引入了“心跳”与“定时任务”机制,能主动检查邮箱、生成日报、监控股票,自动执行任务。这意味着它不再只是一个问答工具,而是真正融入了你的工作流。

| 对比项 | 传统AI助手 | OpenClaw |

|---|---|---|

| 定位 | 知识问答、内容生成 | 任务执行、工作流自动化 |

| 运行环境 | 云端、浏览器沙盒 | 本地电脑、服务器 |

| 交互方式 | 在特定应用内对话 | 通过日常聊天软件下达指令 |

| 核心能力 | “说” | “做”与“说”结合 |

从技术架构看,OpenClaw按照传统智能体“规划、执行、反馈”的框架实现功能,但在记忆(Memory)、工具(Tools)等模块设计上更加完善。它能够记住你的编码风格、团队规范、历史决策,用的越多,它对你越了解。

另一个关键是成本可控。你只需准备一台电脑(或云服务器)和一个大模型API Key,就可以拥有一个完全私有的AI助手。相比动辄数百美元的企业级方案,这是普通人也能承受的价格。

部署前的准备工作

开始部署前,需要确认几件事。

硬件要求方面,最基础的轻量级应用服务器即可,但如果要让它同时处理多个任务,建议6核+16GB。存储10GB可用空间即可。

软件环境方面,最关键的是Node.js 22.x版本。腾讯云和阿里云的轻量应用服务器都提供了预装OpenClaw的镜像,选择这种镜像可以省去大量配置时间。

账户凭证方面,需要准备一个大模型API Key。OpenClaw支持OpenAI、Claude、DeepSeek等多种模型。国内用户建议选择DeepSeek或Qwen,成本更低且效果足够。如果使用OpenAI,需注意国内访问需要代理。

还需要一个飞书企业账号,用于创建自建应用。

云服务器购买与配置

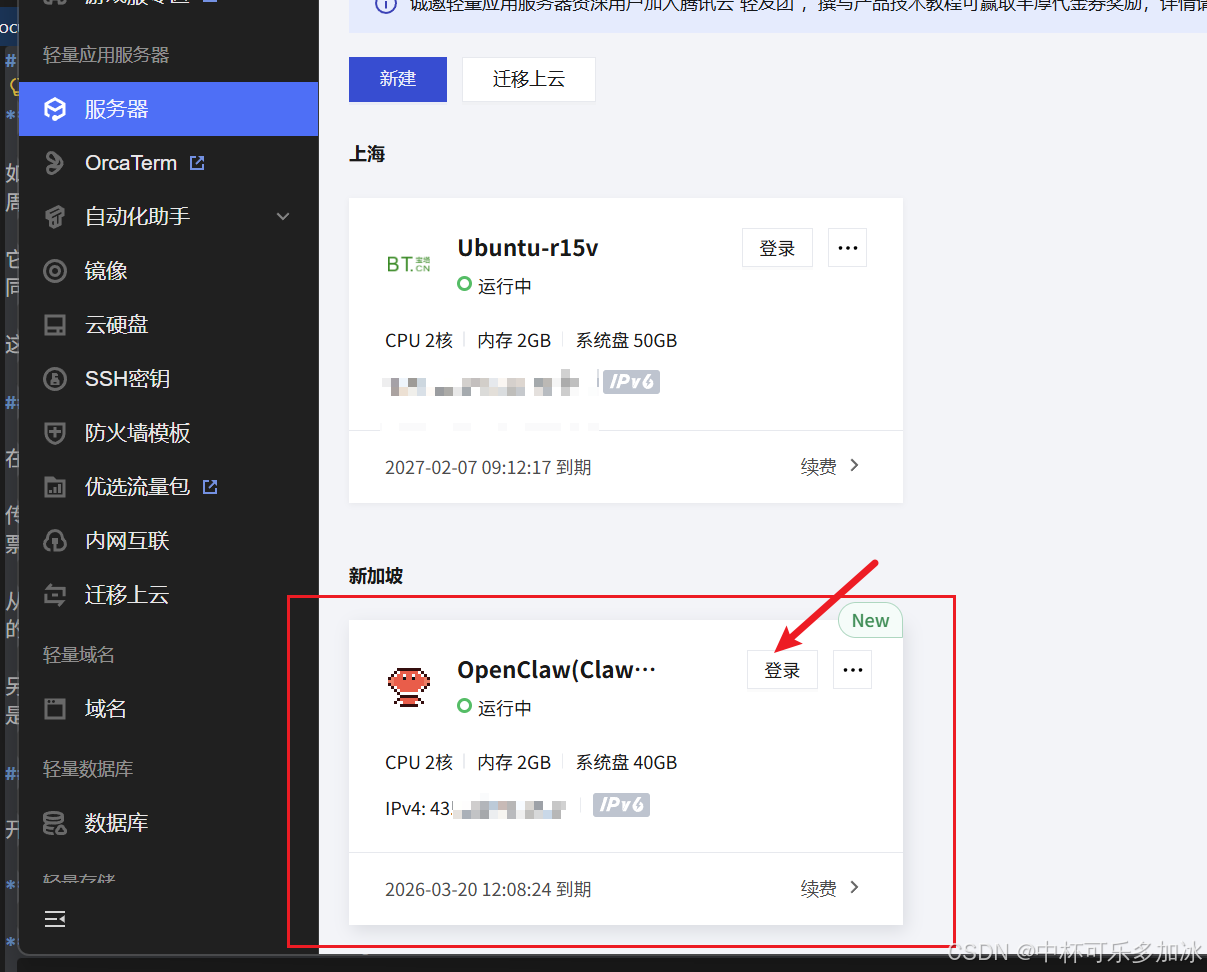

各大云厂商都有轻量应用服务器产品,价格差异不大。这里以腾讯云为例进行说明。

进入腾讯云官网,选择产品进入轻量应用服务器页面,然后选择开年大促活动专区,价格相对优惠。

然后翻到页面最下方出海优选,找到境外云服务器,轻量应用服务器:

配置选择上,2核2G足够运行基础功能,如果预算允许建议选2核4G。镜像一定要选择OpenClaw(Clawdbot)开头的选项,这是云厂商专门优化的版本,预装了所有必要环境。

购买成功后,进入服务器控制台,点击登录。选择免密登录,可能需要手机扫码验证。

OpenClaw初始化配置

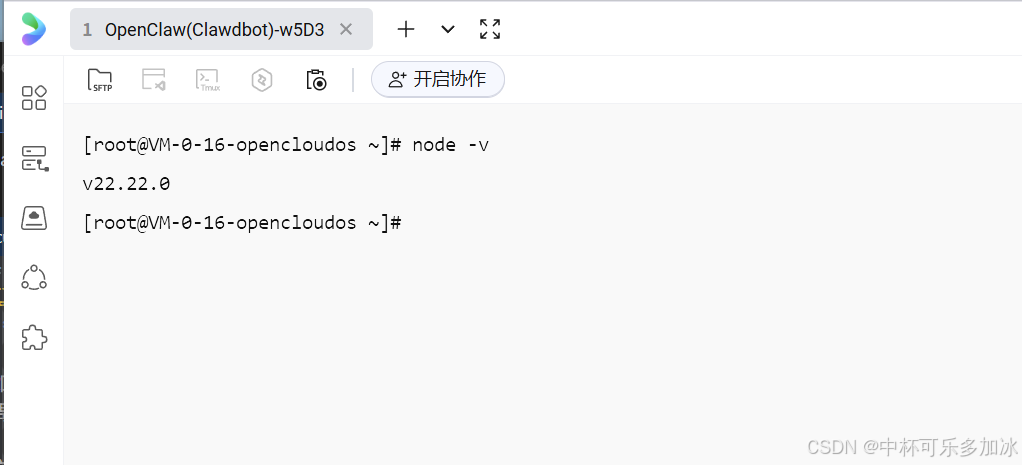

登录服务器后,第一步检查Node.js环境是否就绪。执行命令:

node -v

如果输出版本号(如v22.x.x),说明镜像已经预装好了。

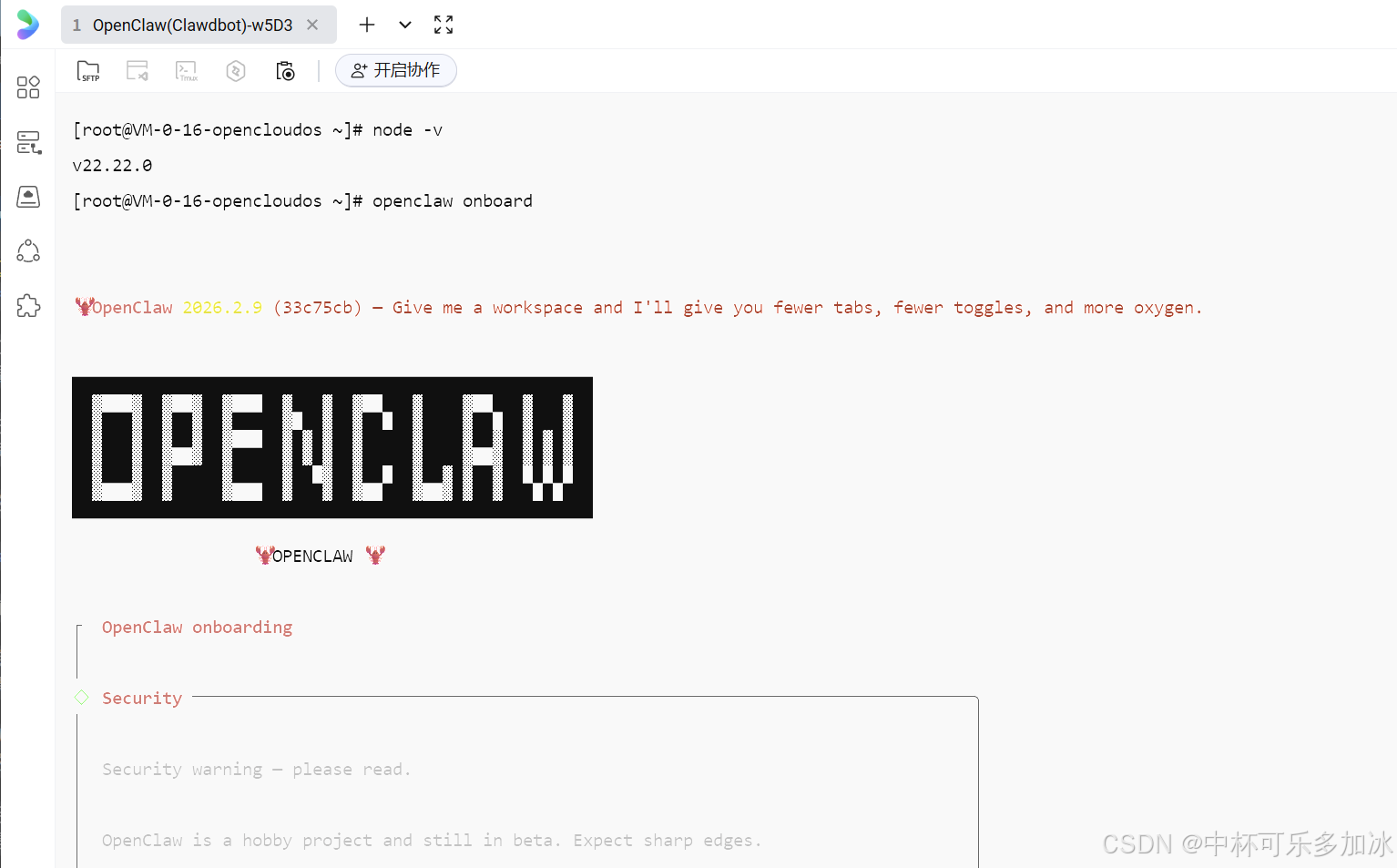

开始配置流程,执行:

openclaw onboard

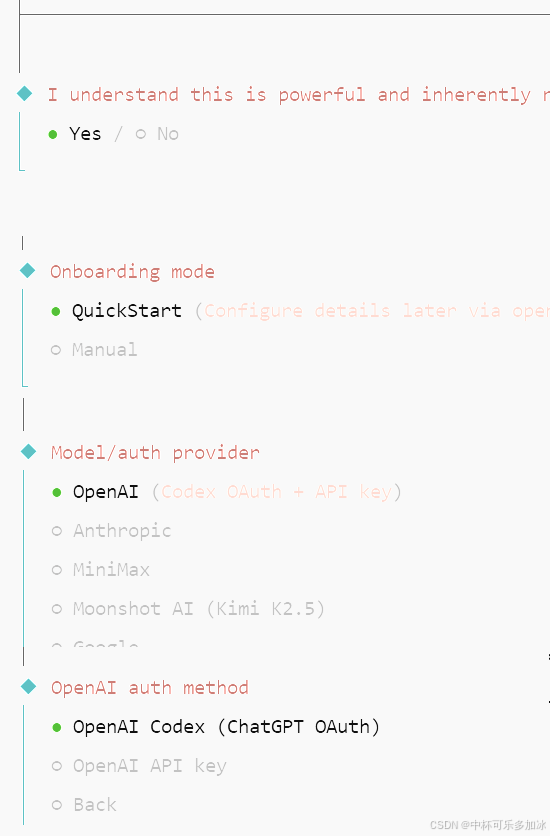

接下来系统会引导你完成几个关键配置。首先是安全警告——选择Yes同意将系统权限交给OpenClaw;第二个是快速配置还是手动配置,选快速即可;第三个就选当前存在的就行。再下一个就是让你选择模型,这里我选择的是 OpenAI,使用 CodeX 授权。

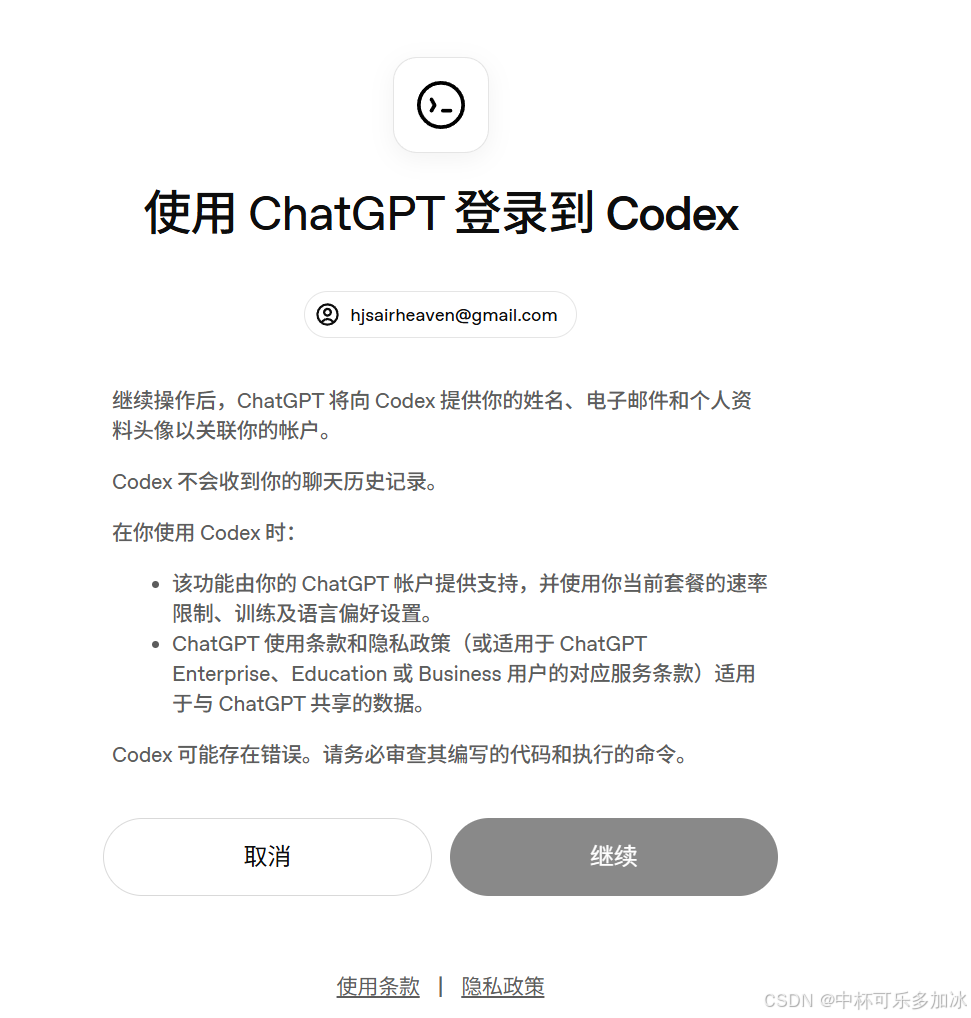

然后会需要你打开一个网页进行OpenAI授权,复制到网页中,授权使用Codex

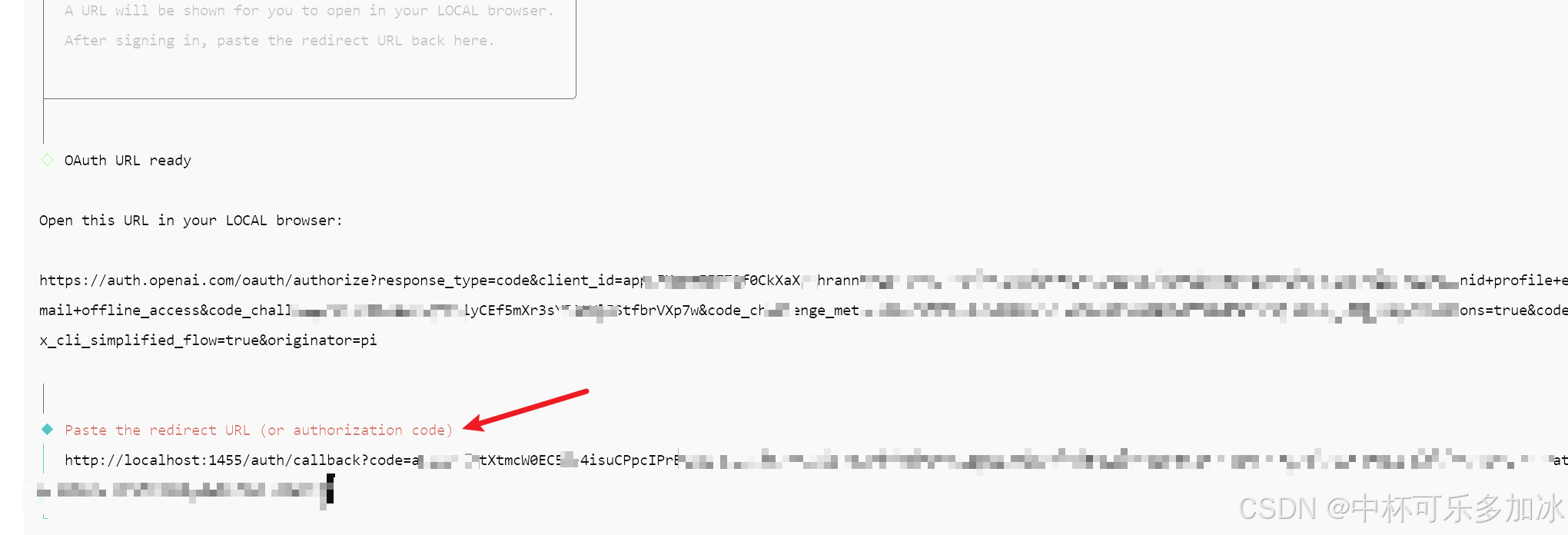

然后把授权后的重定向url复制到服务器当中,这是我授权完成之后的样子。

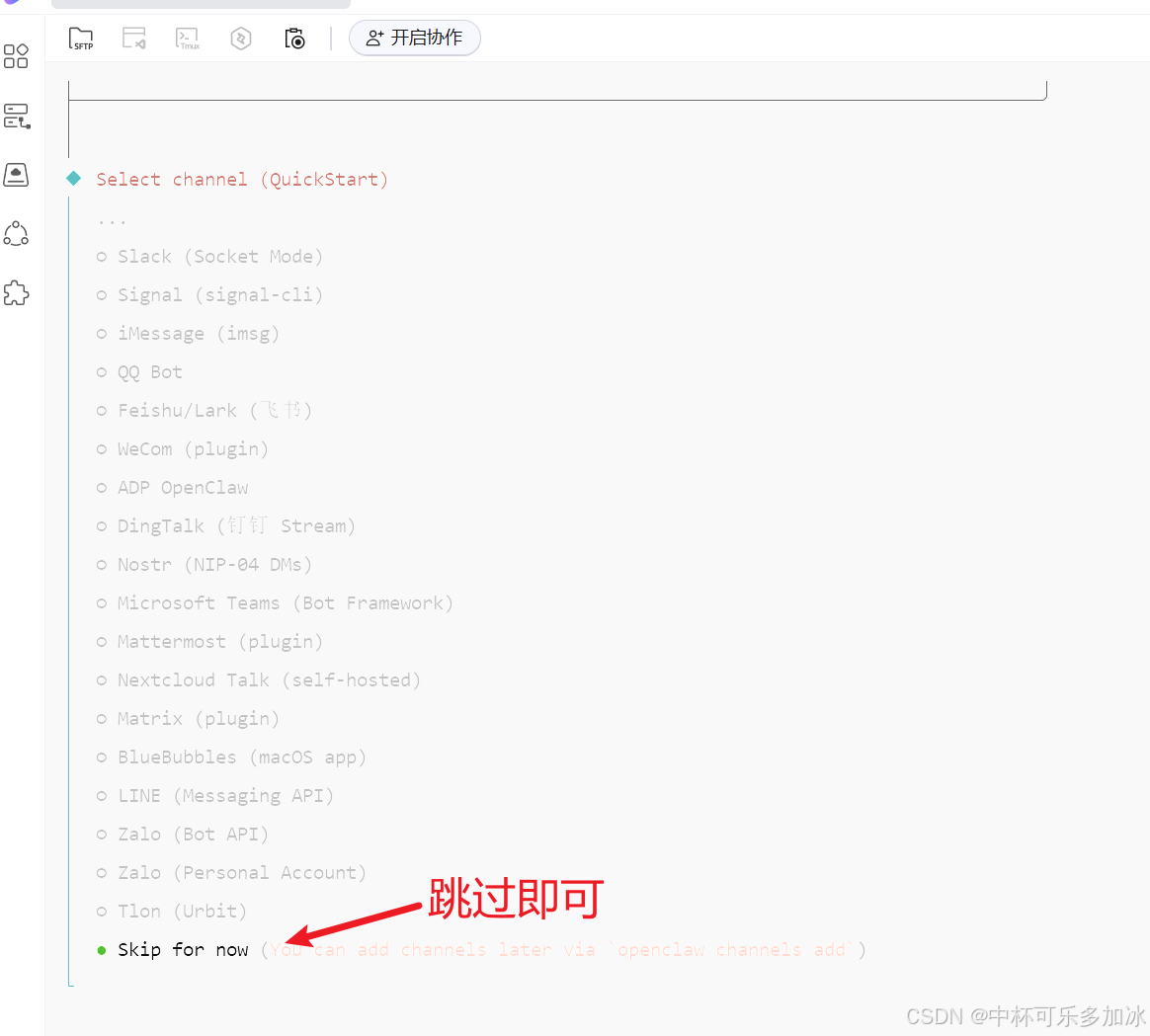

然后选择Channel(聊天渠道)。这里先跳过,后续通过云厂商后台配置更方便。

之后选择Skills(技能),初期可以先不选,直接选择No,等服务跑起来后可以随时通过对话让AI自己安装。

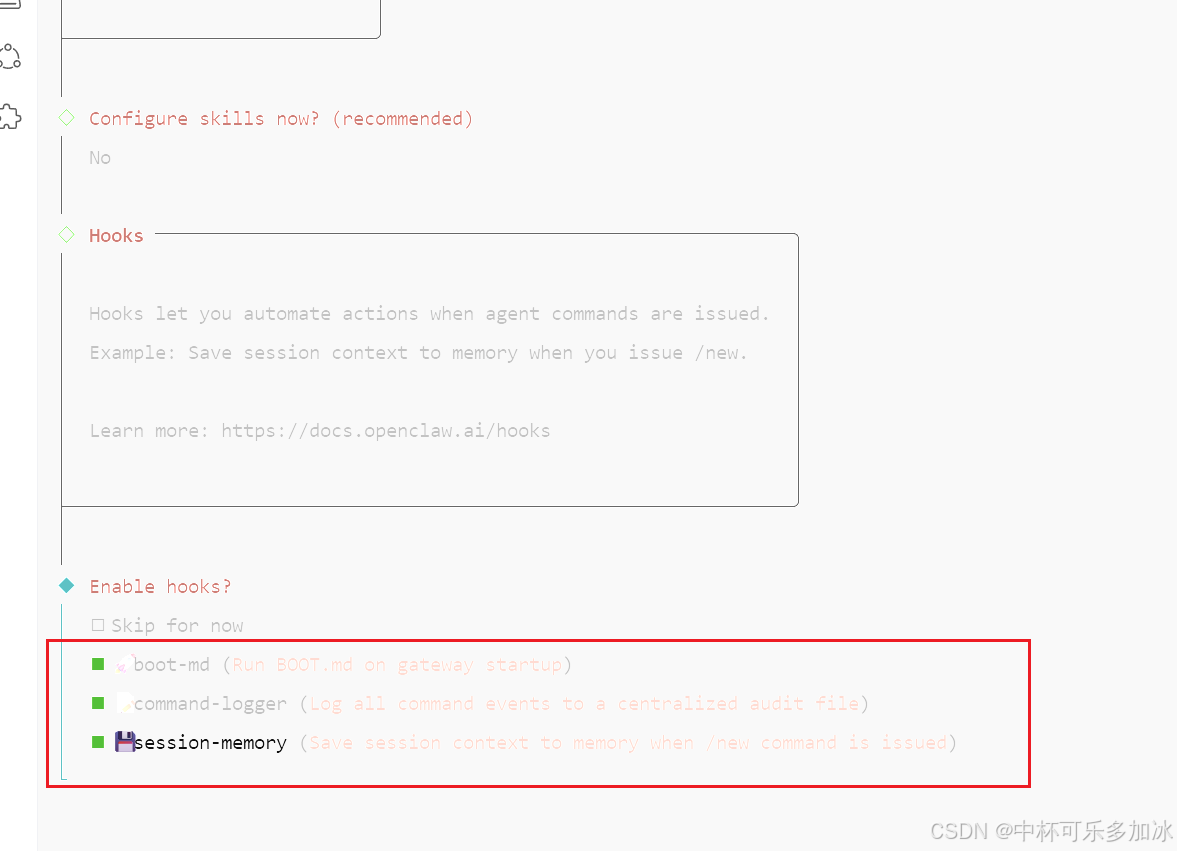

最后配置Hooks,建议全部勾选。Boot-md的作用是程序启动时把所有Markdown内容“读懂”并准备好;Command-logger用于记录所有执行的命令,方便排查问题;Session-memory用来保存会话历史,维护上下文关联。

boot-md:作用是程序 “开机” 时,先把所有用 Markdown 写的内容“读懂” 并准备好,确保后续使用时能正确处理 Markdown 格式的内容(比如渲染成可读文本、解析配置参数)。

command-logger:就是给 OpenClaw 装了个 “监控摄像头”,只要你执行任何 OpenClaw 命令,它就会自动记下来:谁、什么时候、执行了什么命令、传了什么参数、执行成功 / 失败、返回了什么结果。要我说,程序员比较好这口。

session-memory:用来保存会话历史消息、维护技能执行的中间状态、实现上下文关联的对话 / 操作。

配置完成后,系统会提示重启服务。选择Restart,然后选择使用WebUI方式访问。

访问WebUI

服务启动后,终端会显示访问地址。但云服务器没有可视化窗口,无法直接用浏览器打开。这里需要用SSH隧道解决这个问题。

在本地电脑(你自己的Mac或Windows电脑)上打开终端,执行:

ssh -N -L 18789:127.0.0.1:18789 root@你的服务器公网IP

将命令中的替换为腾讯云服务器实例页面显示的公网IP地址。执行后保持终端窗口不要关闭。(如果是普通服务器,记得放通服务器防火墙的18789端口,腾讯云已经默认放通了)

然后在本地浏览器中打开:

http://localhost:18789/#token=xxxx

注意将xxxx替换为终端显示的实际token值。现在你应该能够看到OpenClaw的对话界面,可以开始和AI对话了。

飞书接入配置

在网页版确认OpenClaw能正常工作后,接下来接入飞书。这需要两个步骤:云厂商后台配置和飞书开发者后台配置。

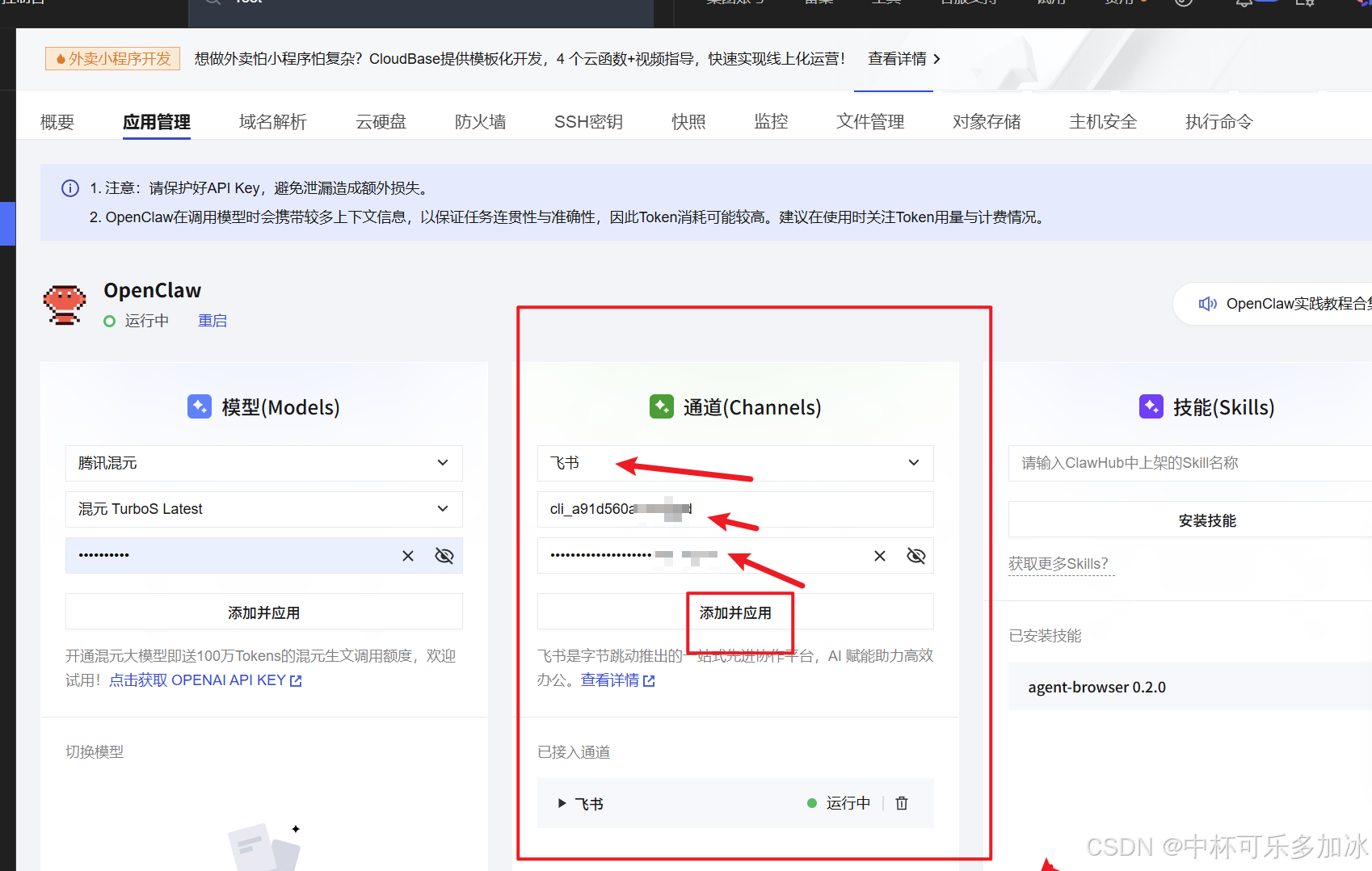

第一步:云厂商后台配置

进入腾讯云轻量应用服务器的控制台,找到应用管理页面。这里可以添加飞书通道。

需要填写两个信息:App ID和App Secret。这两个值来自飞书开放平台。

第二步:飞书开发者后台配置

打开飞书开发者后台(https://open.feishu.cn/),创建企业自建应用。填写基本信息后创建成功。

进入应用的凭证与基础信息页面,记录App ID和App Secret。

回到腾讯云后台,将这两个值粘贴进去,点击添加并应用。

系统可能会询问是否重启Gateway,确认继续即可。

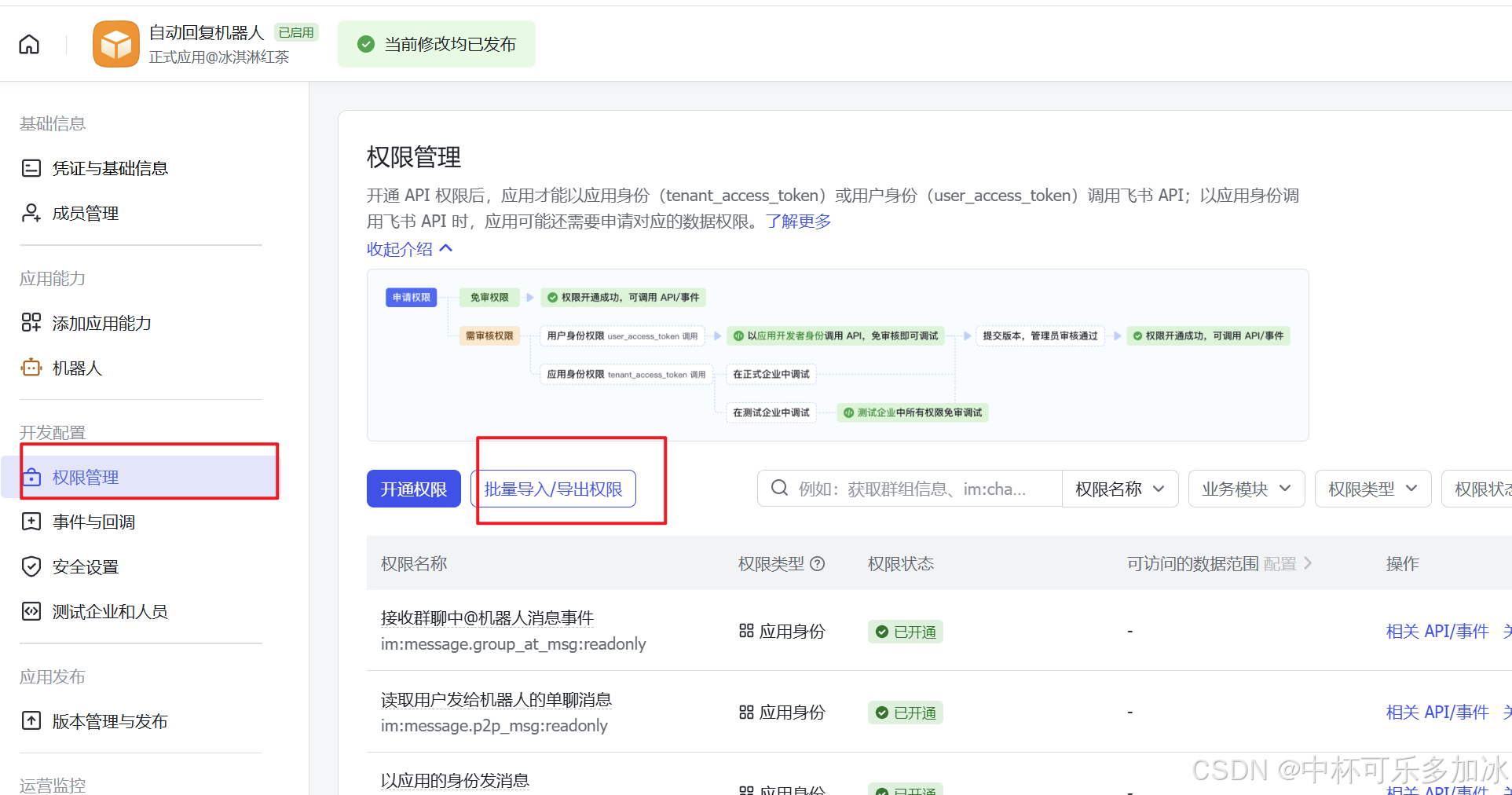

第三步:飞书应用权限配置

回到飞书开发者后台,找到权限管理菜单。

点击批量导入/导出权限,输入以下权限配置:

{

"scopes": {

"tenant": [

"bitable:app",

"bitable:app:readonly",

"contact:contact.base:readonly",

"contact:user.base:readonly",

"docx:document",

"docx:document.block:convert",

"docx:document:create",

"docx:document:readonly",

"drive:drive",

"drive:drive:readonly",

"im:chat.members:read",

"im:chat:read",

"im:chat:readonly",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.group_msg",

"im:message.p2p_msg:readonly",

"im:message.reactions:read",

"im:message:readonly",

"im:message:recall",

"im:message:send_as_bot",

"im:message:update",

"im:resource",

"space:document.event:read",

"task:comment",

"task:task.event_update_tenant:readonly",

"task:task:read",

"task:task:write",

"wiki:wiki",

"wiki:wiki:readonly"

],

"user": []

}

}

这些权限允许机器人读取消息、发送消息、访问云空间文档、管理任务等。

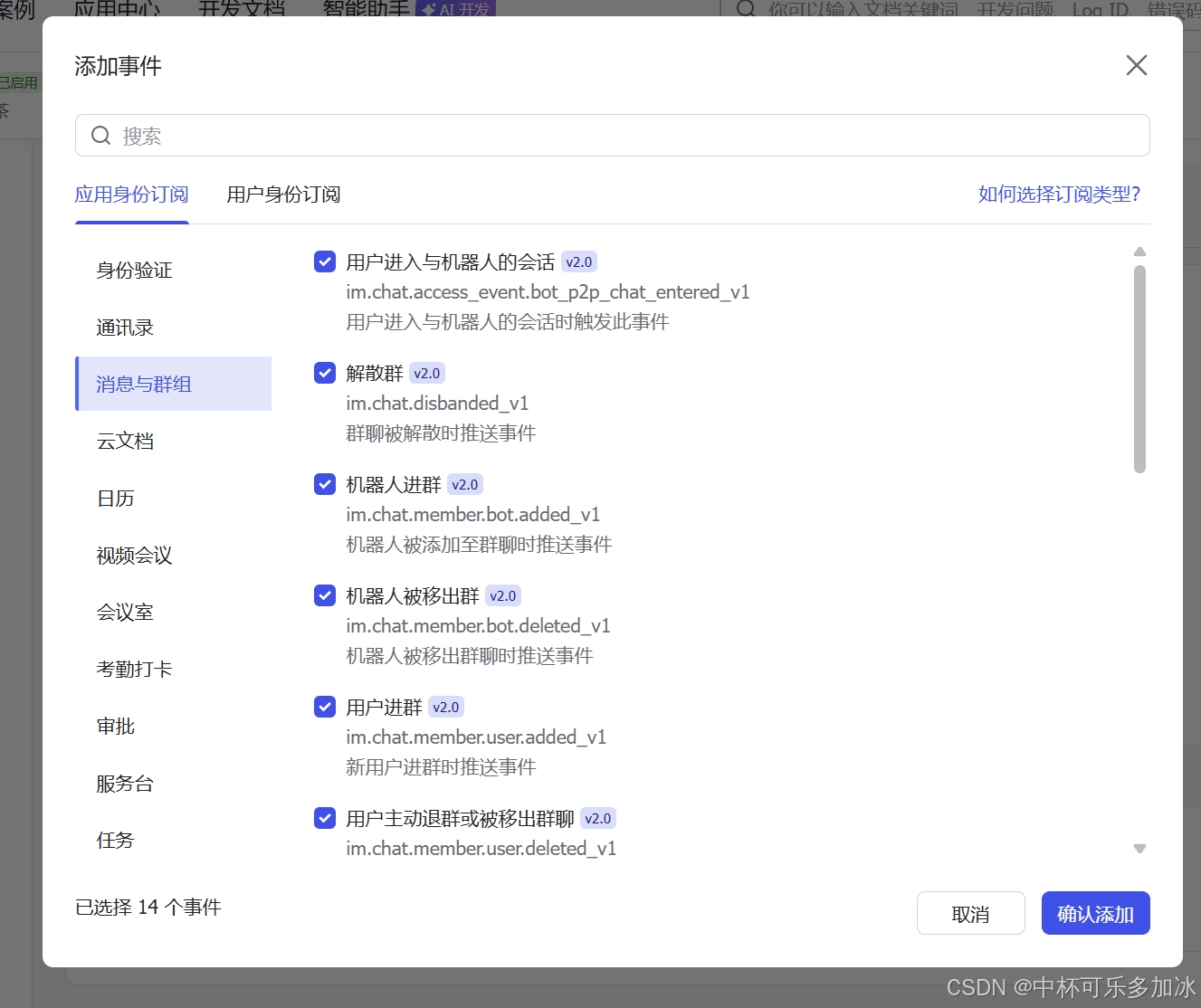

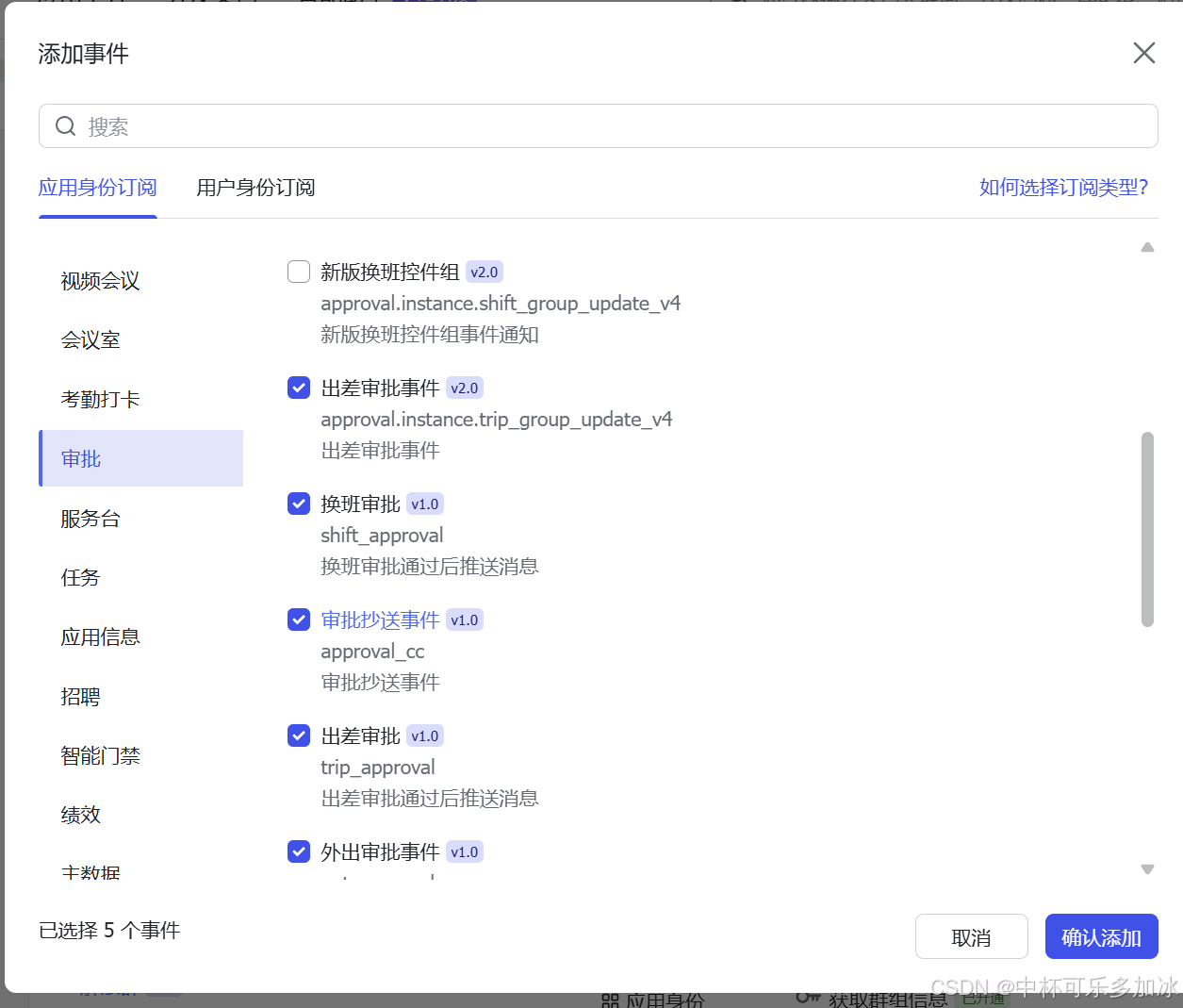

第四步:配置事件与回调

找到事件与回调菜单,将订阅方式改为“使用长链接接收事件”。然后添加事件,可以把你希望Openclaw可以做的事情勾选,试验的话建议全选以获得完整功能。

回调配置同样设置为长链接方式。

第五步:发布应用

完成以上配置后,进入版本管理与发布页面。填写必要的表单信息,点击保存发布。

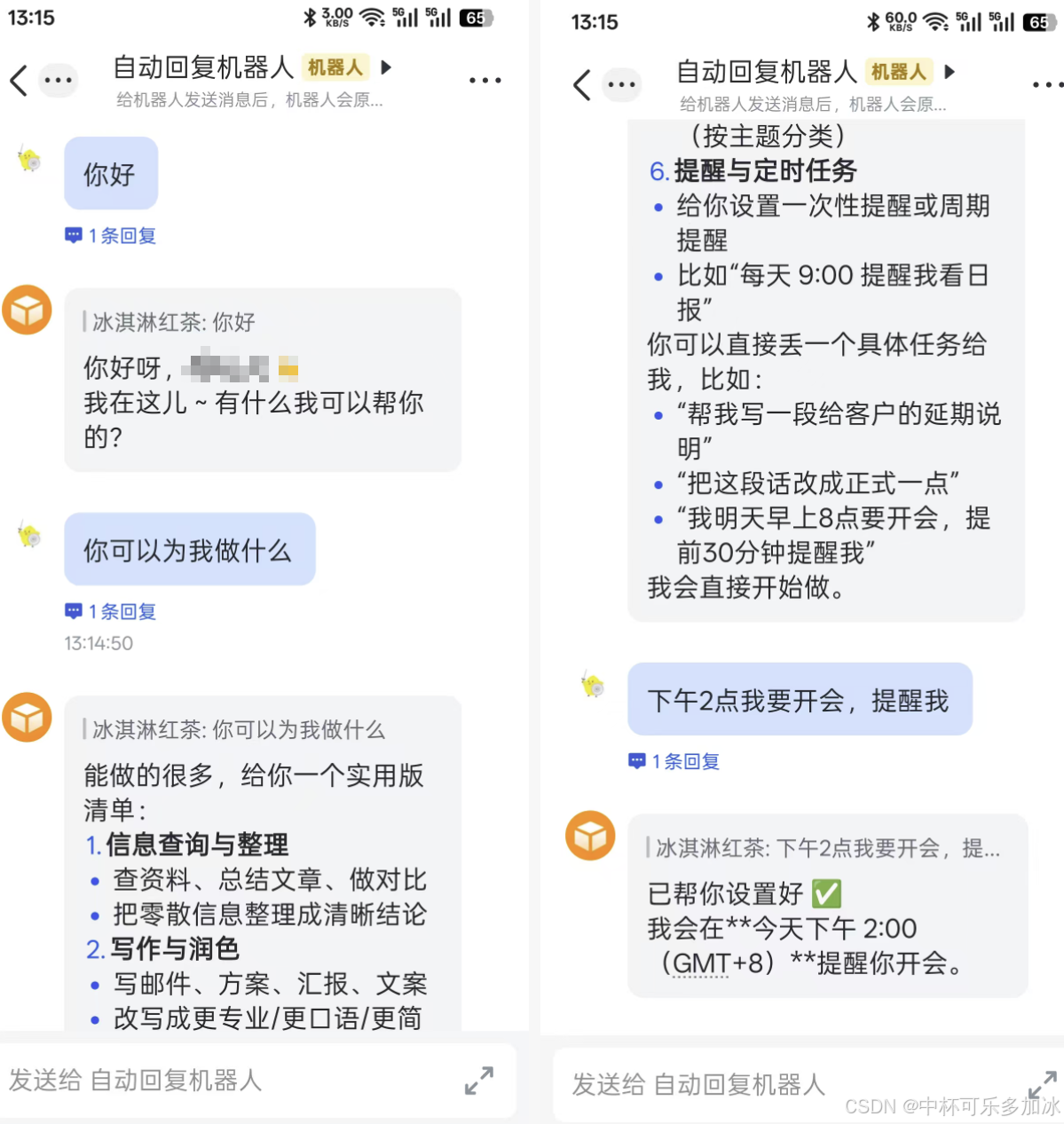

现在,你可以在飞书中搜索并打开你的机器人,开始对话了。

常用排查命令

部署过程中如果遇到问题,以下几个命令可以帮你排查:

# 查看OpenClaw是否在后台运行

openclaw health

# 查看模型状态,确认是否连上大模型

openclaw models list

# 查看聊天通道配置

openclaw channels list

几个关键提醒

安全第一。OpenClaw拥有系统级权限,建议不要在存有重要商业机密的电脑上运行。购买专门的云服务器或使用闲置设备是更稳妥的做法。

成本控制。AI Agent的Token消耗远超普通对话。有用户实测单日最高消耗9000万个Token,成本高达170美元。建议设置API调用限额,定期检查消耗情况。

持续探索。完成基础配置后,可以尝试安装更多Skills(如联网搜索、浏览器自动化等),让AI的能力不断扩展。

总结

通过以上步骤,你应该已经拥有了一个接入飞书的OpenClaw AI助手。它可以24小时运行,通过飞书消息接受指令,自动完成各种任务。

这套方案的核心优势:

成本可控。一次性投入主要是云服务器(月付几十元)和API Key调用费用。相比企业级AI助手动辄数百美元的月费,门槛低很多。

数据私有。所有数据存储在你自己控制的服务器或设备上,不依赖第三方SaaS服务。对于注重数据安全的企业和个人,这很重要。

渠道统一。通过飞书接入,手机和电脑端都能使用。飞书本身就是国内办公高频入口,天然适合作为控制入口。

能力可扩展。700+ Skills可供安装,持续扩展AI的能力边界。从简单的问答到复杂的自动化流程,都可以逐步解锁。

AI Agent的时代已经到来。OpenClaw让每个人都能拥有自己的个人AI助手——它会记住你的偏好、习惯,不断学习进化,最终成为工作流程中不可或缺的一环。

如果觉得这篇文章有帮助到你:

🎉 支持我:点赞👍+ 收藏⭐️ + 在看+留言📝

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)