从代码模式到智能模式:AI时代的设计模式进化论

AI时代设计模式的进化与重构 研究发现AI生成的代码存在更多质量问题,且经验丰富的开发者使用AI工具反而效率下降19%。传统设计模式在AI时代展现出新价值,从"代码复用工具"转变为"系统级杠杆"。文章分析了工厂模式、观察者模式、策略模式在AI系统中的升级应用,并探讨了新兴的智能体设计模式(单智能体、多智能体协作等)。随着软件工程范式重构,设计模式的核心价值从

从代码模式到智能模式:AI时代的设计模式进化论

2025年CodeRabbit对470个开源PR的分析发现,AI协作生成的代码,"重大"问题是人工编写代码的1.7倍。更扎心的是,METR做的随机对照试验发现,经验丰富的开源开发者用AI工具反而慢了19%,尽管他们预测会快24%。

为什么?

因为AI生成代码的速度太快了,快到我们来不及思考架构问题。就像给了每个人一台挖掘机,却没有提供城市规划图。

但有意思的是,在这样的背景下,那些诞生于上世纪90年代的设计模式,不但没有过时,反而呈现出新的生命力。Martin Fowler在2025年架构峰会上说的一句话特别到位:"AI生成的代码如同乐高积木,而设计模式就是组装说明书。"

今天我想聊聊,在AI时代,设计模式是如何从"代码套路"进化为"智能模式"的。

从Vibe Coding说起

2025年2月,Andrej Karpathy发了一条推文,提出了"Vibe Coding"这个概念。他描述说:"It's not really coding. I just see stuff, say stuff, run stuff, and copy paste stuff, and it mostly works."

不是真的编码,只是看到东西,说出东西,运行东西,复制粘贴东西,大部分时候它都能工作。

这个描述太传神了。

AI代码生成流程

Vibe Coding的核心是用自然语言描述需求,让AI自动生成代码。从某种意义上说,这确实降低了编程门槛。数据显示,传统需要100小时学习的基础编程,通过AI辅助,现在10小时内就能掌握——门槛降低了约90%。

但问题也在这里。

当编程从"写代码"变成了"描述需求",开发者与代码的距离变远了。AI生成的代码,你可能连看都没看一遍就运行了。代码审查变成了"Accept All",调试变成了"复制粘贴错误信息"。

GitHub上有个叫"vibe-coded"的topic,已经有184个仓库。其中一个操作系统的描述是"fully designed and written by AI agents"。听起来很厉害,但你敢在生产环境用这样的系统吗?

这里有个根本性的矛盾:AI生成代码的速度提升了,但代码的可理解性、可维护性,反而下降了。

而设计模式,恰好是解决这个问题的关键。

设计模式的核心价值变了

1994年,GoF四人组在《设计模式:可复用面向对象软件的基础》这本书里,系统化了23个经典设计模式。这些模式被分为三类:创建型、结构型、行为型。

在传统软件工程中,设计模式的核心价值是:

• 提高代码复用性

• 统一工程师的沟通语义

• 减少重复设计

• 降低认知成本

这些价值建立在几个假设之上:

• 代码是由人类长期维护的

• 抽象层级越高,理解成本越低

• 模式名称本身承载了语义

但在AI时代,这些假设都被打破了。

AI不是靠长期记忆来理解代码的,而是靠系统级上下文推理。AI可以快速重构、拆分、重组代码,它理解的不是"抽象层级",而是"任务与行为"。

这就导致了一个有趣的现象:对AI来说,模式名称不重要,抽象层级越深,理解成本反而越高。

那么,设计模式还重要吗?

我觉得不但重要,而且价值发生了根本性转变。

从"代码复用工具"转变为"系统级杠杆"。

GitHub内部的一个实验很能说明问题。架构增强型Prompt生成的代码,首次可用率比普通Prompt提高了47%。因为设计模式在这里不再是"代码套路",而是"约束框架"。它告诉AI:不要随意生成,要按照这个架构来生成。

乐高设计模式

Martin Fowler的比喻特别准确:AI生成的代码是乐高积木,设计模式是组装说明书。没有说明书,乐高积木也能拼,但拼出来的是什么就不好说了。

经典模式的AI时代改造

说完了理论,来看看具体的例子。AI对经典设计模式的改造,不是推翻,而是进化。

工厂模式的智能升级

传统的工厂模式用于创建对象家族,避免直接实例化带来的耦合。

在AI系统中,工厂模式进化成了"模型工厂"。它不只是创建对象,而是根据输入数据动态创建不同的AI模型。

工厂流水线架构图

class ModelFactory:

def __init__(self):

self.model_registry = {

'image': CNNModel,

'text': TransformerModel,

'tabular': XGBoostModel,

'multimodal': CLIPModel

}

def create(self, task_type, data_sample):

# AI根据数据特征自动选择模型

model_class = self._auto_select_model(task_type, data_sample)

# 动态配置超参数

config = self._auto_configure(data_sample)

return model_class(**config)

def _auto_select_model(self, task_type, data_sample):

# 这里可以集成AI选择逻辑

# 比如用元学习决定用哪个模型

pass

def _auto_configure(self, data_sample):

# 根据数据样本自动配置

pass这个升级带来了什么?

第一,适应性更强。工厂不再硬编码模型选择,而是根据输入数据动态决定。Google的AutoML就用类似机制。

第二,符合AI系统的特性。AI系统往往是数据驱动的,模型选择应该基于数据特征,而不是人工配置。

观察者模式的分布式演进

传统的观察者模式用于事件通知。这种方式在小系统里没问题,但到了分布式AI系统,就不够用了。

在AI训练场景中,观察者模式进化成了"模型观察者"或"分布式观察者":

星拓扑绿紫图

class TrainingEventBus:

"""分布式训练事件总线"""

def __init__(self):

self.observers = {}

self.federation_enabled = True # 联邦学习开关

def register(self, event_type, observer):

if event_type not in self.observers:

self.observers[event_type] = []

self.observers[event_type].append(observer)

async def emit(self, event_type, data):

if event_type in self.observers:

# 异步通知所有观察者

tasks = [observer.update(data) for observer in self.observers[event_type]]

await asyncio.gather(*tasks)

# 联邦学习:同步到全局

if self.federation_enabled:

await self._sync_to_global(event_type, data)

async def _sync_to_global(self, event_type, data):

# 联邦学习同步逻辑

pass

class MetricMonitor:

"""监控训练指标"""

async def update(self, metrics):

loss = metrics.get('loss')

if loss > self.threshold:

# 触发早停机制

await self.trigger_early_stopping()

class EarlyStopper:

"""早停观察者"""

async def update(self, metrics):

# 实现早停逻辑

pass这个升级不只是加了异步,更重要的是引入了分布式概念。在联邦学习场景中,多个设备观察全局模型更新,实现隐私保护的协作训练。

星拓扑绿紫图

策略模式的自适应进化

策略模式用于在运行时切换算法。传统实现需要手动选择策略。

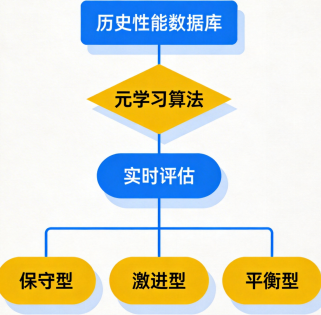

在AI系统中,策略模式进化成了"自适应策略",用元学习让系统自动选择或组合策略。

决策树架构图

class AdaptiveStrategySelector:

"""自适应策略选择器"""

def __init__(self):

self.strategies = {

'conservative': ConservativeStrategy(),

'aggressive': AggressiveStrategy(),

'balanced': BalancedStrategy()

}

self.performance_history = defaultdict(list)

def select_strategy(self, context):

# 元学习:根据历史表现自动选择

best_strategy = self._meta_learn_selection(context)

# 实时评估并调整

performance = self._evaluate_performance(best_strategy, context)

self.performance_history[best_strategy].append(performance)

return best_strategy

def _meta_learn_selection(self, context):

# 实现元学习选择逻辑

# 可以用强化学习、贝叶斯优化等

pass

def _evaluate_performance(self, strategy, context):

# 实时评估策略表现

passAlphaGo的策略网络就是一个动态策略模式的应用。它根据棋局状态自动切换搜索算法,不是人工选择,而是AI自己决定。

智能体设计模式的诞生

除了改造经典模式,AI时代还催生了一整套新模式——智能体设计模式。

这些模式不再是关于代码结构的优化,而是关于如何让AI智能体更智能、高效、安全地协作与行动。

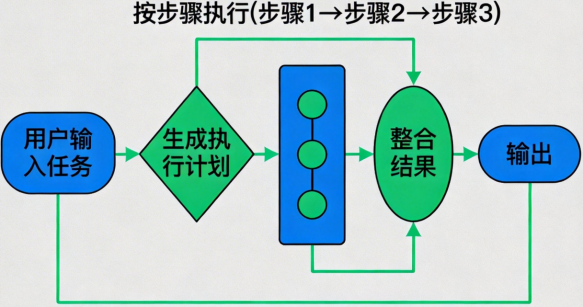

蓝绿工作流程图

单智能体模式家族

最简单的是基础单智能体模式,就是输入→推理→响应。但这种方式太简单了,无法处理复杂任务。

规划智能体模式会先生成一个多步骤计划,然后按顺序执行:

这种方式适用于无法一步完成、需要一系列协调操作的任务。比如SaaS产品的AI入职助手,需要安排欢迎邮件、设置产品引导、跟进检查等一系列步骤。

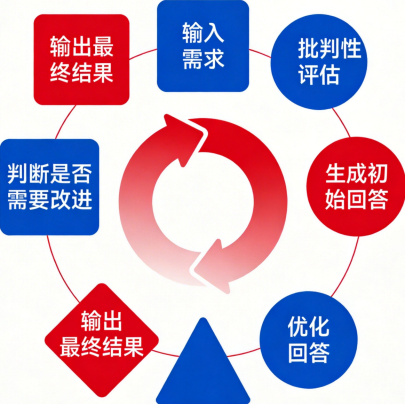

更有意思的是反思智能体模式。它不只是执行,还会自我改进:

红蓝循环优化图

这个模式适用于需要随时间推移不断改进的任务。Routine框架就用这种方式,通过生成→批判→优化的循环迭代,让GPT-4o的任务准确率从41.1%提升至96.3%。

多智能体协作模式

现实中的任务往往比较复杂,单智能体搞不定,这时候就需要多智能体协作。

监督者模式是最常用的多智能体架构。一个智能体担任主导,将任务分解后委托给专用智能体:

class SupervisorAgent:

def __init__(self):

self.sub_agents = {

'researcher': ResearcherAgent(),

'writer': WriterAgent(),

'editor': EditorAgent(),

'notifier': NotifierAgent()

}

async def process(self, user_input):

# 第一步:任务分解

subtasks = await self._decompose_task(user_input)

# 第二步:委派给专门的智能体

results = {}

for task in subtasks:

agent = self.sub_agents[task['agent_type']]

results[task['id']] = await agent.process(task['description'])

# 第三步:整合结果

final_output = await self._integrate_results(results)

return final_output

async def _decompose_task(self, user_input):

# 将大任务分解为子任务

pass

async def _integrate_results(self, results):

# 整合子任务的结果

pass这种方式在医院专家预约系统中很典型。监督者智能体调度检查可用性、检索医疗记录、生成摘要、发送通知等一系列智能体。

层级模式是监督者模式的扩展,引入了多层协调。顶层智能体处理高层目标,中层智能体分解任务,低层智能体执行。

竞争模式则很有意思。多个智能体独立处理同一问题,然后一个评估器选择最佳方案:

class CompetitiveAgentSystem:

def __init__(self):

self.competitors = [

CreativeWriterAgent(),

ProfessionalWriterAgent(),

CasualWriterAgent()

]

self.evaluator = EvaluatorAgent()

async def process(self, user_input):

# 所有竞争者独立工作

tasks = [agent.process(user_input) for agent in self.competitors]

candidates = await asyncio.gather(*tasks)

# 评估器选择最佳方案

best = await self.evaluator.evaluate(candidates, user_input)

return best这种方式适用于需要多样性的场景,比如生成营销文案。多个智能体生成不同风格的内容,A/B测试选择最佳。

软件工程范式的根本性重构

这些模式的背后,其实是软件工程范式的根本性重构。

传统软件工程的核心假设是:

• 软件的唯一智能主体是人类工程师

• 代码是人类长期理解、维护和演化系统的主要媒介

• 系统复杂性只能通过"人类可理解的抽象结构"进行控制

在这个前提下,设计模式的价值在于:

• 提高代码复用性

• 统一工程师的沟通语义

• 降低人类认知成本

但在AI时代,这些假设都被打破了。

AI能在系统级别进行上下文推理,对功能进行快速重构、拆分与重组,以"任务与行为"为中心进行理解。

这意味着,软件系统的主要维护者,正在从"未来的人类工程师"转变为"持续参与的大模型"。

因此,可维护性的核心不再是"这段代码是否优雅、是否符合某种模式",而是"系统是否能够被AI快速理解、精准定位、局部修改,而不产生不可控的连锁反应"。

维护对象,从"代码结构"上升为"系统行为结构"。

这带来了几个重要的变化:

设计模式的价值重定位

对AI来说,模式名称并不重要,抽象层级越深,理解成本越高,多职责聚合反而降低可重构性。

以Mediator模式为例。传统实践中,一个Mediator协调多个组件,Handler承担多个相关职责。

但在AI驱动下,更优结构是:

• 一个Handler = 一个明确、可独立演化的功能行为

• Handler之间通过显式、扁平、可观测的调度关系连接

• 协调逻辑可被AI随时拆分、合并或重写

经典Mediator模式中的"集中式协调",反而成了演化阻力。

从代码级优雅到系统级可维护性

这个转变让我想起之前写过的那篇《AI可以替我写,但不能替我想》。那篇文章的核心观点是:写作不是思考的记录,而是思考本身。

设计模式也是这样。它不是代码的记录,而是系统设计的思考方式本身。

在AI时代,这种思考方式的价值不再体现在代码级,而是体现在系统级:

细粒度、单一职责的功能单元 > 复杂模式

弱结构约束,强行为边界

为AI设计,而不仅是为人设计

接受持续重构,而非追求一次性完美设计

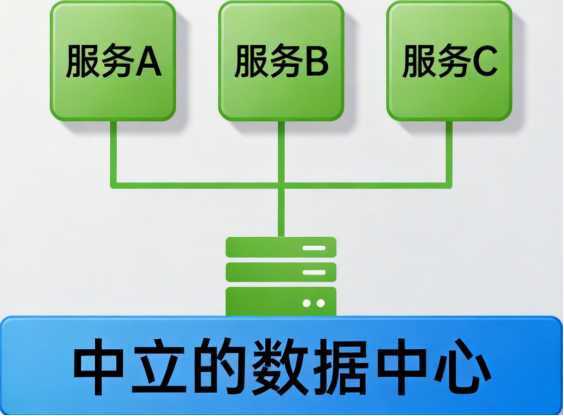

扁平化架构的兴起

这种范式转变,直接催生了扁平化架构。

传统的软件架构像一座层层嵌套的复杂迷宫,在过去帮助我们管理复杂性。但在AI驱动开发的新时代,我们需要一种全新的思路。

扁平化架构彻底摒弃了森严的等级,所有AI实现的子系统处于同一层级。子系统之间不直接沟通,而是通过一个中立的数据中心进行交流。

简洁网络拓扑

这对AI来说是理想的工作环境。每个任务上下文极简,完全独立,AI可以像在干净整洁的工作台上一样,高度专注。

对人类架构师来说,这是一张最清晰的系统地图。系统结构一目了然,复杂性被牢牢封装在每个独立模块内部,不会扩散。

维护一个子系统,问题要么出现在内部,要么在与数据层的关联上,绝对不会跨子系统。这大大降低了调试成本。

未来的设计模式

从代码模式到智能模式的进化,还没有结束。

接下来可能出现哪些新模式?

自演化模式

AI系统能够自动优化自身架构,无需人工干预。系统会根据运行数据,自动识别 可优化的模式,调整自身结构。

多模态融合架构模式

系统同时处理代码、文档、流程图等多维度数据,实现跨模态的模式识别和应 用。

可解释性增强模式

基于注意力机制的决策解析,让AI的设计决策变得可解释、可审计。

Gartner预测,到2027年,60%的架构决策将由AI辅助完成。Forrester的预测更乐观——到2028年,采用成熟AI架构推荐系统的企业,软件交付速度将比同行快3倍,运维成本降低45%。

但不管技术怎么发展,有一点不会变:

设计模式的核心价值,不在于"代码复用",而在于"认知压缩"与"演化杠杆"。

当模式被形式化、工具化、数据化后,它就从"经验口诀"升级为"可计算的系统 资产"。

而未来的软件工程,将从"如何写出能维护十年的代码",转向"如何构建一个能够被AI与人类共同、持续演化的应用系统"。

最后想说的话

2025年12月,Linus Torvalds用Google Antigravity vibe coded了AudioNoise工具的一个组件。他在README里说:"the Python visualizer tool has been basically written by vibe-coding."

连Linux之父都在用Vibe Coding,这个趋势已经不可逆转了。

但我想说的是,Vibe Coding不等于放弃思考。

AI可以生成代码,但代码的意义、系统的方向、架构的决策,仍然需要人来做判断。

设计模式,就是这种判断的框架。

我在用Claude Code构建写作工作流时,其实也用到了设计模式的思路——两层判断机制、9步流程、模块化协作。这不就是责任链模式、模板方法模式的变种吗?

但不同的是,这些模式不再是为了"代码复用",而是为了"让AI更好地协作"。

这就是AI时代设计模式的本质进化:从控制代码,到引导智能。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)