【必藏】小白到专家:一文搞懂Transformer架构与大模型落地实战指南

本文详细解析了Transformer架构的四大阶段流程,揭示了其三大"天生瓶颈":计算量平方增长、专业知识稀释效应和AI幻觉不可避免。针对这些局限,文章提出了垂直领域的三大落地策略:差异化规则设计、强化专业知识模块和合理切分上下文。通过深耕垂直领域,定制专属规则和知识,可在AI竞争中获得持久优势。

现在市面上几乎所有的大模型,比如chatGPT、豆包、kimi等用的都是transformer架构。同时越来越多的人对大模型感到好奇,却常被复杂原理吓退。“作为在 AI 领域创业 3 年的过来人,我将通俗易懂解的大白话说说 transformer 架构,帮助你快速理解其核心流程,并指出它的三大“天生瓶颈”,最后聊聊如何在垂直领域找到突破口。

Transformer 的四个阶段

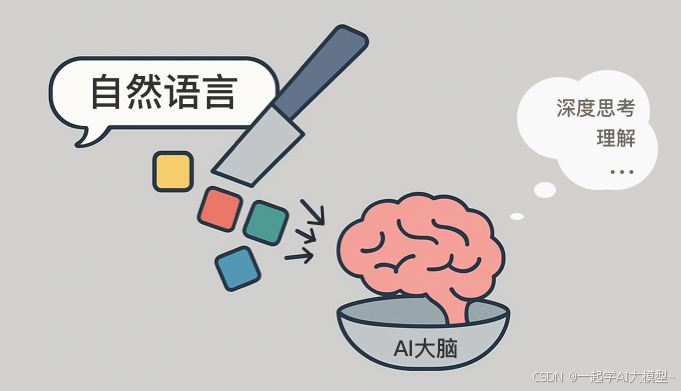

接收输入:向大模型输入一段自然语言,系统会将文本读入并进行编码。

拆解积木:模型会把你的输入像玩乐高一样拆成一个个“词的积木”。这些积木会被送进一个读过海量资料的AI大脑。一开始,它们彼此独立、还不知道彼此的关系;进入“大脑”后,它们开始相互“看见”、彼此联想与讨论,逐步挖掘更深层的含义。你可以把这一步想象成一个积木团队在做头脑风暴:目标只有一个——弄明白你这句话真正想表达什么。这是整个生成式AI中最“用脑”的环节。

组织答案:模型并不会一下子想好整段话,而是先判断“下一个最合适的字/词是什么”(这一步给出的是概率分布而非最终文字)。它脑海里出现的不是一个确定的字,而是一张可能性列表:比如A的可能性80%,B的可能性 30%……它会据此决定从哪里开口。所以这也是AI回答中出现幻觉或错误的原因。

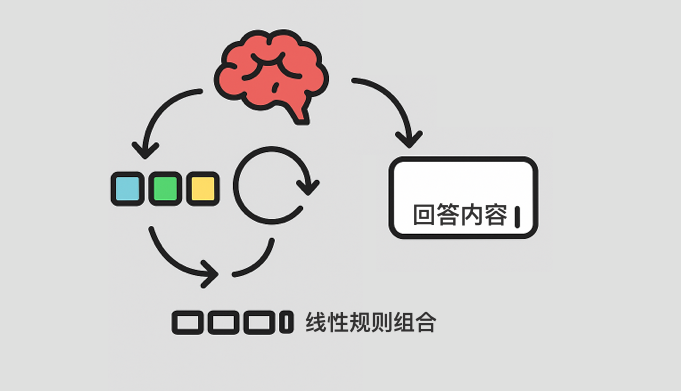

输出答案:接下来需要一个简单的“出字规则”把可能性落成文字。最直观的做法是:每一步都选“当前最可能”的那个字/词。选出第一个之后,再把“已经写出的内容”送回前面的“大脑”,和上下文一起再想一遍,继续决定第二个;第二个出来后,再带着前两个回去想第三个……周而复始,直到把一整段话写完。所以你会看到它是在一个字(或一个词)一个字/词地往外写——这不是故意为难人,而是它的工作方式。

以上就是 Transformer 大模型生成答案的基本流程。理解 Transformer 模型的工作原理很重要,因为其中包含了几个无法逾越的局限,而这些局限正是我们寻找机会驾驭AI的关键。

Transformer 的三大“天生瓶颈

尽管transformer展现出强大能力,但其架构内置了无法逾越的限制,恰恰是我们挖掘机会的切入点。

计算量呈平方增长

每次生成新词,都要把它和之前所有词再次一同计算,生成新词时,模型需要让该词与全部历史tokens做一次注意力计算(历史表征通常被缓存,不会反复重算),因此总计算/显存随长度近似O(n²);从1000到10000,整体成本可达约100倍量级提升。对于长上下文或复杂任务,成本和时延都将迅速攀升,最终遇到显存和带宽瓶颈。

专业知识“稀释”效应

大模型的预训练数据覆盖了海量互联网信息,但专业领域内容只占其中一小部分。纵然模型能在医学、法律等领域深度学习,也会被各种非专业信息“稀释”,从而影响回答的准确性与深度。一次专业问答,往往夹杂着大量无关信息,这一问题在推理阶段难以根除。

AI“幻觉”不可避免

幻觉的根源在于训练目标是「下一个词预测」(缺少“事实对错”的直接约束)且缺少外部事实校验:当证据不足或知识过期时,模型会补全最可能的续写;通过RAG/检索增强生成(先检索权威资料再作答)、工具调用(如计算器/数据库/搜索)、规则约束(限定可回答范围与格式)等手段可以显著降低,但要完全消除非常困难。

面向垂直领域的落地策略

以上三大局限并非坏事,反而为垂直领域应用提供了天然机会。深入行业的核心需求,定制专属规则和流程,能有效规避大模型的通用短板。从技术走向生意,三大局限共同指向一个结论:只要 Transformer 路线不变,垂直领域的 AI 应用就会长期存在,具备不可替代性与更高上限。

原因很简单:规则不可能覆盖所有情境,通用知识不可避免被稀释,而通用能力又有现实天花板。把 AI 放进行业自有的规则与流程里运行,能减少幻觉、稳定表现,这本质上是更务实的 Prompt Engineering 与系统设计。

差异化规则设计

通过精准的 Prompt 设计或内置领域逻辑,让 AI 按照行业特定流程回答,显著降低幻觉风险。先判断场景→再选模板→必要时调用工具。输出尽量结构化(要点/表格/JSON),对不确定内容给出处或人工复核。

强化专业知识模块

把领域内高质量资料(文献、手册、SOP/标准作业流程、内部知识库)做成检索插件(回答前自动从指定资料库里调取相关内容的工具)或微调数据(用你的专属数据再训练一下模型,让它更懂你的领域),聚焦深度与专注度,减少通用数据的干扰。必要时引入权限与版本管理,保证知识的时效与可信度。

合理切分上下文

对长文档进行分块摘要或知识图谱检索,在可控的上下文窗口内提供精准信息,平衡效率与深度。长文不整段塞,采用分块→召回→重排→去重,只把最相关片段送入上下文,并控制窗口长度,避免成本与时延暴涨。

需要提醒:并非所有垂直应用都适合深耕。复杂度不足、门槛较低的场景(如简单翻译/通用摘要)很容易被通用大模型覆盖。另外,市场上相当多的 AI 项目最终并未达到预期,因此要尽量聚焦高价值、数据可控的细分领域,以差异化能力赢得认可。

结语

–

大模型的能力天花板、知识稀释与幻觉机制并非阻碍,而是产业创新的切入口。只要我们深耕垂直领域,定制专属规则和知识,加强专业模块,就能在 AI 竞争中获得持久优势。创业者应将通用模型视作强大底盘,将差异化应用打造成独家利器,把握 AI 时代的最佳商机。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

更多推荐

已为社区贡献465条内容

已为社区贡献465条内容

所有评论(0)