VLM大模型入门指南:对比学习小白必看,收藏学习!

本文介绍了视觉语言模型(VLMs)的核心概念——对比学习,以及它是如何颠覆传统计算机视觉模型的。文章从旧范式基于固定类别的视觉训练谈起,阐述了对比学习如何通过学习事物之间的关系而非僵化定义来提升模型智能。详细解释了对比学习的工作原理、数学原理、零样本学习等关键点,并探讨了其在现实世界中的广泛应用和局限性。通过本文,读者可以了解到对比学习如何推动大模型的发展,以及AI未来的发展方向。

本文介绍了视觉语言模型(VLMs)的核心概念——对比学习,以及它是如何颠覆传统计算机视觉模型的。文章从旧范式基于固定类别的视觉训练谈起,阐述了对比学习如何通过学习事物之间的关系而非僵化定义来提升模型智能。详细解释了对比学习的工作原理、数学原理、零样本学习等关键点,并探讨了其在现实世界中的广泛应用和局限性。通过本文,读者可以了解到对比学习如何推动大模型的发展,以及AI未来的发展方向。

01

引言

当你第一次使用视觉语言模型(Visual Language Models, VLMs)时,它们简直像魔法一样。你上传一张特定汽车零件或某种稀有热带水果的照片,用普通的英文问一句“这是什么?”,它就能立刻给出答案——毫不犹豫,也不会弹出“不支持此类别”的错误提示。

但说实话,这种看似智能的表现背后,其实是一个相当简洁的核心理念。它并非通过像素级记忆来识别物体,而是通过对比来学习。它理解的是事物之间的关系,而非僵化的定义

这个理念就是对比学习,它正是驱动现代人工智能的真正引擎。若想理解我们如何从只能识别1000种物体的“笨拙”图像分类器,进化到能探讨抽象艺术的GPT-4o等智能模型,就必须读懂这场变革。

02

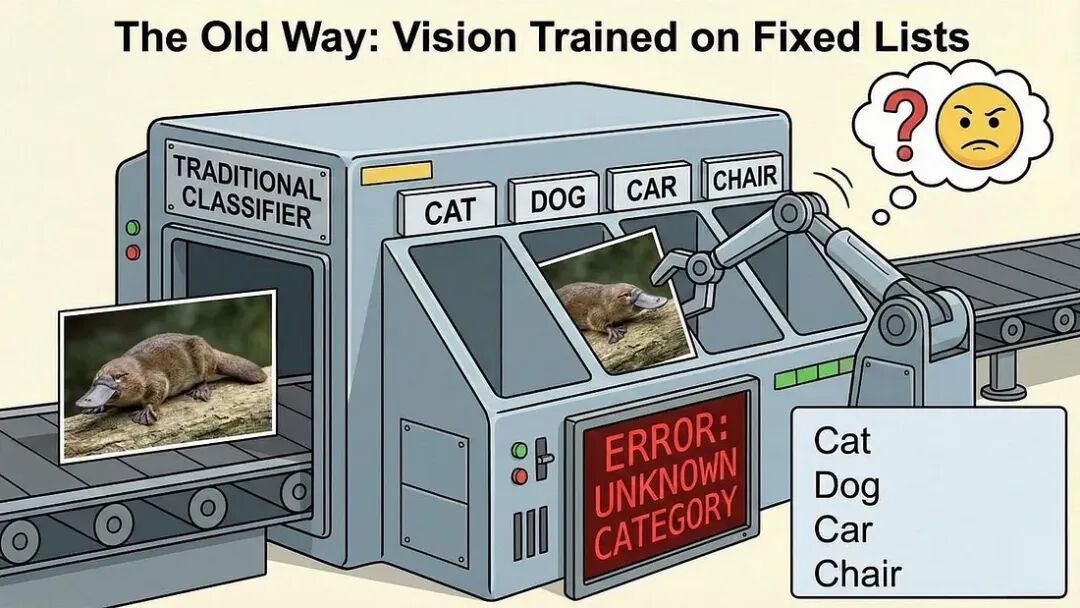

旧范式:基于固定类别的视觉训练

在过去(比如2018年,这在AI领域堪称远古时期),传统的计算机视觉模型以一种极为受限的方式学习。这基本上就像是为计算机准备的单项选择题测试,只不过计算机永远无法跳过问题或回答“我不知道”。

你输入一张图片,它就会输出一个标签。

- 猫

- 狗

- 汽车

- 椅子

该模型对世界的全部理解,都被限制在这些预定义的类别中,这些类别通常来自像包含大约1000个标签的ImageNet这样的数据集。可以把它想象成一个恰好有1000个插槽的邮件分拣机,每个插槽都在出厂时被编号和贴好标签。如果你寄出一个“鸭嘴兽”,但分拣机只有“海狸”和“鸭子”的插槽,机器就会不知所措。它会选择看起来最接近的那个,即使两者都完全不正确。

这种方法在处理特定、狭窄的任务时效果尚可,比如在自动驾驶中识别停车标志等。如果你的问题恰好符合那些预定义的类别,大家甚至可以获得95%以上的准确率。

但它无法扩展到现实世界。现实世界是杂乱无章、无限且不断演变的。你不可能为存在的每一个物体、场景、概念、风格或变体都列出其类别清单。那么“一个涂满涂鸦的生锈停车标志”呢?一幅“罗斯科风格的抽象表现主义画作”呢?或者一个“显示困惑的猫看着沙拉的迷因”呢?

旧范式之所以失效,是因为世界本身就没有固定的标签。而且,人类当然也不是以这种方式来体验视觉的。当你看到新事物时,你不会因为它在你的心理目录中不存在而认知失败。你会描述它,将它与你已知的事物进行比较,并通过上下文来理解它。旧的模型根本无法将鸭嘴兽识别为鸭嘴兽,因为它根本没有为它设置相应的插槽。

03

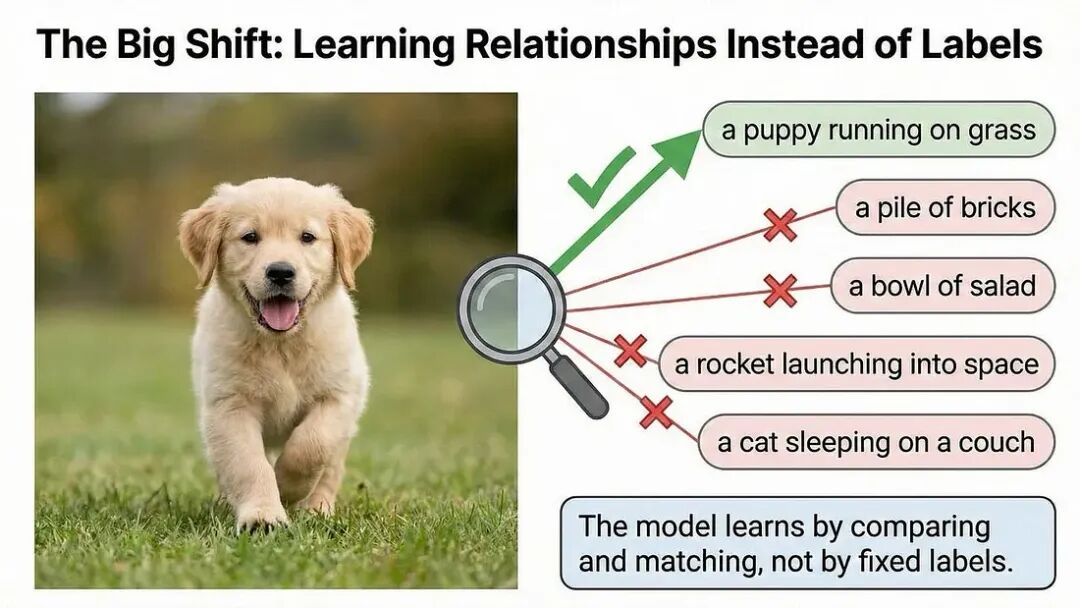

转变:学习关系而非标签

对比学习彻底颠覆了问题本身,这种方法事后看来似乎显而易见,但在当时却是革命性的。

它不再问“这张图片属于哪个标签?”,而是让模型思考:“哪段文本描述与这张图片最匹配?”

同样重要的是,它还会问:“哪些文本与这张图片不匹配?”

它将学习过程变成了一场“找不同”或“配配对”的游戏,而不是死记硬背。模型会观察一张图片和一堆文本片段,然后试图弄清楚哪些是天然匹配的,哪些则不匹配。

这之所以至关重要,是因为它模仿了人类(作为儿童时)实际学习语言和视觉概念的方式。你并不是在记忆一个查询表。你是在看着狗的时候,反复听到“那是一只狗”,在不同情境下(大狗、小狗、奔跑的狗、睡觉的狗)听到数十次,然后你的大脑通过与“不是狗”的事物进行对比,学习到了模式,即“狗”的本质。

这里的洞见非常深刻:意义源于关系,而非定义。狗之所以是狗,并非因为它带有某种内在的“狗身份标签”,而是因为它与其他狗的相似度,要高于它与猫、马或自行车的相似度。语言也是如此。“狗”这个词的意义,源于它如何使用得与“猫”、“小狗”、“狼”等词语不同。

对比学习在大规模层面上实现了这一洞见。

04

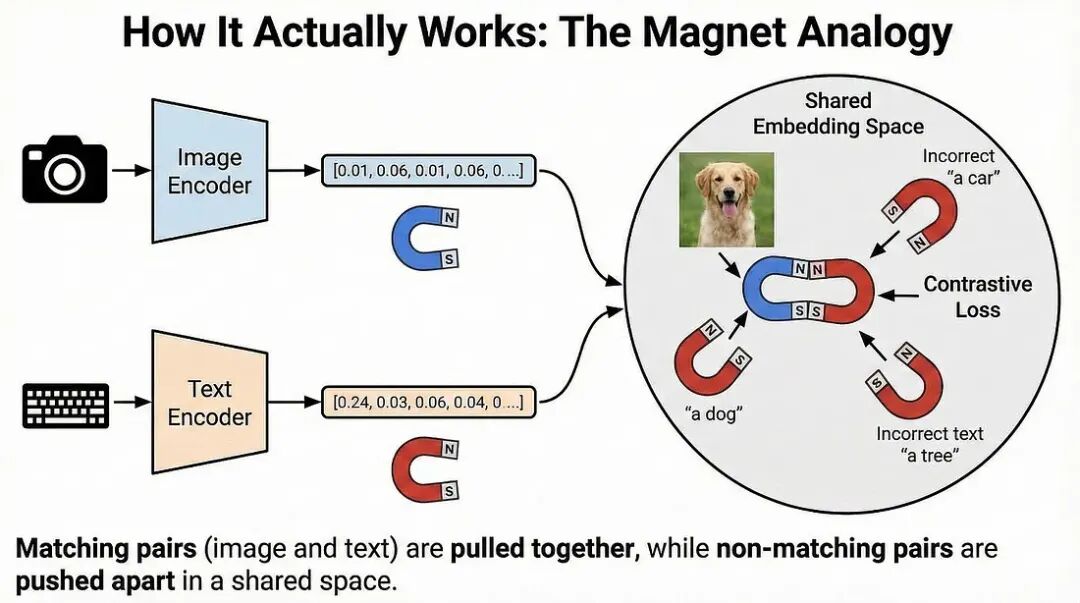

具体工作原理

大家无需了解复杂的数学原理也能理解其核心思想,不过我们稍后还是会稍微深入探讨一下。现在,不妨把它想象成磁铁的作用。

从高层抽象来看,像CLIP(对比语言-图像预训练)这样的模型使用了两个编码器:

- 图像编码器:将图片转换成一串数字(一个向量)。可以把它看作是图像的512维或1024维。

- 文本编码器:将文本转换成位于同一维度空间中的一串数字。

为什么需要两个独立的编码器?

这两个编码器之所以从不同的架构开始,是因为图像和文本本质上是不同的数据类型。视觉处理通常使用针对二维结构调整的卷积网络或Transformer,处理按网格排列的像素。而文本处理则使用为序列化词元构建的Transformer模型,按顺序处理词语。

但关键在于:它们最终会投射到同一个共享空间中,这使得比较成为可能。训练过程迫使这两种截然不同的数据类型使用同一种数学语言。这就好比让一位西班牙语使用者和一位普通话使用者,都通过学习一种通用的中间语言来进行沟通。

“维度”到底意味着什么?

当我们说“512维向量”时,这意味着什么?每一个维度都捕捉了图像或文本的某个学习到的特征。有些维度可能大致对应我们能够识别的概念——比如“毛茸茸的程度”、“金属感的程度”或“户外的程度”——但大多数维度代表了我们难以命名的抽象模式。这些维度是模型通过训练自行发现的。可以把它们想象成512种衡量和描述图像或文本内容的不同方式。

投影头:最后的转换层

在编码器创建了它们的初始表示之后,这些向量会经过一个额外的小型神经网络,称为“投影头”。这最后一层将表示映射到实际发生比较的共享嵌入空间中。可以把它想象成一个翻译器,确保两种模态最终使用完全相同的“方言”,拥有相同的词汇和语法规则。

图像编码器可能自然地产生强调视觉纹理和颜色的向量,而文本编码器可能强调词语之间的语义关系。投影头则将它们重新塑造成一种可以直接进行有意义的比较的通用格式。

魔力在训练中发生

模型选取一张图像(比如一张金毛幼犬在草地上奔跑的照片),并将其与正确的标题配对:“一只在草地上奔跑的幼犬”。这是一个正样本对。

训练目标简单而强大:将这些向量拉近。就像磁铁的南北极相互吸引一样,模型调整其内部参数,使得图像的数值表示与文本的数值表示变得更加相似。

与此同时,它看着这张幼犬照片,并将其与批次中其他图像的随机标题(如“一堆砖头”、“一碗沙拉”、“一枚发射入空的火箭”)进行比较。这些是负样本对。

模型将这些向量推远,就像两个北极相互排斥一样。你希望不匹配的事物之间的距离最大化。

批处理如何创造规模化

这就是其效率变得显著的地方。在一个比如包含32,768张图像及其对应标题的训练批次中,你会自动获得32,768个正样本对(每张图像与其正确的标题)。但同时,你也会获得32,768 × (32,767) = 超过10亿个负样本对——批次中的每张图像都与所有其他标题进行比较。

这种海量的比较是并行发生的,这就是为什么现代对比学习需要强大的计算能力,但扩展效率却如此之高。模型并不是在进行数十亿个独立的训练步骤。它只处理一个批次,而在这个批次中,数十亿次比较会同时影响学习过程。

迭代式的精细化过程

这不是一次性的比较。模型在每个批次后,会按照减少损失的梯度方向,对数百万个内部权重进行微调。损失是衡量当前预测错误程度的数学指标。经过数千个批次和数十亿个示例的处理后,一个非凡的事物涌现出来:一个共享的嵌入空间。这是一个图像和语言能够共存的数学领域。

在这个空间里,一张金毛猎犬的照片最终会出现在短语“一只在外玩耍的狗”旁边。这个簇附近还有“小狗”、“寻回犬”、“宠物”等概念。它距离“跑车”、“摩天大楼”或“量子物理”则非常遥远。

模型并不是在死记硬背。它是在通过纯粹的对比,构建一幅意义的语义空间。

05

数学原理

如果你好奇其内部机制,这里有一个简化的版本。

其核心函数被称为对比损失,通常特指InfoNCE损失。不用纠结这个名字。它的作用如下:

对于批次中的每张图像,模型会使用一种相似度度量方法(通常是余弦相似度,它衡量的是两个向量之间的夹角)来计算该图像与每一个文本描述的相似程度。

为什么偏偏用余弦相似度?

余弦相似度测量的是向量之间的角度,而忽略它们的长度(模长)。这之所以重要,是因为我们关心的是嵌入空间中的方向,而不是绝对大小。

想象两个向量指向不同方向的箭头。如果它们指向相同方向,就表示相似(余弦相似度为1)。如果指向相反方向,则表示不相似(余弦相似度为-1)。如果它们互相垂直,则表示不相关(余弦相似度为0)。

这种归一化处理至关重要。这意味着模型不会被诸如图像亮度(可能使所有像素值变大)或文本长度(可能使文本向量变长)等无关因素所迷惑。我们只关心语义方向。

推拉动态

模型希望正确的图像-文本对具有高相似度,而所有不正确的配对具有低相似度。每当一个正确配对的相似度不够高,或者一个错误配对的相似度太高时,损失函数就会惩罚模型。

这就产生了一种推拉动态。在训练过程中,模型不断进行调整,以最大化匹配对与非匹配对之间的差距。它正在学习判别性特征。是什么让狗明确地成为狗,不仅是在一般意义上,而且是特别地通过与“非狗”事物进行对比来体现的。

双向对称性

对比损失是对称的——它既将图像拉向文本,也将文本拉向图像。这种双向性至关重要。这意味着你之后可以在任一方向进行搜索:寻找与文本匹配的图像,或者寻找与图像匹配的文本。这种对称性正是逆向图像搜索、视觉问答和文本到图像检索等功能的基础。这种关系是双向的。

温度参数:控制置信度

还有一个显著影响学习过程的调节旋钮:温度参数(论文中通常记为 τ)。

模型使用这个“温度”设置来控制它需要达到的置信度。低温度意味着模型被迫做出尖锐的区分——正确配对必须比错误配对相似得多。模型会变得非常果断,其判断几乎是黑白分明的。

高温度则更为宽容,允许存在较模糊的边界。模型可以更加不确定,接受某些错误配对可能与正确配对有一定程度的相似性。这在训练初期,当模型仍在摸索时很有用。

这个看似不起眼的旋钮对模型的学习内容有着巨大影响。温度过低,模型可能会过度关注细微细节。温度过高,它学习到的表示可能过于粗略,从而错过重要的区分点。

排序的力量

这与传统的监督学习不同之处在于,你并不是在教模型一个单一的“正确答案”。你是在教它如何对选项进行排序。对于给定的图像,它更像“日落时分的海滩”还是更像“拥挤的地铁车厢”?模型通过数百万次这样的比较判断来学习。

这种排序方法出奇地稳健。即使标题并非完美(比如,一张严格来说是狼的图片,标题却写着“一只狗”),模型仍然能学到有用的东西,因为“一只狗”远比“一架直升机”要正确得多。

困难负样本:具有挑战性的比较

并非所有负样本对对于学习都具有同等的价值。“一只小狗”与“一艘火箭”的区别很容易——容易到无法提供有效信息。模型从困难负样本中学到的东西更多,例如:“一只小狗” vs. “一只小猫” 或 “一只狼崽”。

这些具有挑战性的比较迫使模型学习细粒度的差异。除了都是年幼的毛茸茸动物之外,究竟是什么让一只小狗不同于一只小猫?先进的实现方法会在训练过程中主动挖掘这些困难负样本,特意找出最易混淆的例子来展示给模型。

这就像为考试而学习。你从那些明显错误的题目中学不到太多东西。你从那些需要仔细思考的棘手题目中学习。

06

打破“封闭世界”的桎梏

这里有一个容易被忽略的哲学层面的重要性:传统的视觉模型生活在一个封闭的世界里。它们的运作基于一个假设,即每一个可能的输入都能被归入某个预定义的类别。这在人工智能中被称为“封闭世界假设”。

但现实世界是一个开放的世界。新事物层出不穷:新的网络俚语、新的时尚潮流、新的迷因、新的产品、新的艺术风格。一个在2020年基于固定标签训练的模型,对于此后出现的任何事物都将完全无法识别。

对比学习正是解锁“开放词汇识别”能力的关键。

你可以构建一个拥有数十亿参数的历史上最大的视觉模型,但如果没有这种与语言的对比对齐,它仍然被困在笼子里。它只能看到被明确教导过的事物。

通过对比学习,模型能够识别出从未见过明确标签的事物,因为它已经学习了视觉和语言两者更深层的组合结构。

它知道“毛茸茸的”看起来像什么。它也知道“猫”看起来像什么。因此,即使它在训练过程中从未见过“毛茸茸的猫”这个确切的短语,它也能通过组合这些概念来推断出它应该是什么样子。

这就是死记硬背与理解之间的区别。或者,至少,是向理解迈进了一步。

07

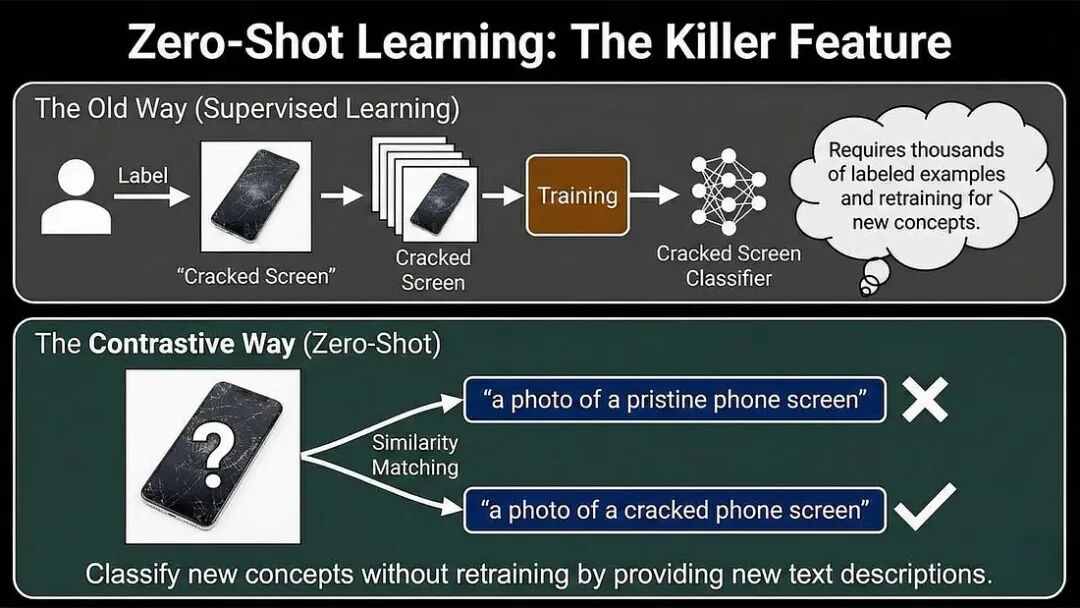

零样本学习

这正是对比学习从“有趣的技术”转变为“改变一切的力量”的关键所在。

零样本学习意味着模型能够执行一项它从未被明确训练过的任务。无需微调,无需标注数据集,仅凭从其学习到的表示中进行纯粹推理。

假设你想为维修店的质量控制构建一个“iPhone屏幕破裂”检测器。

- 传统方法:

你需要收集5000多张屏幕破裂的照片。雇人手动标注。训练一个定制模型(既昂贵又耗时)。寄希望于你的模型能泛化到未见过的破裂模式。当它在边缘案例上失败时,才意识到需要更多数据。然后重复整个过程。

- 对比学习方法:

向VLM输入一张图片。给它两个文本提示:“一张完好无损的手机屏幕照片”和“一张屏幕破裂的手机照片”。模型会检查其内部的嵌入空间。这张图像的向量更接近“完好无损”的文本向量,还是更接近“破裂”的文本向量?判断完成。

瞧!你立刻就拥有了一个功能完备的分类器。无需新的标签,无需训练时间,无需让GPU连续运行数天。仅仅是比较而已。

这种方法适用于任何你能用语言描述的事物:

- “一张假冒产品的照片”对比“一张正品的照片”

- “一张显示肿瘤的医学扫描图”对比“一张健康的扫描图”(尽管你可能需要验证)

- “一幅文艺复兴时期的画作”对比“一幅印象派画作”

- “一个基本停满的停车场”对比“一个基本空着的停车场”

其影响是巨大的。你可以用几分钟就快速构建出新的应用,而这在旧式的监督学习模式下可能需要数月时间。这就是VLM在各行各业的应用呈爆炸式增长的原因。

08

实现规模化

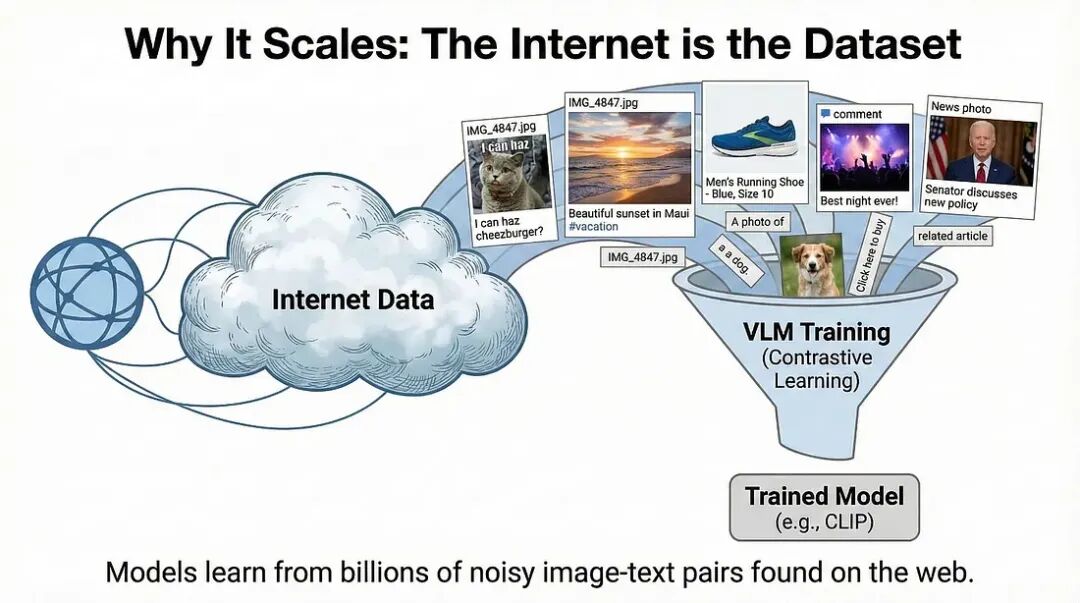

这项技术之所以能主导现代人工智能领域,还有一个现实原因:数据极其丰富。

旧模型需要人工辛苦地标注数据:在物体周围绘制边界框,一张一张地给图片打标签,进行分类、贴标签、质检。这个过程成本高昂(需要众包工人或专业标注员)、速度缓慢(受限于人类瓶颈)、容易出错(标注工作主观且枯燥),并且无法规模化(你不可能把整个互联网都标注完)。

但对比学习直接利用互联网本身来运行。网上有数十亿带有标题、替代文本、标题或上下文信息的图像。它们并不完美,很多嘈杂、模糊不清,甚至完全是错的。例如,“IMG_4847.jpg”就不是一个好标题。但它们数量庞大。

关键洞察:对噪声的容忍度

由于学习是基于相对性的,因此模型对噪声的容忍度非常高。

标题不必是完美的诗句,甚至不需要100%准确。它只需要比随机的一句话更匹配图像就行。

当你在数以百万计的样本上同时训练时,只要噪声是随机且无偏的,它们就会在统计上相互平均抵消。正确的模式通过重复得到加强,而随机的错误则会在统计上抵消。

然而,有一个重要的警告:系统性偏差不会平均抵消。如果大多数医生的图像都显示男性,而大多数护士的图像都显示女性(互联网上的情况确实如此),那么这种偏差就会累积,而不是抵消。模型会把这种偏差当作真理来学习。我们将在后面的局限性部分回到这个问题。

数据增强:学习不变性

模型还会看到同一图像的不同增强版本——裁剪、颜色偏移、旋转、模糊、对比度变化。这教会它关注语义内容,而不是肤浅的细节。无论照片是亮是暗、是居中还是裁剪、是从上还是从侧面拍摄,狗仍然是狗。

这种增强策略对于泛化能力至关重要。没有它,模型可能会认为“海滩”总是意味着阳光明媚的照片,从而无法识别阴天里的海滩。

互联网作为训练场

这使得公司能够利用从网络上抓取的海量、杂乱的数集据进行训练。这些数据集足以让传统的监督模型彻底崩溃。CLIP就是在互联网上的4亿个图像-文本对上训练出来的。你永远无法手工标注那么多图像。但你可以利用网络上现有的结构。

互联网就成了你的训练集。全人类集体加注标题的努力(每条Instagram帖子、每张维基百科图片、每个产品描述)都变成了机器学习燃料。

09

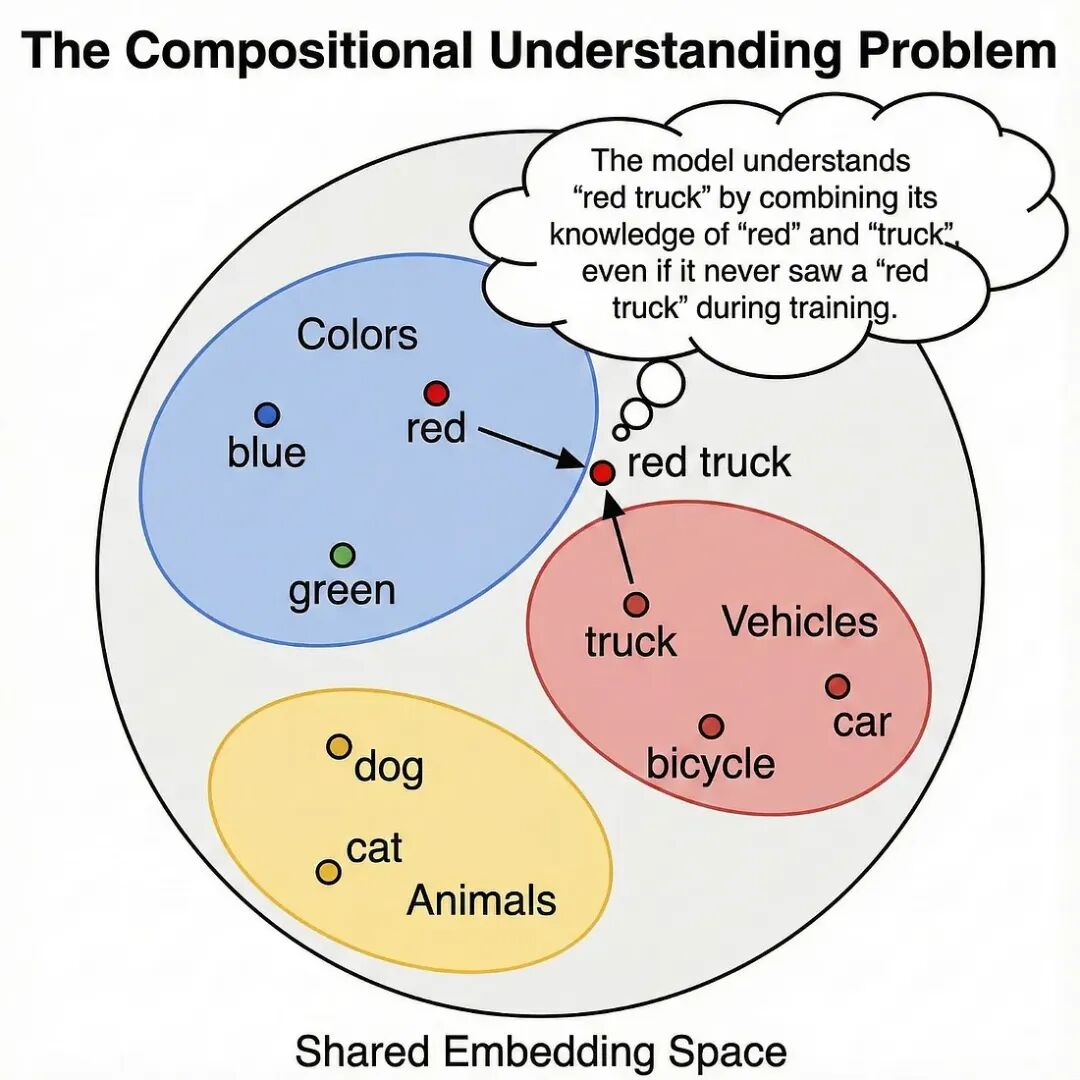

组合泛化能力

让我们深入探讨一个微妙但至关重要的问题:组合泛化能力。

人类的语言是具有组合性的。即使我们从未见过“蓝色的车”这两个词确切地组合在一起,我们也能理解它,因为我们分别知道“蓝色的”和“车”的含义。即使我们可能从未亲眼见过“一只戴着太阳镜、踩着滑板的狗”这个场景,我们也能解析出这句话的意思。

对比学习赋予了模型这种超能力的初级版本。

由于模型在一个共享空间中学习了视觉特征和文本特征,它能够以新颖的方式组合概念。如果它学会了“红色”的样子(来自“红苹果”、“红色汽车”、“红色夕阳”),并且知道了“卡车”的样子(来自“送货车”、“皮卡”、“消防车”),那么即使它在训练过程中从未见过“红色卡车”这个确切的短语,它也能推断出“红色卡车”应该是什么样子。

- 几何特性

嵌入空间具有令人惊讶的几何特性。概念会聚集在一起。有动物的“区域”、车辆的“区域”、情感的“区域”。相似的概念最终会彼此靠近,并非因为有人这样编程,而是因为它们在训练过程中出现在相似的语境中。

有时,向量运算甚至能生效:“狗”的向量减去“小狗”的向量再加上“猫”的向量,结果可能落在“小猫”附近。“小狗之于狗,如同小猫之于猫”这种关系会在几何结构中自然涌现。这并非绝对保证——该空间并非完美的线性——但这些规律性确实从纯粹的对比中浮现出来,这非常了不起。

想象一下嵌入空间的二维投影:狗的照片聚集在一个区域,猫的照片在其附近,车辆的照片在完全不同的另一个区域,而风景照片又在另一个区域。文本描述也存在于这些相同的区域。“一只快乐的狗”就位于狗群聚集的区域。“一辆红色跑车”则位于车辆区域。这种空间组织结构编码了语义的相似性。

- 不仅仅是死记硬背

这与死记硬背不同。模型并非从数据库中检索“红色卡车”。它通过在嵌入空间中导航,计算找到“红色属性”和“卡车属性”的交集来得出结果。

这种组合能力并非完美(稍后会详述其局限性),但正是它让这些模型感觉“聪明”,而不仅仅是巨大的查找表。它们能够处理组合爆炸问题。仅凭1000个视觉概念和1000个描述性词语,理论上就能组合出数百万个有意义的组合。

10

现实世界的影响

让我们来谈谈影响,因为这不仅仅是学术界的空谈。对比学习从根本上改变了生产级AI系统的能力范围。

- 内容审核:像Meta和谷歌这样的公司利用VLM来检测违反政策的内容,而无需手动定义每一种违规情况。他们不再需要为“仇恨符号”、“暴力画面”、“自残内容”等分别训练模型,而是可以用文本描述概念,让模型进行匹配。

- 无障碍功能:为视障用户生成替代文本的能力得到了显著提升。VLM不再生成像“户外场景”这样笼统的标签,而是能够生成描述性的文字,例如“日落时分,一个穿着红色夹克的人站在山巅远眺”。

- 电商搜索:现在你可以用自然语言搜索产品目录(如“100美元以下的舒适跑鞋”),甚至上传照片进行搜索(如“找类似款,但要蓝色的”)。传统的搜索需要精确的关键词匹配或手动打标签。

- 医学影像:放射科医生可以用他们正在寻找的描述来查询图像数据库,即使没有明确的诊断标签,模型也能调出相关的病例。

- 创意工具:像Photoshop这样的设计软件利用VLM实现了基于文本的选择功能(例如“选择这张图片中的所有植物”),而无需手动抠图。

- 制造质量控制:工厂使用VLM检测缺陷时,只需简单描述缺陷的样子,而无需为每一种可能的故障模式收集数千个带标签的示例。

- 野生动物保护:研究人员可以使用文本描述来搜索相机陷阱拍摄的特定动物行为或稀有物种的影像,极大地加速了生态学研究。

所有这些应用都有一个共同点:灵活性。模型通过语言来适应你的需求,而不是为每个用例都耗费数月进行定制训练。

更广阔的多模态愿景

同样的原理不仅限于视觉和语言。现代模型利用对比学习来对齐音频、视频、3D形状、传感器数据、蛋白质结构——任何可以数值编码的模态。

想象一下,你可以要求“找一些某人听起来很沮丧的视频片段”,模型就能搜索音频。或者“展示与这个椅子设计相似的3D模型”,它就能理解形状。其愿景是构建一个通用嵌入空间,任何类型的数据都可以相互比较,所有数据都可以通过自然语言进行搜索和组合。

我们尚未完全实现这一目标,但对比学习已经铺平了道路。

11

局限性分析

让我们坦诚地谈谈局限性,因为理解对比学习做不到什么,与理解它能做什么同样重要。

难以处理细粒度细节

由于模型是从网络规模的标题中学习的,它关注的是整体的“调性”或主要对象。人们不会用精确的细节来给图片加标题。你得到的是“树枝上的一只鸟”,而不是“一只栖息在橡树枝上的雄性幼年家麻雀”。

这意味着:

计数出奇地困难。“这个碗里有多少个苹果?”常常得到错误的答案。模型学习了“苹果”这个概念,但没有通过图像-文本配对学会数数。标题很少会明确说明具体的数量。空间关系也很棘手。“杯子在勺子的左边还是右边?”可能会让模型感到困惑。标题很少指定精确的空间布局。它们会说“桌子上的一个杯子和一把勺子”,但不会说“勺子左边的一个杯子”。

细微的区分会失败。区分相似的鸟类或狗的品种需要细粒度的视觉特征,而这些特征在粗粒度的对比学习目标中被模糊化了。模型非常了解“鸟”,但要区分“家麻雀”和“歌带鹀”则困难得多。

一些结合了空间区域注意力机制的新架构在这方面有所改进,但这仍然是一个挑战。

关联不等于理解

模型知道“宇航员”和“马”在视觉上是相关的,因为它在训练期间看到了科幻艺术。但它并不真正理解为什么马实际上不能在太空中生存的物理学原理。这是模式匹配,而非推理。

同样,它可能会将“海滩”与“阳光”联系起来,因为网上大多数海滩照片都显示晴天,但它可能无法识别出雾天的海滩仍然是海滩。

偏见放大

由于训练数据来自互联网,互联网上所有的偏见也会随之而来。刻板印象(医生是男性,护士是女性,CEO是年长的白人男性等)被植入了嵌入空间。

这一点尤其有害,因为这些偏见并非被明确编程进去的——它们是从训练数据的统计模式中浮现出来的。模型学习互联网展示给它的东西,而互联网反映了历史上和持续存在的社会偏见。

解决这个问题需要精心的数据集筛选、去偏技术,并承认“从互联网学习”意味着在获取知识的同时也继承了它的缺陷。

图像中的文字

具有讽刺意味的是,以这种方式训练的模型可能难以处理图像中实际出现的文本。一张“STOP”标志的照片可能不会像识别其红色八边形形状那样强烈地识别出“STOP”这个文字,因为模型学习的是图像和标题之间的视觉-语言对齐,而不是OCR(光学字符识别)。

图像编码器将字母视为视觉模式,而非语言符号。要真正“阅读”图像中的文本,你需要针对该任务进行额外的训练。

损失函数的盲点

对比学习优化的是相似度匹配。如果两个非常不同的图像同样好地匹配同一个模糊的标题,模型可能无法学会区分它们。这可能导致模式坍缩(模型学习了过于通用的表示)或特征忽略(某些视觉属性被忽视)。

例如,如果大多数标题只写“一个人”,而不提及年龄、种族或服装,那么模型可能无法强烈地学习对这些属性进行编码,尽管它们在视觉上是存在的。

12

总结

无论你是初学者、实践者,还是只是想了解AI发展方向的普通人,以下是你需要记住的:

视觉语言模型之所以令人印象深刻,并不是因为它们比旧模型“看得更清楚”。事实上,有时它们在原始像素级别的视觉能力,技术上还不如为特定任务训练的专业分类器。

它们令人印象深刻,是因为它们能更好地进行比较。它们能将事物的外观与词语的含义联系起来。

这个区别至关重要。它意味着AI的未来不在于构建更大的孤立模型,而在于构建能够通过共享表示连接不同模态的模型。

语言成为通用的桥梁。它不仅仅是一个附加功能,而是使视觉模型变得有用、灵活和通用的核心推动力。

我们正在从脆弱的、任务特定的AI,转向流畅的、与任务无关的、可以用语言引导的AI。你无需为了识别一个新的对象类别而重新训练模型,只需描述它即可。模型会在它已经学习到的嵌入空间中找到它

最后

我在一线科技企业深耕十二载,见证过太多因技术更迭而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。

我整理出这套 AI 大模型突围资料包:

- ✅AI大模型学习路线图

- ✅Agent行业报告

- ✅100集大模型视频教程

- ✅大模型书籍PDF

- ✅DeepSeek教程

- ✅AI产品经理入门资料

完整的大模型学习和面试资料已经上传带到CSDN的官方了,有需要的朋友可以扫描下方二维码免费领取【保证100%免费】👇👇

为什么说现在普通人就业/升职加薪的首选是AI大模型?

人工智能技术的爆发式增长,正以不可逆转之势重塑就业市场版图。从DeepSeek等国产大模型引发的科技圈热议,到全国两会关于AI产业发展的政策聚焦,再到招聘会上排起的长队,AI的热度已从技术领域渗透到就业市场的每一个角落。

智联招聘的最新数据给出了最直观的印证:2025年2月,AI领域求职人数同比增幅突破200% ,远超其他行业平均水平;整个人工智能行业的求职增速达到33.4%,位居各行业榜首,其中人工智能工程师岗位的求职热度更是飙升69.6%。

AI产业的快速扩张,也让人才供需矛盾愈发突出。麦肯锡报告明确预测,到2030年中国AI专业人才需求将达600万人,人才缺口可能高达400万人,这一缺口不仅存在于核心技术领域,更蔓延至产业应用的各个环节。

资料包有什么?

①从入门到精通的全套视频教程⑤⑥

包含提示词工程、RAG、Agent等技术点

② AI大模型学习路线图(还有视频解说)

全过程AI大模型学习路线

③学习电子书籍和技术文档

市面上的大模型书籍确实太多了,这些是我精选出来的

④各大厂大模型面试题目详解

⑤ 这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

所有的视频教程由智泊AI老师录制,且资料与智泊AI共享,相互补充。这份学习大礼包应该算是现在最全面的大模型学习资料了。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

智泊AI始终秉持着“让每个人平等享受到优质教育资源”的育人理念,通过动态追踪大模型开发、数据标注伦理等前沿技术趋势,构建起"前沿课程+智能实训+精准就业"的高效培养体系。

课堂上不光教理论,还带着学员做了十多个真实项目。学员要亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓**

更多推荐

已为社区贡献816条内容

已为社区贡献816条内容

所有评论(0)