GitHub开源项目周报 · 2026年第6周(2026-02-02 ~ 2026-02-08) · 本期榜单聚焦AI代理与本地化检索

本期榜单主要项目聚焦 AI 代理与本地化检索等方向。超过10000星的项目有 Shannon、OpenClaw、Claude-Mem、ChatDev、nanochat、PageIndex 等,覆盖企业安全、私有助手、记忆注入、协作编排与长文档检索等场景。其中每天增长100星以上的项目包含 OpenClaw、nanochat、QMD、Claude-Mem,OpenClaw 日增最高,达到 2310.

本期榜单主要项目聚焦 AI 代理与本地化检索等方向。超过10000星的项目有 Shannon、OpenClaw、Claude-Mem、ChatDev、nanochat、PageIndex 等,覆盖企业安全、私有助手、记忆注入、协作编排与长文档检索等场景。其中每天增长100星以上的项目包含 OpenClaw、nanochat、QMD、Claude-Mem,OpenClaw 日增最高,达到 2310.59 星/日,反映出对隐私与本地化能力的强烈需求。总体呈现 AI 助手生态快速扩展与高效工作流的持续关注。

根据Github Trendings的统计,共有以下项目上榜:

| 排名 | 项目名称 | 项目语言 |

|---|---|---|

| 1 | Shannon:全自动 AI 渗透测试与漏洞利用工具 (KeygraphHQ/shannon) | TypeScript |

| 2 | OpenClaw:本地运行的个人 AI 助手 (moltbot/moltbot) | TypeScript |

| 3 | Codex 技能目录与安装指南 (openai/skills) | Python |

| 4 | Claude-Mem:Claude Code 的持久记忆与上下文注入插件 (thedotmack/claude-mem) | TypeScript |

| 5 | AI Agent Toolkit:编码代理 CLI、统一 LLM API、TUI/Web UI 与 (badlogic/pi-mono) | TypeScript |

| 6 | Claude Code Hooks:对 Claude Code 行为的确定性与扩展控制 (disler/claude-code-hooks-mastery) | Python |

| 7 | QMD:本地混合检索引擎用于文档与知识库 (tobi/qmd) | TypeScript, Python |

| 8 | Neovim AI 代理:Alpha 版工作流实验 (ThePrimeagen/99) | Lua |

| 9 | ChatDev 2.0: DevAll 零代码多代理协作平台 (OpenBMB/ChatDev) | Python, Vue |

| 10 | Maestro:AI代理编排中心 (pedramamini/Maestro) | TypeScript |

| 11 | nanochat:用$100预算训练的ChatGPT级小型模型 (karpathy/nanochat) | Python |

| 12 | PageIndex:向量无依赖的推理式RAG文档索引框架 (VectifyAI/PageIndex) | Python |

| 13 | Playwright CLI 与 SKILLs (microsoft/playwright-cli) | JavaScript, TypeScript |

| 14 | prek:用 Rust 重塑的快速无依赖 pre-commit 替代 (j178/prek) | Rust |

Rank 1 - Shannon:全自动 AI 渗透测试与漏洞利用工具

- 项目路径:KeygraphHQ/shannon

- 创建时间:创建于134天前

- 项目成长:平均每天获得87.8个星星

- 开发语言:TypeScript

- 协议类型:GNU Affero General Public License v3.0

- Star数量:11759 个

- Fork数量:1416 次

- 贡献人数:4 人

- Open Issues数量:26 个

- Github地址:https://github.com/KeygraphHQ/shannon.git

- 项目首页: https://keygraph.io/

关键词: AI 渗透测试, white-box 测试, 动态利用, Proof-of-Concept, Nmap, Subfinder, WhatWeb, Schemathesis, Shannon Lite, Shannon Pro, OWASP, SSRF, XSS, Injection, 身份认证绕过, CI/CD 集成, Keygraph 平台, 合规审计

趋势变化

上一次上榜时间:2026-02-07,Star 增长:+3248 (+38.2%)

项目简介

Shannon 是一款全自动的 AI 渗透测试工具,能够在无需人工干预的情况下,利用 white-box 源码分析与 dynamic exploitation,自动定位并执行真实的漏洞利用,不仅给出告警,还生成可复现的 Proof-of-Concept 报告。它是 Keygraph Security and Compliance Platform 的核心组件之一,Lite 版基于 AGPL-3.0,Pro 版为商业授权,面向企业 CI/CD 的安全测试与合规审计场景。注意白盒测试环境为必要前提。

传统渗透测试往往年度进行一次,难以覆盖持续更新的应用风险,Shannon 通过完全自动化的白盒分析与动态利用,按需进行真实利用并输出经过验证的风险证据,帮助团队在每次变更和部署时快速验证安全性,减少生产环境的潜在漏洞暴露。同时,Shannon 与 Keygraph Platform 的合规能力结合,提供从证据采集到审计就绪的闭环解决方案,提升企业的合规性与安全管控效率。

应用场景

- 企业级应用在 CI/CD 流水线中的按需白盒渗透测试,自动覆盖源码与运行时环境,生成可追溯的 pentest-grade 报告,帮助在每次发布前验证关键漏洞并降低上线风险。

- Monorepo/多仓库场景的集中安全测试,Shannon 能并行分析跨组件的入口点与 API,提供覆盖注入、XSS、SSRF、认证/授权等关键风险的实证验证。

- 独立开发者与安全研究者的自测与漏洞证明场景,集成进开发流程后获得可复现的 PoC,提升个人项目的安全性认知与研究产出。

- 企业级合规审计与证据管理,将自动化的渗透测试结果与 Keygraph Platform 的合规能力结合,支持 SOC 2、HIPAA 等框架的证据收集与审计就绪。

Rank 2 - OpenClaw:本地运行的个人 AI 助手

- 项目路径:moltbot/moltbot

- 创建时间:创建于76天前

- 项目成长:平均每天获得2310.6个星星

- 开发语言:TypeScript

- 协议类型:MIT License

- Star数量:175605 个

- Fork数量:28790 次

- 贡献人数:376 人

- Open Issues数量:4737 个

- Github地址:https://github.com/moltbot/moltbot.git

- 项目首页: https://molt.bot

关键词: OpenClaw, gateway, multi-channel, Canvas, A2UI, ClawHub, nodes, DM policy, local deployment

趋势变化

上一次上榜时间:2026-02-01,Star 增长:+36833 (+26.5%)

项目简介

OpenClaw 是一个本地运行的个人 AI 助手,能够通过 WhatsApp、Telegram、Slack、Discord、Google Chat、Signal、iMessage、Microsoft Teams、WebChat 等渠道与用户对话,并在 macOS/iOS/Android 上进行语音输入输出和实时 Canvas 展示。网关作为控制平面,统一管理会话、渠道、工具与事件,支持多工作区路由与跨设备协作。通过 onboarding 向导快速设置,支持在 macOS、Linux、Windows(通过 WSL2)等环境运行,运行时需 Node≥22,且可通过 CLI、浏览器控件、Canvas、Nodes 等扩展能力。

本地部署的个人 AI 助手在隐私、低延迟和离线可用性方面需求高涨。本项目通过 Local-first Gateway 提供统一的会话与通道管理、跨代理的路由,以及设备本地动作能力(如 system.run、camera、screen recording、notifications),解决跨设备协作、跨渠道沟通与安全控制的痛点,并通过 Canvas 实现可视化工作区,提升生产力与控制感。

应用场景

- 个人日常助手场景:在 macOS/iOS/Android 上本地化运行 OpenClaw,通过 WhatsApp、Telegram、Slack 等渠道与 AI 助手对话,处理日程、笔记、提醒与任务,并借助 Canvas 提供的可视化进展展示,确保快速、本地化、隐私友好。

- 跨设备协作场景:通过 Local-first Gateway 将会话、渠道与工具集中管理,多个代理在不同会话间路由、分工与协作;团队成员可在不同设备与渠道上继续对话、查看历史记录、发送任务,从而提升协同效率。

- 开发者/企业自建场景:企业可以将 Gateway 自托管,连接多渠道并利用 ClawHub 自动发现并引入技能,搭建定制化工作流与内部助手,配合远程访问与安全策略实现可控的企业级应用。

- 教育/培训与演示场景:结合 Browser 控制、Canvas 与 Nodes 功能,创建互动教学或产品演示环境,教师可远程控制 AI 助手的操作、可视化输出与多渠道沟通,提升学习体验。

Rank 3 - Codex 技能目录与安装指南

- 项目路径:openai/skills

- 创建时间:创建于75天前

- 项目成长:平均每天获得90.1个星星

- 开发语言:Python

- Star数量:6755 个

- Fork数量:380 次

- 贡献人数:15 人

- Open Issues数量:51 个

- Github地址:https://github.com/openai/skills.git

关键词: Codex, Agent Skills, 技能目录, curated, experimental, skill-installer, 许可证, 开放标准, OpenAI Codex, 自动化

趋势变化

上一次上榜时间:2026-02-07,Star 增长:+1323 (+24.4%)

项目简介

本仓库聚合并整理用于 Codex 的 Agent Skills,提供系统技能(.system)、curated 与 experimental 分类,介绍如何通过 skill-installer 安装和更新技能。开发者和团队可以将可复用的指令、脚本与资源封装成技能,方便在 Codex 中重复使用、分发与管理,并在新版本中自动生效。

README 解释了如何将 AI 代理能力组织成独立的技能、实现可重复使用与分发的能力,以及通过自动安装、重启 Codex 以使新技能生效的工作流。它解决了技能的加载、版本升级、分类管理和许可信息的获取等在实际使用中的痛点,帮助团队高效构建、维护与扩展代理能力库。

应用场景

- 企业级场景:大型组织将 Skills Catalog for Codex 作为内部代理能力的集中库,团队基于 curated/experimental 技能快速组建自动化任务工作流。通过 $skill-installer 安装所需技能后,重启 Codex 即可上线新技能,提升跨部门任务的一致性与重复性。

- 个人开发者场景:学习与原型阶段使用系统、curated 与 experimental 技能,快速试验不同任务的代理实现,降低搭建成本并便于分享与复用。

- 教育/研究场景:教育机构或研究团队利用技能目录搭建教学助手、研究协助代理,帮助学生与研究人员完成数据整理、报告撰写等重复性工作,提升工作效率。

Rank 4 - Claude-Mem:Claude Code 的持久记忆与上下文注入插件

- 项目路径:thedotmack/claude-mem

- 创建时间:创建于160天前

- 项目成长:平均每天获得157.6个星星

- 开发语言:TypeScript

- 协议类型:Other

- Star数量:25211 个

- Fork数量:1663 次

- 贡献人数:41 人

- Open Issues数量:102 个

- Github地址:https://github.com/thedotmack/claude-mem.git

- 项目首页: https://claude-mem.ai

关键词: Claude-Mem, Claude Code, memory, memory search, MCP tools, search, timeline, get_observations, save_memory, Chroma, SQLite, web viewer, privacy, Endless Mode, token savings, context injection, agent-sdk, Bun, FTS5, histories

趋势变化

上一次上榜时间:2026-02-05,Star 增长:+1758 (+7.5%)

项目简介

Claude-Mem 是为 Claude Code 提供的持久记忆插件,能自动捕获编码会话中的操作,利用 Claude 的 agent-sdk 进行压缩并生成语义摘要,随后将相关上下文注入未来会话。核心特性包括跨会话的内存持久性、分层检索、内置 mem-search、Web 查看界面、隐私控制以及可配置的上下文注入。

开发者在编码时常丢失会话上下文,导致重复查找与知识断裂。Claude-Mem 通过自动观测、生成语义摘要并持久化存储,在后续会话中快速恢复相关信息;结合 search、timeline 与 get_observations 等工具实现高效检索,降低重复工作负担并提升协作效率。

应用场景

- 企业级应用场景:大型软件团队在跨子系统协同开发时,利用 Claude-Mem 自动保留的会话上下文、变更日志和调试线索,提升代码审查、问题定位和知识复用效率,缩短迭代周期。

- 个人开发者/学习场景:独立开发者或学生在学习阶段,通过持续的上下文记忆与自然语言搜索快速回顾实现、设计决策和思路来源,提升学习效果。

- AI/ML 与 DevOps 场景:在实验记录、数据处理流水线和部署变更中,记忆时间线和观测摘要有助于复现实验、追踪结果并快速定位问题。

- 知识管理与教育场景:团队或培训场景下将编码实践与解决方案沉淀为可检索的记忆,便于新员工培训与技术传承。

Rank 5 - AI Agent Toolkit:编码代理 CLI、统一 LLM API、TUI/Web UI 与

- 项目路径:badlogic/pi-mono

- 创建时间:创建于183天前

- 项目成长:平均每天获得44.0个星星

- 开发语言:TypeScript

- 协议类型:MIT License

- Star数量:8051 个

- Fork数量:836 次

- 贡献人数:112 人

- Open Issues数量:21 个

- Github地址:https://github.com/badlogic/pi-mono.git

关键词: pi-ai, pi-agent-core, pi-coding-agent, pi-mom, pi-tui, pi-web-ui, pi-pods, OpenAI, Anthropic, Google, LLM API, tool calling, state management, vLLM, GPU pods, Slack bot, CLI, UI, AI chat

趋势变化

上一次上榜时间:2026-02-02,Star 增长:+2637 (+48.7%)

项目简介

本项目是一套用于构建 AI 代理的工具集,提供编码代理 CLI、统一的多供应商 LLM API、TUI 与 web UI 库,以及 Slack bot 和 vLLM 部署管理等组件。通过一体化的包生态,开发者可以快速实现代码生成与工具调用、构建 AI 聊天界面,以及在 GPU Pod 上高效部署 LLM 模型,提升开发和运维效率。

当前 AI 代理生态在跨供应商 LLM API 集成、代理运行时的工具调用与状态管理、前端展示以及多渠道协作对接方面往往割裂。该项目整合了 Unified LLM API、Agent runtime、UI 组件和部署工具,降低了集成难度,提升了可扩展性、可维护性与协作效率。

应用场景

- 个人开发者或研究者可使用 pi-coding-agent CLI 进行代码生成、自动化工具调用与实验性编码代理的迭代,提升开发效率与学习体验。

- 团队场景中,pi-mom Slack bot 将消息转发给 pi coding agent,支持即时协作、任务分发与自动化工作流的实现。

- 在企业环境中通过 pi-pods 管理 vLLM 部署,结合 nuTUI/ web UI 快速搭建对话与辅助工具,为内部客服、开发助手或 AI 助手提供稳定的运行基础。

- 将 pi-web-ui 组件嵌入自有应用,构建自定义的 AI 聊天界面和对话体验,满足企业级前端集成与品牌定制需求。

Rank 6 - Claude Code Hooks:对 Claude Code 行为的确定性与扩展控制

- 项目路径:disler/claude-code-hooks-mastery

- 创建时间:创建于217天前

- 项目成长:平均每天获得12.4个星星

- 开发语言:Python

- Star数量:2697 个

- Fork数量:529 次

- 贡献人数:1 人

- Open Issues数量:21 个

- Github地址:https://github.com/disler/claude-code-hooks-mastery.git

关键词: Claude Code, hooks, UV single-file scripts, prompt validation, security blocking, logging, transcript conversion, TTS, Sub-Agents, Meta-Agent, team-based validation, environment persistence

项目简介

本项目展示如何使用 Claude Code hooks 来对 Claude Code 的行为进行确定性或非确定性控制,涵盖 13 种钩子生命周期事件、前置提示验证、权限审计、工具执行拦截、以及自动日志与 Transcript 转换,以及 TTS 提示等功能,配合 UV 单文件脚本实现模块化和跨环境可移植性。

本项目通过演示 Claude Code hooks 的完整生命周期、前置提示验证、工具执行拦截、以及后置反馈等机制,解决了如何对 Claude Code 行为进行确定性或非确定性控制的问题。并提供日志记录、Transcript 转换、TTS 通知、子代理与元代理等能力,帮助开发者在实际场景中实现安全、可控、可观测的对话式 AI 工作流。

应用场景

- 通过 .claude/hooks 实现前置 Prompt 验证、权限控制、上下文注入与日志记录,提升 Claude Code 在企业场景的安全性、可追溯性和行为一致性,并通过 UV 单文件脚本实现模块化、与主项目解耦。

- 利用 Sub-Agents、Meta-Agent 与 Team-Based Validation 构建端到端自动化工作流,自动分解任务、执行工具、汇总结果并进行阶段性校验,降低人为干预。

- 在维护与合规场景中,通过 PreCompact、会话与 transcript 日志、环境持久化等机制实现数据备份、变更追踪与审计,提升可控性与快速回溯能力。

- 支持 ElevenLabs、OpenAI、Anthropic、Ollama 等 LM/TTS 提供者的组合部署,适配本地或云端场景,方便实现多元化语言模型与语音输出的集成。

- 开发者学习工具场景,个人开发者可用来学习 Claude Code hooks、UV 架构与日志机制,快速搭建自定义工作流与示例实现。

Rank 7 - QMD:本地混合检索引擎用于文档与知识库

- 项目路径:tobi/qmd

- 创建时间:创建于62天前

- 项目成长:平均每天获得116.5个星星

- 开发语言:TypeScript, Python

- Star数量:7222 个

- Fork数量:355 次

- 贡献人数:18 人

- Open Issues数量:79 个

- Github地址:https://github.com/tobi/qmd.git

关键词: QMD, BM25, vector search, LLM reranking, on-device, GGUF, node-llama-cpp, MCP, knowledge base, markdown, transcripts

项目简介

QMD 是一个在设备上运行的本地化搜索引擎,面向文档、知识库、会议记录等内容。它将 BM25 全文检索、向量语义检索与 LLM 重新排序相结合,通过 node-llama-cpp 驱动的 GGUF 模型在本地完成检索与排序,支持关键词和自然语言查询,适合需要本地、快速且注重隐私的 agentic 工作流。

本地环境中对多源文本实现高效检索存在数据隐私、离线能力和检索质量的挑战。QMD 通过将 BM25、向量检索与 LLM 重排序整合,提供本地化、无云依赖的混合检索能力,并通过集合、上下文元数据和多种输出格式,方便与代理工作流对接,提升信息获取的速度与准确性。

应用场景

- 个人场景:将笔记、会议纪要和工作文档等内容本地化索引与检索,支持快速定位关键信息,确保数据不出本地设备。

- 企业场景:内部知识库与文档的私有化检索解决方案,结合 MCP/Claude 等工具实现工作流自动化,同时保障数据隐私和合规性。

- 开发者/研究场景:在离线或受限网络环境中对研发资料、技术文档进行高效检索与汇总,减少对外部服务的依赖。

Rank 8 - Neovim AI 代理:Alpha 版工作流实验

- 项目路径:ThePrimeagen/99

- 创建时间:创建于77天前

- 项目成长:平均每天获得45.4个星星

- 开发语言:Lua

- Star数量:3498 个

- Fork数量:158 次

- 贡献人数:11 人

- Open Issues数量:37 个

- Github地址:https://github.com/ThePrimeagen/99.git

关键词: Neovim, AI, 99, opencode, cmp, Lua, TypeScript, ALPHA, logging, debug, prompt, visual, 配置示例

趋势变化

上一次上榜时间:2026-02-02,Star 增长:+560 (+19.1%)

项目简介

这是一个 Neovim 插件示例仓库,旨在测试理想的 AI 工作流,帮助用户在 AI 请求中实现受控、集中化的交互。以 ThePrimeagen/99 为核心,强调通过 @ 触发的技能补全、可自定义规则、日志与调试等能力,并提供 visual 选区的使用方式。当前为 ALPHA 版本,功能仍在开发中,需安装 opencode 并按示例配置 Neovim。

该项目通过在 Neovim 中引入受控的 AI 工作流,解决了在编码时对 AI 请求的范围限制、提示质量管理以及调试追踪的问题。它通过使用 @ 开始的技能补全、可配置的规则、日志记录以及日志查看工具,帮助用户减少无关请求、提升交互效率。尽管仍处于 ALPHA 阶段,且 API 可能变化,但提供了具体的配置示例与调试路径。

应用场景

- 个人开发场景:在日常编码中,开发者通过 99 插件与 cmp 自动完成集成,快速获得 AI 给出的代码片段、重构建议与文档草稿,并通过日志排查问题,确保对话受控在特定范围内。

- 学习/插件开发场景:学习者和插件开发者可将该仓库作为 AI 工作流的教学示例,理解 prompt、规则与 API 的集成,使用 view_logs 回放对话,演示调试流程。

- 企业级/团队场景:在 TS/Lua 项目中,借助 opencode 与自定义规则进行代码生成、脚手架搭建、文档初稿编写等 AI 辅助工作,提升协作效率与产出一致性。

- 演示与排错场景:在演示环境中通过日志记录、prev_request_logs/next_request_logs 跟踪历史请求,帮助排错并展示受控 AI 工作流的可观测性。

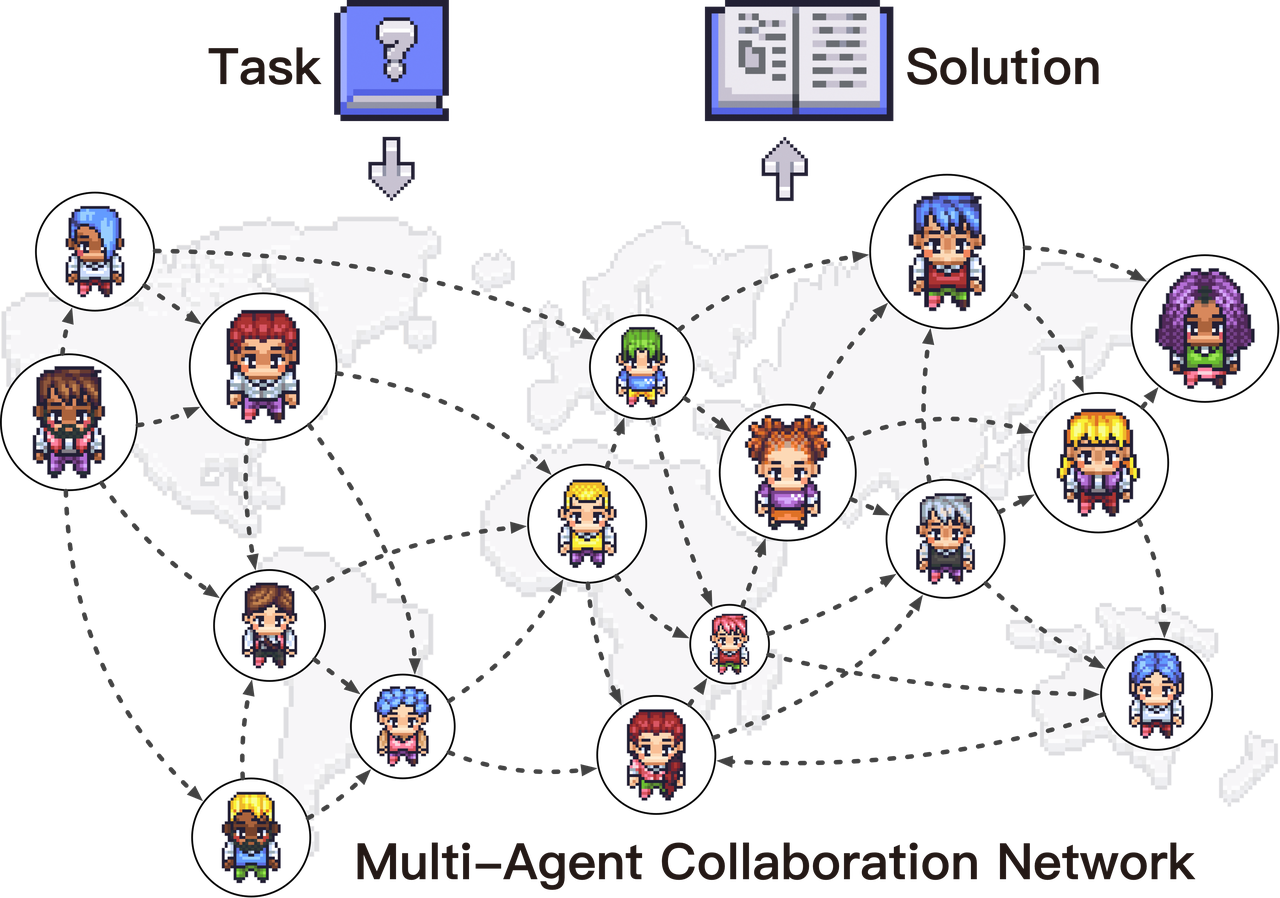

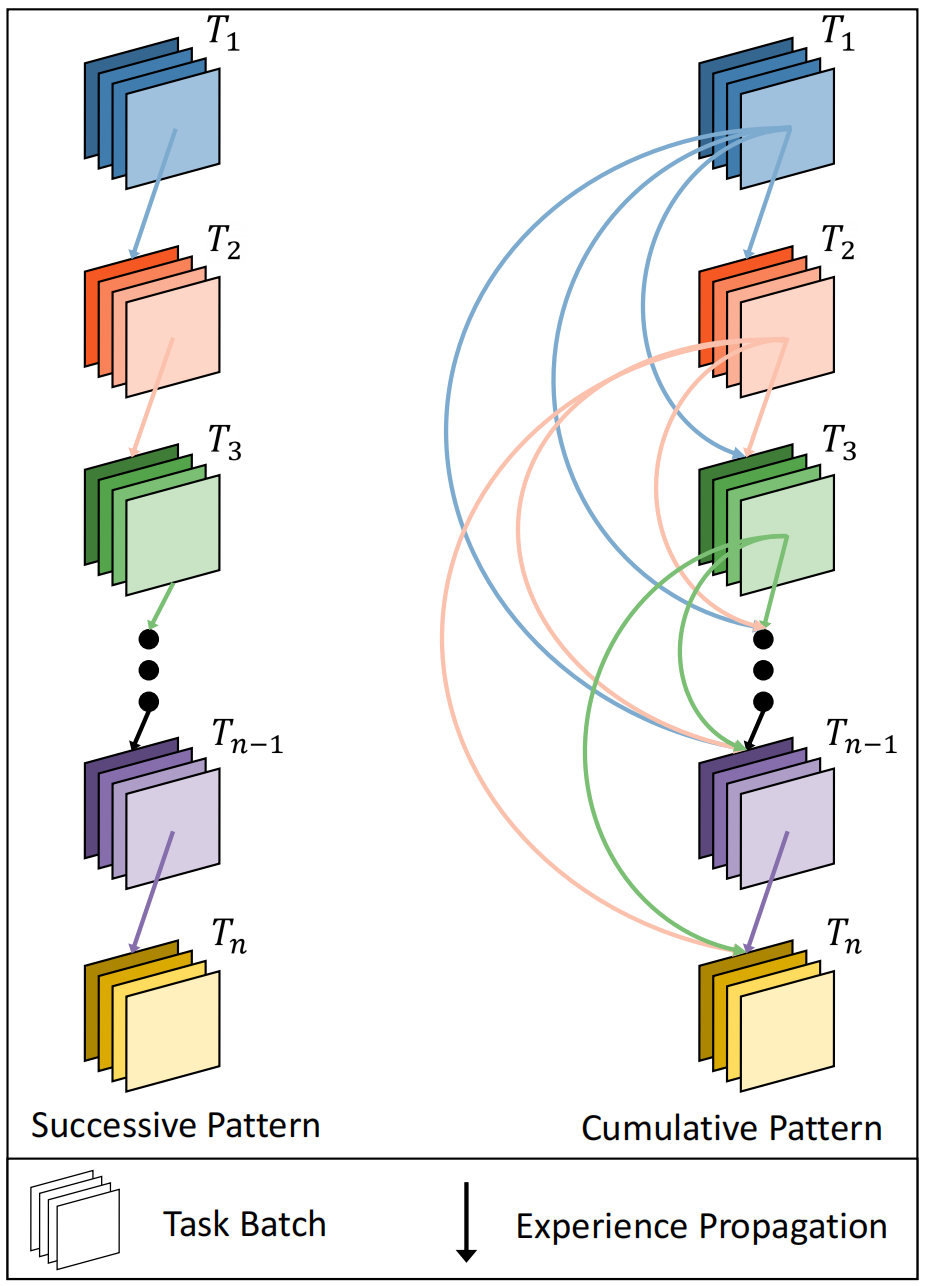

Rank 9 - ChatDev 2.0: DevAll 零代码多代理协作平台

- 项目路径:OpenBMB/ChatDev

- 创建时间:创建于2年前

- 项目成长:平均每天获得34.1个星星

- 开发语言:Python, Vue

- 协议类型:Apache License 2.0

- Star数量:30541 个

- Fork数量:3770 次

- 贡献人数:6 人

- Open Issues数量:36 个

- Github地址:https://github.com/OpenBMB/ChatDev.git

- 项目首页: https://arxiv.org/abs/2307.07924

关键词: ChatDev, DevAll, Zero-Code, Multi-Agent Platform, workflow, LLM, agent orchestration, data visualization, 3D generation, Blender, MacNet, IER, Experiential Co-Learning, Puppeteer, Git mode, Docker, FastAPI, Vue 3, yaml

趋势变化

上一次上榜时间:2026-02-04,Star 增长:+637 (+2.1%)

项目简介

ChatDev 2.0(DevAll)是一款零代码的多代理编排平台,提供前后端分离的可配置式工作流,用户无需编码即可通过配置定义代理、任务与流程,以实现数据可视化、3D 生成、深度研究等多场景的协作式任务执行。平台集成 FastAPI 后端、Vue 3 前端、以及可扩展的 Python 工具体系,配有 YAML 模板与一体化 SDK,帮助开发者快速创建并运行自定义工作流。

传统的多代理系统通常需要大量编码、复杂的任务拆解与系统集成,开发成本高且迭代慢。ChatDev 2.0 通过零代码配置实现代理、工作流和任务的模块化编排,降低上手门槛,提升可复用性与扩展性。它将工作流设计、执行、监控与人机反馈整合在一个平台,并提供模板、示例和 SDK,帮助用户快速验证想法、缩短交付周期。

应用场景

- 数据可视化和数据分析场景:通过 data_visualization_basic.yaml/ enhanced.yaml 配置多代理协作,完成数据清洗、分析与图表生成,输出 4–6 张高质量 PNG 图表并生成分析摘要,极大降低手写代码与重复操作的成本,适用于企业报表、市场分析与业务决策。

- 3D 生成与设计场景:结合 Blender 相关模板(blender_3d_builder_simple.yaml、hub.yaml、scientific_illustration.yaml),由多代理流程完成需求分析、几何建模、材质与渲染设置,自动生成成品或原型,显著缩短创作周期并降低跨工具协作成本。

- 游戏开发与原型设计场景:使用 GameDev_v1.yaml 或 ChatDev_v1.yaml,多个代理分工完成需求理解、架构设计、关卡与美术实现、测试与迭代,Launch 界面提供实时日志与中间产物,提升协同效率与产品质量。

- 深度研究与学术分析场景:Deep Research v1.yaml 为核心,组织代理进行文献梳理、实验设计、数据整理与结论总结,自动生成研究要点、可视化图表及撰写大纲,显著提升研究产出速度与可复现性。

- 教学视频与教育内容生成场景:Teach Video.yaml 结合 Manim 等工具,构建教师讲解任务的代理链路,自动生成凸优化等主题的教学视频、字幕与演示材料,降低课程制作成本并提升产出效率。

市场价值

行业前景覆盖软件开发、数据分析、教育与创意设计等。通过零代码编排多代理系统,快速搭建并执行复杂工作流,降低人力与时间成本。潜在变现路径包括 SaaS 订阅、企业授权、定制化工作流开发与模板销售,并通过行业集成获得持续收益。

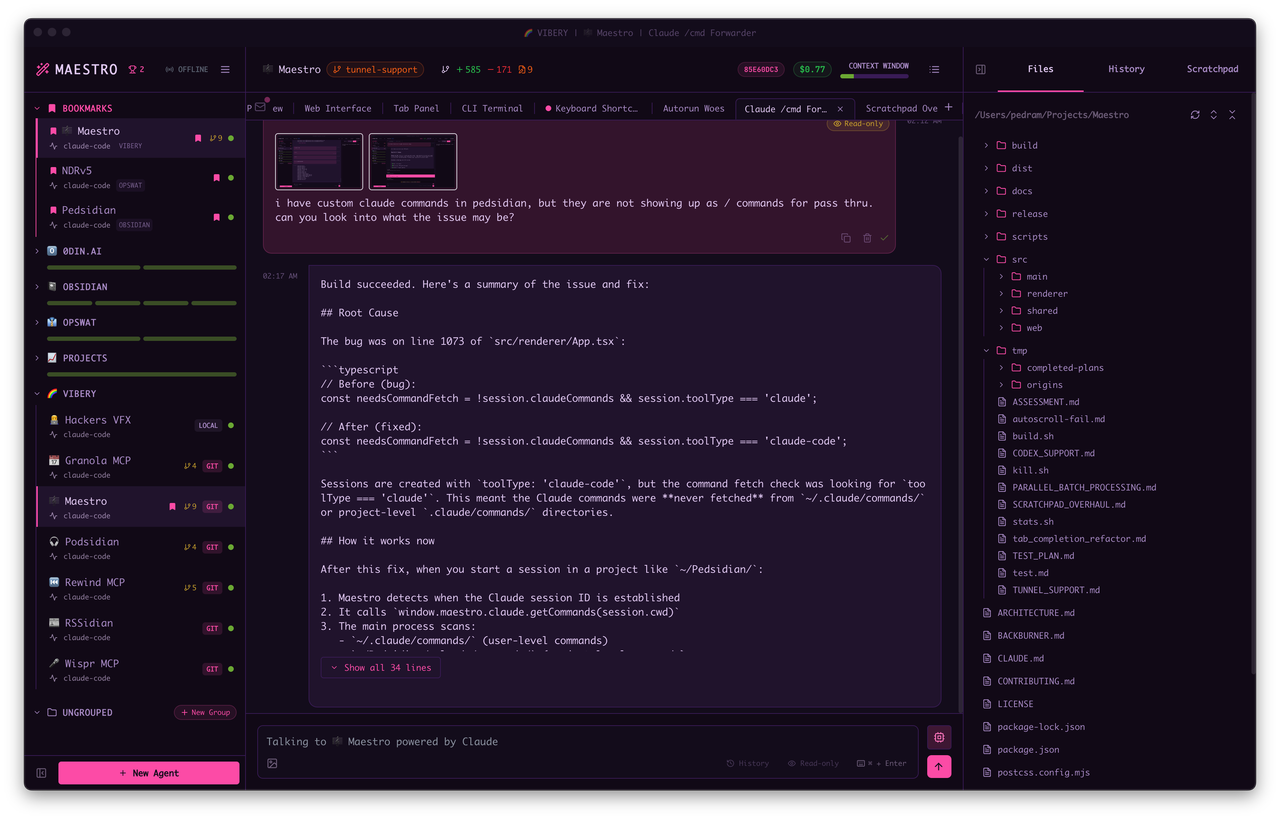

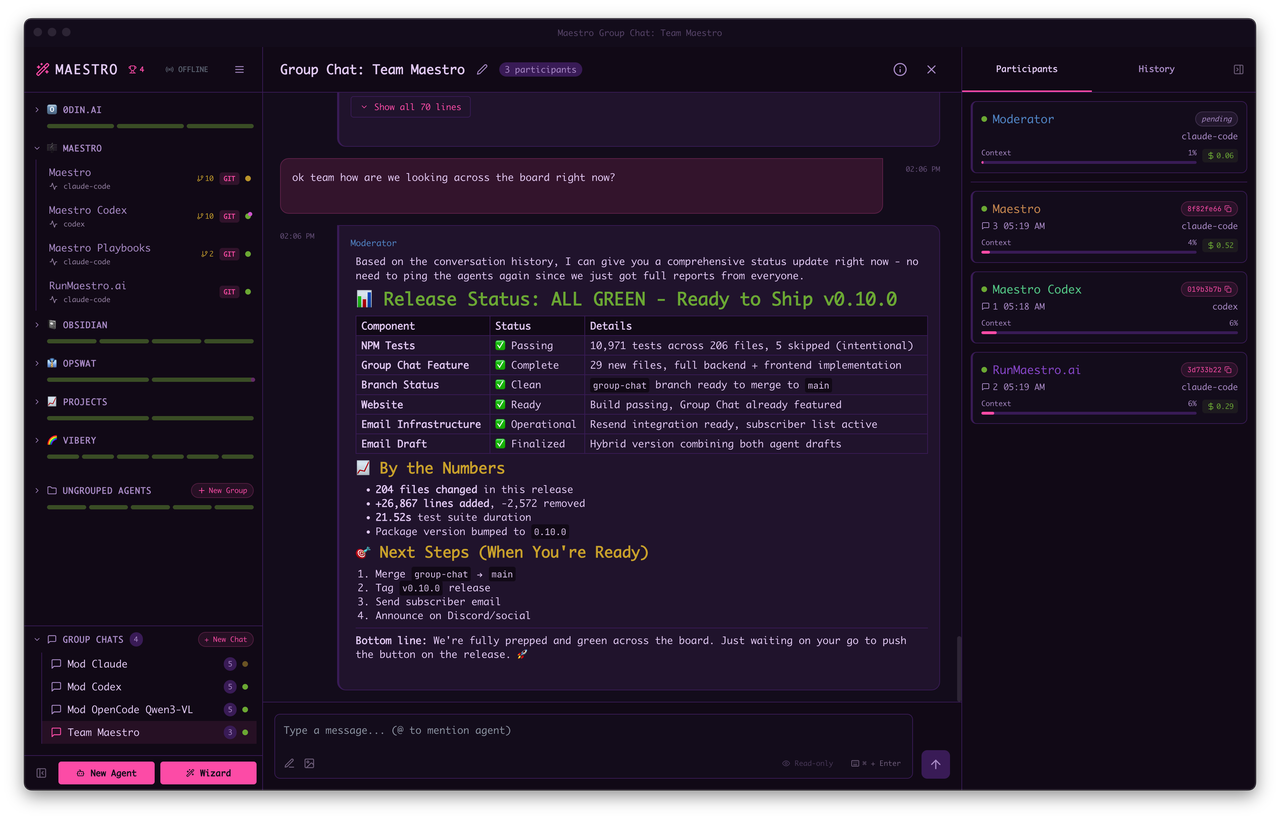

Rank 10 - Maestro:AI代理编排中心

- 项目路径:pedramamini/Maestro

- 创建时间:创建于77天前

- 项目成长:平均每天获得25.9个星星

- 开发语言:TypeScript

- 协议类型:GNU Affero General Public License v3.0

- Star数量:1992 个

- Fork数量:187 次

- 贡献人数:19 人

- Open Issues数量:77 个

- Github地址:https://github.com/pedramamini/Maestro.git

- 项目首页: https://RunMaestro.ai

关键词: Maestro, AI agents, Playbooks, Git Worktrees, Group Chat, Auto Run, CLI, Mobile Remote Control, Keyboard-first, Session management, Document Graph, Cost Tracking, Usage Dashboard, MCP Server, Git integration, File Explorer, Output Filtering, Slash Commands, Draft Auto-Save, Achievements

趋势变化

上一次上榜时间:2026-02-04,Star 增长:+391 (+24.4%)

项目简介

Maestro 是一款跨平台桌面应用,用于编排 AI agents 与项目。通过与 AI 协作生成详细规格文档后,由 Auto Run 自动执行,确保每个任务在独立会话中完成,便于长时间无人干预的任务。它支持多代理并发、分支级子代理、群组对话协作、移动端远程控制、以及命令行接口,旨在提升多项目协作的效率与可控性。

当前多代理协作往往缺乏统一编排、清晰的上下文隔离,以及跨任务的高效并发管理。Maestro 提供统一的代理编排、独立会话上下文、分支级并行、组态协作、以及会话发现和 Git 集成等能力,解决任务分散、上下文混乱和协作冲突等痛点。

应用场景

- 在大型软件开发中,开发者可并发运行多位 AI coding agent,通过 Auto Run/Playbooks 自动执行重复任务;利用 Git Worktrees 创建分支级的子代理实现真正并行开发,独立工作区与对话历史,完成后可一键生成 PR。

- 在 AI 研究或系统架构设计场景,团队通过 Group Chat 协调多位代理,主持人将问题分发给合适的代理并汇总其回答,结合 Document Graph 将文档关系可视化,提升跨项目协作与知识管理效率。

- 在 CI/CD 流水线或日常开发运维中,使用 maestro-cli 进行无头任务执行,调度 Playbooks、轮询输出、按需存档,输出格式可为人类可读文本或 JSONL,帮助下游系统或脚本继续处理。

- 需要随时随地监控和控制多代理任务时,Mobile Remote Control 提供内置网页服务器与二维码访问,支持局域网与 Cloudflare 隧道,让演示、现场协作和远程运维更高效,用户可在手机端直接查看任务进度、代理状态和会话历史。

市场价值

行业可覆盖软件开发、AI研究/教育、企业服务等,潜在变现路径包括SaaS订阅、企业授权与技术服务,取决于对多代理并发、自动化编排与会话分析的需求。

Rank 11 - nanochat:用$100预算训练的ChatGPT级小型模型

- 项目路径:karpathy/nanochat

- 创建时间:创建于118天前

- 项目成长:平均每天获得360.8个星星

- 开发语言:Python

- 协议类型:MIT License

- Star数量:42573 个

- Fork数量:5500 次

- 贡献人数:43 人

- Open Issues数量:49 个

- Github地址:https://github.com/karpathy/nanochat.git

关键词: nanochat, GPT-2, LLM, tokenization, pretraining, finetuning, evaluation, inference, Chat UI, PyTorch, 8XH100, CORE score, DCLM, bits per byte, wandb, speedrun, miniseries, depth, KV Cache, tokenizer, BPE, chat_web

趋势变化

上一次上榜时间:2026-02-04,Star 增长:+371 (+0.9%)

项目简介

nanochat 是一个用于训练大语言模型(LLMs)的简单实验框架,设计在单个 GPU 节点上运行,代码简洁可 hack。它覆盖分词、预训练、微调、评估、推理以及 Chat UI 等全流程,且通过单一复杂度参数 --depth 自动推导其余超参数,使用户能够以极低成本训练出接近 GPT-2 水平的模型,并在网页端进行对话体验。

实现了在有限预算和简单代码结构下完成 LLM 的端到端训练、评估与对话的能力。覆盖从数据准备、分词、预训练、微调、基线评估(CORE、bits per byte)到推理与前端 UI 的完整环节,降低研究者在资源、复杂性与部署方面的门槛,提供可复刻的指标和基线模型。

应用场景

- 企业/研究机构的低成本原型搭建场景:在单机/云端 GPU 节点上以极低费用跑完完整训练流程,生成可对话的自有 LLM,用于评估、演示和 early-stage 实验。

- 个人开发者的学习与实验场景:在本地或云端快速训练一个 GPT-1/GPT-2 规模的能力模型,通过 Chat UI 与对话任务进行学习和知识探索。

- 教育与研究场景:用于教学和学术演示,展示从分词到对话系统的完整流水线、以及如何通过 depth 调整模型复杂度并观察 CORE 指标与吞吐量。

- 对比研究场景:将 nanochat 作为 compute-optimal 基线,进行规模、深度、优化算法的对比实验,评估不同配置对 CORE、val_bpb、训练时耗的影响。

Rank 12 - PageIndex:向量无依赖的推理式RAG文档索引框架

- 项目路径:VectifyAI/PageIndex

- 创建时间:创建于313天前

- 项目成长:平均每天获得45.3个星星

- 开发语言:Python

- 协议类型:MIT License

- Star数量:14171 个

- Fork数量:1019 次

- 贡献人数:3 人

- Open Issues数量:70 个

- Github地址:https://github.com/VectifyAI/PageIndex.git

- 项目首页: https://pageindex.ai

关键词: PageIndex, vectorless RAG, tree index, LLM, No Vector DB, No Chunking, human-like retrieval, FinanceBench, Mafin2.5, MCP, API, OCR, document analysis, financial documents, on-prem, self-host

趋势变化

上一次上榜时间:2026-02-02,Star 增长:+1855 (+15.1%)

项目简介

PageIndex 是一个向量无依赖的推理式 RAG 系统,将长文档转化为树状结构索引,由 LLM 对索引进行推理检索,以实现对专业文档的上下文定位与可解释的检索过程。它无需 Vector DB,也不进行人工分块,支持自建本地、云端服务与企业私有部署,并提供框架、cookbooks、MCP 与 API 集成。该框架在 FinanceBench 上达到 98.7% 的准确率,展现了在金融报告等长文档分析中的优势。

传统的向量检索依赖语义相似性,难以把握专业文档中的真实相关性,且对长文档的上下文容量有限,缺乏可解释性与可追溯性。PageIndex 通过树状索引与推理检索,提供逐级定位、引用页/段落的可追溯性,避免对向量数据库和简单分块的依赖,提升对复杂文档的检索准确性与理解能力。

应用场景

- 金融机构在分析年报、SEC filings、监管披露等长文档时,利用 PageIndex 的树状索引与推理检索,从多份报告中快速定位关键段落与信息,提升审阅效率和信息对比的一致性。

- 法律、合规与技术手册等长文档场景,需精确检索条款、引用及关系,PageIndex 提供可追溯的引用结构,帮助律师与合规人员进行条款比对与证据整理。

- 教育和研究领域的教材、论文与技术手册,适用于章节导航、知识点提取以及跨文献的上下文检索,提升学习与研究的效率与深度。

- 开发者与企业的私有部署/自托管、云服务、API 集成场景,结合 MCP 或 API 快速接入现有工作流,便于在内部系统中启用长期文档分析。

Rank 13 - Playwright CLI 与 SKILLs

- 项目路径:microsoft/playwright-cli

- 创建时间:创建于5年前

- 项目成长:平均每天获得1.3个星星

- 开发语言:JavaScript, TypeScript

- 协议类型:Apache License 2.0

- Star数量:2598 个

- Fork数量:105 次

- 贡献人数:5 人

- Open Issues数量:6 个

- Github地址:https://github.com/microsoft/playwright-cli.git

- 项目首页: https://playwright.dev

关键词: Playwright, CLI, SKILL, MCP, headless, session, storageState, cookies, localStorage, selector, screenshot, test generation, trace, video, requests mocking, automation, CI/CD

趋势变化

上一次上榜时间:2026-01-30,Star 增长:+745 (+40.2%)

项目简介

本项目提供用于 Playwright 的命令行界面(CLI)并通过 SKILL 将其嵌入到编码代理的工作流中。它支持记录和生成 Playwright 代码、inspect selectors 以及截取页面截图,专为 token 高效的代理场景设计。与 MCP 相比,CLI 更适合在有限上下文内执行快速自动化任务;默认使用持久化 profile,便于跨项目复用浏览器状态,并可通过 session 管理实现多浏览器并行工作。

此工具解决在编码代理环境中高效实现浏览器自动化的问题:提供一个轻量、对模型上下文友好的 CLI,用于执行常用 Playwright 操作、记录与生成代码、检查选择器并截屏等,避免将大量页面数据持续加载到模型上下文中。同时通过持久化浏览器配置和会话管理,支持多浏览器实例与跨项目复现,提升自动化任务的速度与稳定性。

应用场景

- 在个人开发者或小型团队的 AI 辅助测试中,利用 playwright-cli 自动化打开页面、输入文本、截屏,并生成测试代码,提升学习和实践效率。

- 在企业级项目中,通过持久化浏览器配置和多会话支持,进行跨项目的回归测试、端到端流程验证,以及在受控环境中执行自定义 SKILLs,以提高测试覆盖与一致性。

- 在教学和演示场景,快速创建示例流程(如 todomvc、登录流程等),展示自动化能力并生成可复用的 Playwright 测试脚本,便于教学与演示。

- 在 CI/CD 流水线中,结合请求拦截、 tracing、视频录制等能力,提升排错效率、可追溯性和自动化产出的一致性。

Rank 14 - prek:用 Rust 重塑的快速无依赖 pre-commit 替代

- 项目路径:j178/prek

- 创建时间:创建于1年前

- 项目成长:平均每天获得11.9个星星

- 开发语言:Rust

- 协议类型:MIT License

- Star数量:5843 个

- Fork数量:153 次

- 贡献人数:81 人

- Open Issues数量:87 个

- Github地址:https://github.com/j178/prek.git

- 项目首页: https://prek.j178.dev/

关键词: prek, pre-commit, Rust, uv, monorepo, workspace, hook, virtualenv, toolchain, binary, PyPI, Homebrew, installer, GitHub Actions

趋势变化

上一次上榜时间:2026-02-05,Star 增长:+429 (+7.9%)

项目简介

prek 是对 pre-commit 的重构版本,采用 Rust 构建,目标是在不依赖 Python 运行时的前提下提供更快、占用磁盘更少的替代方案。它与原始 pre-commit 配置兼容,支持 monorepo/workspace,并内置 Rust-native 的常用 hooks,同时通过 uv 管理 Python 虚拟环境与依赖,简化工具链安装。提供独立安装器,以及 PyPI、Homebrew、cargo binstall、npmjs、Conda、Nix 等多种安装途径,方便在不同环境快速部署。

该项目解决了对 Python 运行时的依赖要求、环境管理与安装复杂性的挑战。通过单一二进制、无需额外运行时、并行克隆与并行执行、按优先级调度等设计,显著提升启动和执行速度,并降低磁盘空间占用。同时提供工作区/工作区模式、uv 管理虚拟环境,以及 Rust-native 实现的常用 hooks,提升了性能和稳定性。

应用场景

- 在大型企业内部代码库和 CI 环境中,利用 prek 的工作区模式与并行执行能力实现对大量仓库的统一钩子检查,降低部署成本并加速代码质量控制,同时避免对现有 pre-commit 配置的破坏。

- 开源项目与个人开发者可以使用 prek 作为 pre-commit 的快速替代,享受更短的安装时间、简化的环境管理,以及跨语言钩子的一致性体验,提升提交前的代码质量保护。

- 在包含多语言、多子项目的 monorepo 场景中,使用 prek 的 workspace 功能对不同子项目的钩子配置进行局部化管理,减少重复依赖与冲突,提高维护效率和构建稳定性。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)