梳理 LangChain、Ollama、Dify、RAGFlow四大工具的定位、关系及使用场景

本文梳理了LangChain、Ollama、Dify、RAGFlow四大LLM工具的定位与关系。全景图显示技术栈分为四层:基础设施层、模型服务层(Ollama/云端API)、开发框架层(LangChain)、应用平台层(Dify/RAGFlow)。LangChain是代码级开发框架,提供灵活但复杂的编程接口;Ollama专注本地模型运行;Dify为低代码应用构建平台;RAGFlow则专精RAG场景

·

梳理 LangChain、Ollama、Dify、RAGFlow 四大工具的定位、关系及使用场景。

一、全景定位图

┌─────────────────────────────────────────────────────────────┐

│ LLM 技术栈分层 │

├─────────────────────────────────────────────────────────────┤

│ │

│ 第四层:应用平台层(低代码/无代码) │

│ ┌─────────────────┐ ┌─────────────────┐ │

│ │ Dify │ │ RAGFlow │ │

│ │ (应用构建平台) │ │ (RAG专项平台) │ │

│ │ • 可视化界面 │ │ • 深度文档解析 │ │

│ │ • 知识库管理 │ │ • 企业级检索 │ │

│ │ • 工作流编排 │ │ • 溯源与合规 │ │

│ │ • 运营分析 │ │ • 多路召回优化 │ │

│ └─────────────────┘ └─────────────────┘ │

│ ▲ ▲ │

│ │ │ │

│ 第三层:开发框架层(代码级) │

│ ┌─────────────────────────────────────────┐ │

│ │ LangChain / LlamaIndex │ │

│ │ (LLM应用开发框架) │ │

│ │ • 链式调用(Chains) │ │

│ │ • 工具集成(Tools) │ │

│ │ • 记忆管理(Memory) │ │

│ │ • Agent编排 │ │

│ │ • RAG封装(RetrievalQA) │ │

│ └─────────────────────────────────────────┘ │

│ ▲ │

│ │ │

│ 第二层:模型服务层 │

│ ┌─────────────────┐ ┌─────────────────┐ │

│ │ Ollama │ │ 云端API服务 │ │

│ │ (本地模型框架) │ │ (OpenAI/阿里等) │ │

│ │ • 本地运行GGUF │ │ • 高性能推理 │ │

│ │ • 兼容OpenAI │ │ • 按量计费 │ │

│ │ • 隐私保护 │ │ • 无需运维 │ │

│ └─────────────────┘ └─────────────────┘ │

│ │

│ 第一层:基础设施层 │

│ ┌─────────────────────────────────────────┐ │

│ │ GPU服务器 / 云服务器 / Docker / K8s │ │

│ └─────────────────────────────────────────┘ │

│ │

└─────────────────────────────────────────────────────────────┘

二、四大工具详解

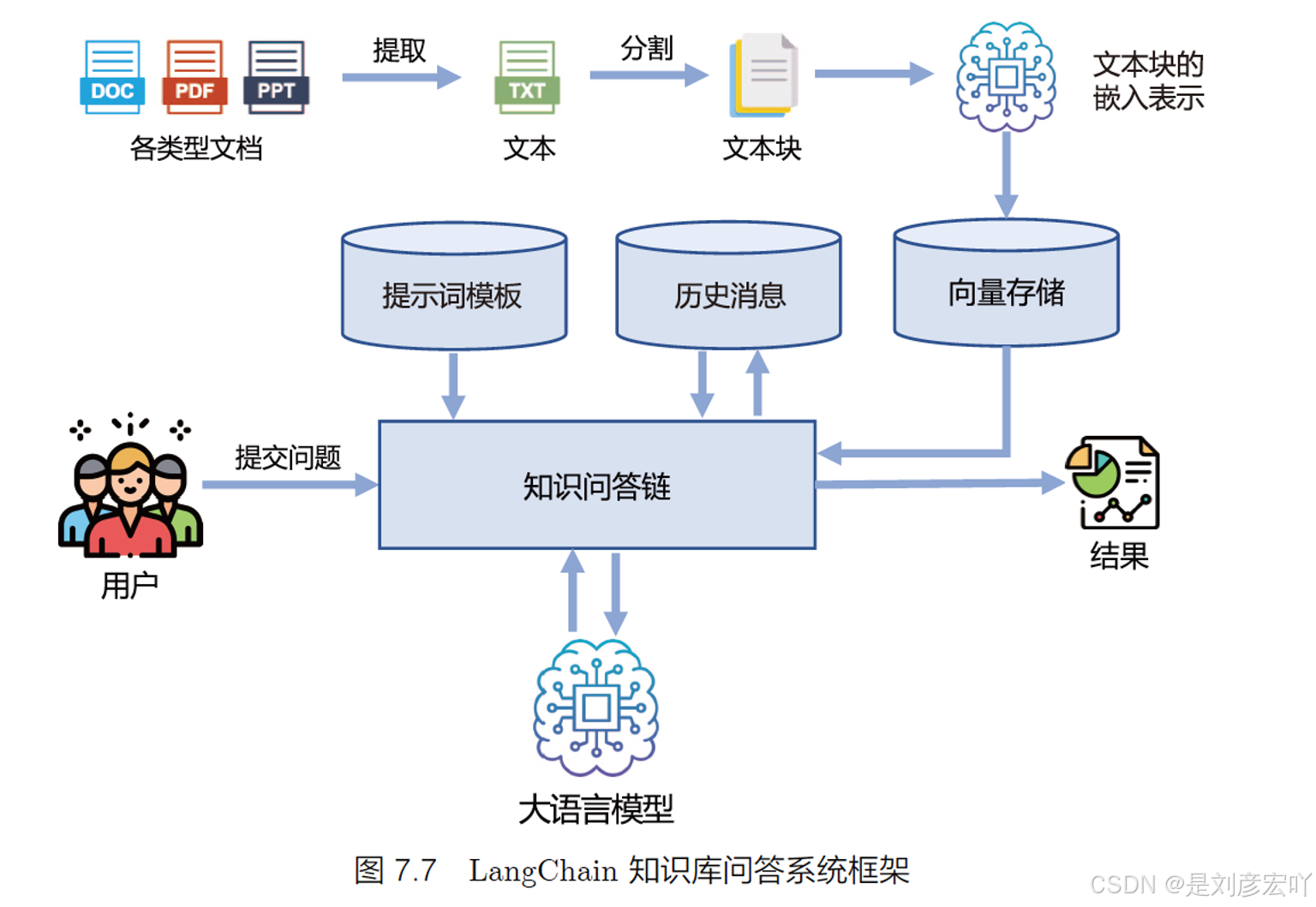

2.1 LangChain — 开发框架

| 属性 | 说明 |

|---|---|

| 定位 | Python/JS 代码级开发框架 |

| 核心抽象 | Chains(链)、Agents(代理)、Tools(工具)、Memory(记忆) |

| 学习曲线 | 陡峭(需编程能力) |

| 灵活性 | 极高(代码控制一切) |

| 适用人群 | 开发者、算法工程师 |

核心功能示例:

# LangChain 典型用法:构建RAG链

from langchain import OpenAI, VectorDBQA

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import Chroma

# 1. 加载文档 → 2. 分割 → 3. 嵌入 → 4. 存储(四阶段代码实现)

loader = PyPDFLoader("菜谱.pdf")

documents = loader.load()

texts = RecursiveCharacterTextSplitter(chunk_size=1000).split_documents(documents)

embeddings = OpenAIEmbeddings()

vectordb = Chroma.from_documents(texts, embeddings)

# 5. 构建RAG链(检索+生成)

qa = VectorDBQA.from_chain_type(

llm=OpenAI(),

chain_type="stuff",

vectorstore=vectordb

)

# 使用

result = qa.run("番茄炒蛋怎么做?")

优势与局限:

✓ 灵活:任何环节可自定义

✓ 生态:集成500+工具/模型/数据库

✓ 可控:细粒度调优每个参数

✗ 门槛:必须写代码

✗ 复杂:生产级应用代码量大

✗ 维护:版本迭代快,API常变

2.2 Ollama — 本地模型引擎

| 属性 | 说明 |

|---|---|

| 定位 | 本地大模型运行框架 |

| 核心功能 | 下载、运行、管理开源模型(GGUF格式) |

| 接口 | 命令行 + OpenAI兼容API |

| 硬件要求 | 消费级GPU/CPU可跑7B-13B模型 |

快速使用:

# 安装运行

curl -fsSL https://ollama.com/install.sh | sh

ollama run qwen2:14b

# API调用(与OpenAI格式兼容)

curl http://localhost:11434/v1/chat/completions \

-d '{"model":"qwen2:14b","messages":[{"role":"user","content":"你好"}]}'

在LangChain/Dify中使用:

# LangChain调用Ollama

from langchain.llms import Ollama

llm = Ollama(model="qwen2:14b")

# Dify配置Ollama

# 设置 → 模型提供商 → Ollama → 填写 http://localhost:11434

2.3 Dify — 应用构建平台

| 属性 | 说明 |

|---|---|

| 定位 | 开源LLM应用开发平台(低代码) |

| 核心功能 | 知识库、工作流、Agent、对话应用、运营分析 |

| 部署方式 | Docker自托管 / Dify Cloud SaaS |

| 模型支持 | OpenAI/ Anthropic/ 阿里/ 百度/ Ollama/ 本地等 |

核心界面:

┌─────────────────────────────────────────┐

│ Dify 控制台 │

├─────────────────────────────────────────┤

│ • 知识库:上传文档,自动RAG │

│ • 应用:Chatbot/Agent/工作流 │

│ • 提示词:可视化编辑器,版本管理 │

│ • 工作流:拖拽式节点编排 │

│ • 运营:对话日志、标注、分析 │

└─────────────────────────────────────────┘

典型工作流(烹饪场景):

[用户语音] → [ASR] → [意图识别] → [知识库检索] → [可执行性检查]

↓

[语音输出] ← [TTS] ← [LLM生成] ← [调用Cheftron API]

2.4 RAGFlow — RAG专项平台

| 属性 | 说明 |

|---|---|

| 定位 | 深度文档理解 + 企业级RAG引擎 |

| 核心优势 | 复杂文档解析(PDF/表格/图表/OCR)、高精度检索 |

| 与Dify区别 | 更专注RAG精度,弱于工作流/Agent |

| 文档处理 | 自研DeepDoc,支持布局分析、表格提取 |

深度解析能力:

普通RAG(Dify内置):

PDF → 纯文本提取 → 可能丢失表格结构、图文关系

RAGFlow:

PDF → 布局分析 → 识别标题/段落/表格/图片位置

→ 表格结构化提取(保持行列关系)

→ OCR识别扫描件文字

→ 图文关联(图片标注对应文字)

→ 高质量Chunk分割

三、四维对比矩阵

| 维度 | LangChain | Ollama | Dify | RAGFlow |

|---|---|---|---|---|

| 本质 | 代码框架 | 模型引擎 | 应用平台 | RAG引擎 |

| 使用方式 | 写Python/JS代码 | 命令行/API | Web界面配置 | Web界面配置 |

| 代码量 | 大量 | 无 | 极少 | 极少 |

| 灵活性 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| 易用性 | ⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| RAG能力 | ⭐⭐⭐(需自研) | ❌ 无 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 文档解析 | ⭐⭐(基础) | ❌ 无 | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 工作流 | ⭐⭐⭐⭐(代码) | ❌ 无 | ⭐⭐⭐⭐⭐ | ⭐⭐ |

| Agent | ⭐⭐⭐⭐⭐ | ❌ 无 | ⭐⭐⭐⭐ | ⭐⭐ |

| 本地部署 | ✅ 可 | ✅ 核心 | ✅ 可 | ✅ 可 |

| 数据隐私 | 依赖实现 | ⭐⭐⭐⭐⭐ | 依赖部署 | 依赖部署 |

四、组合使用场景

场景1:快速验证MVP(无代码)

推荐:Dify + 云端API

架构:

用户 → Dify Cloud → 阿里通义API(嵌入+生成)

优势:

- 5分钟搭建知识库问答

- 无需服务器,按量付费

- 快速验证业务价值

局限:

- 数据上云

- 持续API费用

场景2:企业私有化部署(数据敏感)⭐ 您的场景

推荐:Dify + Ollama + 可选RAGFlow

架构:

┌─────────────────────────────────────────┐

│ Dify(应用层) │

│ ├─ 知识库管理(调用RAGFlow或内置) │

│ ├─ 工作流编排(点餐→检索→控制) │

│ ├─ Agent开发(多轮对话+工具调用) │

│ └─ 运营监控 │

├─────────────────────────────────────────┤

│ RAGFlow(可选,增强RAG) │

│ └─ 复杂PDF解析(设备手册扫描件) │

│ └─ 高精度检索(多路召回+重排序) │

├─────────────────────────────────────────┤

│ Ollama(模型层) │

│ ├─ Qwen2-14B(对话生成) │

│ └─ bge-m3(文本嵌入) │

├─────────────────────────────────────────┤

│ 本地服务器 / 私有云 │

└─────────────────────────────────────────┘

优势:

- 数据完全不出域(菜谱、故障手册保密)

- 无API调用费用

- 功能完整(应用层+推理层)

场景3:极致灵活定制(开发者)

推荐:LangChain + Ollama + 自研RAG

架构:

LangChain(框架)

├─ 自定义Document Loader(特殊格式菜谱)

├─ 自定义Text Splitter(按工序分割)

├─ 自定义Embedding(领域微调模型)

├─ 自定义Retriever(混合检索策略)

├─ 自定义Chain(对接Cheftron API)

└─ 自定义Agent(复杂决策逻辑)

Ollama(本地模型)

└─ 运行微调后的领域模型

优势:

- 每个环节完全可控

- 深度优化检索效果

- 紧密集成业务系统

局限:

- 开发周期长(周/月级)

- 需持续维护代码

场景4:超大规模企业级

推荐:LangChain + RAGFlow + 云原生

架构:

┌─────────────────────────────────────────┐

│ 前端:自研/低代码平台 │

├─────────────────────────────────────────┤

│ 中台:LangChain(统一编排) │

│ ├─ 多租户管理 │

│ ├─ 多知识库路由 │

│ └─ A/B测试与灰度 │

├─────────────────────────────────────────┤

│ RAG引擎:RAGFlow集群 │

│ └─ 十亿级向量检索 │

├─────────────────────────────────────────┤

│ 模型服务:vLLM/TGI推理集群 │

│ └─ 高并发低延迟 │

└─────────────────────────────────────────┘

五、您的烹饪项目决策树

开始:您的需求是什么?

│

├─► 需要深度定制,已有技术团队

│ │

│ └─► LangChain + Ollama(灵活可控)

│

├─► 需要快速上线,无技术团队

│ │

│ ├─► 数据可上云 → Dify Cloud + 阿里API

│ │

│ └─► 数据需本地 → Dify + Ollama ⭐推荐

│

├─► 文档极复杂(扫描件/表格/图文混排)

│ │

│ └─► RAGFlow + Ollama(文档解析优先)

│ 或 Dify + RAGFlow + Ollama(完整方案)

│

└─► 已有系统,需嵌入AI能力

│

└─► LangChain(代码集成现有系统)

六、一句话定位

| 工具 | 核心记忆 | 类比 |

|---|---|---|

| LangChain | “链接一切,代码编织” | 乐高积木(自由组合,需动手) |

| Ollama | “On-premise Local LLM” | 家用发电机(本地供电,自主可控) |

| Dify | “Develop Intelligent Flows Yourself” | 智能厨房(设备齐全,按菜谱做) |

| RAGFlow | “Real Accurate Generation” | 专业料理机(切配精细,出品优质) |

黄金组合:Ollama 供弹药(本地模型),Dify/RAGFlow 造武器(应用平台),LangChain 定制特种装备(深度开发)。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)