一文搞懂Agent记忆层原理,大模型入门到精通,收藏这篇就足够了!

当前大语言模型(LLM)本身无状态,受 Transformer 上下文窗口限制,存在短期遗忘(对话超出窗口长度会丢失初始信息,影响连贯性)、无法长期学习(不能从与特定用户交互中积累偏好等信息,每次对话如与陌生人开始)、缺乏个性化(难以形成独特个性和建立长期用户关系,服务较通用)等问题。

一、为何 Agent 需要记忆

当前大语言模型(LLM)本身无状态,受 Transformer 上下文窗口限制,存在短期遗忘(对话超出窗口长度会丢失初始信息,影响连贯性)、无法长期学习(不能从与特定用户交互中积累偏好等信息,每次对话如与陌生人开始)、缺乏个性化(难以形成独特个性和建立长期用户关系,服务较通用)等问题。为打破 “金鱼困境”,实现持续学习、演化和提供个性化体验,记忆机制至关重要。

二、记忆系统构成

(一)短期记忆(STM)

- 核心功能:短期记忆如同 Agent 的 “工作台”,在执行当前任务或单次对话时,存储即时对话历史、当前任务状态、中间推理步骤等信息,保障短期交互的连贯性与上下文感知能力。

- 挑战:主要挑战在于如何有效管理有限的 LLM 上下文窗口。

- 实现路径

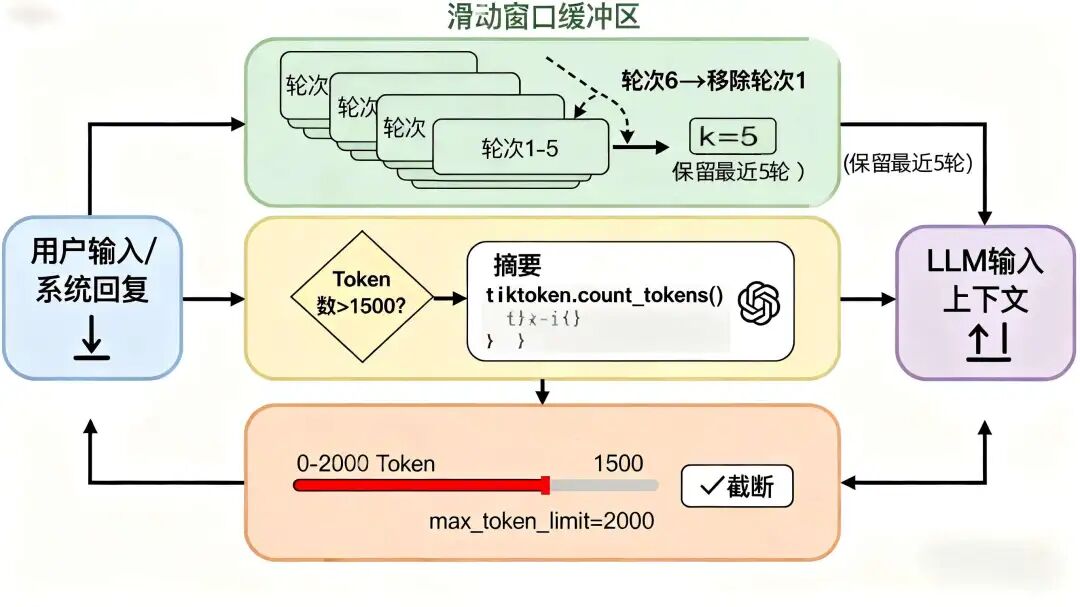

- 滑动窗口缓冲区:最简单方式,在内存维护固定大小队列,保留最近 K 轮对话。新对话产生时,最早对话移出窗口。例如,若设定保留最近 5 轮对话,当第 6 轮对话产生,第 1 轮对话就会被移除。

- 技术工具:LangChain

ConversationBufferWindowMemory、llama-indexWindowMemoryBuffer - 核心参数:

k(窗口大小,默认 5)、memory_key(存储对话历史的键名,默认 “history”) - 代码示例(LangChain):

from langchain.memory import ConversationBufferWindowMemory

memory = ConversationBufferWindowMemory(k=3) # 保留最近3轮对话

memory.save\_context({"input": "你好"}, {"output": "您好!有什么可以帮您?"})

memory.save\_context({"input": "我叫小明"}, {"output": "很高兴认识你,小明!"})

print(memory.load\_memory\_variables({})) # 输出前3轮对话

- 摘要化策略:当对话长度快超出上下文限制,调用 LLM 对早期对话内容摘要,将摘要和最近对话内容保留在上下文。如在一段长对话中,模型会定期对之前的多轮对话进行总结,以精简信息。

- 技术依赖:LLM 摘要模型(如 GPT-3.5-turbo-1106、Claude 3 Haiku)、LangChain

ConversationSummaryMemory - 摘要触发条件:对话 Token 数达到阈值(如 GPT-3.5 设为 1500 Token)、对话轮次超预设值(如每 10 轮触发一次)

- 技术优化:采用

tiktoken库计算 Token 数(支持多模型 Token 规则),代码示例:

import tiktoken

encoder = tiktoken.encoding\_for\_model("gpt-3.5-turbo")

def count\_tokens(text):

return len(encoder.encode(text))

\# 当对话历史Token数超阈值时触发摘要

if count\_tokens(memory.load\_memory\_variables({})\["history"]) > 1500:

summary = llm.generate\_summary(memory.load\_memory\_variables({})\["history"])

- Token 长度限制策略:依据 Token 数量控制记忆。总 Token 数超预设阈值时,从对话历史开头移除内容直至满足限制。比如,设定阈值为 1000 个 Token,当对话总 Token 数达到 1200 时,从开头逐步删除部分内容,使总 Token 数回到 1000 以下。

- 技术工具:LangChain

ConversationTokenBufferMemory、OpenAIEmbeddings(辅助 Token 计算) - 核心参数:

max_token_limit(默认 2000)、llm(指定用于 Token 计算的 LLM 模型) - 冲突处理:当单轮对话超

max_token_limit时,触发文本截断(采用textwrap库按 Token 分割)

- 相关示例(含技术对比):LangChain 中的 ConversationTokenBufferMemory、ConversationSummaryMemory(对整个对话摘要)、ConversationSummaryBufferMemory(保留近期对话并对更早对话摘要)、ConversationBufferWindowMemory 等都是短期记忆的实现方式。其中,ConversationBufferWindowMemory 实现简单,适合短对话,但长对话中会突然丢失早期重要信息;ConversationSummaryMemory 等能在长对话保留核心信息,扩展 “记忆” 长度,不过摘要过程会消耗额外 API 调用成本且可能丢失细节。

| 记忆类型 | 技术优势 | 适用场景 | 性能开销(Token / 轮) |

|---|---|---|---|

| ConversationBufferWindowMemory | 无额外 API 调用成本 | 短对话(<10 轮) | 0(仅内存存储) |

| ConversationSummaryMemory | 长对话核心信息保留 | 客服对话、多轮咨询 | 50-200(摘要消耗) |

| ConversationTokenBufferMemory | 精确控制 Token 用量 | 低 Token 预算场景 | 0(仅截断无摘要) |

(二)长期记忆(LTM)

- 核心功能:长期记忆是 Agent 的 “知识库” 与 “经验库”,用于跨会话、跨时间存储和检索信息,是实现个性化、持续学习和积累经验的关键。可存储用户偏好、核心事实、过去成功 / 失败经验、特定领域外部知识文档等。

- 挑战:核心挑战是如何从海量外部信息中高效精确检索当前任务所需相关知识。

- 实现路径(以 RAG 为核心,含技术细节)

- 简单拼接:将检索到的文本块直接塞入 Prompt,适用于检索内容不多的情况。比如,若只检索到少量与问题相关的文本片段,可直接将它们组合起来提供给模型。

- Map - Reduce 策略:检索内容过多时,先对每个文本块独立摘要(Map 阶段),再将所有摘要整合生成最终答案(Reduce 阶段)。例如在处理大量文档时,先分别对每篇文档生成简短摘要,再将这些摘要汇总,得出综合结论。

- Refine 策略:迭代处理检索到的文本块。先基于第一个文本块生成初步答案,再结合后续文本块和初步答案,让 LLM 优化修正。如在回答复杂问题时,模型先依据部分信息给出初步回答,再根据新检索到的相关信息对答案进行完善。

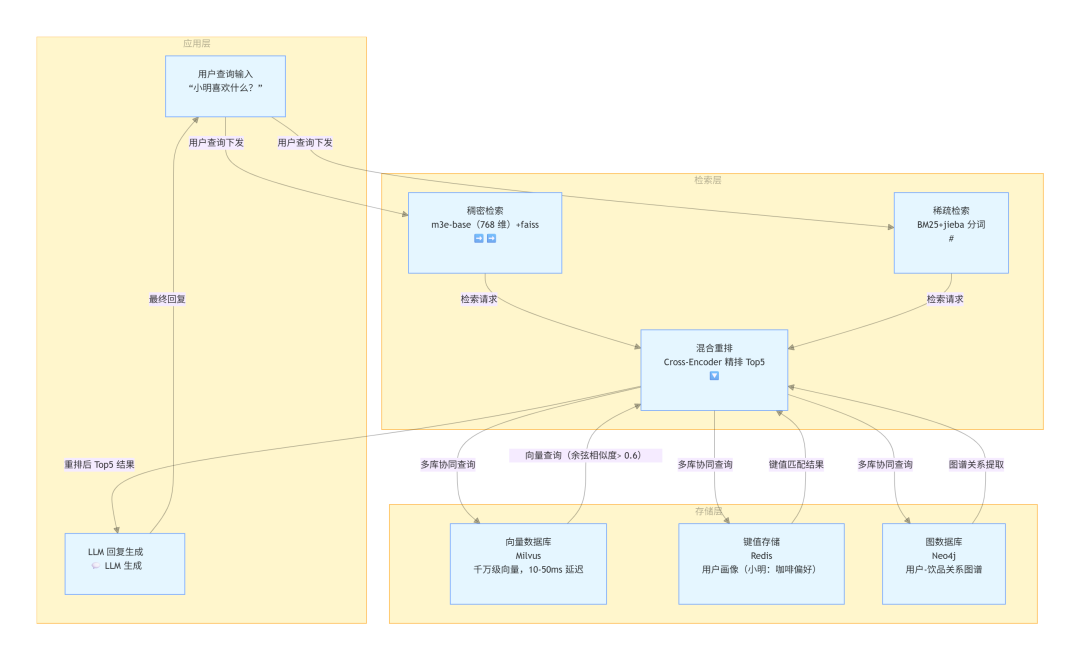

- 稠密检索:基于 Embedding 模型进行语义相似度搜索,是主流方式。需选择合适 Embedding 模型,如 BERT、m3e - base、OpenAI 的 text - embedding - ada - 002 等。例如,将用户问题和文档都转换为向量形式,通过计算向量间余弦相似度来查找最相关文档。

- 模型选型:中文用

m3e-base(维度 768,开源免费)、英文用text-embedding-ada-002(维度 1536,精度高) - 向量计算库:

faiss(CPU 环境)、faiss-gpu(GPU 加速,支持 1000 万级向量检索) - 代码示例(m3e + faiss):

from sentence\_transformers import SentenceTransformer

import faiss

\# 加载Embedding模型

model = SentenceTransformer('moka-ai/m3e-base')

\# 生成文档向量

docs = \["用户小明偏好咖啡", "用户小红对茶敏感"]

doc\_embeddings = model.encode(docs)

\# 构建FAISS索引

index = faiss.IndexFlatL2(doc\_embeddings.shape\[1])

index.add(doc\_embeddings)

\# 检索相似文档

query = "小明喜欢什么饮品"

query\_embedding = model.encode(\[query])

distances, indices = index.search(query\_embedding, k=1) # 返回Top1相似文档

- 稀疏检索:基于关键词匹配的传统方法,如 BM25 算法,对关键词明确的查询很有效。当用户输入包含明确关键词的问题时,该方法能快速定位相关文档。

- 算法:BM25(

rank_bm25库)、TF-IDF(scikit-learn库) - 技术优化:中文需先分词(

jieba或THULAC),英文用nltk分词

- 混合检索:结合稠密和稀疏检索优点,先分别搜索,再通过重排序模型融合结果,提高检索鲁棒性和准确性。在实际应用中,先利用稀疏检索快速筛选出一批可能相关文档,再用稠密检索对这些文档进行更精确排序。

- 融合方案:

ColBERT(稠密检索)+BM25(稀疏检索),通过Cross-Encoder重排序(如cross-encoder/ms-marco-MiniLM-L-6-v2)

- 向量数据库:存储非结构化数据(如文档、对话记录)语义向量,是实现 RAG 的核心。像 Pinecone、Milvus、Weaviate、Chroma 等。数据经 Embedding 模型转换为向量存入,通过计算向量间余弦相似度等方式快速语义检索。例如,将大量文章转换为向量存储在向量数据库中,当用户提问时,能迅速找到语义相似的文章。

- 键值存储 / 文档数据库:存储半结构化数据,如用户画像、会话 ID 等。如 Redis(用于快速缓存)、MongoDB。可方便地存储和查询与用户相关的特定信息。

- 图数据库:存储实体及其复杂关系,构建知识图谱,如 Neo4j。对需要深度推理和关系发现的 Agent 很重要。例如在构建智能客服系统时,可通过图数据库存储客户信息、产品信息以及它们之间的关系,帮助客服更好地理解客户问题和提供解决方案。

| 存储类型 | 技术工具 | 适用数据量 | 检索延迟(单条) | 部署成本 |

|---|---|---|---|---|

| 向量数据库 | Pinecone(云服务) | 亿级向量 | <100ms | 较高 |

| Milvus(开源) | 千万级向量 | 10-50ms | 中 | |

| Chroma(轻量开源) | 万级向量 | <50ms | 低 | |

| 键值存储 | Redis(内存数据库) | 百万级键值对 | <1ms | 中 |

| 图数据库 | Neo4j(开源) | 百万级节点关系 | 10-30ms | 较高 |

- 记忆合成流程

- 存储层:记忆的物理载体,根据数据类型选择合适存储方案。如文本数据可存储在普通文件系统或数据库中,向量数据存储在向量数据库。

- 检索层:负责从存储层 “提取” 记忆。通过上述检索策略,从存储的大量信息中找到与当前任务相关内容。

- 记忆合成层:将检索到的信息与当前查询整合成有效 Prompt,供 LLM 生成最终回复。例如,把用户问题、从长期记忆中检索到的相关知识以及短期记忆中的当前对话状态组合成一个完整的输入,提供给 LLM 进行处理。

- Prompt 拼接模板(LangChain

PromptTemplate):

from langchain.prompts import PromptTemplate

template = """

短期对话历史:{short\_memory}

长期记忆检索结果:{long\_memory}

用户当前问题:{user\_query}

请结合上述信息,生成自然语言回复。

"""

prompt = PromptTemplate(

input\_variables=\["short\_memory", "long\_memory", "user\_query"],

template=template

)

- 多源信息融合:采用

LangChain SequentialChain或llama-index MultiDocumentQueryEngine,支持并行处理短期 + 长期记忆

通过上述短期记忆和长期记忆的实现路径,共同构成动态、可扩展的记忆系统,助力 Agent 摆脱 “金鱼困境”,迈向更智能、自主方向。

三、关键技术挑战与解决方案

- 短期记忆 Token 溢出:采用

Token 压缩算法(如gzip文本压缩)+ 优先级排序(保留用户提问、核心回复,丢弃冗余寒暄) - 长期记忆检索噪声:引入

检索过滤机制(如设置相似度阈值,余弦相似度 < 0.6 过滤)、多轮检索(先粗检索 Top20,再精排 Top5) - 跨模态记忆存储:图像用

CLIP模型生成向量,音频用Wav2Vec2模型,统一存入向量数据库(如 Milvus 支持多模态向量)

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献399条内容

已为社区贡献399条内容

所有评论(0)