2026年02月12日热门论文

当前AI研究呈现三大核心趋势:效率优化、多模态融合与Agent应用深化。大模型研究转向参数精简与推理加速,如Flash模型通过稀疏架构实现11B活跃参数的高效推理;多模态突破2D-3D生成边界,如Stroke3D实现笔触到绑定动画的转换;Agent系统向专业化发展,涵盖代码生成、经济谈判等场景,如FeatureBench构建功能开发评估体系。同时强化学习与安全对齐技术持续升级,形成技术深耕-场景拓

近期研究趋势总结

“万物得其本者生,百事得其道者成。” 当前AI领域研究正朝着“效率与能力共生、创新与实用并重”的核心趋势演进:大模型从参数堆砌转向精准效率优化,通过稀疏架构、训练-free方法解锁算力潜力;多模态融合突破单一模态局限,从视觉-文本到3D-语音实现跨域协同;Agent系统向专业化、自主化深耕,覆盖代码生成、经济谈判、推荐调度等实用场景;强化学习成为能力提升的核心引擎,从单目标优化转向多目标协同与泛化;安全与对齐从被动防御走向主动设计,筑牢AI落地的信任基石;数据与预训练策略回归本质,通过重复学习、统一管理挖掘数据深层价值。研究脉络清晰呈现“技术深耕(效率、算法)- 场景拓展(多模态、Agent)- 安全兜底(对齐、防御)”的三维发展格局,彰显AI从实验室走向产业落地的务实路径。

一、大模型效率与压缩(删繁就简,提质增效)

-

⭐⭐⭐ Step 3.5 Flash: Open Frontier-Level Intelligence with 11B Active Parameters

核心应用场景:工业级Agent部署、数学与代码任务

创新点:以“稀疏MoE架构”破局,将196B参数基座与11B活跃参数精准结合,借 interleaved 3:1滑动窗口/全注意力与MTP-3技术削减交互延迟,辅以“可验证信号+偏好反馈”的强化学习框架,实现“frontier级智能”与“高效推理”的平衡,恰如“举一纲而万目张”,为大模型工业化部署奠定基础。

论文地址:https://huggingface.co/papers/2602.10604 -

⭐⭐⭐ ASA: Training-Free Representation Engineering for Tool-Calling Agents

核心应用场景:LLM工具调用适配

创新点:针对工具调用“分布偏移易碎、微调成本高昂”的痛点,提出训练-free的Activation Steering Adapter,通过中层激活干预与路由条件导向向量,破解“表征-行为鸿沟”,在Qwen2.5-1.5B上使工具使用F1从0.18升至0.50,False Positive率降至0.05,以“四两拨千斤”之智优化工具调用可靠性。

论文地址:https://huggingface.co/papers/2602.04935 -

⭐⭐⭐ PhyCritic: Multimodal Critic Models for Physical AI

核心应用场景:物理AI任务的感知与推理评估

创新点:首创两阶段RLVR pipeline,先经“物理技能预热”强化物理感知推理,再通过“自指批评微调”生成内部参考以提升判断稳定性,填补物理AI领域批评模型的空白,实现“评估-优化”闭环,如“工欲善其事,必先利其器”,为物理AI的精准迭代提供工具支撑。

论文地址:https://huggingface.co/papers/2602.11124 -

⭐⭐ GRU-Mem: When to Memorize and When to Stop: Gated Recurrent Memory for Long-Context Reasoning

核心应用场景:长上下文推理任务

创新点:针对长上下文推理“记忆爆炸、无退出机制”的弊病,引入文本控制的更新门与退出门,结合强化学习奖励信号,使推理速度提升400%,恰似“有所为而有所不为”,在保留关键信息的同时削减冗余计算。

论文地址:https://huggingface.co/papers/2602.10560 -

⭐⭐ G-LNS: Generative Large Neighborhood Search for LLM-Based Automatic Heuristic Design

核心应用场景:组合优化问题(TSP、CVRP)

创新点:跳出“构造性规则”的局限,提出生成式进化框架,让LLM协同进化“破坏-修复”算子对,通过合作评估机制捕捉算子交互逻辑,突破局部最优解,实现“重塑优于构造”的优化哲学,在经典组合优化问题上超越传统求解器。

论文地址:https://huggingface.co/papers/2602.08253 -

⭐⭐ TimeChat-Captioner: Scripting Multi-Scene Videos with Time-Aware and Structural Audio-Visual Captions

核心应用场景:多场景视频的结构化字幕生成

创新点:提出Omni Dense Captioning任务与六维结构schema,构建OmniDCBench基准与SodaM评估指标,以SFT+GRPO训练TimeChat-Captioner-7B,生成带时间戳的“剧本式”音视频字幕,超越Gemini-2.5-Pro,实现“形神兼备”的视频内容还原。

论文地址:https://huggingface.co/papers/2602.08711 -

⭐ ROCKET: Rapid Optimization via Calibration-guided Knapsack Enhanced Truncation for Efficient Model Compression

核心应用场景:大模型无训练压缩

创新点:将层间压缩分配转化为多选择背包问题,以稀疏矩阵分解与激活-权重敏感性分析实现单步稀疏化,30%压缩率下保留90%性能,轻量微调后可媲美同规模原生模型,践行“取其精华,去其糟粕”的压缩智慧。

论文地址:https://huggingface.co/papers/2602.11008 -

⭐ Free(): Learning to Forget in Malloc-Only Reasoning Models

核心应用场景:长horizon推理任务

创新点:针对LLM“只存不取”导致的推理退化,设计Free-Module插件式LoRA适配器,通过“推理-清理”模式动态修剪无用上下文,在8B-685B模型上均实现性能提升,于Qwen3-235B-A22B的长任务中恢复50%精度,印证“有舍方有得”的认知规律。

论文地址:https://huggingface.co/papers/2602.08030 -

⭐ ArcFlow: Unleashing 2-Step Text-to-Image Generation via High-Precision Non-Linear Flow Distillation

核心应用场景:文本到图像的快速生成

创新点:突破线性蒸馏的局限,以非线性流轨迹逼近教师模型轨迹,通过动量过程参数化速度场与解析积分,在Qwen-Image-20B等模型上实现40倍加速(2NFEs)且质量无损,彰显“曲径通幽”的优化思路。

论文地址:https://huggingface.co/papers/2602.09014

二、多模态模型与生成(融贯多域,感知生成)

-

⭐⭐⭐ GENIUS: Generative Fluid Intelligence Evaluation Suite

核心应用场景:多模态模型的生成流体智能评估

创新点:直指现有基准“重结晶智能、轻流体智能”的盲区,构建GENIUS套件,将生成流体智能拆解为“隐式模式诱导、临时约束执行、上下文适应”三大原语,提出训练-free注意力干预策略,为多模态模型从“知识复用”走向“动态推理”指明方向。

论文地址:https://huggingface.co/papers/2602.11144 -

⭐ Stroke3D: Lifting 2D strokes into rigged 3D model via latent diffusion models

核心应用场景:3D动画资产生成

创新点:首创“2D笔触+文本提示”到绑定3D模型的生成框架,通过Sk-VAE编码骨架结构、Sk-DiT生成嵌入,结合TextuRig数据集与SKA-DPO偏好优化,实现“笔落成型,动可起舞”的3D内容创作,填补2D到3D绑定生成的空白。

论文地址:https://huggingface.co/papers/2602.09713 -

⭐ Ex-Omni: Enabling 3D Facial Animation Generation for Omni-modal Large Language Models

核心应用场景:全模态模型的语音-3D面部动画对齐生成

创新点:解耦语义推理与时间生成,以语音单元为时间支架,借TQGF机制实现语义注入,构建InstructEx数据集,让OLLMs具备speech-accompanied 3D面部动画生成能力,实现“言形合一”的自然交互。

论文地址:https://huggingface.co/papers/2602.07106 -

⭐ VidVec: Unlocking Video MLLM Embeddings for Video-Text Retrieval

核心应用场景:视频-文本检索任务

创新点:发现MLLM中层已蕴含强视频-文本表征,提出“中层嵌入+校准头”的零样本检索方案,辅以文本对齐策略(密集字幕转摘要),无需视觉监督即超越视频基础模型,践行“慧眼识珠”的表征挖掘理念。

论文地址:https://huggingface.co/papers/2602.08099

三、Agent系统与应用(自主协同,赋能实业)

-

⭐⭐ FeatureBench: Benchmarking Agentic Coding for Complex Feature Development

核心应用场景:Agent的复杂功能开发能力评估

创新点:突破现有基准“重Bug修复、轻功能开发”的局限,构建200个特征级任务与3825个可执行环境,以“单元测试-依赖图”追溯任务,揭示顶尖模型仅11%任务成功率,为Agent编码能力从“修补”走向“创造”提供评估标尺。

论文地址:https://huggingface.co/papers/2602.10975 -

⭐ CLI-Gym: Scalable CLI Task Generation via Agentic Environment Inversion

核心应用场景:CLI环境的Agent训练与评估

创新点:类比Dockerfile与Agent任务,通过Agent模拟健康环境历史并反转至故障状态,生成1655个环境密集型任务,微调LiberCoder模型使Terminal-Bench性能提升21.1%,实现“以史为鉴,以境练兵”的Agent训练新模式。

论文地址:https://huggingface.co/papers/2602.10999 -

⭐ AgenticPay: A Multi-Agent LLM Negotiation System for Buyer-Seller Transactions

核心应用场景:多Agent的买卖谈判与经济交互

创新点:构建含110+任务的谈判基准,模拟“私有约束+产品依赖估值”的市场环境,要求Agent通过自然语言多轮谈判达成协议,揭示LLM在长horizon战略推理中的短板,为Agent化commerce奠定基础。

论文地址:https://huggingface.co/papers/2602.06008 -

⭐ EcoGym: Evaluating LLMs for Long-Horizon Plan-and-Execute in Interactive Economies

核心应用场景:LLM-Agent的长周期经济规划评估

创新点:打造“售货、自由职业、运营”三大经济环境,以1000+步长的持续决策与商业指标(净值、DAU)评估,发现模型在“战略-执行”中的协同短板,为Agent长周期规划能力的提升提供全景式测试床。

论文地址:https://huggingface.co/papers/2602.09514 -

⭐ V-STAR: Spend Search Where It Pays: Value-Guided Structured Sampling and Optimization for Generative Recommendation

核心应用场景:生成式推荐系统

创新点:破解生成式推荐“概率-奖励失配”的痛点,以价值引导解码挖掘高潜力前缀,借Sibling-GRPO计算兄弟相对优势,在提升推荐精度的同时增强多样性,实现“好钢用在刀刃上”的优化逻辑。

论文地址:https://huggingface.co/papers/2602.10699 -

⭐ QP-OneModel: A Unified Generative LLM for Multi-Task Query Understanding in Xiaohongshu Search

核心应用场景:社交网络(小红书)的查询理解与检索

创新点:打破传统查询处理的“多模型流水线”模式,将异质子任务统一为序列生成,经三阶段对齐与多奖励强化学习,生成高保真意图描述,离线F1提升9%+,在线检索相关性与用户留存显著优化,践行“一以贯之”的建模思想。

论文地址:https://huggingface.co/papers/2602.09901 -

⭐ When Actions Go Off-Task: Detecting and Correcting Misaligned Actions in Computer-Use Agents

核心应用场景:计算机使用Agent的行为对齐与安全防护

创新点:定义并研究Agent的“失准行为”(外部攻击/内部推理错误),构建MisActBench基准,提出DeAction护栏系统,通过结构化反馈迭代纠正失准行为,使攻击成功率降低90%,筑牢Agent安全落地的“防火墙”。

论文地址:https://huggingface.co/papers/2602.08995

四、强化学习优化(循道而进,智启迭代)

-

⭐ DataChef: Cooking Up Optimal Data Recipes for LLM Adaptation via Reinforcement Learning

核心应用场景:LLM适配的自动化数据配方生成

创新点:针对数据配方设计“手动繁琐、依赖经验”的痛点,提出DataChef-32B框架,以在线强化学习与代理奖励预测下游性能,生成的配方使Qwen3-1.7B在AIME’25上超越原生模型,实现“数据为料,强化为火,智烹佳肴”的自动化适配。

论文地址:https://huggingface.co/papers/2602.11089 -

⭐ Beyond Correctness: Learning Robust Reasoning via Transfer

核心应用场景:LLM的稳健推理能力提升

创新点:突破RLVR“重答案正确、轻推理稳健”的局限,提出RLTR框架,以“迁移奖励”验证推理前缀的跨模型指导能力,使MATH500的Maj@64提升3.6%,样本效率提升2.5倍,彰显“授人以鱼不如授人以渔”的推理优化理念。

论文地址:https://huggingface.co/papers/2602.08489 -

⭐ Internalizing Meta-Experience into Memory for Guided Reinforcement Learning in Large Language Models

核心应用场景:LLM的元经验学习与推理提升

创新点:在RLVR基础上引入“元经验”概念,通过对比分析正确/错误轨迹定位推理分叉点,将元经验内化为参数记忆,使不同规模模型的Pass@1提升3.92%-4.73%,实现“吃一堑,长一智”的自主进化。

论文地址:https://huggingface.co/papers/2602.10224 -

⭐ Blockwise Advantage Estimation for Multi-Objective RL with Verifiable Rewards

核心应用场景:结构化生成的多目标强化学习优化

创新点:破解GRPO“单标量优势导致奖励干扰”的问题,提出块级优势估计,为不同文本块分配独立优势,结合结果条件基线避免嵌套采样,在数学任务中缓解干扰并保留集成增益,践行“分而治之”的优化策略。

论文地址:https://huggingface.co/papers/2602.10231 -

⭐ Online Causal Kalman Filtering for Stable and Effective Policy Optimization

核心应用场景:LLM强化学习的策略优化稳定性提升

创新点:针对token级重要性采样的高方差问题,将IS比率建模为时序latent状态,以因果卡尔曼滤波autoregressively更新状态,平滑噪声同时保留结构信息,在数学推理任务中实现稳定优化,恰似“运筹帷幄,稳中求进”。

论文地址:https://huggingface.co/papers/2602.10609 -

⭐ UMEM: Unified Memory Extraction and Management Framework for Generalizable Memory

核心应用场景:LLM-Agent的通用记忆提取与管理

创新点:打破“记忆提取静态、管理动态”的脱节现状,提出UMEM框架,通过语义邻域建模与边际效用奖励,联合优化记忆提取与管理,多轮任务性能提升10.67%,实现“知行合一”的记忆进化。

论文地址:https://huggingface.co/papers/2602.10652 -

⭐ Graph-Enhanced Deep Reinforcement Learning for Multi-Objective Unrelated Parallel Machine Scheduling

核心应用场景:制造场景的多目标并行机器调度

创新点:融合PPO与GNN,以GNN建模作业、机器与设置的复杂状态,通过多目标奖励函数平衡总加权延迟与总设置时间,超越传统调度规则与元启发式算法,实现“运筹于帷幄之中,决胜于千里之外”的智能调度。

论文地址:https://huggingface.co/papers/2602.08052

五、安全与对齐(筑牢防线,行稳致远)

-

⭐ When the Prompt Becomes Visual: Vision-Centric Jailbreak Attacks for Large Image Editing Models

核心应用场景:图像编辑模型的视觉导向越狱攻击与防御

创新点:揭示视觉提示编辑的安全盲区,提出VJA视觉越狱攻击,构建IESBench基准,攻击成功率达70.1%-80.9%,并设计训练-free内省多模态推理防御,为图像编辑模型的安全对齐提供“攻防兼备”的解决方案。

论文地址:https://huggingface.co/papers/2602.10179 -

⭐ Large Language Lobotomy: Jailbreaking Mixture-of-Experts via Expert Silencing

核心应用场景:MoE模型的安全对齐与越狱防御

创新点:发现MoE模型的安全行为集中于少数专家,提出L³训练-free攻击,通过自适应专家沉默绕过安全护栏,攻击成功率从7.3%升至70.4%,揭示效率与安全的内在张力,为MoE模型的分布式安全机制设计敲响警钟。

论文地址:https://huggingface.co/papers/2602.08741 -

⭐ GoodVibe: Security-by-Vibe for LLM-Based Code Generation

核心应用场景:LLM代码生成的安全增强

创新点:定位安全相关推理集中于少数神经元,通过梯度归因识别安全关键神经元,实施神经元选择性微调与激活聚类,以4700倍更少可训练参数匹配全量微调的安全性能,实现“精准施策”的代码安全优化。

论文地址:https://huggingface.co/papers/2602.10778 -

⭐ Bielik Guard: Efficient Polish Language Safety Classifiers for LLM Content Moderation

核心应用场景:波兰语LLM的内容安全审核

创新点:构建0.1B/0.5B参数的紧凑型安全分类器,覆盖仇恨、粗俗、色情等五大安全维度,0.1B模型实现77.65%精度与0.63%低误报率,超越同规模基线,为小语种LLM的安全落地提供高效解决方案。

论文地址:https://huggingface.co/papers/2602.07954

六、数据处理与预训练(精耕细作,固本培元)

-

⭐ Data Repetition Beats Data Scaling in Long-CoT Supervised Fine-Tuning

核心应用场景:LLM的长链思维监督微调

创新点:颠覆“数据越多越好”的认知,证明长CoT微调中“小数据集多轮重复”优于“大数据集单轮训练”,Olmo3-7B在400样本128轮训练下超越51200样本单轮训练12-26个百分点,印证“熟读深思子自知”的学习规律。

论文地址:https://huggingface.co/papers/2602.11149 -

⭐ Weight Decay Improves Language Model Plasticity

核心应用场景:LLM预训练的可塑性优化

创新点:聚焦预训练超参数对下游适配的影响,发现增大权重衰减可增强模型可塑性,即使预训练验证损失上升,下游微调性能仍显著提升,揭示“守正出奇”的预训练策略,为模型适配性优化提供新视角。

论文地址:https://huggingface.co/papers/2602.11137 -

⭐ FedPS: Federated data Preprocessing via aggregated Statistics

核心应用场景:联邦学习的分布式数据预处理

创新点:填补联邦学习中数据预处理的研究空白,基于聚合统计与数据草图技术,设计特征缩放、编码、缺失值填充等联邦算法,支持横向/纵向FL设置,实现“数据不出域,预处理不打折”的高效协同。

论文地址:https://huggingface.co/papers/2602.10870

七、特定任务与检索(精准赋能,学以致用)

-

⭐ Benchmarking Large Language Models for Knowledge Graph Validation

核心应用场景:知识图谱的事实验证

创新点:构建FactCheck基准,从“内部知识、外部证据(RAG)、多模型共识”三维评估LLM的KG验证能力,发现LLM稳定性不足,RAG与共识策略增益有限,为KG事实校验的技术路线提供实证参考。

论文地址:https://huggingface.co/papers/2602.10748 -

⭐ Towards Autonomous Mathematics Research

核心应用场景:自主数学研究与问题求解

创新点:开发Aletheia数学研究Agent,融合Gemini Deep Think、推理时缩放律与工具使用,实现从奥赛题到博士级习题的自主求解,完成AI独立生成研究论文、人机协作证明定理等里程碑,推动AI从“解题”走向“科研”。

论文地址:https://huggingface.co/papers/2602.10177

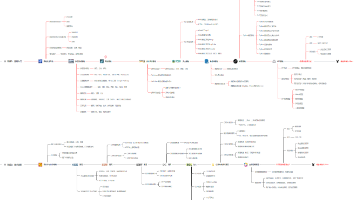

AI领域近期研究思维导向图

核心趋势:效率与能力共生 · 创新与实用并重

├── 一、大模型效率与压缩

│ ├── 稀疏架构优化(Step 3.5 Flash)

│ ├── 训练-free适配(ASA)

│ ├── 记忆管理(GRU-Mem、Free()LM)

│ ├── 蒸馏加速(ArcFlow)

│ └── 模型压缩(ROCKET)

├── 二、多模态模型与生成

│ ├── 流体智能评估(GENIUS)

│ ├── 3D生成(Stroke3D、Ex-Omni)

│ ├── 视频-文本检索(VidVec)

│ └── 音视频字幕(TimeChat-Captioner)

├── 三、Agent系统与应用

│ ├── 编码Agent(FeatureBench、CLI-Gym)

│ ├── 经济交互(AgenticPay、EcoGym)

│ ├── 推荐Agent(V-STAR)

│ ├── 搜索查询(QP-OneModel)

│ └── 计算机使用Agent(DeAction)

├── 四、强化学习优化

│ ├── 数据配方(DataChef)

│ ├── 稳健推理(RLTR)

│ ├── 元经验学习(MEL)

│ ├── 多目标优化(Blockwise Advantage Estimation)

│ ├── 记忆管理(UMEM)

│ └── 调度优化(Graph-Enhanced DRL)

├── 五、安全与对齐

│ ├── 视觉越狱攻防(VJA)

│ ├── MoE安全(L³)

│ ├── 代码安全(GoodVibe)

│ └── 小语种审核(Bielik Guard)

├── 六、数据处理与预训练

│ ├── 重复学习(Data Repetition)

│ ├── 预训练可塑性(Weight Decay)

│ └── 联邦预处理(FedPS)

└── 七、特定任务与检索

├── 数学研究(Aletheia)

└── 知识图谱验证(FactCheck)

更多内容关注公众号"快乐王子AI说"

更多推荐

已为社区贡献113条内容

已为社区贡献113条内容

所有评论(0)