Agent中的反思机制

反思机制将 AI 从“概率预测器”提升到了“自主解决问题的智能体”。它不仅是在输出结果,而是在通过“尝试-失败-分析-改进”的过程不断逼近最优解。

·

在 AI Agent 架构中,反思机制(Reflection Mechanism) 是让智能体具备“自我进化”能力的核心。如果说思维链(CoT)是“谋定而后动”,那么反思机制就是“三省吾身”。

它通过建立一个闭环反馈系统,让模型审视自己之前的输出、推理过程或执行结果,从而识别错误并进行修正。

1. 反思机制的核心逻辑:闭环控制

传统的 LLM 调用是线性的(Input -> Output),而带有反思机制的 Agent 是循环的。其标准流程通常包含以下三个阶段:

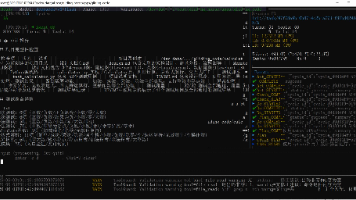

- 执行阶段 (Action/Generation):Agent 根据当前目标生成一个初始方案、代码或回答。

- 评估阶段 (Evaluation/Critique):对生成的产出进行检查。这可以通过模型自我检查、外部工具(如编译器、单元测试)或另一个专门的审核模型(Critic)来完成。

- 反思与修正阶段 (Reflection & Revision):模型根据评估反馈,分析错误原因(为什么错了?哪里漏了?),并生成改进后的版本。

2. 反思机制的三种主流实现范式

A. 简单自我修正 (Self-Correction)

这是最基础的实现,通常在单次对话或简单的 Loop 中完成。

- 做法:在模型生成答案后,立即发送第二个 Prompt:“检查你上面的回答。是否存在逻辑错误或事实不符?如果有,请给出更正后的版本。”

- 优点:实现简单,能减少明显的低级错误。

- 缺点:模型往往倾向于坚持自己的初始错误(自我印证偏见)。

B. Reflexion 架构 (基于语言反馈的强化学习替代方案)

由 Shinn 等人在 2023 年提出,是目前最著名的反思框架。它模拟了人类的“失败乃成功之母”学习过程。

- Actor (执行者):尝试完成任务并生成轨迹。

- Evaluator (评价者):给产出打分(如:代码是否跑通,测试覆盖率多少)。

- Self-Reflection (反思者):如果得分不高,反思者会生成一段自然语言反馈(例如:“我之前使用了错误的 API 路径,下次应该尝试 X 路径”)。

- 记忆存储:这段文字反馈会被存入长期记忆(Memory)。在下一次尝试时,模型会读取这段“教训”,从而避免重蹈覆辙。

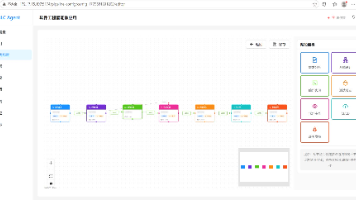

C. 多智能体对抗/协作反思 (Multi-agent Reflection)

通过角色扮演,让不同的模型实例相互博弈。

- 角色分工:

- Generator (生成者):负责干活。

- Critic (评论家):专门负责“找茬”,以刁钻的角度评估生成者的作品。

- 流程:Generator 生成内容 -> Critic 提出修改意见 -> Generator 针对意见修改。这种方式比“自我反思”更有效,因为 Critic 的系统提示词(System Prompt)是专门为审计优化的。

3. 常见的“反思”触发信号(工程实现关键)

在开发 Agent 时,你不能无限制地让它反思(会浪费 Token 和时间),通常需要定义触发机制:

- 工具执行失败:当代码运行报错(Runtime Error)或 API 返回 4xx/5xx 时,强制进入反思逻辑。

- 外部验证不通过:例如在 Text2SQL 任务中,SQL 虽然语法正确,但查出来的结果是空集,或者与预期 Schema 不符。

- 评分低于阈值:使用一个较小但判别能力强的模型作为“裁判”,对输出进行打分,低于 80 分则打回重做。

- 逻辑不一致性:利用前文提到的自一致性(Self-Consistency),如果多次采样结果不一,则触发反思。

4. 反思机制的实际价值

| 解决的问题 | 表现形式 |

|---|---|

| 幻觉 (Hallucination) | 模型在反思过程中会核对事实,从而发现并剔除凭空捏造的内容。 |

| 陷入死循环 | 通过记录失败尝试,反思机制能让 Agent 意识到“这条路不通”,从而尝试新策略。 |

| 长文本一致性 | 在撰写长文或大型项目时,反思可以检查前后文逻辑是否冲突。 |

| 代码/工具准确率 | 极大地提升了复杂 API 调用和复杂算法生成的成功率。 |

5. 反思机制的局限性

- Token 膨胀:每一轮反思都要重新输入上下文并生成长文本,成本成倍增加。

- 效率损耗:由于需要多次往返推理,实时性(Latency)会变差。

- 反思陷阱:有时候模型会把对的改错,或者在错误的逻辑里越陷越深(Over-correction)。

总结

反思机制将 AI 从“概率预测器”提升到了“自主解决问题的智能体”。 它不仅是在输出结果,而是在通过“尝试-失败-分析-改进”的过程不断逼近最优解。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)