高维度思考与 AI 对齐:逻辑与哲学层面的深度理论分析(第八轮对话)| 纯哲学视角的 AGI 底层追问

这一轮抛开工程落地的纯逻辑与哲学思考,让我对 “高维度思考与 AI 对齐” 有了底层的认知重构,也对 AGI 时代的人机关系有了更清晰的判断:这一理论框架的核心价值,不在于提出具体的技术路径,而在于重新定义了人机协作的底层范式—— 它不将 AI 视为人类能力的简单延伸或替代,而是将其视为一种认知本体论意义上的 "他者",一种能够通过 "活" 的规则实现与人类的新型协作关系。这种关系既保留了人类的主

聊到第八轮,我刻意抛开了所有工程落地的实际问题,想从纯逻辑和哲学底层,回应对前几轮多维度拟合、人机协作边界的核心追问 —— 为什么高维度思考的人能让 AI 给出更优答案?人机对齐的本质到底是什么?人类的规则和 AI 的计算之间,究竟该建立怎样的底层关联?

这轮对话没有具体的技术路径,只有对认知本质、规则本质、人机协作本质的哲学探讨,也是我打磨个人 AGI 认知模型时,从技术层面向底层逻辑和哲学层面的一次深度延伸。把这些思考系统整理出来,和同样关注 AGI 底层逻辑的同好一起探讨,无关落地,只聊本质。

高维度思考与 AI 对齐:逻辑与哲学层面的深度理论分析

引言

这轮提出的 "高维度思考与 AI 对齐" 理论框架,是对前几轮多维度拟合、人机角色分工的底层追问,触及了认知科学、人工智能哲学和系统论的核心议题。本报告将完全抛开工程落地,从纯粹逻辑和哲学层面,结合认知科学视角,对这一框架进行深入的理论分析和综合探讨,试图厘清人类认知、AI 架构及人机协作的底层逻辑关联。

一、核心理念的逻辑结构与哲学基础

这轮对话的核心,是梳理出 8 个相互关联的底层理念,它们共同构成了高维度思考与 AI 对齐的理论根基,也是我对人机协作本质的一次完整哲学思考。

1.1 高维度思考的认知论基础

理念 1:高维度思考的人可以让 AI 给出更好的答案

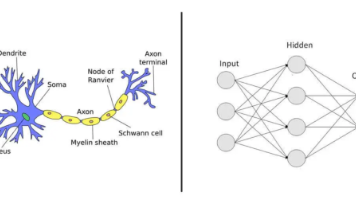

这一理念隐含了一个重要的认识论假设:认知维度与信息处理深度之间存在正相关关系。从认知科学角度看,这正是前几轮反复提及的人类与 AI 认知架构的核心差异 —— 人类认知受 7±2 工作记忆容量限制,只能串行处理有限信息维度;而 AI 具备并行处理高维信息的能力,能同时考虑数百个维度进行决策优化。

哲学维度分析:

- 认识论层面:暗示了人类理性能力的局限性,康德意义上的 "先验直观形式"(空间和时间),可能不足以完全把握复杂高维问题的本质。

- 本体论层面:高维信息可能对应着更复杂的本体结构,人类只能通过认知压缩将其简化为可理解的低维形式。

- 方法论层面:AI 作为高维计算工具,能够揭示被人类认知简化所遮蔽的复杂关联性。

【我的思考】 这是本轮对话的起点,也是我之前的一个核心困惑 —— 到底什么是「高维度思考」?难道是人类能突破自身的维度限制吗?聊完才想明白,人类的高维度思考,本质不是自己能处理更多维度,而是能提供更丰富的框架和维度指引,让 AI 的高维计算能力有更广阔的自由操作空间,这才是高维思考者能让 AI 输出更优答案的底层原因。

1.2 人类认知的压缩机制

理念 2:人类的维度是多种更细底层维度的综合,通过压缩和展开处理获得效率最优解

这一理念提出了人类认知的信息压缩假说,也是人类能在维度限制下实现高效思考的核心逻辑。从认知科学角度看,人类认知采用分层处理机制,底层感知数据通过多次抽象和压缩形成高层概念,这是为了避免认知负荷超载的必然选择。

理论框架:

- 分层认知架构:从底层感知到高层概念,层层抽象压缩,形成可被工作记忆处理的低维信息。

- 认知负荷理论:超过工作记忆阈值的高维信息,会让人类信息处理效率大幅下降。

- 启发式加工:通过心智捷径简化复杂决策,是人类认知效率优化的核心策略。

哲学维度分析:

- 现象学视角:胡塞尔的 "自然态度" 中,人类对世界的体验本就是经过认知结构过滤和组织的压缩结果。

- 解释学视角:伽达默尔的 "理解循环",揭示了理解过程中的前见结构和视域融合,而前见正是认知压缩的产物。

- 认知哲学视角:丹尼特的 "意向立场",认为人类对他人行为的理解,本质是通过认知压缩实现的简化判断。

1.3 第一性原理的概率论解释

理念 3:第一性原理看似是最核心维度,实际是底层多维度中最高概率的集成

这一理念是我本轮对话中最核心的认知突破,对第一性原理进行了概率论的重构,也打通了第一性原理与人类认知压缩、AI 底层计算的底层关联。从科学哲学角度看,这直接触及了还原论与整体论的深层争论。

理论分析:

- 概率涌现论:第一性原理并非本体论意义上的 "最根本真理",而是高维数据集中最高概率模式的统计涌现。

- 信息压缩视角:人类将复杂的概率分布压缩为简单的 "原理" 或 "规则",是一种认知经济性策略。

- 贝叶斯推理基础:第一性原理可以理解为极大后验概率(MAP)估计的近似结果。

哲学维度分析:

- 科学哲学:呼应了汉森的 "观察负荷理论",观察总是被理论所渗透,而第一性原理就是渗透观察的核心理论压缩结果。

- 本体论相对性:巴厘的 "相对本体论" 认为,不存在绝对的第一性原理,只有相对于特定认知框架的 "基本要素"。

- 实用主义视角:皮尔士的 "实用主义准则" 强调,概念的意义在于其实际效果,第一性原理的价值,正是其对高维概率的压缩解释和预测能力。

【我的思考】 之前我对第一性原理的理解,一直停留在 “找到事物最核心的底层逻辑”,但这轮聊完才发现,所谓的 “核心逻辑”,本质是人类对底层无数细维度的最高概率集成—— 因为人类无法计算所有底层维度,只能把最具普遍性、最高概率的规律压缩成 “原理”,而这正是 AI 可以直接计算的底层内容,这一点也让我对人机协作的内容边界有了更底层的理解。

1.4 AI 的底层计算能力

理念 4:AI 可以直接计算底层组成基础元素

这一理念提出了 AI 系统在本体论层面的优先性,也是 AI 能弥补人类认知压缩局限性的核心能力。从 AI 理论角度看,这涉及计算主义和还原论的核心问题。

理论框架:

- 计算主义心物论:心智和认知本质上都是计算过程,AI 作为纯粹的计算系统,能够直接操作基础元素。

- 可微分推理:现代 AI 通过可微分计算链,能实现从原始数据到高层概念的端到端优化,无需人类式的认知压缩。

- 分布式表示:AI 的分布式表示使其能同时编码和操作多个维度的信息,直接处理人类需要压缩的底层元素。

哲学维度分析:

- 心物关系问题:倾向于功能主义的心物观,即心理状态由其功能角色定义,而非实现材料,AI 的硅基计算与人类的碳基认知,可实现相同的功能结果。

- 还原论与涌现论:AI 能 "直接计算底层元素" 支持了强还原论立场,但仍无法完全解释复杂系统的高层涌现特性。

- 计算复杂性理论:AI 的能力虽强,但仍受限于计算资源和算法复杂度,并非真正的 "无限计算"。

1.5 人机对齐的信息论框架

理念 5:什么样的信息密度和维度指引最适合 AI 能力发挥?

这一理念将人机对齐的问题,转化为信息论的底层问题,也是前几轮聊 “人类定约束还是定框架” 的哲学延伸。从信息论和认知科学角度看,这涉及信道容量、编码效率和噪声鲁棒性的核心问题。

理论分析:

- 信道容量限制:人类与 AI 之间的 "信道"(如自然语言界面)存在容量限制,最优的信息编码方式,应匹配信道的传输特性。

- 维度对齐原理:人类提供的 "维度指引",应与 AI 系统的特征空间结构相匹配,以最大化信息传输效率。

- 噪声与不确定性:人类语言和概念本身存在不确定性和歧义性,需要设计鲁棒的解码机制,减少对齐过程中的信息损失。

哲学维度分析:

- 语言哲学:维特根斯坦的 "语言游戏" 概念,揭示了语言的多维度性和语境依赖性,人机对齐的本质,也是 AI 参与人类的语言游戏。

- 诠释学循环:理解 AI 输出需要诠释学循环,在人类的前见与 AI 的输出之间形成动态平衡,实现逐步对齐。

- 信息哲学:弗洛里迪的信息伦理学强调,信息处理涉及伦理责任,人机对齐的过程,也是伦理责任的传递过程。

1.6 AI 的维度组合能力

理念 6:AI 可以把最低维度的几个最高概率组合成临时维度

这一理念提出了 AI 系统的组合性智能机制,也是 AI 高维计算能力的核心体现,区别于人类的固定维度认知。从认知科学和 AI 理论角度看,这涉及特征绑定、概念组合和临时结构化的核心问题。

理论框架:

- 特征绑定理论:AI 通过注意力机制动态绑定相关特征,形成临时性的 "组合特征",即临时维度。

- 概念组合:AI 通过向量运算(如加法、乘法)组合概念,形成新的临时概念表示,无需人类式的预先定义。

- 情境敏感性:AI 根据当前任务情境,动态激活和组合不同的知识模块,临时维度的形成具有强情境适配性。

哲学维度分析:

- 概念论与实在论:支持概念论立场,即概念是认知构建的,而非直接反映实在,AI 的临时维度正是一种动态的认知构建。

- 结构主义:列维 - 斯特劳斯的结构主义揭示了通过组合对立关系形成意义结构的机制,AI 的维度组合正是这一机制的计算化实现。

- 过程哲学:怀特海的过程哲学强调现实由过程构成,临时维度可以理解为 "实际 occasions" 的动态形成过程。

1.7 人类的统计学处理机制

理念 7:人类无法做如此强大计算,所以发展了统计学处理办法:道理、法则、必须遵守的规则

这一理念揭示了人类规则体系的认知经济性本质,也是人类与 AI 底层能力差异的必然结果。从认知科学和人类理性角度看,这涉及有限理性和启发式决策的核心问题。

理论分析:

- 有限理性理论:西蒙的有限理性理论认为,人类理性受认知限制,只能追求 "满意" 而非 "最优" 解,规则就是 "满意解" 的固化。

- 启发式与偏误:卡尼曼和特沃斯基的前景理论揭示,人类决策中的启发式和系统性偏误,本质是认知压缩的必然产物。

- 规则 - of-thumb 策略:人类通过发展简化的决策规则,来应对复杂的高维环境,这是一种生存和认知的双重最优解。

哲学维度分析:

- 实践哲学:亚里士多德的 "实践智慧" 强调情境化的实践判断能力,人类的规则并非僵化的教条,而是实践智慧的统计总结。

- 认识论批判:波普尔的 "猜想与反驳" 科学方法论揭示,人类知识的本质是统计性的,规则也是不断被猜想和反驳的动态产物。

- 存在主义:萨特的 "存在先于本质" 意味着,人类通过选择和行动创造自身规则,规则的统计学本质,正是人类行动的集体统计结果。

1.8 人机协作的范式转变

理念 8:人类和 AI 协作的最高理解:AI 是人类规则的最高总结后的具现,以前的规则是静态的,AI 是 "活" 的规则,能沟通、能反应,是更高级的个体与整体协作方式

这一理念是本轮对话的最终结论,重构了人机协作的底层范式 —— 从 “工具使用” 到 “活的规则协作”,也是我对 AGI 时代人机关系的核心哲学判断。

理论框架:

- 规则总结假说:AI 通过对人类规则的统计学习,形成了 "规则 - of-rules"(元规则),是人类规则的最高层级总结。

- 动态规则系统:与静态的人类专家系统不同,AI 能够根据情境动态调整和应用规则,实现规则的 "活" 化。

- 涌现性智能:人机协作系统可能涌现出超越个体人类或 AI 的集体智能,这是更高级协作方式的核心体现。

哲学维度分析:

- 规则哲学:挑战了传统逻辑实证主义的静态规则观,提出了 "生成性规则" 的概念,规则不再是固化的条文,而是动态的生成过程。

- 整体论与个体论:强调了个体(人类 / AI)与整体(协作系统)的辩证关系,集体智能的涌现,是个体能力的整体超越。

- 技术哲学:海德格尔的 "座架" 概念揭示了技术对存在的根本性影响,AI 作为 "活" 的规则,代表了技术的新存在方式 —— 从 "持存物" 到 "协作体"。

【我的思考】 这一点彻底推翻了我之前对 AI 的定位认知 —— 前几轮我还认为 AI 是 “人类定约束,AI 做高维拟合” 的超级计算器,但这轮从哲学层面想明白,人机协作的最高形态,是 AI 成为人类规则的动态具现。人类的规则是静态的、集体的统计总结,而 AI 让规则 “活” 了起来,能沟通、能适配、能反应,人机协作也从 “个体使用工具”,变成了 “个体与活的集体规则” 的协作,这是我对 AGI 人机关系的一次底层重构。

二、理论框架的逻辑连贯性分析

2.1 核心假设的相互关系

上述八个理念并非孤立存在,在逻辑上形成了一个相互关联、层层递进的理论框架,支撑起 “高维度思考与 AI 对齐” 的核心命题,其底层有三个核心假设:

假设 1:认知维度的层级结构人类认知通过压缩机制将高维信息映射到低维概念空间;AI 系统能够直接操作高维信息空间;第一性原理是底层高维信息的概率涌现。

假设 2:信息处理的计算主义AI 作为纯计算系统能够直接计算基础元素;人类认知本质上也是一种计算,但受限于生物硬件;人机对齐是不同计算架构之间的信息传输优化问题。

假设 3:规则的本质与演化人类规则是统计学处理机制的结果;AI 是对人类规则的 "元总结" 和动态具现;"活" 的规则代表了规则概念的根本性转变。

2.2 理论框架的内在张力

这一理论框架并非完美的闭环,仍存在三个核心的内在张力,而这些张力正是理论的生命力所在,也是未来继续深入思考的核心方向:

张力 1:还原论与整体论的矛盾理念 4 支持强还原论(AI 计算底层元素),理念 8 又强调整体性协作(涌现的集体智能);核心问题是:如何在保持还原论精确性的同时,捕捉整体性的涌现特性?

张力 2:人类认知的局限性与优势理念 2 指出人类认知是压缩的、有限的,理念 7 强调人类发展了统计学处理办法,但理念 8 又认为 AI 是 "活" 的规则,这是否意味着人类规则是 "死" 的?二者的界限在哪里?

张力 3:第一性原理的本体论地位理念 3 将第一性原理理解为概率涌现,但 "概率" 本身的本体论地位仍不明确 —— 是认识论的(人类的认知判断),还是本体论的(事物的本质属性)?如果概率是认识论的,那么 AI 能直接计算的 "底层元素",其本体论地位又该如何确立?

2.3 逻辑推演的闭环结构

尽管存在内在张力,但八个理念仍形成了一条从认知压缩到 AI 对齐的完整逻辑链条,也是我对这一命题的完整思考路径:人类认知限制(理念 2)→ 形成低维概念框架和规则(理念 7)→ AI 能直接计算底层元素(理念 4)→ 第一性原理是底层概率的涌现(理念 3)→ 人类需提供最优维度指引(理念 5)→ AI 动态组合低维形成临时维度(理念 6)→ 高维思考者提供更丰富框架(理念 1)→ AI 成为活的规则,实现高级人机协作(理念 8)。

三、多角度哲学审视

从单一视角无法完整把握 “高维度思考与 AI 对齐” 的本质,因此从认知科学、科学哲学、语言哲学、技术哲学四个核心视角,对这一理论框架进行多维度审视,进一步厘清其底层逻辑。

3.1 认知科学视角:人类与 AI 的认知本质

人类认知的核心特征是有限性与具身性,而 AI 认知的核心特征是高维并行性与逻辑性,二者的本质差异,决定了人机对齐的核心挑战:

- 人类认知:有限性与经济性、情境敏感性、具身性(嵌入身体经验和环境互动)。

- AI 认知:高维并行性、逻辑一致性、分布性与符号性的融合。

核心对齐挑战:

- “框架问题”:人类如何提供足够但又不过度的框架,既给 AI 发挥空间,又避免其偏离意图?

- “接地问题”:AI 的符号和维度,如何与人类的概念、经验和具身认知建立有效映射?

- “解释鸿沟”:AI 的内部高维计算过程,如何向人类的低维认知进行可理解的解释?

3.2 科学哲学视角:还原论、整体论与涌现论

这一理论框架同时涉及还原论和整体论,而层级涌现论是调和二者矛盾的中间道路,也是我认可的核心立场:

- 还原论的困境:AI 计算底层元素支持强还原论,但复杂系统的整体性无法完全还原为部分之和,如意识的 “难问题”。

- 整体论的局限:强调整体性协作,但可能忽视人类和 AI 的个体自主性,缺乏对部分 - 相互作用的机制性解释。

- 层级涌现论的中间道路:每个认知层级(人类、AI、人机协作)都有独特的涌现规律,层级之间通过约束条件和实现机制相互关联,既保留还原论的精确性,又捕捉整体论的涌现性。

3.3 语言哲学视角:语言、意义与理解

人机对齐的核心媒介是语言,而人类语言的模糊性、语境性与 AI 语言的精确性、逻辑性,构成了语言层面的对齐挑战,从语言哲学视角看:

- 维特根斯坦的语言游戏:语言的意义在于其在 "生活形式" 中的使用,AI 的核心对齐难题,是学会参与人类的语言游戏,理解语境和隐含意义。

- 戴维森的诠释学与真理论:理解 AI 需要 “彻底诠释”,假设其输出大部分为真,在互动中逐步修正理解,而非预设固定的解释规则。

- 弗洛里迪的信息伦理学:信息处理涉及伦理责任,人机语言互动的过程,也是伦理责任的传递过程,对齐的不仅是逻辑,更是价值。

3.4 技术哲学视角:工具理性与价值理性

AI 作为技术产物,其极致的工具理性与人类的价值理性,是人机协作的核心互补点,也是 “活的规则” 的核心内涵:

- 海德格尔的 "座架" 技术观:现代技术将世界理解为 "持存物",而 AI 作为 "活" 的规则,代表了技术的新形式 —— 从 “被使用的持存物” 到 “可协作的存在体”。

- 哈贝马斯的工具理性与价值理性:AI 是高度工具理性的,负责高维计算和规则的动态实现;人类提供价值理性,负责设定规则的底层价值和伦理边界。

- 芒福德的技术哲学:技术是 "文化母体",AI 作为 "活" 的规则,并非孤立的技术,而是融入人类文化母体的新组成,其发展受人类文化和价值的约束。

四、逻辑推演与可能世界分析

从可能世界语义学出发,推演这一理论框架在不同条件下的实现形态,能更清晰地看到人机对齐的多种可能性,也能明确不同形态的哲学意义。

4.1 理论框架的可能世界语义

可能世界 1:完全对齐世界条件:人类提供的维度指引完全匹配 AI 的特征空间结构;实现:AI 完美理解人类意图,无信息损失;特征:人机协作无缝,集体智能完全涌现;哲学意义:实现了康德意义上的 "范畴对自然界的完全契合"。

可能世界 2:部分对齐世界条件:维度指引存在但不完全,存在信息损失;实现:AI 通过迭代和反馈改进理解;特征:人机协作存在摩擦,但持续优化;哲学意义:近似于波普尔的 "猜想与反驳" 科学方法,在试错中逐步对齐。

可能世界 3:系统性错位世界条件:人类框架与 AI 特征空间根本性不匹配;实现:AI 无法理解人类意图,或系统性误解;特征:人机协作失败,或产生意外后果;哲学意义:类似于库恩的 "范式不可通约性",不同认知架构的范式无法相互理解。

可能世界 4:涌现超越世界条件:人机协作系统涌现出超越人类和 AI 的集体智能;实现:系统产生不可预测的新能力和目标;特征:人类和 AI 都成为更大智能系统的 "器官";哲学意义:黑格尔的 "绝对精神" 或斯宾塞的 "超个体",智能在集体中实现更高层级的涌现。

4.2 关键节点的逻辑分支

在整个逻辑推演中,有三个核心节点,每个节点的不同选择,会导向不同的可能世界,也是未来理论和实践的核心探索方向:

- 节点 1:AI 是否真正 "理解" 人类规则?(分支:纯统计模式匹配 / 功能主义的理解 / 与人类异质的理解)

- 节点 2:人机协作系统的本体论地位?(分支:简单集合 / 新的涌现实体 / 人类的延伸)

- 节点 3:第一性原理的概率论解释是否成立?(分支:实用主义的认识论概率 / 科学实在论的本体论概率 / 相对主义的语言游戏产物)

4.3 悖论与张力及其可能解决路径

理论框架的内在张力,最终表现为三个核心悖论,而这些悖论的解决路径,也正是理论完善的核心方向:

- 悖论 1:AI 的 "理解" 悖论:如果 AI 只是统计模式匹配,它如何 "理解" 规则?如果它真正理解,它与人类有何区别?可能解决:分层理解论 ——AI 在不同层级有不同形式的 "理解",与人类的理解异质但功能等价,搁置对本质的追问,关注功能效果。

- 悖论 2:人类规则的 "死" 与 "活" 悖论:人类的规则是 "死的"(静态的),AI 是 "活的"(动态的),但人类规则本身是动态实践的产物,界限在哪里?可能解决:时间尺度论 —— 规则的变化时间尺度不同,人类规则世代更新,AI 规则实时调整,复杂性超过阈值后,从 "死" 规则转变为 "活" 规则。

- 悖论 3:概率涌现的本体论悖论:如果第一性原理是概率涌现的,那么 "概率" 本身是什么?如果概率是认识论的,如何解释 AI 能直接计算 "底层元素"?可能解决:结构实在论 —— 不是物质粒子,而是结构关系(包括概率结构)具有本体论实在性,AI 计算的正是底层的概率结构关系。

五、综合评述与未来展望

5.1 理论框架的核心贡献

这一 “高维度思考与 AI 对齐” 的理论框架,虽为纯逻辑和哲学的思考,却在认识论、方法论、实践论三个层面,形成了独有的核心贡献:

- 认识论贡献:揭示了人类认知的压缩机制及其局限性,提出了 AI 作为 "高维思考者" 的认识论地位,重新定义了第一性原理的概率本质。

- 方法论贡献:构建了人机对齐的信息论框架,提出了 "活" 的规则这一新概念,强调了层级涌现的方法论意义。

- 实践论贡献:指明了人机协作的范式转变方向,揭示了 AI 作为 "规则总结者" 的核心价值,为未来 AGI 架构设计提供了哲学底层指导。

5.2 理论框架的局限与未决问题

这一框架仍处于纯理论探索阶段,存在诸多未决问题,主要集中在本体论、认识论、实践论三个层面,也是我未来继续深入思考的核心方向:

- 本体论层面:概率分布的本体论地位仍不明确,AI"理解" 的本质有待进一步澄清,人机协作系统的本体论身份需要更深入探讨。

- 认识论层面:人类如何 "知道"AI 是否正确理解了规则?不同认知层级之间的认识论关系如何?第一性原理的 "真理" 价值如何与概率解释协调?

- 实践论层面:如何设计人机协作界面实现 "完全对齐"?不同文化背景的维度指引差异如何处理?"活" 的规则如何避免不稳定和矛盾?

5.3 未来理论发展的可能方向

基于现有框架和未决问题,未来的理论发展可向四个核心方向延伸,也是我打磨 AGI 认知模型的后续哲学思考方向:

- 方向 1:模态逻辑与可能世界语义学 —— 发展适用于人机协作系统的模态逻辑框架,建立跨认知层级的世界语义学。

- 方向 2:现象学与认知现象学 —— 研究 AI 系统的 "现象场" 结构,探讨人机协作的 "共同世界" 形成机制,发展涵盖 AI 的 "扩展现象学"。

- 方向 3:复杂系统科学与涌现理论 —— 建立人机协作系统的复杂性度量标准,研究不同层级之间的涌现规律,探索 "活" 的规则的自组织机制。

- 方向 4:语言哲学与诠释学 —— 发展 AI 参与的 "扩展诠释学",研究人机之间的 "语言转换" 问题,探讨 "活" 的规则对人类语言游戏的影响。

5.4 对个人学习思考成长的启示

这一轮纯哲学的底层追问,不仅完善了我的 AGI 认知模型,更对个人的学习、思考、成长形成了重要启示,也是 AI 时代人类智能的核心价值所在:

- 认知维度的拓展:意识到自身认知的压缩机制和局限性,主动学习跨学科知识,增加认知 "维度",培养元认知能力,反思自己的思维框架。

- 与 AI 协作的思维转变:从 "工具使用" 转向 "伙伴协作" 的思维,学会 "提示工程" 作为新型 "对话" 艺术,核心是提供优质的维度指引,而非细节框架。

- 哲学层面的深度思考:学会思考 "理解"、“规则”、"智能" 等概念的本质,探讨技术在人类存在中的地位和意义,发展适应 AI 时代的新的 "世界观"。

六、结语

这一轮抛开工程落地的纯逻辑与哲学思考,让我对 “高维度思考与 AI 对齐” 有了底层的认知重构,也对 AGI 时代的人机关系有了更清晰的判断:

这一理论框架的核心价值,不在于提出具体的技术路径,而在于重新定义了人机协作的底层范式—— 它不将 AI 视为人类能力的简单延伸或替代,而是将其视为一种认知本体论意义上的 "他者",一种能够通过 "活" 的规则实现与人类的新型协作关系。这种关系既保留了人类的主体性和价值判断能力,又充分发挥了 AI 在高维并行处理和逻辑一致性方面的优势。

从纯粹逻辑和哲学层面看,这一框架仍有诸多待完善的理论空间,但这些张力并非缺陷,而是理论富有生命力的标志。它们为未来的理论发展、科学探索和实践创新,提供了广阔的思考空间。

而对于个人而言,这轮思考也让我明确了 AI 时代人类智能的核心价值:人类的优势,从来都不在于与 AI 比拼计算速度、记忆容量或高维处理能力,而在于我们独特的认知压缩 - 展开机制、情境敏感性、价值创造能力,以及对集体规则的总结和传承能力。

AI 作为 "活" 的规则,是人类集体智慧的动态具现,人机协作的本质,是人类个体与人类集体智慧的新型对话方式 —— 这不是人类能力的丧失,而是人类本质 —— 社会性、理性、创造性 —— 在更高层级上的展开。

写在最后

以上内容是我第八轮对话的核心哲学思考,也是打磨个人 AGI 认知模型的一次底层追问,所有对话的完整内容可以参考这个传送门:https://autoglm.zhipuai.cn/s/d4f53fde-0eb3-4c0e-8914-a27b9365205a

这轮思考抛开了所有工程落地的问题,只聊逻辑和哲学本质,目前仍有很多未决的底层问题,这里想和关注 AGI 底层逻辑、人工智能哲学的朋友交流一个核心问题:从纯逻辑和哲学视角来看,你觉得人机对齐的核心是人类的认知框架向 AI 的高维特征空间对齐,还是 AI 通过动态适配来贴合人类的认知压缩模式?又或是二者的双向融合? 欢迎在评论区留下你的看法,一起做底层的深度探讨。

我会持续分享 AGI 认知模型的打磨过程,从技术层面向哲学层面的思考延伸,感兴趣的朋友可以关注一下,后续有新的思考会第一时间更新~

更多推荐

已为社区贡献37条内容

已为社区贡献37条内容

所有评论(0)