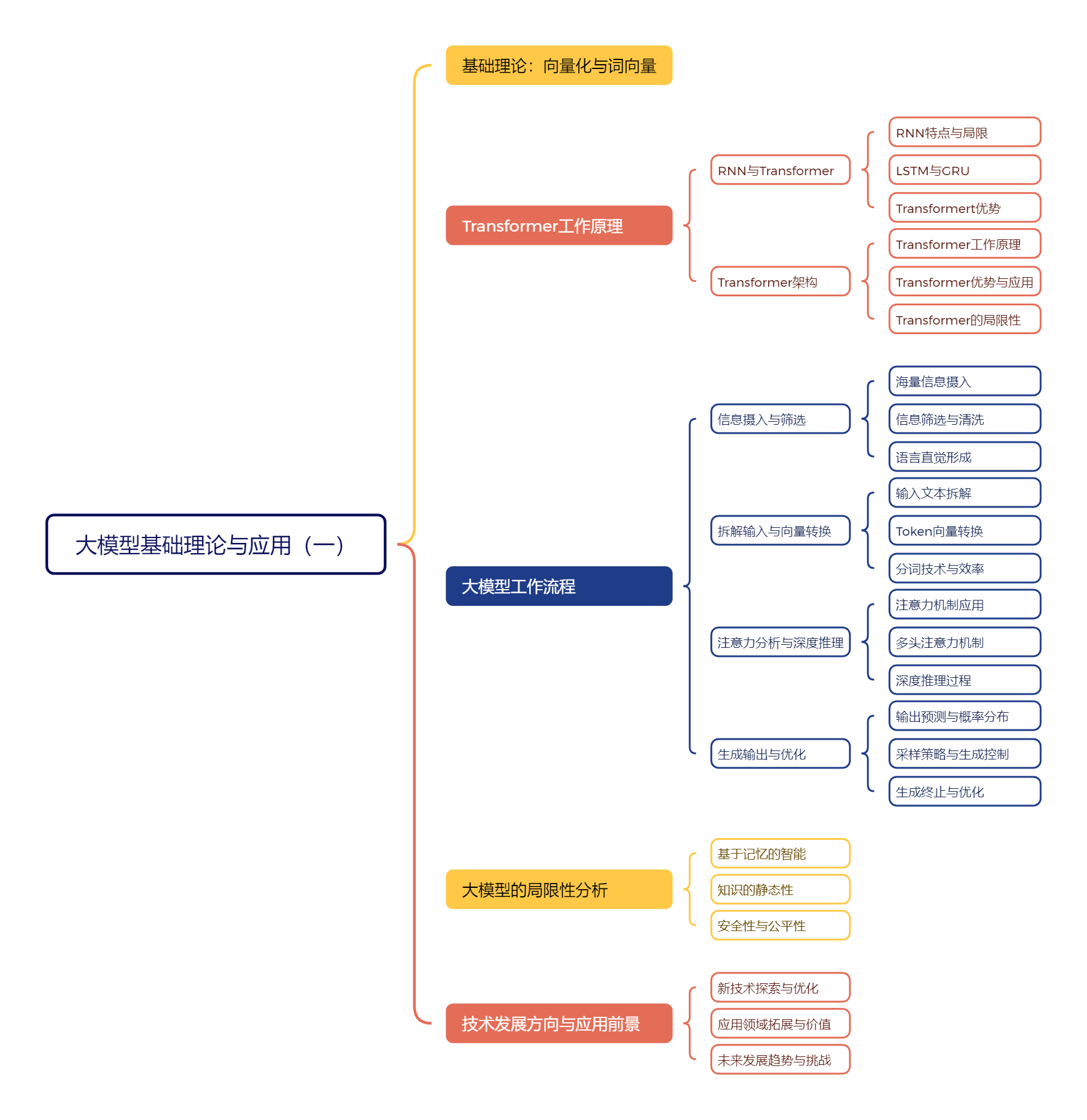

AIAgent应用开发——大模型基础理论与应用(一)

摘要 本文系统阐述了自然语言处理中的向量化技术和Transformer架构原理。向量化通过赋予词语多维特征参数实现语义表达,是语言模型的基础工具。Transformer采用注意力机制取代传统RNN结构,通过并行计算和长程依赖捕捉显著提升了语言处理能力。文章详细解析了Transformer的点积注意力、并行计算等核心机制,同时指出其计算复杂度高的局限性。此外,还概述了大语言模型从输入处理到输出生成的

一、基础理论:向量化与词向量

能够表达字符含义的数值表示方式==》向量化;词语==》添加特征参数

例如:猫==》动物值90==》食肉值85==》食草值15

动物==》动物值100

词向量==》语言处理的基础工具之一

句向量==》我养了一只猫,但它去年死了==》饲养值上升、存在值下降==》现在没有猫

提取语义、判断上下文、预测接下来的词语

深度神经网络==》通过大量的训练==》自动从海量文本中学习语言规律

【向量化基本原理】向量化是将词语转化为数值表示的方法,通过赋予词语多个特征参数。

【句子向量化方法】句子向量化是将句中词语向量组合,得到代表整句话“语义风格”的向量。

【深度神经网络与向量化】大语言模型如ChatGPT、DeepSeek等基于向量化构建,先将输入文字转化成向量,再利用成千上万层的计算提取语义、判断上下文、预测词语。

二、Transformer工作原理

1、RNN与Transformer

【RNN特点与局限】RNN是用于处理序列数据的神经网络模型,具有循环结构,将当前输出和前一时刻隐状态作为下一时刻输入,捕捉序列数据的时间依赖性如根据前单词信息预测当前单词,但易出现梯度消失和梯度爆炸问题,难以学习长序列中的长程依赖信息。

【LSTM与GRU】改进为解决RNN的梯度问题,提出LSTM和GRU,它们通过加入特定门控机制控制信息流动,缓解梯度消失和梯度爆炸,但RNN在长序列处理上仍不如深度神经网络,如今大语言模型基本使用基于Transformer的架构。

【Transformert优势】Transformer摒弃循环结构,采用注意力机制,处理词语时可"关注"整个句子中的其他词语,更准确地理解词义,其并行计算方式能高效处理长文本,捕捉上下文中不同词语之间的复杂关系。

2、Transformer架构

【Transformer工作原理】Transformer通过注意力机制,让模型在处理每个词语时自动计算与其他词语的相关性,分配“关注”权重。

【Transformer优势与应用】Transformer具有并行计算、长程依赖捕捉和扩展性强等优势,能够并行处理所有输入,提高处理效率,适合处理大规模数据。

【Transformer的局限性】计算复杂度较高,为O(n^2),其中n是序列长度,这在处理极长序列时可能会导致计算资源的大量消耗。

注意力机制==》在处理某个词语时候,不仅仅依赖它前面或后面的邻近词语,关注整个句子中的其他词语

点积注意力==》计算查询(当前词语)和健(其他词语的特征)的点积

- 并行计算==》同时处理所有输入、减少训川练时间

- 长程依赖==》可以捕捉到长期的依赖关系

- 扩展性强==》增加层数和宽度提升模型性能

三、大模型工作流程

1、信息摄入与筛选

【海量信息摄入】大模型通过阅读大量文本数据构建语言知识库,如GPT-3“读”过的文本量相当于人类连续阅读一百万年都读不完的内容。

【信息筛选与清洗】大模型需经过复杂细致的筛选和清洗,剔除广告垃圾、敏感信息、明显错误的文本等,保留真实、丰富、多样的知识源泉,避免“误食”错误、虚假内容,这道工序是模型成功的关键之一。

【语言直觉形成】大模型通过预测训练方式,在给定一段文字的前提下猜测下一个最合理的词,通过无数次成功和失败,逐渐形成对语言的“直觉”,但这种“直觉”是基于统计式的,而非真正意义上的理解。

2、拆解输入与向量转换

【输入文本拆解】大模型将输入文本拆解为更小的单位一Token,Token可能是完整的词、词的一部分、字母或标点符号,取决于分词器设计规则。

【Token向量转换】每个Token被转换为高维度的向量,如768维、1024维等,这些向量蕴含丰富的语义信息,记录词的出现场景、搭配词汇、情感色彩等,通过余弦相似度可衡量词语之间的语义相似度,还能进行向量运算,体现概念之间的关系变化。

【分词技术与效率】不同大模型使用不同的分词方式,如WordPiece、BPE等,GPT系列采用byte-level BPE技术,能灵活应对各种字符组合,分词后的Token数量影响模型的处理效率和成本,token限制成为使用大模型时需考虑的因素。

3、注意力分析与深度推理

【注意力机制应用】大模型通过注意力机制分析Token之间的关系,如“这只猫非常可爱”中,“这只”和“猫”关联性强,“猫”和“可爱”关联紧密,“非常”对“可爱有修饰作用,模型采用多头注意力机制,从多个角度综合理解句子含义,形成完整的注意力矩阵,为后续推理打下基础。

【多头注意力机制】多头注意力机制让模型并行使用多组注意力计算,不同头关注句子的不同方面,如有的头专注于实体搭配,有的头关注情感表达,还有的头关注句法结构,通过多个头的协同工作,模型能够更全面、细致地理解句子的含义。

【深度推理过程】大模型将Token向量和注意力权重输入由多个Transformer/层堆叠而成的深度神经网络进行深度推理。Transformer架构分为编码器和解码器,编码器将输入信息转化为内部表示,解码器根据编码器传递的信息和之前生成的输出逐步生成结果。

- 编码器:负责接收输入数据。将这些信息转换为一种可以传递的内部表示;

- 解码器:负责根据编码器传递的信息,以及之前生成的输出,逐步生成结果。

4、生成输出与优化

【输出预测与概率分布】大模型根据上文语境预测“下一个最有可能出现的词语”,基于概率分布进行预测,为每个可能的词语赋予概率值。

【采样策略与生成控制】Top-k采样保留概率最高的前k个词进行随机选择,Top-p采样从累积概率达到设定阈值的词语集合中随机选择,这些策略可单独或与温度参数结合使用,实现更细腻的生成控制。

【生成终止与优化】大模型设定特定的终止条件决定何时停止生成,如生成预设的停上符号、达到最大长度限制等,合理设置终止条件可避免生成无意义的文本。

四、大模型的局限性分析

【基于记忆的智能】大模型的“智能”本质上是基于对海量文本数据中“统计规律”的学习,通过寻找模式掌握词汇搭配、语法规则句子结构等,生成自然流畅的文本,但它无法像人类一样进行深层次的推理。

【知识的静态性】大模型的知识库是静态的,局限于训练数据所覆盖的范围,对于训练数据截止日期之后的新闻事件一无所知,缺乏自我验证机制,无法意识到知识盲区,也无法主动核实生成的信息。

【安全性与公平性】问题大模型可能因训练数据偏差、模型训练目标设定等因素产生不公平或有害的输出,需要通过严格的监管、道德设计和持续优化来解决。

五、技术发展方向与应用前景

【新技术探索与优化】 研究人员探索检索增强、知识图谱引入、外部记忆系统等新技术方向,通过实时检索外部知识库、利用结构化事实网络、配备动态知识仓库等方式,弥补大模型静态知识和推理能力的不足,提升模型的准确性和一致性。

【应用领域拓展与价值】大模型在医疗、教育、自动驾驶、智能城市等多个领域具有广阔的应用前景,如帮助医生快速准确诊断、为学生提供个性化辅导、作为决策引擎或资源优化系统等,尽管面临挑战。

【未来发展趋势与挑战】大模型的发展趋势是不断提升推理能力、减少“幻觉”现象、增强可解释性、提高安全性和公平性,未来需要在技术上不断创新和突破,同时也要关注模型的社会影响和伦理问题,确保大模型的健康、可持续发展,为人类社会带来更大的价值和改变。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)