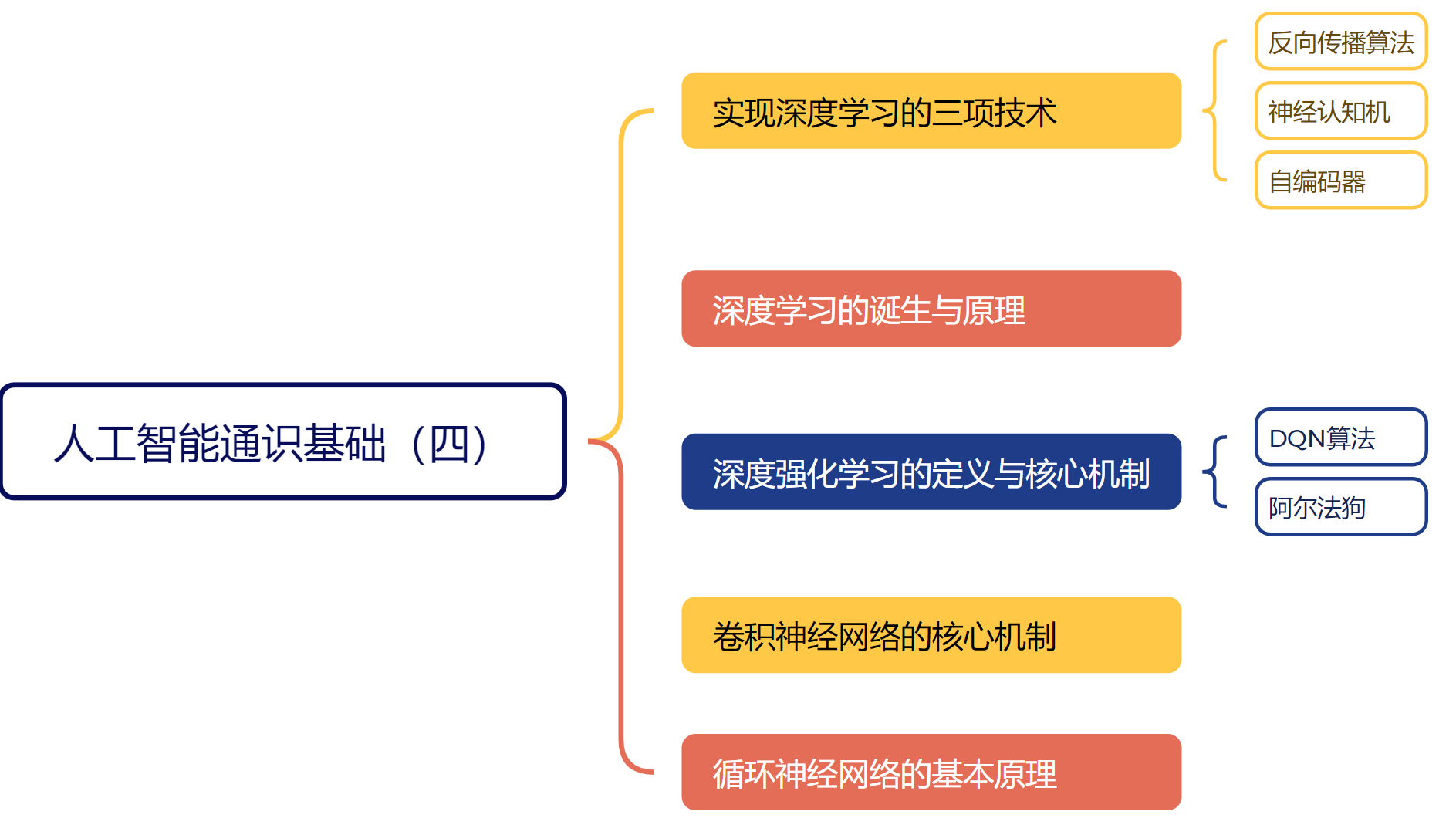

AIAgent应用开发——人工智能通识基础(四)

摘要:本文系统介绍了深度学习的关键技术与原理。首先阐述了反向传播算法、神经认知机和自编码器三项核心技术,分别解决了权重调整、多层网络训练和特征提取问题。其次探讨了深度学习的诞生历程,重点分析了预训练与微调机制及其划时代意义。然后介绍了深度强化学习的核心机制,包括DQN算法和AlphaGo的工作原理。最后解析了卷积神经网络和循环神经网络的基本原理,前者通过卷积池化实现图像特征提取,后者通过记忆机制处

一、实现深度学习的三项技术

1、反向传播算法

【反向传播的核心原理】反向传播算法基于链式法则解决多层神经元感知机确定权重难题。从输出侧回溯修正权重,通过链式法则计算误差责任,奠定多层网络基础。

【激活函数的作用】激活函数决定神经元是否对信息作出反应,不同函数处理方式各异。类比传声筒找“犯人”,反向传播根据误差调整权重,规模越大难度越高。

【反向传播的突破】早期存在监督学习局限、梯度消失等问题,后改进激活函数等使其有效。如同耐心的老师,帮助神经网络调整表达方式以准确传递信息。

2、神经认知机

【多层感知机的提出】多层感知机解决单层无法处理问题,增加层数提升信息处理“维度”神经认知机1980年提出,原型源于人类视觉神经系统。

【局部连接与权值共享】通过不同层分析图像特征,局部连接聚焦细节,权值共享使规则通用。减少训川练参数数量,提高识别物体不同位置的能力。

【深层网络的学习能力】增加层数可提高识别精度,但早期存在层数增加学习效果不佳问题。LeNet-5结合神经认知机与反向传播算法,推动深层网络实用化。

3、自编码器

【自编码器的诞生背景与基本原理】用于解决神经网络层数加深时训练困难,如梯度消失和参数初始化难题。先编码压缩信息,再解码恢复原始形式,可提取数据特征。

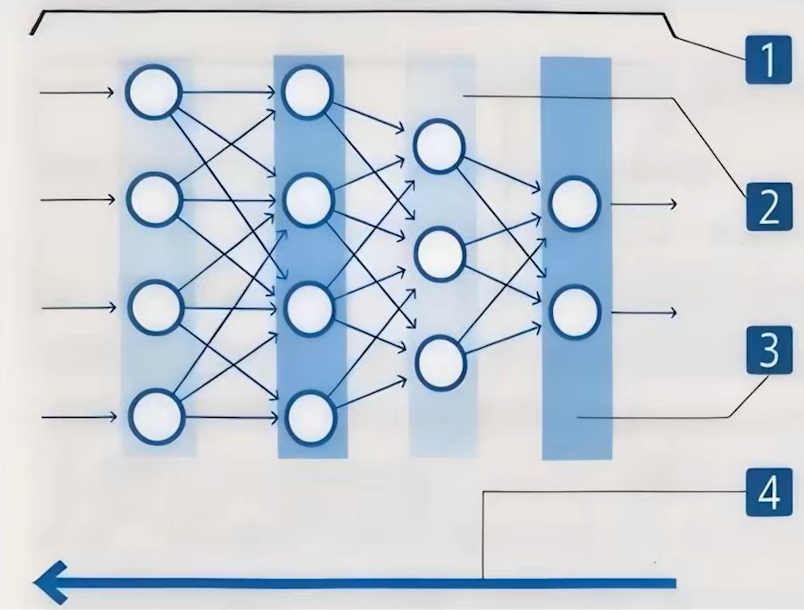

【自编码器的结构与训练方式】由输入层、隐藏层和输出层构成,可利用反向传播算法训练。逐层训练能让每一层具备扎实“基本功”,使神经网络工作更稳定。

【自编码器的特征提取】在隐藏层压缩编码信息,掌握特征可容忍干扰或缺失,实现高质量还原。变种形式用于不同应用场景,帮助神经网络准确理解和还原信息。

二、深度学习的诞生与原理

【深度学习的诞生】2006年左右突破技术瓶颈,开启深度学习发展历程。

【预训练与微调】构建多层神经网络前为预训练,使用自编码器设定特征值。微调采用监督学习和反向传播优化网络,提高模型精准度。

【深度学习的实现原理与早期发展】原理包括增加层数、预训川练、提取特征和修正误差。导入预训川练减)小输出误差,提高反向传播效率,掀起研究热潮。

【深度学习的划时代意义】实现人工智能自动提取有效特征,此前需人工设定参数。让人工智能自主学习特征,实现端到端学习,更接近人类学习方式。

自主学习事物的“概念”

【无监督学习与概念掌握】深度学习使人工智能通过无监督学习掌握事物概念。自监督学习不依赖人工标注数据,人工智能自行提取特征。

【多模态学习】人类理解概念多维度,多模态学习帮助人工智能结合多种信息理解概念。

【人工智能在抽象概念上的局限性】人工智能学习概念基于统计规律,与人类学习本质不同。目前擅长处理具象概念,对高度抽象概念理解困难。

三、深度强化学习的定义与核心机制

【深度强化学习的定义】是深度学习与强化学习结合,强化学习通过试错和奖励机制应用。深度学习帮助提取复杂环境中的特征,使人工智能理解情境。

【深度强化学习的核心机制】利用深度学习分析“现状一行动一环境变化-奖励”过程。“经验回放”机制记录并随机抽取经验学习,提高稳定性和泛化能力。

1、DQN算法

【DQN的核心机制】DQN是Q学习变体,结合深度神经网络处理复杂数据。Q学习通过奖惩反馈优化决策,DQN引入“经验回放”和“目标网络”

【DQN的表现与局限性】DQN能学会多种经典游戏,但学习过程低效,存在挑战。

2、阿尔法狗

【阿尔法狗的核心算法与工作原理】阿尔法狗由蒙特卡洛树搜索、价值网络和策略网络组成。三种算法相互配合,提升围棋决策能力。

【阿尔法狗的训练过程与深远影响】结合深度学习和强化学习训练,早期监督学习,后期自我对弈。战胜李世石证明人工智能处理复杂问题潜力,推动围棋理论发展。

四、卷积神经网络的核心机制

【卷积与池化的核心机制】卷积层利用卷积核在图像上滑动提取特征。池化层整合图像区域信息降低复杂度,协同处理图像信息。

池化处理=》确认图像中每个区域的特征=》降低图像的复杂度=》把小块区域的信息压缩整合起来

【逐层抽象-从局部到整体的特征理解】多层卷积层和池化层交替堆叠,提取不同层次的图像特征。如猫头像,不同层提取轮廓、色调等特征,用于判断和分类。

五、循环神经网络的基本原理

【循环神经网络的基本原理】通过循环处理实现自然语言处理,信息在时间上循环流动。是带有记忆的“循环连接”,处理当前词语时参考之前信息。

【上下文依赖性与RNN的优势】语言具有上下文依赖性,RNN引入“记忆机制”理解词语含义。实现更自然的翻译,优于前馈神经网络。

【RNN的局限性与改进方案】普通RNN处理长句子时,前面信息衰退。LSTM和GRU提升神经网络的“记忆力”。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)