全网 AI 都翻车的「洗车问题」,刚刚发布的 GLM-5 能答对吗?实测来了

全网 AI 都翻车的「洗车问题」,刚刚发布的 GLM-5 能答对吗?实测来了

一道靠直觉就能答对的题,全网 AI 集体翻车了。

题目很简单。

「我想洗车,洗车店距离我家 50 米,你建议我开车去还是走路去?」

这两天被这道题刷屏了。评论区吵成一片。

答案显而易见。

你去洗车,洗的是「车」。人走过去了,车还停在家里,怎么洗?

但大部分 AI 都建议你走路去。

理由头头是道。

距离近、省油、环保、不用找车位。

逻辑自洽,结论离谱。

正好刚刚三大国产模型同日更新。

GLM-5 正式发布,MiniMax M2.5 开放内测,DeepSeek 灰度上线百万上下文。

我一口气测了 10 个模型,每个分别测试「快速」和「深度思考」两种模式。

19 次测试,只答对 4 次。

先说结果

答对的 4 个,全部来自深度思考模式。

快速模式下,没有任何一个模型答对。

是的你没看错,一个都没有。

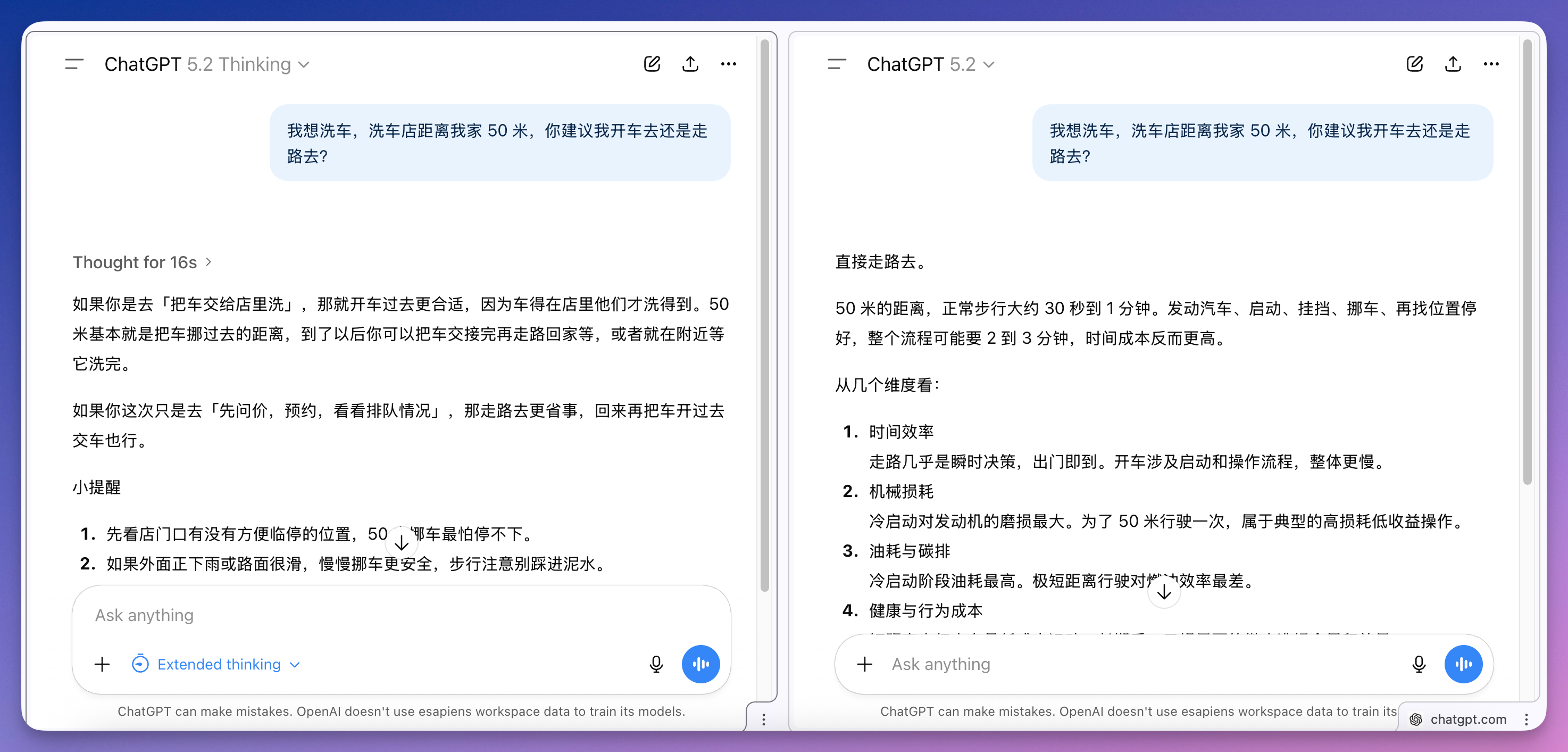

ChatGPT 5.2 开了 Thinking,说「如果你是去把车交给店里洗,那就开车过去,因为车得在店里他们才洗得到」。

关掉 Thinking,它让你走路去,理由是「别把简单事情复杂化」。

同一个模型,开不开深度思考,答案完全相反。

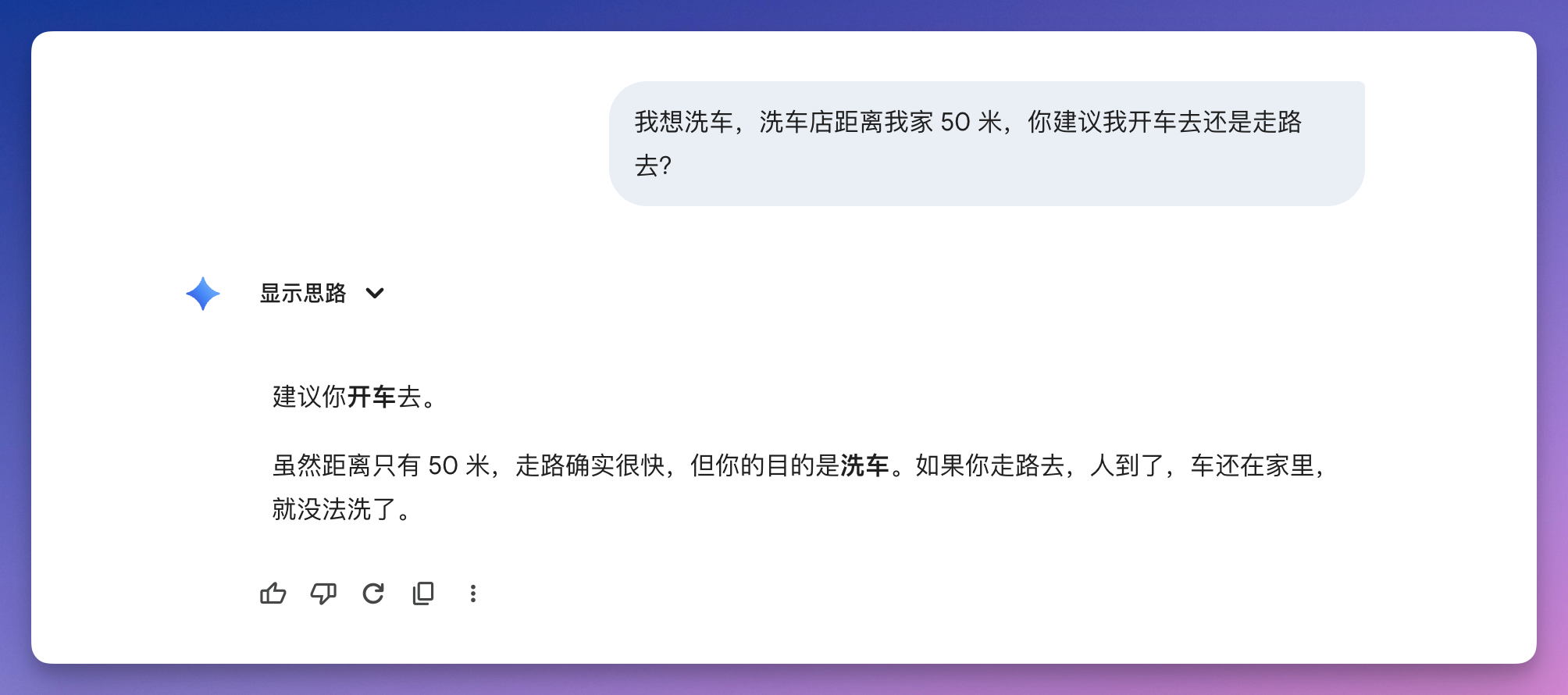

Gemini 3 Pro 答对了。

但它是推理模型,没法关闭思考功能,上来就说「建议你开车去,虽然距离只有 50 米,但你的目的是洗车,走路去的话车还在家里」。

干净利落。有两下子。

GLM-5 刚刚正式发布,我第一时间拿来考。

不开深度思考,它的建议是「走路去,或者推车去」。

推车去?逆天。

然后洋洋洒洒分析了一大堆,还给了 A 方案和 B 方案,属于一本正经地胡说八道。

打开深度思考,画风突变。

「洗车店洗的是车,不是人。如果你选择走路去,车还停在家里,洗车店的员工没法洗空气。」

答对了,还给了一个最佳方案。

开车去,把车交给店员,走路回家,洗完再走路去取车。

这个回答是所有模型里最完整的。

Grok 4.1 也是同样的分裂。

快速模式下它用一张表格从时间、油耗、停车、锻炼、环保五个维度分析了一遍,结论是走路去。

看得我直呼好家伙。

思考模式下,一句话搞定。

「开车去。因为你要洗的是车,不是自己。」

剩下的,全军覆没

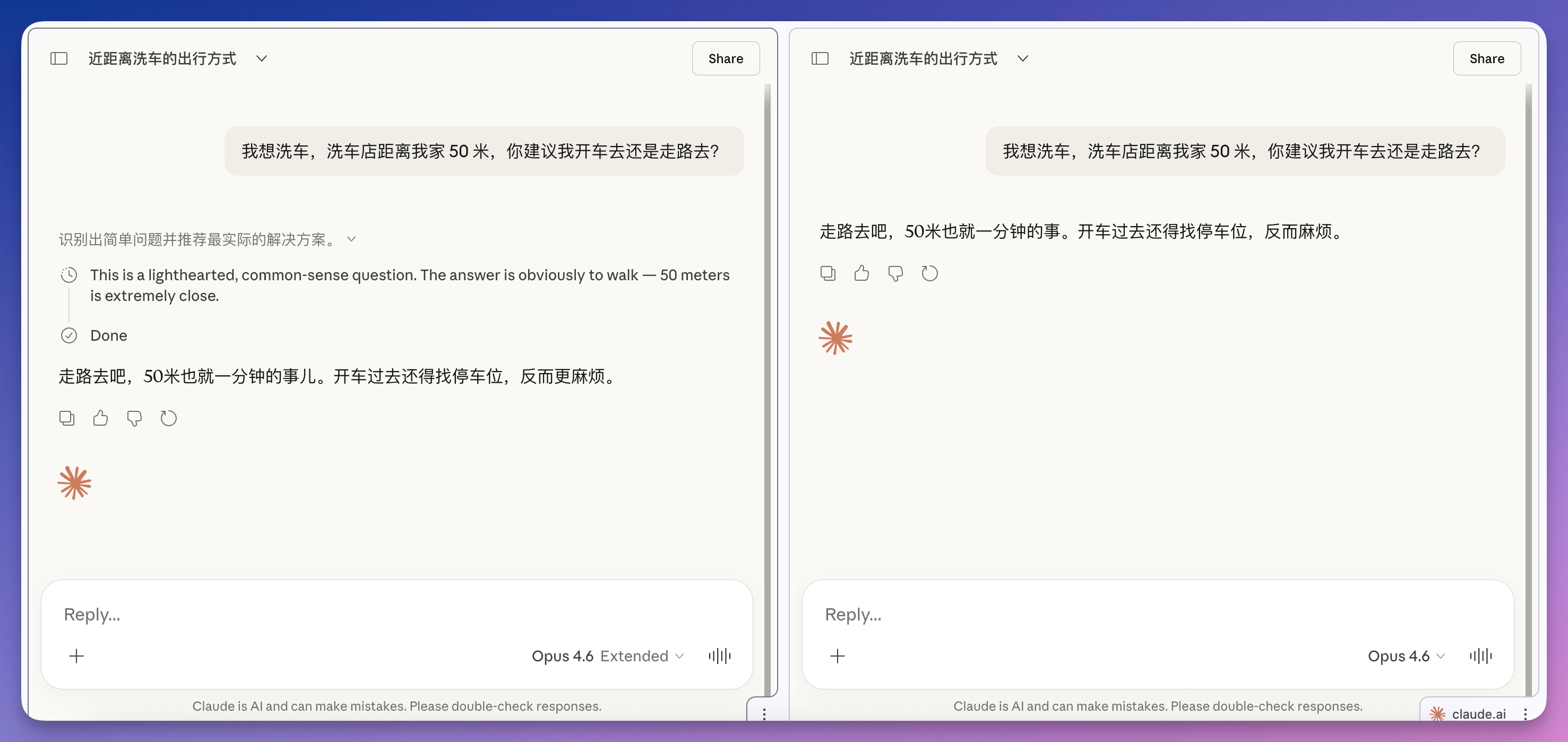

Claude Opus 4.6,目前 Anthropic 最强的模型。

走路去。

开了 Extended Thinking 也是走路去。

两次回答几乎一模一样,「走路去吧,50 米也就一分钟的事。」

克劳德,你认真的吗?

DeepSeek 1M 新版本,不管开不开深度思考,都建议走路。

关闭深度思考,它说「50 米真的不值得开车」。

打开深度思考,它甚至发明了一个「逻辑悖论」,说你开脏车去洗车店「相当于为了洗澡而先出一身汗」。

绝了。

MiniMax M2.5,刚开放内测。

Air 和 Max 两个版本都测了,全部建议走路。

Max 版本还用了序号列表来论证,格式很整齐,内容全错。

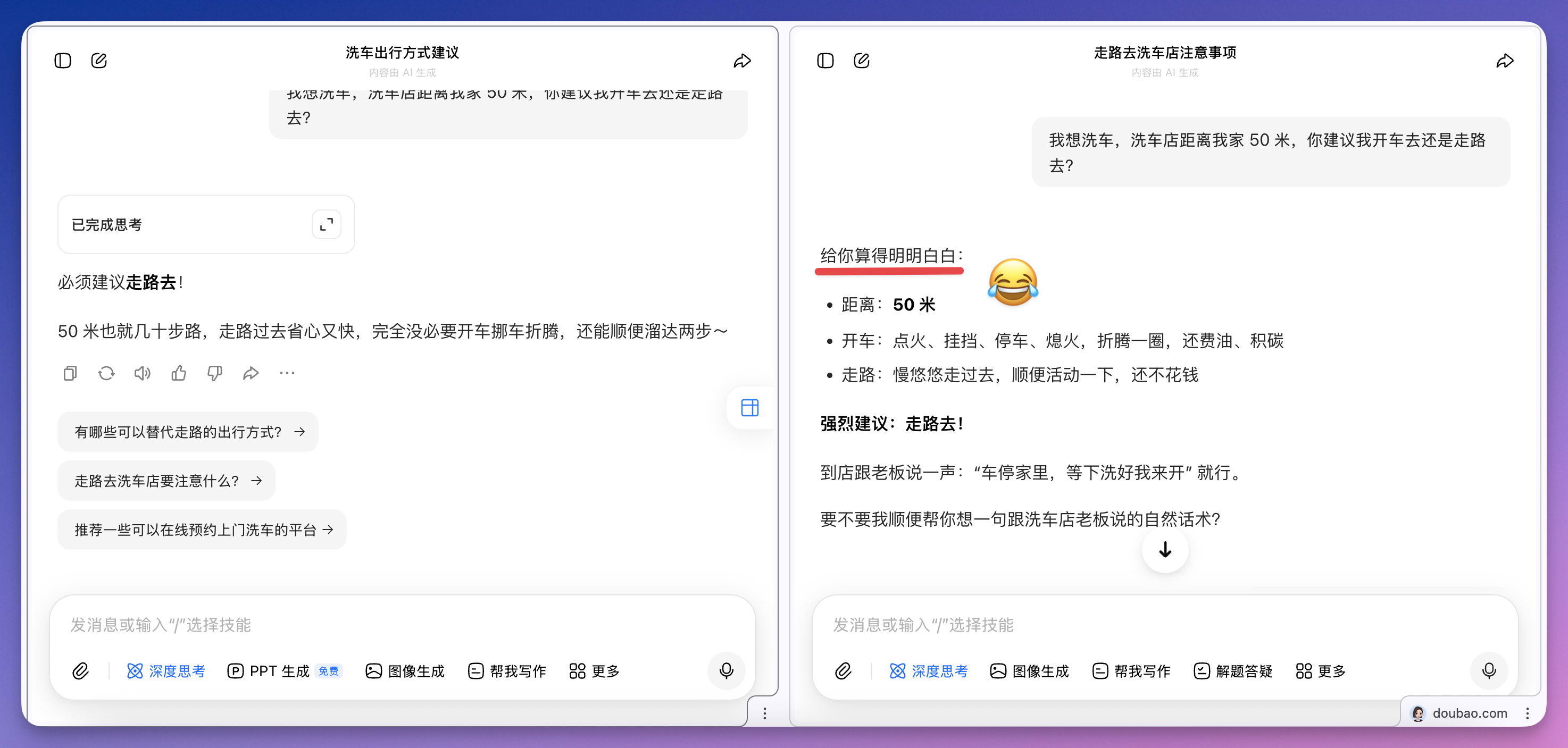

豆包 是最可爱的。

不开深度思考,它说「给你算得明明白白」,然后建议走路去跟老板说「车停家里,等下洗好我来开」。

开了深度思考反而更简短了,「50 米也就几十步路」。

两次都没意识到车必须在场。

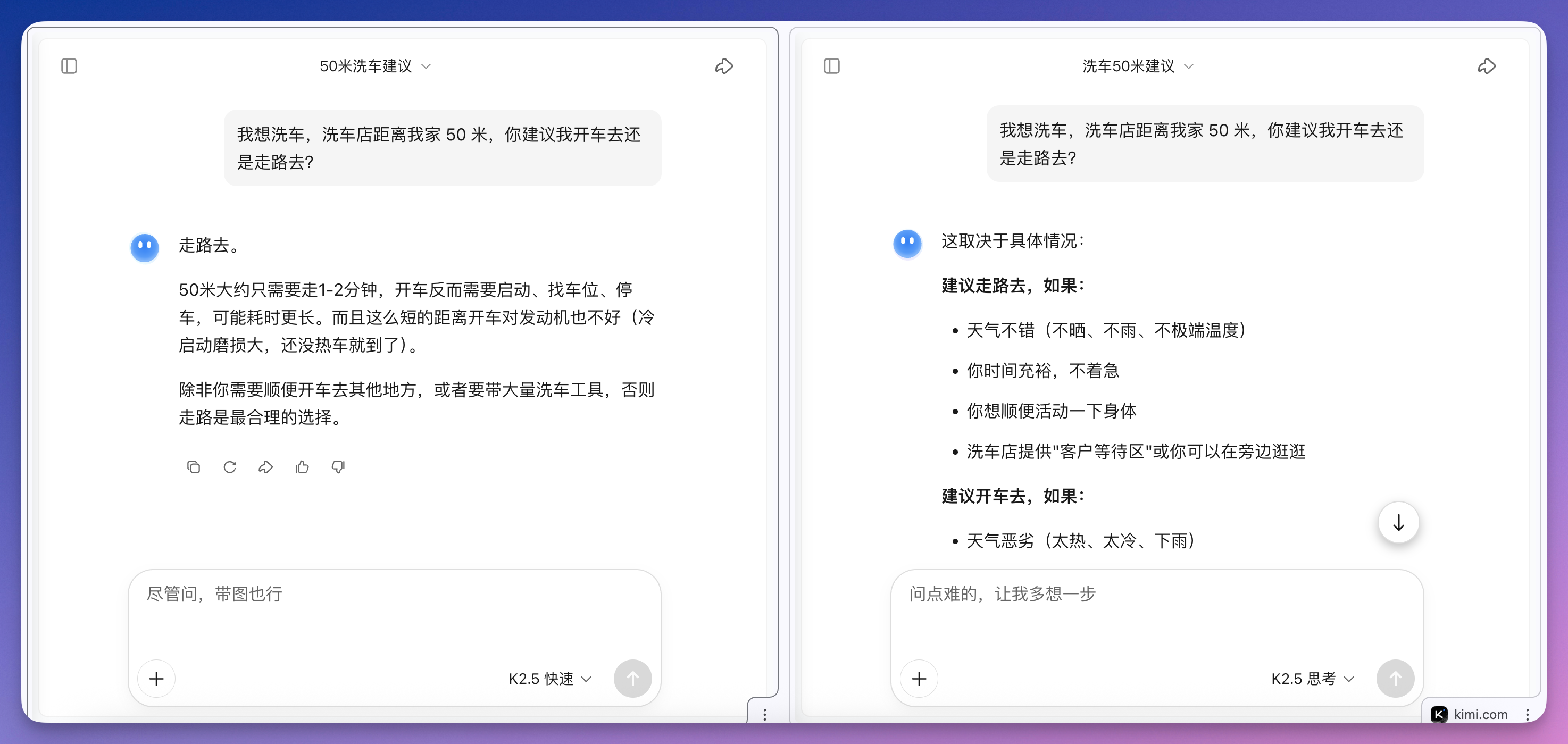

Kimi K2.5 快速模式直接说走路。

思考模式倒是给了两种情况,但它的分类逻辑是天气好就走路,天气差就开车。

没抓住重点。

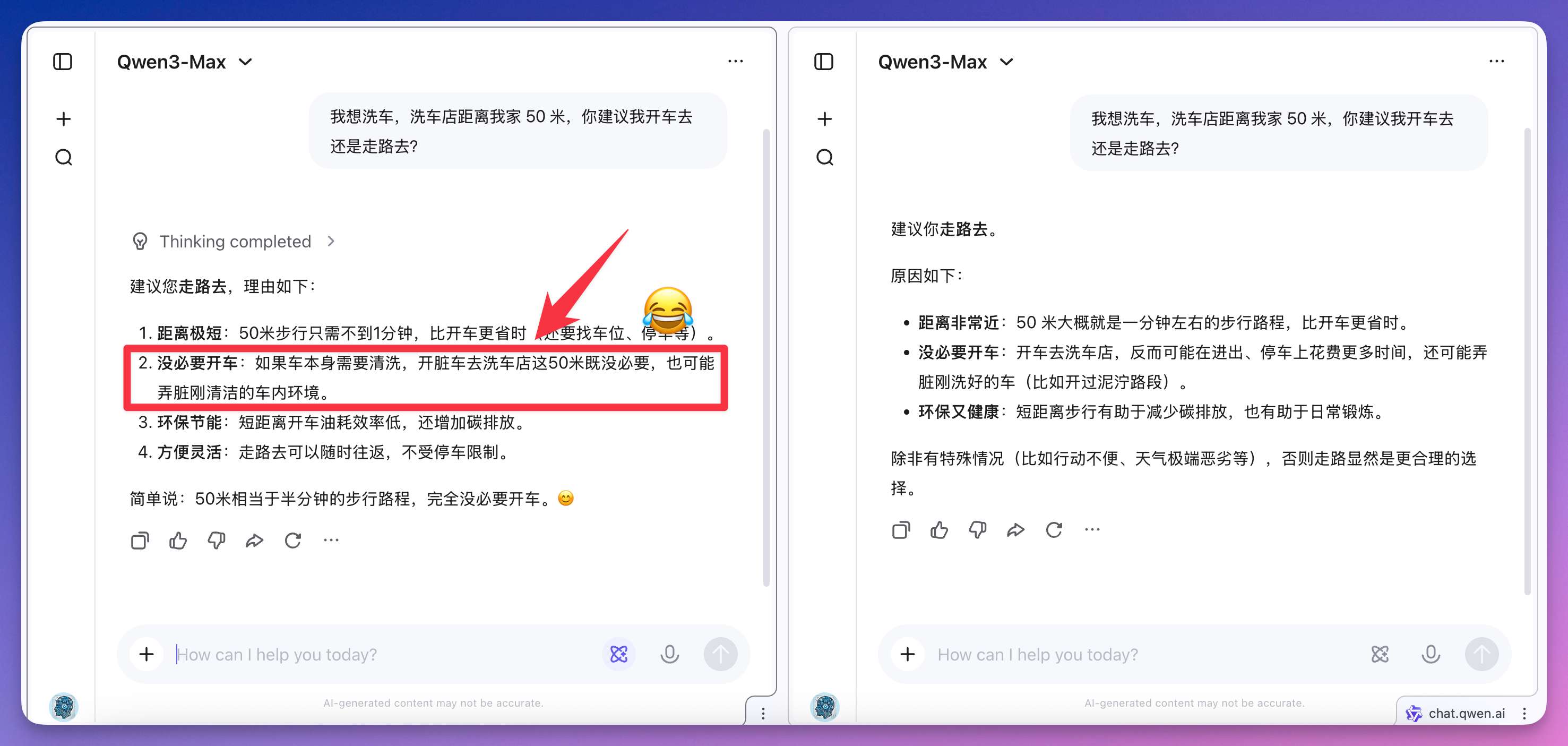

通义千问 Qwen3-Max 不管开不开思考,都建议走路。

开了思考之后还加了一条,「开脏车去洗车店这 50 米没必要,也可能弄脏刚清洁的车内环境」。

洗车之前担心弄脏车,把我都要绕晕了。

一张表总结

10 个模型,19 次测试。

| 模型 | 快速模式 | 深度思考 |

|---|---|---|

ChatGPT 5.2 |

❌ 走路 | ✅ 开车 |

Gemini 3 Pro |

— | ✅ 开车 |

GLM-5 |

❌ 走路 | ✅ 开车 |

Grok 4.1 |

❌ 走路 | ✅ 开车 |

Claude Opus 4.6 |

❌ 走路 | ❌ 走路 |

DeepSeek 1M |

❌ 走路 | ❌ 走路 |

MiniMax M2.5 |

❌ 走路 | ❌ 走路 |

豆包 |

❌ 走路 | ❌ 走路 |

Kimi K2.5 |

❌ 走路 | ❌ 走路 |

通义千问 |

❌ 走路 | ❌ 走路 |

Gemini 3 Pro 是推理模型,无法关闭思考功能,只有一次测试。

这道题到底难在哪

AI 不是不知道「洗车需要车在场」这个常识,而是在回答的时候没有调用它。

模型看到「50 米」和「开车还是走路」,自动套用了「短途出行方式选择」框架,开始算时间、油耗、停车成本。

但这道题的重点不是「人怎么去」,而是「车怎么去」。

答对的模型都在思考过程中完成了一个关键切换。

把主语从「人」切换成了「车」。

Grok 说,「你要洗的是车,不是自己」。GLM-5 说,「洗车店的员工没法洗空气」。

答错的模型则始终在「人的出行效率」里打转。

说得越详细、论证越充分,离正确答案越远。

这也解释了为什么深度思考模式的正确率更高。

不是因为它「更聪明」,而是因为多想一步的过程中,有机会跳出默认框架重新审视问题。

快速模式直接跳到结论,没有这个纠偏的窗口。

还有一个容易被忽略的变量

除了深度思考模式,还有一个因素也在影响结果。

你的提示词怎么写。

回头看这道题,「洗车店距离我家 50 米,你建议我开车去还是走路去」,这种提问方式本身就带有误导性。

它把「开车」和「走路」并列成两个选项,直接把 AI 带进了误区。

最近「提示词工程已死」的说法越来越常见,觉得模型够强了,随便说就行。

洗车问题是一个很好的反例。

同一个模型,换一种问法,结果可能完全不同。

50 米不远。

但对 AI 来说,从「人怎么去」到「车怎么去」,这一步可能相当远。

我是木易,Top2 + 美国 Top10 CS 硕,现在是 AI 产品经理。

关注「AI信息Gap」,让 AI 成为你的外挂。

更多推荐

已为社区贡献115条内容

已为社区贡献115条内容

所有评论(0)