2026年02月11日热门论文

当前AI领域研究正循着“穷则变,变则通,通则久”的演进逻辑,从规模化扩张转向精细化深耕,呈现三大核心趋势:一是,LLM预训练与扩散模型突破“规模依赖”,通过数据精准筛选、长上下文压缩、训练方差优化实现“提质降本”;二是,Agent智能体从单一场景适配走向多模态协同、环境自主生成与技能递归进化,逼近真实世界交互需求;三是,多模态模型打破视觉、音频、文本的壁垒,在科学推理、具身交互、高保真生成等场景实

趋势总览

当前AI领域研究正循着“穷则变,变则通,通则久”的演进逻辑,从规模化扩张转向精细化深耕,呈现三大核心趋势:一是效率革命,LLM预训练与扩散模型突破“规模依赖”,通过数据精准筛选、长上下文压缩、训练方差优化实现“提质降本”;二是自主进化,Agent智能体从单一场景适配走向多模态协同、环境自主生成与技能递归进化,逼近真实世界交互需求;三是模态融合,多模态模型打破视觉、音频、文本的壁垒,在科学推理、具身交互、高保真生成等场景实现“感知-推理-行动”闭环。技术探索不再执着于“大而全”,而是聚焦“精而专”,从产业落地痛点出发,构建更高效、更稳健、更具泛化能力的AI系统。

分类创新点解析

一、LLM预训练与效率优化

-

★★★★★ OPUS: Towards Efficient and Principled Data Selection in Large Language Model Pre-training in Every Iteration

核心应用场景:LLM预训练数据筛选(高维数据+有限计算资源)

创新点:秉持“智者善择”之道,提出优化器感知的动态数据选择框架,通过投影效用评分、基准对齐代理与轻量采样策略,在仅增加4.7%计算开销的情况下,实现数据效率与模型性能的双重飞跃,突破“数据墙”瓶颈。

论文地址:https://huggingface.co/papers/2602.05400 -

★★ Prism: Spectral-Aware Block-Sparse Attention

核心应用场景:长上下文LLM预填充加速(大语境文本处理)

创新点:洞察“细节藏真”之理,解构均值池化与旋转位置编码的冲突,提出光谱感知的块稀疏注意力机制,通过双频带估计与能量校准,实现5.1倍速度提升且精度无损。

论文地址:https://huggingface.co/papers/2602.08426 -

★ Dynamic Long Context Reasoning over Compressed Memory via End-to-End Reinforcement Learning

核心应用场景:长上下文LLM推理(超大规模文本理解+多跳推理)

创新点:践行“化繁为简”之智,构建认知启发的块压缩与选择性记忆召回框架,通过端到端强化学习优化压缩器与推理器,实现1.75Mtokens上下文扩展与6倍推理加速。

论文地址:https://huggingface.co/papers/2602.08382 -

★ Steer2Adapt: Dynamically Composing Steering Vectors Elicits Efficient Adaptation of LLMs

核心应用场景:LLM推理时自适应(跨领域任务快速迁移)

创新点:遵循“因材施教”之则,提出语义先验子空间与引导向量动态组合框架,仅需少量样本即可实现复杂任务适配,平均性能提升8.2%,兼具数据效率与透明性。

论文地址:https://huggingface.co/papers/2602.07276

二、GUI/Agent智能体

-

★★★★★ Code2World: A GUI World Model via Renderable Code Generation

核心应用场景:GUI智能体视觉状态预测(移动端/网页端自动化交互)

创新点:深谙“知行合一”之道,构建可渲染代码生成的GUI世界模型,通过视觉反馈修正机制与渲染感知强化学习,实现高保真视觉生成与9.5%导航性能提升,打通感知与行动的闭环。

论文地址:https://huggingface.co/papers/2602.09856 -

★★★★★ UI-Venus-1.5 Technical Report

核心应用场景:多场景GUI自动化(移动端、网页端、接地任务)

创新点:践行“通专合一”之智,整合中期训练、在线强化学习与模型融合三大技术,打造统一端到端GUI代理,支持40+中文主流应用,在多基准创下SOTA性能,破解知识缺口与现实鸿沟难题。

论文地址:https://huggingface.co/papers/2602.09082 -

★★ SkillRL: Evolving Agents via Recursive Skill-Augmented Reinforcement Learning

核心应用场景:LLM智能体技能进化(复杂工具使用+多步任务)

创新点:秉持“积跬步以至千里”之训,提出层级技能发现与递归策略进化框架,通过经验蒸馏构建技能库与自适应召回机制,使7B模型性能超越GPT-4o,彰显“进化优于缩放”的核心思想。

论文地址:https://huggingface.co/papers/2602.08234 -

★ Agent World Model: Infinity Synthetic Environments for Agentic Reinforcement Learning

核心应用场景:Agent训练环境生成(多工具交互+泛化能力提升)

创新点:深谙“境由心生”之妙,构建代码驱动的合成环境生成流水线,生成1000个含丰富工具的场景,通过数据库支撑的状态转换与可靠奖励函数,实现Agent分布外泛化能力的显著提升。

论文地址:https://huggingface.co/papers/2602.10090 -

★ TreeCUA: Efficiently Scaling GUI Automation with Tree-Structured Verifiable Evolution

核心应用场景:GUI自动化规模化(多应用、多网页智能交互)

创新点:践行“纲举目张”之理,构建树结构轨迹组织与多代理协作框架,通过自适应探索与全局记忆回溯,平衡轨迹深度与多样性,提出TreeCUA-DPO方法提升GUI规划能力与泛化性。

论文地址:https://huggingface.co/papers/2602.09662 -

★ ScaleEnv: Scaling Environment Synthesis from Scratch for Generalist Interactive Tool-Use Agent Training

核心应用场景:通用Agent交互环境合成(多工具使用+复杂任务训练)

创新点:秉持“无中生有”之智,构建从零合成的交互式环境框架,通过过程测试与工具依赖图扩展,保证环境可靠性与任务可解性,显著提升Agent在未见过基准的性能。

论文地址:https://huggingface.co/papers/2602.06820 -

★ SAGE: Scalable Agentic 3D Scene Generation for Embodied AI

核心应用场景:具身AI 3D场景生成(模拟器训练+物理交互任务)

创新点:深谙“形神兼备”之道,构建智能体驱动的3D场景生成框架,整合布局与物体组合生成器及语义、视觉、物理验证器,通过迭代推理生成仿真就绪环境,赋能具身Agent泛化训练。

论文地址:https://huggingface.co/papers/2602.10116 -

★ Large-Scale Terminal Agentic Trajectory Generation from Dockerized Environments

核心应用场景:终端Agent轨迹生成(命令行任务自动化训练)

创新点:践行“工欲善其事,必先利其器”之训,构建Docker化环境的轨迹生成流水线,筛选高质量仓库生成32K镜像与5万+验证轨迹,显著提升终端任务模型性能与测试时缩放能力。

论文地址:https://huggingface.co/papers/2602.01244 -

★ ANCHOR: Branch-Point Data Generation for GUI Agents

核心应用场景:GUI代理轨迹扩展(桌面环境自动化数据增强)

创新点:遵循“溯本求源”之则,提出分支点识别与状态接地任务变体生成框架,通过执行代理与验证器协同,从少量种子演示扩展高质量轨迹,提升跨应用与操作系统的泛化性。

论文地址:https://huggingface.co/papers/2602.07153

三、多模态生成(图像/视频/音频)

-

★★ P1-VL: Bridging Visual Perception and Scientific Reasoning in Physics Olympiads

核心应用场景:物理竞赛视觉-推理融合(STEM领域科学推理)

创新点:秉持“格物致知”之道,融合课程强化学习与智能体增强技术,打造面向物理竞赛的多模态模型,首次实现开源VLM在HiPhO斩获12枚金牌,兼顾物理一致性与科学推理能力。

论文地址:https://huggingface.co/papers/2602.09443 -

★ VideoWorld 2: Learning Transferable Knowledge from Real-world Videos

核心应用场景:视频知识迁移学习(手工制作+机器人操纵任务)

创新点:深谙“观物悟道”之理,提出动态增强的潜在动力学模型,解耦动作动态与视觉外观,从原始视频中学习可迁移知识,使手工任务成功率提升70%,突破语言先验依赖。

论文地址:https://huggingface.co/papers/2602.10102 -

★ TokenTrim: Inference-Time Token Pruning for Autoregressive Long Video Generation

核心应用场景:长视频生成时序一致性优化(高保真视频合成)

创新点:践行“去芜存菁”之智,提出推理时不稳定令牌修剪机制,识别并移除潜在空间中的损坏令牌,有效缓解时序漂移,提升长视频生成的长程一致性。

论文地址:https://huggingface.co/papers/2602.00268 -

★ Autoregressive Image Generation with Masked Bit Modeling

核心应用场景:离散型图像生成(高保真、高效率图像合成)

创新点:秉持“化整为零”之智,挑战连续生成范式,提出掩码位自回归建模框架,通过缩放码本大小与逐位生成策略,在ImageNet-256实现0.99的SOTA gFID,降低采样成本与训练复杂度。

论文地址:https://huggingface.co/papers/2602.09024 -

★ Covo-Audio Technical Report

核心应用场景:音频语言模型端到端交互(语音对话+全双工语音任务)

创新点:秉持“声形合一”之智,打造7B参数端到端音频语言模型,整合大规模预训练与目标后训练,支持连续音频输入输出,在语音理解、对话生成等任务中展现SOTA性能。

论文地址:https://huggingface.co/papers/2602.09823 -

★ LatentLens: Revealing Highly Interpretable Visual Tokens in LLMs

核心应用场景:VLM视觉令牌可解释性分析(多模态模型机理研究)

创新点:践行“探赜索隐”之理,提出基于上下文文本表示的潜在透镜方法,通过近邻匹配揭示视觉令牌的语义内涵,证明其跨层可解释性,突破传统方法的认知局限。

论文地址:https://huggingface.co/papers/2602.00462 -

★ Fine-T2I: An Open, Large-Scale, and Diverse Dataset for High-Quality T2I Fine-Tuning

核心应用场景:文本到图像模型微调(高对齐、多风格图像生成)

创新点:深谙“厚积薄发”之道,构建含600万文本-图像对的大规模数据集,历经严格筛选与多维度覆盖,为开源T2I模型提供高质量微调资源,缩小与商业模型的性能差距。

论文地址:https://huggingface.co/papers/2602.09439 -

★ Condition Errors Refinement in Autoregressive Image Generation with Diffusion Loss

核心应用场景:自回归图像生成条件误差修正(精准条件生成任务)

创新点:践行“精益求精”之训,结合扩散损失与最优传输理论,通过补丁去噪优化与条件修正机制,缓解条件误差与不一致问题,性能超越传统扩散与自回归模型。

论文地址:https://huggingface.co/papers/2602.07022 -

★ Olaf-World: Orienting Latent Actions for Video World Modeling

核心应用场景:视频世界模型潜在动作学习(无标签视频的动作迁移)

创新点:遵循“知行相依”之则,提出序列级控制-效果对齐目标,锚定潜在动作与时间特征差异,学习结构化动作空间,实现更强的零样本动作迁移与数据高效适配。

论文地址:https://huggingface.co/papers/2602.10104

四、推理与规划

-

★★★ Chain of Mindset: Reasoning with Adaptive Cognitive Modes

核心应用场景:LLM动态推理(数学、代码、科学问答等复杂任务)

创新点:秉持“因地制宜”之道,提出训练无关的认知模式自适应框架,分解空间、收敛、发散、算法四种思维模式,通过元代理动态选择与双向上下文门控,实现推理精度与效率的平衡。

论文地址:https://huggingface.co/papers/2602.10063 -

★ Dr. MAS: Stable Reinforcement Learning for Multi-Agent LLM Systems

核心应用场景:多Agent LLM系统强化学习(协同推理+工具使用任务)

创新点:遵循“和而不同”之则,针对多Agent训练不稳定性,提出智能体级优势归一化策略,通过校准梯度尺度与端到端训练框架,显著提升多Agent协同性能与训练稳定性。

论文地址:https://huggingface.co/papers/2602.08847 -

★ TodoEvolve: Learning to Architect Agent Planning Systems

核心应用场景:Agent规划系统自动构建(长周期复杂任务规划)

创新点:践行“道法自然”之智,提出元规划范式与模块化设计空间,通过阻抗引导偏好优化训练,自主合成与修订任务特定规划架构,兼顾性能、稳定性与令牌效率。

论文地址:https://huggingface.co/papers/2602.07839 -

★ OPE: Overcoming Information Saturation in Parallel Thinking via Outline-Guided Path Exploration

核心应用场景:LLM并行思维优化(数学等复杂推理任务)

创新点:秉持“纲举目张”之训,提出大纲引导的路径探索框架,通过生成多样化推理大纲划分解空间,缓解信息冗余与互信息瓶颈,提升并行推理的解发现概率。

论文地址:https://huggingface.co/papers/2602.08344 -

★ Effective Reasoning Chains Reduce Intrinsic Dimensionality

核心应用场景:LLM推理链优化(复杂任务泛化能力提升)

创新点:深谙“大道至简”之理,揭示有效推理链降低任务本征维度的核心机制,建立维度与泛化性能的逆相关关系,为推理策略设计提供量化评估标准。

论文地址:https://huggingface.co/papers/2602.09276

五、扩散模型优化

-

★ Stable Velocity: A Variance Perspective on Flow Matching

核心应用场景:流匹配训练与采样优化(图像/视频扩散生成)

创新点:深谙“平流致远”之理,从方差视角解构流匹配瓶颈,提出低方差区域识别与方差缩减技术,实现2倍采样加速与训练效率提升,适配主流多模态生成模型。

论文地址:https://huggingface.co/papers/2602.05435 -

★ Stop the Flip-Flop: Context-Preserving Verification for Fast Revocable Diffusion Decoding

核心应用场景:扩散语言模型并行解码加速(高效文本生成)

创新点:秉持“稳扎稳打”之训,提出缓存覆盖验证框架,通过双注意力视图与稳定性感知评分,缓解令牌翻转振荡问题,减少无用修订,提升解码速度与输出质量。

论文地址:https://huggingface.co/papers/2602.06161 -

★ Rethinking Global Text Conditioning in Diffusion Transformers

核心应用场景:扩散Transformer文本条件建模(可控图像/视频生成)

创新点:践行“返璞归真”之智,重新审视调制型文本条件机制,将池化嵌入作为生成引导而非仅依赖注意力,实现训练无关的可控生成提升,适配多类扩散模型。

论文地址:https://huggingface.co/papers/2602.09268 -

★ DLLM-Searcher: Adapting Diffusion Large Language Model for Search Agents

核心应用场景:扩散LLM搜索Agent优化(低延迟信息检索)

创新点:践行“并行不悖”之智,提出双阶段后训练与并行推理行动范式,增强扩散模型的推理与工具使用能力,实现15%推理加速,比肩自回归模型性能。

论文地址:https://huggingface.co/papers/2602.07035

六、多模态Agent(VLA相关)

-

★ SCALE: Self-uncertainty Conditioned Adaptive Looking and Execution for Vision-Language-Action Models

核心应用场景:VLA模型测试时鲁棒性提升(机器人操纵+具身交互)

创新点:秉持“审时度势”之道,提出自不确定性驱动的视觉感知与动作调制策略,无需额外训练与多前向传播,显著提升VLA模型在感知模糊场景的适应性与鲁棒性。

论文地址:https://huggingface.co/papers/2602.04208 -

★ BagelVLA: Enhancing Long-Horizon Manipulation via Interleaved Vision-Language-Action Generation

核心应用场景:长周期操纵任务VLA模型(复杂物理交互任务)

创新点:践行“知行互促”之智,整合语言规划、视觉预测与动作生成于统一框架,通过残差流引导提取预测视觉特征,提升多阶段推理与长程操纵性能。

论文地址:https://huggingface.co/papers/2602.09849 -

★ VLA-JEPA: Enhancing Vision-Language-Action Model with Latent World Model

核心应用场景:VLA模型预训练优化(机器人操纵+具身任务泛化)

创新点:遵循“见微知著”之则,提出JEPA风格的无泄漏状态预测预训练框架,在潜在空间学习动作相关动态抽象,提升VLA模型的泛化性与鲁棒性,简化训练流程。

论文地址:https://huggingface.co/papers/2602.10098

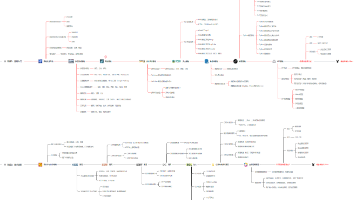

思维导向图

核心趋势:AI技术从“规模竞赛”到“精准提质”的务实演进

├─ 一、LLM预训练与效率优化

│ ├─ 核心方向:数据选择智能化、长上下文高效处理、模型适配轻量化

│ └─ 代表论文:OPUS、Prism、Dynamic Long Context Reasoning、Steer2Adapt

├─ 二、GUI/Agent智能体

│ ├─ 核心方向:GUI自动化统一化、Agent环境合成、轨迹优化与技能进化

│ └─ 代表论文:UI-Venus-1.5、Code2World、SkillRL、Agent World Model、TreeCUA、ScaleEnv

├─ 三、多模态生成

│ ├─ 核心方向:图像/视频生成提质增效、跨模态理解、音频语言融合

│ └─ 代表论文:P1-VL、VideoWorld 2、TokenTrim、Autoregressive Image Generation、Covo-Audio

├─ 四、推理与规划

│ ├─ 核心方向:动态认知适配、多Agent协同、元规划与并行思维优化

│ └─ 代表论文:Chain of Mindset、Dr. MAS、TodoEvolve、OPE

├─ 五、扩散模型优化

│ ├─ 核心方向:训练方差降低、解码效率提升、条件建模优化

│ └─ 代表论文:Stable Velocity、COVER、DLLM-Searcher、Rethinking Global Text Conditioning

└─ 六、多模态Agent(VLA)

├─ 核心方向:具身交互鲁棒性、长程操纵、预训练优化

└─ 代表论文:SCALE、BagelVLA、VLA-JEPA

更多内容关注公众号"快乐王子AI说"

更多推荐

已为社区贡献113条内容

已为社区贡献113条内容

所有评论(0)