牛!大模型的9大核心技术解析!

以上九大技术构成了AI智能体架构的核心体系,覆盖了智能体基础、多智能体协作、知识增强、模型优化、工具调用、协议标准化及人机交互等关键维度。随着技术演进,这些组件将继续推动AI应用向更智能、更协同、更易用的方向发展。如果您对AI大模型架构设计与落地实践感兴趣,欢迎关注我的后续分享。

今天我们来系统梳理AI智能体架构设计的九大核心技术,这些技术构成了现代AI应用开发的核心框架,涵盖从基础推理到多智能体协作、从数据处理到人机交互的关键层面。欢迎各位指正交流。

一、AI 智能体(AI Agent)

AI智能体是一种具备自主意识的软件实体,能够感知环境、进行推理与决策,并执行相应动作。其核心架构包括以下组件:

-

Prompt(提示词):用于引导大语言模型(LLM)的行为,定义可用的工具集,输出为JSON格式,指示下一步操作(如工具调用或函数调用)。

-

Switch 语句:根据LLM返回的JSON内容解析并决定后续操作。

-

累积上下文:记录已执行的操作及其结果,为后续决策提供依据。

-

For 循环:驱动整个流程循环执行,直至LLM返回终止信号(如标记为“Terminal”的响应)。

这种结构使AI智能体兼具高效性、灵活性和适应性。

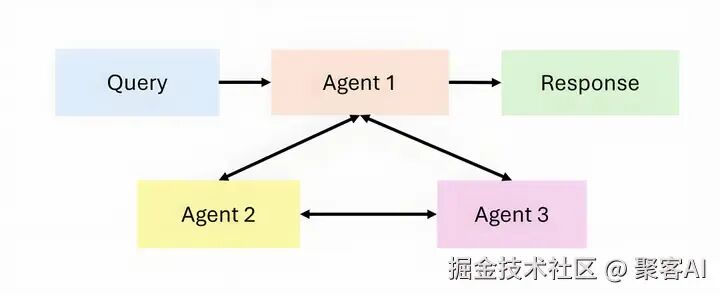

二、Agentic AI

Agentic AI 代表多智能体协作的系统架构。与单体智能体不同,它由多个智能体组成,具备动态任务分解、持久记忆和高级任务编排能力,可应对更复杂的工作流程。

其结构类似交响乐团,各智能体分工协作、共享信息、动态调整策略,适用于医疗诊断、科研协作、机器人协同等复杂场景。

ps:如果你对多智能体代理的工作模式和技术不是很了解,建议你可以看看我之前整理的一个技术文档《Agentic AI 多智能体代理模式技术详解》

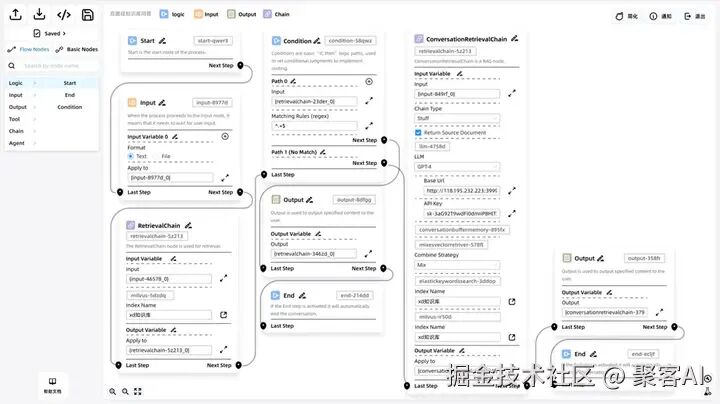

三、工作流(WorkFlow)

WorkFlow 通过将大任务拆解为多个小任务,并按顺序执行,以提升处理效率和准确性。尤其在高可靠性要求的场景中,可避免AI智能体因自主规划而产生的错误或“幻觉”。

例如在订单处理中,WorkFlow可自动检查库存、触发补货、通知客户,形成端到端的自动化流程。

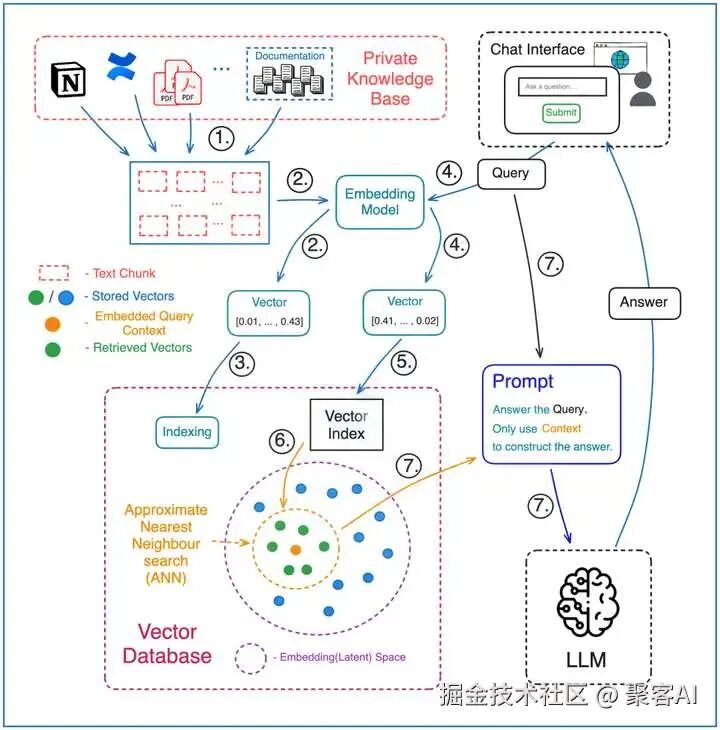

四、RAG(检索增强生成)

RAG系统通过检索外部知识库增强生成模型的输出,尤其适用于企业知识管理场景。其架构分为两阶段:

-

预处理:将文本数据分块、编码为向量,并存储至向量数据库。

-

检索与生成:将用户查询与向量库匹配,检索相关上下文,与问题一并提交给LLM生成答案。

该方法显著提升了模型输出的准确性和事实一致性。

ps:由于文章篇幅有限,之前我也整理过关于RAG检索增强生成的技术文档,建议粉丝朋友自行领取查阅:《检索增强生成(RAG)》

五、微调(Fine-tuning)

尽管预训练模型能力强大,但仍需微调以适应具体场景。微调的主要原因包括:

-

模型与人类策略差异;

-

缺乏领域数据;

-

训练数据陈旧;

-

预训练成本高;

-

数据安全需求。

微调分为全参数微调与高效参数微调(PEFT),通常包括数据工程、模型加载、迭代训练等步骤。

六、函数调用(Function Calling)

由OpenAI推动的Function Calling技术使LLM能通过自然语言调用外部API,以获取实时数据(如天气、股价等)。其流程包括:

-

识别需求;

-

选择函数;

-

准备参数;

-

执行调用;

-

整合响应。

尽管开发友好,该技术仍存在跨模型不一致、平台依赖、扩展性有限等问题。

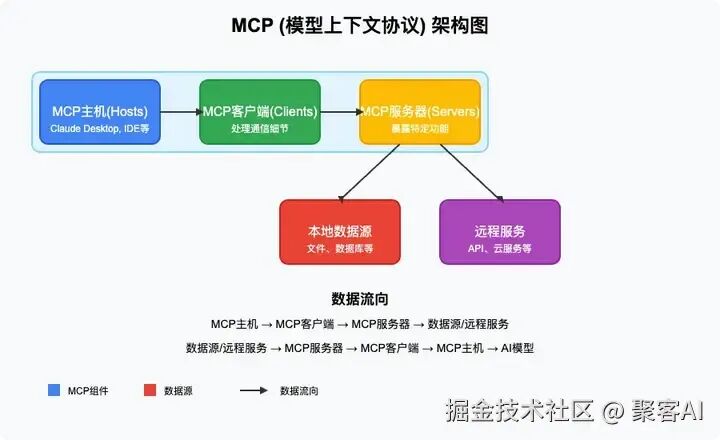

七、MCP(模型上下文协议)

由Anthropic提出的MCP协议,旨在标准化LLM与外部工具的集成方式。其采用客户端-服务器架构,包括:

-

MCP主机(如IDE或AI工具);

-

MCP客户端(管理连接);

-

MCP服务器(提供标准化功能);

-

数据源(本地或远程)。

该协议提升了大模型的安全性、灵活性和生态兼容性。

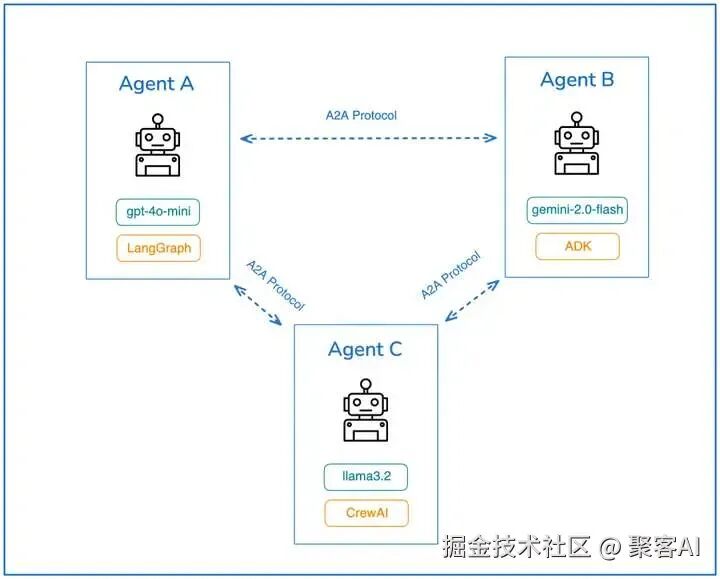

八、A2A(智能体间通信协议)

A2A是一种开放协议,用于解决多智能体系统中的状态转移、远程协作与资源共享问题。其核心机制包括:

-

能力发现:通过“Agent Card”公开智能体能力;

-

任务管理:支持长短任务同步;

-

协作通信:智能体间传递上下文与结果;

-

用户体验协商:统一数据返回格式。

A2A基于HTTP、SSE、JSON-RPC等标准构建,强调安全性与企业级集成。

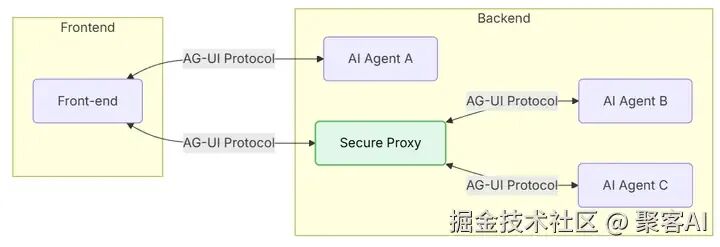

九、AG-UI(智能体用户交互协议)

AG-UI专注于前端与AI智能体之间的通信标准化,避免为不同框架重复开发交互逻辑。其采用事件驱动机制,支持16种标准事件,兼容SSE、WebSocket等传输方式。

该协议实现双向通信,前端可发送事件与上下文,智能体可流式返回响应,极大提升了开发效率与体验一致性。

最后总结

以上九大技术构成了AI智能体架构的核心体系,覆盖了智能体基础、多智能体协作、知识增强、模型优化、工具调用、协议标准化及人机交互等关键维度。随着技术演进,这些组件将继续推动AI应用向更智能、更协同、更易用的方向发展。

如果您对AI大模型架构设计与落地实践感兴趣,欢迎关注我的后续分享。

如何学习AGI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取