CANN pypto 对高阶函数与控制流的表达能力分析

相关链接:

- CANN 组织主页:https://atomgit.com/cann

- pypto 仓库地址:https://atomgit.com/cann/pypto

前言

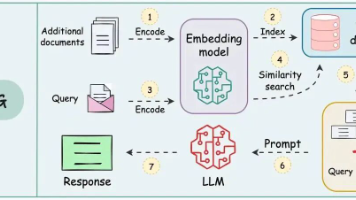

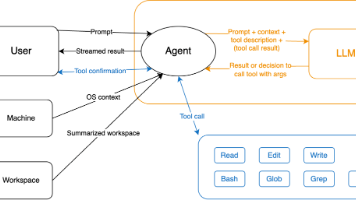

在 AI 算子开发范式从“手写 Kernel”向“高级语言描述 + 自动编译”演进的背景下,CANN 生态推出的 PyPTO(Parallel Tensor/Tile Operation)编程框架,代表了一种兼顾表达力与性能可控性的新型开发模型。PyPTO 以 Python 为宿主语言,通过装饰器、上下文管理器与自定义 DSL(领域特定语言),将 PTO(Parallel Tile Operation)指令集的能力暴露给开发者,使其能以接近 NumPy 的语法编写高性能 NPU 算子。

然而,真实世界中的算子逻辑往往包含复杂的控制流(如条件分支、循环)与高阶抽象(如 map、reduce、scan)。本文基于 pypto 仓库(https://atomgit.com/cann/pypto),深入分析 PyPTO 如何通过 AST 转换、符号执行 与 模板展开 机制,支持高阶函数与动态控制流的表达,并揭示其在 FlashAttention、MoE(Mixture of Experts)等前沿算子实现中的工程实践。

一、PyPTO 编程模型基础:从张量到 Tile 的映射

PyPTO 的核心抽象是 TileTensor,它是对底层 PTO ISA 中 Tile 的 Python 封装。用户通过 @kernel 装饰器定义算子函数,函数体内的操作将被转换为 PTO 指令序列。

1.1 基本用法示例

from pypto import kernel, TileTensor

@kernel

def matmul_kernel(A: TileTensor, B: TileTensor, C: TileTensor):

# A: [M, K], B: [K, N], C: [M, N]

C[...] = A @ B # 自动映射为 TMATMUL 指令

该函数在编译时被解析为 PTO 指令流,无需手动管理内存或流水线。

1.2 静态 Shape 与编译期绑定

PyPTO 要求所有 TileTensor 的 Shape 在编译期已知(通过类型注解或显式声明),这是实现高效代码生成的前提:

@kernel

def softmax_kernel(x: TileTensor["M, N"]):

# M, N 为符号常量,在实例化时绑定具体值

max_val = x.reduce(axis=1, op="max") # 行最大值

exp_x = (x - max_val).exp()

sum_exp = exp_x.reduce(axis=1, op="sum")

return exp_x / sum_exp

注:

"M, N"是 PyPTO 的 Shape 描述语法,类似 TVM 的te.var。

二、高阶函数的支持机制:map、reduce 与 scan

PyPTO 将常见的高阶操作封装为 TileTensor 的方法,其背后是 PTO 指令的组合。

2.1 reduce:归约操作的统一接口

reduce() 方法支持多种归约操作(sum/max/min/prod),并自动选择最优实现路径。

源码实现(简化)

# src/pypto/tensor.py

class TileTensor:

def reduce(self, axis, op="sum"):

if op == "sum":

return _call_pto_instruction("TREDUCE_SUM", self, axis)

elif op == "max":

return _call_pto_instruction("TREDUCE_MAX", self, axis)

# ...

对于行归约(axis=1),PyPTO 可能生成如下 PTO 序列:

TTRANSPOSE(若硬件对列归约更高效);TREDUCE(调用专用归约指令);TRESHAPE(恢复输出 Shape)。

2.2 map:逐元素操作的泛化

所有逐元素操作(+、-、*、sin、exp 等)均视为 map 的特例:

y = x.exp() + 1.0 # 等价于 map(lambda v: math.exp(v) + 1.0, x)

PyPTO 通过操作符重载将其转换为 TEWISER 指令链。

2.3 scan:前缀扫描的硬件加速

2025 年底,PyPTO 新增了对 scan(前缀扫描)的支持,用于实现 LayerNorm、Cumsum 等操作:

# examples/scan_example.py

@kernel

def cumsum_kernel(x: TileTensor["N"]):

return x.scan(op="add") # 输出 [x0, x0+x1, x0+x1+x2, ...]

其底层映射为 PTO 的 TSCAN 指令(若硬件支持),否则回退到循环实现。

三、控制流的表达:静态展开 vs 动态调度

控制流是高级语言与底层 Kernel 之间的鸿沟。PyPTO 采用 混合策略:对编译期已知的控制流进行静态展开,对运行时依赖的控制流提供受限支持。

3.1 静态 for 循环:unroll 与 tile 循环

当循环边界为常量时,PyPTO 自动展开(unroll)或生成带流水线的循环:

@kernel

def tiled_gemm(A: TileTensor["M, K"], B: TileTensor["K, N"]):

C = zeros("M, N")

for k in range(0, K, TILE_K): # K, TILE_K 为常量

A_tile = A[:, k:k+TILE_K]

B_tile = B[k:k+TILE_K, :]

C += A_tile @ B_tile

return C

编译器将此循环转换为 PTO 的 TMATMUL + TADD 序列,并插入 SET_FLAG/WAIT_FLAG 实现双缓冲。

3.2 条件分支:if-else 的静态分发

PyPTO 支持 编译期条件(即条件表达式仅依赖 Shape 或常量):

@kernel

def conditional_op(x: TileTensor["M, N"]):

if M > 1024:

return x * 2

else:

return x + 1

编译时,PyPTO 会根据实例化的 M 值只保留一个分支,避免生成冗余指令。

3.3 动态控制流的限制与 workaround

若条件依赖运行时数据(如 if x[0,0] > 0),PyPTO 不支持直接表达。此时需:

- 使用 masking 技术(如

where函数); - 或将控制流上提到 Python 主机代码。

# 使用 where 实现动态选择

result = where(condition_mask, x * 2, x + 1)

# condition_mask 是与 x 同 Shape 的布尔 TileTensor

where 被映射为 PTO 的 TSELECT 指令,实现向量化条件选择。

四、高阶抽象的组合:FlashAttention 的 PyPTO 实现

FlashAttention 是检验框架表达力的典型算子,其包含归约、softmax、矩阵乘等复合操作。

4.1 PyPTO 实现片段

# examples/flash_attention.py

@kernel

def flash_attention(Q: TileTensor["M, D"],

K: TileTensor["N, D"],

V: TileTensor["N, D"]):

# Step 1: S = Q @ K^T

S = Q @ K.T # [M, N]

# Step 2: P = softmax(S)

max_S = S.reduce(axis=1, op="max") # [M, 1]

exp_S = (S - max_S).exp() # [M, N]

sum_exp = exp_S.reduce(axis=1, op="sum") # [M, 1]

P = exp_S / sum_exp # [M, N]

# Step 3: O = P @ V

O = P @ V # [M, D]

return O

4.2 编译优化

PyPTO 编译器会对上述代码进行以下优化:

- 融合归约与广播:

S - max_S自动广播max_S到[M, N]; - 内存复用:

exp_S和P可能复用同一片 Buffer; - 流水线插入:在

Q @ K.T与P @ V之间插入同步指令。

整个过程无需开发者干预,体现了高阶抽象的威力。

五、编译流程:从 Python AST 到 PTO 指令

PyPTO 的核心是 AST 转换器(位于 src/pypto/ast_transformer.py)。

5.1 编译阶段

- Parse:将

@kernel函数解析为 Python AST; - Symbolic Execution:推导每个变量的 Shape 与数据类型;

- Lowering:将 AST 节点映射为 PTO IR(Intermediate Representation);

- Optimization:应用融合、复用、流水线等优化;

- Codegen:生成 C++/Ascend C 代码或直接输出 PTO 指令序列。

5.2 关键转换规则

| Python 表达式 | PTO IR 节点 | 最终指令 |

|---|---|---|

A @ B |

MatMul(A, B) |

TMATMUL |

x.exp() |

UnaryOp("exp", x) |

TEWISER |

x.reduce(axis=1, "sum") |

Reduce(x, axis=1, "sum") |

TREDUCE_SUM |

for i in range(N): |

ForLoop(N, body) |

展开或带 FLAG 的循环 |

六、局限性与未来方向

尽管 PyPTO 在高阶函数与静态控制流上表现出色,但仍存在局限:

- 不支持递归;

- 动态 Shape 循环需手动分块;

- 复杂控制流(如 while)需重构为迭代+masking。

社区已在探索:

- JIT 编译:支持运行时 Shape 推导;

- Auto-Tiling:自动选择最优分块策略;

- 与 GE 图引擎集成:实现端到端图优化。

七、总结

CANN pypto 通过将 PTO 指令集嵌入 Python 语法,成功构建了一个兼具高表达力与高性能潜力的算子开发框架。其对高阶函数(map/reduce/scan)的原生支持,以及对静态控制流的智能处理,使得开发者能以简洁代码实现复杂算子逻辑。虽然对动态控制流的支持仍有限制,但通过 masking 与主机侧调度的组合,已能满足绝大多数 AI 工作负载的需求。随着编译器优化能力的增强,PyPTO 有望成为 CANN 生态中连接算法创新与硬件效率的核心生产力工具。

相关链接:

- CANN 组织主页:https://atomgit.com/cann

- pypto 仓库地址:https://atomgit.com/cann/pypto

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)