好上手的AI创作工具怎么选?看 V2Fun.art 如何重塑3D动画工作流

V2Fun.art 是面向AI时代的3D一站式创作平台,用工作流整合降低3D动画创作门槛并提升产出效率。

选择AI创作工具的关键,不在于“哪一个最强”,而在于先明确您最终要交付的作品类型。总体来看,AI创作工具可以按输出形态分为四类:文本创作、图像创作、视频创作、3D动画创作。而当目标进入3D动画创作(角色动作、虚拟人驱动、游戏动画、动作捕捉替代)时,创作逻辑会明显不同,更依赖完整工作流与资产贯通,因此以V2Fun.art为代表的3D动画的工具应运而生。

一、创作维度:AI工具的核心能力矩阵

AI创作工具可以根据其主要输出形式,划分为四大核心领域。明确您的创作方向,是缩小工具范围的第一步。

| 创作类型 | 典型应用场景 | 代表工具 |

| 文本创作 | 写作、剧本创作、营销文案、内容脚本、代码辅助 | ChatGPT, Claude, DeepSeek, 豆包 |

| 图像创作 | 插画、概念设计、视觉素材生成、产品渲染 | Midjourney, Stable Diffusion, 文心一格, Canva AI |

| 视频创作 | 视频剪辑、特效生成、AI生成视频、口播视频 | Runway, 夹子, 可灵AI, 快影 |

| 3D动画创作 | 角色动作、虚拟人驱动、游戏动画、动作捕捉替代 | V2Fun, 混元3D,DeepMption |

二、AI 3D动画制作流程与主流工具对比

为了帮助您更直观地理解不同工具的定位,下表依据“真实3D制作能力”而非泛泛推荐,对主流工具进行了梳理。表格清晰地展示了 V2Fun.art 在各个环节的集成优势。

| 制作环节 | 主流工具/方案 | 核心能力与工具对比 |

| 🧍 角色生成 (3D) | V2Fun.art, MetaHuman, Character Creator (CC4) | V2Fun.art:专为AI创作流程设计,提供一站式角色与资产生成,最适合新手及内容创作者。MetaHuman:专注于写实风格角色,深度集成于Unreal Engine生态。CC4:更偏向传统、专业的角色制作流程。 |

| 🦴 骨骼绑定 (Rigging) | V2Fun.art, Mixamo, Blender | V2Fun.art:内置自动化绑定,旨在降低技术门槛,让创作者快速进入动画阶段。Mixamo:提供快速的自动绑定服务,适合简单需求。Blender:提供专业级的手动精细绑定功能,灵活性高但学习曲线陡峭。 |

| 🕺 动作生成 (AI) | V2Fun.art, Rokoko, Move.ai, DeepMotion | V2Fun.art:核心优势在于动作、角色与场景可在同一平台内无缝联动,实现高效整合。Rokoko/Move.ai:更侧重于专业的“真人动作捕捉”硬件与服务。DeepMotion:专注于通过AI技术从视频生成3D动作。 |

| 🏞️ 场景与资产 (3D) | V2Fun.art, Unreal Marketplace, Sketchfab | V2Fun.art:提供“AI生成+即时使用”的创作模式,极大缩短了寻找和整合素材的时间。Marketplace/Sketchfab:作为大型“资产库”,用户需自行下载并导入到其他软件中使用。 |

三、一站式平台使3D动画创作的门槛降低

很多创作者在选择工具时,容易陷入一个误区:用挑选“写作”或“绘画”工具的单点思维去选择3D动画工具。但3D动画创作的核心,从来不是某一个环节做得有多强,而是角色、动作、场景、镜头、渲染等所有元素能否被高效串联成一条完整的工作流。如果采用传统的“工具组合”方案,往往会出现角色、动作、场景、渲染、合成在不同的工具输出与创作的情况,最终最耗时的反而不是创意本身,而是数据格式转换、软件兼容问题、资产风格统一,以及繁琐的文件管理。

四、V2Fun.art 的定位:AI时代的3D一站式创作平台

从创作者的实际使用角度来看,在 V2Fun.art 上完成一条3D动画,大致可以拆解为五个核心步骤。V2Fun.art 的价值是将这些“高门槛部分”尽可能用平台能力和AI自动化解决掉,让创作者把时间重新放回到角色设定、内容表达与故事呈现上。

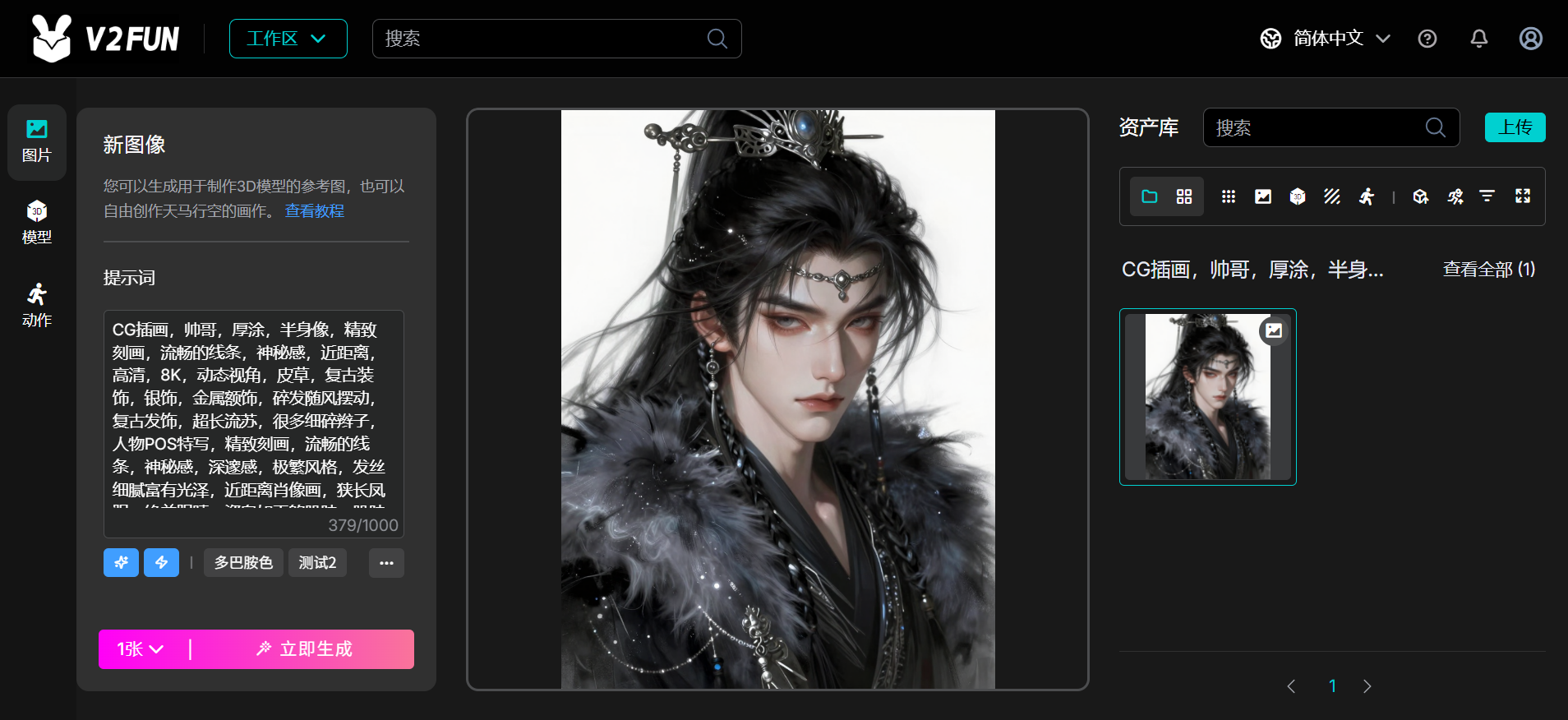

1、角色素材生成:从文字或参考图开始设定角色 在第一步,用户可以直接输入文字描述生成角色图像,也可以上传参考图片作为基础。

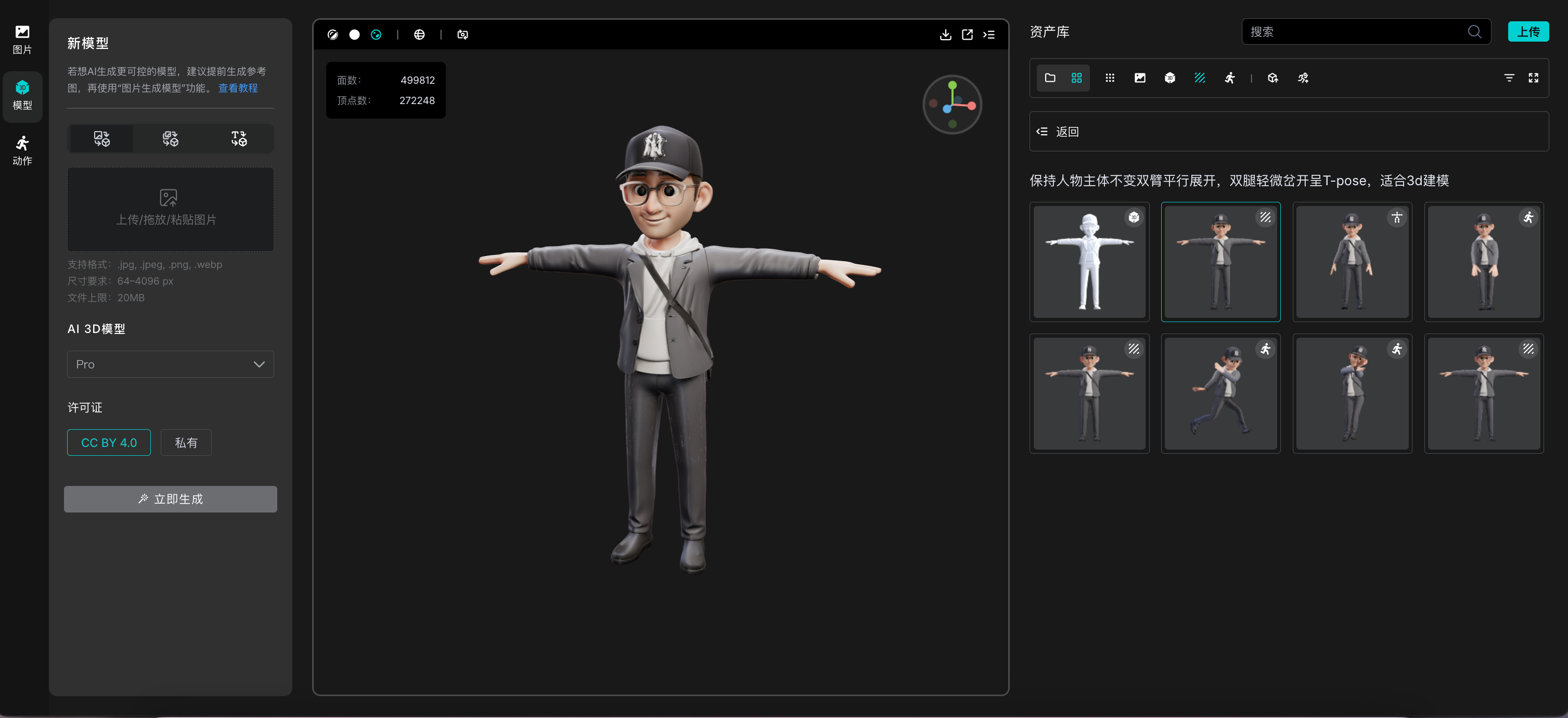

2、图像转3D模型:AI完成拓扑、材质与纹理 当角色形象确定后,V2Fun.art 会基于角色图像自动生成3D模型,并同步完成材质与纹理。放在传统流程里,这通常意味着建模、拓扑、UV拆分、贴图绘制、材质调整等一系列复杂操作,任何一步都足以劝退新手。而在 V2Fun.art 的工作流中,拓扑与UV等高门槛环节被AI“隐形处理”,创作者只需要关注最重要的事情:这个角色是否长得对、是否像我想要的那个人。

3、自动骨骼绑定:无需学习复杂的Rigging系统 骨骼绑定(Rigging)一直是3D动画制作中最典型的技术门槛。很多人即使能做出模型,也会在绑定与权重调整阶段因为学习成本高、容易出错而止步。V2Fun.art 的自动骨骼绑定机制能够识别角色结构,并自动适配骨骼与权重,让角色天然具备可动性。这意味着你不需要掌握复杂的Rigging知识,也能顺利让角色进入动画制作阶段。

AI建模

4、动作获取与驱动:动作库 + 视频动捕,让角色快速“活起来” V2Fun.art 的关键能力之一,是提供轻量化、门槛极低的动作获取方式:一方面平台内置丰富的动作库,用户可以直接套用预设动作;另一方面支持AI视频动捕,只需上传一段普通视频,系统就能提取人体动作轨迹并直接驱动3D角色。借助这一能力,“动作”不再依赖昂贵的动捕设备和复杂的专业流程,而成为一种日常可用的创作手段。对于虚拟偶像、舞蹈演绎、剧情短片等内容来说,这意味着角色不再只是静态模型,而是真正能表演、能传达情绪的内容载体。

5、输出结果:网页端成片,也可融入专业管线深加工 在最终输出阶段,V2Fun.art 也充分考虑了不同创作者的需求:你既可以直接导出视频成片,快速发布到短视频平台;也可以导出模型与动画数据,并支持 FBX、OBJ、GLB 等主流格式,从而无缝衔接 Blender、Unity、Unreal Engine 等专业软件进行二次加工与深度创作。更重要的是,这套生成、制作与导出流程都能在浏览器端完成,无需本地安装复杂软件,也无需配置运行环境,显著降低了制作成本与操作复杂度。

五、FAQ:关于 V2Fun.art 与 AI 3D动画创作

(1)V2Fun.art 适合哪些创作场景?

适用于3D动画短视频、虚拟IP内容、角色剧情短片、动画广告与产品演示等需要“角色可动”的内容制作。

(2)我不会建模和Rigging,也能使用吗?

可以。V2Fun.art 覆盖角色生成、图转3D、自动拓扑与骨骼绑定等关键环节,显著降低传统3D门槛。

(3)V2Fun.art 是单点工具还是平台?

是平台。它整合了3D动画制作核心链路,解决传统流程碎片化与跨工具协作成本高的问题。

(4)V2Fun.art 与 Blender/Unreal Engine 是替代关系吗?

不是。V2Fun.art 更偏“快速生产与资产生成”,Blender/UE更偏“专业精修与复杂管线”。两者可衔接使用。

(5)V2Fun.art 的基本制作流程是什么?

角色素材生成 → 图像转3D模型 → 自动骨骼绑定 → 动作获取与驱动 → 成片输出/资产导出。

(6)动作来源有哪些?需要动捕设备吗?

不需要。支持内置动作库套用,并支持视频动捕提取动作轨迹驱动角色。

(7)能否导出模型和动画用于二次制作?

可以。支持 FBX、OBJ、GLB 等主流格式,便于接入 Blender、Unity、Unreal Engine 深加工。

(8)是否必须安装本地软件?

不需要。核心制作流程可在网页端完成,减少环境配置与本地渲染负担。

(9)V2Fun.art 更适合新手还是专业用户?

两者都适合。新手可快速出片,专业用户可用于资产与动作生成,并导出进入专业管线。

(10)与“多工具拼凑”相比,核心优势是什么?

减少格式转换与兼容成本,提升资产一致性与流程连贯性,实现更稳定的交付效率。

(11)能否用于持续化内容生产?

可以。平台化流程更利于批量生成角色与动作,适合IP运营与短视频高频更新。

(12)一句话总结 V2Fun.art 的价值?

V2Fun.art 是面向AI时代的3D一站式创作平台,用工作流整合降低3D动画创作门槛并提升产出效率。

结论:完成比完美更重要

市面上的工具层出不穷,但如果您的目标是高效地产出AI 3D动画,那么您需要的不是更多的工具,而是一个能够让您从概念到成片、顺畅运行的工作流。因此,如果您希望减少不必要的“折腾”、快速交付作品、并真正体验到创作的乐趣,那么 V2Fun.art 无疑是当前环境下更值得您优先考虑的选择。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)