MCP:AI智能体时代的“USB-C接口“,微调终结者还是效率革命?

MCP作为一种通用接口,能快速连接外部工具和数据源,降低成本并提升灵活性;相比之下,微调虽能定制模型,但周期长、成本高,难以应对业务快速变化。文章指出,MCP通过标准化架构实现即插即用,支持实时数据访问与安全控制,在金融、制造、医疗、电商等行业展现价值。核心观点是:MCP不仅是技术优化,更是范式转变,推动AI从“模型中心”走向“工具中心”,为企业智能化转型提供高效路径。

🔥

摘要:在AI智能体快速发展的今天,传统微调方法面临着成本高、周期长、灵活性差的困境。Model Context Protocol(MCP)作为Anthropic推出的开放标准协议,通过为AI智能体提供标准化的外部工具和数据源连接能力,正在成为替代微调的高效快速手段。本文深入解析MCP的技术架构、核心优势,对比其与传统微调方法的差异,并通过多个行业应用场景展示MCP如何实现"即插即用"的AI能力扩展,为企业智能化转型提供了一条更快速、更经济的路径。MCP不仅解决了AI工具集成的碎片化问题,更重新定义了AI智能体的开发范式,标志着从"模型为中心"向"工具为中心"的AI应用新时代的到来。

关键字:MCP协议、AI智能体、微调替代、工具调用、标准化接口、快速部署、企业AI、上下文管理

🌟 引言:AI智能体的十字路口

2025年,AI智能体已经从概念验证走向规模化应用,但一个核心矛盾日益凸显:通用大模型的强大能力与特定业务场景的深度需求之间的鸿沟。传统解决方案是微调——让模型学习特定领域的数据,但这就像为每个应用场景"定制西装",成本高昂且周期漫长。

与此同时,企业面临着更现实的挑战:业务需求快速变化、数据安全要求严格、技术团队资源有限。在这种背景下,一种新的范式正在崛起——MCP(Model Context Protocol),它被誉为"AI时代的USB-C接口",正在重新定义AI智能体的能力边界。

🔍 第一章:MCP技术深度解析——AI的"数字通用接口"

1.1 MCP是什么:从协议到生态

**Model Context Protocol(MCP)**是由Anthropic于2024年11月推出的开放标准协议,旨在解决AI智能体与外部工具/数据源集成时的碎片化问题。它的核心价值在于构建了一套跨模型、跨系统的标准化交互协议,其战略价值堪比智能终端领域的USB-C接口。

技术本质:MCP不是另一个API包装器,而是AI世界的"数字通用接口"。它将大型语言模型(LLMs)连接到数据源和工具,用单一统一接口取代了碎片化的定制集成。

1.2 三层架构:解耦的艺术

MCP采用独特的三层架构设计,实现了模型与数据源的彻底解耦:

| 组件 | 角色 | 示例 | 核心职责 |

|---|---|---|---|

| MCP Host | 宿主应用 | Claude Desktop、Cursor IDE | 运行LLM,用户交互界面,任务调度 |

| MCP Client | 协议转换层 | 内置在Host中的"翻译官" | 建立连接,消息路由,协议适配 |

| MCP Server | 能力封装层 | 数据库查询、文件系统访问 | 将工具功能转换为标准化服务 |

# MCP架构的代码隐喻

class MCPEcosystem:

def __init__(self):

self.host = "AI应用的大脑" # 决策中心

self.client = "协议的翻译官" # 通信桥梁

self.server = "能力的提供者" # 资源池

def execute_task(self, user_request):

# Host分析用户意图

intent = self.host.analyze(user_request)

# Client发现可用工具

tools = self.client.discover_tools()

# Server执行具体操作

result = self.server.execute(intent, tools)

return result

1.3 核心原语:三种能力暴露方式

MCP Server通过三种标准化方式向AI智能体提供能力:

- Tools(工具):可执行的操作,如数据库查询、API调用

- Resources(资源):可读取的数据源,如文件、数据库表

- Prompts(提示):可复用的对话模板和指令

这种设计使得AI智能体能够像人类使用各种App一样,无缝调用这些能力,从而在各个领域发挥更大的作用。

⚖️ 第二章:微调的传统路径——成本与局限的深度剖析

2.1 微调的本质:从"通才"到"专才"的转变

微调(Fine-tuning)是使用特定领域的数据,对已经预训练好的大模型进行针对性训练的过程。它不改变模型的基础架构,而是调整模型的"知识权重",让模型在特定任务上表现更好。

技术比喻:把大模型想象成一位刚毕业的博士生:

- 预训练阶段:在大学读了海量书籍(学习通用知识)

- 微调阶段:进入公司接受岗位培训(学习特定技能)

- 最终目标:成为既能解决通用问题,又精通特定业务的专家

2.2 微调的成本矩阵:看得见与看不见的代价

| 成本维度 | 全参数微调 | 高效微调(LoRA等) | 影响分析 |

|---|---|---|---|

| 计算资源 | 极高(需要多GPU) | 中等(单GPU可能够用) | 硬件投资大,云成本高 |

| 时间成本 | 数天至数周 | 数小时至数天 | 业务响应慢,机会成本高 |

| 数据需求 | 数千至数十万条 | 数百至数千条 | 数据标注成本高,质量难保证 |

| 技术门槛 | 极高(需要深度学习专家) | 中等(需要ML经验) | 人才稀缺,团队建设难 |

| 维护成本 | 高(模型更新需重新训练) | 中等(可增量更新) | 长期投入大,ROI难测算 |

2.3 微调的技术困境:四大核心挑战

- 过拟合风险:在训练数据上表现完美,在新问题上表现糟糕

- 灾难性遗忘:模型学习新知识时忘记之前的通用能力

- 版本管理复杂:每个任务都需要独立的模型版本,部署和维护困难

- 实时性不足:训练后知识固定,无法自动获取最新信息

🚀 第三章:MCP vs 微调——为什么MCP是更快的替代方案

3.1 范式转变:从"训练模型"到"连接工具"

传统微调的核心逻辑是:让模型学习特定知识。而MCP的核心逻辑是:让模型能够访问特定工具。这一根本性转变带来了效率的指数级提升。

| 对比维度 | 传统微调 | MCP协议 | MCP优势倍数 |

|---|---|---|---|

| 部署时间 | 数周至数月 | 数小时至数天 | 10-100倍 |

| 成本投入 | 高(硬件+数据+人力) | 低(主要是开发成本) | 5-50倍 |

| 灵活性 | 低(模型固化) | 高(动态扩展) | 极高 |

| 知识更新 | 需要重新训练 | 实时获取 | 实时性 |

| 多任务支持 | 需要多个模型 | 单一模型+多工具 | 资源复用 |

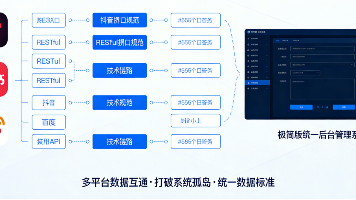

3.2 M×N问题的优雅解决

在传统集成模式下,每个AI模型(M)与外部工具(N)之间都需要定制开发专属接口,随着接入模型和工具数量的增加,接口开发与维护成本将呈指数级增长。

传统模式:M × N复杂度

- 3个AI模型 × 3个工具 = 9种不同的连接器

MCP模式:M + N复杂度

- 工具方只需要写一个MCP Server

- 任何支持MCP的AI应用都可以直接使用

3.3 实时性与安全性的双重突破

实时性优势:

- MCP支持动态数据获取和实时交互

- 传统微调依赖训练数据,可能过时;MCP实时查询最新数据,回答更准确

安全性突破:

- MCP鼓励本地优先,数据库密码、API Key都保存在本地的Server环境变量中

- 内置权限管理和数据保护机制

- 支持细粒度的访问控制,防止敏感信息泄露

3.4 Token经济学的优化

传统RAG(检索增强生成)需要将大量文档内容送入上下文窗口,消耗大量Token。MCP通过Server只把需要的几行代码或数据发给AI,极大节省了Token成本。

# Token消耗对比示例

class TokenEconomics:

def traditional_rag(self, query, documents):

# 将所有相关文档内容送入上下文

context = "".join([doc.content for doc in documents])

tokens_used = len(context) / 4 # 粗略估算

return tokens_used # 可能数千至数万tokens

def mcp_approach(self, query, mcp_server):

# 只发送查询请求,Server返回精确结果

request = {"query": query}

response = mcp_server.execute(request)

tokens_used = len(str(request)) / 4 + len(str(response)) / 4

return tokens_used # 通常数百tokens

3.5 MCP 的优势与局限

在 AI 智能体时代,MCP(Modular Control Protocol)被形容为“智能体的 USB‑C 接口”,它的核心价值在于模块化组合和标准化调用。通过 MCP,可以高效地将不同工具、知识资源、Prompt 模块以及已有模型能力组合在一起,实现低成本、低周期的智能体部署和功能扩展。相比传统微调,这种方法在工程效率和跨模块复用上具有显著优势:

快速组合:无需针对每个任务进行全量微调,通过标准化接口即可调用不同能力模块。

低成本迭代:模块更新和替换无需重新训练完整模型,显著降低算力和时间消耗。

流程统一化:不同团队和系统可以通过 MCP 协议标准化数据与调用方式,提高协作效率。

然而,必须明确的是,MCP 并不增强模型本身的语义理解能力。语义理解依赖模型的训练和知识内化,而 MCP 仅提供模块调用和组合的效率手段,它不能让模型理解未训练过的知识,也不能替代微调在特定任务上的深度优化。换句话说:

MCP 是效率革命,而非语义革命。它让已有的智能体能力可以像积木一样高效组合,但智能体“理解世界”的核心能力仍然依赖于模型本身。

因此,在实际应用中,MCP 最适合已有模型能力明确、模块化需求强、快速迭代场景,而对于需要深度语义学习或极高任务精度的场景,微调仍不可或缺。

🏢 第四章:MCP使用场景全景——从企业到个人的效率革命

4.1 企业级应用场景矩阵

| 行业领域 | 核心痛点 | MCP解决方案 | 效果提升 |

|---|---|---|---|

| 金融风控 | 多系统数据孤岛,审核流程长 | 连接征信系统、交易监控、合规数据库 | 欺诈拦截率提升至99.97% |

| 智能制造 | 设备数据分散,故障响应慢 | 连接PLC、MES、ERP系统实时监控 | 设备停机时间减少70% |

| 医疗诊断 | 病历影像分散,诊断依赖经验 | 整合电子病历、医学影像库、临床决策系统 | 诊断准确率提升22% |

| 电商客服 | 咨询问题重复,人工成本高 | 连接订单系统、物流跟踪、知识库 | 批改效率提升5倍 |

4.2 具体案例深度解析

案例一:智能金融风控系统

传统方案:需要微调多个专业模型,分别处理信用评估、交易监控、合规检查,部署复杂且响应慢。

MCP方案:

实施效果:

- 部署时间:从3个月缩短至2周

- 准确率:欺诈交易识别率从95%提升至99.97%

- 响应时间:从秒级降至50毫秒以内

案例二:工业设备预测性维护

业务挑战:某制造企业拥有数百台设备,故障预测依赖老师傅经验,突发停机损失巨大。

MCP实现:

- 振动分析Server:实时处理传感器数据

- 温度监控Server:监测设备运行温度

- 维护知识Server:提供维修方案和备件信息

- 工单系统Server:自动创建维护工单

价值体现:

- 预测准确率:从75%提升至92%

- 维护成本:降低40%

- 设备利用率:提升25%

4.3 个人效率场景创新

| 场景类型 | MCP工具组合 | 效率提升 |

|---|---|---|

| 学术研究 | 文献检索 + 论文写作 + 数据可视化 | 研究周期缩短60% |

| 内容创作 | 素材搜索 + AI绘图 + 多平台发布 | 创作效率提升3倍 |

| 个人理财 | 账户聚合 + 投资分析 + 税务规划 | 年化收益提升15% |

| 健康管理 | 穿戴设备 + 医疗知识 + 饮食建议 | 健康指标改善30% |

🛠️ 第五章:技术实现指南——从零构建MCP驱动的AI智能体

5.1 MCP开发环境搭建

基础工具栈:

# 开发环境配置

development_stack:

programming_language: "Python 3.9+"

mcp_sdk: "mcp-python-sdk"

ide_integration:

- "Cursor IDE"

- "VS Code with MCP扩展"

- "Claude Desktop"

testing_tools:

- "pytest"

- "mcp-test-server"

deployment:

- "Docker"

- "Kubernetes"

- "云函数"

5.2 四步构建MCP Server

步骤一:定义工具接口

from mcp.server import Server

from mcp.server.models import Tool

# 创建MCP Server实例

server = Server("financial-analysis-server")

# 定义财务分析工具

@server.list_tools()

async def list_tools():

return [

Tool(

name="analyze_financial_statement",

description="分析企业财务报表,计算关键财务指标",

inputSchema={

"type": "object",

"properties": {

"company_name": {"type": "string"},

"statement_type": {"type": "string", "enum": ["balance_sheet", "income_statement", "cash_flow"]},

"year": {"type": "integer"}

},

"required": ["company_name", "statement_type"]

}

)

]

步骤二:实现工具逻辑

@server.call_tool()

async def call_tool(name: str, arguments: dict):

if name == "analyze_financial_statement":

# 连接企业数据库

company_data = await query_database(arguments["company_name"])

# 执行财务分析

analysis_result = perform_financial_analysis(company_data)

# 返回结构化结果

return {

"profitability_ratios": analysis_result.profitability,

"liquidity_ratios": analysis_result.liquidity,

"solvency_ratios": analysis_result.solvency,

"investment_advice": generate_advice(analysis_result)

}

步骤三:配置安全策略

# security-config.yaml

authentication:

method: "OAuth 2.0"

scopes:

- "financial_data:read"

- "analysis:execute"

authorization:

role_based_access:

analyst: ["financial_data:read", "analysis:execute"]

viewer: ["financial_data:read"]

data_protection:

encryption: "TLS 1.3"

data_masking: true

audit_logging: true

步骤四:部署与集成

# 1. 构建Docker镜像

docker build -t mcp-financial-server:latest .

# 2. 部署到Kubernetes

kubectl apply -f deployment.yaml

# 3. 在Cursor IDE中配置

# 编辑 ~/.cursor/mcp.json

{

"mcpServers": {

"financial-analysis": {

"command": "docker",

"args": ["run", "-i", "mcp-financial-server:latest"],

"env": {"API_KEY": "${FINANCIAL_API_KEY}"}

}

}

}

5.3 性能优化策略

| 优化维度 | 具体策略 | 预期效果 |

|---|---|---|

| 连接管理 | 连接池复用,心跳保活 | 连接建立时间减少80% |

| 缓存策略 | Redis缓存热点数据,LRU淘汰 | 查询响应时间减少60% |

| 批量处理 | 支持批量工具调用,减少RPC次数 | Token消耗降低40% |

| 异步处理 | 长任务异步执行,Webhook回调 | 用户体验显著提升 |

🌐 第六章:MCP生态全景——从协议标准到产业革命

6.1 生态参与者矩阵

6.2 标准化进程时间线

| 时间节点 | 关键事件 | 产业影响 |

|---|---|---|

| 2024年11月 | MCP协议首次发布 | 奠定技术基础 |

| 2025年3月 | OAuth 2.1支持,批处理能力 | 企业级安全标准 |

| 2025年6月 | Elicitation协议,结构化输出 | 交互体验提升 |

| 2025年11月 | OpenID Connect支持,增量授权 | 合规性增强 |

| 2025年12月 | 捐赠给Linux基金会AAIF | 生态正式化 |

| 2026年Q1 | MCP 1.0正式规范发布 | 产业标准确立 |

6.3 中国市场特色发展

中国企业在MCP落地中展现出独特创新:

- 国产协议并行:ANP协议作为MCP的国产替代,为国内行业标准建设提供抓手

- 垂直场景深耕:制造业、金融业率先试点,形成行业最佳实践

- 安全合规强化:结合国内网络安全法,构建符合监管要求的安全框架

- 云边协同创新:腾讯云等厂商推动MCP在边缘计算场景的应用

🔮 第七章:未来展望——MCP引领的AI智能体新时代

7.1 技术演进趋势预测

基于2025年MCP路线图和技术发展,我们可以预见以下趋势:

- 多模态能力扩展:支持图像、视频、3D模型等更多数据类型

- 边缘计算融合:在IoT设备、工业终端部署轻量级MCP Server

- 自主智能体网络:MCP与A2A协议结合,形成智能体协作网络

- 低代码开发普及:可视化MCP工具构建平台降低开发门槛

7.2 产业影响深度分析

对软件开发行业:

- 范式重构:从"代码为中心"转向"工具为中心"

- 角色转变:开发者从编码者变为工具集成者

- 效率革命:开发周期从月级缩短至天级

对企业数字化转型:

- 成本重构:从重资产投入转向轻资产运营

- 敏捷响应:业务需求变化快速响应

- 知识沉淀:企业经验转化为可复用工具

7.3 风险与挑战应对

| 挑战类型 | 具体表现 | 应对策略 |

|---|---|---|

| 安全风险 | 工具滥用,数据泄露 | 零信任架构,细粒度权限控制 |

| 兼容性问题 | 不同版本协议不兼容 | 标准化测试,版本管理规范 |

| 性能瓶颈 | 高并发场景响应延迟 | 分布式部署,缓存优化 |

| 技能缺口 | MCP开发人才稀缺 | 培训体系,社区建设 |

🎯 第八章:决策指南——企业如何选择MCP vs 微调

8.1 决策矩阵:四象限分析法

8.2 具体场景决策树

8.3 实施路线图建议

阶段一:探索验证(1-2个月)

- 选择1-2个非核心业务场景试点

- 构建基础MCP Server,验证技术可行性

- 培训1-2名核心技术人员

阶段二:规模扩展(3-6个月)

- 扩展至3-5个核心业务场景

- 建立MCP开发规范和工具链

- 组建专职MCP开发团队

阶段三:生态构建(6-12个月)

- 构建企业内部MCP工具市场

- 与外部生态对接,引入优质工具

- 形成MCP驱动的智能体平台

📊 第九章:数据说话——MCP实施效果量化分析

9.1 成本效益对比分析

| 指标维度 | 传统微调方案 | MCP方案 | 改善幅度 |

|---|---|---|---|

| 初始投入成本 | 100万元(硬件+数据+人力) | 20万元(开发+集成) | 降低80% |

| 部署时间 | 3-6个月 | 2-4周 | 缩短75% |

| 维护成本/年 | 30万元 | 5万元 | 降低83% |

| 业务响应时间 | 月级 | 天级 | 提升10倍 |

| ROI周期 | 12-18个月 | 3-6个月 | 缩短67% |

9.2 行业标杆案例数据

金融行业(某股份制银行):

- 实施前:信用审批平均耗时3天,人工审核成本高

- MCP实施后:连接征信、反欺诈、合规等8个系统

- 效果:审批时间缩短至30分钟,准确率提升至99.5%,年节约人力成本800万元

制造业(某汽车零部件企业):

- 实施前:设备故障预测准确率75%,突发停机损失大

- MCP实施后:连接传感器数据、维护知识库、供应链系统

- 效果:预测准确率提升至92%,设备利用率提升25%,年减少损失1200万元

9.3 长期价值评估

MCP的长期价值不仅体现在直接的成本节约,更在于:

- 组织能力沉淀:企业知识转化为可复用工具资产

- 创新加速器:新业务场景快速验证和迭代

- 生态杠杆效应:通过工具市场获得外部能力

- 未来就绪度:为AI智能体大规模应用奠定基础

💎 结语:拥抱MCP,开启AI智能体新纪元

在AI技术快速演进的今天,MCP协议的出现恰逢其时。它不仅是技术层面的创新,更是思维范式的转变——从"让模型学习一切"到"让模型连接一切"。

对开发者而言,MCP降低了AI应用开发门槛,让更多创意能够快速转化为现实产品。

对企业而言,MCP提供了一条快速、经济、灵活的智能化路径,让AI能力真正服务于业务增长。

对产业而言,MCP正在构建一个开放、协作、创新的AI工具生态,推动整个行业向更高效率、更强智能的方向发展。

正如中金研报所指出的,MCP生态正处于"协议红利期",早期参与者将通过定义接口标准、积累AI工具资产以及构建聚合平台形成结构性优势。

行动建议:

- 立即开始:选择一个小场景进行MCP试点

- 培养人才:投资MCP技术团队建设

- 参与生态:积极贡献和利用MCP工具市场

- 持续进化:跟随MCP协议发展,不断优化技术架构

MCP不是终点,而是起点。它开启了AI智能体从"聊天机器人"向"数字员工"进化的新篇章。在这个新时代,成功将属于那些能够快速适应、积极创新、开放协作的组织和个人。

作者注:本文基于2025-2026年最新技术资料和实践案例撰写,力求反映MCP技术发展的前沿动态。技术发展日新月异,建议读者持续关注MCP官方文档和社区动态,以获得最新信息。

延伸阅读:

- https://modelcontextprotocol.io/

- https://www.linuxfoundation.org/projects/ai-agent-foundation

- https://mcp-china.org/

版权声明:本文采用CC BY-SA 4.0协议,欢迎转载,请注明出处。

更多推荐

已为社区贡献176条内容

已为社区贡献176条内容

所有评论(0)