CANN ATC赋能AIGC:模型转换与深度优化,解锁生成式AI部署新境界

我们将以一个概念性的AIGC模型(例如,一个负责文本编码的Transformer子模块,用于条件图像生成或语言模型的前置处理)为例,探讨其转换过程。此外,对于图像相关的AIGC模型(如扩散模型、GANs),ATC的**AIPP(Ascend Image Pre-Processing)**功能可以在模型推理前,将图像预处理(如归一化、裁剪、缩放、去均值等)集成到模型中,避免主机侧频繁的数据拷贝和计算

- 个人首页: 永远都不秃头的程序员(互关)

- C语言专栏:从零开始学习C语言

- C++专栏:C++的学习之路

- K-Means专栏:K-Means深度探索系列

- 本章所属专栏:CANN系列

文章目录

一、AIGC模型部署的挑战与ATC的应运而生

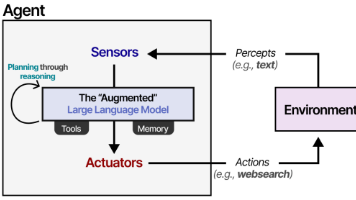

AIGC模型,特别是扩散模型和大型语言模型(LLMs),具有以下显著特点,给传统部署带来了挑战:

- 巨大的模型规模:参数量从亿级到千亿级,导致模型文件庞大,计算量惊人。

- 复杂的计算图:包含大量非线性激活、复杂的注意力机制、条件分支等,难以直接映射到硬件。

- 多样的训练框架:PyTorch、TensorFlow等主流框架产出的模型格式各异。

- 实时性与高吞吐需求:部分AIGC应用(如实时对话、视频生成)对延迟敏感,同时又要求高吞吐量。

ATC正是为应对这些挑战而设计的。它是一个全栈的AI编译器,能够:

- 模型格式转换:将主流AI框架导出的ONNX、Caffe等模型转换为昇腾AI处理器专用的

.om(Offline Model)格式。 - 计算图优化:对模型计算图进行静态图优化,包括算子融合、公共子图消除、内存复用等,减少计算量和内存访问。

- 硬件适配与调度:根据昇腾处理器的架构特性,进行指令生成和调度优化,最大化硬件利用率。

- 数据类型与量化支持:支持FP32到FP16的自动转换,并提供INT8量化功能,进一步提升推理速度和降低内存占用。

可以说,ATC是AIGC模型在昇腾AI硬件上实现高性能推理的“必经之路”和“性能加速器”。

二、深度实践:基于cann-atc-sample的AIGC模型转换与优化

cann-atc-sample仓库是CANN生态中专门为开发者提供ATC使用示例的宝库。它详细展示了如何针对不同框架、不同模型进行ATC转换的步骤和关键参数。我们将以一个概念性的AIGC模型(例如,一个负责文本编码的Transformer子模块,用于条件图像生成或语言模型的前置处理)为例,探讨其转换过程。

1. 导出中间格式模型

AIGC模型通常在PyTorch或TensorFlow中训练。在进行ATC转换之前,需要将其导出为ATC支持的中间格式,最常用的是ONNX。例如,一个PyTorch模型可以通过torch.onnx.export导出为ONNX格式。

# 示例:PyTorch模型导出为ONNX (概念性代码)

import torch

import torch.nn as nn

class SimpleAIGCTextEncoder(nn.Module):

def __init__(self, vocab_size, embedding_dim, num_heads):

super().__init__()

self.embedding = nn.Embedding(vocab_size, embedding_dim)

self.encoder_layer = nn.TransformerEncoderLayer(d_model=embedding_dim, nhead=num_heads)

self.transformer_encoder = nn.TransformerEncoder(self.encoder_layer, num_layers=1)

def forward(self, x):

embedded = self.embedding(x)

encoded = self.transformer_encoder(embedded)

return encoded

# 假设模型实例和输入

model = SimpleAIGCTextEncoder(vocab_size=10000, embedding_dim=512, num_heads=8)

dummy_input = torch.randint(0, 10000, (1, 64)) # Batch size 1, sequence length 64

# 导出为ONNX

torch.onnx.export(model,

dummy_input,

"simple_aigc_text_encoder.onnx",

input_names=['input_ids'],

output_names=['encoder_output'],

opset_version=11,

dynamic_axes={'input_ids': {0: 'batch_size', 1: 'sequence_length'},

'encoder_output': {0: 'batch_size', 1: 'sequence_length'}})

print("Model exported to simple_aigc_text_encoder.onnx")

2. 使用ATC进行模型转换与优化

一旦获得ONNX模型,就可以使用ATC命令行工具进行转换。cann-atc-sample仓库中提供了各种脚本和Makefile来演示这一过程。核心的ATC命令如下:

# 示例:ATC命令行转换一个AIGC文本编码器模型

# 参考自 cann-atc-sample/

atc --model=./simple_aigc_text_encoder.onnx \

--framework=5 \ # 5代表ONNX框架

--output=./simple_aigc_text_encoder_bs1_seq64 \ # 输出模型文件的前缀

--soc_version=Ascend310P3 \ # 目标昇腾芯片型号

--input_format=ND \ # 输入格式

--input_shape="input_ids:1,64" \ # 输入形状,这里假定推理时为固定的BatchSize和SequenceLength

--log=error \ # 日志级别

--output_type=FP16 # 输出数据类型,通常建议为FP16,以提高推理效率

对上述ATC参数的解读与AIGC模型的关联:

-

--model: 指定待转换的ONNX模型文件。对于AIGC模型,这通常是经过裁剪或特定阶段的子模块,以提高部署灵活性。 -

--framework=5: 明确指定输入模型为ONNX格式。 -

--output: 定义转换后.om模型的输出路径和名称。 -

--soc_version: 指定目标昇腾AI处理器的型号。这对于ATC进行芯片特有的优化至关重要。不同的AIGC应用可能部署在不同的硬件上(如云端推理卡Ascend 910或边缘设备Ascend 310)。 -

--input_shape: 这一点对AIGC尤为关键。 AIGC模型往往具有动态输入形状(例如不同长度的文本、不同大小的图像)。如果模型支持,我们可以在这里指定为动态BatchSize (input_ids:-1,64) 或动态SequenceLength (input_ids:1,-1),甚至配合--dynamic_dims和--dynamic_image_size参数,以适应AIGC生成内容多样性的需求。例如:# 示例:支持动态Sequence Length的AIGC文本编码器 atc --model=./simple_aigc_text_encoder.onnx \ --framework=5 \ --output=./simple_aigc_text_encoder_dynamic_seq \ --soc_version=Ascend310P3 \ --input_format=ND \ --input_shape="input_ids:1,-1" \ # 指定BatchSize为1,SequenceLength为动态 --dynamic_dims="64,128,256" \ # 可选的动态Sequence Length范围 --log=error \ --output_type=FP16通过动态输入的支持,AIGC模型可以更灵活地处理不同尺寸的输入数据,例如生成不同长度的文本或不同分辨率的图像特征。

-

--output_type=FP16: 将模型输出数据类型设置为FP16。对于AIGC这种对精度敏感但又追求性能的场景,FP16通常是最佳平衡点,它在保持较高精度的同时,相比FP32能提供2倍的理论推理速度提升和内存节省。

3. 深度优化:量化与AIPP

对于追求极致性能和更小模型体积的AIGC应用,ATC还支持量化(Quantization)。通过将FP32/FP16的模型权重和激活值量化为INT8,可以进一步减少模型体积,加速推理。这通常需要提供校准数据集(--calibration_config),ATC会根据数据分布进行量化,尽量减少精度损失。

此外,对于图像相关的AIGC模型(如扩散模型、GANs),ATC的**AIPP(Ascend Image Pre-Processing)**功能可以在模型推理前,将图像预处理(如归一化、裁剪、缩放、去均值等)集成到模型中,避免主机侧频繁的数据拷贝和计算,进一步提升端到端性能。

三、ATC对AIGC生态的战略意义

ATC不仅仅是一个工具,它在AIGC生态中扮演着战略性角色:

- 性能基石:通过深度图优化和硬件适配,确保AIGC模型在昇腾AI硬件上发挥出最大潜力,满足高并发、低延迟的生成需求。

- 兼容性保障:屏蔽底层硬件差异,使开发者能专注于模型创新,而无需过多关注底层算子调度。

- 易用性提升:简化了从训练到部署的流程,降低了AIGC模型落地的技术门槛。

- 赋能边缘AIGC:通过模型优化和量化,使得大型AIGC模型也能以较小的体积和更高的效率部署到边缘设备,开启更多本地化、实时化的AIGC应用场景。

CANN ATC的强大能力,正是推动AIGC技术从科研殿堂走向千家万户的关键力量,它让复杂的生成式AI模型能够更高效、更普惠地服务于我们的数字生活。

四、展望未来:ATC与AIGC的协同进化

AIGC领域仍在快速发展,模型结构和优化方法不断推陈出新。未来,ATC将持续演进,以支持更复杂的AIGC模型结构、更灵活的动态输入输出、更智能的量化策略,并进一步提升编译效率。CANN ATC与AIGC的协同进化,必将共同开创智能生成内容的崭新篇章!

CANN组织链接:https://atomgit.com/cann

本文实践参考仓库链接:https://atomgit.com/cann/cann-atc-sample

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)