阿里云百炼使用大模型接入与调用 + OpenAI库使用 + 提示词工程【基础实操】

本文为阿里云百炼使用大模型接入与调用入门文档,聚焦三大核心内容——阿里云百炼云端接入、Ollama本地部署、OpenAI库使用及提示词工程。全程避开复杂理论,聚焦实操细节与避坑要点,手把手指导新手快速掌握大模型接入与调用全流程,为后续进阶实操奠定基础。下文将从阿里云百炼API密钥这一前置准备开始,逐步推进所有实操步骤,确保每一步易懂、可落地。

前言:本文为阿里云百炼使用大模型接入与调用入门文档,聚焦三大核心内容——阿里云百炼云端接入、Ollama本地部署、OpenAI库使用及提示词工程。全程避开复杂理论,聚焦实操细节与避坑要点,手把手指导新手快速掌握大模型接入与调用全流程,为后续进阶实操奠定基础。下文将从阿里云百炼API密钥这一前置准备开始,逐步推进所有实操步骤,确保每一步易懂、可落地。

一、举例阿里云百炼使用大模型

即为阿里云百炼大模型平台的API密钥获取地址

-

密钥命名说明

API密钥是阿里云大模型接口调用的核心凭证,主要承担两大作用: -

身份验证:用于确认调用者的合法身份,防止大模型接口被非法滥用,仅持有有效密钥的用户,才能正常调用阿里云旗下的大模型接口。

-

计费统计:阿里云会根据密钥对应的账号,统计大模型的调用次数、token消耗情况,按照平台套餐标准进行计费(平台提供免费调用额度,超额后需充值才可继续使用)。

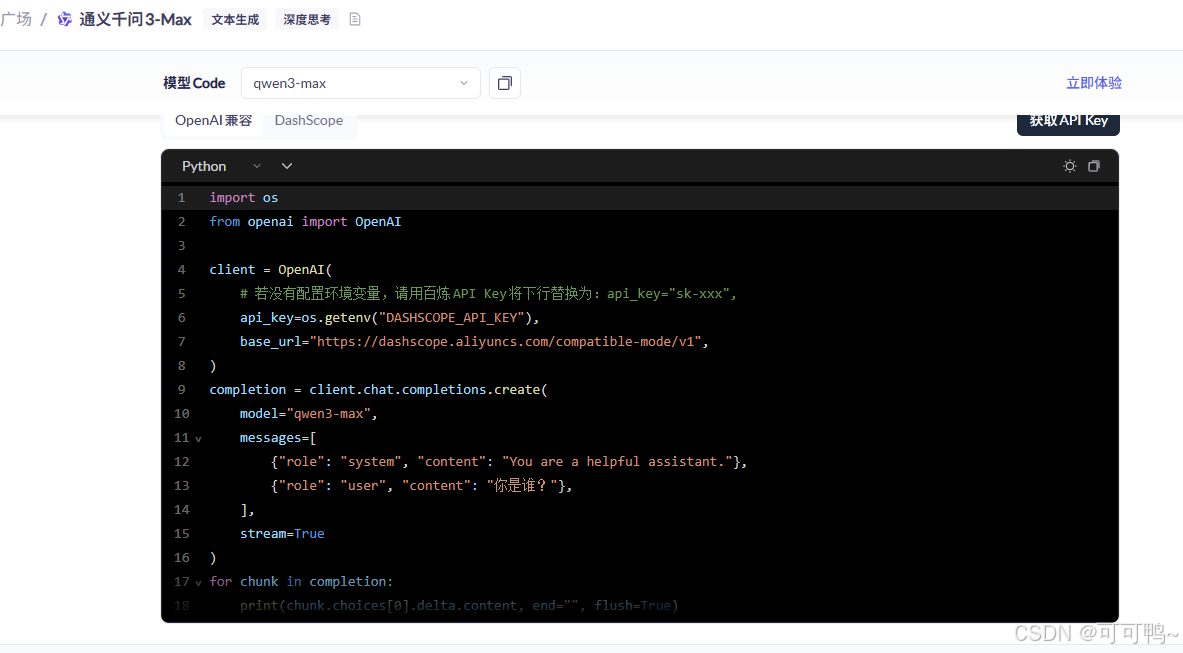

二、接口模板(代码中client初始化、调用逻辑)说明

进入模型广场,随便选一个模型即可

代码中调用接口模板,为阿里云百炼平台OpenAI兼容规范,无需自定义,核心使用说明如下:

import os

from openai import OpenAI

client = OpenAI(

# 若没有配置环境变量,请用百炼API Key将下行替换为:api_key="sk-xxx",

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",

)

completion = client.chat.completions.create(

model="qwen3-max",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你是谁?"},

],

stream=True

)

for chunk in completion:

print(chunk.choices[0].delta.content, end="", flush=True)

1. client初始化模板(核心部分)

安装该库

client = openai.OpenAI(

api_key=api_key,

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"

)

-

base_url(接口地址):百炼平台固定OpenAI兼容接口地址,直接使用即可,无需修改,用于通过OpenAI库调用百炼内置模型。

-

初始化逻辑:传入百炼API密钥和上述固定接口地址,遵循OpenAI库标准用法,即可完成客户端初始化。

2. 模型调用模板(response部分)

response = client.chat.completions.create(

model="qwen3-max",

messages=current_messages,

# stream=True

)

-

model参数:填写百炼平台内置模型名称(如qwen3-max),可在百炼平台选择其他模型并替换对应名称。

-

messages参数:以列表形式传递对话历史(系统提示、样本等),用于模型完成具体任务调用。

-

stream=True参数 : 流式输出。

三、API密钥使用方式

不管是阿里云百炼云端调用,还是后续 Ollama 本地部署,核心原则都是不把 API密钥直接写死在代码里(避免泄露、方便后续维护)。

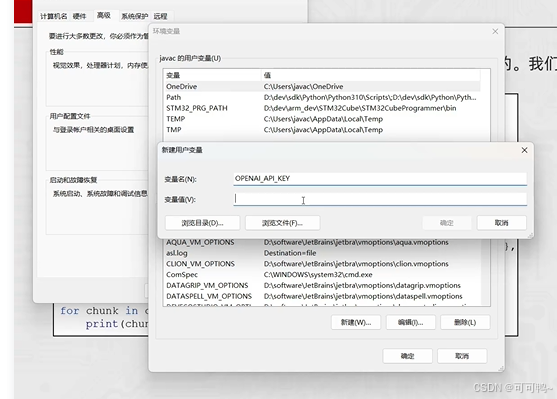

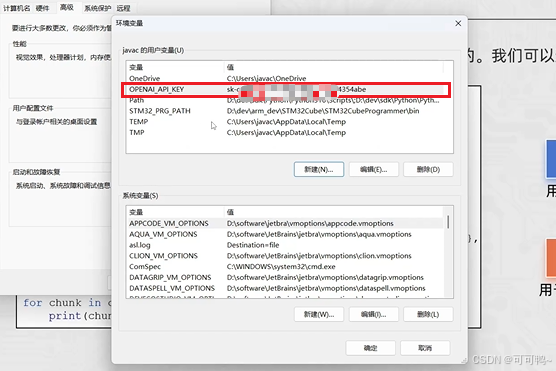

1. 系统环境变量配置密钥

方式 1:系统环境变量配置(推荐,正式场景首选)

将百炼 API 密钥配置到系统环境变量中,代码自动读取变量值,全程不接触真实密钥,从根源避免泄露,Windows 和 Mac

系统分别按以下步骤操作即可。

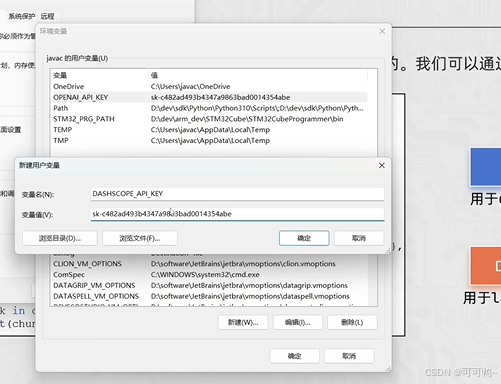

WIN系统

第一步:配置系统环境变量(按系统选择操作)

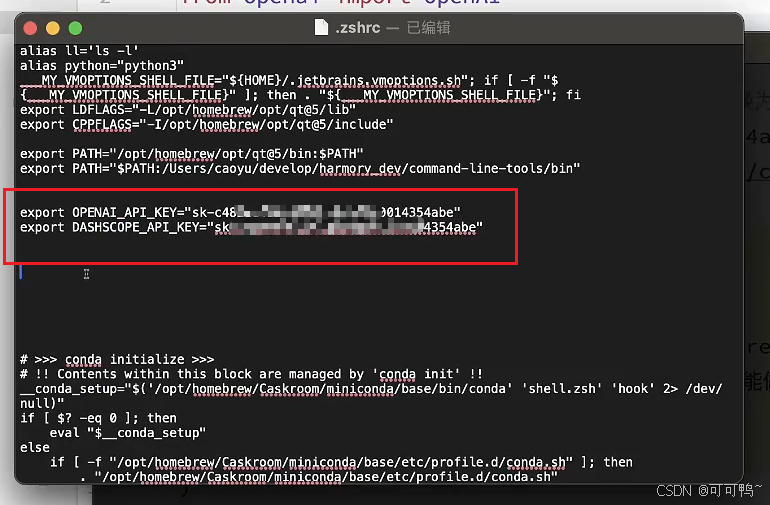

变量名:填写固定值 OPENAI_API_KEY(代码会自动读取这个名称,不能改);

变量名:填写固定值 DASHSCOPE_API_KEY(代码会自动读取这个名称,不能改);

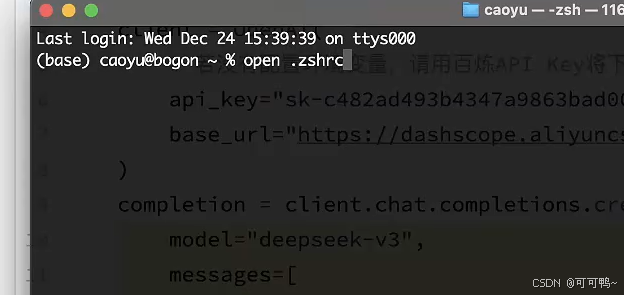

Mac 系统(修改配置文件,永久生效)

打开电脑「终端」,输入命令打开配置文件(无文件则自动创建):

open ~/.zshrc

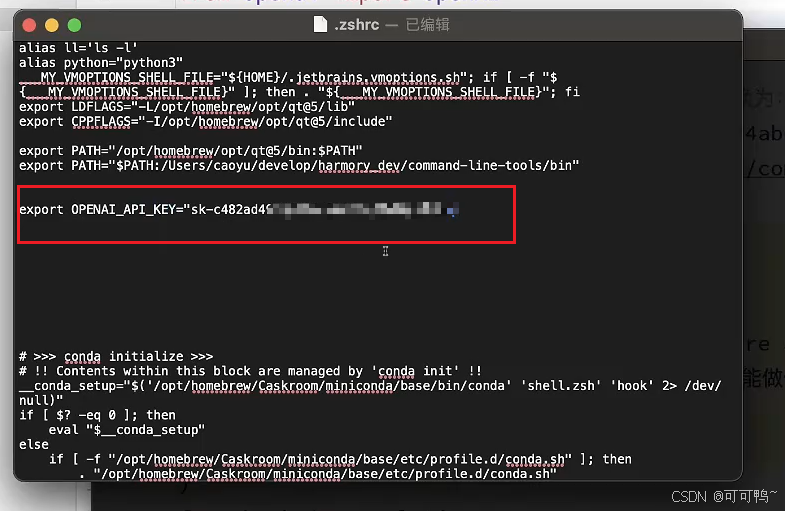

在打开的文件末尾,添加一行代码(替换为你的真实百炼 API 密钥):

export DASHSCOPE_API_KEY=你的百炼真实API密钥

保存并关闭文件,返回终端输入命令,让配置立即生效:

配置完成后,必须重启 PyCharm/VS Code 等 Python 编辑器(环境变量需重启才能被编辑器识别);若重启编辑器后仍读取失败,重启电脑即可解决。

2:config配置

核心:新建config.json文件,写入百炼真实key,代码读取该文件,步骤:

import openai

import json

# 1. 读取JSON配置(保留你的逻辑,不动)

api_key = None

try:

with open("config.json", "r", encoding="utf-8") as f:

config = json.load(f)

api_key = config["DASHSCOPE_API_KEY"]

except FileNotFoundError:

print("提示:没找到config.json文件")

exit(1)

except KeyError:

print("提示:config.json里没有DASHSCOPE_API_KEY")

exit(1)

# 2. 初始化client(保留你的逻辑,不动)

client = openai.OpenAI(

api_key=api_key,

# 如果是本地模型需要换一下地址以及模型名称

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"

)

# 3. 定义数据(保留你的逻辑,不动)

questions = [

"今日,央行发布公告宣布降低利率,以刺激经济增长,这一降息举措将影响贷款利率,并在未来几个季度内对金融市场产生影响。",

"ABC公司今日发布公告称,已成功完成对XYZ公司股权的收购交易,本次交易是ABC公司在扩大业务范围、加强市场竞争力方面的重要举措,据悉,此次收购将进一步公司资产负债表显示,公司偿债能力强劲,现金流充足,为未来投资和扩张提供了坚实的财务基础。",

"最新的分析报告指出,可再生能源行业预计将在未来几年持续增长,投资者应关注这一领域的投资机会。",

"小明喜欢小新吗?"

]

example_data = {

"新闻报道": "今日,央行发布公告称,为进一步支持实体经济发展,优化流动性结构,降低市场融资成本,决定下调金融机构存款准备金率0.5个百分点,此次降准共计释放长期资金约8000亿元,预计将对中小企业融资、房地产市场平稳运行以及消费市场复苏带来积极提振作用。",

"财务报道": "公司发布三季度财务报告,报告显示,本季度公司实现营业总收入126.8亿元,同比增长18.3%;归母净利润15.2亿元,同比增长25.7%,环比增长9.1%。其中,核心业务板块营收占比达89%,毛利率较上季度提升2.3个百分点。同时,公司公告拟以现金方式收购某细分领域龙头企业100%股权,交易对价为22.5亿元,本次收购将完善公司产业链布局,提升核心竞争力。",

"公司公告": "本公司拟实施新一轮全国性业务拓展计划,计划在未来12个月内,在华北、华南、西南三大区域新增28家线下直营门店,同时加大线上电商平台及直播渠道的投入力度,预计总投入金额约5.8亿元。本次业务拓展旨在提升公司市场覆盖率,扩大品牌影响力,为未来三年的业绩持续增长奠定坚实基础,相关资金将来源于公司自有流动资金,不会对公司当期现金流及经营状况产生重大不利影响。",

"分析师报告": "最新的行业分析报告指出,该公司在能源装备制造领域的技术储备和市场份额均处于行业领先地位,随着国内新能源产业的快速发展以及海外市场需求的持续攀升,公司未来三年的业绩预计将保持20%-30%的复合增长率。分析师建议,长期投资者可重点关注公司后续的技术迭代和海外订单落地情况,短期需留意原材料价格波动对公司毛利率的潜在影响。"

}

# 修正点1:优化System提示词(明确要求,锁定输出格式)

_messages = [

{

"role": "system",

"content": "你是金融文本分类专家,你的唯一任务是:将输入的文本分类到以下固定类别中,只能从这几个类别里选:['新闻报道','财务报道','公司公告','分析师报告']。无法明确判断时,仅返回'不清楚类别'。要求:只返回类别名称,不添加任何额外解释、不补充任何内容、不复述文本。"

}

]

# 修正点2:修正样本传递逻辑(assistant传类别k,不是文本v!关键!)

for k, v in example_data.items():

print(f"{k}: {v}")

# 第一步:用户传文本内容(v)→ 待分类的样本

_messages.append({"role": "user", "content": v})

# 第二步:助手传对应类别(k)→ 给模型的正确答案,让模型学习

_messages.append({"role": "assistant", "content": k}) # 这里把v改成k!!!

# 保留你原本的遍历questions逻辑(不动)

for q in questions:

# 关键补充:每次分类复制一份消息列表,避免冗余信息干扰(可选,但提升准确率)

current_messages = _messages.copy()

current_messages.append({"role": "user", "content": q})

response = client.chat.completions.create(

model="qwen3-max",

messages=current_messages, # 用复制后的列表

# stream=True

)

print("分类结果:", response.choices[0].message.content)

四、AOllama 本地大模型部署(纯软件安装,装完即用)

Ollama 是轻量级本地大模型部署工具,本质就是一个可一键安装的电脑软件,支持 Windows/Mac/Linux,无需 API密钥、无需网络、无需复杂配置,装完就能本地运行大模型,完美兼容前面的 OpenAI 库调用逻辑,仅需修改一个参数就能复用所有代码。

4.1 核心优势(对比百炼云端)

纯本地运行:无网络也能用,数据不泄露,适合隐私要求高的场景; 零成本使用:无调用计费、无免费额度限制,永久免费;

代码高度复用:和阿里云百炼的调用代码仅需修改base_url,无需重新学习; 一键安装部署:无需配置 Python环境、无需下载模型文件,终端命令一键搞定。

4.2 Ollama 软件下载与安装(Windows/Mac 通用,一步到位)

第一步:下载安装包

打开 Ollama官方官网,点击首页显眼的「Download」按钮,根据自己的电脑系统(Windows/Mac)下载对应安装包,官网会自动识别系统,推荐适配版本。

第二步:一键安装

双击下载的安装包,全程默认点击「下一步 / 继续」 即可,无需修改任何安装路径、无需额外配置; Mac

系统注意:若提示「无法打开,因为来自身份不明的开发者」,前往「系统设置 - 隐私与安全性」,下滑找到对应提示,点击「仍要打开」即可;

安装完成后,软件会自动在后台启动服务,无需手动操作,直接进入下一步使用。 安装验证(确认软件装成功) 打开电脑「终端 /命令提示符」,输入以下命令,若能显示 Ollama 的版本号,说明安装成功

ollama -v

安装成功之后修改代码中base_url地址即可

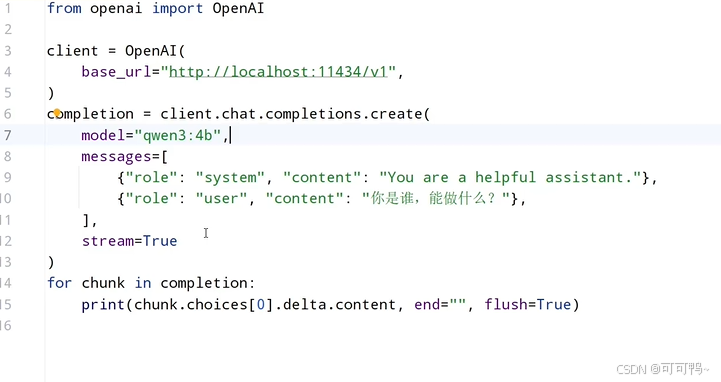

4.3常见疑问:Ollama 本地调用地址需要自己配置吗?

新手在使用 Ollama 时,常疑惑「本地调用地址需要手动查找或修改吗?」—— 答案是:Ollama 的本地调用地址是官方固定值,所有系统通用,无需手动查找、无需自定义配置,直接抄用即可。

(1)本地调用地址是固定的,直接用

OpenAI 库兼容调用的核心地址为:http://localhost:11434/v1也可替换为本地回环

IP,效果完全一致:http://127.0.0.1:11434/v1其中 11434 是 Ollama

官方默认端口,安装后会自动绑定该端口,无需任何手动设置。

(2)快速验证地址是否可用

若担心地址不通,可通过浏览器快速确认 Ollama 服务状态: 确保 Ollama 软件在后台运行(安装后默认自动启动);打开任意浏览器,在地址栏输入基础地址 http://localhost:11434(无需加最后的 /v1); 若页面显示 Ollama is running,说明地址正常、服务可用;若显示 “无法访问”,重启 Ollama 软件即可。

(3)特殊情况:端口 11434 被占用(极少发生)

若电脑中其他软件恰好占用了 11434 端口(小众工具 / 本地服务偶发),可通过以下简单方式解决: 关闭占用 11434端口的软件(通过「任务管理器 / 活动监视器」排查); 重启 Ollama 软件(关闭后重新打开,会自动重新绑定端口); 再次用浏览器验证地址,显示Ollama is running即可正常调用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)