【OpenAI】爆款干货|flux-kontext-pro深度解析:前端状态管理从入门到精通全攻略获取OpenAI API KEY的两种方式,开发者必看全方面教程!

作为一名前端开发者,我曾经也被状态管理搞得焦头烂额。项目越大,组件越多,状态传递越复杂,props层层传递让代码臃肿不堪。那时,我尝试了各种方案,最终发现flux-kontext-pro不仅解决了我的痛点,还极大提升了开发效率。今天,我将结合实际项目经验,带你全面了解flux-kontext-pro的功能、原理和实战技巧,助你快速上手,写出高质量、易维护的代码。通过以上步骤,你已经掌握了如何获取和

【爆款干货】flux-kontext-pro详解:从入门到精通,带你玩转前端状态管理神器!

你是否在大型前端项目中,因状态管理混乱而头疼?

你是否想找到一款既高效又灵活的状态管理方案?

今天,我将带你深度揭秘flux-kontext-pro,这款基于Flux架构的状态管理利器,帮你轻松搞定复杂数据流和跨组件通信难题!🔥

前言:为什么选择flux-kontext-pro?

作为一名前端开发者,我曾经也被状态管理搞得焦头烂额。项目越大,组件越多,状态传递越复杂,props层层传递让代码臃肿不堪。那时,我尝试了各种方案,最终发现flux-kontext-pro不仅解决了我的痛点,还极大提升了开发效率。

今天,我将结合实际项目经验,带你全面了解flux-kontext-pro的功能、原理和实战技巧,助你快速上手,写出高质量、易维护的代码。

目录

- 一、flux-kontext-pro是什么?

- 二、核心功能深度解析

- 三、flux-kontext-pro工作原理详解

- 四、实战教程:从零开始搭建flux-kontext-pro项目

- 五、常见问题及优化技巧

- 六、总结与未来展望

一、flux-kontext-pro是什么?

flux-kontext-pro是一款基于Flux架构设计的前端状态管理和上下文处理库。它通过集中式Store管理全局状态,结合React等框架的Context机制,实现跨组件树的状态共享和单向数据流,极大简化了复杂应用中的状态管理难题。

小故事:

在我参与的一个电商项目中,订单状态、用户信息、购物车数据分散在多个组件,导致状态同步混乱。引入flux-kontext-pro后,所有状态集中管理,组件只需订阅对应Store,代码清晰且易维护,团队协作效率提升了50%!

二、核心功能深度解析

1. 全局状态集中管理

-

为什么重要?

避免状态分散,减少数据不一致风险。 -

flux-kontext-pro如何实现?

通过Store集中管理状态,所有状态变更都通过Action触发,保证数据流单向且可追踪。

2. 跨组件上下文传递

- 利用React Context,避免props逐层传递的繁琐,提升组件复用性。

3. 单向数据流设计

- 保证数据流动方向一致,方便调试和维护。

4. 异步操作支持

- 内置对异步Action的支持,轻松处理API请求、定时任务等复杂异步逻辑。

5. 模块化拆分

- 支持将状态和逻辑拆分为多个模块,方便团队协作和代码复用。

6. 中间件机制

- 支持日志记录、错误捕获、性能监控等中间件扩展,提升开发体验。

三、flux-kontext-pro工作原理详解

flux-kontext-pro基于Flux架构,核心流程如下:

| 流程步骤 | 说明 |

|---|---|

| Action | 用户操作或系统事件触发,描述“发生了什么” |

| Dispatcher | 接收Action并分发给对应Store |

| Store | 根据Action更新状态,管理业务逻辑 |

| View | 监听Store变化,自动刷新UI |

| Context | 通过Context注入状态和方法,实现跨组件访问 |

| 异步处理 | 内置异步支持,保证状态更新顺序和正确性 |

这套流程保证了数据流的单向性和可预测性,极大降低了状态管理的复杂度。

四、实战教程:从零开始搭建flux-kontext-pro项目

1. 环境准备

npm init -y

npm install react react-dom flux-kontext-pro

## 第一种方式(国外):获取 OpenAI API Key

要开始使用 OpenAI 的服务,你首先需要获取一个 API Key。以下是获取 API Key 的详细步骤:

### 1. 访问 OpenAI

在浏览器中点击 [OpenAI ](https://www.openai.com)。

### 2. 创建账户

- 点击网站右上角的“**Sign Up**”或者选择“**Login**”登录已有用户。

### 3. 进入 API 管理界面

- 登录后,导航到“**API Keys**”部分。

### 4. 生成新的 API Key

- 在 API Keys 页面,点击“**Create new key**”按钮,按照提示完成 API Key 的创建。

> **注意**:创建 API Key 后,务必将其保存在安全的地方,避免泄露。🔒

## 使用 OpenAI API

现在你已经拥有了 API Key 并完成了充值,接下来是如何在你的项目中使用 GPT-4.0 API。以下是一个简单的 Python 示例,展示如何调用 API 生成文本:

```python

import openai

import os

# 设置 API Key

openai.api_key = os.getenv("OPENAI_API_KEY")

# 调用 GPT-4.0 API

response = openai.Completion.create(

model="gpt-4.0-turbo",

prompt="鲁迅与周树人的关系。",

max_tokens=100

)

# 打印响应内容

print(response.choices[0].text.strip())

代码解析

- 导入库:首先导入必要的库。

- 设置 API Key:通过环境变量设置 API Key。

- 调用 API:发送一个包含问题的请求到 GPT-4.0 模型。

- 打印响应:打印出模型生成的答案。

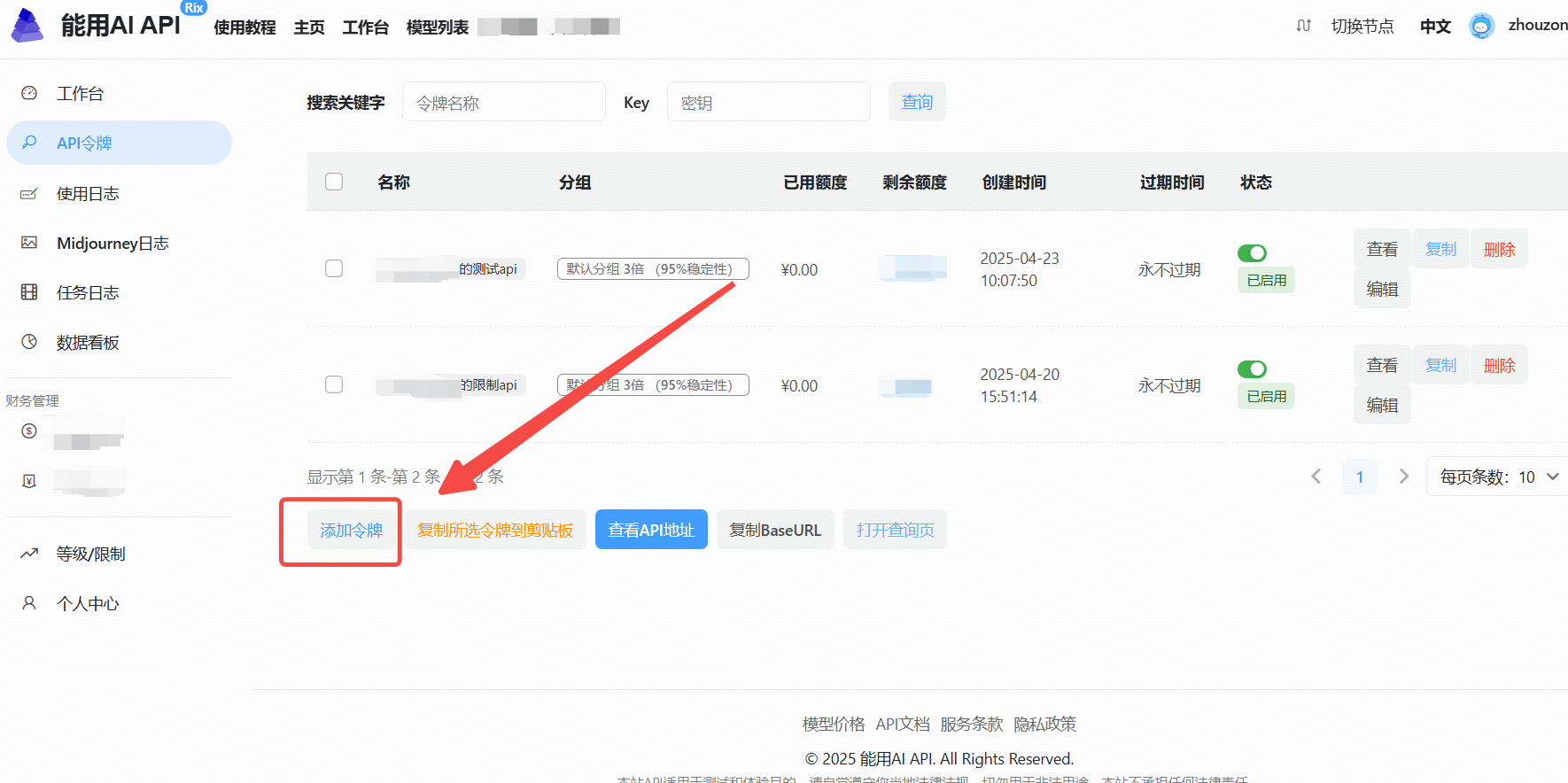

第二种方式(国内):获取 能用AI API Key

要开始使用 能用AI 的服务,以下是获取 API Key 的详细步骤:

1. 点击 [能用AI 工具]

在浏览器中打开 能用AI 工具。

2. . 进入 API 管理界面

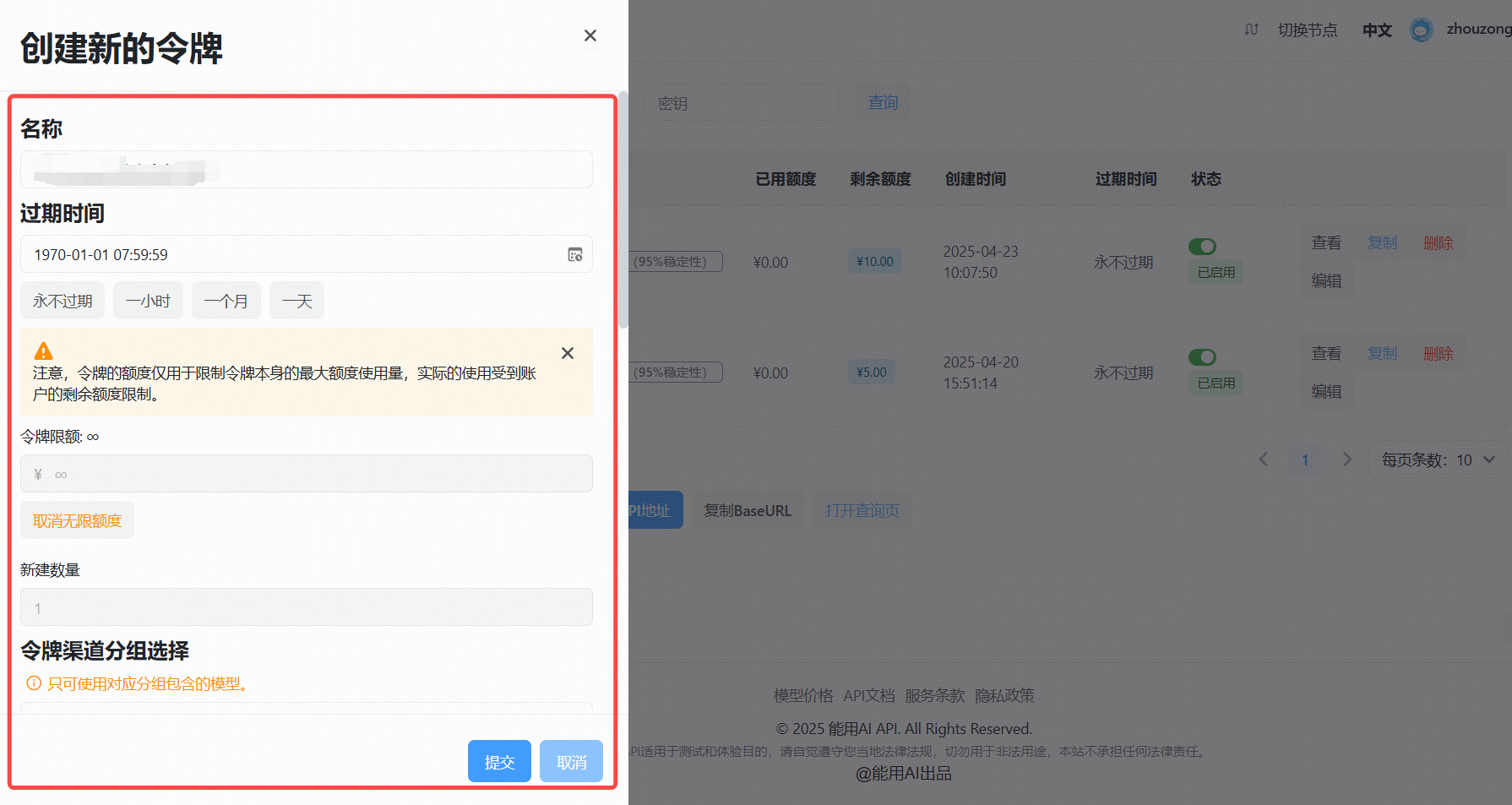

3. 生成新的 API Key

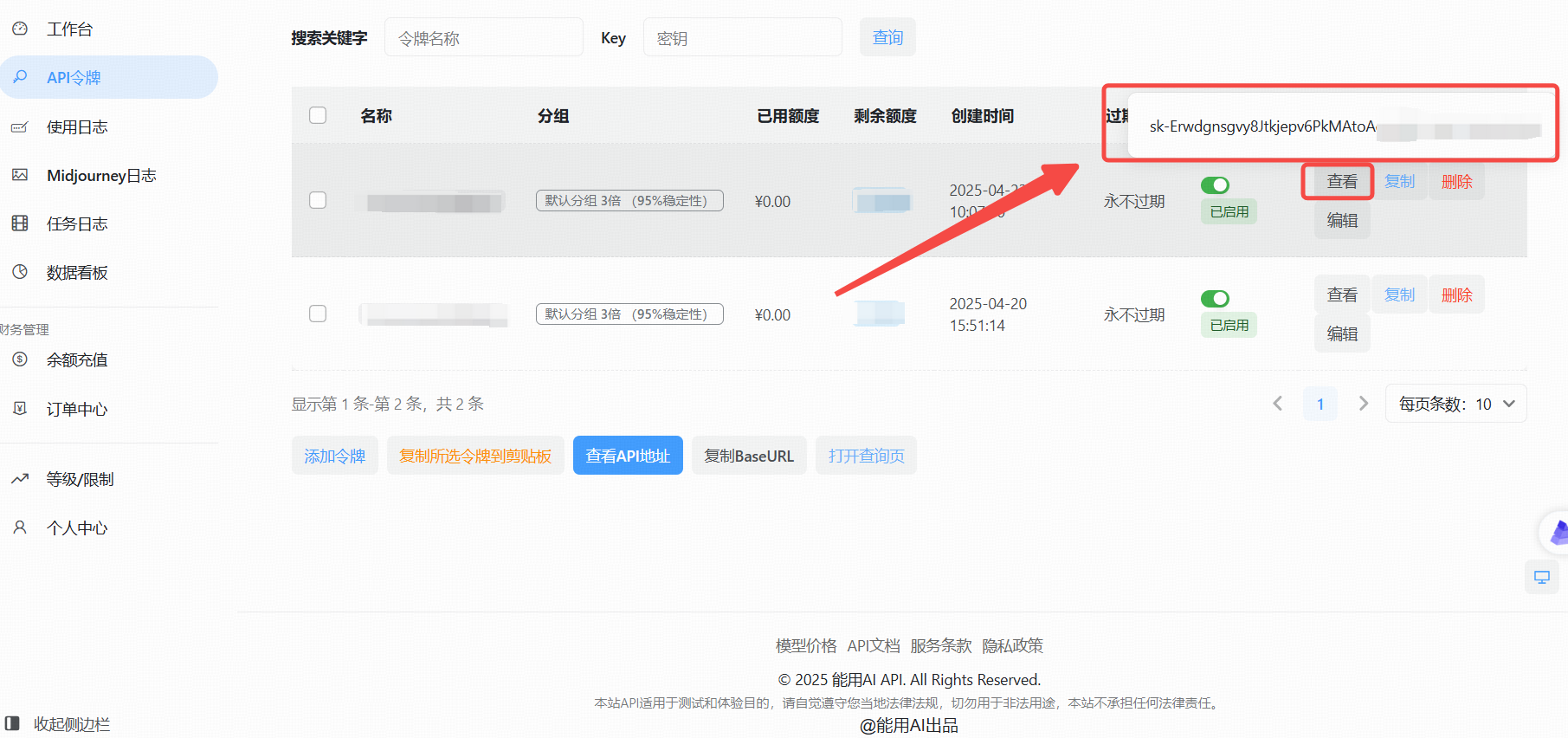

创建成功后点击“查看KEY”

4. 调用代码使用 能用AI API

# [调用API:具体模型大全](https://flowus.cn/codemoss/share/42cfc0d9-b571-465d-8fe2-18eb4b6bc852)

from openai import OpenAI

client = OpenAI(

api_key="这里是能用AI的api_key",

base_url="https://ai.nengyongai.cn/v1"

)

response = client.chat.completions.create(

messages=[

{'role': 'user', 'content': "鲁迅为什么打周树人?"},

],

model='gpt-4',

stream=True

)

for chunk in response:

print(chunk.choices[0].delta.content, end="", flush=True)

总结

通过以上步骤,你已经掌握了如何获取和使用 OpenAI API Key 的基本流程。无论你是开发者还是技术爱好者,掌握这些技能都将为你的项目增添无限可能!🌟

更多推荐

已为社区贡献67条内容

已为社区贡献67条内容

所有评论(0)