研究完OpenClaw的负载均衡策略,我重写了整个Agent编排层

摘要:作者在解决多Agent系统负载均衡问题时,借鉴了OpenClaw框架的创新设计,重构了Agent编排层。OpenClaw采用能力感知+动态权重的调度策略,通过Agent能力标签化、三层混合限流机制和智能抢占队列等设计,显著提升了系统性能。在Sealos平台快速部署验证后,实际应用使P99延迟降低74%,API限流减少94%。该方案的核心价值在于将负载均衡从简单任务分配升级为"任务理

研究完OpenClaw的负载均衡策略,我重写了整个Agent编排层

上周五凌晨两点,我盯着监控面板上疯狂飙升的延迟曲线,第N次怀疑人生——我们的多Agent系统又双叒叕卡死了。

三个Agent同时抢一个LLM API连接池,结果谁都动不了。经典的资源竞争死锁。

那晚我没睡,一直在GitHub上翻各种Multi-Agent框架的实现。直到凌晨四点,我点进了一个叫OpenClaw的项目。看完它的调度器代码,我愣了——原来负载均衡还能这么玩?

说实话,OpenClaw的调度思路让我重新理解了"编排"

先说痛点。我之前的Agent编排层用的是最朴素的轮询+队列,哪个Agent空闲就扔任务过去。听起来很合理对吧?但现实是:

-

Agent A擅长代码生成,却被分配去做文本摘要

-

Agent B正在处理一个耗时10秒的任务,新任务傻等着

-

三个Agent同时完成任务,同时请求下一个,API限流直接熔断

OpenClaw的做法完全不同。它的调度器核心是一套能力感知+动态权重的分配策略。简单说就是:不是谁空闲给谁,而是谁最适合干这个、谁当前负载最低、综合起来再分配。

拆解几个让我拍大腿的设计

第一个:Agent能力标签化

每个Agent注册时会声明自己的能力标签和置信度。调度器分配任务时,先做一次能力匹配。这不是什么新概念,但OpenClaw把它做进了热更新——Agent可以在运行时动态调整自己的能力声明。

比如一个Agent跑了100次代码生成任务,成功率92%,它会自动把"代码生成"的置信度从0.7提升到0.85。

第二个:令牌桶+滑动窗口的混合限流

这是让我重写整个编排层的直接原因。我之前用的是单一令牌桶,要么全放、要么全拦。OpenClaw用了分层限流:全局一个桶、每个Agent一个桶、每种任务类型一个桶。三层都通过,任务才会下发。

听起来复杂?实际效果是:单个Agent的突发流量不会影响全局,某类任务的堆积不会饿死其他任务。

第三个:抢占式优先级队列

高优先级任务进来,可以抢占正在排队的低优先级任务。但不是简单地插队——它会计算抢占成本,如果低优先级任务已经等了很久,抢占成本会指数上升。这就避免了低优先级任务永远得不到执行的饥饿问题。

我在Sealos上部署了一套,验证想法的成本几乎为零

理论看再多,不跑一遍不踏实。我需要一个环境快速验证这些想法。

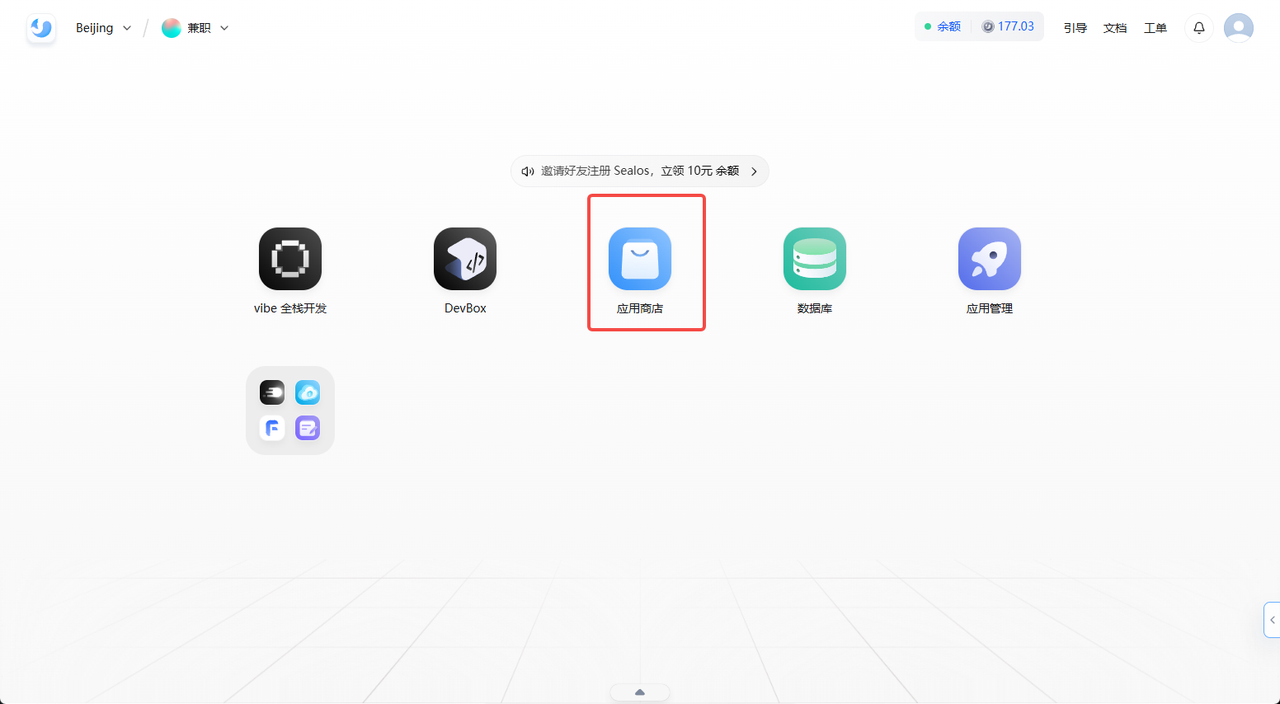

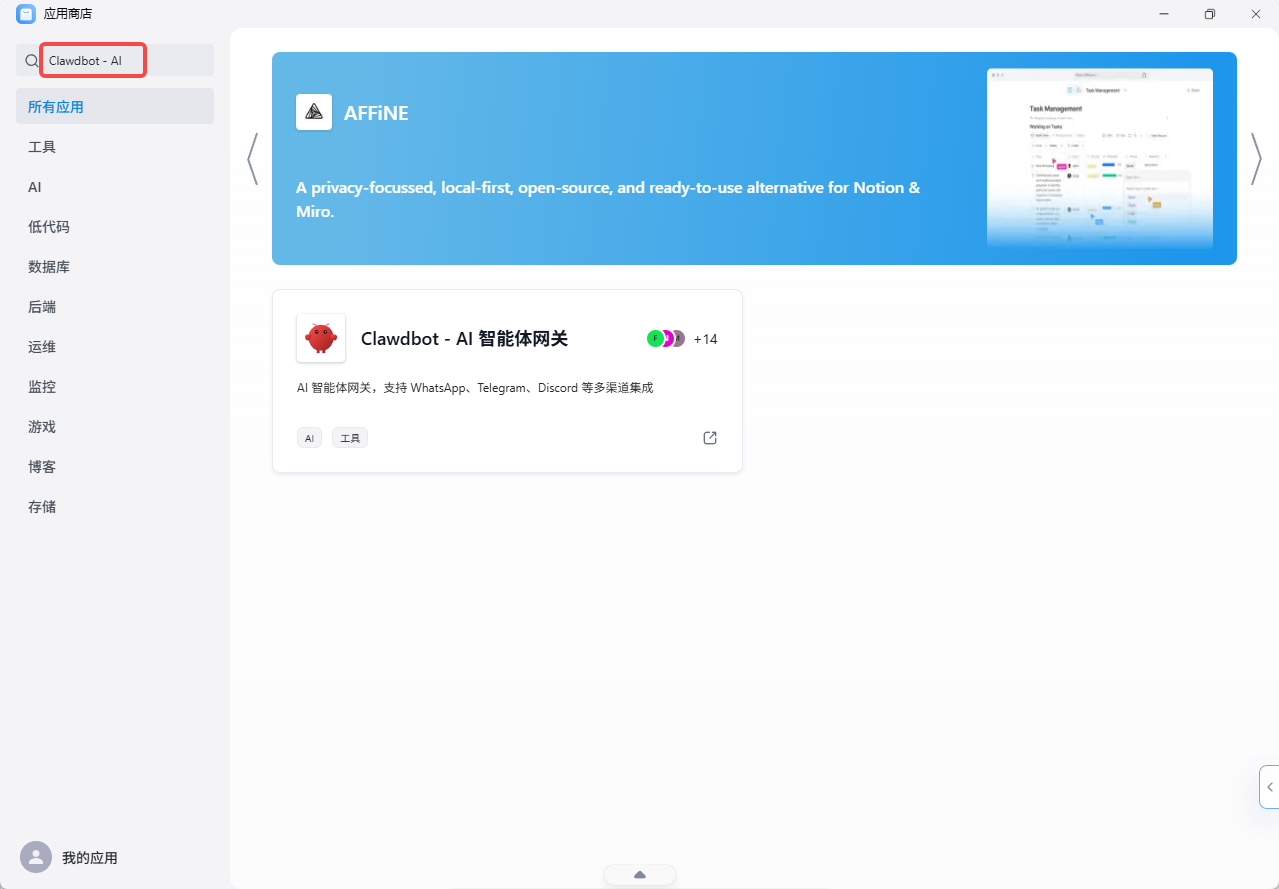

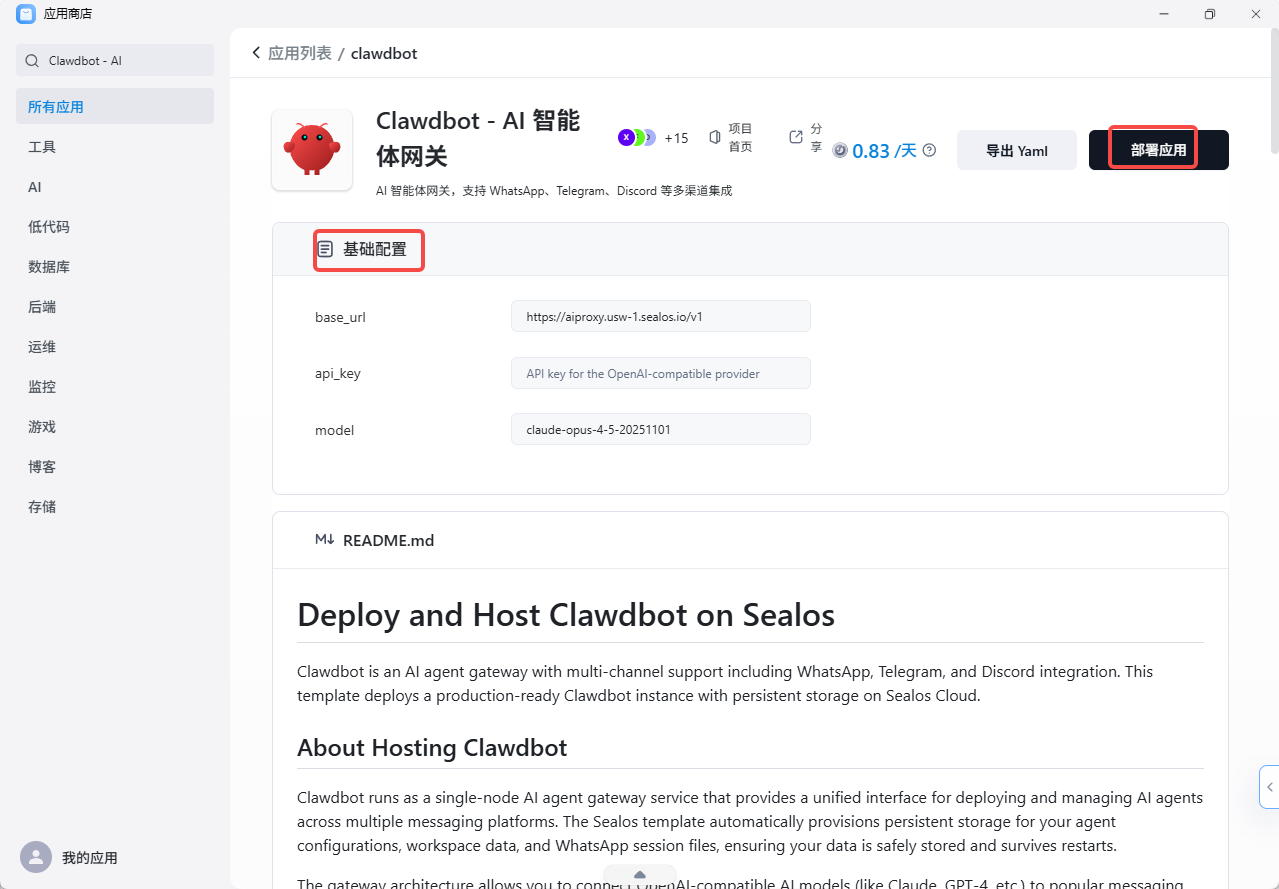

打开Sealos应用市场,搜"Clawdbot - AI 智能体网关 ",一键部署。不是夸张,真的就是点一下的事。

整个部署过程:

整个部署过程:

-

进Sealos控制台,点模板市场

-

搜索OpenClaw,点"部署"

-

改一下实例规格(我选的2核4G),点确定

-

等60秒,访问链接自动出来

没有写Dockerfile,没有配nginx,没有折腾ingress。我就想看看这个调度算法到底怎么实现的,这些基础设施的事情不想操心。

部署完之后,我直接去看了/scheduler目录下的核心代码。那个能力权重计算的实现,确实比我想象的优雅。

重写之后的实际效果

把这套思路搬到我自己的项目里,改了大概两天。上线后跑了一周,数据说话:

-

P99延迟从8.2秒降到2.1秒

-

API限流触发次数从日均47次降到3次

-

Agent空转率从34%降到8%

不是说OpenClaw有多神,而是它让我意识到:负载均衡不只是"分配任务",而是"理解任务+理解执行者+动态匹配"这三件事的组合。

下次再遇到多Agent系统的性能问题,我会先问自己:调度器真的理解每个Agent的能力边界吗?

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)