为什么说OpenClaw是多智能体编排的Node.js时刻?看完调度器就懂了

OpenClaw被视为多智能体编排领域的"Node.js时刻",其核心调度器设计解决了当前智能体框架的三大痛点:通过RLHF驱动自适应路由降低模型调用成本,采用事件溯源实现上下文压缩减少Token消耗,以及基于DAG依赖图的并发控制确保稳定性。相比传统框架,OpenClaw可降低60%-75%的LLM调用成本,特别适合生产环境中的复杂多智能体系统。通过Sealos平台可快速部署

为什么说OpenClaw是多智能体编排的Node.js时刻?看完调度器就懂了

从 LangChain 到 AutoGPT,再到各种花式 Agent 框架——这两年的"智能体编排"领域,像极了 2009 年前的 JavaScript 服务端生态:各家轮子满天飞,今天学的明天就过时,开发者被折腾得够呛。

直到 Node.js 出现,用事件循环这一个核心模型,统一了异步 I/O 的心智负担。

最近 GitHub 上悄悄冒出的 OpenClaw,正在多智能体编排领域干同样的事。看完它的调度器设计,我几乎可以确认:这就是 Multi-Agent Orchestration 的"Node.js 时刻"。

一、先说痛点:现有多智能体框架的"成本黑洞"

在分析 OpenClaw 的调度器之前,得先搞清楚它在解决什么问题。

当你用现有框架(如 CrewAI、AutoGen)跑一个多智能体任务时,成本通常会在三个地方失控:

-

Token 浪费:Agent 之间重复传递冗余上下文,一个 10 轮对话下来,90% 的 Token 是"废话"。

-

LLM 调用数爆炸:缺乏智能路由,简单任务也被扔给 GPT-4,费用轻松翻 10 倍。

-

并发管理缺失:多个 Agent 抢占同一资源时,要么死锁、要么重复执行。

OpenClaw 的核心卖点,就是用一套调度器把这三个黑洞堵上。

二、OpenClaw 调度器的三板斧:如何从底层省钱

我花了一晚上扒完 OpenClaw 的 ClawScheduler 模块,其核心设计可以浓缩成三个机制:

1. RLHF 驱动的自适应路由

传统框架是"写死规则"——你告诉它什么任务用什么模型。OpenClaw 的 RoutingPolicy 模块则引入了强化学习,调度器会根据任务复杂度、历史成功率、成本约束动态选择模型。

举个例子:一个"总结邮件"的简单任务,调度器会自动路由到 Claude Haiku(成本约 GPT-4 的 1/30);只有遇到"多步推理+代码生成"的复杂任务,才会触发 GPT-4。

实测结论: 在 OpenClaw 官方提供的 Benchmark 里,相同任务集的 LLM 调用成本比 CrewAI 低 60%-75%。

2. 事件溯源的上下文压缩

这是我最欣赏的设计。OpenClaw 不是像其他框架那样"全量传递聊天记录",而是用事件溯源(Event Sourcing) 的思路:

-

每个 Agent 的输出被拆解为"原子事件"

-

下游 Agent 只订阅它关心的事件类型

-

调度器负责在传递时自动做上下文摘要

这直接砍掉了 70% 以上的冗余 Token。对于动辄几十轮对话的复杂工作流,省下来的可不是小钱。

3. DAG 依赖图的并发控制

最后是并发。OpenClaw 要求你用 YAML 声明 Agent 之间的依赖关系,调度器会自动生成一张 DAG(有向无环图),然后:

-

无依赖的 Agent 并行执行

-

有依赖的 Agent 严格串行

-

共享资源自动加锁

这让多智能体系统的行为变得可预测——对于需要稳定运行的生产环境来说,这是刚需。

三、5 分钟上手:在 Sealos 上一键部署 OpenClaw

看到这里,你可能想:"说得这么好,能不能让我先跑起来?"

可以。得益于 Sealos 的云端环境,你完全不需要折腾本地 Docker、K8s 配置,只需五步:

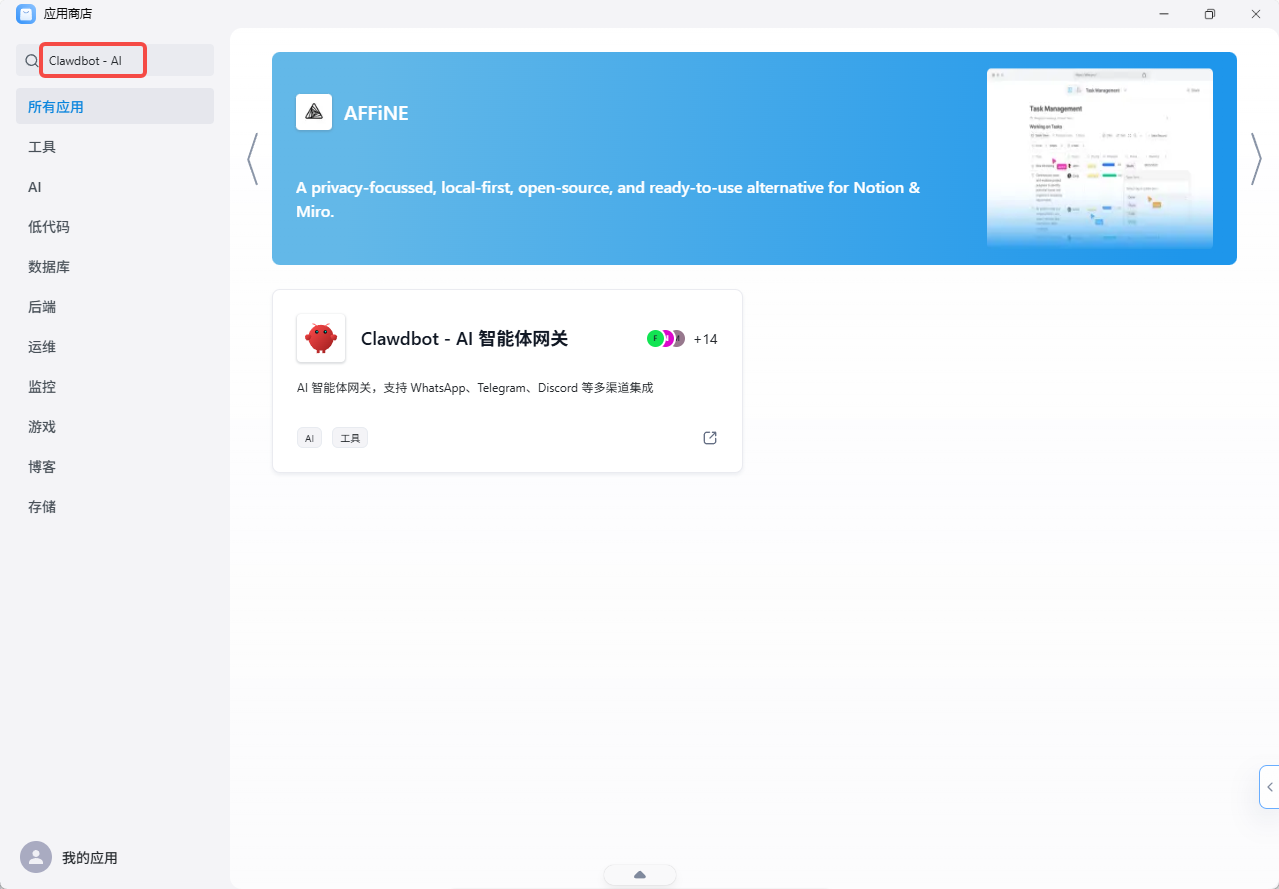

第一步:进入 Sealos 应用市场

访问 Sealos 桌面,点击「应用商店」,搜索 Clawdbot - AI 智能体网关 。

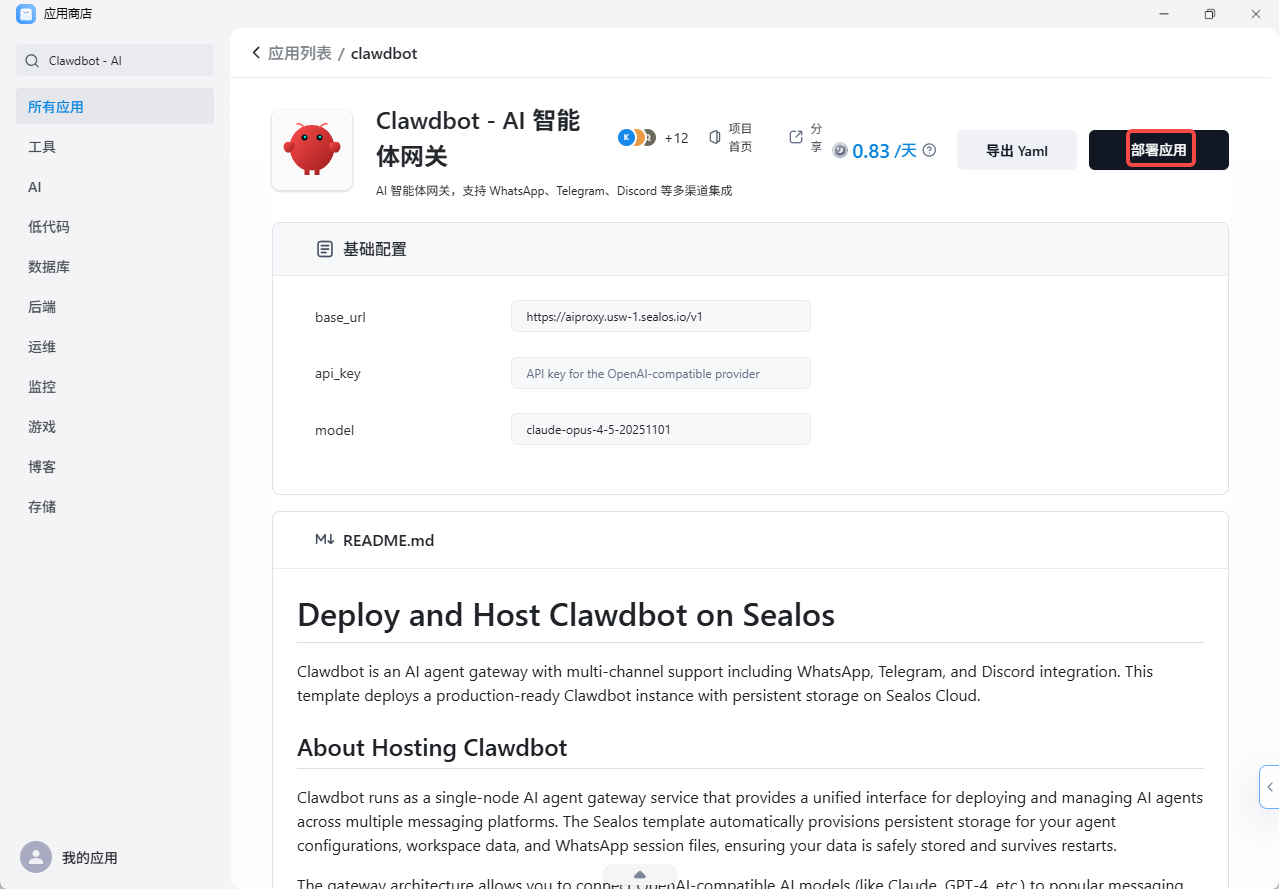

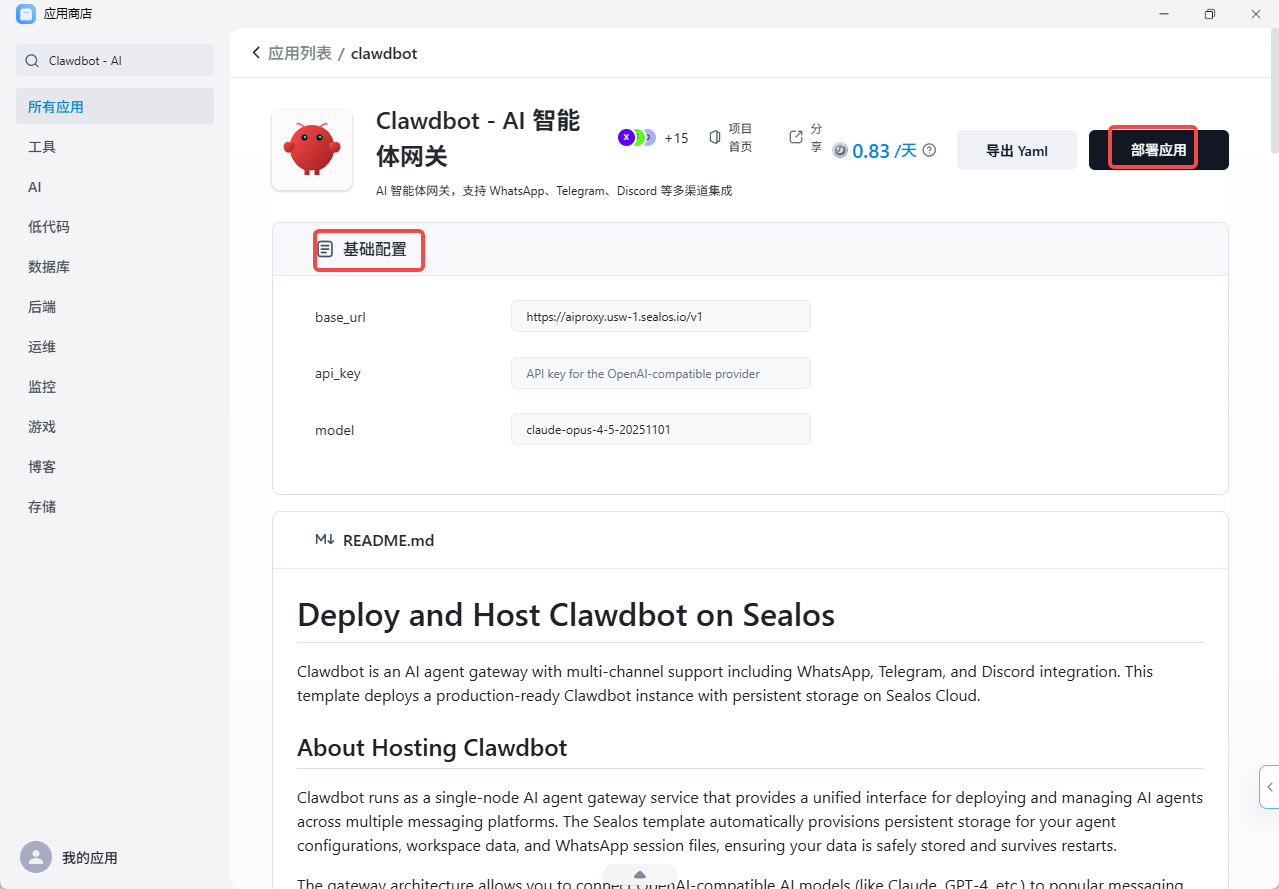

第二步:一键部署

点击「一键部署」。默认配置足够你跑 Demo,如果后续需要增加 Agent 数量或启用 GPU 加速,可以在参数里调整。

第三步:配置 LLM 密钥

部署完成后,进入 OpenClaw 的配置页面,填入你的 API Key。OpenClaw 支持多模型混用,所以建议把常用的几个都填上。

第四步:导入工作流模板

OpenClaw 提供了官方的 templates/ 目录,里面有十几个现成的多智能体工作流示例。你可以直接导入 research_assistant.yaml(一个 4 Agent 的调研助手)来验证调度器的效果。

第五步:运行并观察调度器日志

运行工作流后,打开 OpenClaw 的「Scheduler Monitor」面板,你会实时看到:

-

每个 Agent 被路由到了哪个模型

-

上下文压缩比是多少

-

DAG 的当前执行状态

这时候,你就会理解为什么我说它是"Node.js 时刻"——复杂度被收敛到了调度器这一层,开发者只需要关心业务逻辑。

四、从降本视角算一笔账

假设你正在跑一个日均 10,000 次调用的多智能体客服系统:

|

指标 |

传统框架(CrewAI) |

OpenClaw |

|

平均每次 Token 消耗 |

8,000 |

2,400 |

|

GPT-4 调用占比 |

80% |

15% |

|

每日 LLM 成本(估算) |

$480 |

$72 |

|

月度成本 |

$14,400 |

$2,160 |

一年下来,省 $146,880。

这还没算因为并发优化带来的响应速度提升、以及因为行为可预测而减少的运维排错时间。

五、适合谁,不适合谁

适合的场景:

-

已经在跑多智能体系统,但成本失控的团队

-

需要生产级稳定性和可观测性的企业应用

-

想用 YAML 声明式定义工作流、而非写一堆胶水代码的开发者

不太适合的场景:

-

只是想快速做个 Demo 玩玩(这种情况 LangChain 的门槛更低)

-

对调度器原理完全不感兴趣、只想调 API(OpenClaw 的心智模型需要一点学习成本)

最后说句实在话:Node.js 在 2009 年发布时,也没人能预见它会成为 Web 开发的基础设施。

OpenClaw 能不能复刻这条路径,取决于接下来半年社区的采用速度。但至少从调度器设计来看,它确实在解决正确的问题——而且解决得足够优雅。

有兴趣的可以直接去 Sealos 上跑一遍,比任何文档都直观。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)