【建议收藏】告别大模型“胡说八道“:RAG技术全面解析,程序员必备!

大语言模型存在"幻觉"问题,即生成看似合理但错误或过时的回答。RAG(检索增强生成)技术通过引入外部知识库,无需修改模型参数即可提高生成质量、避免灾难性遗忘。RAG系统由知识库、检索器和生成器组成,相比全量微调,RAG具有灵活性高、成本低、时效性强等优势,特别适合需要快速集成新知识的场景,已成为解决大模型幻觉问题的重要技术手段。

想象一下,如果你问AI一个最新的问题,,它却因为“没学过”而张口胡说怎么办?这时候我们可能会想到打开联网搜索,让AI去寻找网络上的相关知识。

大语言模型(Large Language Models,LLMs)得益于海量的训练数据及超大参数量的深度神经网络,将知识储存在其参数中,7B左右的LLM表现出来的涌现能力(Emergent Abilities),比如初步的链式推理能力,零样本学习能力,初步的指令理解能力等,带有这些能力的LLM为社会生产实践注入了巨大的应用可能性。

但是,大语言模型存在不可忽视的问题,通常LLM对于自己的回答过于自信,而对于它们不知道的知识回答“I don’t know”的能力不足,比如它们给出的回答中数据是错误的,但是LLM仍然写道“根据最新的统计数据”。尤其是在特定领域或知识密集型任务中,特别是在处理超出其训练数据或需要当前信息的查询时,会产生 “幻觉(hallucination)”,即生成看似合理实则逻辑混乱或违背事实的回答。

一方面是训练数据导致的幻觉,截止到某个时间点的训练数据导致知识过时的问题,同时无法覆盖世间所有知识,存在知识边界,训练数据还可能存在不实与偏见信息,这将导致知识偏差问题,它的回答可能比现实情况更加激进。另一方面是模型自身导致的幻觉,即使训练数据中已经包含了相关知识,但是LLM仍然出现幻觉现象,造成这一问题可能的因素有:知识长尾,训练数据中部分信息的出现频率较低,导致模型对这些知识的学习程度较差;曝光偏差,模型训练与推理任务存在差异,导致模型在实际推理时存在偏差;对齐不当,在模型与人类偏好对齐阶段中,偏好数据标注不当可能引入了不良偏好;解码偏差,模型解码策略中的随机因素可能影响输出的准确性。

幻觉问题极大地影响了大语言模型的生成质量。像人类解决问题一样,LLM也可以查找相关信息帮助回答。

一、RAG的定义

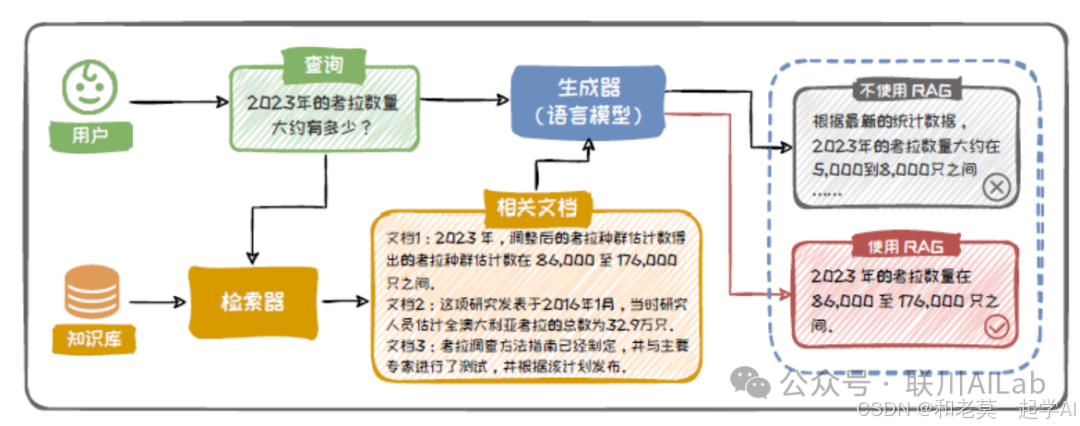

从外部知识库(Corpus)中检索出相关信息来辅助改善大语言模型生成质量的系统被称之为检索增强生成(Retrieval-Augmented Generation,RAG),是抑制幻觉的有效机制。外部知识库与LLM储存在参数中的知识相对,一个被称为参数化记忆,另一个被非参数化记忆。RAG系统的基本架构由外部知识库(Corpus)、信息检索器(Retriever)、生成器(Generator)组成,其系统链路大致如下:

图1. RAG系统链路图

针对用户提出的查询问题,做查询增强,可以做同义改写、多视角分解等语义增强,也可以做生成背景文档的内容增强。事先定义好的外部知识库为查询提供“抓手”,当前用户提出的查询作为“钩子”,实现查询与相关文档的抓取。

RAG 的核心优势在于不需要对大语言模型的内部知识进行更新,便可改善大语言模型的幻觉现象,提高生成质量。这可以有效避免内部知识更新带来的计算成本和对旧知识的灾难性遗忘(Catastrophic Forgetting)。此外,在知识时效性、领域适应性、生成内容的可解释性、灵活性与扩展性、生成的精准性上都表现出技术优势。

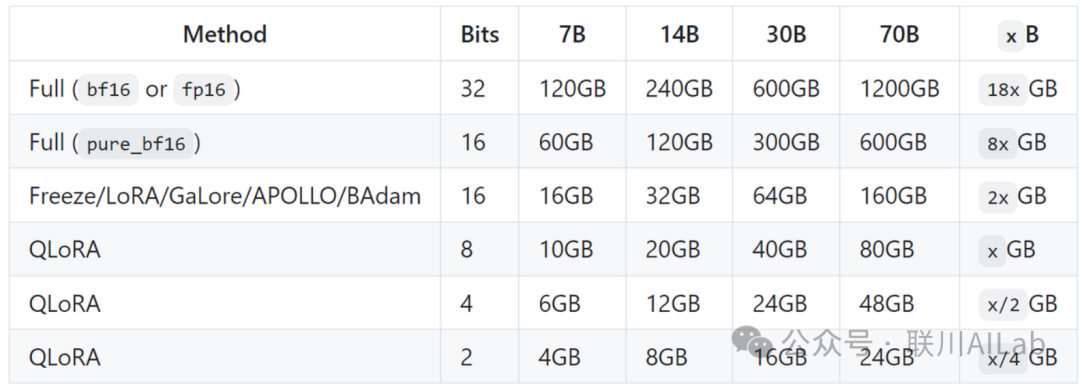

全量微调(Full Fine-Tuning,FFT)或参数高效微调(Parameter-Efficient Fine-Tuning,PEFT)通常可以让大语言模型更好地学习和掌握新的知识体系,尤其适用于各类垂直领域(如医疗、法律、金融等)的定制化任务。这些方法能够有效提升模型在特定任务或特定领域的表现,实现知识的“内化”。但是这种方法局限性也比较明显,体现在资源消耗、知识更新的灵活性、灾难性遗忘风险、运维和管理复杂性上。不同领域、不同任务可能需要维护多个微调模型,增加了系统的运维难度和成本。其所需的计算资源估计如下图1所示:

图2. 资源估算

计算资源估算:https://github.com/hiyouga/LLaMA-Factory?tab=readme-ov-file#supported-models

相较之下,RAG(Retrieval-Augmented Generation)则通过“外部检索+语言生成”的方式,有效绕开了上述问题:

- 无需对模型参数进行修改即可灵活集成新知识;

- 外部知识库实时可更新,具备更好的时效性和灵活性;

- 降低了算力消耗和维护成本;

- 提高了生成结果的可控性和可解释性。

因此,在需要快速集成、知识更新频繁或资源受限的场景下,RAG 往往是比微调更具性价比、更易落地的选择。

二、知识库(Corpus)

LLMs仅能处理文本输入,但现实文档包含多模态数据(文本/表格/图片/图表),结构化与半结构化文档(如PDF/Word/Excel)需要特殊解析技术。知识库的核心功能包括文档解析层和知识组织层,实现原始的知识文档到可检索单元的转变。

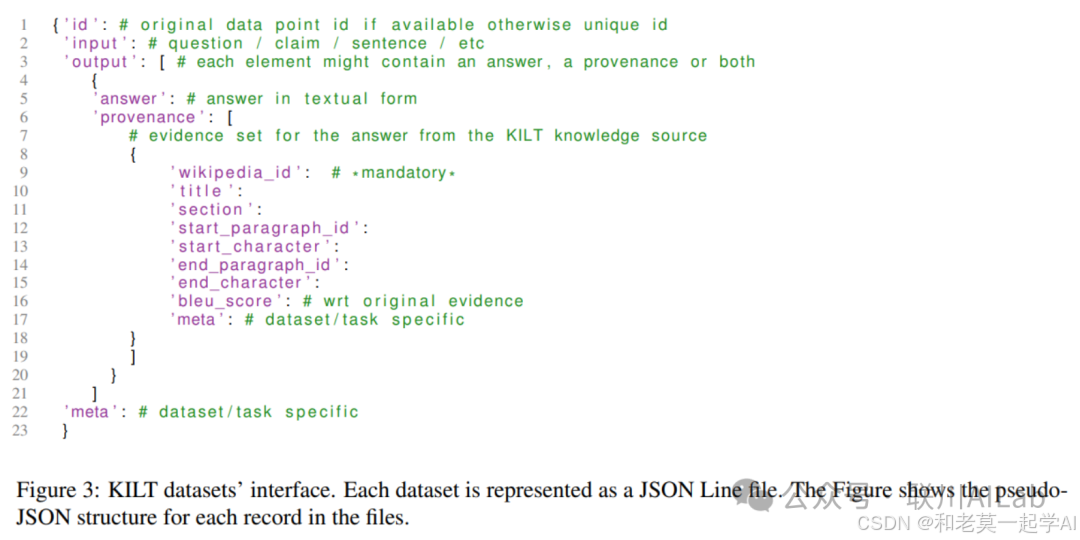

图3. KILT数据库内容

以Wikipedia语料为例,原始资料为XML格式的快照,经过清楚HTML标签、提取正文、段落分块,最后事先向量化存储。

三、检索器(Retriever)

在RAG(检索增强生成)系统中,检索器(Retriever) 扮演着"知识库导航员"的角色,专门负责在海量数据中快速锁定与问题最相关的信息片段,为大语言模型(LLM)的生成环节提供精准的辅助信息。其工作流程如下:

-

问题理解

将用户提问转化为机器可理解的查询(如向量化表示或关键词组合)。

-

知识库搜索

通过语义匹配或关键词检索,从知识库中筛选出Top-K最相关的文档段落(例如:维基百科条目、技术文档片段等)。

-

质量过滤

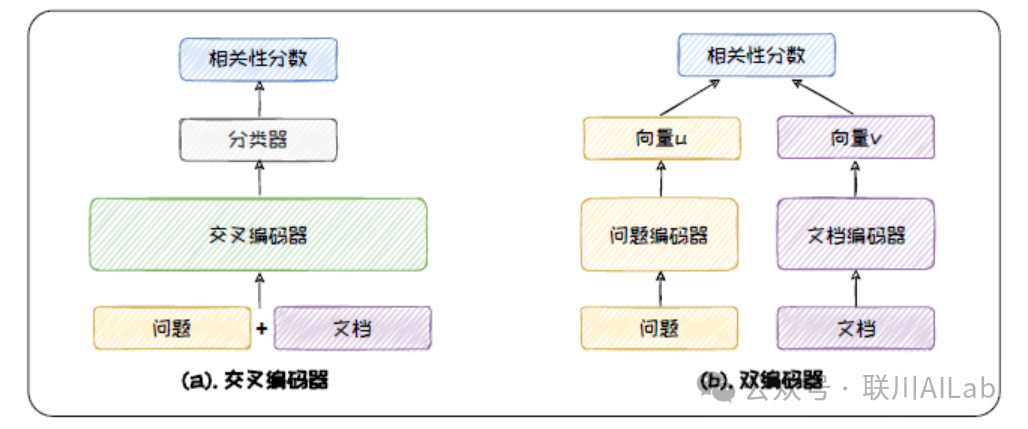

对检索结果进行相关性评分,剔除低质量或无关内容(如使用BM25/稠密向量相似度计算)。

RAG的检索器像一位图书管理员,它不会自己写书,但能瞬间从千万本书中找出你需要的那几页——这正是LLM生成可靠答案的关键保障。

图4.检索器结果示意图

四、生成器(Generator)

在RAG系统中,生成器(Generator) 是大语言模型(LLM)的核心组件,负责将检索器提供的知识转化为自然语言回答。它就像一位"知识整合专家",能够结合检索到的外部信息和自身预训练的内部知识,生成准确、流畅且符合上下文的答案。

它的核心功能有三点:

知识融合:将检索器返回的文档片段(如维基百科段落、专业资料)与用户查询结合,通过注意力机制动态加权关键信息。

上下文学习(In-Context Learning,ICL):通过Prompt设计(如Few-shot示例、思维链提示)引导模型理解任务需求。

抗幻觉设计:当检索信息与内部知识冲突时,优先依赖检索结果(需配合检索质量优化)。部分先进架构(如SELF-RAG)会引入自省标记(Reflection Tokens),动态判断是否需检索或修正生成内容。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

更多推荐

已为社区贡献485条内容

已为社区贡献485条内容

所有评论(0)