从 OpenClaw 看懂“能做事的 AI”:它到底强在哪?为什么不只是 Claude + Skills

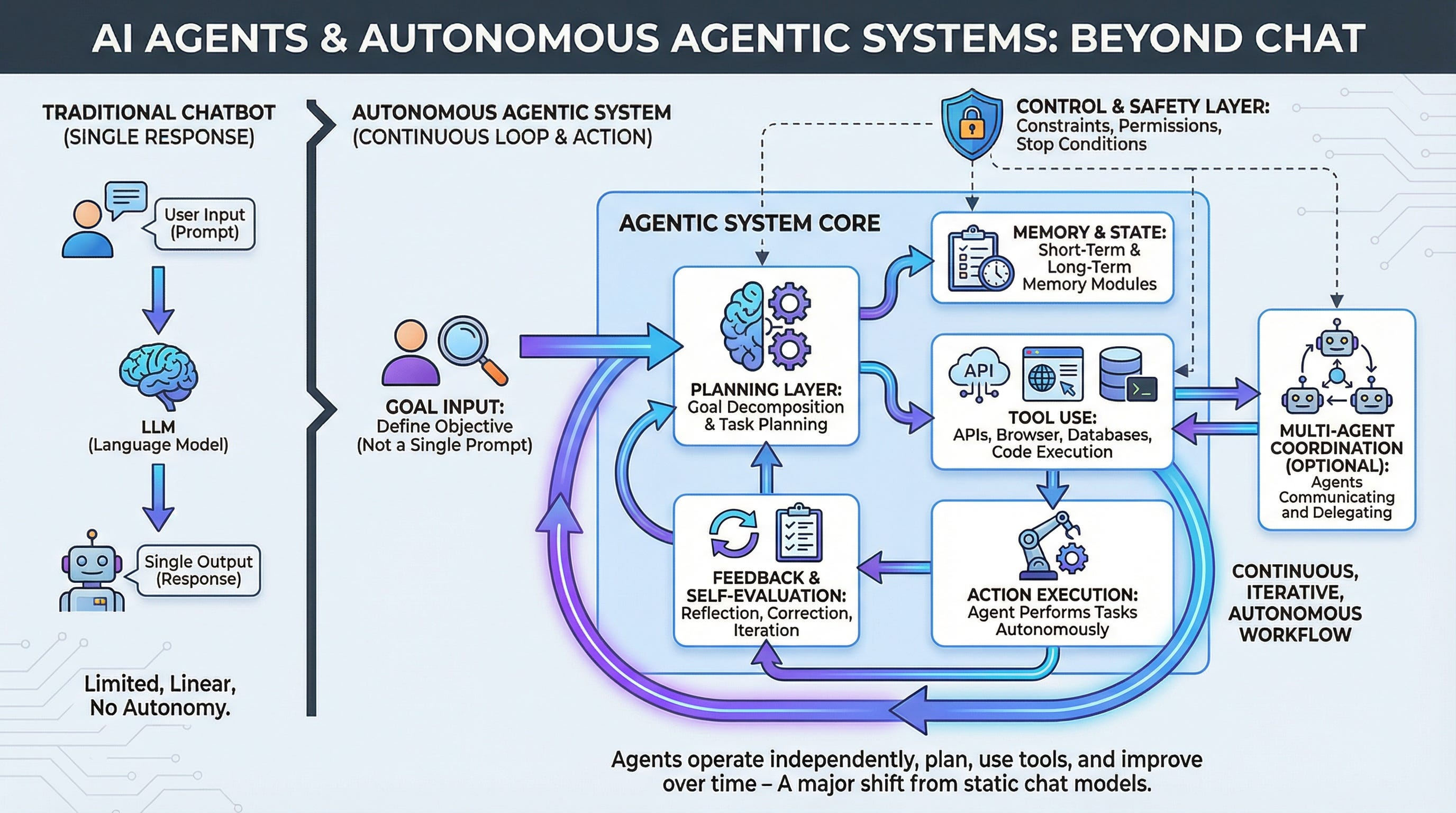

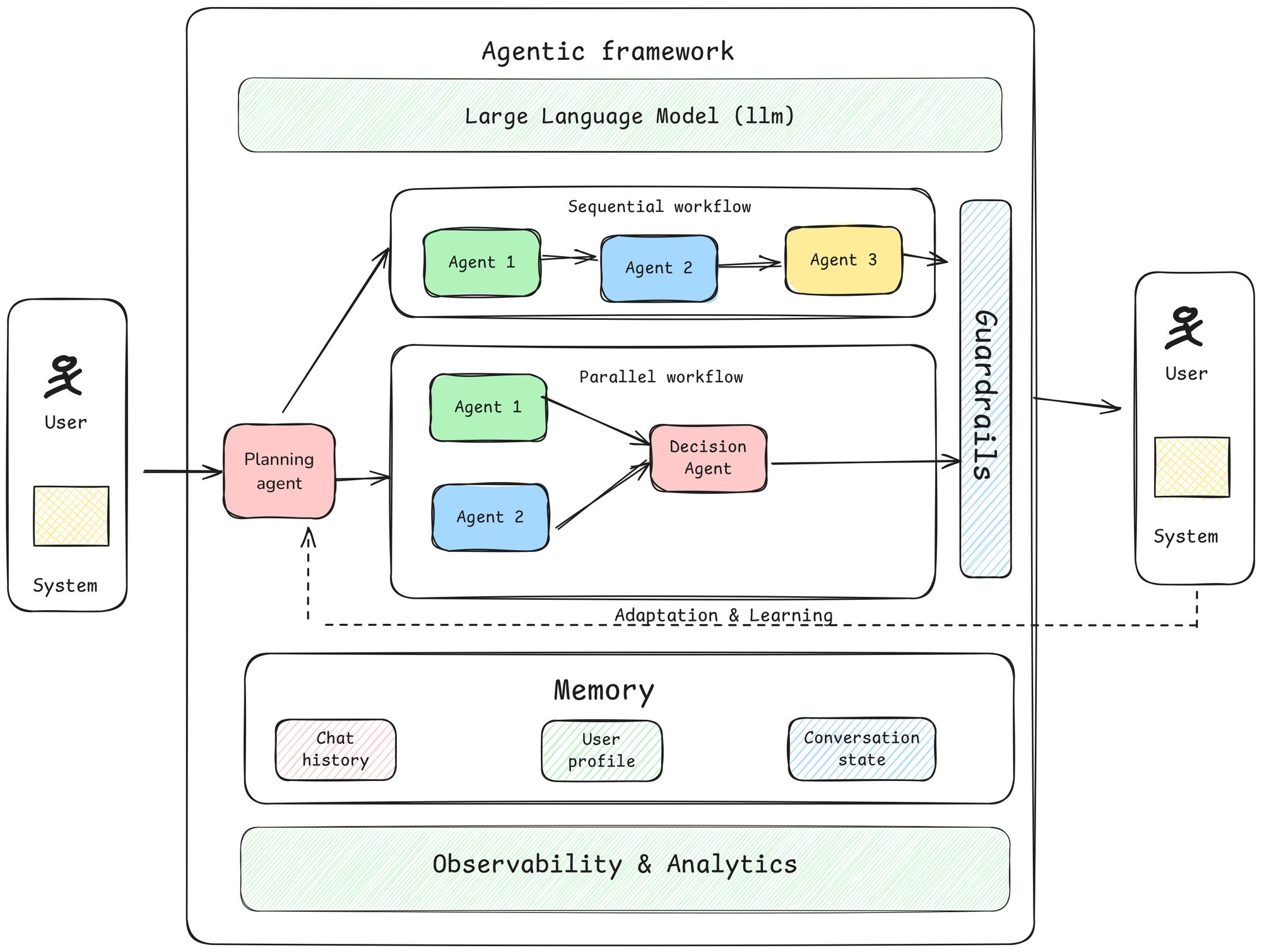

OpenClaw展示了通用Agent的基本框架,通过工具调用、任务持续性和模型决策实现了AI助理功能。然而,行业级Agentic System需要更复杂的控制机制,引入状态机来约束流程安全,形成"有边界的不确定性"。这类系统强调规则推导、状态约束、人机协作和可追溯性,本质是将智能嵌入可控系统而非单纯提升AI能力。从OpenClaw到行业级系统的演进,标志着Agent技术正从概念

从 OpenClaw 看懂“能做事的 AI”:它到底强在哪?为什么不只是 Claude + Skills

很多人第一次看到 OpenClaw,都会有一个很合理的判断:

“这不就是把 Claude 接上 Skills,再接到 Telegram/WhatsApp 里吗?”

这句话对了一半——工具调用确实是表面形态。但 OpenClaw 真正有价值的地方,不是“模型更聪明”,而是它把 AI 从“会对话”升级成了“会长期运转的系统”。当你用系统工程的视角去看,OpenClaw 其实在回答一个更现实的问题:

如何让 AI 在真实世界里持续工作、可控、不越界、可扩展?

先说 OpenClaw 是什么:它不是聊天产品,而是 Agent 的运行时

OpenClaw 的定位不是再做一个聊天窗口,而是做一个常驻的 Agent 平台:你把它跑在自己的机器上(电脑、家用服务器或 VPS 都行),它能接入你日常使用的聊天渠道,让“同一个助手”出现在你已经在用的入口里。

这看起来像体验层的变化,但本质是系统形态的变化:

- 它不是一次对话的临时智能,而是一个长期运行的进程

- 它不是只回答问题,而是可以组织任务、执行动作、跨会话持续

- 它不是把能力写进 prompt,而是通过插件/skills 扩展能力边界

- 它不是被动等你问,而是可以按时间调度、做周期性检查与提醒

一句话概括:OpenClaw 更像“个人级的 Agent OS/运行时”,而不是“更强的 Chatbot”。

那它和 Claude + Skills 的区别到底是什么?

如果你只比较“能不能调用工具”,Claude 本身当然很强,甚至更强。真正的区别在于:

Claude + Skills 是对话能力;OpenClaw 是系统能力。

1)Claude 的世界是“对话回合”,OpenClaw 的世界是“时间轴”

Claude Chatbot 的默认假设是:你现在问、它现在答,连续性主要靠当前对话上下文。你关掉页面、换个入口、隔一段时间再来,很多东西都要重新讲一遍,任务也容易“断”。

OpenClaw 把智能放进了时间轴:

你不在线,它也在;任务中断可以恢复;状态和记忆可以按规则加载;甚至可以按心跳或定时去跑一些“你没开口但系统该做”的检查与提醒。

这不是“更聪明”,而是更像一个能长期工作的系统。

2)Claude 的 Skills 是“模型临场调用”,OpenClaw 的 Skills 是“系统插件资产”

在 Claude Chatbot 里,Skills 很像模型的一组可选动作:模型决定调用哪个、参数怎么填、失败怎么处理。你可以通过提示词约束它,但本质仍是“模型即兴发挥”。

OpenClaw 把 Skills 当成系统的一等公民:

- 可以安装、管理、组合

- 可以形成能力库与生态

- 能把能力增长从“改提示词”迁移到“装插件/扩能力”

这会带来一个很现实的变化:当能力变多时,你不需要把所有东西塞进 prompt,也不必期待模型“永远记得怎么做”,而是让系统把能力以可管理的方式沉淀下来。

3)最关键的差异:OpenClaw 有一套“Agent 运行契约”

真正拉开差距的地方,是 OpenClaw 用一系列文件与规则,把模型当成一个“受控进程”来运行。它会明确规定:

- 每次会话如何“启动”:先加载什么身份信息、再加载什么用户信息、再加载哪一段记忆

- 记忆的边界:哪些记忆属于主会话,哪些场景(例如共享/群聊)绝对不能加载长期记忆,避免越界泄露

- 记忆的机制:重要信息不能靠“模型心里记住”,而要落到可追踪的文件与日志中

- 行为的边界:什么时候应该发言、什么时候应该保持沉默、什么时候需要先询问再执行

这件事非常关键,因为它改变了连续性的来源:

连续性不再依赖模型的“记性”,而依赖系统的“可审计状态”。

这也是为什么你会觉得“OpenClaw 看起来像 Claude,但又不只是 Claude”。

为什么 OpenClaw 能做到这些?看懂三个模块就够了

如果把 OpenClaw 的能力拆开看,你会发现它并不是用某个“超级 prompt”解决所有问题,而是靠模块化系统把问题分治掉。

第一块:Agents 设置——把“你是谁、你该记什么”制度化

它用类似 AGENTS 配置文件定义会话的启动流程、记忆的加载顺序、安全边界和行为约束。

这相当于给模型规定了一套“操作规程”:你每次醒来都按规程办事,而不是假装自己永远记得所有历史。

这一步带来的最大收益是:可控、可复现、可审计。

当系统出现异常行为,你能回溯“它读了什么、写了什么、在哪一步做了什么决策”,而不是陷入“模型怎么突然这样了”的黑盒解释。

第二块:Plugins/Skills——能力增长靠插件体系,而不是靠更长的提示词

当你想让 Agent 做更多事时,最危险的路径是:不断往 prompt 里塞规则、塞说明、塞例子。短期有效,长期一定崩——上下文会爆、行为会漂移、维护会失控。

OpenClaw 的思路是把能力模块化成插件/skills:

- 能力以代码和规范沉淀

- 系统提供统一的调用与返回

- 能力可以复用、可替换、可扩展

这会让系统的“增长方式”变得健康:增长靠能力资产,而不是靠提示词堆叠。

第三块:Channels——把 Agent 放进真实入口,并为“渠道差异”制定规则

很多人忽略了“渠道”带来的系统复杂度:

群聊和私聊不同;不同 App 的消息机制不同;有些场景你必须克制发言,否则就变成刷屏机器人;有些场景你必须沉默,避免误触发。

OpenClaw 把这些差异作为系统的一部分:

- 通过 Channel 接入多个入口

- 为不同入口制定行为规范与策略

- 让 Agent 更像“在真实世界社交和工作的实体”,而不是只活在一个网页里

再加上心跳/定时这类调度机制,它就从“你问我答”变成“我能自己跑时间轴”。

最后把这件事说透:OpenClaw 的独特优势是什么?

如果你只看“工具调用”,确实会觉得它和 Claude + Skills 很像。

但当你把关注点从“能不能调用”换成“能不能长期可靠地运行”,差异就非常清晰:

- Claude + Skills 更像“强大对话智能”

- OpenClaw 更像“把智能嵌入系统后的运行机制”

它的优势不是更聪明,而是更系统化:

用 Agent 运行契约管理身份与记忆边界,用插件体系管理能力增长,用多渠道接入真实入口,再用调度机制把时间轴跑起来。

你真正该用它来做什么判断?

如果你的目标只是“让 AI 帮我做一次事”,Claude Chatbot 往往就够了。

但如果你的目标是:

- 让它持续工作、跨会话不中断

- 让它在不同入口都能用

- 让能力可扩展、可管理

- 让行为可控、可回溯、可隔离

那你需要的就不只是一个强模型,而是一套像 OpenClaw 这样的Agentic System 运行框架。

OpenClaw 的意义就在这里:它把“能做事的 AI”从概念演示,推到了系统工程的范式里。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)