群体偏见攻击:信贷风控模型的隐形漏洞

在数字化金融时代,信贷风控模型依赖AI算法快速决策,但隐藏的群体偏见可能导致歧视性结果,如少数族裔或低收入群体被系统性拒贷。例如,30%通过率的样本训练模型时,KS值虽达20%,但全量测试时性能衰减至16%,暴露样本代表性不足问题。:如Patronus AI平台,基于RAG技术批量创建对抗样本(如伪造少数群体数据),测试模型在边缘场景的公平性断裂。未来,随着生成式AI普及,测试工具需进化至多智能体

在数字化金融时代,信贷风控模型依赖AI算法快速决策,但隐藏的群体偏见可能导致歧视性结果,如少数族裔或低收入群体被系统性拒贷。这种偏见不仅违背伦理,更构成安全漏洞——攻击者可利用数据偏差操纵模型输出,造成金融损失或声誉风险。对软件测试从业者而言,传统功能测试已不足够,公平性渗透测试(Fairness Penetration Testing)应运而生。它模拟恶意攻击者视角,主动挖掘模型中的群体偏见漏洞,确保系统公正性与鲁棒性。

一、漏洞成因:从数据到算法的连锁缺陷

群体偏见漏洞根源复杂,需测试者深入拆解:

-

数据层偏差:历史信贷数据常包含隐性歧视。例如,30%通过率的样本训练模型时,KS值虽达20%,但全量测试时性能衰减至16%,暴露样本代表性不足问题。攻击者可注入倾斜数据,放大特定群体(如特定地域用户)的拒贷率。

-

算法层缺陷:黑盒模型(如深度学习)决策不透明,易引入依赖特征偏见。测试显示,性别与贷款批准率在卡方检验中常呈显著关联(p<0.05),但模型内部机制难追溯。

-

部署层漏洞:动态环境中,模型迭代可能忽视公平性约束。例如,生成式AI在信用评分中若未嵌入正则化技术,会复刻历史歧视。

二、渗透测试工具链:实战化漏洞挖掘

针对上述漏洞,测试人员可部署专业化工具包,实现端到端审计:

-

偏见检测工具:

-

FairML:作为Python工具箱,它量化模型对输入特征的依赖度,无需源码访问。例如,通过

audit_model函数扫描信贷模型,输出特征权重热力图,直观识别种族或收入等敏感变量的过度影响。 -

SHAP解释器:结合

shap.KernelExplainer可视化决策路径。测试案例中,SHAP值分析揭示某些特征(如邮政编码)对低收入群体的负面权重,提示潜在歧视点。

-

-

攻击模拟框架:

-

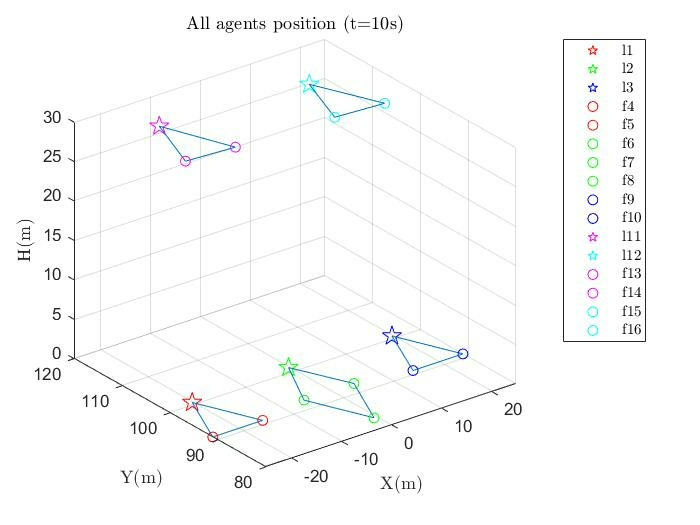

样本偏差注入工具:模拟通过率变化(如从30%降至10%),监测模型KS和PSI指标波动。PSI>0.25时,表明分布差异显著,易被攻击者利用制造“偏见盲区”。

-

对抗测试生成器:如Patronus AI平台,基于RAG技术批量创建对抗样本(如伪造少数群体数据),测试模型在边缘场景的公平性断裂。

-

-

评估指标矩阵:

综合四大核心指标,量化漏洞严重性:指标

说明

阈值(警戒值)

Demographic Parity

群体间批准率差异

>5% 需紧急修复

Equalized Odds

假阳性/假阴性率公平性

组间差异>0.1

PSI (Population Stability Index)

数据分布稳定性

>0.25 高风险

特征依赖度

FairML输出的中位数权重

>0.3 表示强偏见

三、测试流程:四步实战指南

软件测试团队可依此框架高效作业:

-

需求分析:定义敏感属性(如种族、性别),设定公平性目标(如demographic parity差异<3%)。

-

静态扫描:

-

使用FairML审计训练数据,生成特征依赖报告。

-

执行卡方检验代码(见示例),验证群体关联性:

from scipy.stats import chi2_contingency contingency_table = [[male_approved, male_rejected], [female_approved, female_rejected]] chi2, p, dof, expected = chi2_contingency(contingency_table) if p < 0.05: print("检测到显著性别偏见!")

-

-

动态攻击:

-

注入偏差数据,观察PSI变化。若PSI>0.25,标记为高危漏洞。

-

运行对抗测试,评估模型在间谍样本(spy samples)下的误判率。

-

-

修复验证:

-

集成正则化技术(如公平性约束层),重新测试指标。

-

持续监控生产环境,部署SHAP实时解释器。

-

四、行业启示:从测试到治理

公平性渗透测试不仅是技术任务,更是风险防控核心。成功案例显示,采用此类工具的企业能将偏见相关投诉降低40%。测试从业者应推动跨部门协作,例如:

-

开发阶段:要求嵌入偏见检测SDK,如Trade Ledger的SaaS工具,提升决策透明度。

-

合规层面:结合AI伦理指南(如欧盟AI法案),将公平性测试纳入CI/CD流水线。

未来,随着生成式AI普及,测试工具需进化至多智能体协作模式,以应对更复杂的偏见攻击向量。

精选文章:

更多推荐

已为社区贡献338条内容

已为社区贡献338条内容

所有评论(0)